工业仿真系统的制作方法

1.本公开实施例涉及智能电子设备技术领域,更具体地,涉及一种工业仿真系统。

背景技术:

2.工业仿真目前被很多企业广泛地应用到工业的各个环节,对企业提高开发效率,加强数据采集、分析、处理能力,减少决策失误,降低企业风险起到了重要的作用。

3.目前,工业仿真的主要形式是基于虚拟现实(virtual reality,vr)技术,vr技术通过计算机生成一种模拟环境,使用户沉浸到该环境中,使用此技术进行工业仿真可利用虚拟场景,配合特定的显示设备,为体验者营造一种身临其境的感觉。然而,但其完全是由计算机技术模拟出来的现实中的世界,体验者通过借助设备将用户的感官与现实世界分离开,无法感知周遭的真实环境,用户体验性低。

技术实现要素:

4.本公开实施例的一个目的是提供一种工业仿真系统的新的技术方案。

5.根据本公开实施例的第一方面,提供一种工业仿真系统,包括主机和头戴显示设备,所述主机和所述头戴显示设备通信连接,所述头戴显示器包括体感控制器,

6.所述主机,用于响应于搭建针对目标对象的三维场景的请求,搭建所述目标对象的三维场景,其中,所述三维场景中至少包括所述目标对象的三维模型;

7.所述体感控制器,用于在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,并将所述手部的三维空间位置信息发送至所述主机;

8.所述主机,用于根据所述手部的三维空间位置信息,控制所述三维模型在所述三维场景中模拟所述目标操作。

9.可选地,所述体感控制器,用于在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,具体包括:

10.在所述头戴显示设备的佩戴者针对所述目标对象执行目标操作的情况下,追踪所述佩戴者的手部运动信息;

11.根据所述手部运动信息,定位所述手部的多个关键点的三维空间位置信息;

12.根据所述手部的多个关键点的三维空间位置信息,确定所述佩戴者的手部的三维空间位置信息。

13.可选地,所述主机,用于响应于搭建针对目标对象的三维场景的请求,搭建所述目标对象的三维场景,具体包括:

14.响应于搭建针对目标对象的三维场景的请求,获取所述目标对象的初始三维模型及其对应的初始场景模型;

15.对所述初始三维模型进行模型开发,获得所述目标对象的三维模型;

16.对所述三维模型和所述初始场景模型进行逻辑开发,获得所述三维场景。

17.可选地,所述对所述初始三维模型进行模型开发包括:对所述初始三维模型的材质进行设置和/或对所述初始三维模型的ui控件进行设置。

18.可选地,所述佩戴者的手部绑定有第一碰撞体,所述目标对象上设置有第二碰撞体;

19.所述体感控制器,用于在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,并将所述手部的三维空间位置信息发送至所述主机;

20.所述主机,用于将所述手部的三维空间位置信息同步给所述第一碰撞体,并在所述头戴显示设备的佩戴者对所述目标对象执行目标操作,使得所述第一碰撞体和所述第二碰撞体发生碰撞的情况下,执行逻辑代码以展示操作结果。

21.可选地,所述头戴显示设备包括显示模块,

22.所述主机,还用于根据所述手部的三维空间位置信息,渲染出虚拟手,并将渲染出的虚拟手发送至所述显示模块;

23.所述显示模块,用于显示渲染出的虚拟手。

24.可选地,所述目标对象上设置有第一标识信息,所述头戴显示设备还包括摄像模块,

25.所述摄像模块,用于获取所述佩戴者所处真实场景的场景图像,并将所述场景图像发送至所述主机;

26.所述主机,用于识别出所述场景图像中的所述第一标识信息,获得所述目标对象的三维空间位置信息;以及,

27.根据所述目标对象的三维空间位置信息,确定所述目标对象的当前状态。

28.可选地,所述第一标识信息包括双色标识信息。

29.可选地,所述主机提供针对所述目标对象的培训模式、练习模式和考核模式中的至少一种模式;

30.其中,在所述培训模式下,所述主机提供针对所述目标对象所实施的操作的语音讲解;

31.在所述练习模式下,所述主机提供针对所述目标对象所实施的操作之间的操作顺序;

32.在所述考核模式下,所述主机提供针对所述目标对象所实施的操作的评分。

33.可选地,所述目标对象上设置有第二标识信息,所述头戴显示器还包括摄像模块和显示模块,

34.所述摄像模块,用于获取所述佩戴者所处真实场景的场景图像,并将所述场景图像发送至所述主机;

35.所述主机,用于识别出所述场景图像中的所述第二标识信息,并根据所述第二标识信息,将所述场景图像和所述三维场景进行融合,获得融合图像并输出至所述显示模块,

36.所述显示模块,用于显示所述融合图像。

37.本公开实施例的一个有益效果在于,其提供的工业仿真系统包括主机和头戴显示设备,该头戴显示设备上设置有体感控制器,该主机能够搭建针对目标对象的三维场景,该三维场景中包括该目标对象的三维模型,该体感控制器能够在使用者对目标对象执行目标

操作的情况下,确定该使用者的手部的三维空间位置信息并发送至主机,主机根据该手部的三维空间位置信息,控制三维模型在三维场景模拟目标操作。即,通过本工业仿真系统,在虚拟场景中配合真实部件进行操作可以显著提高实操实训真实感,能够有效克服真实环境训练中存在的问题,可有效提高培训效率,同时,增强了系统的体验感和使用者使用系统的积极性。

38.通过以下参照附图对本说明书的示例性实施例的详细描述,本说明书的其它特征及其优点将会变得清楚。

附图说明

39.被结合在说明书中并构成说明书的一部分的附图示出了本说明书的实施例,并且连同其说明一起用于解释本说明书的原理。

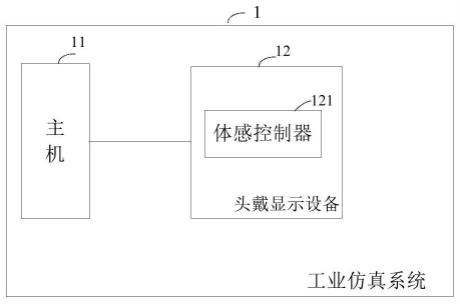

40.图1是根据本公开实施例的工业仿真系统的硬件配置示意图;

41.图2是根据本公开实施例的主机的工作示意图;

42.图3是根据本公开实施例的手部关键点的示意图;

43.图4是根据本公开实施例的渲染出的虚拟手的示意图;

44.图5是根据本公开实施例的目标对象的示意图;

45.图6是根据本公开另一实施例的目标对象的示意图;

46.图7是根据本公开另一实施例的工业仿真系统的硬件配置示意图;

47.图8是根据本公开另一实施例的目标对象的示意图。

具体实施方式

48.现在将参照附图来详细描述本公开的各种示例性实施例。应注意到:除非另外具体说明,否则在这些实施例中阐述的部件和步骤的相对布置、数字表达式和数值不限制本公开实施例的范围。

49.以下对至少一个示例性实施例的描述实际上仅仅是说明性的,决不作为对本公开及其应用或使用的任何限制。

50.对于相关领域普通技术人员已知的技术、方法和设备可能不作详细讨论,但在适当情况下,所述技术、方法和设备应当被视为说明书的一部分。。

51.在这里示出和讨论的所有例子中,任何具体值应被解释为仅仅是示例性的,而不是作为限制。因此,示例性实施例的其它例子可以具有不同的值。

52.应注意到:相似的标号和字母在下面的附图中表示类似项,因此,一旦某一项在一个附图中被定义,则在随后的附图中不需要对其进行进一步讨论。

53.《设备实施例》

54.请参见图1,其是本技术实施例提供的一种工业仿真系统的硬件结构示意图。如图1所示,该工业仿真系统1包括主机11和头戴显示设备12,主机11和头戴显示设备12通信连接,该头戴显示设备12包括体感控制器121。

55.其中,头戴显示设备12可以是增强现实(augmented reality,ar)设备,该ar设备采样视频透视式(video see through,vst)技术,vst是先由vr设备上的摄像模块获取真实场景的实时场景信息,然后与主机生成的虚拟信息相结合,再传入vr设备的显示模块输出

到佩戴者的眼部。通过vst技术,其能够保证佩戴者拥有足够的视场角,达到很好的体验效果;同时,通过vst技术,在传入人眼之前,将虚拟与现实进行良好结合,有效解决遮挡问题。当然,该头戴显示设备12还可以是其他设备,本实施例在此不做限定。

56.其中,头戴显示设备12上设置有体感控制器(leap motion)121,该体感控制器121能够捕捉头戴显示设备12的佩戴者的手部运动信息。

57.其中,主机11可以是为手机、平板电脑、笔记本电脑等,该主机11以cpu(central processing unit,中央处理器)或gpu(graphic processing unit,图形处理器)等作为运算器件,通过软件算法实现增强现实的各类应用。参照图2,该主机11上设置有vst开发引擎,该vst开发引擎能够搭建与真实场景中目标对象对应的三维场景。同时,主机11上安装有leap motion插件,通过该leap motion插件能够管理体感控制器121传递的数据,实现vst开发引擎与体感控制器之间的数据传递,进而使得虚拟手与真实手的对应。vst开发引擎还能够与摄像模块之间进行数据传递,进而进行目标对象的位置判定。

58.在本实施例中,主机11用于响应于搭建针对目标对象的三维场景的请求,搭建所述目标对象的三维场景。其中,所述三维场景中至少包括所述目标对象的三维模型。

59.在一个具体地实施例中,主机11,用于响应于搭建针对目标对象的三维场景的请求,搭建所述目标对象的三维场景,具体包括:响应于搭建针对目标对象的三维场景的请求,获取所述目标对象的初始三维模型及其对应的初始场景模型;对所述初始三维模型进行模型开发,获得所述目标对象的三维模型;对所述三维模型和所述初始场景模型进行逻辑开发,获得所述三维场景。

60.以上目标对象可以是头戴显示设备12的佩戴者当前所处真实场景中的对象,该目标对象为佩戴者实际操作的对象。该目标对象可以是零部件例如阀门、模温机温度调节器等。

61.具体的,参照图2,主机11上安装有solidworks软件和3dsmax软件,首先,通过solidworks软件可以对目标对象建立初始三维模型及其对应的初始场景模型,与此同时,可以根据实际操作过程简化模型面数。然后,通过3dsmax软件优化初始三维模型及其对应的初始场景模型,并将初始三维模型及其对应的初始场景模型导入vst开发引擎进行开发。其中,基于vst开发引擎进行开发分为两个阶段的开发,第一阶段为模型开发,第二阶段为模型逻辑开发。

62.对于模型开发,其涉及初始三维模型的模型开发和初始场景模型的模型开发,对于初始三维模型进行模型开发包括:对所述初始三维模型的材质进行设置和/或对所述初始三维模型的ui控件进行设置。当然,其还涉及对三维模型制作动画和特性、语音讲解等。对于初始场景模型进行模型开发包括:对初始场景模型的材质进行设置、对初始场景模型制作动画和特效等。可以理解的是,在本公开实施例中,其将进行模型开发后的目标对象的初始三维模型称之为目标对象的三维模型。

63.对于逻辑开发,其涉及对目标对象的三维模型的模型进行逻辑开发,例如建立ui控件与真实场景中目标对象的实际按钮控件之间的对应关系,建立ui控件之间的业务逻辑关系。其还涉及目标对象的三维模型和该进行模型开发后的初始场景模型之间的逻辑开发,例如建立目标对象的三维模型和该进行模型开发后的初始场景模型之间的交互关系、业务逻辑关系等。

64.示例性地,以目标对象2为图8所示阀门为例,先利用solidworks建立阀门的初始三维模型,以及建立与该阀门相连的管子和与管子相连的其他阀门的初始三维模型。然后基于3dsmax软件优化阀门的初始三维模型、与该阀门相连的管子和与管子相连的其他阀门的初始三维模型。最后,对该阀门的初始三维模型进行优化得到该阀门的三维模型,以及对该阀门相连的管子和与管子相连的其他阀门的初始三维模型进行优化,并对该阀门的三维模型的ui控件等交互逻辑进行开发,以及对该阀门的三维模型和进行优化后的该阀门相连的管子和与管子相连的其他阀门的初始三维模型之间的交互进行逻辑开发,进而得到该阀门的三维场景。

65.在本实施例中,体感控制器121,用于在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,并将所述手部的三维空间位置信息发送至所述主机。

66.在一个具体地实施例中,体感控制器121,用于在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,具体包括:在所述头戴显示设备的佩戴者对所述目标对象执行目标操作的情况下,追踪所述佩戴者的手部运动信息;根据所述手部运动信息,定位所述手部的多个关键点的三维空间位置信息;根据所述手部的多个关键点的三维空间位置信息,确定所述佩戴者的手部的三维空间位置信息。

67.具体地,在头戴显示设备12的佩戴者操作真实场景中的目标对象的情况下,体感控制器121便可获得视野范围内的手部运动信息,并根据该手部运动信息,定位21个手部关键点的三维空间位置信息,该21个手部关键点的三维空间位置信息参照图3所示。并根据该21个手部关键点的三维空间位置信息,确定佩戴者手部的三维空间位置信息。

68.在本实施例中,主机11,用于根据所述手部的三维空间位置信息,控制所述三维模型在所述三维场景模拟所述目标操作。

69.在一个具体地实施例中,所述佩戴者的手部绑定有第一碰撞体,所述目标对象上设置有第二碰撞体。

70.具体的,目标对象包括目标操作位置及相关目标ui控件,对应的,可以是在目标操作位置及相关目标ui控件等绑定有第二碰撞体。该第二碰撞体可以是图6所示的立方体碰撞体2和立方体碰撞体3。

71.具体的,佩戴者的手部指尖位置处绑定有第一碰撞体,第一碰撞体形状与指尖大小相符,第一碰撞体可以是图6所示的球型碰撞体1。例如可以是在佩戴者的中指指尖位置处绑定形状符合中指指尖大小的第一碰撞体。

72.本实施例中,体感控制器121,用于在所述佩戴者对所述目标对象执行目标操作的情况下,确定所述佩戴者的手部的三维空间位置信息,并将所述手部的三维空间位置信息发送至所述主机。

73.具体的,体感控制器在佩戴者对目标对象的目标操作位置执行目标操作的情况下,会获取佩戴者的手部的三维空间位置信息,其中,该手部的三维空间位置信息包括手部指尖位置信息。并将手部指尖位置信息发送至主机。

74.本实施例中,主机11,用于将所述手部的三维空间位置信息同步给所述第一碰撞体,并在所述头戴显示设备的佩戴者对所述目标对象执行目标操作,使得所述第一碰撞体

和所述第二碰撞体发生碰撞的情况下,执行逻辑代码以展示操作结果。

75.具体的,主机接收到佩戴者的手部的三维空间位置信息之后,便会将手部指尖位置信息同步至形状符合指尖大小的第一碰撞体,即,主机根据手部指尖位置信息控制第一碰撞体的位置,以便在佩戴者对目标对象执行目标操作,使得第一碰撞体和目标操作位置的第二碰撞体发生碰撞的情况下,执行逻辑判断以展示操作结果。

76.示例性地,以目标对象2为图5所示模温机温度调节器为例,如图6所示,在控制升温功能的按钮上添加立方体碰撞体2,以及在控制降温功能的按钮上添加立方体碰撞体3。

77.例如,当佩戴者通过真实手点击真实场景中模温机温度调节器的降温按钮时,通过佩戴的体感控制器131将佩戴者的手部的三维位置信息发送至主机11。主机11将指尖位置信息赋予给与指尖相符大小的球型碰撞体,这里球型碰撞体即为碰撞体1,实现碰撞体1始终与指尖的坐标位置同步。当指尖与升温按钮接触时,主机11进行碰撞检测,并在该碰撞体1与升温按钮对应的立方体碰撞体2发生碰撞的情况下,执行碰撞逻辑实现虚拟温度的上升。

78.本实施例中,参照图7,头戴显示设备12还包括显示模块123。

79.所述主机11,还用于根据所述手部的三维空间位置信息,渲染出虚拟手,并将渲染出的虚拟手发送至所述显示模块。

80.所述显示模块123,用于显示渲染出的虚拟手。

81.继续上述示例,当佩戴者通过真实手点击真实场景中模温机温度调节器的降温按钮时,通过佩戴的体感控制器131将佩戴者的手部的三维位置信息发送至主机11。主机会根据手部的三维空间位置信息渲染出虚拟手,渲染出的虚拟手参照图4所示。

82.根据本技术实施例,其提供的工业仿真系统包括主机和头戴显示设备,该头戴显示设备上设置有体感控制器,该主机能够搭建针对目标对象的三维场景,该三维场景中包括该目标对象的三维模型,该体感控制器能够在使用者对目标对象执行目标操作的情况下,确定该使用者的手部的三维空间位置信息并发送至主机,主机根据该手部的三维空间位置信息,控制三维模型在三维场景模拟目标操作。即,通过本工业仿真系统,在虚拟场景中配合真实部件进行操作可以显著提高实操实训真实感,能够有效克服真实环境训练中存在的问题,可有效提高培训效率,同时,增强了体验感和使用者使用系统的积极性。

83.在一个实施例中,目标对象2上还设置有第一标识信息,该第一标识信息可以为双色标识信息。参照图8,目标对象2为阀门,该阀门的第一标识信息可以是在该阀门上设置的第一颜色21和第二颜色22,其中,该第一颜色和第二颜色为不同颜色,例如,该第一颜色可以为红色,该第二颜色可以为蓝色,通过该第一颜色和第二颜色,可以将阀门与真实场景中的其他对象例如管子和其他阀门进行区分,方便追踪和定位。

84.参照图7,头戴显示设备12还包括摄像模块122,该摄像模块122可以是双目摄像头。

85.本实施例中,摄像模块122,用于获取所述佩戴者所处真实场景的场景图像,并将所述场景图像发送至所述主机。

86.本实施例中,主机11,用于识别出所述场景图像中的所述第一标识信息,获得所述目标对象的三维空间位置信息;以及,根据所述目标对象的三维空间位置信息,确定所述目标对象的当前状态。

87.示例性地,继续以图8所示阀门为例,摄像模块122获取阀门所在真实场景的场景图像并发送至主机11。主机11检测追追踪场景图像中阀门的第一标识信息,并计算阀门的三维空间位置信息,进而根据该三维空间位置信息,判断佩戴者操作是否正确。

88.根据本技术实施例,其发明采用人工标识进行跟踪,依靠标识特定的颜色等特征达到快速、准确的跟踪目的。通过人工标识来识别实物位姿比以往通过传感器和追踪器进行位姿获取的方法,大大缩减了软件开发的成本。

89.在一个实施例中,目标对象2上还设置有第二标识信息,该第二标识信息不同于第一标识信息。

90.本实施例中,所述摄像模块122,用于获取所述佩戴者所处真实场景的场景图像,并将所述场景图像发送至所述主机11。

91.本实施例中,所述主机11,用于识别出所述场景图像中的所述第二标识信息,并根据所述第二标识信息,将所述视频图像和所述三维场景进行融合,获得融合图像并输出至所述显示模块。

92.具体的,三维注册技术是实现虚拟世界坐标系与现实世界坐标系的对准,将虚拟环境和真实环境中的信息映射到“同一空间”。常见的三维注册方法有基于硬件传感器的跟踪注册技术,然而,其硬件设备成本较高,本公开实施例采样基于人工标志物的三维注册方法。该基于人工标志物的三维注册方法是基于主机识别场景图像中的第二标志信息,进而根据该第二标识信息,将视频图像和三维场景的信息映射到同一空间得到融合图像并输出至显示模块。

93.本实施例中,所述显示模块123,用于显示所述融合图像。

94.根据本公开实施例,该工业仿真系统基于视频透视技术,即通过视频合成技术,将摄像模块采集到的现实画面和计算机生成的数字画面融合在一起,能实现更大的视角范围。同时,通过vst技术,将内容直接通过视频展示,对定位精度要求低,在传入人眼之前,将虚拟与现实进行良好结合,有效解决遮挡问题。

95.在一个实施例中,主机11还提供针对所述目标对象的培训模式、练习模式和考核模式中的至少一种模式。

96.其中,在所述培训模式下,所述主机提供针对所述目标对象所实施的操作的语音讲解;

97.在所述练习模式下,所述主机提供针对所述目标对象所实施的操作之间的操作顺序;

98.在所述考核模式下,所述主机提供针对所述目标对象所实施的操作的评分。

99.本实施例中,主机11提供有选择接口,佩戴者可以根据实际需要选择培训模式、练习模式和考核模式中的一种模式作为本次的目标模式,进而在该目标模式下实现真实场景和虚拟场景的交互。

100.根据本技术实施例,其能够提供培训模式、练习模式和考核模式这三种不同模式,在每一种模式实现下均能实现真实场景和虚拟场景的交互,达到直接自然、沉浸式体验好、操作效率高的目的。

101.在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示意性实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结

构、材料或者特点包含于本技术的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不一定指的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任何的一个或多个实施例或示例中以合适的方式结合。

102.尽管已经示出和描述了本技术的实施例,本领域的普通技术人员可以理解:在不脱离本技术的原理和宗旨的情况下可以对这些实施例进行多种变化、修改、替换和变型,本技术的范围由权利要求及其等同物限定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1