特征提取模型的训练方法、装置、设备、介质及程序产品与流程

1.本技术涉及人工智能技术,尤其涉及一种特征提取模型的训练方法、装置、电子设备、计算机可读存储介质及计算机程序产品。

背景技术:

2.在传统的纵向联邦场景下,所有参与方设备只能基于各参与方设备对齐的有标签的训练样本进行有监督的联合建模。然而,实际场景中,由于标签数据较难获得,各参与方设备只有少量的训练样本存在标签;同时,由于参与方设备各自场景不同,所以各参与方设备的对齐样本的数量可能更少,这就导致最后各参与方能够用于联合建模的、对齐的、带标签的训练样本的数量偏少,从而影响联合建模的效果。

技术实现要素:

3.本技术实施例提供一种特征提取模型的训练方法、装置、电子设备、计算机可读存储介质及计算机程序产品,能够提高基于联邦架构下的特征提取模型的精确性。

4.本技术实施例的技术方案是这样实现的:

5.本技术实施例提供一种特征提取模型的训练方法,基于联邦学习系统,所述联邦学习系统包括协作方设备及至少两个参与方设备,所述方法应用于第一参与方设备,所述方法包括:

6.通过第一特征提取模型,对所述第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征;

7.接收第二参与方设备发送的第二用户特征,所述第二用户特征为,所述第二参与方设备通过第二特征提取模型,对本地的第二训练用户样本进行特征提取得到的用户特征;

8.其中,所述第二训练用户样本与所述第一训练用户样本在目标维度的维度信息相同,所述第一用户特征与所述第二用户特征存在部分相同;

9.基于所述第一用户特征以及所述第二用户特征,采用对比学习的方式,确定所述第一特征提取模型的损失;

10.基于所述损失,通过所述协作方设备,采用横向联邦学习的方式更新所述第一特征提取模型的模型参数。

11.本技术实施例提供一种特征提取模型的训练装置,基于联邦学习系统,所述联邦学习系统包括协作方设备及至少两个参与方设备,所述装置应用于第一参与方设备,包括:

12.特征提取模块,用于通过第一特征提取模型,对所述第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征;

13.接收模块,用于接收第二参与方设备发送的第二用户特征,所述第二用户特征为,所述第二参与方设备通过第二特征提取模型,对本地的第二训练用户样本进行特征提取得到的用户特征;其中,所述第二训练用户样本与所述第一训练用户样本在目标维度的维度

信息相同,所述第一用户特征与所述第二用户特征存在部分相同;

14.对比学习模块,用于基于所述第一用户特征以及所述第二用户特征,采用对比学习的方式,确定所述第一特征提取模型的损失;

15.更新模块,用于基于所述损失,通过所述协作方设备,采用横向联邦学习的方式更新所述第一特征提取模型的模型参数。

16.上述方案中,所述更新模块,还用于将所述损失发送至所述协作方设备,以使所述协作方设备对各个参与方设备发送的损失进行聚合,得到目标损失;接收所述协作方设备返回的所述目标损失,并基于所述目标损失更新所述第一特征提取模型的模型参数。

17.上述方案中,所述更新模块,还用于对所述损失进行隐私保护,得到隐私保护后的加密损失;发送隐私保护后的所述加密损失至协作方设备,以使所述协作方设备对多个参与方设备发送的所述加密损失进行聚合处理,得到所述目标损失。

18.上述方案中,所述更新模块,还用于基于所述损失更新所述第一特征提取模型的模型参数,得到更新后的第一特征提取模型;将所述更新后的第一特征提取模型的第一模型参数发送至所述协作方设备,以使所述协作方设备对所述第一模型参数及第二参与方设备发送的第二模型参数进行聚合,得到聚合模型参数;其中,所述第二模型参数为,更新后的所述第二特征提取模型的模型参数;利用所述聚合模型参数更新所述第一特征提取模型的模型参数。

19.上述方案中,所述装置还包括预训练模块,所述预训练模块,用于对所述第一训练用户样本进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本;通过初始特征提取模型,对所述第一增强训练用户样本以及所述第二增强训练用户样本分别进行特征提取,得到对应所述第一增强训练用户样本的第一增强特征、以及对应所述第二增强训练用户样本的第二增强特征;基于所述第一增强特征以及所述第二增强特征,采用对比学习的方式训练所述初始特征提取模型,得到所述第一特征提取模型。

20.上述方案中,所述预训练模块,还用于当所述第一训练用户样本的数量为至少两个时,对至少两个所述第一训练用户样本中一个进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本;通过初始特征提取模型,对所述第一增强训练用户样本、所述第二增强训练用户样本、以及未经过数据增强的第一训练用户样本分别进行特征提取,得到对应所述第一增强训练用户样本的第一增强特征、对应所述第二增强训练用户样本的第二增强特征、以及对应未经过数据增强的第一训练用户样本的第三特征;确定所述第一增强特征与所述第二增强特征之间的相似度、以及所述第一增强特征与所述第三特征之间的相似度;基于所述第一增强特征与所述第二增强特征之间的相似度、以及所述第一增强特征与所述第三特征之间的相似度,更新所述初始特征提取模型的模型参数,得到所述第一特征提取模型。

21.上述方案中,所述第二训练用户样本存在至少两个,所述对比学习模块,还用于获取所述第一训练用户样本的第一样本标识、以及各所述第二训练用户样本的第二样本标识;基于所述第一样本标识以及所述第二样本标识,从至少两个第二训练用户样本中,选取样本标识与所述第一样本标识相同的第二训练用户样本,作为所述第一训练用户样本对应的正样本,并选取样本标识与所述第一样本标识不同的第二训练用户样本,作为所述第一训练用户样本对应的负样本;确定所述正样本对应的第二用户特征与所述第一用户特征的

第一相似度,并确定所述负样本对应的第二用户特征与所述第一用户特征的第二相似度;结合所述第一相似度及所述第二相似度,确定所述第一特征提取模型的损失。

22.上述方案中,所述装置包括后训练模块,所述后训练模块,用于获取训练完成的第一特征提取模型;通过所述训练完成的第一特征提取模型,对本地携带标签的第三训练用户样本进行特征提取,得到目标特征;获取所述目标特征与所述标签之间的差异,并基于所述差异更新所述训练完成的第一特征提取模型的模型参数。

23.上述方案中,所述装置包括样本对齐模块,所述样本对齐模块,用于获取所述第一参与方设备本地的训练用户样本、以及所述第二参与方设备本地的训练用户样本;对所述第一参与方设备本地的训练用户样本、以及所述第二参与方设备本地的训练用户样本进行样本对齐,得到所述第一训练用户样本以及所述第二训练用户样本。

24.本技术实施例提供一种电子设备,包括:

25.存储器,用于存储可执行指令;

26.处理器,用于执行所述存储器中存储的可执行指令时,实现本技术实施例提供的特征提取模型的训练方法。

27.本技术实施例提供一种计算机可读存储介质,存储有可执行指令,用于引起处理器执行时,实现本技术实施例提供的特征提取模型的训练方法。

28.本技术实施例提供一种计算机程序产品,包括计算机程序,该计算机程序被处理器执行时实现本技术实施例提供的特征提取模型的训练方法。

29.本技术实施例具有以下有益效果:

30.相较于相关技术中采用有标签的训练用户样本对特征提取模型进行训练的方式,本技术实施例首先利用纵向联邦学习,即第一参与方设备通过将依据本地的训练用户样本提取的第一用户特征,与第二参与方设备发送的、依据第二参与方设备本地的训练用户样本所提取的第二用户特征,进行对比学习以得到损失,再通过协作方设备,结合横向联邦学习的方式来更新特征提取模型的模型参数。如此,在混合联邦学习的架构下,通过采用对比学习的方式,利用各参与方设备本地的训练用户样本对特征提取模型进行训练,由于无需考虑训练用户样本是否携带标签,保证了模型的训练用户样本充足,在提高特征提取模型的精确性的同时,提高了模型的训练效率。

附图说明

31.图1是本技术实施例提供的特征提取模型的训练方法的实施场景示意图;

32.图2是本技术实施例提供的电子设备的结构示意图;

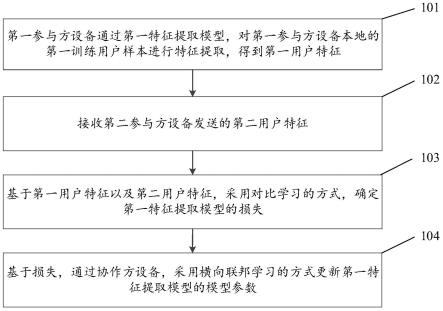

33.图3是本技术实施例提供的特征提取模型的训练方法的流程示意图;

34.图4是本技术实施例提供的对第一特征提取模型进行预训练的流程示意图;

35.图5本技术实施例提供的对第一特征提取模型进行预训练的过程示意图;

36.图6是本技术实施例提供的对第一特征提取模型进行预训练的流程示意图;

37.图7是本技术实施例提供的通过协作方设备采用横向联邦学习的方式更新第一特征提取模型的模型参数的示意图;

38.图8是本技术实施例提供的通过协作方设备采用横向联邦学习的方式更新第一特征提取模型的模型参数的示意图;

39.图9是本技术实施例提供的种特征提取模型的训练方法的一个可选的流程示意图;

40.图10是本技术实施例提供的特征提取模型的训练装置的结构示意图。

具体实施方式

41.为了使本技术的目的、技术方案和优点更加清楚,下面将结合附图对本技术作进一步地详细描述,所描述的实施例不应视为对本技术的限制,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

42.在以下的描述中,涉及到“一些实施例”,其描述了所有可能实施例的子集,但是可以理解,“一些实施例”可以是所有可能实施例的相同子集或不同子集,并且可以在不冲突的情况下相互结合。

43.在以下的描述中,所涉及的术语“第一\第二\第三”仅仅是区别类似的对象,不代表针对对象的特定排序,可以理解地,“第一\第二\第三”在允许的情况下可以互换特定的顺序或先后次序,以使这里描述的本技术实施例能够以除了在这里图示或描述的以外的顺序实施。

44.除非另有定义,本文所使用的所有的技术和科学术语与属于本技术的技术领域的技术人员通常理解的含义相同。本文中所使用的术语只是为了描述本技术实施例的目的,不是旨在限制本技术。

45.对本技术实施例进行进一步详细说明之前,对本技术实施例中涉及的名词和术语进行说明,本技术实施例中涉及的名词和术语适用于如下的解释。

46.1)联邦机器学习(federated machine learning/federated learning),又名联邦学习,联合学习,联盟学习,是指通过联合不同的参与者(participant,或者party,也称为数据拥有者(data owner),或者客户(client))进行机器学习的方法。在联邦学习中,参与者并不需要向其它参与者和协调者(coordinator,也称为参数服务器(parameter server),或者聚合服务器(aggregation server))暴露自己拥有的数据,因而联邦学习可以很好的保护用户隐私和保障数据安全。

47.联邦学习(federated learning,a.k.a.federated machine learning)可以分为三类:横向联邦学习(horizontal federated learning),纵向联邦学习(vertical federated learning),联邦迁移学习(federated transfer learning)。

48.其中,横向联邦学习也称为特征对齐的联邦学习(feature-aligned federated learning),即横向联邦学习的参与者的数据特征是对齐的,适用于参与者的数据特征重叠较多,而样本标识(id,identity document)重叠较少的情况,即在各个参与者的用户特征重叠较多,而用户样本重叠较少的情况下,取出参与者数据特征相同而用户不完全相同的那部分数据进行联合机器学习。比如有两家不同地区的银行,它们的用户群体分别来自各自所在的地区,相互的交集很小。但是它们的业务相似,记录的用户数据特征很大部分是相同的。可以使用横向联邦学习来帮助两家银行构建联合模型来预测他们的客户行为。

49.纵向联邦学习也称为样本对齐的联邦学习(sample-aligned federated learning),纵向联邦学习的参与者的训练用户样本是对齐的,适用于参与者训练用户样本id重叠较多,而数据特征重叠较少的情况,即在参与者的用户特征重叠较小,而用户样本重

叠较多的情况下,取出参与者用户相同而用户数据特征不同的那部分用户及数据进行联合机器学习训练。比如有属于同一个地区的两个参与者a和b,其中参与者a是一家银行,参与者b是一个电商平台。参与者a和b在同一地区拥有较多相同的用户,但是a与b的业务不同,记录的用户数据特征是不同的。特别的,a和b记录的用户数据特征可能是互补的。在这样的场景下,可以使用纵向联邦学习来帮助a和b构建联合机器学习预测模型,帮助a和b向客户提供更好的服务。

50.2)同态加密(he,homomorphic encryption),是一种对称加密算法,由ibm的craiggentry在2009年提出。同态加密的目的是找到一种加密算法,这种加密算法能够在密文上执行加法、乘法运算,使得对加密后的密文进行某种操作所得到的结果,恰好等于对加密前的明文进行预期操作后再加密得到的密文。同态加密有效保证了数据处理方可以直接对数据的密文进行相应的处理,而无法获知其所处理的数据明文信息。同态加密的这一特性使用户的数据和隐私可以得到相应的安全保障,因此,同态加密被应用于许多现实场景来保证数据的安全。

51.如果一个加密函数同时满足加法同态和乘法同态,称为全同态加密。使用这个加密函数可以完成各种加密后的运算(加减乘除、多项式求值、指数、对数、三角函数等)。

52.3)对比学习(contrastive learning),是一种为机器学习模型描述相似和不同事物的任务的方法,利用这种方法,可以训练机器学习模型来区分相似和不同的图像。对比式学习着重于学习同类实例之间的共同特征,区分非同类实例之间的不同之处。与生成式学习比较,对比式学习不需要关注实例上繁琐的细节,只需要在抽象语义级别的特征空间上学会对数据的区分即可,因此模型以及其优化变得更加简单,且泛化能力更强。对比学习的目标是学习一个编码器,此编码器对同类数据进行相似的编码,并使不同类的数据的编码结果尽可能的不同。

53.在传统的纵向联邦场景下,所有参与方只能基于各参与方设备对齐的有标签样本进行有监督的联合建模。然而,实际场景中,由于标签数据较难获得,参与方只有少量的有标签样本数据。同时,由于参与方设备各自场景不同,参与方设备的对齐样本数量可能更少,这就导致最后各参与方设备能够用于联合建模的对齐的带标签样本数据偏少,从而影响联合建模的效果。

54.基于此,本技术实施例提供一种特征提取模型的训练方法、装置、电子设备、计算机可读存储介质以及计算机程序产品,能够有效利用对齐的样本数据以及各个参与方本地的(有标签和无标签)样本数据进行联合训练,优化各个参与方设备的本地特征提取模型,然后各个参与方设备基于各自优化后的特征提取模型在少量的本地有标签样本上进行有监督的训练,可极大提升各个参与方本地模型的性能。

55.基于上述对本技术实施例中涉及的名词和术语的解释,下面说明本技术实施例提供的基于联邦学习系统的多分类梯度提升树构建方法的实施场景,参见图1,图1是本技术实施例提供的特征提取模型的训练方法的实施场景示意图,为实现支撑一个示例性应用,第一参与方设备200-1通过网络300-1连接第二参与方设备200-2,协作方设备400通过网络300-2连接第一参与方设备200-1和第二参与方设备200-2,其中第一参与方设备200-1和第二参与方设备200-2可以是持有训练用户样本的机构,例如可以是医院、银行、商场或超市,协作方设备400可以是具有公信力的机构,第一参与方设备200-1、第二参与方设备200-2以

及协作方设备400互相协助进行联邦学习以使第一参与方设备200-1得到特征提取模型,网络300-1以及300-2可以是广域网或者局域网,又或者是二者的组合,使用无线或有线链路实现数据传输。

56.其中,第一参与方设备(包括第一参与方设备200-1),用于通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征;

57.第二参与方设备(包括第二参与方设备200-2),用于通过第二特征提取模型,对本地的第二训练用户样本进行特征提取得到第二用户特征,并将第二用户特征发送至第一参与方设备;其中,第二训练用户样本与第一训练用户样本在目标维度的维度信息相同,第一用户特征与第二用户特征存在部分相同;

58.第一参与方设备(包括第一参与方设备200-1),还用于基于第一用户特征以及第二用户特征,采用对比学习的方式,确定第一特征提取模型的损失,并基于损失,通过协作方设备(包括协作方设备400),采用横向联邦学习的方式更新第一特征提取模型的模型参数。

59.在实际应用中,协作方设备400、第一参与方设备200-1和第二参与方设备200-2可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(cdn,content deliver network)、以及大数据和人工智能平台等基础云计算服务的云服务器。协作方设备400和第一参与方设备200-1、第二参与方设备200-2同样可以是智能手机、平板电脑、笔记本电脑、台式计算机、智能音箱、智能手表等,但并不局限于此。协作方设备400、第一参与方设备200-1和第二参与方设备200-2可以通过有线或无线通信方式进行直接或间接地连接,本技术在此不做限制。

60.下面对本技术实施例提供的实施特征提取模型的训练方法的电子设备的硬件结构做详细说明,电子设备包括但不限于服务器或终端。参见图2,图2是本技术实施例提供的电子设备的结构示意图,图2所示的电子设备200包括:至少一个处理器210、存储器250、至少一个网络接口220和用户接口230。电子设备200中的各个组件通过总线系统240耦合在一起。可以理解的是,总线系统240用于实现这些组件之间的连接通信。总线系统240除包括数据总线之外,还包括电源总线、控制总线和状态信号总线。但是为了清楚说明起见,在图2中将各种总线都标为总线系统240。

61.处理器210可以是一种集成电路芯片,具有信号的处理能力,例如通用处理器、数字信号处理器(dsp,digital signal processor),或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等,其中,通用处理器可以是微处理器或者任何常规的处理器等。

62.用户接口230包括使得能够呈现媒体内容的一个或多个输出装置231,包括一个或多个扬声器和/或一个或多个视觉显示屏。用户接口230还包括一个或多个输入装置232,包括有助于用户输入的用户接口部件,比如键盘、鼠标、麦克风、触屏显示屏、摄像头、其他输入按钮和控件。

63.存储器250可以是可移除的,不可移除的或其组合。示例性的硬件设备包括固态存储器,硬盘驱动器,光盘驱动器等。存储器250可选地包括在物理位置上远离处理器210的一个或多个存储设备。

64.存储器250包括易失性存储器或非易失性存储器,也可包括易失性和非易失性存储器两者。非易失性存储器可以是只读存储器(rom,read only memory),易失性存储器可以是随机存取存储器(ram,random access memory)。本技术实施例描述的存储器250旨在包括任意适合类型的存储器。

65.在一些实施例中,存储器250能够存储数据以支持各种操作,这些数据的示例包括程序、模块和数据结构或者其子集或超集,下面示例性说明。

66.操作系统251,包括用于处理各种基本系统服务和执行硬件相关任务的系统程序,例如框架层、核心库层、驱动层等,用于实现各种基础业务以及处理基于硬件的任务;

67.网络通信模块252,用于经由一个或多个(有线或无线)网络接口220到达其他计算设备,示例性的网络接口220包括:蓝牙、无线相容性认证(wifi)、和通用串行总线(usb,universal serial bus)等;

68.输入处理模块253,用于对一个或多个来自一个或多个输入装置232之一的一个或多个用户输入或互动进行检测以及翻译所检测的输入或互动。

69.在一些实施例中,本技术实施例提供的多分类梯度提升树的构建装置可以采用软件方式实现,图2示出了存储在存储器250中多分类梯度提升树的构建装置254,其可以是程序和插件等形式的软件,包括以下软件模块:特征提取模块2541、接收模块2542、对比学习模块2543和更新模块2544,这些模块是逻辑上的,因此根据所实现的功能可以进行任意的组合或进一步拆分,将在下文中说明各个模块的功能。

70.在另一些实施例中,本技术实施例提供的特征提取模型的训练装置可以采用软硬件结合的方式实现,作为示例,本技术实施例提供的特征提取模型的训练装置可以是采用硬件译码处理器形式的处理器,其被编程以执行本技术实施例提供的特征提取模型的训练方法,例如,硬件译码处理器形式的处理器可以采用一个或多个应用专用集成电路(asic,application specific integrated circuit)、dsp、可编程逻辑器件(pld,programmable logic device)、复杂可编程逻辑器件(cpld,complex programmable logic device)、现场可编程门阵列(fpga,field-programmable gate array)或其他电子元件。

71.基于上述对本技术实施例的特征提取模型的训练方法的实施场景及电子设备的说明,下面说明本技术实施例提供的特征提取模型的训练方法。参见图3,图3是本技术实施例提供的特征提取模型的训练方法的流程示意图,本技术实施例提供的特征提取模型的训练方法包括:

72.步骤101,第一参与方设备通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征。

73.在实际实施时,第一参与方设备首先获取本地的第一训练用户样本,这里,第一训练用户样本为第一参与方设备持有的本地用户,第一训练用户样本可以是携带标签的样本,也可以是不携带标签的样本,而第一用户特征可以是用户的特征数据,标签可以是相应用户的真实特征数据。

74.需要说明的是,第一用户特征至少包括第一业务特征以及基础特征,第一业务特征对应第一业务,第一业务为对应第一参与方设备的业务。作为示例,第一参与方设备可以是银行、超市、互联网公司、学校、医院等机构中至少之一,当第一参与方设备为银行、第二参与方设备为第二参与方设备为超市时,第一业务可以是用户在银行有过的储蓄业务或者

贷款业务等,第一用户特征包括但不限于用户的姓名、性别、年龄、学历、职业、贷款金额、贷款时间、还款金额、还款时间、储蓄金额及逾期还款数据等,其中,第一业务特征包括但不限于用户的贷款金额、贷款时间、还款金额、还款时间、储蓄金额及逾期还款数据等,而基础特征包括但不限于用户的姓名、性别、年龄、学历、职业等,而第一用户特征中的基础特征包括但不限于用户的姓名、性别、年龄、学历、职业等。

75.在实际实施时,在第一参与方设备通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征之前,第一参与方设备首先需要对第一特征提取模型行预训练,具体地,获取初始特征提取模型以及第一参与方设备本地的第一训练用户样本,基于第一训练用户样本,采用对比学习的方式,确定初始特征提取模型的损失,并基于损失对初始特征提取模型的模型参数进行更新,当完成预设轮次的训练后,得到第一特征提取模型。需要说明的是,这里采用对比学习的方式,对第一特征提取模型进行预训练的过程存在两种,接下来,这两种过程进行说明。

76.在一些实施例中,参见图4,图4是本技术实施例提供的对第一特征提取模型进行预训练的流程示意图,基于图4,在步骤101之前,本技术实施例提供的特征提取模型的训练方法还包括:

77.步骤201,第一参与方设备对第一训练用户样本进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本。

78.在实际实施时,对第一训练用户样本进行数据增强的方式可以存在多种,示例性地,可以是在保证数据增强结果的有效性的前提下,对第一训练用户样本添加噪声,又或者可以是通过确定第一训练用户样本的数据分布,采样新数据作为增强数据,对于对第一训练用户样本进行数据增强的方式,本技术实施例不做限制。

79.步骤202,通过初始特征提取模型,对第一增强训练用户样本以及第二增强训练用户样本分别进行特征提取,得到对应第一增强训练用户样本的第一增强特征、以及对应第二增强训练用户样本的第二增强特征。

80.在实际实施时,首先对初始特征提取模型进行复制,得到复制特征提取模型,然后固定住复制特征提取模型的模型参数,从而保证复制特征提取模型不进行模型参数的更新;然后通过初始特征提取模型,对第一增强训练用户样本进行特征提取,得到对应第一增强训练用户样本的第一增强特征,并通过复制特征提取模型,对第二增强训练用户样本进行特征提取,得到对应第二增强训练用户样本的第二增强特征。

81.需要说明的是,在一些实施例中,也可以不固定住复制特征提取模型的模型参数,从而使复制特征提取模型同样进行模型参数的更新,对此,本技术实施例不做限制。

82.步骤203,基于第一增强特征以及第二增强特征,采用对比学习的方式训练初始特征提取模型,得到第一特征提取模型。

83.在实际实施时,基于第一增强特征以及第二增强特征,采用对比学习的方式训练初始特征提取模型,得到第一特征提取模型的过程,具体为,首先确定第一增强特征以及第二增强特征之间的相似度,然后获取预先设定的对比学习损失函数,即

[0084][0085]

其中,公式(1)中的u为第一增强特征,v

+

为第二增强特征,τ为一个超参数。

[0086]

然后基于第一增强特征和第二增强特征之间的相似度、以及获取的对比学习损失函数,确定对应初始特征提取模型的损失,并基于损失更新初始特征提取模型的模型参数,以得到第一特征提取模型。

[0087]

示例性地,参见图5,图5本技术实施例提供的对第一特征提取模型进行预训练的过程示意图,基于图5,第一参与方设备对训练用户样本x进行数据增强,得到第一增强训练用户样本x1以及第二增强训练用户样本x2;然后获取初始特征提取模型即特征提取模型a,并对特征提取模型a进行复制,得到复制特征提取模型即特征提取模型ac,接着固定住特征提取模型ac的模型参数,通过特征提取模型a,对x1进行特征提取,得到第一增强特征f,并通过特征提取模型ac,对x2进行特征提取,得到对第二增强特征fc;然后确定f以及fc之间的相似度,并获取预设的对比学习损失函数,基于f以及fc之间的相似度、以及获取的对比学习损失函数,确定对应初始特征提取模型的损失,并基于损失更新初始特征提取模型的模型参数,以得到第一特征提取模型。

[0088]

在一些实施例中,当第一训练用户样本的数量为多个时,参见图6,图6是本技术实施例提供的对第一特征提取模型进行预训练的流程示意图,基于图6,在步骤101之前,本技术实施例提供的特征提取模型的训练方法还包括:

[0089]

步骤301,当第一训练用户样本的数量为至少两个时,第一参与方设备对至少两个第一训练用户样本中一个进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本。

[0090]

在实际实施时,当第一训练用户样本的数量为多个时,第一参与方设备首先从多个第一训练用户样本中选取一个训练用户样本,并对选取得到的这个训练用户样本进行新建增强,得到第一增强训练用户样本以及第二增强训练用户样本。

[0091]

步骤302,通过初始特征提取模型,对第一增强训练用户样本、第二增强训练用户样本、以及未经过数据增强的第一训练用户样本分别进行特征提取,得到对应第一增强训练用户样本的第一增强特征、对应第二增强训练用户样本的第二增强特征、以及对应未经过数据增强的第一训练用户样本的第三特征。

[0092]

在实际实施时,首先对初始特征提取模型进行复制,得到第一复制特征提取模型以及第二复制特征提取模型,然后固定住第一复制特征提取模型以及第二复制特征提取模型的模型参数,从而保证第一复制特征提取模型以及第二复制特征提取模型不进行模型参数的更新;然后通过初始特征提取模型,对第一增强训练用户样本进行特征提取,得到对应第一增强训练用户样本的第一增强特征,并通过第一复制特征提取模型,对第二增强训练用户样本进行特征提取,得到对应第二增强训练用户样本的第二增强特征,同时通过第二复制特征提取模型,对未经过数据增强的第一训练用户样本分别进行特征提取,对应未经过数据增强的第一训练用户样本的第三特征。

[0093]

需要说明的是,在一些实施例中,也可以不固定住第一复制特征提取模型和/或第

二复制特征提取模型的模型参数,从而使第一复制特征提取模型和/或第二复制特征提取模型同样进行模型参数的更新,对此,本技术实施例不做限制。

[0094]

步骤303,确定第一增强特征与第二增强特征之间的相似度、以及第一增强特征与第三特征之间的相似度。

[0095]

在实际实施时,在得到第一增强特征、第二增强特征以及第三特征之后,确定第一增强特征与第二增强特征之间的相似度、以及第一增强特征与第三特征之间的相似度,这里确定相似度的方法可以包括但不限于向量空间余弦相似度、欧几里得距离、欧式距离与余弦相似度等。

[0096]

步骤304,基于第一增强特征与第二增强特征之间的相似度、以及第一增强特征与第三特征之间的相似度,更新初始特征提取模型的模型参数,得到第一特征提取模型。

[0097]

在实际实施时,获取预先设定的对比学习损失函数,即

[0098][0099]

其中,公式(2)中的u为第一增强特征,v

+

为第二增强特征,v-为第三特征,τ为一个超参数。

[0100]

然后,基于第一增强特征与第二增强特征之间的相似度、第一增强特征与第三特征之间的相似度以及预先设定的对比学习损失函数,确定初始特征提取模型的损失,并基于损失,更新初始特征提取模型的模型参数,以得到第一特征提取模型。

[0101]

步骤102,接收第二参与方设备发送的第二用户特征。

[0102]

在实际实施时,第二用户特征为,第二参与方设备通过第二特征提取模型,对本地的第二训练用户样本进行特征提取得到的用户特征,第二训练用户样本与第一训练用户样本在目标维度的维度信息相同,第一用户特征与第二用户特征存在部分相同。

[0103]

需要说明的是,这里目标维度的维度信息相同表征第二训练用户样本与第一训练用户样本为经过样本对齐后的对齐训练用户样本,示例性地,目标维度的维度信息可以为第二训练用户样本与第一训练用户样本的样本标识或用户标识如手机号和身份证号等,目标维度的维度信息相同表征第二训练用户样本与第一训练用户样本具有相同的样本标识或者用户标识,即第二训练用户样本与第一训练用户样本相同。

[0104]

需要说明的是,第二用户特征至少包括第二业务特征以及基础特征,第二业务特征对应第二业务,第二业务为对应第二参与方设备的业务。作为示例,第二参与方设备可以是银行、超市、互联网公司、学校、医院等机构中至少之一。当第二参与方设备为第二参与方设备为超市时,第二业务可以是用户在超市有过的购买业务等,而第二用户特征包括但不限于用户的姓名、性别、年龄、学历、职业、消费金额、消费时间、消费方式(例如,信用卡消费或储蓄卡消费等)、常用的支付方式(例如,二维码支付方式、刷卡支付方式)等,其中,第二业务特征包括但不限于用户的消费金额、消费时间、消费方式(例如,信用卡消费或储蓄卡消费等)、常用的支付方式(例如,二维码支付方式、刷卡支付方式)等,这里,第一用户特征中的基础特征与第二用户特征中的基础特征相同,都是包括但不限于用户的姓名、性别、年龄、学历、职业等,而第二用户特征中的基础特征包括但不限于用户的姓名、性别、年龄、学

历、职业等。

[0105]

需要说明的是,第一业务与第二业务为两种不同类型的业务,第一参与方设备与第二参与方设备为同一区域的两个机构,而第一用户特征与第二用户特征中相同的部分至少包括基础特征。

[0106]

接下来,对第一训练用户样本与第二训练用户样本进行样本对齐的过程进行说明。

[0107]

在一些实施例中,在通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一特征之前,还可以获取第一参与方设备本地的训练用户样本、以及第二参与方设备本地的训练用户样本;对第一参与方设备本地的训练用户样本、以及第二参与方设备本地的训练用户样本进行样本对齐,得到所述第一训练用户样本以及所述第二训练用户样本。

[0108]

在实际实施时,对第一参与方设备本地的训练用户样本、以及第二参与方设备本地的训练用户样本进行样本对齐,得到所述第一训练用户样本以及所述第二训练用户样本的过程,具体包括,获取第一参与方设备本地的训练用户样本的样本标识、以及第二参与方设备本地的训练用户样本的样本标识,将第一参与方设备本地的训练用户样本的样本标识,与第二参与方设备本地的训练用户样本的样本标识进行匹配,得到匹配结果;当匹配结果表征将第一参与方设备本地的训练用户样本的样本标识,与第二参与方设备本地的训练用户样本的样本标识相同时,确定第一参与方设备本地的训练用户样本为第一训练用户样本,并确定第二参与方设备本地的训练用户样本为第二训练用户样本。

[0109]

步骤103,基于第一用户特征以及第二用户特征,采用对比学习的方式,确定第一特征提取模型的损失。

[0110]

在实际实施时,第二训练用户样本存在至少两个,基于第一用户特征以及第二用户特征,采用对比学习的方式,确定第一特征提取模型的损失的过程,具体为,获取第一训练用户样本的第一样本标识、以及各第二训练用户样本的第二样本标识;基于第一样本标识以及第二样本标识,从至少两个第二训练用户样本中,选取样本标识与第一样本标识相同的第二训练用户样本,作为第一训练用户样本对应的正样本,并选取样本标识与第一样本标识不同的第二训练用户样本,作为第一训练用户样本对应的负样本;确定正样本对应的第二用户特征与第一用户特征的第一相似度,并确定负样本对应的第二用户特征与第一用户特征的第二相似度;结合第一相似度及第二相似度,确定第一特征提取模型的损失。需要说明的是,这里的样本标识可以是如手机号和身份证号等用于标识样本的信息。

[0111]

在实际实施时,确定正样本对应的第二用户特征与第一用户特征的第一相似度,并确定负样本对应的第二用户特征与第一用户特征的第二相似度的过程,具体包括,在得到第一用户特征、正样本对应的第二用户特征以及负样本对应的第二用户特征之后确定正样本对应的第二用户特征与第一用户特征的第一相似度、以及确定负样本对应的第二用户特征与第一用户特征的第二相似度,这里确定相似度的方法可以包括但不限于向量空间余弦相似度、欧几里得距离、欧式距离与余弦相似度等。

[0112]

在实际实施时,结合第一相似度及第二相似度,确定第一特征提取模型的损失的过程,具体包括,首先获取预先设定的对比学习损失函数,即

[0113][0114]

其中,公式(2)中的q为第一用户特征,k

+

为正样本对应的第二用户特征,i为第二训练用户样本的数量,ki为第二训练用户样本对应的第二特征,ki包括正样本对应的第二用户特征以及负样本对应的第二用户特征,τ为一个超参数。

[0115]

在实际实施时,基于第一用户特征与正样本对应的第二用户特征之间的相似度、第一用户特征与负样本对应的第二用户特征间的相似度以及预先设定的对比学习损失函数,确定第一特征提取模型的损失。

[0116]

步骤104,基于损失,通过协作方设备,采用横向联邦学习的方式更新第一特征提取模型的模型参数。

[0117]

在实际实施时,基于损失,通过协作方设备,采用横向联邦学习的方式更新第一特征提取模型的模型参数存在两种方式,接下来,对这两种方式进行说明。

[0118]

在一些实施例中,参见图7,图7是本技术实施例提供的通过协作方设备采用横向联邦学习的方式更新第一特征提取模型的模型参数的示意图,各参与方设备可以直接将损失发送至协作方设备,以使协作方设备对各个参与方设备发送的损失进行聚合,得到目标损失;然后接收所述协作方设备返回的目标损失,并基于目标损失更新所述第一特征提取模型的模型参数。

[0119]

在实际实施时,各参与方设备在对损失进行发送的时候,还可以对损失进行隐私保护,得到隐私保护后的加密损失;然后发送隐私保护后的加密损失至协作方设备,以使协作方设备对多个参与方设备发送的加密损失进行聚合处理,得到所述目标损失。这里隐私保护的方式可以为对损失进行模糊处理,例如添加噪声、差分隐私处理等,协作方设备获得的即为至少两个参与方设备对损失进行隐私处理后的加密损失,应当理解的是,协作方设备在统计至少两个参与方设备的加密损失时,其中的噪声将会互相抵消,不影响对加密损失的聚合结果。此外,隐私保护的处理方式还可以为对损失进行同态加密。

[0120]

在实际实施时,协作方设备对多个参与方设备发送的加密损失进行聚合处理的过程可以有多种方式,示例性地,对各参与方设备发送的加密损失求平均值,或者随机选取部分参与方设备发送的加密损失进行平均,又或者获取各参与方设备的权重,然后基于权重对参与方发送的加密损失进行加权求和。对于协作方进行聚合操作的过程本技术对此不做限制。

[0121]

在一些实施例中,还可以首先基于损失更新第一特征提取模型的模型参数,得到更新后的第一特征提取模型,然后参见图8,图8是本技术实施例提供的通过协作方设备采用横向联邦学习的方式更新第一特征提取模型的模型参数的示意图,基于图8,在第一特征提取模型,第一参与方设备将更新后的第一特征提取模型的第一模型参数发送至协作方设备,以使协作方设备对第一模型参数及第二参与方设备发送的第二模型参数进行聚合,得到聚合模型参数;其中,第二模型参数为,更新后的第二特征提取模型的模型参数;然后利用聚合模型参数更新第一特征提取模型的模型参数。

[0122]

在一些实施例中,在得到训练完成的特征提取模型后,还可以基于携带标签的训

练用户样本对特征提取模型进行再次训练,具体地,获取训练完成的第一特征提取模型,然后通过训练完成的第一特征提取模型,对本地携带标签的第三训练用户样本进行特征提取,得到目标特征,最后获取目标特征与标签之间的差异,并基于差异更新训练完成的第一特征提取模型的模型参数。需要说明的是,这里的标签可以是相应用户的真实特征数据,第三训练用户样本可以与第一训练用户样本相同,也可以与第一训练用户样本不同。

[0123]

需要说明的是,在获取训练完成的特征提取模型后,可以通过训练完成的特征提取模型进行下游的本地机器学习任务或者下游的联邦学习任务,接下来,以通过训练完成的特征提取模型进行下游的本地机器学习任务为例进行说明。

[0124]

作为示例,当通过训练完成的特征提取模型进行下游的本地机器学习任务,该机器学习任务为二分类任务时,获取携带二分类标签的训练用户样本,其中,二分类标签用于指示训练用户样本对应的二分类的结果。示例性地,当该二分类任务对应的分类模型应用于风控管理或风控预测时,该二分类标签可以为风控标签,如该风控标签可以为标识用户守信或不守信的二分类标签,还可以为标识用户忠诚度高或低的二分类标签,亦或是用于评估用户是否为优质客户的二分类标签。然后通过训练完成的特征提取模型,对携带二分类标签的训练用户样本进行特征提取,得到训练用户样本对应的特征数据,接着将该特征数据输入至分类模型,以使分类模型基于该特征数据对相应训练用户样本进行分类,得到对相应训练用户样本进行分类的二分类结果,再获取该二分类结果与相应二分类标签的差异,并基于差异更新该分类模型。

[0125]

应用本技术上述实施例,相较于相关技术中采用有标签的训练用户样本对特征提取模型进行训练的方式,本技术实施例首先利用纵向联邦学习,即第一参与方设备通过将依据本地的训练用户样本提取的第一用户特征,与第二参与方设备发送的、依据第二参与方设备本地的训练用户样本所提取的第二用户特征,进行对比学习以得到损失,再通过协作方设备,结合横向联邦学习的方式来更新特征提取模型的模型参数。如此,在混合联邦学习的架构下,通过采用对比学习的方式,利用各参与方设备本地的训练用户样本对特征提取模型进行训练,由于无需考虑训练用户样本是否携带标签,保证了模型的训练用户样本充足,在提高特征提取模型的精确性的同时,提高了模型的训练效率。

[0126]

接下来以具体应用场景为例,对本技术实施例提供的种特征提取模型的训练方法进行介绍,参见图9,图9是本技术实施例提供的种特征提取模型的训练方法的一个可选的流程示意图,基于图9,本技术实施例提供的种特征提取模型的训练方法由协作方设备、至少两个参与方设备协同实施。协作方设备、参与方设备均可以是服务器,也可以是终端。参见图9,本技术实施例提供的种特征提取模型的训练方法还包括:

[0127]

步骤401,第一参与方设备初始化本地的模型,得到初始特征提取模型。

[0128]

在实际实施时,各参与方设备在模型训练最开始初始化各自本地的模型,由于每个参与方的模型训练程序相同,这里仅以第一参与方设备为例描述训练过程,需要说明的是,所有参与方都拥有少量的标签。

[0129]

步骤402,对初始特征提取模型进行复制,得到复制特征提取模型。

[0130]

需要说明的是,在得到复制特征提取模型后,需要固定住复制特征提取模型的模型参数,从而保证复制特征提取模型不进行后续模型参数的更新。

[0131]

步骤403,通过数据增强对本地的训练用户样本进行变换,得到变换后的第一增强

训练用户样本以及第二增强训练用户样本。

[0132]

步骤404,通过初始特征提取模型对第一增强训练用户样本进行特征提取,得到第一增强特征,并通过复制特征提取模型对第二增强训练用户样本进行特征提取,得到第二增强特征。

[0133]

步骤405,将第一增强特征以及第二增强特征输入至对比学习损失函数,得到初始特征提取模型的梯度,并通过梯度更新初始特征提取模型的模型参数,得到第一特征提取模型。

[0134]

需要说明的是,这里的对比学习损失函数可以为公式(1)中的损失函数。

[0135]

步骤406,通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征。

[0136]

步骤407,第二参与方设备通过第二特征提取模型,对第二参与方设备本地的第二训练用户样本进行特征提取,得到第二用户特征。

[0137]

步骤408,发送第二用户特征至第一参与方设备。

[0138]

步骤409,第一参与方设备将第一用户特征以及第二用户特征至对比学习损失函数,得到第一特征提取模型的梯度。

[0139]

需要说明的是,这里的对比学习损失函数可以为公式(3)中的损失函数。

[0140]

步骤410,基于梯度更新第一特征提取模型的模型参数,得到更新后的第一特征提取模型。

[0141]

步骤411,发送更新后的第一特征提取模型的第一模型参数至协作方设备。

[0142]

步骤412,第二参与方设备发送第二模型参数至协作方设备。

[0143]

需要说明的是,由于各参与方设备本地的特征提取模型的训练过程相同,因此,这里第二参与方设备发送的第二模型参数为更新后的第二特征提取模型的模型参数。

[0144]

步骤413,协作方设备对第一模型参数及第二模型参数进行聚合,得到聚合模型参数。

[0145]

在实际实施时,协作方设备对多个参与方设备发送的模型参数进行聚合处理的过程可以有多种方式,示例性地,对各参与方发送的模型参数求平均值,或者随机选取部分参与方设备发送的模型参数进行平均,又或者获取各参与方设备的权重,然后基于权重对参与方发送的模型参数进行加权求和。对于协作方进行聚合操作的过程本技术对此不做限制。

[0146]

步骤414,将聚合模型参数发送至各参与方设备。

[0147]

步骤415,第一参与方设备基于聚合模型参数更新第一特征提取模型的模型参数。

[0148]

需要说明的是,在完成对特征提取模型的训练后,得到训练完成的第一特征提取模型,然后可以基于训练完成的第一特征提取模型进行下游的如步骤416-步骤420的机器学习任务。

[0149]

步骤416,获取携带真实标签的训练用户样本、待训练的任务模型、以及训练完成的第一特征提取模型。

[0150]

需要说明的是,当通过训练完成的第一特征提取模型进行下游的本地机器学习任务为二分类任务时,这里的真实标签为二分类标签,待训练的任务模型为二分类模型,其中,二分类标签用于指示训练用户样本对应的二分类的结果。示例性地,当该二分类任务对

应的分类模型应用于风控管理或风控预测时,该二分类标签可以为风控标签,如该风控标签可以为标识用户守信或不守信的二分类标签,还可以为标识用户忠诚度高或低的二分类标签,亦或是用于评估用户是否为优质客户的二分类标签。

[0151]

步骤417,通过训练完成的第一特征提取模型,对携带真实标签的训练用户样本进行特征提取,得到训练用户样本对应的特征数据。

[0152]

步骤418,将特征数据输入至任务模型,得到相应训练用户样本的预测结果。

[0153]

步骤419,将预测结果与相应训练用户样本的真实标签输入至任务损失函数,得到任务模型的梯度。

[0154]

在实际实施时,这里的任务损失函数可以为交叉熵损失函数。

[0155]

步骤420,基于梯度对任务模型的模型参数进行更新。

[0156]

如此,各个参与方设备充分利用所有(有标签和无标签)样本数据进行联邦学习,结合本地对比学习、纵向联邦对比学习、横向联邦学习来更好的优化各个参与方设备的特征提取模型,使其能够学习到更好的公共表征,从而提高各个参与方下游任务的建模性能。

[0157]

应用本技术上述实施例,相较于相关技术中采用有标签的训练用户样本对特征提取模型进行训练的方式,本技术实施例首先利用纵向联邦学习,即第一参与方设备通过将依据本地的训练用户样本提取的第一用户特征,与第二参与方设备发送的、依据第二参与方设备本地的训练用户样本所提取的第二用户特征,进行对比学习以得到损失,再通过协作方设备,结合横向联邦学习的方式来更新特征提取模型的模型参数。如此,在混合联邦学习的架构下,通过采用对比学习的方式,利用各参与方设备本地的训练用户样本对特征提取模型进行训练,由于无需考虑训练用户样本是否携带标签,保证了模型的训练用户样本充足,在提高特征提取模型的精确性的同时,提高了模型的训练效率。

[0158]

下面继续说明本技术实施例提供的特征提取模型的训练装置254,参见图10,图10是本技术实施例提供的特征提取模型的训练装置254的结构示意图,本技术实施例提供的特征提取模型的训练装置254包括:

[0159]

特征提取模块2541,用于通过第一特征提取模型,对第一参与方设备本地的第一训练用户样本进行特征提取,得到第一用户特征;

[0160]

接收模块2542,用于接收第二参与方设备发送的第二用户特征,所述第二用户特征为,所述第二参与方设备通过第二特征提取模型,对本地的第二训练用户样本进行特征提取得到的用户特征;其中,所述第二训练用户样本与所述第一训练用户样本在目标维度的维度信息相同,所述第一用户特征与所述第二用户特征存在部分相同;

[0161]

对比学习模块2543,用于基于所述第一用户特征以及所述第二用户特征,采用对比学习的方式,确定所述第一特征提取模型的损失;

[0162]

更新模块2544,用于基于所述损失,通过所述协作方设备,采用横向联邦学习的方式更新所述第一特征提取模型的模型参数。

[0163]

在一些实施例中,所述更新模块2544,还用于将所述损失发送至所述协作方设备,以使所述协作方设备对各个参与方设备发送的损失进行聚合,得到目标损失;接收所述协作方设备返回的所述目标损失,并基于所述目标损失更新所述第一特征提取模型的模型参数。

[0164]

在一些实施例中,所述更新模块2544,还用于对所述损失进行隐私保护,得到隐私

保护后的加密损失;发送隐私保护后的所述加密损失至协作方设备,以使所述协作方设备对多个参与方设备发送的所述加密损失进行聚合处理,得到所述目标损失。

[0165]

在一些实施例中,所述更新模块2544,还用于基于所述损失更新所述第一特征提取模型的模型参数,得到更新后的第一特征提取模型;将所述更新后的第一特征提取模型的第一模型参数发送至所述协作方设备,以使所述协作方设备对所述第一模型参数及第二参与方设备发送的第二模型参数进行聚合,得到聚合模型参数;其中,所述第二模型参数为,更新后的所述第二特征提取模型的模型参数;利用所述聚合模型参数更新所述第一特征提取模型的模型参数。

[0166]

在一些实施例中,所述装置还包括预训练模块,所述预训练模块,用于对所述第一训练用户样本进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本;通过初始特征提取模型,对所述第一增强训练用户样本以及所述第二增强训练用户样本分别进行特征提取,得到对应所述第一增强训练用户样本的第一增强特征、以及对应所述第二增强训练用户样本的第二增强特征;基于所述第一增强特征以及所述第二增强特征,采用对比学习的方式训练所述初始特征提取模型,得到所述第一特征提取模型。

[0167]

在一些实施例中,所述预训练模块,还用于当所述第一训练用户样本的数量为至少两个时,对至少两个所述第一训练用户样本中一个进行数据增强,得到第一增强训练用户样本以及第二增强训练用户样本;通过初始特征提取模型,对所述第一增强训练用户样本、所述第二增强训练用户样本、以及未经过数据增强的第一训练用户样本分别进行特征提取,得到对应所述第一增强训练用户样本的第一增强特征、对应所述第二增强训练用户样本的第二增强特征、以及对应未经过数据增强的第一训练用户样本的第三特征;确定所述第一增强特征与所述第二增强特征之间的相似度、以及所述第一增强特征与所述第三特征之间的相似度;基于所述第一增强特征与所述第二增强特征之间的相似度、以及所述第一增强特征与所述第三特征之间的相似度,更新所述初始特征提取模型的模型参数,得到所述第一特征提取模型。

[0168]

在一些实施例中,所述第二训练用户样本存在至少两个,所述对比学习模块2543,还用于获取所述第一训练用户样本的第一样本标识、以及各所述第二训练用户样本的第二样本标识;基于所述第一样本标识以及所述第二样本标识,从至少两个第二训练用户样本中,选取样本标识与所述第一样本标识相同的第二训练用户样本,作为所述第一训练用户样本对应的正样本,并选取样本标识与所述第一样本标识不同的第二训练用户样本,作为所述第一训练用户样本对应的负样本;确定所述正样本对应的第二用户特征与所述第一用户特征的第一相似度,并确定所述负样本对应的第二用户特征与所述第一用户特征的第二相似度;结合所述第一相似度及所述第二相似度,确定所述第一特征提取模型的损失。

[0169]

在一些实施例中,所述装置包括后训练模块,所述后训练模块,用于获取训练完成的第一特征提取模型;通过所述训练完成的第一特征提取模型,对本地携带标签的第三训练用户样本进行特征提取,得到目标特征;获取所述目标特征与所述标签之间的差异,并基于所述差异更新所述训练完成的第一特征提取模型的模型参数。

[0170]

在一些实施例中,所述装置包括样本对齐模块,所述样本对齐模块,用于获取所述第一参与方设备本地的训练用户样本、以及所述第二参与方设备本地的训练用户样本;对所述第一参与方设备本地的训练用户样本、以及所述第二参与方设备本地的训练用户样本

进行样本对齐,得到所述第一训练用户样本以及所述第二训练用户样本。

[0171]

应用本技术上述实施例,相较于相关技术中采用有标签的训练用户样本对特征提取模型进行训练的方式,本技术实施例首先利用纵向联邦学习,即第一参与方设备通过将依据本地的训练用户样本提取的第一用户特征,与第二参与方设备发送的、依据第二参与方设备本地的训练用户样本所提取的第二用户特征,进行对比学习以得到损失,再通过协作方设备,结合横向联邦学习的方式来更新特征提取模型的模型参数。如此,在混合联邦学习的架构下,通过采用对比学习的方式,利用各参与方设备本地的训练用户样本对特征提取模型进行训练,由于无需考虑训练用户样本是否携带标签,保证了模型的训练用户样本充足,在提高特征提取模型的精确性的同时,提高了模型的训练效率。

[0172]

本技术实施例还提供一种电子设备,所述电子设备包括:

[0173]

存储器,用于存储可执行指令;

[0174]

处理器,用于执行所述存储器中存储的可执行指令时,实现本技术实施例提供的特征提取模型的训练方法。

[0175]

本技术实施例提供了一种计算机程序产品,包括计算机程序,该计算机程序被处理器执行时实现本技术实施例提供的特征提取模型的训练方法。

[0176]

本技术实施例提供一种存储有可执行指令的计算机可读存储介质,其中存储有可执行指令,当可执行指令被处理器执行时,将引起处理器执行本技术实施例提供的特征提取模型的训练方法。

[0177]

在一些实施例中,计算机可读存储介质可以是fram、rom、prom、eprom、eeprom、闪存、磁表面存储器、光盘、或cd-rom等存储器;也可以是包括上述存储器之一或任意组合的各种设备。

[0178]

在一些实施例中,可执行指令可以采用程序、软件、软件模块、脚本或代码的形式,按任意形式的编程语言(包括编译或解释语言,或者声明性或过程性语言)来编写,并且其可按任意形式部署,包括被部署为独立的程序或者被部署为模块、组件、子例程或者适合在计算环境中使用的其它单元。

[0179]

作为示例,可执行指令可以但不一定对应于文件系统中的文件,可以可被存储在保存其它程序或数据的文件的一部分,例如,存储在超文本标记语言(html,hyper text markup language)文档中的一个或多个脚本中,存储在专用于所讨论的程序的单个文件中,或者,存储在多个协同文件(例如,存储一个或多个模块、子程序或代码部分的文件)中。

[0180]

作为示例,可执行指令可被部署为在一个计算设备上执行,或者在位于一个地点的多个计算设备上执行,又或者,在分布在多个地点且通过通信网络互连的多个计算设备上执行。

[0181]

综上所述,通过本技术实施例,各个参与方设备充分利用所有(有标签和无标签)样本数据进行联邦学习,结合本地对比学习、纵向联邦对比学习、横向联邦学习来更好的优化各个参与方的特征提取模型,使其能够学习到更好的公共表征,从而提高各个参与方设备下游任务的建模性能。

[0182]

以上所述,仅为本技术的实施例而已,并非用于限定本技术的保护范围。凡在本技术的精神和范围之内所作的任何修改、等同替换和改进等,均包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1