基于混合批归一化的长尾学习图像分类、训练方法及装置与流程

1.本发明涉及图像分类领域,尤其是涉及基于混合批归一化的长尾学习图像分类、训练方法及装置。

背景技术:

2.近年来,不平衡学习问题吸引了广泛的研究兴趣。然而,现有的方法无法在不妨碍头部类的性能或保持有效框架的情况下获得尾部类的高精度。本发明的目标是利用长尾训练数据进行学习,同时避免了上述问题。在使用长尾样本学习深度卷积神经网络(cnns)时,网络参数的优化以头部类样本为主导,导致尾部类样本的性能相对较低,在图像分类领域,最终将会影响图像分类的精度。数据不平衡问题的传统解决方案是使优化过程偏向于较不频繁的类。批量标准化是在cnns的前馈计算过程中,减少内部协变量偏移的一个关键组成部分。它可以加快网络参数的优化速度,提高泛化能力。但是,在图像数据分类识别中,在头部类样本(图像数据中经常出现的通用类别)和尾部类样本(图像数据中较少出现的稀有类别)不平衡的情况下,如图1a所示,利用单模态高斯概率函数不能完全对特征空间进行建模,容易忽略尾部类的样本。因此,传统的批标准化只能消除全局协变量偏移,而忽略了尾部类的内部协变量偏移。这损害了尾部类的学习效率和泛化能力。如图1b所示,采用混合高斯分布来拟合特征,可以缓解这种问题。

3.然而在长尾分布的图像数据集中,由于训练数据为头部类别所主导,交叉熵损失难以分辨尾部类别的正确与错误样本。目前的大多工作,试图通过集成在不同采样策略下学习的多个分类器或采用辅助分类器来突出尾部类的学习,从而解决这个问题。然而,数据不平衡对特征表示学习的影响仍不能有效减轻,因为它们仍然依赖于数据重采样或重加权算法来管理多个分类器。基于上述分析,现有的深度神经网络cnn针对具有长尾特征的图像数据集进行分类识别的上述问题,仍然没有有效的解决方法。

技术实现要素:

4.为解决现有技术的不足,在通过具有长尾特征的图像数据,进行分类识别训练后,提升模型分类识别效果的目的,本发明采用如下的技术方案:一种基于混合批归一化的长尾学习图像分类训练方法,包括如下步骤:步骤s1:构建混合标准化分支,利用混合批归一化(compound batch normalization),采用m个高斯分布,标准化输入的当前批次样本图像的特征向量,通过学习单独的比例系数和偏差系数,重新分配不同的归一化分支的批次特征向量,采用期望最大化(expectation maximization)算法,更新m个高斯分布的参数;对输入样本图像的特征图进行扁平化处理,得到扁平化后的特征图,n=b

×h×

w,其中分别代表批次大小(batch size)、通道的数量、图像的高度以及图像的宽度;

步骤s2:构建分裂标准化分支,采用分裂特征标准化(split feature normalization),将作为训练数据的样本图像的特征向量,分成m个独立的组,利用不同组的特征,计算分裂阶段当前批次高斯分布的参数,并结合混合批归一化更新的高斯分布的参数,累计更新m个组高斯分布的参数,通过单独的比例系数和偏差系数,重新分配不同的高斯分布标准化分支的特征向量;对于采用期望最大化算法学习混合的高斯分布很容易陷入局部最优的问题,采用分裂特征标准化能够克服这一问题;步骤s3:构建双分支学习(dual-path learning)框架,对混合标准化分支和分裂标准化分支的输入样本图像,均进行强增强和弱增强,即每个分支两个输入,通过得到的特征向量进行图像分类,计算两个分支分类预测的相似性最大化(maximization of the similarity)损失以及用平衡softmax交叉熵(balanced softmax cross-entropy)分类损失来计算分类损失,优化双分支对应的图像分类神经网络参数。

5.进一步地,所述步骤s1包括如下步骤:步骤s1.1:对当前批次样本图像的特征图进行标准化,得到混合阶段标准化特征图;步骤s1.2:采用期望最大化算法,对当前批次样本图像的特征图和m组高斯分布的参数,计算混合阶段当前批次m组高斯分布的参数;步骤s1.3:采用期望最大化算法,混合阶段各组的高斯分布的参数,累计更新m个高斯分布的参数,采用单独的比例系数和偏差系数,重新分配不同的高斯分布标准化分支的特征向量。

6.进一步地,所述高斯分布的参数包括高斯分布的先验概率、均值和方差;步骤s1.1中,通过高斯分布的均值和方差,对当前批次样本图像的特征图进行标准化;其中,表示样本图像对应的特征图,,分别表示第j组高斯分布的均值和方差,表示通过第j组高斯分布得到的标准化特征图;步骤s1.2中,高斯分布的参数包括先验概率、均值和方差,首先对当前批次样本图像的特征图、均值和方差,通过期望最大化算法,得到高斯概率密度,然后通过高斯概率密度和先验概率,计算当前批次样本图像的特征图属于某一组高斯分布的概率值,最后通过概率值和批归一化的大小,计算混合阶段的先验概率,通过概率值、批归一化的大小和当前批次样本图像的特征图,计算混合阶段的均值,通过概率值、批归一化的大小、当前批次样本图像的特征图和混合阶段的均值,计算混合阶段的方差;本图像的特征图和混合阶段的均值,计算混合阶段的方差;

其中,表示样本图像对应的特征图,,,分别表示第j组高斯分布的先验概率、均值、方差,j≠k,t表示矩阵转置,exp(

·

)表示期望函数,表示高斯概率密度函数,表示属于第组高斯分布的概率值,n表示批归一化的大小,,,分别表示混合(compound)阶段得到的当前批次的第j组高斯分布的先验概率、均值以及方差;步骤s1.3中,高斯分布的先验概率、均值和方差,结合对应的混合阶段高斯分布的先验概率、均值和方差,通过比例系数进行更新,得到混合阶段更新后的高斯分布先验概率、均值和方差;混合阶段标准化特征图,经其对应的偏差系数调整后,结合相应的所述概率值,通过累加得到混合阶段高斯分布标准化分支的特征向量。值,通过累加得到混合阶段高斯分布标准化分支的特征向量。值,通过累加得到混合阶段高斯分布标准化分支的特征向量。值,通过累加得到混合阶段高斯分布标准化分支的特征向量。

7.其中、、分别表示混合阶段更新后的第j组高斯分布的先验概率、均值、方差,表示比例系数,diag(

·

)表示对角矩阵,和表示偏差系数,表示混合阶段高斯分布标准化分支的特征向量。

8.进一步地,所述步骤s2中,将训练数据分成相互独立的m组,输入的特征向量也相应的划分为m组,包括如下步骤:步骤s2.1:通过混合阶段更新后的高斯分布参数,对相应组的样本图像的特征图进行标准化,得到分裂阶段标准化特征图;步骤s2.2:利用不同组的特征,计算分裂阶段当前批次的高斯分布参数;步骤s2.3:利用混合阶段更新后的高斯分布参数,以及分裂(split)阶段的高斯分布参数,累计更新每个组的高斯分布参数,采用单独的比例系数和偏差系数来重新分配不同的分裂阶段高斯分布标准化分支的特征向量。

9.进一步地,所述高斯分布的参数包括高斯分布的先验概率、均值和方差;步骤s2.1中,通过更新后的高斯分布均值和方差,对相应组的样本图像的特征图进行标准化;

步骤s2.2中,通过样本图像的特征图及其所在组的特征数量,计算分裂阶段的高斯分布均值;通过样本图像的特征图及其所在组的特征数量、对应的分裂阶段高斯分布均值,计算分裂阶段高斯分布的方差;值,计算分裂阶段高斯分布的方差;其中表示第j组的特征数量,;步骤s2.3中,利用混合阶段更新后的高斯分布均值和方差,以及分裂阶段当前批次的高斯分布均值和方差,通过比例系数,累计更新每个组高斯分布的参数,得到分裂阶段更新后的高斯分布均值和方差,分裂阶段标准化特征图经其对应的偏差系数、调整后,通过累加得到分裂阶段高斯分布标准化分支的特征向量。

10.即可表示为:即可表示为:即可表示为:进一步地,所述步骤s3中,对输入图像,通过弱增强和弱增强方法,分别得到强增强图像和弱增强图像,3表示输入图像的rgb3个通道,将强增强图像和弱增强图像通过混合标准化分支得到的特征向量,进行图像分类识别,分别得到图像类别的混合标准化分支强增强预测结果和弱增强预测结果;同样的,将强增强图像和弱增强图像通过分裂标准化分支得到的特征向量,进行图像分类识别,分别得到图像类别的分裂标准化分支强增强预测结果和弱增强预测结果;采用两个分支预测结果之间的相似性最大化方法以及分类损失,优化网络参数,并使用随机梯度下降法(sgd)更新网络参数。

11.进一步地,所述相似性最大化方法,是采用相似性损失,分别对混合标准化分支强增强预测结果和停止梯度的分裂标准化分支弱预测结果,分裂标准化分支强预测结果和停止梯度的混合标准化分支弱预测结果,计算最大相似性指标。

12.相似性损失表示如下:其中表示停止梯度操作,即对应的和为常数,表示相似性指

标;。

13.进一步地,所述分类损失是对混合标准化分支强增强预测结果计算平衡交叉熵分类损失,分类损失表示如下:其中k表示样本总类别数,y表示样本的真实标签,exp(

·

)表示期望函数,ny表示类别为y的样本数量。

14.一种基于混合批归一化的长尾学习图像分类方法,将待分类图像输入到所述基于混合批归一化的长尾学习图像分类训练方法训练好的混合标准化分支得到预测结果。

15.一种基于混合批归一化的长尾学习图像分类装置,包括存储器和一个或多个处理器,所述存储器中存储有可执行代码,所述一个或多个处理器执行所述可执行代码时,用于实现所述的图像分类方法。

16.本发明的优势和有益效果在于:本发明的基于混合批归一化的长尾学习图像分类、训练方法及装置,基于混合批归一化的双分支学习框架,通过基于高斯分布混合的混合批归一化,更全面地对特征空间进行建模,减轻头部类的主导地位,通过分裂特征标准化来多样化估计的高斯分布,使高斯分布更全面地拟合尾部类别的训练样本图像。本发明实现方法简便,手段灵活,在实时获取类拟合度方面具有优势,因此在具有长尾特征的图像训练数据上,取得了分类效果的显著提升。

附图说明

17.图1a是传统的图像特征归一化忽略尾部类样本的效果示意图。

18.图1b是采用多个高斯分布来拟合特征的效果示意图。

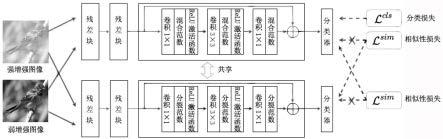

19.图2是本发明实施例中基于混合批归一化的长尾学习进行图像分类训练的原理图。

20.图3是本发明实施例中基于混合批归一化的长尾学习进行图像分类训练方法流程图。

21.图4是本发明实施例中基于混合批归一化的长尾学习进行图像分类方法流程图。

22.图5是本发明实施例中基于混合批归一化的长尾学习图像分类装置的结构图。

具体实施方式

23.以下结合附图对本发明的具体实施方式进行详细说明。应当理解的是,此处所描述的具体实施方式仅用于说明和解释本发明,并不用于限制本发明。

24.本发明主要解决当前基于深度神经网络的图像分类任务中,对具有长尾特征的图像数据进行分类的问题。采用混合高斯分布建模特征空间来推广特征标准化。为了更全面地拟合特征,采用了一个均值和方差参数的混合集来实现特征标准化过程。利用每一组均值和方差参数对局部子空间内的一组特征进行白化(whitening),并利用独立的仿射参数重建分布统计量。这种混合特征归一化有助于消除局部协变量的偏移,减轻头部类的优势。

在混合特征归一化的基础上,建立了分类模型的主流分支,并设计了一种基于移动平均的期望最大化算法来评估统计参数。多模态高斯概率函数的统计参数估计很容易陷入局部极小值,其中多个高斯分布仍然集中于头部类,而忽略尾部类。因此,设计了一个双路径学习框架,以多样化这些高斯分布之间的所有类。通过分裂标准化化建立了一个辅助分支,将总的训练样本类别分成不同的子集,并使用独立的统计参数和仿射参数对它们进行处理。这有利于分散不同高斯分布的统计参数。此外,主流分支和辅助分支通过基于停止梯度的一致性约束相互作用,以增强表示学习。

25.如图2、图3所示,基于混合批归一化的长尾学习进行图像分类训练方法,主要解决图像分类任务中,对同时具有长尾特征与噪声标签的图像数据进行分类的问题,使用pytorch框架进行实验,使用sgd作为优化器,其学习率为0.05,随余弦退火计划而衰减;训练期数设置为400,批量大小设置为128;,和均设置为0.1,主干是resnet32,所有模型都默认从头开始训练;具体包括如下步骤:步骤s1:构建混合标准化分支,利用混合批归一化(compound batch normalization),采用m个高斯分布,标准化输入的当前批次样本图像的特征向量,通过学习单独的比例系数和偏差系数,重新分配不同的归一化分支的批次特征向量,采用期望最大化(expectation maximization)算法,更新m个高斯分布的参数。

26.给定有l个样本图像和k个样本图像类别的训练数据集,表示样本图像,表示样本图像对应的类别标签,定义输入的特征图为,经过扁平化处理后(n=b

×h×

w),其中分别代表批次大小(batch size)、通道的数量、图像的高度以及图像的宽度;高斯分布的参数包括高斯分布的先验概率、均值和方差,定义:,,分别表示高斯分布的先验概率、均值、方差。

27.步骤s1.1:对当前批次样本图像的特征图进行标准化,得到混合阶段标准化特征图;通过高斯分布的均值和方差,对当前批次样本图像的特征图进行标准化;即标准化的特征图可表示为:其中,表示样本图像对应的特征图,,分别表示第j组高斯分布的均值和方差,表示通过第j组高斯分布得到的标准化特征图。

28.步骤s1.2:采用期望最大化(expectation maximization)算法,对当前批次样本图像的特征图和m组高斯分布的参数,计算混合阶段当前批次m组高斯分布的参数;首先对当前批次样本图像的特征图、均值和方差,通过期望最大化算法,得到高斯概率密度,然后通过高斯概率密度和先验概率,计算当前批次样本图像的特征图属于某一组高斯分布的概率值,最后通过概率值和批归一化的大小,计算混合阶段的先验概率,通过概率值、批归一化的大小和当前批次样本图像的特征图,计算混合阶段的均值,通过概率值、批归一化的大小、当前批次样本图像的特征图和混合阶段的均值,计算混合阶段的方

差;差;差;差;差;其中,表示样本图像对应的特征图,,,分别表示第j组高斯分布的先验概率、均值、方差,j≠k,t表示矩阵转置,exp(

·

)表示期望函数,表示高斯概率密度函数,表示属于第组高斯分布的概率值,n表示批归一化的大小,,,分别表示混合(compound)阶段得到的当前批次的第j组高斯分布的先验概率、均值以及方差。

29.步骤s1.3:采用期望最大化(expectation maximization)算法,混合阶段各组的高斯分布的参数,累计更新m个高斯分布的参数,采用单独的比例系数和偏差系数,重新分配不同的高斯分布标准化分支的特征向量;高斯分布的先验概率、均值和方差,结合对应的混合阶段高斯分布的先验概率、均值和方差,通过比例系数进行更新,得到混合阶段更新后的高斯分布先验概率、均值和方差;混合阶段标准化特征图,经其对应的偏差系数调整后,结合相应的所述概率值,通过累加得到混合阶段高斯分布标准化分支的特征向量;化分支的特征向量;化分支的特征向量;化分支的特征向量;其中、、分别表示混合阶段更新后的第j组高斯分布的先验概率、均值、方差,表示比例系数,diag(

·

)表示对角矩阵,和表示偏差系数,表示混合阶段高斯分布标准化分支的特征向量。

30.步骤s2:构建分裂标准化分支,采用分裂特征标准化(split feature normalization),将作为训练数据的样本图像的特征向量,分成m个独立的组,利用不同组的特征,计算分裂阶段当前批次高斯分布的参数,并结合混合批归一化更新的高斯分布的

参数,累计更新m个组高斯分布的参数,通过单独的比例系数和偏差系数,重新分配不同的高斯分布标准化分支的特征向量;对于采用期望最大化算法学习混合的高斯分布很容易陷入局部最优的问题,采用分裂特征标准化能够克服这一问题;定义将全部的训练数据集分为m组,即可表示为:,表示第j组的标签,且组之间相互独立,即可表示为:时,。

31.将训练数据分成相互独立的m组,输入的特征向量也相应的划分为m组,包括如下步骤:步骤s2.1:通过混合阶段更新后的高斯分布参数,对相应组的样本图像的特征图进行标准化,得到分裂阶段标准化特征图;标准化的特征图可表示为:步骤s2.2:利用不同组的特征,计算分裂阶段当前批次的高斯分布参数;通过样本图像的特征图及其所在组的特征数量,计算分裂阶段的高斯分布均值;通过样本图像的特征图及其所在组的特征数量、对应的分裂阶段高斯分布均值,计算分裂阶段高斯分布的方差;阶段高斯分布的方差;其中表示第j组的特征数量,;步骤s2.3:利用混合阶段更新后的高斯分布参数,以及分裂(split)阶段的高斯分布参数,累计更新每个组的高斯分布参数,采用单独的比例系数和偏差系数来重新分配不同的分裂阶段高斯分布标准化分支的特征向量;利用混合阶段更新后的高斯分布均值和方差,以及分裂阶段当前批次的高斯分布均值和方差,通过比例系数,累计更新每个组高斯分布的参数,得到分裂阶段更新后的高斯分布均值和方差,分裂阶段标准化特征图经其对应的偏差系数、调整后,通过累加得到分裂阶段高斯分布标准化分支的特征向量。

32.即可表示为:即可表示为:即可表示为:步骤s3:构建双分支学习(dual-path learning)框架,对混合标准化分支和分裂

标准化分支的输入样本图像,均进行强增强和弱增强,即每个分支两个输入,通过得到的特征向量进行图像分类,计算两个分支分类预测的相似性最大化(maximization of the similarity)损失以及用平衡softmax交叉熵(balanced softmax cross-entropy)分类损失来计算分类损失,优化双分支对应的图像分类神经网络参数。

33.定义输入图像,对输入图像,通过强增强(strong augmentation)和弱增强(weak augmentation)方法,分别得到强增强图像和弱增强图像,3表示输入图像的rgb3个通道,将强增强图像和弱增强图像通过混合标准化分支得到的特征向量,进行图像分类识别,分别得到图像类别的混合标准化分支强增强预测结果和弱增强预测结果;同样的,将强增强图像和弱增强图像通过分裂标准化分支得到的特征向量,进行图像分类识别,分别得到图像类别的分裂标准化分支强增强预测结果和弱增强预测结果;采用两个分支预测结果之间的相似性最大化方法以及分类损失,优化网络参数,并使用随机梯度下降法(sgd)更新网络参数。

34.本发明实施例中,弱数据增强的实施方式为简单的随机翻转(random flip)和裁剪(crop),而强数据增强则使用了自动数据增强(autoaugment)的实施方式,采用在imagenet上利用搜索算法自动选取的数据增强策略。

35.相似性最大化方法,是采用相似性损失,分别对混合标准化分支强增强预测结果和停止梯度的分裂标准化分支弱预测结果,分裂标准化分支强预测结果和停止梯度的混合标准化分支弱预测结果,计算最大相似性指标。

36.相似性损失表示如下:其中表示停止梯度操作,即对应的和为常数,表示相似性指标;。

37.分类损失是对混合标准化分支强增强预测结果计算平衡交叉熵分类损失,分类损失表示如下:其中k表示样本总类别数,y表示样本的真实标签,exp(

·

)表示期望函数,ny表示类别为y的样本数量。

38.如图4所示,基于混合批归一化的长尾学习图像分类方法,在基于混合批归一化的长尾学习图像分类训练方法训练完成后,将待分类图像输入到所述基于混合批归一化的长尾学习图像分类训练方法训练好的混合标准化分支得到预测结果。

39.对于长尾分布数据的设定,将总样本数为l的训练数据中每个类别k的训练样本数量定义为lk,满足。本发明定义样本数最多类别与样本数最少类别之间的样本数

比例为不平衡因子(imbalance factor),即。

40.本发明的方法及其他传统方法在cifar-10-lt,cifar-100-lt数据集上,使用resnet-32网络进行长尾分布的样本学习的测试准确率变化如表1所示,不平衡比率。

41.表1 基于cifar-10-lt,cifar-100-lt数据集,resnet-32网络的测试准确率变化表其中,mislas为混合偏移标签感知平滑法,lade为标签分布解耦法,ace为专家互补联合法,dro-lt为分布鲁棒性损失法,paco为参数化对比学习法,dive为虚拟样本蒸馏法,ssd为自监督蒸馏法,ib+focal为焦点势力平衡法,vs为过参数化方法,tcm为先验模型矫正法。

42.本发明的方法及其他传统方法在imagenet-lt数据集上,使用resnet-50网络进行长尾分布的样本学习的测试准确率变化如表2所示。

43.表2 基于imagenet-lt数据集,resnet-50网络的测试准确率变化表其中,disalign为分布对齐法。

44.本发明的方法及其他传统方法在place-lt数据集上使用resnet-152网络进行长尾分布的样本学习的测试准确率变化如表3所示。

45.表3 基于place-lt数据集,resnet-152网络的测试准确率变化表其中,gistnet为几何结构迁移法。

46.本发明的方法及其他传统方法在inaturalist2018数据集上使用resnet-50网络进行长尾分布的样本学习的测试准确率变化如表4所示。

47.表4 基于inaturalist2018数据集数据集,resnet-50网络的测试准确率变化表通过测试准确率的比较能够得出,在相同测试集和神经网络下,本发明的训练方法得到的图像分类准确率高于其他传统的方法。

48.与前述基于混合批归一化的长尾学习图像分类方法的实施例相对应,本发明还提供了基于混合批归一化的长尾学习图像分类装置的实施例。

49.参见图5,本发明实施例提供的基于混合批归一化的长尾学习图像分类装置,包括存储器和一个或多个处理器,存储器中存储有可执行代码,所述一个或多个处理器执行所述可执行代码时,用于实现上述实施例中的基于混合批归一化的长尾学习图像分类方法。

50.本发明基于混合批归一化的长尾学习图像分类装置的实施例可以应用在任意具备数据处理能力的设备上,该任意具备数据处理能力的设备可以为诸如计算机等设备或装置。装置实施例可以通过软件实现,也可以通过硬件或者软硬件结合的方式实现。以软件实现为例,作为一个逻辑意义上的装置,是通过其所在任意具备数据处理能力的设备的处理器将非易失性存储器中对应的计算机程序指令读取到内存中运行形成的。从硬件层面而言,如图5所示,为本发明基于混合批归一化的长尾学习图像分类装置所在任意具备数据处理能力的设备的一种硬件结构图,除了图5所示的处理器、内存、网络接口、以及非易失性存储器之外,实施例中装置所在的任意具备数据处理能力的设备通常根据该任意具备数据处理能力的设备的实际功能,还可以包括其他硬件,对此不再赘述。

51.上述装置中各个单元的功能和作用的实现过程具体详见上述方法中对应步骤的实现过程,在此不再赘述。

52.对于装置实施例而言,由于其基本对应于方法实施例,所以相关之处参见方法实施例的部分说明即可。以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本发明方案的目的。本领域普通技术人员在不付出创造性劳动的情况下,即可以理解并实施。

53.本发明实施例还提供一种计算机可读存储介质,其上存储有程序,该程序被处理器执行时,实现上述实施例中的基于混合批归一化的长尾学习图像分类方法。

54.所述计算机可读存储介质可以是前述任一实施例所述的任意具备数据处理能力的设备的内部存储单元,例如硬盘或内存。所述计算机可读存储介质也可以是任意具备数据处理能力的设备的外部存储设备,例如所述设备上配备的插接式硬盘、智能存储卡(smart media card,smc)、sd卡、闪存卡(flash card)等。进一步的,所述计算机可读存储介质还可以既包括任意具备数据处理能力的设备的内部存储单元也包括外部存储设备。所述计算机可读存储介质用于存储所述计算机程序以及所述任意具备数据处理能力的设备所需的其他程序和数据,还可以用于暂时地存储已经输出或者将要输出的数据。

55.以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明实施例技术方案的范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1