一种基于建筑和环境的神经网络SGE电力预测方法

一种基于建筑和环境的神经网络sge电力预测方法

技术领域

1.本发明涉及深度学习和电力预测技术领域,尤其是一种基于建筑和环境的神经网络sge电力预测方法。

背景技术:

2.电力系统的应用加速人类社会的经济发展与文化交流,互联网与信息行业在大规模电力系统被广泛应用的基础上大放异彩。众所周知,电能具有难以大量储存的特点,因此要求电力系统的发电、输电、用电近乎同时完成,这要求发电量和用电量需要保持一个动态的平衡,因此电力负荷预测在电力系统运营中尤为重要。电力负荷预测成为电力部门的重要工作之一,准确的负荷预测,可以经济合理地安排电网内部发电机组的启停,保持电网运行的安全稳定性,减少不必要的旋转储备容量,合理安排机组检修计划,保障社会的正常生产和生活,有效地降低发电成本,提高经济效益和社会效益。但是电力负荷预测方面存在许多的挑战,比如意外天气条件(温度、湿度、风速、风向等复杂的变化),人类社会性活动(节假日或者集体活动)。对于外生变量和电力负荷之间的关系很难建模,这导致整体预测精度偏低。

3.常见的负荷预测方法可以分为经典预测方法和现代预测方法两类。经典预测方法中常用的有趋势外推法、时间序列法、回归分析法等。现代预测方法中常用的有灰色数学理论、专家系统方法、神经网络理论、模糊负荷预测等。为实现相对准确的负荷预测,相关工作研究人员提出和实践许多负荷分析与预测方法。

技术实现要素:

4.本发明需要解决的技术问题是提供一种基于建筑和环境的神经网络sge电力预测方法,能够实现准确的负荷预测。

5.为解决上述技术问题,本发明所采用的技术方案是:

6.一种基于建筑和环境的神经网络sge电力预测方法,包括以下步骤:

7.s1、现实数据集构建,对建筑物信息、环境信息、电力信息进行数据预处理;

8.s2、特征工程,对所述现实数据集的特征进行时间戳处理、特征选择和特征缩放,得到特征时序矩阵;

9.s3、将特征时序矩阵x=[x1,x2,...xn]

t

输入sge电力预测方法;

[0010]

s4、将sge模型最终电力负荷预测值与电力负荷真实值y进行对比,得出模型的效果。

[0011]

本发明技术方案的进一步改进在于:s3具体包括以下步骤:

[0012]

s31、特征时序矩阵进入前馈神经网络,进行特征扩充与有效信息过滤;

[0013]

s32、将经过前馈神经网络的x

ff

进行规范化;

[0014]

s33、将经过规范化的特征时序矩阵x

off

输入到sg层;

[0015]

s34、将经过sg层生成的两个特征矩阵x

ein_1

、x

ein_2

与事先经过规范化的特征时序

矩阵x

off

输入到编码器中进行运算;

[0016]

s35、经过若干个s34组成的编码器进行运算,输出电力负荷预测结果

[0017]

s36、对于每层神经网络使用adam算法更新。

[0018]

本发明技术方案的进一步改进在于:s31具体包括以下步骤:

[0019]

s311、特征时序矩阵先输入到前馈神经网络的隐藏层,公式如下:

[0020]

x

ffh

=xw

ffh

[0021]

其中,w

ffh

为前馈神经网络层的权重矩阵,x

ffh

为经过前馈神经网络中的隐藏层转换后的特征时序矩阵;

[0022]

s312、特征时序矩阵经过隐藏层,进入sigmoid激活函数,sigmoid激活函数公式如下:

[0023][0024]

s313、特征时序矩阵经过sigmoid激活函数,进入输出层,输出层公式如下:

[0025]

x

ff

=sigmoid(x

ffh

)w

ffo

[0026]

其中,w

ffo

为输出层的权重矩阵,x

ff

为经过前馈神经网络的最终输出。

[0027]

本发明技术方案的进一步改进在于:s32中,将经过前馈神经网络的x

ff

进行规范化,公式如下:

[0028][0029]

其中,normlization(x

ff

)为矩阵归一化方式,e[x

ff

]是x

ff

的期望,var(x

ff

)是x

ff

的方差。

[0030]

本发明技术方案的进一步改进在于:s33具体包括以下步骤:

[0031]

s331、特征时序矩阵x

off

先输入到轻量级卷积神经网络shufflenetv2中,具体包括以下步骤:

[0032]

s3311、将特征时序矩阵x

off

进行通道分割,输出x

cs

;

[0033]

s3312、将x

csp

进行卷积操作,激活函数为relu,公式如下:

[0034]

x

cs1

=conv(x

csp

)

[0035]

x

cs1a

=relu(x

cs1

)=max(0,x

cs1

)

[0036]

x

cs2

=dwconv(x

cs1a

)

[0037]

x

cs3

=conv(x

cs2

)

[0038]

x

cs3a

=relu(x

cs3

)=max(0,x

cs3

)

[0039]

其中,x

csp

为x

cs

分割的一部分,其中p表示所切割后的序号,conv为卷积操作,dwconv是深度卷积操作;

[0040]

s3313、将x

cs

、x

cs3a

进行拼接操作,公式如下:

[0041]

x

csi

=concat(x

cs

,x

cs3a

)

[0042]

s3313、将x

csi

进行通道混洗操作,促使信息流通,形成矩阵x

cso

;

[0043]

s332、征时序矩阵x

off

与矩阵x

cso

输入规范化残差网络,输出x

grui

,公式如下:

[0044][0045]

x

r1

=x

off

+x

csoa

[0046][0047]

其中,e与var分别为期望与方差;

[0048]

s333、将x

grui

输入门控循环单元,获取时序信息,输出x

gruo

,公式如下:

[0049]

重置门:

[0050][0051][0052]

更新门:

[0053][0054][0055]

记忆单元:

[0056][0057][0058]

隐藏层:

[0059][0060]

输出:

[0061][0062]

其中w

(z)

与u

(r)

为权值矩阵,在训练中学习,在学习结束时确定,h

(t-1)

为t时刻之前的隐藏层的状态,为或同运算;

[0063]

s334、征时序矩阵x

off

与矩阵x

gruo

输入规范化残差网络,输出x

ein

,公式如下:

[0064][0065]

x

r2

=x

off

+x

gruon

[0066][0067]

本发明技术方案的进一步改进在于:s34具体包括以下步骤:

[0068]

s341、令q0=x

ein_1

、k0=x

ein_2

、v0=x

off

,输入多头注意力机制进行计算,具体包括

以下步骤:

[0069]

s3411、将qi、ki、vi输入n个线性层,所述n为多头注意力机制的头数,公式如下:

[0070]qli

=qiw

iq

、k

li

=kiw

ik

、v

li

=viw

iv

[0071]

其中,i为其对应的注意力机制模块,i=1,2,......,n;

[0072]

s3412、将经过线性层的q

li

、k

li

、v

li

输入到不同的注意力机制中进行运算,得到输出headi,公式如下:

[0073]

缩放点积注意力公式:

[0074][0075]

softmax公式:

[0076][0077]

注意力机制公式:

[0078]

attention(q,k,v)=softmax(s(q,k))v

[0079]

多头注意力机制公式:

[0080]

headi=attention(q

li

,k

li

,v

li

)

[0081]

x

mo

=multihead(q,k,v)=concat(head1,head2,...,headn)

[0082]

其中,d为查询q的长度,k为所对应的注意力机制模块,dk为缩放因子,k=1,2,......,n;

[0083]

s342、多头注意力机制输出的v0与x

mo

输入规范化残差网络,输出x

mon

,公式如下:

[0084][0085]

x

r2

=x

off

+x

moa

[0086][0087]

s343、规范化残差网络的x

mon

输入前馈神经网络进行运算,得到x

ffi

;

[0088]

s343具体包括以下步骤:

[0089]

s3431、矩阵x

mon

先输入到前馈神经网络的隐藏层,公式如下:

[0090]

x

ffi_1

=x

monwff_1

[0091]

其中,w

ff_1

为本层前馈网络的权重矩阵,x

ffi_1

为经过隐藏层后x

mon

;

[0092]

s3432、特征时序矩阵经过隐藏层,进入sigmoid激活函数,sigmoid激活函数公式如下:

[0093][0094]

s3433、特征时序矩阵经过sigmoid激活函数,进入输出层,输出层公式如下:

[0095]

x

ffi

=sigmoid(x

ffi_1

)w

ffi

[0096]

s3434、将经过前馈神经网络的x

ffi_1

进行规范化,公式如下:

[0097][0098]

本发明技术方案的进一步改进在于:s4具体包括以下步骤:

[0099]

s41、通过均方误差标准衡量,公式如下:

[0100][0101]

其中,y为电力负荷真实值,为电力负荷预测值,n为数据量;

[0102]

s42、通过矫正决定系数标准衡量,公式如下:

[0103][0104][0105]

其中,var(y)表示电力负荷真实值y的方差,p是输入特征数;

[0106]

s43、通过平均绝对百分比误差标准衡量,公式如下:

[0107][0108]

由于采用了上述技术方案,本发明取得的技术进步是:

[0109]

1、本发明针对时序电力负荷数据的中的环境特征、建筑区域特征以及时序电力负荷信息存在一定的时序性和周期性,利用卷积网络构建单向的因果卷积来实现时序电力负荷数据的规律性记忆和再认识。

[0110]

2、本发明针对时序电力负荷数据中的特征存在大量无效信息的干扰,提出基于多头注意力的线性结构特征权重调整模块,针对特征信息中的无效信息进行清洗。

[0111]

3、本发明针对电力负荷数据的时间相对较长的问题,利用空洞卷积与时间残差模块来增强模型的记忆能力,缓解模型训练过程中出现的梯度问题。

附图说明

[0112]

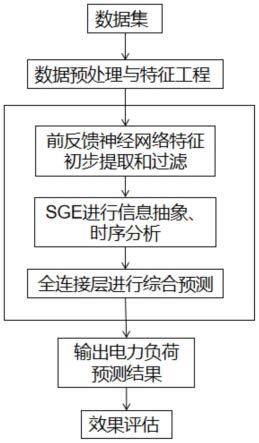

图1是本发明预测方法流程图;

[0113]

图2是本发明中sge的算法框架图。

具体实施方式

[0114]

下面结合附图及实施例对本发明做进一步详细说明:

[0115]

如图1所示,一种基于建筑与环境的深层神经网络sge电力预测方法,其中,sg为自身构造的sg层,其由shufflenet和门控循环单元(gru)构成,e为enhance(数据增强),sge电力预测为通过shufflenet和门控循环单元方法增强数据特征表达的电力预测技术,包括如下步骤:

[0116]

s1、现实数据集构建,对建筑物信息、环境信息、电力信息进行数据预处理;

[0117]

s2、特征工程,对所述现实数据集的特征进行时间戳处理、特征选择和特征缩放,

得到特征时序矩阵;

[0118]

s3、将特征时序矩阵x=[x1,x2,...xn]

t

输入sge电力预测方法;

[0119]

如图2所示,s3具体包括以下步骤:

[0120]

s31、特征时序矩阵进入前馈神经网络,进行特征扩充与有效信息过滤,具体包括以下步骤:

[0121]

s311、特征时序矩阵先输入到前馈神经网络的隐藏层,公式如下:

[0122]

x

ffh

=xw

ffh

[0123]

其中,w

ffh

为前馈神经网络层的权重矩阵,x

ffh

为经过前馈神经网络中的隐藏层转换后的特征时序矩阵。

[0124]

s312、特征时序矩阵经过隐藏层,进入sigmoid激活函数,sigmoid激活函数公式如下:

[0125][0126]

s313、特征时序矩阵经过sigmoid激活函数,进入输出层,输出层公式如下:

[0127]

x

ff

=sigmoid(x

ffh

)w

ffo

[0128]

其中,w

ffo

为输出层的权重矩阵,x

ff

为经过前馈神经网络的最终输出。

[0129]

s32、将经过前馈神经网络的x

ff

进行规范化,公式如下:

[0130][0131]

其中,normlization(x

ff

)为矩阵归一化方式,e[x

ff

]是x

ff

的期望,var(x

ff

)是x

ff

的方差;

[0132]

s33、将经过规范化的特征时序矩阵x

off

输入到sg层;

[0133]

s33具体包括以下步骤:

[0134]

s331、特征时序矩阵x

off

先输入到轻量级卷积神经网络shufflenetv2中,具体包括以下步骤:

[0135]

s3311、将特征时序矩阵x

off

进行通道分割,输出x

cs

;

[0136]

s3312、将x

csp

进行卷积操作,激活函数为relu,公式如下:

[0137]

x

cs1

=conv(x

csp

)

[0138]

x

cs1a

=relu(x

cs1

)=max(0,x

cs1

)

[0139]

x

cs2

=dwconv(x

cs1a

)

[0140]

x

cs3

=conv(x

cs2

)

[0141]

x

cs3a

=relu(x

cs3

)=max(0,x

cs3

)

[0142]

其中,x

csp

为x

cs

分割的一部分,其中p表示所切割后的序号,conv为卷积操作,dwconv是深度卷积操作;

[0143]

s3313、将x

cs

、x

cs3a

进行拼接操作,公式如下:

[0144]

x

csi

=concat(x

cs

,x

cs3a

)

[0145]

s3313、将x

csi

进行通道混洗操作,促使信息流通,形成矩阵x

cso

;

[0146]

s332、征时序矩阵x

off

与矩阵x

cso

输入规范化残差网络,输出x

grui

,公式如下:

[0147][0148]

x

r1

=x

off

+x

csoa

[0149][0150]

其中,e与var分别为期望与方差;

[0151]

s333、将x

grui

输入门控循环单元,获取时序信息,输出x

gruo

,公式如下:

[0152]

重置门:

[0153][0154][0155]

更新门:

[0156][0157][0158]

记忆单元:

[0159][0160][0161]

隐藏层:

[0162][0163]

输出:

[0164][0165]

其中w

(z)

与u

(r)

为权值矩阵,在训练中学习,在学习结束时确定,h

(t-1)

为t时刻之前的隐藏层的状态,为或同运算。

[0166]

s334、征时序矩阵x

off

与矩阵x

gruo

输入规范化残差网络,输出x

ein

,公式如下:

[0167][0168]

x

r2

=x

off

+x

gruon

[0169][0170]

s34、将经过sg层生成的两个特征矩阵x

ein_1

、x

ein_2

与事先经过规范化的特征时序矩阵x

off

输入到编码器中进行运算;

[0171]

s34具体包括以下步骤:

[0172]

s341、令q0=x

ein_1

、k0=x

ein_2

、v0=x

off

,输入多头注意力机制进行计算,具体包括以下步骤:

[0173]

s3411、将qi、ki、vi输入n个线性层,所述n为多头注意力机制的头数,公式如下:

[0174]qli

=qiw

iq

、k

li

=kiw

ik

、v

li

=viw

iv

[0175]

其中,i为其对应的注意力机制模块,i=1,2,......,n;

[0176]

s3412、将经过线性层的q

li

、k

li

、v

li

输入到不同的注意力机制中进行运算,得到输出headi,公式如下:

[0177]

缩放点积注意力公式:

[0178][0179]

softmax公式:

[0180][0181]

注意力机制公式:

[0182]

attention(q,k,v)=softmax(s(q,k))v

[0183]

多头注意力机制公式:

[0184]

headi=attention(q

li

,k

li

,v

li

)

[0185]

x

mo

=multihead(q,k,v)=concat(head1,head2,...,headn)

[0186]

其中,d为查询q的长度,k为所对应的注意力机制模块,dk为缩放因子,k=1,2,......,n;

[0187]

s342、多头注意力机制输出的v0与x

mo

输入规范化残差网络,输出x

mon

,公式如下:

[0188][0189]

x

r2

=x

off

+x

moa

[0190][0191]

s343、规范化残差网络的x

mon

输入前馈神经网络进行运算,得到x

ffi

;

[0192]

s343具体包括以下步骤:

[0193]

s3431、矩阵x

mon

先输入到前馈神经网络的隐藏层,公式如下:

[0194]

x

ffi_1

=x

monwff_1

[0195]

其中,w

ff_1

为本层前馈网络的权重矩阵,x

ffi_1

为经过隐藏层后x

mon

;

[0196]

s3432、特征时序矩阵经过隐藏层,进入sigmoid激活函数,sigmoid激活函数公式如下:

[0197][0198]

s3433、特征时序矩阵经过sigmoid激活函数,进入输出层,输出层公式如下:

[0199]

x

ffi

=sigmoid(x

ffi_1

)w

ffi

[0200]

s3434、将经过前馈神经网络的x

ffi_1

进行规范化,公式如下:

[0201][0202]

s35、经过若干个s34组成的编码器进行运算,输出电力负荷预测结果

[0203]

s36、对于每层神经网络使用adam算法更新。

[0204]

s4、将sge模型最终电力负荷预测值与电力负荷真实值y进行对比,得出模型的效果;

[0205]

s4具体包括以下步骤:

[0206]

s41、通过均方误差(mse)标准衡量,公式如下:

[0207][0208]

其中,y为电力负荷真实值,为电力负荷预测值,n为数据量;

[0209]

s42、通过矫正决定系数(adjusted r-square)标准衡量,公式如下:

[0210][0211][0212]

其中,var(y)表示电力负荷真实值y的方差,p是输入特征数;

[0213]

s43、通过平均绝对百分比误差(mape)标准衡量,公式如下:

[0214][0215]

综上所述,本发明能sge模型相较于其他模型可以实现较快的收敛,并且可解释性强,对噪声数据具有一定的鲁棒性,在处理异常数据上有较为优秀的表现,够实现准确的负荷预测。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1