基于深度网络的多组分、多尺度织物三维模型的重构方法与流程

基于深度网络的多组分、多尺度织物三维模型的重构方法

【技术领域】

1.本发明涉及一种织物三维模型的建模方法,具体涉及一种基于深度网络的多组分、多尺度织物三维模型的重构方法,属于织物模型生成技术领域。

背景技术:

2.伴随着人们生活水平的提高,传统的单组分织物已不能满足人们的生活需求,多组分织物成为纺织领域的发展方向。但是,每种组分织物的印染工艺不一样,染整工艺参数的制定与各组份的比例直接相关。现有加工技术条件下,都是经过小样加工、大货配方流程来实现工艺参数的制定,这样效率较低,所以迫切需要一种基于织物模型的方法预先确定工艺参数来提高其智能决策水平。

3.传统的织物建模方法主要依靠计算机辅助设计或参数化建模等直接、正向建模方法,如中国专利文献cn108446522a和cn109583048a所示,但是此类方法只能同时对单一尺度、固定组分的织物进行正向建模而无法构建优秀的已存在的织物模型,而重构真实织物的三维模型数据集无论是在织物干燥、定型等方面的仿真研究还是工艺参数的制定方面都具有重大意义,所以需要找到一种能够快速重构出大型织物模型数据集方法。

4.基于织物的多孔特性,目前引进多孔材料模型重构思路,进行织物模型重构。其中,最直接的模型重构方法是基于ct扫描,采用高端的纳米ct对材料直接扫描可建立三维模型,但此方法耗费太多,且每次都需要按照要求单独重构。所以进一步地,一些基于数值的重构方法逐渐发展起来了,如高斯法、模拟退火方法、多点统计法等,但这些方法仍然存在耗时长、经济开销大、重构出来的多孔介质模型连通性差,分辨率低等问题。近年来,基于深度学习算法的多孔模型重构技术成为热门的研究领域之一,为三维多孔介质重构开辟了新的道路,现今的研究主要是基于标准gan和dcgan等网络利用二维图片重构三维模型,如中国专利文献cn109801375b提出了一种基于深度卷积对抗神经网络的多孔质材料三维重构方法,其利用二维sem电镜图像训练dcgan网络后生成新的图像,然后利用插值方法获得层与层之间的拟合图像,最后通过图像堆叠重构三维模型,但从二维图片重构三维模型基本上只能提取平面上的信息,没有考虑到多孔结构3d模型的全局信息(如通道的曲率等),不能完全反应真实多孔结构。

5.因此,为解决上述问题,确有必要提供一种创新的基于深度网络的多组分、多尺度织物三维模型的重构方法,以克服现有技术中的所述缺陷。

技术实现要素:

6.本发明的目的在于提供一种基于深度网络的多组分、多尺度织物三维模型的重构方法,其同时利用3d模型和2d图片训练神经网络,综合考虑了多孔结构的全局信息和平面信息,能够快速重构出大量的织物三维模型,构建起大数据集,继而在此基础上进行数值模拟,预先确定染整工艺参数。

7.为实现上述目的,本发明采取的技术方案为:基于深度网络的多组分、多尺度织物

三维模型的重构方法,其包括如下步骤:

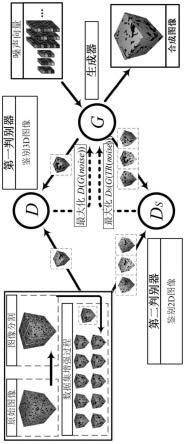

8.1),构建基于无监督学习的织物三维模型的生成对抗神经网络3d-style-gan重构模型,该模型由一个生成器g与两个判别器d和ds构成;

9.2),3d-style-gan模型训练;

10.将潜向量空间中的噪声向量输入生成器中,生成器对输入向量进行恢复,生成三维织物模型;判别器d接收三维样本输入,判别器ds接收二维样本输入;对于判别器ds,同时输入三个笛卡尔坐标方向的2d切片图像,使得判别器ds能够从空间的多个方向逐层识别输入图像;当训练次数达到设定的迭代次数,得到训练好的3d-style-gan模型;

11.3),将已经学习到的具有特定概率密度分布的噪声向量输入到训练好的3d-style-gan模型中即可得到各自的重构模型,再进行重构3d模型与真实3d模型的统计特性对比,确定重构模型的效果。

12.本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述步骤1)中,生成器g将生成的3d模型分割为2d切片,具体实现方式为,通过转置操作实现所生成的3d模型旋转,得到三种状态的3d模型,然后对三种状态的3d进行整型操作,得到三个维度方向的2d切片,将此转置和整型功能记为tr操作。

13.本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述步骤1)中,生成器g包括合成网络和输入模块;其中,所述合成网络包含5个子块顺序连接,最后设计一层额外的tanh激活函数层;子块能处理的体素分辨率从43至643间变化;第一子块包含一层输入层和三层卷积层,输入层接收可变尺寸输入张量,通过输入不同尺寸的张量让模型获得直接生成任意分辨率样本的能力,并且去除原始style-gan生成器合成网络中的adain全局归一化操作;后面每个子块都包含一个上采样卷积层和三个卷积层,上采样卷积层实现体素精度较上层翻倍,所有卷积层卷积核大小为3x3x3。

14.本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述输入模块包含20个向量,每个向量与一个学习比例因子相乘后分别输入给合成网络每一层。

15.本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述判别器ds由五个顺序连接的子块组成,每个子块均有一个卷积核大小为3x3的降采样卷积层和两个卷积核大小为3x3卷积层;最后一个子块后面包含两个全连接层,第一全连接层包含128个神经元,第二全连接层包含1个神经元;输入判别器的图像为64x64,通道数为1,经过五重卷积后,通道数变为128,图像尺寸压缩为2x2,将其展平为512维的一维向量,然后与拥有128个神经元的第一隐藏层全连接,再与只有一个神经元的第二隐层全连接,最终输出判别结果;所述判别器d的架构同理。

16.本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述步骤2)中,模型训练策略如下式:

[0017][0018]

式中,x表示训练图片,g()和d()分别表示经过生成器和判别器处理之后得到结果,tr()表示对3d模型进行装置和整型操作得到的2d切片图片。

[0019]

本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述步骤2)中,生成器g的损失函数为:

[0020][0021]

判别器d的损失函数为:

[0022][0023]

判别器ds的损失函数为:

[0024][0025]

式中,λ为[0,1]之间的随机变量,η为梯度惩罚因子,α和β为正则项系数,x(i)为来自真实数据的样本,noise(i)为均匀分布随机噪声向量集合,n表示batch-size,s表示单位长度的切片数量,tr

i=x,y,z

分别表示每个方向的转置和整型操作。

[0026]

本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述步骤3)的统计特性对比方法包括两点相关函数和闵可夫斯基泛函。

[0027]

本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法进一步为:所述两点相关函数具体为:

[0028]

s2(r)=p(o∈w,o+r∈w)for o,r∈r3式中:o和o+r表示两点,r为距离矢量,可分别测量两点之间的三个笛卡尔坐标方向的距离和径向方向的距离。

[0029]

本发明的基于深度网络的多组分、多尺度织物三维模型的重构方法还为:所述闵可夫斯基泛函具体为:

[0030]

体积:v=t4[0031]

表面积:s=2t

3-6t3[0032]

平均宽度:b=t3/2-t3+3t4/2

[0033]

欧拉参数:χ=t

1-t2+t

3-t4[0034]

式中,t1表示顶点的数量,t2表示边的数量,t3表示面的数量,t4表示体的数量。

[0035]

与现有技术相比,本发明具有如下有益效果:

[0036]

1.本发明通过构建无监督学习的织物三维模型的生成对抗神经网络3d-style-gan重构模型,利用已构建的数据库训练此模型,训练后的模型得到多组分、多尺度织物三维模型重构能力,使得在需求大数据集制定多组分织物染整工艺时,能够快速、准确地重构出所需的织物三维模型。

[0037]

2.本发明同时利用3d模型和2d图片训练神经网络,综合考虑了多孔结构的全局信息和平面信息,能够快速重构出大量的织物三维模型,构建起大数据集,继而在此基础上进行数值模拟,预先确定染整工艺参数。

【附图说明】

[0038]

图1是本发明的步骤1)中生成对抗神经网络的工作示意图。

[0039]

图2是本发明的判别器ds的模型架构图。

[0040]

图3是本发明的生成器g的模型架构图。

[0041]

图4是本发明的tr操作的示例分析图。

[0042]

图5是本发明的步骤2)模型训练的流程图。

[0043]

图6是基于原始style-gan多尺度合成模型和本发明3d-style-gan多尺度合成模型对比图。

[0044]

图7是真实3d模型、3d-style-gan重构模型以及标准gan重构模型外观对比图。

[0045]

图8是真实3d模型、3d-style-gan重构模型以及标准gan重构模型分别沿x,y,z方向的两点相关函数s2(r)值随r变化曲线对比图。

[0046]

图9是真实3d模型、3d-style-gan重构模型以及标准gan重构模型分别对体积、表面积、平均宽度以及欧拉参数的闵可夫斯基泛函对比图。

【具体实施方式】

[0047]

请参阅说明书附图1至附图9所示,本发明为一种基于深度网络的多组分、多尺度织物三维模型的重构方法,其包括如下工艺步骤:

[0048]

1),构建基于无监督学习的织物三维模型的生成对抗神经网络3d-style-gan重构模型。3d-style-gan是基于style-gan的原理改进的算法模型,其能根据2d和3d输入更好地控制重构模型的风格,其中2d输入让网络能够关注到平面上的信息,3d输入能够让网络关注到全局信息,也能够通过调整输入向量的大小调整重构模型的尺度,使重构模型的参数和尺度能够更加符合真实模型。

[0049]

所述模型由一个生成器g与两个判别器d和ds构成。其中,所述生成器g具备切片功能,即能将生成的3d模型分割为2d切片,具体实现方式为,通过转置操作实现所生成的3d模型旋转,得到三种状态的3d模型,然后对三种状态的3d进行整型操作,得到三个维度方向的2d切片,将此转置和整型功能记为tr操作。通过tr操作,数据形式可以从n

xcxdxhx

w改变至n

xcxhx

w,n为batch-size,c为通道数,d,h和w分别为特征图的长、宽、高,结合图4所示tr过程示例图以4x4x4的样本为例分析,数据形式可从n

xcx4x4x

4切片为4份n

xcx4x

4。

[0050]

如图2所示,所述生成器g包括合成网络和输入模块。所述合成网络包含5个子块顺序连接,最后设计一层额外的tanh激活函数层。子块能处理的体素分辨率从43至643间变化,第一子块包含一层输入层和三层卷积层,输入层接收可变尺寸输入张量,可以通过输入不同尺寸的张量让模型获得直接生成任意分辨率样本的能力,提高了网络在多尺度织物重构中的适应性,并且去除原始style-gan生成器合成网络中的adain全局归一化操作,后面每个子块都包含一个上采样卷积层和三个卷积层,其中的上采样卷积层实现体素精度较上层翻倍,所有卷积层卷积核大小为3x3x3。

[0051]

结合图6分析,其中(a)(b)图是保留合成网络中的adain全局归一化操作重构的图,(c)(d)图是去除adain全局归一化操作重构的图重构的图,两者均能够在64x64尺寸的图片上获得很好的重构效果,但是在160x160尺寸的图片重构上,前者重构的图片非常模糊,后者获得很好的效果,表明去除adain全局归一化操作能提高网络多尺度重构能力。

[0052]

所述输入模块包含20个向量,每个向量与一个学习比例因子相乘后分别输入给合成网络每一层。

[0053]

进一步的,所述判别器ds和判别器d架构同理,两者均由五个顺序连接的子块组成。判别器ds中每个子块均有一个卷积核大小为3x3(判别器d为3x3x3)的降采样卷积层和两个卷积核大小为3x3(判别器d的卷积核大小为3x3x3)卷积层,特别地,最后一个子块后面包含两个全连接层,第一全连接层包含128个神经元,第二神经元包含1个神经元。输入判别器的图像为64x64,通道数为1,经过五重卷积后,通道数变为128,图像尺寸压缩为2x2,将其展平为512维的一维向量,然后与拥有128个神经元的第一隐藏层全连接,再与只有一个神经元的第二隐层全连接,最终输出判别结果。

[0054]

2),3d-style-gan模型训练。

[0055]

如图5所示,将潜向量空间中的噪声向量输入生成器中,生成器对输入向量进行恢复,生成三维织物模型;判别器d接收三维样本输入,判别器ds接收二维样本输入;对于判别器ds,同时输入三个笛卡尔坐标方向的2d切片图像,使得判别器ds能够从空间的多个方向逐层识别输入图像,从而提高模型质量;当训练次数达到设定的迭代次数,得到训练好的3d-style-gan模型。

[0056]

其中,模型训练策略需综合考虑生成器g和步骤1所示tr操作内容,其公式如下式:

[0057][0058]

式中,x表示训练图片,g()和d()分别表示经过生成器和判别器处理之后得到结果,tr()表示对3d模型进行装置和整型操作得到的2d切片图片。

[0059]

生成器g的损失函数为:

[0060][0061]

判别器d的损失函数为:

(r)值越接近表示重构质量越好,显然,从图7可知,3d-style-gan重构出来的模型质量优于利用标准gan网络重构的模型。

[0079]

图9所示为真实3d模型、3d-style-gan重构模型以及标准gan重构模型分别对体积、表面积、平均宽度以及欧拉参数的闵可夫斯基泛函对比图,从左至右分别为对体积、表面积、平均宽度以及欧拉参数的闵可夫斯基泛函对比图,每一张图中,第一个表示真实模型,第二个表示3d-style-gan重构模型,第三个表示标准gan重构模型,结果表明,3d-style-gan重构模型在误差和集中度方面都有较好的效果。

[0080]

以上的具体实施方式仅为本创作的较佳实施例,并不用以限制本创作,凡在本创作的精神及原则之内所做的任何修改、等同替换、改进等,均应包含在本创作的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1