信息处理装置的制作方法

1.本公开涉及执行与由摄像机拍摄的对象的动作相应的演出的技术。

背景技术:

2.近年来,在开源(open source)中公开了用于估计人的姿势的库(library)。该库使用实施了深度学习的神经网络,从二维图像中检测人的关节位置等特征点,并将特征点接合,由此估计人的姿势。专利文献1公开了利用这样的姿势估计模型来估计所拍摄的人的姿势并使机器人装置的姿势与估计出的用户的姿势同步的机器人系统。

3.现有技术文献

4.专利文献

5.专利文献1:日本特开2020-204890号公报

技术实现要素:

6.发明要解决的课题

7.在直播会场、音乐厅中,进行配合演员的动作而使照明变化、或使声音的音量变化的演出。以往,这样的演出以人工的方式进行,演出负责人判断演出的开始时机以及结束时机,手动地控制照明设备、音响设备。在由演员进行的表演中,演出负责人观察演员的动作并进行使演出与演员的动作同步的作业,但该作业负担大。

8.因此,本公开的目的在于,提供一种自动执行与演员等对象的动作相应的演出的技术。

9.用于解决课题的手段

10.为了解决上述课题,本发明的某一方式的信息处理装置具备:获取部,获取摄影对象的多个部位的位置信息;导出部,导出两个部位之间的长度;以及演出控制部,基于所导出的长度执行演出。

11.本发明的另一方式的信息处理装置具备:获取部,获取摄影对象的多个部位的位置信息;导出部,导出连结两个部位的方向;以及演出控制部,基于所导出的方向执行演出。

12.另外,以上的构成元素的任意的组合、将本发明的表述在方法、装置、系统、记录介质、计算机程序等之间进行变换而得的方式,作为本发明的方式而有效。

附图说明

13.图1是示出执行与演员的动作相应的演出的演出系统的例子的图。

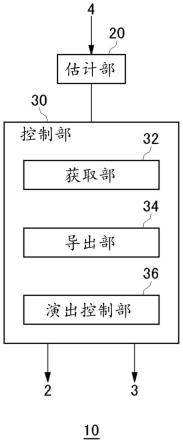

14.图2是示出实施例的信息处理装置的结构的图。

15.图3是示出估计出演员的多个部位的位置的结果的例子的图。

16.图4是示出演员的多个部位的具体例的图。

17.图5是示出导出的两个部位之间的长度的例子的图。

18.图6是示出导出的两个部位之间的长度的另一个例子的图。

19.图7是示出连结导出的两个部位的方向的例子的图。

20.图8是示出演出控制部生成的影像的例子的图。

21.图9是示出演出控制部实施了影像演出的影像的例子的图。

22.附图标记说明

23.1:演出系统;

24.2:照明设备;

25.3:音响设备;

26.4:摄像机;

27.5:舞台;

28.10:信息处理装置;

29.20:估计部;

30.30:控制部;

31.32:获取部;

32.34:导出部;

33.36:演出控制部。

具体实施方式

34.图1示出执行与演员(表演者)的动作相应的演出的演出系统1的例子。在舞台5设置用于进行光演出的多个照明设备2和用于进行声音演出的多个音响设备3。演出系统1也可以利用于音乐厅、户外舞台等演员在观众面前表演的会场。在图1中,示出了包含照明设备2以及音响设备3的演出设备设置在舞台5的情形,但这些演出设备也可以设置在舞台5的周边,只要配置在能够对演员、舞台5周边的观众提供光演出和/或声音演出的位置即可。

35.摄像机4以规定的周期拍摄在舞台5上表演中的演员。摄像机4是能够获取进深(深度)的信息的三维摄像机,可以是立体摄像机、tof(飞行时间(time of flight))摄像机。摄像机4以规定的周期(例如30帧/秒)对演员所存在的三维空间进行拍摄。

36.照明设备2具备能够变更光的照射方向的可动部,照射光的颜色、光量通过后述的信息处理装置(参照图2)动态地变更。音响设备3具备能够变更声音的输出方向的可动部,音量、输出音的效果通过信息处理装置动态地变更。在演出系统1中,信息处理装置从摄像机4被提供拍摄了演员的图像,并基于该图像控制基于照明设备2的光演出和/或基于音响设备3的声音演出,提升直播表演。

37.图2示出实施例的信息处理装置10的结构。信息处理装置10具备估计演员的姿势和/或位置的估计部20和控制演出的控制部30。控制部30具有获取部32、导出部34以及演出控制部36。在由演员进行的表演中,控制部30从音响设备3输出音乐。

38.在图2中,关于记载为进行各种各样的处理的功能块的各元素,在硬件上能够包含电路块、存储器、其他lsi、cpu,在软件上通过加载于存储器的程序等实现。因此,这些功能块能够仅通过硬件、仅通过软件、或通过它们的组合以各种方式实现,这一情况对于本领域技术人员是可以理解的,而并不限定于某一种。在信息处理装置10中,估计部20和控制部30可以由相同的处理器实现,但也可以由不同的处理器实现。

39.估计部20接收由摄像机4拍摄了作为摄影对象的演员的图像,并估计演员的身体

的多个部位的位置。以往提出了识别人体的部位位置的各种各样的方法,估计部20可以使用以往的姿势估计技术来估计演员的各部位的位置。

40.图3示出估计出演员的多个部位的位置的结果的例子。估计部20估计三维空间的演员的多个部位的位置,提供给控制部30。估计部20估计三维空间的演员的多个部位的位置,将相邻的两个部位用直线(骨骼(bone))来连结,由此能够估计三维空间的演员的姿势以及位置。估计部20实时实施姿势估计处理,也就是说,以与摄像机4的拍摄周期相同的周期实施姿势估计处理,将估计结果提供给控制部30。在控制部30中,获取部32以规定的周期获取作为摄影对象的演员的身体的多个部位的位置信息。

41.在实施例中,演员也可以是配合音乐跳舞的舞者,舞台5中的演员的姿势、位置随时间的经过而变化。演出控制部36根据演员的动作,控制照明设备2和/或音响设备3,执行光演出和/或声音演出。

42.图4示出演员的多个部位的具体例。在实施例中,获取部32获取演员的身体的19个部位的位置信息,具体地,获取鼻子50a、颈部50b、右肩50c、右肘50d、右手腕50e、右手50f、左肩50g、左肘50h、左手腕50i、左手50j、中央腰50k、右腰50l、右膝盖50m、右脚踝50n、右脚尖50o、左腰50p、左膝盖50q、左脚踝50r、左脚尖50s的位置信息。

43.在实施例中采用的人体模型中,定义19个部位,并且对每个部位定义了与该部位相邻的部位。例如对于颈部50b,定义鼻子50a、右肩50c、左肩50g、中央腰50k作为相邻的部位,将相邻的两个部位用骨骼来连结。例如对于右肘50d,定义右肩50c、右手腕50e作为相邻的部位。这样,在人体模型中,定义了多个部位和两个部位间的连结关系,估计部20基于该人体模型,估计演员的多个部位的位置信息。

44.若获取部32获取演员的多个部位的位置信息,则导出部34导出两个部位之间的长度。演出控制部36基于所导出的两个部位间的长度执行演出。

45.图5示出导出的两个部位之间的长度的例子。导出部34导出右手50f与左手50j之间的长度l,演出控制部36基于所导出的长度l执行演出。长度l可以根据右手50f的三维坐标值和左手50j的三维坐标值导出。另外,右手50f和左手50j是一例,导出部34也可以导出其他两个部位之间的长度l。

46.图6示出导出的两个部位之间的长度的另一个例子。演员始终在活动,因此右手50f与左手50j之间的长度l不间断地变化。

47.演出控制部36也可以根据所导出的长度l,调整由音响设备3输出的音乐的音量。例如演出控制部36可以在长度l变长时增大音乐的音量,并在长度l变短时减小音乐的音量。另外,演出控制部36也可以在长度l变长时减小音乐的音量,并在长度l变短时增大音乐的音量。除了音量以外,演出控制部36可以在音乐中实施与长度l相应的声音效果,可以根据长度l,使声音效果的参数变化。例如演出控制部36可以在长度l变长时放大并增强高音域,并在长度l变短时放大并增强低音域。

48.演出控制部36可以根据所导出的长度l,调整照明设备2的光量。例如演出控制部36在长度l变长时增大光量,并在长度l变短时减小光量。此时,演出控制部36也可以对多个照明设备2的可动部进行控制以使照射右手50f或左手50j,并且根据所导出的长度l调整照明设备2的光量。另外,演出控制部36也可以在长度l变长时减小光量,并在长度l变短时增大光量。除了光量以外,演出控制部36可以调整照射光的颜色,可以根据长度l,使照射光的

颜色变化。

49.在实施例的演出系统1中,优选导出部34导出在人体模型中不相邻的两个部位之间的长度,并且演出控制部36基于不相邻的两个部位间的长度执行演出。上述的右手50f和左手50j是在人体模型中不相邻的两个部位的一例,但由于不相邻的两个部位之间的长度l与相邻的两个部位之间的长度相比,能够大幅变化,所以适合于利用为动态的演出的参数。例如导出部34可以导出人体的右半身的一个部位与左半身的一个部位之间的长度作为演出参数。演员可以通过识别被设定为演出参数的两个部位,从而进行意识到该两个部位间的长度的表演、例如在左右方向上大幅活动的表演。

50.此外,导出部34也可以导出人体的上半身的一个部位与下半身的一个部位之间的长度作为演出参数。演员可以通过识别被设定为演出参数的两个部位,从而进行意识到该两个部位间的长度的表演、例如在上下方向上大幅活动的表演。

51.另外,并不限于规定的1组(特定的两个部位)之间的长度,导出部34也可以导出规定的多个组之间的长度作为演出参数,演出控制部36也可以基于各组之间的长度执行演出。例如演出控制部36也可以基于第1组的部位间的长度执行控制了音响设备3的声音演出,也可以基于与第1组不同的第2组的部位间的长度执行控制了照明设备2的光演出。

52.导出部34也可以导出连结两个部位的方向作为其他演出参数。演出控制部36基于所导出的方向执行演出。

53.图7示出连结导出的两个部位的方向的例子。导出部34导出连结左肘50h与左手50j的方向矢量d,演出控制部36基于所导出的方向矢量d执行演出。在导出连结两个部位的方向矢量时,导出部34可以在人体模型中从中心部分观察,将更靠内侧的部位作为起点,将更靠外侧的部位作为终点,确定方向矢量的朝向。若比较左肘50h和左手50j,左肘50h比左手50j靠近中心部分,因此演出控制部36以左肘50h为起点,以左手50j为终点,导出方向矢量d。另外,左肘50h和左手50j是一例,导出部34可以导出连结其他两个部位的方向。

54.演出控制部36可以根据所导出的方向矢量d,调整照明设备2的光的照射方向。例如演出控制部36可以对各照明设备2的可动部进行控制,以使多个照明设备2对将方向矢量d在从起点朝向终点的方向上延长的半直线上的1点(图7中的虚线上的

×

标记)照射光。由此,演员能够明亮地照射从左肘朝向左手的方向的1点。从方向矢量d的终点到半直线上的1点为止的距离可以是预先确定的距离,或也可以设定为方向矢量的长度的规定倍。通过该光演出,演员在直播会场中,能够自由地操纵照明设备2所照射的位置,能够实现崭新的直播表演。

55.在执行这样的光演出的情况下,演员活动手臂来指定基于照明设备2的照射位置是自然的,因此,优选导出部34导出连结左臂或右臂中的两个部位的方向来利用为演出参数,但也可以导出连结手臂以外的两个部位的方向。

56.以上,基于实施例对本发明进行了说明。根据实施例,演出控制部36能够自动执行基于由导出部34所导出的演出参数的演出。该实施例是例示,这些各构成元素、各处理过程的组合能够形成各种变形例,此外,这样的变形例也属于本发明的范围,这一情况对于本领域技术人员是可以理解的。

57.在实施例中,摄像机4的摄影对象为直播表演者,但也可以是直播表演者以外的人。另外,摄像机4的摄影对象只要是确立了人体模型并能够从摄影图像中获取多个部位的

位置信息的对象,就可以是任何对象,例如也可以是人型、宠物型的自主机器人。

58.在实施例中,说明了摄像机4是能够获取进深(深度)的信息的三维摄像机,但如专利文献1所示,也可以是获取不具有进深信息的二维图像的摄像机。

59.在实施例中,获取部32导出了两个部位之间的长度l作为演出参数,但例如也可以导出演员的一个部位与演出设备之间的长度来利用为演出参数。

60.此外,在实施例中,对演出系统1利用于演员在观众面前表演的会场的情况进行了说明,但在变形例中,也可以在直播发布演员的表演时利用。在变形例中,演出控制部36可以基于由导出部34导出的演出参数,执行影像演出。

61.图8示出演出控制部36生成的影像的例子。在变形例中,演出控制部36获取摄像机4所拍摄的图像,生成发布用的影像60。

62.图9示出演出控制部36执行了影像演出的影像的例子。在该例子中,演出控制部36实施在演员的右手与左手之间有闪电划过那样的演出(图像处理)。演出控制部36可以基于由导出部34所导出的右手50f与左手50j之间的长度l,控制影像60所包含的演员的右手与左手之间的闪电的大小。

63.另外,演出控制部36可以执行基于方向矢量d的影像演出。在实施例中,演出控制部36对各照明设备2的可动部进行控制,以使多个照明设备2对将方向矢量d延长的半直线上的1点照射光,但在变形例中,演出控制部36也可以在将方向矢量d延长的半直线上的1点设定输出声音的虚拟声源,在该虚拟声源位置配置光球,并且进行如虚拟声源根据演员的手臂的动作移动那样的影像演出。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1