一种图像增强方法、装置、电子设备及存储介质与流程

1.本技术涉及计算机视觉、图像处理和深度学习的技术领域,具体而言,涉及一种图像增强方法、装置、电子设备及存储介质。

背景技术:

2.图像增强,是指为了减少网络的过拟合现象,通过对训练图片进行变换可以得到泛化能力更强的网络,更好的适应应用场景,也可以强调某些关注的特征,且抑制非关注的特征。

3.目前,为了增加神经网络模型的训练数据集,通常对原始图像进行图像增强的方式都是采用随机方式进行的,这些随机方式包括:翻转变换(flip)、缩放变换(zoom)、平移变换(shift)、尺度变换(scale)、对比度变换(contrast)、噪声(noise)添加和随机裁切等随机方式进行图像增强。然而,在具体的实施过程中发现,采用随机方式对原始图像进行图像增强,并使用得到的增强图像训练模型后,这些模型泛化性能并没有明显提升。因此,采用随机方式进行图像增强得到的增强图像难以提升模型泛化性能。

技术实现要素:

4.本技术实施例的目的在于提供一种图像增强方法、装置、电子设备及存储介质,用于改善进行图像增强得到的增强图像难以提升模型泛化性能的问题。

5.本技术实施例提供了一种图像增强方法,包括:使用神经网络模型对原始图像进行特征提取,获得隐特征向量;对隐特征向量进行修改,获得修改后的隐向量;根据修改后的隐向量对原始图像进行图像增强,获得原始图像对应的增强图像。在上述方案的实现过程中,通过使用神经网络模型对原始图像进行特征提取,并对获得的隐特征向量进行修改,获得修改后的隐向量,然后根据修改后的隐向量对原始图像进行图像增强,由于对神经网络模型提取的隐特征向量进行修改,修改后的隐向量用于引导神经网络模型生成能够提升模型泛化性能的增强图像,因此,使用获得的增强图像能够提升模型泛化性能,从而有效地提高了模型泛化性能。

6.可选地,在本技术实施例中,神经网络模型是自编码网络;使用神经网络模型对原始图像进行特征提取,包括:使用自编码网络中的编码器对原始图像进行特征提取;根据修改后的隐向量对原始图像进行图像增强,包括:使用自编码网络中的生成器根据修改后的隐向量对原始图像进行图像增强。在上述方案的实现过程中,通过采用自编码网络中的编码器和生成器对原始图像进行图像增强,从而使得自编码网络中的编码器和生成器能够更好地生成用于提升模型泛化性能的增强图像,因此,使用获得的增强图像能够提升模型泛化性能,从而有效地提高了模型泛化性能。

7.可选地,在本技术实施例中,神经网络模型是超网络;根据修改后的隐向量对原始图像进行图像增强,包括:使用修改后的隐向量修改超网络的网络参数,获得修改后的超网络;通过修改后的超网络对原始图像进行图像增强。在上述方案的实现过程中,通过修改后

的超网络对原始图像进行图像增强,使得修改后的超网络能够更好地生成用于提升模型泛化性能的增强图像,因此,使用获得的增强图像能够提升模型泛化性能,从而有效地提高了模型泛化性能。

8.可选地,在本技术实施例中,对隐特征向量进行修改,包括:获取修改向量,并在隐特征向量的基础上增加修改向量。在上述方案的实现过程中,通过获取修改向量,并在隐特征向量的基础上增加修改向量,获得的修改后的隐向量用于引导生成能够提升模型泛化性能的增强图像,因此,使用获得的增强图像能够提升模型泛化性能,从而有效地提高了模型泛化性能。

9.可选地,在本技术实施例中,获取修改向量,包括:获取样本图像和样本标签,样本标签是对样本图像进行图像增强获得的增强图像;使用神经网络模型对样本图像进行图像增强,获得预测增强图像;根据预测增强图像与样本标签之间的图像像素损失值确定修改向量。在上述方案的实现过程中,通过根据预测增强图像与样本标签之间的图像像素损失值确定修改向量,从而避免了难以确定修改向量的问题,有效地提高了确定修改向量的准确率。

10.可选地,在本技术实施例中,获取修改向量,包括:获取样本图像和样本标签,样本标签是样本图像所属的类别标签;对样本图像进行类别预测,获得预测图像类别;根据预测图像类别与类别标签之间的分类损失值确定修改向量。在上述方案的实现过程中,通过根据预测图像类别与类别标签之间的分类损失值确定修改向量,从而避免了难以确定修改向量的问题,有效地提高了确定修改向量的准确率。

11.可选地,在本技术实施例中,获取修改向量,包括:获取样本图像和样本标签,样本标签包括:样本图像对应的增强图像和类别标签;使用神经网络模型对样本图像进行图像增强,获得预测增强图像,并对样本图像进行类别预测,获得预测图像类别;计算出预测增强图像与样本标签之间的图像像素损失值,并计算出预测图像类别与类别标签之间的分类损失值;根据图像像素损失值和分类损失值确定修改向量。在上述方案的实现过程中,通过根据图像像素损失值和分类损失值确定修改向量,从而避免了难以确定修改向量的问题,有效地提高了确定修改向量的准确率。

12.本技术实施例还提供了一种图像增强装置,包括:特征向量获得模块,用于使用神经网络模型对原始图像进行特征提取,获得隐特征向量;特征向量修改模块,用于对隐特征向量进行修改,获得修改后的隐向量;增强图像获得模块,用于根据修改后的隐向量对原始图像进行图像增强,获得原始图像对应的增强图像。

13.可选地,在本技术实施例中,神经网络模型是自编码网络;特征向量获得模块,包括:图像特征提取子模块,用于使用自编码网络中的编码器对原始图像进行特征提取;增强图像获得模块,包括:原始图像增强子模块,用于使用自编码网络中的生成器根据修改后的隐向量对原始图像进行图像增强。

14.可选地,在本技术实施例中,神经网络模型是超网络;增强图像获得模块,包括:网络参数修改子模块,用于使用修改后的隐向量修改超网络的网络参数,获得修改后的超网络;网络图像增强子模块,用于通过修改后的超网络对原始图像进行图像增强。

15.可选地,在本技术实施例中,特征向量修改模块,包括:向量增减修改子模块,用于获取修改向量,并在隐特征向量的基础上增加修改向量。

16.可选地,在本技术实施例中,向量增减修改子模块,包括:第一数据获取单元,用于获取样本图像和样本标签,样本标签是对样本图像进行图像增强获得的增强图像;增强图像预测单元,用于使用神经网络模型对样本图像进行图像增强,获得预测增强图像;第一向量确定单元,用于根据预测增强图像与样本标签之间的图像像素损失值确定修改向量。

17.可选地,在本技术实施例中,向量增减修改子模块,包括:第二数据获取单元,用于获取样本图像和样本标签,样本标签是样本图像所属的类别标签;图像类别预测单元,用于对样本图像进行类别预测,获得预测图像类别;第二向量确定单元,用于根据预测图像类别与类别标签之间的分类损失值确定修改向量。

18.可选地,在本技术实施例中,向量增减修改子模块,包括:第三数据获取单元,用于获取样本图像和样本标签,样本标签包括:样本图像对应的增强图像和类别标签;数据类别预测单元,用于使用神经网络模型对样本图像进行图像增强,获得预测增强图像,并对样本图像进行类别预测,获得预测图像类别;图像损失计算单元,用于计算出预测增强图像与样本标签之间的图像像素损失值,并计算出预测图像类别与类别标签之间的分类损失值;第三向量确定单元,用于根据图像像素损失值和分类损失值确定修改向量。

19.本技术实施例还提供了一种电子设备,包括:处理器和存储器,存储器存储有处理器可执行的机器可读指令,机器可读指令被处理器执行时执行如上面描述的方法。

20.本技术实施例还提供了一种计算机可读存储介质,该计算机可读存储介质上存储有计算机程序,该计算机程序被处理器运行时执行如上面描述的方法。

21.本技术实施例的其他特征和优点将在随后的说明书阐述,并且,部分地从说明书中变得显而易见,或者通过实施本技术实施例了解。

附图说明

22.为了更清楚地说明本技术实施例的技术方案,下面将对本技术实施例中所需要使用的附图作简单地介绍,应当理解,以下附图仅示出了本技术实施例中的某些实施例,因此不应被看作是对范围的限定,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他相关的附图。

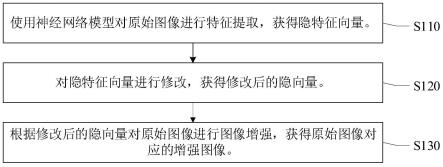

23.图1示出的本技术实施例提供的图像增强方法的流程示意图;

24.图2示出的本技术实施例提供的使用自编码网络进行图像增强的示意图;

25.图3示出的本技术实施例提供的使用超网络进行图像增强的示意图;

26.图4示出的本技术实施例提供的图像增强装置的结构示意图;

27.图5示出的本技术实施例提供的电子设备的结构示意图。

具体实施方式

28.下面将结合本技术实施例中附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术实施例中的一部分实施例,而不是全部的实施例。通常在此处附图中描述和示出的本技术实施例的组件可以以各种不同的配置来布置和设计。因此,以下对在附图中提供的本技术实施例的详细描述并非旨在限制要求保护的本技术实施例的范围,而是仅仅表示本技术实施例中的选定实施例。基于本技术实施例,本领域技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本技术实施

例保护的范围。

29.可以理解的是,本技术实施例中的“第一”、“第二”用于区别类似的对象。本领域技术人员可以理解“第一”、“第二”等字样并不对数量和执行次序进行限定,并且“第一”、“第二”等字样也并不限定一定不同。

30.在介绍本技术实施例提供的图像增强方法之前,先介绍本技术实施例中所涉及的一些概念:

31.深度学习(deep learning),是机器学习中一种基于对数据进行表征学习的算法,深度学习是机器学习的分支,也是一种以人工神经网络为架构,对数据进行表征学习的算法。

32.卷积神经网络(convolutional neural networks,cnn),是一种人工神经网络,人工神经网络的人工神经元可以响应周围单元,可以进行大型图像处理;卷积神经网络可以包括卷积层和池化层。

33.kl散度(kullback-leibler divergence,kld),在信息系统中称为相对熵(relative entropy),在连续时间序列中称为随机性(randomness),在统计模型推断中称为信息增益(information gain),也称信息散度(information divergence),是指两个概率分布p和q差别的非对称性的度量。

34.需要说明的是,本技术实施例提供的图像增强方法可以被电子设备执行,这里的电子设备是指具有执行计算机程序功能的设备终端或者服务器,设备终端例如:智能手机、个人电脑、平板电脑、个人数字助理或者移动上网设备等。服务器是指通过网络提供计算服务的设备,服务器例如:x86服务器以及非x86服务器,非x86服务器包括:大型机、小型机和unix服务器。

35.下面介绍该图像增强方法适用的应用场景,这里的应用场景包括但不限于:图像压缩(即原始图像是未被压缩的图像,使用该图像增强方法对原始图像进行增强,获得的增强图像是像素被压缩过的图像)、超分辨率重建深度学习的数据增强和图像分类等应用场景。此处的超分辨率重建的应用场景具体例如:使用该图像增强方法从原始图像中提取和修改隐特征向量,并根据修改后的隐特征向量对原始图像进行增强,获得的增强图像的分辨率大于原始图像的分辨率,在获得分辨率更高的增强图像之后,还可以将增强图像用于图像分类的应用场景中。此处的深度学习的数据增强的应用场景具体例如:训练数据集中包括a类别图像和b类别图像,如果a类别图像的数量少于b类别图像的数量,那么可以使用该图像增强方法对a类别图像进行图像增强,从而获得更多的a类别图像,使得a类别图像的数量与b类别图像的数量大致相等。

36.请参见图1示出的本技术实施例提供的图像增强方法的流程示意图;本技术实施例提供了一种图像增强方法,包括:

37.步骤s110:使用神经网络模型对原始图像进行特征提取,获得隐特征向量。

38.神经网络模型(neural network model),是指使用预设的训练数据对未经训练的神经网络进行训练后获得的神经网络模型,具体是用于对原始图像进行特征提取的网络模型。此处的神经网络模型具体可以采用自编码网络(auto-encoder networks)或者超网络(hyper networks)等等。

39.原始图像,是指需要进行图像增强的图像,此处的原始图像可以是rgb彩色图像

(即rgb三个通道构成的三维矩阵),也可以是黑白图像。若原始图像是rgb彩色图像的三维矩阵,那么在图像增强后获得的增强图像是不同与原始图像的新三维矩阵。

40.隐特征向量(latent feature vector,lfv),又被称为潜空间表示(latent space representation,lsr)或者潜空间表示向量(lsr vector),是指神经网络模型从图像中提取出来的潜空间表示向量。

41.步骤s120:对隐特征向量进行修改,获得修改后的隐向量。

42.由于上述步骤s120中的隐特征向量的修改方式有很多种,因此将在下面详细地描述隐特征向量的修改方式,此处便不再赘述。

43.步骤s130:根据修改后的隐向量对原始图像进行图像增强,获得原始图像对应的增强图像。

44.由于上述步骤s130中的图像增强方式有很多种,因此将在下面详细地描述图像增强方式,此处便不再赘述。

45.在上述的实现过程中,通过使用神经网络模型对原始图像进行特征提取,并对获得的隐特征向量进行修改,获得修改后的隐向量,然后根据修改后的隐向量对原始图像进行图像增强,由于对神经网络模型提取的隐特征向量进行修改,修改后的隐向量用于引导神经网络模型生成能够提升模型泛化性能的增强图像,因此,使用获得的增强图像能够提升模型泛化性能,从而有效地提高了模型泛化性能。

46.可以理解的是,在使用上述图像增强方法对图像进行增强时,可以是针对一个数据集中的全部图像进行增强。即针对一个图像数据集,可以使用该图像增强方法将所有原始图像进行图像增强(即根据修改后的隐特征向量进行图像增强),并将增强后的增强图像加入神经网络模型的训练数据集(训练数据集包括:样本图像和样本标签)中,从而完成对图像训练数据的扩充功能。本技术实施例提供的图像增强方法与传统通过镜像变换、反转变换等基于图像变换或引入噪声的数据增强方式扩充不同,该图像增强方法可以理解为,根据修改后的隐向量将原始图像中的部分与分类无关的原始特征进行了替换,因此新生成的增强图像无法使用矩阵变换的方式恢复为原始图像,从而从另外一个维度丰富了图像的多样性。另外,本技术实施例提供的图像增强方法还可以与镜像变换、反转变换等基于图像变换增强方式结合使用,即数据集中的一部分图像使用该图像增强方法来进行图像增强,数据集中的另一部分图像使用基于图像变换增强方式进行图像增强,从而有效地增加数据扩充的倍数。

47.另外,也可以是针对一个数据集中的特定图像(例如具有某一类特征的少样本图像)进行增强,即从图像数据集中筛选出一张图像确定为原始图像,使用上述图像增强方法对该原始图像进行增强,并将增强获得的增强图像加入该图像数据集中,从而完成该图像数据集的数据扩充功能。当该图像数据集有共性且作为神经网络的训练数据时,可以针对该图像数据集中的某一类特征的少样本图像进行图像增强,从而增加少样本图像的数量,改善该图像数据集中某一类特征的样本图像数量过少导致数据类别不均衡的问题。在针对该图像数据集中的某一类特征的少样本图像进行图像增强时,由于神经网络模型(例如自编码网络或超网络)提取出这一类特征的训练过程中,神经网络模型会根据这一类特征更新自己的网络参数,所以,在对同一类特征的少样本图像进行特征提取(以及后续的图像增强)时,可以直接使用更新后的网络参数,因此,少样本图像的同一类特征在神经网络模型

的模型训练过程和图像增强的过程中是通过网络参数来共享的,从而降低了对同一类特征的少样本图像进行数据增强的计算成本,并提升了使用神经网络模型进行图像增强的性能。

48.上述图像数据集中的特定图像进行增强的例子,例如:假设一个图像数据集中包括猫的图像和狗的图像,该图像数据集的共性是均是哺乳动物的图像,当猫的图像数量少于狗的图像数量时,那么猫的图像就可以理解为少样本图像,此时可以使用上述的图像增强方法对少样本图像进行增强,以增强猫的图像数量,从而改善了猫的图像在在图像数据集中数量过少导致数据类别不均衡的问题。又例如:假设一个图像数据集中包括男人的脸部图像和女人的脸部图像,该图像数据集的共性是均是人脸图像,当女人的脸部图像数量少于男人的脸部图像数量时,那么女人的脸部图像就可以理解为少样本图像,此时可以使用上述的图像增强方法对少样本图像进行增强,以增强女人的脸部图像数量,从而改善了女人的脸部图像在在图像数据集中数量过少导致数据类别不均衡的问题。

49.请参见图2示出的本技术实施例提供的使用自编码网络进行图像增强的示意图;作为上述图像增强方法的第一种可选实施方式,上述的神经网络模型可以是自编码网络(auto-encoder networks),该自编码网络可以包括:编码器(encoder)和生成器(decoder);上述步骤s110的实施方式可以包括:

50.步骤s111:使用自编码网络中的编码器对原始图像进行特征提取,获得隐特征向量。

51.编码器(encoder),是指自编码网络中的编码器,具体可以采用很多种结构,例如可以采用线性层(又被称为全连接层)和激活函数层来构成编码器,也可以采用cnn网络(例如resnet22、resnet38、resnet50、resnet101和resnet152等等),也可以采用基于transformer网络(例如vit等等)。

52.上述步骤s111的实施方式具体例如:假设可以将原始图像的集合表示为d

imgs

={x1,x2,

…

,xn},那么可以使用自编码网络中的编码器(encoder)对原始图像的集合d

imgs

={x1,x2,

…

,xn}进行特征提取,获得的隐特征向量的集合可以表示为h={h1,h2,

…

,hn}。针对原始图像集合中的每个原始图像,上述的每个原始图像处理过程使用公式可以表示为h=e(x),其中,h表示隐特征向量,e表示自编码网络中的编码器(encoder),x表示原始图像。

53.作为上述步骤s120的第一种可选实施方式,对隐特征向量进行修改的过程可以包括:

54.步骤s121:获取修改向量,并在隐特征向量的基础上增加修改向量。

55.上述步骤s121中的获取修改向量的实施方式有很多种,在下面将详细举例说明这三种实施方式:第一种可选实施方式,根据图像像素损失值获取修改向量;第二种可选实施方式,根据分类损失值获取修改向量;第三种可选实施方式,根据图像像素损失值和分类损失值来获取修改向量。由于在下面将详细举例说明这三种实施方式,因此不再赘述。

56.上述步骤s121中的在隐特征向量的基础上增加修改向量的实施方式例如:使用公式ha=h+h

aug

在隐特征向量的基础上增加修改向量,获得修改后的隐向量;其中,ha表示修改后的隐向量,h表示修改之前的隐特征向量,h

aug

表示修改向量。

57.作为上述步骤s130的第一种可选实施方式,图像增强的过程可以包括:

58.步骤s131:使用自编码网络中的生成器根据修改后的隐向量对原始图像进行图像

增强,获得原始图像对应的增强图像。

59.上述步骤s131中的使用自编码网络进行图像增强的实施方式例如:使用自编码网络中的生成器(decoder)根据修改后的隐向量对原始图像进行图像增强,这个图像增强的过程可以使用公式表示为xr=d(ha|θd),其中,xr表示获得的增强图像,且增强图像的分辨率可以大于或等于原始图像的分辨率,θd表示自编码网络的网络参数,由于自编码网络在提取某一类特征的训练过程中,自编码网络会更新自己的网络参数,所以在对同一类特征的图像进行特征提取(以及后续的图像增强)时,可以直接使用更新后的网络参数,因此自编码网络的网络参数是可以在原始图像的集合(即用于训练其它模型的图像数据集)中共享的,ha表示修改后的隐向量,d表示自编码网络中的生成器(decoder)。

60.请参见图3示出的本技术实施例提供的使用超网络进行图像增强的示意图;作为上述图像增强方法的第二种可选实施方式,上述的神经网络模型也可以是超网络(hyper networks),即可以使用超网络提取出该原始图像的隐特征向量,然后,在隐特征向量的基础上增加修改向量,获得修改后的隐向量,并将修改后的隐向量输入超网络,以使超网络根据原始图像的未知信息(即修改后的隐向量所代表的信息)来生成增强图像。具体地,上述步骤s130中的图像增强的实施方式可以包括:

61.步骤s132:使用修改后的隐向量修改超网络的网络参数,获得修改后的超网络。

62.步骤s133:通过修改后的超网络对原始图像进行图像增强,获得原始图像对应的增强图像。

63.上述步骤s132至步骤s133的实施方式例如:假设原始图像是600

×

800的像素图像,那么提取出该原始图像的像素点所在的坐标信息,并将该原始图像的像素点所在的坐标信息输入超网络,且可以同时使用超网络提取出该原始图像的隐特征向量,然后,获取修改向量,并在隐特征向量的基础上增加修改向量,获得修改后的隐向量,并将修改后的隐向量输入超网络。超网络在接收到该原始图像的像素点所在的坐标信息和修改后的隐向量之后,可以使用修改后的隐向量修改超网络的网络参数,获得修改后的超网络,以使通过修改后的超网络对原始图像进行图像增强,也就是说,修改后的超网络可以根据原始图像的像素点所在的坐标信息和修改后的隐向量预测出该坐标信息对应的rgb三通道像素值,最后,根据该坐标信息及该坐标信息对应的rgb三通道像素值还原出增强图像。

64.可以理解的是,上述的使用超网络进行图像增强的过程可以公式表示为xr=d(c;ha|θd);其中,xr表示获得的增强图像,且增强图像的分辨率可以大于或等于原始图像的分辨率,θd表示超网络的网络参数,由于超网络在提取某一类特征的训练过程中,超网络会更新自己的网络参数,所以在对同一类特征的图像进行特征提取(以及后续的图像增强)时,可以直接使用更新后的网络参数,因此超网络的网络参数是可以在原始图像的集合(即用于训练其它模型的图像数据集)中共享的,ha表示修改后的隐向量,c表示原始图像的像素点所在的坐标信息,d表示自编码网络中的生成器(decoder)。

65.作为上述步骤s121的第一种可选实施方式,根据图像像素损失值获取修改向量的方式可以包括:

66.步骤s121a:获取样本图像和样本标签,样本标签是对样本图像进行图像增强获得的增强图像。

67.上述的样本图像和样本标签可以分开获取,具体例如:人工的搜集样本图像,并人

工地对样本图像进行图像增强,将获得的增强图像标注为样本标签;当然,也可以将样本图像和样本标签打包为第一训练数据集一起获取。

68.上述步骤s121a中的第一训练数据集的获得方式包括:第一种获得方式,使用摄像机、录像机或彩色照相机等终端设备对目标对象进行拍摄,人工搜集样本图像,并人工地对样本图像进行图像增强,将获得的增强图像标注为样本标签,获得第一训练数据集;然后该终端设备向电子设备发送第一训练数据集,然后电子设备接收终端设备发送的第一训练数据集,电子设备可以将第一训练数据集存储至文件系统、数据库或移动存储设备中;第二种获得方式,获取预先存储的第一训练数据集,具体例如:从文件系统、数据库或移动存储设备中获取第一训练数据集;第三种获得方式,使用浏览器等软件获取互联网上的第一训练数据集,或者使用其它应用程序访问互联网获得第一训练数据集。

69.步骤s121b:使用神经网络模型对样本图像进行图像增强,获得预测增强图像。

70.步骤s121c:根据预测增强图像与样本标签之间的图像像素损失值确定修改向量。

71.上述步骤s121b至步骤s121c的实施方式例如:使用神经网络模型对样本图像进行图像增强,获得预测增强图像;根据kl散度公式l(x,xr)=||x-xr||2计算出增强图像与样本标签之间的图像像素损失值,并根据图像像素损失值确定修改向量;其中,x表示原始图像,xr表示获得的增强图像,l(x,xr)表示原始图像与增强图像之间的kl散度。上述的kl散度是用来度量使用基于q的概率分布来编码服从p的概率分布的样本所需的额外的平均比特数;典型情况下,p表示数据的真实分布,q表示数据的理论分布、估计的模型分布或p的近似分布。最后,上面的根据图像像素损失值确定修改向量的具体方式例如:先随机初始化修改向量,使用公式量,使用公式对初始化的修改向量和图像像素损失值进行计算,获得最终的修改向量;其中,左边的h

aug

表示本次计算出来的修改向量,右边的h

aug

表示初始化的修改向量(或者上一次计算出来修改向量),α表示预先设置的学习率超参数,表示图像像素损失值的本次梯度值,表示修改向量的本次梯度值。

72.作为上述步骤s121的第二种可选实施方式,根据分类损失值获取修改向量的方式可以包括:

73.步骤s121d:获取样本图像和样本标签,样本标签是样本图像所属的类别标签。

74.上述的样本图像和样本标签可以分开获取,具体例如:人工搜集样本图像,并人工地识别样本图像的样本标签;当然,也可以将样本图像和样本标签打包为第二训练数据集一起获取。

75.上述步骤s121d中的第二训练数据集的获得方式包括:第一种获得方式,使用摄像机、录像机或彩色照相机等终端设备对目标对象进行拍摄,人工地识别样本图像所属的类别标签标注为样本标签,获得第二训练数据集;然后该终端设备向电子设备发送第二训练数据集,然后电子设备接收终端设备发送的第二训练数据集,电子设备可以将第二训练数据集存储至文件系统、数据库或移动存储设备中;第二种获得方式,获取预先存储的第二训练数据集,具体例如:从文件系统、数据库或移动存储设备中获取第二训练数据集;第三种获得方式,使用浏览器等软件获取互联网上的第二训练数据集,或者使用其它应用程序访问互联网获得第二训练数据集。

76.步骤s121e:对样本图像进行类别预测,获得预测图像类别。

77.步骤s121f:根据预测图像类别与类别标签之间的分类损失值确定修改向量。

78.上述步骤s121e至步骤s121f的实施方式例如:使用图像分类模型(例如lenet网络模型、alexnet网络模型、vgg网络模型、googlenet网络模型和resnet网络模型等)对样本图像进行类别预测,获得预测图像类别;根据交叉熵损失函数或者欧式距离损失函数计算出预测图像类别与类别标签之间的分类损失值;其中,l1表示分类损失值,n表示原始图像的总数量,yi表示第i个原始图像对应的类别标签,pi表示第i个原始图像对应的预测图像类别。最后,上面的根据分类损失值确定修改向量的具体方式例如:先随机初始化修改向量,使用公式对初始化的修改向量和分类损失值进行计算,获得最终的修改向量;其中,左边的h

aug

表示本次计算出来的修改向量,右边的h

aug

表示初始化的修改向量(或者上一次计算出来修改向量),α表示预先设置的学习率超参数,表示分类损失值的本次梯度值,表示修改向量的本次梯度值。

79.作为上述步骤s121的第三种可选实施方式,根据图像像素损失值和分类损失值来获取修改向量的方式可以包括:

80.步骤s121g:获取样本图像和样本标签,样本标签包括:样本图像对应的增强图像和类别标签。

81.其中,该步骤s121g的实施原理和实施方式与步骤s121a和步骤s121d的实施原理和实施方式是类似的,因此,这里不再说明其实施原理和实施方式,如有不清楚的地方,可以参考步骤s121a和步骤s121d的描述。

82.步骤s121h:使用神经网络模型对样本图像进行图像增强,获得预测增强图像,并对样本图像进行类别预测,获得预测图像类别。

83.上述步骤s121h的实施方式例如:使用神经网络模型(例如上述的自编码网络或者超网络)对样本图像进行图像增强,获得预测增强图像,并使用图像分类模型(例如lenet网络模型、alexnet网络模型、vgg网络模型、googlenet网络模型和resnet网络模型等)对样本图像进行类别预测,获得预测图像类别。

84.步骤s121i:计算出预测增强图像与样本标签之间的图像像素损失值,并计算出预测图像类别与类别标签之间的分类损失值。

85.上述步骤s121i的实施方式例如:使用kl散度公式、均方误差(mean square error,mse)损失函数或者指数损失函数(exponential loss)等等计算出预测增强图像与样本标签之间的图像像素损失值,并使用交叉熵损失函数等计算出预测图像类别与类别标签之间的分类损失值。

86.步骤s121j:根据图像像素损失值和分类损失值确定修改向量。

87.上述步骤s121j的实施方式例如:使用公式对图像像素损失值与分类损失值进行计算,获得最终的修改向量;其中,左边的h

aug

表示本次计算出来的修改向量,右边的h

aug

表示初始化的修改向量(或者上一次计算出来修改向量),α表示预

先设置的学习率超参数,表示图像像素损失值与分类损失值的和值的本次梯度值,表示修改向量的本次梯度值。

88.可选地,在具体实践过程中,如果隐特征向量或者修改后的隐向量的数值大于预设阈值,则可以将隐特征向量或者修改后的隐向量进行归一化,并使用归一化后的隐特征向量或者修改后的隐向量参与上面的计算。

89.请参见图4示出的本技术实施例提供的图像增强装置的结构示意图;本技术实施例提供了一种图像增强装置200,包括:

90.特征向量获得模块210,用于使用神经网络模型对原始图像进行特征提取,获得隐特征向量。

91.特征向量修改模块220,用于对隐特征向量进行修改,获得修改后的隐向量。

92.增强图像获得模块230,用于根据修改后的隐向量对原始图像进行图像增强,获得原始图像对应的增强图像。

93.可选地,在本技术实施例中,神经网络模型是自编码网络;特征向量获得模块,包括:

94.图像特征提取子模块,用于使用自编码网络中的编码器对原始图像进行特征提取。

95.增强图像获得模块,包括:

96.原始图像增强子模块,用于使用自编码网络中的生成器根据修改后的隐向量对原始图像进行图像增强。

97.可选地,在本技术实施例中,神经网络模型是超网络;增强图像获得模块,包括:

98.网络参数修改子模块,用于使用修改后的隐向量修改超网络的网络参数,获得修改后的超网络。

99.网络图像增强子模块,用于通过修改后的超网络对原始图像进行图像增强。

100.可选地,在本技术实施例中,特征向量修改模块,包括:

101.向量增减修改子模块,用于获取修改向量,并在隐特征向量的基础上增加修改向量。

102.可选地,在本技术实施例中,向量增减修改子模块,包括:

103.第一数据获取单元,用于获取样本图像和样本标签,样本标签是对样本图像进行图像增强获得的增强图像。

104.增强图像预测单元,用于使用神经网络模型对样本图像进行图像增强,获得预测增强图像。

105.第一向量确定单元,用于根据预测增强图像与样本标签之间的图像像素损失值确定修改向量。

106.可选地,在本技术实施例中,向量增减修改子模块,包括:

107.第二数据获取单元,用于获取样本图像和样本标签,样本标签是样本图像所属的类别标签。

108.图像类别预测单元,用于对样本图像进行类别预测,获得预测图像类别。

109.第二向量确定单元,用于根据预测图像类别与类别标签之间的分类损失值确定修改向量。

110.可选地,在本技术实施例中,向量增减修改子模块,包括:

111.第三数据获取单元,用于获取样本图像和样本标签,样本标签包括:样本图像对应的增强图像和类别标签。

112.数据类别预测单元,用于使用神经网络模型对样本图像进行图像增强,获得预测增强图像,并对样本图像进行类别预测,获得预测图像类别。

113.图像损失计算单元,用于计算出预测增强图像与样本标签之间的图像像素损失值,并计算出预测图像类别与类别标签之间的分类损失值。

114.第三向量确定单元,用于根据图像像素损失值和分类损失值确定修改向量。

115.应理解的是,该装置与上述的图像增强方法实施例对应,能够执行上述方法实施例涉及的各个步骤,该装置具体的功能可以参见上文中的描述,为避免重复,此处适当省略详细描述。该装置包括至少一个能以软件或固件(firmware)的形式存储于存储器中或固化在装置的操作系统(operating system,os)中的软件功能模块。

116.请参见图5示出的本技术实施例提供的电子设备的结构示意图。本技术实施例提供的一种电子设备300,包括:处理器310和存储器320,存储器320存储有处理器310可执行的机器可读指令,机器可读指令被处理器310执行时执行如上的方法。

117.本技术实施例还提供了一种计算机可读存储介质330,该计算机可读存储介质330上存储有计算机程序,该计算机程序被处理器310运行时执行如上的方法。

118.其中,计算机可读存储介质330可以由任何类型的易失性或非易失性存储设备或者它们的组合实现,如静态随机存取存储器(static random access memory,简称sram),电可擦除可编程只读存储器(electrically erasable programmable read-only memory,简称eeprom),可擦除可编程只读存储器(erasable programmable read only memory,简称eprom),可编程只读存储器(programmable read-only memory,简称prom),只读存储器(read-only memory,简称rom),磁存储器,快闪存储器,磁盘或光盘。

119.需要说明的是,本说明书中的各个实施例均采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似的部分互相参见即可。对于装置类实施例而言,由于其与方法实施例基本相似,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

120.本技术实施例提供的几个实施例中,应该理解到,所揭露的装置和方法,也可以通过其他的方式实现。以上所描述的装置实施例仅是示意性的,例如,附图中的流程图和框图显示了根据本技术实施例的多个实施例的装置、方法和计算机程序产品的可能实现的体系架构、功能和操作。在这点上,流程图或框图中的每个方框可以代表一个模块、程序段或代码的一部分,模块、程序段或代码的一部分包含一个或多个用于实现规定的逻辑功能的可执行指令。也应当注意,在有些作为替换的实现方式中,方框中所标注的功能也可以和附图中所标注的发生顺序不同。例如,两个连续的方框实际上可以基本并行地执行,它们有时也可以按相反的顺序执行,这主要根据所涉及的功能而定。

121.另外,在本技术实施例中的各个实施例的各功能模块可以集成在一起形成一个独立的部分,也可以是各个模块单独存在,也可以两个或两个以上模块集成形成一个独立的部分。此外,在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特

点包含于本技术实施例的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。此外,在不相互矛盾的情况下,本领域的技术人员可以将本说明书中描述的不同实施例或示例以及不同实施例或示例的特征进行结合和组合。

122.在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。

123.以上的描述,仅为本技术实施例的可选实施方式,但本技术实施例的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本技术实施例揭露的技术范围内,可轻易想到变化或替换,都应涵盖在本技术实施例的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1