一种在特征空间内进行多维时序数据建模的神经网络方法及装置

1.本发明属于计算方法领域,是一种在特征空间内进行多维时序数据建模的神经网络方法及装置。

背景技术:

2.建立一种对多维数据时间序列建立神经网络模型的方法,实现对系统单位时间状态变化的驱动机制学习,并利用神经网络模型模拟系统内在机制的时序变化,是人工智能领域对时序分析的一个重要目标。

3.例如,生物发酵过程的时序数据建模与预测是实现高效生物制造的一项重要技术。发酵过程的时序数据是指,在微生物的发酵过程中,在各个时间点采集的具有时间点标签的序列数据,每个时间点包括一组固定的指标,常见的指标包括代谢组数据、发酵工艺数据、转录组数据。发酵过程时序数据建模与预测的目的是通过模拟探索发酵规律,优化发酵过程,以获得更好的经济和社会效益。

4.在多维时序数据建模的应用场景中,存在高维小样本数据的应用场景,即数据维数高,样本绝对数量很少或样本数远小于数据维数;同时,所有维度的数据并非独立变化,存在较强的数据维度间的相关性,数据维度远大于决定数据差异的独立因子的个数。例如,发酵过程的转录组和代谢组表征可以测定上万个不同指标的值来表示发酵系统在特定时间点的状态,但这些指标并非全部独立,指标之间存在复杂的关联性。

5.直接基于观察所得的数据建模,会使得模型的输入维度过大,造成模型的复杂度过大,容易引发“维数灾难”。维数灾难即随着模型的输入维数增高,模型的计算复杂度快速增高。模型的输入维数的增加也会导致模型训练所需的样本量变大。当实际观察的数据量不足时,模型容易出现过拟合,即模型仅记住了训练数据本身的特征,而不是拟合了训练数据间的内在关联;过拟合会降低模型的泛化能力。为了消除或减轻维数灾难,同时提升学习模型的泛化能力,一种策略是在建模时首先提取观察数据的特征。特征数据较观察数据有较低的维数,并可以通过固定的方法以较高的保真度还原为观察数据。用较低维度的特征数据表示较高纬度的观察数据,然后基于特征数据建模,可以有效地降低模型的输入维数,降低模型复杂度,减少对训练例子的需求,抑制模型过拟合,提升模型的泛化能力。

6.目前的降维方法,在多维时序数据的建模过程中,通常作为一种前处理步骤独立完成。方法主要有主成分分析、独立分量分析、滤波分析、因子分析等。作为一种前处理步骤,降维过程和模型学习过程是独立的。降维方法的目标是提取特定统计意义下包含数据主要信息的特征因子,例如决定指标变化或指标独立性的特征因子,而这些特征因子不一定与驱动时间序列变化的机制的关键因子相符,不能很好地支撑在低维特征因子空间内的时序机制的建模。同时,这些作为前处理的降维方法,在应用中需要配合将特征因子转换为观察值的后处理方法。转换的过程可能存在误差放大的问题,即特征因子的微小误差可能导致预测观察数据的较大误差。

7.综上所述,目前对高维小样本的时间序列建模具有以下不足:

8.1)观察数据的维度大,导致模型复杂度大,容易引发“维数灾难”,即随着维数增高,计算复杂度显著增高;

9.2)通过独立于模型学习方法的特征提取方法提取的特征因子,不一定与驱动时间序列变化的机制的关键因子相符,不能很好地支撑在低维特征因子空间内的时序机制的建模;

10.3)将特征因子转换为观察值的后处理方法在转换的过程可能存在误差放大的问题,即特征因子的微小误差可能导致预测观察数据的较大误差。

11.为了解决上述问题,我们提出了一种在特征空间内对系统多维度状态变化时间序列数据进行建模的神经网络方法。通过在自编码神经网络中嵌合串联的时间序列生成机制网络的结构设计,由自编码神经网络对观察到的时间序列提取特征,生成机制网络在特征空间内完成对时间序列生成机制的学习建模。在这一方法中,特征提取不是建模的前处理步骤,将特征还原为观察数据也不是模型预测的后处理步骤。自编码神经网络和串联生成机制网络通过嵌合,实现了特征提取和时序生成机制学习在同一框架下完成,不仅通过降维解决了模型复杂度高容易过拟合的问题,还同时解决了特征提取与机制学习目标的适配和特征数据到观察数据转换的误差放大问题。

12.上述在特征空间内对系统多维度状态变化时间序列数据进行建模的神经网络方法,可以用于建模一个生物发酵体系的工作机制。发酵体系工作机制的神经网络模型可以针对发酵过程的多组学时间序列(一类高维小样本数据),根据当前的体系状态,计算一个单位时间之后的体系状态。这一生物发酵体系的时间序列状态变化的驱动机制模型,相比于一般意义上的时间序列状态变化的数值拟合模型,能够更好地反映工程菌的各类调控机制对发酵过程的影响,能更好地指导进行工程菌的基因组改造,获得更好的生产性能。

技术实现要素:

13.本发明公开了一种在特征空间内进行多维时序数据建模的神经网络方法及装置,具体的,是通过以下技术方案来实现的:

14.一种在特征空间内进行多维时序数据建模的神经网络方法,包括以下步骤:

15.1)将原始观察数据进行规范化整理,得到形式统一的规范观察数据;

16.2)基于规范观察数据组织用于人工神经网络训练的训练例子;

17.3)设计人工神经网络的结构,建立人工神经网络模型;

18.4)利用步骤2)中的训练例子对步骤3)中建立的人工神经网络模型进行训练,得到人工神经网络的参数矩阵;

19.5)利用步骤2)中的训练例子,评估在设计人工神经网络结构的过程中使用的参数以及在对建立的人工神经网络模型进行训练的过程中使用的参数对所得的人工神经网络模型的精度影响,选取不同的参数组合下最优的人工神经网络模型作为最终的结果模型;

20.步骤3)中设计的神经网络结构具有如下特征:

21.神经网络具有嵌合训练结构(e-(g)

n-d);嵌合训练结构依次由编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d)三个模块组成;编码器模块和解码器模块分别实现观察数据到特征数据和特征数据到观察数据的转换,使串联生成机制模块可在特征空间内

学习系统的工作机制;

22.串联生成机制模块中的一个神经网络单元可以对系统从当前状态变换为一个单位时间之后状态的工作机制进行建模,这样的网络单元称为单位时间正向变化生成器(g单元);通过g单元的串联可以实现对系统经过多个单位时间发生的变化建模,由多个g单元的串联组成串联生成机制模块((g)n)。

23.作为进一步地改进,本发明所述的嵌合训练结构按如下方式建立:嵌合训练结构(e-(g)

n-d)依次由编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d)三个模块组成,编码器模块输入层神经元节点数为观察数据维数,输出层神经元节点数为特征数据维数,串联生成机制模块((g)n)由多个g单元串联得到,g单元每一层的神经元节点数均为特征数据维数,解码器模块输入层神经元节点数为特征数据维数,输出层神经元节点数为观察数据维数。

24.作为进一步地改进,本发明所述的时间间隔个数为n的嵌合训练结构称为e-(g)

n-d:n=0时e-d中不包含g单元,其训练数据为起始时间点数据和终止时间点数据为同一个时间点的训练例子;n=1时e-(g)

1-d中仅包含1个g单元,其训练数据为时间间隔个数为1的训练例子;n》1时,e-(g)

n-d中的串联生成机制模块((g)n)由n个g单元串联得到,其训练数据为时间间隔个数为n的训练例子。

25.作为进一步地改进,本发明所述的步骤4)的训练方式具体为:

26.4.1)计算每个嵌合训练结构的损失值:对于特定的嵌合训练结构:e-(g)

n-d,仅使用时间间隔为n的例子计算模型损失,将训练例子起始时间点的观察数据输入到对应时间间隔个数的嵌合训练结构中计算损失值(即时间间隔个数为n的训练例子的起始时间点的观察数据输入到嵌合训练结构(e-(g)

n-d))。训练数据输入嵌合训练结构后,通过前向传播得网络输出数据,由网络输出数据与真实数据计算嵌合训练结构的损失值。即把ti时间点的数据输入到嵌合训练结构e-(g)

n-d得到网络输出数据由网络输出数据与t

i+b

时间点的真实数据可得损失值loss,公式为可得损失值loss,公式为

27.4.2)在模型损失值的基础上,进行限制损失的反向传播层数的梯度计算:对时间间隔个数为0的嵌合训练结构,其仅包含编码器模块和解码器模块,此时训练例子的起始时间点数据和终止时间点数据为同一个时间点的观察数据。更新解码器模块和编码器模块的权值参数,其实质相当于训练一个自编码网络,更新后的权值参数与其他嵌合训练结构中的编码器模块和解码器模块共享;对时间间隔个数为1的嵌合训练结构,其仅包含1个g单元,该网络使用误差反向传播训练机制,直接得到g单元和解码器模块的更新梯度;时间间隔个数大于1的嵌合训练结构中的串联生成机制模块由多个g单元串联,采用误差反向传播机制计算梯度,截取解码器模块和最后一个g单元上的梯度作为g单元和解码器模块的更新梯度;

28.4.3)在限制损失反向传播层数的梯度计算方法的基础上,将多个嵌合训练结构按顺序进行权值更新,并在顺序权值更新的过程中共享网络权值参数,具体实现为:对于不同时间间隔的嵌合训练结构,按照一定的顺序,计算嵌合训练结构的梯度,并使用梯度下降方

法进行权值更新,更新后的权值参数共享到其它所有嵌合训练结构;

29.4.4)对k+1个嵌合训练结构e-d、e-(g)

1-d、e-(g)

2-d、e-(g)

3-d

…

e-(g)

k-d计算每个嵌合训练结构的损失值,判断是否每个嵌合训练结构的损失值都收敛,若均已收敛,则得到结果模型,否则继续重复4.1)、4.2)、4.3),直至每个串联训练结构的损失值均收敛,得到结果模型。

30.作为进一步地改进,本发明所述的步骤1)具体为:将多维时间序列观察数据整理为四元组的组织形式,即批次、时间、指标、值,经多个批次的观察得到多个批次的多维时间序列观察数据,每个批次的观察数据包括一组时间点,每个时间点的观察数据包括一组指标,每个指标的观察数据为一个具体的值。

31.作为进一步地改进,本发明所述的步骤2)具体为:将同一批次内任意两个时间点的系统状态变化组织为一个训练例子,得到一组具有不同时间间隔的训练例子,其中每个训练例子包括两个时间点的状态,当两个时间点不为相同时间点时,称较早的时间点的数据为该训练例子的起始时间点数据,称较晚的时间点的数据为该训练例子的结束时间点数据;两个时间点相同时,起始时间点数据和结束时间点数据相同;每个训练例子的起始时间点数据和结束时间点数据表示为观察数据四元组的组织形式。

32.作为进一步地改进,本发明所述的嵌合训练结构采用全连接结构。

33.作为进一步地改进,本发明所述的步骤5)具体指从模型超参数的层面对建模过程进行优化,在优化的过程中尝试调整再建模过程中使用的超参数,具体包括:特征维数;网络模块的结构参数(编码器模块、串联生成机制模块、解码器模块网络的每层节点数,隐藏层数量);梯度下降方法的学习率;每次训练投入训练数据例子数;循环训练的循环次数,采用上述超参数的不同组合,依据步骤3)和步骤4),完成建立神经网络结构和神经网络训练的工作,得到新的结果模型;评估每个超参数组合下结果模型对观察数据的拟合精度,选取最优模型。

34.本发明还公开了一种在特征空间内进行多维时序数据建模的装置,包括:

35.获取单元:用于将原始观察数据进行规范化整理,得到形式统一的规范观察数据;

36.组织单元:用于将基于规范观察数据组织用于人工神经网络训练的训练例子;

37.构建单元:用于设计人工神经网络的结构,建立人工神经网络模型;

38.训练单元:用于利用训练例子对建立的人工神经网络模型进行训练,得到人工神经网络的参数矩阵;

39.优化单元:用于利用训练例子,评估在设计人工神经网络结构的过程中使用的参数以及在对建立的人工神经网络模型进行训练的过程中使用的参数对所得的人工神经网络模型的精度影响,选取不同的参数组合下最优的人工神经网络模型作为最终的结果模型;

40.设计的神经网络结构具有如下特征:

41.神经网络具有嵌合训练结构(e-(g)

n-d);嵌合训练结构依次由编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d)三个模块组成;编码器模块和解码器模块分别实现观察数据到特征数据和特征数据到观察数据的转换,使串联生成机制模块可在特征空间内学习系统的工作机制;

42.串联生成机制模块中的一个神经网络单元可以对系统从当前状态变换为一个单

位时间之后状态的工作机制进行建模,这样的网络单元称为单位时间正向变化生成器(g单元);通过g单元的串联可以实现对系统经过多个单位时间发生的变化建模,由多个g单元的串联组成串联生成机制模块((g)n)。

43.本发明的有益效果如下:

44.1)通过编码器模块(e)实现对观察数据的特征提取,降低数据维度,在特征空间内构建生成机制模型,从而降低生成机制模型的复杂度,抑制过学习的可能性,允许使用较少的样本得到较好的训练效果;

45.2)通过自编码神经网络中嵌合串联的生成机制模型的网络结构,实现在统一的神经网络中完成特征提取和生成机制模型的训练,其训练误差在网络整体水平上计算,完成特征提取功能和生成机制模型功能的网络权重协同训练,可以达成特征提取网络和生成机制模型的适配,提升模型拟合精度;

46.3)通过在串联的生成机制模型的两侧添加编码器和解码器,使在特征空间工作的生成模型可以使用实际观察数据进行训练和预测,同时确保了生成机制模型输出的特征数据可以准确地还原为观察数据,有利于模型应用。

附图说明

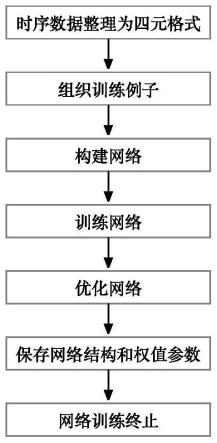

47.图1为模型训练步骤示意图;

48.图2为训练例子组织方式示例图;

49.图3为串联生成机制模块结构示意图;

50.图4为嵌合训练结构的损失限制性反向传播示意图。

具体实施方式

51.本发明设计的嵌合训练结构(e-(g)

n-d)包含三个模块:编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d),可用于建模发酵生物体系的整体机制,包括菌体生理、催化反应、相应工艺和营养条件调控的机制。通过对这一机制模型的分析,可以得到机制优化的可能方案,指导对发酵过程的优化,包括对目标产物的产量预测、工程菌的基因组改造与发酵条件设计。本发明公开的方法通过以下步骤对发酵生物体系的整体机制建模;图1为模型训练步骤示意图;

52.1.整理时序数据格式为四元组织形式

53.建模分析的对象是“生物发酵体系”,生物发酵体系包括菌种和发酵环境,因此模型需要能够学习和预测反映菌种状态和发酵环境的指标。菌种状态和发酵环境可以通过多种组学技术表征,发酵过程是由多个时间点组成的时间序列;因此,这些发酵时序数据可以整理为这样的四元组织形式:批次、时间、指标、值。发酵时序数据分为训练数据和测试数据。训练数据用于建立模型,测试数据用于评估模型的精度。

54.设数据为以阿卡波糖为目标产物的放线菌发酵过程中测量得到的时序数据,有(m+u)个批次(例如m=7,u=3),每个批次有(k+1)个时间点(例如k=10,每个时间点分别记为t1,t2,t3…

t

11

)。

55.对(m+u)个批次的放线菌发酵过程中每个批次对应的(k+1)个时间点的样本,通过质谱测定每个样本中的各类化合物的丰度,选定其中与阿卡波糖合成相关的化合物q个(例

如q=196),从每个时间点的样本的化合物丰度报告中提取这q个化合物的丰度,作为该时间点生物发酵系统状态的观察值,质谱没有观测到的化合物丰度记为缺失。记在这批样本中,其中第2个批次的t3时间点和第3批次的t2时间点,由于样本测定的实验失败,造成数据缺失。

56.将(m+u)个批次的放线菌发酵数据分为训练数据和测试数据,其中有m个批次为训练数据批次,有u个批次为测试数据批次。因此,所有数据共有(m+u)个批次,每个批次有(k+1)个时间点(t1,t2,t3…

t

k+1

),每个时间点有q维指标数据值,其中第m个批次中第p个时间点的q维数据表示为

[0057][0058]

2.组织训练数据例子

[0059]

图2为训练例子组织方式示例图;将m个批次的放线菌发酵数据作为训练数据,根据步骤1中的四元组织形式,对同一批次内任意两个时间点的系统状态变化组织为一个例子,ta与tb分别表示例子的起始时间点和终止时间点,实例训练数据被组织为:

[0060]

批次1例子集合d1:

[0061]

批次2例子集合d2:

[0062]

批次3例子集合d3:

[0063]

批次m例子集合dm:

[0064]

其中4≤m≤m-1,m∈n

*

[0065]

批次m例子集合dm:

[0066]

再将各个批次中的例子汇总,按照例子中ta与tb两个时间点间隔大小,被重新组织为:

[0067][0068][0069][0070][0071][0072]

3.为不同时间间隔的训练例子建立g单元的嵌合训练结构

[0073]

图3为串联生成机制模块结构示意图;搭建编码器模块(e)和解码器模块(d):两个模块均为全连接神经网络,编码器模块(e)的输入层的节点数为观察数据维数r、隐藏层的节点数均为s、隐藏层层数为f1、输出层的节点数为特征数据维数e。解码器模块(d)的输入层的节点数为特征数据维数e、隐藏层的节点数均为s、隐藏层层数为f1、输出层的节点数为观察数据维数r。用表示在第n个嵌合训练结构e-(g)

n-d中编码器模块(e)和解码器模块(d)的网络权值参数(为表示方便,网络权重参数和网络偏置参数统称为网络权值参数)。

[0074]

搭建串联生成机制模块((g)n):g单元的网络由输入层,隐藏层,输出层组成,其中

每一层的节点数均为e,隐藏层层数为f2。对不同时间间隔的训练例子,根据其时间间隔个数来将g单元串联起来得到对应的串联生成机制模块:g、(g)2、g)3…

(g)k,用表示为第n个嵌合训练结构e-(g)

n-d中串联生成机制模块(g)i的第j个g单元的网络权值参数。

[0075]

再由编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d)三个模块依次嵌合组成嵌合训练结构(e-(g)

n-d)。

[0076]

各个嵌合训练结构参数具体为:

[0077]

e-d中没有g单元:权值参数有

[0078]

e-(g)

1-d中有1个g单元:权值参数有

[0079]

e-(g)

2-d中有2个g单元:权值参数有

[0080]

e-(g)

3-d中有3个g单元:权值参数有

[0081][0082]

e-(g)

k-d中有k个g单元:权值参数有

[0083]

对各个嵌合训练结构的g单元、e模块和d模块初始权值参数设置为相同随机值:即:训练开始前时都等于训练开始前时都等于训练开始前时都等于训练开始前时都等于

[0084]

4.计算模型损失值

[0085]

将c组训练例子的起始时间点ta的多维数据,输入到对应时间间隔个数的嵌合训练结构中计算损失值。即将集合合中的c个起始时间点t的多维数据输入e-(g)

n-d中,得到输出数据其中n≤k、n∈n。与tb时间点多维真实数据可计算得损失值lossn,计算公式为

[0086]

5.通过损失限制性反向传播计算梯度,通过顺序循环优化更新网络权值参数

[0087]

图4为嵌合训练结构的损失限制性反向传播示意图;对时间间隔个数为0时的嵌合训练结构,其仅包含编码器模块和解码器模块,更新解码器模块和编码器模块的权值参数。

[0088]

对时间间隔个数为1的嵌合训练结构,其仅包含1个g单元,该网络使用误差反向传播训练机制,直接得到g单元和解码器模块的更新梯度。

[0089]

时间间隔个数大于1的嵌合训练结构中的串联生成机制模块由多个g单元串联,采用误差反向传播机制计算梯度,截取解码器模块和最后一个g单元上的梯度作为g单元和解码器模块的更新梯度。具体计算公式为:

[0090]

对时间间隔个数为0时的嵌合训练结构,e-d只计算编码器模块和解码器模块的更新梯度,即

[0091]

[0092][0093]

对时间间隔个数为1的嵌合训练结构e-(g)

1-d,计算和解码器模块的更新梯度,即

[0094][0095][0096]

对时间间隔个数为2的嵌合训练结构e-(g)

2-d,计算和解码器模块的更新梯度,即

[0097][0098][0099]

对时间间隔个数为3的嵌合训练结构e-(g)

3-d,计算和解码器模块的的更新梯度,即

[0100][0101][0102][0103]

对时间间隔个数为k的嵌合训练结构e-(g)

k-d,计算和解码器模块的更新梯度,即

[0104][0105][0106]

上述梯度计算方法每次仅计算嵌合训练结构最后两个结构单元(当时间间隔为0时,仅计算为解码器模块和编码器模块的梯度,当时间间隔个数大于1时,仅计算最后一个g单元的梯度和编码器模块的梯度),所以本发明将这一方法称为损失限制性反向传播。

[0107]

在上述方法计算所得的梯度基础上,对于不同时间间隔的嵌合训练结构,按照时间间隔个数大小顺序,先计算较小时间间隔的嵌合训练结构的梯度,并使用sgd随机梯度下降方法进行权重更新,更新后的权重共享到其它所有嵌合训练结构,本发明将这一训练方法称为顺序循环优化。设置循环训练中循环次数参数为h,其中第t次循环训练流程为:

[0108]

先计算e-d中编码器模块和解码器模块的更新梯度,即d中编码器模块和解码器模块的更新梯度,即其中,α表示sgd梯度下降方法的学习率;表示第t-1次循环训练训练结束时编码器模块和解码器模块更新后的权值参数,表示第t次循环编码器模块和解码器模块更新后的权值参数;将编码器模块和解码器模块更新后的梯度权值参数共享到其它嵌合训练结构中即:

[0109]

都等于都等于

[0110]

再计算e-(g)

1-d中单元和解码器模块的更新权值,即单元和解码器模块的更新权值,即单元和解码器模块的更新权值,即其中,表示第t-1次循环训练训练结束时g1中单元更新后的权值参数,表示第t次循环g1中单元更新后的权值参数;

[0111]

将单元和解码器模块更新后的梯度权值参数共享到其它嵌合训练结构中即:

[0112]

都等于都等于都等于

[0113]

计算e-(g)

2-d中单元和解码器模块的更新权值,即单元和解码器模块的更新权值,即单元和解码器模块的更新权值,即再将单元和解码器模块更新后的梯度权值参数共享到其它所有嵌合训练结构中。

[0114]

按照相同的计算方法以此更新e-(g)

3-d、e-(g)

4-d、e-(g)

5-d

…

e-(g)

k-d,当本循环训练计算到e-(g)

k-d中单元和解码器模块更新完权值并共享到其它嵌合训练结构,本次循环训练结束,进入到下一次循环训练计算。

[0115]

6.在全部训练结构损失收敛后得到结果模型

[0116]

在第5步的每次循环训练后,对k+1个嵌合训练结构e-d、e-(g)

1-d、e-(g)

2-d、e-(g)

3-d

…

e-(g)

k-d按照第4步的方式输入对应时间间隔的全部训练例子,可以得到每个串联训练模块的全数据损失值。具体计算为:

[0117]

计算e-d的损失值,即

[0118]

计算e-(g)

1-d的损失值,即d的损失值,即

[0119]

计算e-(g)

2-d的损失值,即d的损失值,即

[0120]

计算e-(g)

3-d的损失值,即d的损失值,即

[0121][0122]

计算e-(g)

k-d的损失值,即d的损失值,即

[0123]

判断loss0,loss1,loss2,loss3,

…

,lossk是否都收敛,如果是,则进行下一步,否则继续步骤4和步骤5的计算,直至loss0,loss1,loss2,loss3,

…

,lossk都收敛。记训练过程经历h次循环后嵌合训练结构的整体损失收敛

[0124]

7.调整模型超参数,优化结果模型

[0125]

步骤6完成训练得到结果模型后,调整模型的超参数:特征维数e,网络模块的结构参数(编码器模块和解码器模块的隐藏层的节点数s、隐藏层层数f1;串联生成机制模块每层的节点数e,隐藏层层数为f2),sgd随机梯度下降方法的学习率α,单次循环训练投入训练例子数c,循环训练的循环次数h。通过对超参数的组合调整后,重复步骤4-6直至网络loss差值收敛,终止训练。

[0126]

8.得到最优模型

[0127]

经步骤7的超参数优化后,得到最优的g单元、编码器模块和解码器模块。保存g单元、编码器模块和解码器模块的网络结构和网络权值两组参数。并利用测试数据对模型的预测精度进行验证。

[0128]

将应用案例中第一步所述的u个批次的放线菌发酵数据作为测试数据,每个批次有k+1个时间点(t1,t2,t3…

t

k+1

),每个时间点有q个指标,将测试数据以第1、第2步骤的方式组织为:

[0129][0130][0131][0132][0133][0134]

其中,中有共n

l

个例子,l≤k、l∈n

*

。

[0135]

计算e-d的预测精度,即

[0136]

计算e-(g)

1-d的预测精度,即d的预测精度,即

[0137]

计算e-(g)

2-d的预测精度,即d的预测精度,即

[0138]

计算e-(g)

3-d的预测精度,即d的预测精度,即

[0139][0140]

计算e-(g)

k-d的预测精度,即d的预测精度,即

[0141]

由此得到生物发酵系统机制模型中编码器模块(e)、解码器模块(d)和系统机制模型(g单元)用于预测不同时间间隔的生物发酵体系中系统状态改变时的精度预期。

[0142]

本发明还公开了一种应用对多维数据时间序列进行建模方法的对多维数据时间序列进行建模的装置,包括:

[0143]

获取单元:用于将原始观察数据进行规范化整理,得到形式统一的规范观察数据;

[0144]

组织单元:用于将基于规范观察数据组织用于人工神经网络训练的训练例子;

[0145]

构建单元:用于设计人工神经网络的结构,建立人工神经网络模型;

[0146]

训练单元:用于利用训练例子对建立的人工神经网络模型进行训练,得到人工神经网络的参数矩阵;

[0147]

优化单元:用于利用训练例子,评估在设计人工神经网络结构的过程中使用的参数以及在对建立的人工神经网络模型进行训练的过程中使用的参数对所得的人工神经网络模型的精度影响,选取不同的参数组合下最优的人工神经网络模型作为最终的结果模型;

[0148]

所述的设计的神经网络结构具有如下特征:

[0149]

神经网络具有嵌合训练结构(e-(g)

n-d);嵌合训练结构依次由编码器模块(e)、串联生成机制模块((g)n)、解码器模块(d)三个模块组成;编码器模块和解码器模块分别实现观察数据到特征数据和特征数据到观察数据的转换,使串联生成机制模块可在特征空间内学习系统的工作机制;

[0150]

串联生成机制模块中的一个神经网络单元可以对系统从当前状态变换为一个单位时间之后状态的工作机制进行建模,这样的网络单元称为单位时间正向变化生成器(g单元);通过g单元的串联可以实现对系统经过多个单位时间发生的变化建模,由多个g单元的串联组成串联生成机制模块((g)n)。

[0151]

以上并非是对本专利具体实施方式的限制。应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明实质范围的前提下,还可以做出若干变化、改型、添加或替换,这些改进和润饰也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1