一种基于嵌套U型网络结构的图像去模糊方法

本发明属于图像处理、计算机视觉,具体涉及一种基于嵌套u型网络结构的图像去模糊方法。

背景技术:

1、作为外界客观世界信息记录和传递的载体,图像一直是人类获取和辨别客观世界信息的主要来源和手段。然而,在图像的拍摄过程中会经常发生由相机抖动或物体运动引发的图像模糊问题。由于模糊的图像失去了清晰的结构和丰富的纹理信息,使得人们很难从中获取清晰的内容和精细的信息。因此,如何实现图像去模糊,使其可以更好的应用于高级图像处理(图像检测、图像识别)等领域已经成为了一个研究热点。

2、针对如何清晰化模糊图像这个问题,人们主要从以下两个方面展开研究:基于传统的方法和基于深度学习的图像去模糊方法。基于传统方法的图像去模糊方法依靠于从图像中手动提取先验或图像的统计信息,并在此基础上建模优化方程,通过迭代求解优化方程得到恢复后的图像。由于传统方法仅在有限的图像上提取先验,因此这类方法只在特定模糊图像上获得较好的去模糊结果,而在其他模糊图像上泛化性较低。此外,迭代求解优化函数需要耗费大量的时间,因而这类方法并不能很好的满足算法对实时性的要求。基于深度学习的图像去模糊问题通过在大量的数据集上提取特征,并在网络模型训练的过程中不断迭代选取更适合图像恢复的权值,从而恢复潜在的标签图像。虽然图像去模糊问题已经取得了一些成绩,但恢复得到的图像并不十分令人满意。例如,一些基于深度学习的方法中存在网络参数过多、网络模型过大的问题,而这无疑对网络训练在硬件配置方面提出了更高的要求;另外一些方法仅适用于合成的模糊图像,在实际的模糊图像中泛化性和鲁棒性较弱。

技术实现思路

1、本发明的目的是为了克服现有技术中的不足,通过综合利用对抗生成模型以及结构注意机制,提供一种能够有效减少网络模型大小、满足图像去模糊实时处理需求,解决图像纹理和细节丢失等问题的图像去模糊方法。

2、本发明的目的是通过以下技术方案实现的:

3、一种基于嵌套u型网络结构的图像去模糊方法,其特征在于,包括以下步骤:

4、(1)准备数据,包括模糊图像和标签图像;搭建生成对抗网络模型并设置参数;其中标签图像为未经模糊退化的清晰图像,生成对抗网络模型包括生成网络和判别网络两个子网络;

5、(2)设置生成网络和判别网络的网络结构框架;生成网络的网络结构框架采用u型网络结构,生成网络包括编码器和解码器两部分,编码器用以下采样并提取输入图像中有用的细节特征进行编码,解码器用于上采样并解码输入图像;其中,编码器和解码器又分别包括若干个独立的u型网络结构,每一水平的编码器和解码器保持相同的分辨率,所述编码器和解码器用于学习重建生成图像的特征;具体的:

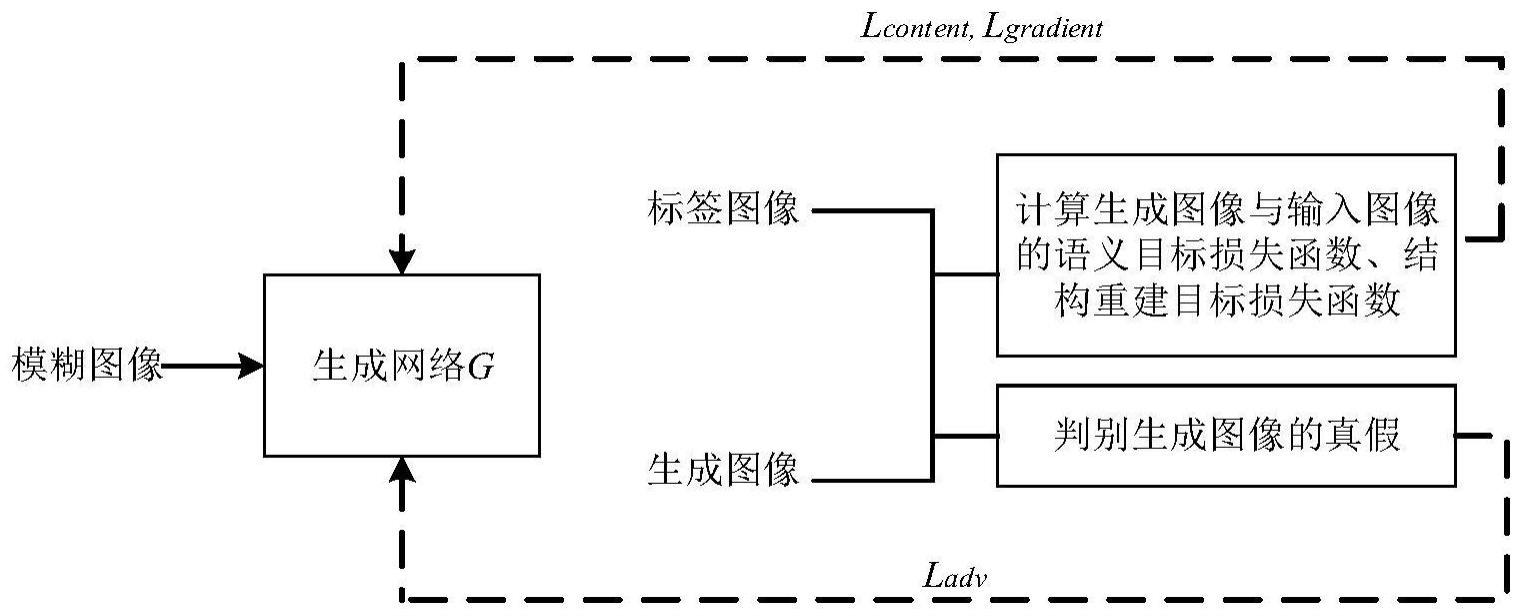

6、将模糊图像送入生成网络中,在生成网络优化训练过程中,对生成网络增加语义目标损失函数和结构目标损失函数的约束,使得生成图像具有和标签图像一致的语义及结构信息;判别网络将判别的结果反馈给生成网络,驱使生成网络能够生成图像结构较为完整的图像;生成网络根据判别网络的反馈更新生成网络的参数进入下一次的迭代训练,生成网络和判别网络以上述描述的方式不断竞争训练,直到训练使生成对抗网络模型收敛;

7、(3)设置生成对抗网络模型的目标损失函数:生成网络中的目标损失函数包括图像语义目标损失函数lcontent、图像结构重建目标损失函数lgradient;其中,lcontent保证恢复前后的图像能保持相同的语义内容,lgradient约束生成图像与标签图像,在图像结构方面具有一致性;判别网络中的目标损失函数ladv,ladv用于完成生成图像与标签图像的判别,以提升判别网络对图像真假的判别学习能力;

8、(4)将模糊图像、标签图像输送到生成对抗网络模型中,判别网络用以判别生成图像和标签图像在内容方面的一致性;判别网络将判断得到的结果反馈给生成网络,生成网络和判别网络之间竞争学习,直到达到纳什均衡,生成对抗网络模型收敛;将模糊图像载入到训练收敛的生成网络中,最终得到结构完整的生成图像。

9、进一步的,步骤(3)中,生成对抗网络模型的目标损失函数加权地表示为:

10、l(g,d)=βlcontent+λlgradient+αladv

11、其中,β,λ和α分别是lcontent,lgradient和ladv的权重系数;各约束项的权重系数约束如下:β=10,λ=12,α=1,值越大代表对应部分越重要。

12、进一步的,生成网络采用一个双层嵌套的u型网络结构,第一层u型网络结构是指由六个阶段的编码器和五个阶段的解码器构成的u型网络结构,六个阶段的编码器包括从上到下依次设置的第一编码器、第二编码器、第三编码器、第四编码器、第五编码器、第六编码器;五个阶段的解码器包括从下到上依次设置的第五解码器、第四解码器、第三解码器、第二解码器、第一解码器;所述第一编码器与第一解码器位于同一水平面,所述第二编码器与第二解码器位于同一水平面,所述第三编码器与第三解码器位于同一水平面,所述第四编码器与第四解码器位于同一水平面,所述第五编码器与第五解码器位于同一水平面;所述第六编码器位于第五编码器与第五解码器的下方中部;

13、第二层u型网络结构是指每个解码器和编码器内部设置的基于u型网络结构的残差u型模块;所述第一编码器、第二编码器、第三编码器、第四编码器内的残差u型模块的层数依次减少;所述第一解码器、第二解码器、第三解码器、第四解码器内的残差u型模块的层数依次减少;所述第五编码器、第六编码器和第五解码器内均设置有包含膨胀率的残差u型模块;

14、每个解码器阶段将其输出的特征图进行上采样后与位于其前一水平面的编码器阶段输出的特征图进行融合;最后,第一解码器输出的特征图,经过一个tanh层和一个卷积层重建得到去模糊图像。

15、进一步的,对于判别网络,采用基于块的生成对抗网络作为判别网络的网络结构,包括一个平卷积层、三个下采样卷积层、一个特征重建块;所述下采样卷积层用于降低输入图像的分辨率和编码局部特征;每个下采样卷积层后面都添加了样本标准化层和带泄露修正线性单元激活函数leaky relu,并且每个下采样卷积层的卷积核大小为4×4。

16、进一步的,所述残差u型模块包含以下三部分:首先,特征输入到一个卷积核大小为3×3的卷积层中,将h×w×cin的输入特征图x的通道数转换为cout的中间映射f1(x);第二,采用对称的编码器-解码器结构,整个残差u型模块深度为l;将中间映射f1(x)作为输入,学习提取和编码多尺度的上下文信息u(f1(x));第三,设置有残差连接,用于融合局部特征和多尺度特征,数学表达是为f1(x)+u(f1(x))。

17、进一步的,生成对抗网络模型用于搭载在计算机上运行;其中批量训练图像的个数是2,生成网络和判别网络的学习率是0.0001;激活函数leaky relu的坡度是0.2;生成对抗网络模型使用adam优化器,其动量参数分别是β1=0.5和β2=0.999。

18、本发明还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现所述基于嵌套u型网络结构的图像去模糊方法的步骤。

19、本发明还提供一种计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现所述基于嵌套u型网络结构的图像去模糊方法的步骤。

20、与现有技术相比,本发明的技术方案所带来的有益效果是:

21、1.本发明方法与现有的图像去模糊算法相比,本方法恢复得到的图像具有更清晰的结构以及更丰富的细节。相较以往从有限的图像中手动提取特征先验知识或的方法,本发明基于对抗生成网络的纯数据驱动的重构方式可以避免分开估计模型参数带来的累积误差,提高算法的准确性和鲁棒性。

22、2.本发明方法使用不同深度的残差u型模块(rsu),可以从具有任意空间分辨率的输入特征图中提取多尺度特征。

23、使用不同深度的残差u型模块(rsu),可以从具有任意空间分辨率的输入特征图中提取多尺度特征;多尺度特征从逐渐下采样的特征图中提取,并通过逐渐上采样、拼接和卷积编码成高分辨率特征图。该过程减轻了由大规模直接上采样引起的精细细节的损失。

24、3.本发明在低内存和低计算成本的情况下,在保持高分辨率特征图的同时,实现更加深的网络架构。

25、4.本发明方法中生成网络使用嵌套的u型网络结构能够更有效地提取阶段内的多尺度特征和聚合阶段间的多层次特征。

- 还没有人留言评论。精彩留言会获得点赞!