一种基于注意力机制的多视觉混合任务学习方法与流程

1.本发明属于图像识别领域,尤其涉及一种基于注意力机制的多视觉混合任务学习方法。

背景技术:

2.随着互联网的快速发展和智能手机的全面普及,极大地方便了人们的生活,图片也逐渐成为信息传递的一种主要载体。图片中可能包含许多丰富的信息,其中包含很多敏感信息,需要通过计算机视觉的方法来进行审核。

3.目前,还没有针对图像检测任务和图像分类任务进行同时训练和测试的方法。现有的方法多为其中计算机视觉任务的一环,包括:基于深度学习的图像检测方法,和基于深度学习的图像分类方法。

4.这些现有技术有哪些不足或缺点:

5.1.单视觉任务不能共享模型参数,占用内存量大;

6.2.单视觉任务不能和其它任务同时进行前向计算,推理速度慢;

7.3.单视觉任务无法共享多任务的信息,相互补充。

技术实现要素:

8.本发明所要解决的技术问题是针对背景技术的不足提供一种基于注意力机制的多视觉混合任务学习方法,通过多个注意力分支实现对图像分类和图像检测任务进行同时训练和测试。

9.本发明为解决上述技术问题采用以下技术方案:

10.一种基于注意力机制的多视觉混合任务学习方法,包含多视觉任务数据加载、注意力分支提取特征、多视觉损失平衡训练,具体包含如下步骤:

11.步骤1,在数据读取阶段,图像分类和图像检测任务通过两个数据加载器将数据并联加载到共享主干网络;

12.步骤2,在共享特征提取阶段,引入注意力机制,通过注意力模块将注意掩码应用于共享主干网络,为每个任务输出特定的特征后,再进入每个任务独立的检测头head进行学习预测;

13.步骤3,多视觉损失平衡训练:

14.从权重的角度对损失函数进行优化,自适应加权方法,具体如下,

15.loss=λ

taska

*loss

taska

+λ

taskb

*loss

taskb

16.其中,loss为多个任务的loss总和,loss

taska

是任务a的损失,loss

taskb

是任务b的损失,λ

taska

是任务a的损失权重,λ

taskb

是任务b的损失权重;

17.通过每个任务的损失变化率来衡量每个任务的收敛状态,以各自任务的收敛状态来动态确定随时间变化的平均任务权重。

18.作为本发明一种基于注意力机制的多视觉混合任务学习方法的进一步优选方案,

所述步骤1具体步骤如下:

19.步骤1.1,分别构建检测数据加载器和分类数据加载器,两个数据加载器分别使用目标数据增强方法和分类数据增强方法进行数据增强;

20.步骤1.2,利用检测数据加载器和分类数据加载器同时加载一批检测图片数据和检测图片标签以及一批分类图片数据和分类图片标签;

21.步骤1.3,将加载的检测图片数据和分类图片数据进行某一维度的拼接,然后送入共享模型的主干网络,用于提取特征。

22.作为本发明一种基于注意力机制的多视觉混合任务学习方法的进一步优选方案,在步骤2中,引入注意力机制具体如下,任务i在j层学到的和第j层的共享特征p

(j)

进行逐像素相乘,就得到本层中特定于该任务的特征,具体计算如下;

[0023][0024]

作为本发明一种基于注意力机制的多视觉混合任务学习方法的进一步优选方案,在步骤3中,多视觉损失平衡训练的图像分类任务:直接连接一个全局平均池化层后做softmax分类,而目标检测任务将经过一个特征金字塔pa-fpn结构将不同层次的特征图进行高效融合,再连接检测头,实现多视觉学习任务的整体学习,具体学习过程如下;

[0025]

a)构建损失函数,通过最小梯度下降使得整个模型朝好的方向发展;

[0026]

b)构建优化器函数,模型根据它得到的结果和损失函数,对模型进行优化;

[0027]

c)构建评价方式:用于监督训练和测试过程的准确程度。

[0028]

作为本发明一种基于注意力机制的多视觉混合任务学习方法的进一步优选方案,在步骤4中,具体权重计算如下,将任务k的任务权重λk定义为:

[0029][0030][0031][0032]

式中,lossk(t)代表第k个任务t时刻的loss,lossk(t-1)代表第k个任务t-1时刻的loss,lossk(t-2)代表第k个任务t-2时刻的loss,ωk(t)计算范围为(0,+∞),代表当前epoch和上一个epoch的loss变化率,ωk'(t)计算范围为(0,+∞),代表当前epoch和上上个epoch的loss变化率,t是迭代指数,t表示控制任务权重的值,k表示若k个任务权重初始均为1则总的任务权重和为k,exp代表以自然常数e为底的指数函数,较大的t会使不同任务之间的分布更加均匀,若t足够大,我们有即任务权重相等;损失值lossk(t)为多次迭代中每个epoch的平均损失,减少随机梯度下降和随机训练数据选择带来的不确定性。

[0033]

本发明采用以上技术方案与现有技术相比,具有以下技术效果:

[0034]

1、本发明使用注意力分支共享主干神经网络,同时进行图像检测和分类任务端到端的训练和优化,整体上缩减训练时间,可以实现图像检测任务和图像分类任务的同时训

练;

[0035]

2、本发明模型可以通过共享多视觉任务的特征,提升模型的特征提取能力,提升多视觉任务的效果;

[0036]

3、本发明模型可以通过对单张图片同时进行检测和整体分类的测试,在对图片进行推理时,可以减少重复进行图片预处理的时间,提升多任务的测试速度。

附图说明

[0037]

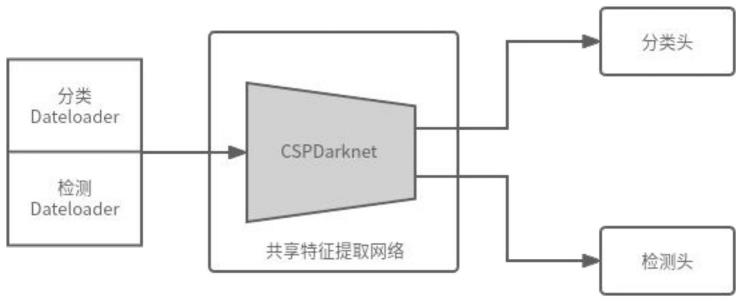

图1是本发明多视觉任务数据加载示意图;

[0038]

图2是本发明注意力分支模块;

[0039]

图3是本发明多视觉学习策略整体流程;

[0040]

图4是本发明多视觉混合任务学习策略测试流程。

具体实施方式

[0041]

下面结合附图对本发明的技术方案做进一步的详细说明:

[0042]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0043]

一种基于注意力机制的多视觉混合任务学习方法,包含多视觉任务数据加载、注意力分支提取特征、多视觉损失平衡训练,具体包含如下步骤:

[0044]

多视觉任务数据加载:

[0045]

多视觉学习策略整体流程如图1所示,图片分类和图片检测任务通过两个数据加载器将数据并联加载到共享主干网络,引入注多视觉任务在数据读取阶段,分类和检测任务通过两个数据加载器(dataloader)等规模并联拼接作为网络的输入,可以解决多视觉任务中不同任务样本标签混淆和样本规模不同的问题。

[0046]

在数据读取阶段,图像分类和图像检测任务通过两个数据加载器将数据并联加载到共享主干网络;具体步骤如下:

[0047]

a)首先分别构建检测数据加载器和分类数据加载器,两个数据加载器分别使用目标数据增强方法和分类数据增强方法进行数据增强。

[0048]

b)利用检测数据加载器和分类数据加载器同时加载一批检测图片数据和检测图片标签以及一批分类图片数据和分类图片标签。

[0049]

c)将加载的检测图片数据和分类图片数据进行某一维度的拼接,然后送入共享模型的主干网络,用于提取特征。

[0050]

注意力分支提取特征:

[0051]

在共享特征提取阶段,引入注意力机制,以确定每个特征对于特定任务的重要性。共享网络本身则学习所有任务的全局特征池,如图2所示,注意力分支模块将注意掩码应用于共享网络,可以被视为来自共享网络的特征选择器,以端到端的方式自动学习。

[0052]

在共享特征提取阶段,引入注意力机制,如下式所示,任务i在j层学到的和第j层的共享特征p

(j)

进行逐像素相乘,就得到本层中特定于该任务的特征,通过注意力

模块将注意掩码应用于共享主干网络,为每个任务输出特定的特征后,再进入每个任务独立的检测头head进行学习预测;

[0053][0054]

多视觉损失平衡训练:

[0055]

多视觉任务学习的损失函数计算涉及到多个任务的损失合并,当采用简单相加即loss=loss

taska

+loss

taskb

时,不同任务的损失量级及优化速度不同,可能导致总损失函数的优化由其中某个任务的损失主导,影响不同任务的收敛效果。因此损失函数优化是多任务优化不可避免的方面,尤其当任务间差异较大时。如图3所示,本发明从权重的角度对损失函数进行优化,提出了一种有效而简单的自适应加权方法:

[0056]

loss=λ

taska

*loss

taska

+λ

taskb

*loss

taskb

[0057]

其中,loss为多个任务的loss总和,loss

taska

是任务a的损失,loss

taskb

是任务b的损失,λ

taska

是任务a的损失权重,λ

taskb

是任务b的损失权重;

[0058]

该方法提出通过每个任务的损失变化率来衡量每个任务的收敛状态,以各自任务的收敛状态来动态确定随时间变化的平均任务权重,具体权重设计如下,我们将任务k的任务权重λk定义为:

[0059][0060][0061][0062]

式中,lossk(t)代表第k个任务t时刻的loss,lossk(t-1)代表第k个任务t-1时刻的loss,lossk(t-2)代表第k个任务t-2时刻的loss,ωk(t)计算范围为(0,+∞),代表当前epoch和上一个epoch的loss变化率,ωk'(t)计算范围为(0,+∞),代表当前epoch和上上个epoch的loss变化率,t是迭代指数,t表示控制任务权重的值,k表示若k个任务权重初始均为1则总的任务权重和为k,exp代表以自然常数e为底的指数函数,较大的t会使不同任务之间的分布更加均匀,若t足够大,我们有即任务权重相等;损失值lossk(t)为多次迭代中每个epoch的平均损失,减少随机梯度下降和随机训练数据选择带来的不确定性。

[0063]

本技术领域多视觉学习整体流程:

[0064]

注意力机制,通过注意力模块将注意掩码应用于共享主干网络,为每个任务输出特定的特征后,再进入每个任务独立的head进行学习预测。在我们的结构中,图像分类任务直接连接一个全局平均池化层后做softmax分类,而目标检测任务将经过一个pa-fpn结构将不同层次的特征图进行高效融合,再连接检测头,最终实现多视觉学习任务的整体学习。

[0065]

针对基于注意力机制的多视觉混合任务学习策略,根据相关任务输入图像,分别

通过图像分类注意力分支和图像检测注意力分支,并最终给出图片分类和检测结果。可用于海量数据中敏感物体的检测和审核。

[0066]

实施例:

[0067]

应用多视觉混合任务学习策略的流程以及结果示意如图4所示:

[0068]

针对基于注意力机制的多视觉混合任务学习策略,根据相关任务输入图像,分别通过图像分类注意力分支和图像检测注意力分支,并最终给出图片分类和检测结果。可用于海量数据中敏感物体的检测和审核。

[0069]

执行如下步骤a到c分别获得。

[0070]

步骤a,获取相关图片,并对图片进行尺寸归一化等操作,送入主干网络提取特征。

[0071]

步骤b,将主干网络提取的特征通过图片分类注意力分支和图片检测注意力分支,并输出相关标签。

[0072]

步骤c,将两个注意力分支输出的标签进行组合,从而进行判断是否是目标图片。

[0073]

技术人员可以理解的是,除非另外定义,这里使用的所有术语(包括技术术语和科学术语)具有与本发明所属领域中的普通技术人员的一般理解相同的意义。还应该理解的是,诸如通用字典中定义的那些术语应该被理解为具有与现有技术的上下文中的意义一致的意义,并且除非像这里一样定义,不会用理想化或过于正式的含义来解释。

[0074]

以上实施例仅为说明本发明的技术思想,不能以此限定本发明的保护范围,凡是按照本发明提出的技术思想,在技术方案基础上所做的任何改动,均落入本发明保护范围之内。上面对本发明的实施方式作了详细说明,但是本发明并不限于上述实施方式,在本领域普通技术人员所具备的知识范围内,还可以在不脱离本发明宗旨的前提下做出各种变化。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1