基于终身学习的遥感影像解译方法与流程

本发明涉及遥感影像处理领域,具体涉及一种基于终身学习的遥感影像解译方法。

背景技术:

1、进入21世纪以来,我们通过卫星、无人机、数码相机、成像光谱仪与航天飞机等多种设备,多角度对高分辨率遥感影像进行采集,并将其应用在不同的领域中。如何快速有效的处理大量的遥感影像数据是遥感领域迫切需要解决的问题。显然,人工处理遥感影像,虽然精度高,但效率低下,且需要大量的成本去投入,这种方法是不可取的。传统遥感影像方法利用物体几何形状和空间位置等信息进行目标的特征提取,也可以通过颜色、阴影、纹理等特征信息,结合lidar或sar对三维数据提取有效特征。采用以上单一的方法进行特征提取存在着一定的不足之处,比如分类效果不够明显、分类错误较多等问题,无法在可辩别性和鲁棒性之间保持一个良好的平衡点。然而,日益成熟的机器学习技术可以应用在我们生活中的多个领域,尤其是深度学习方式对网络进行训练,最终让模型对未知样本能够准确预测。遥感技术提供的大量且可靠数据,为深度学习模型发展奠定基础。而深度学习可以应用在遥感影像的分类、语义分割和检测等领域,为遥感技术更好的发展起到一定的推动作用。

2、目前应用于遥感影像解译的深度学习方法都面临着一个常见的问题,即面对不同的解译任务时,为了达到较高的解译精度需要构建全新的深度学习模型并进行全新的训练,这导致了工程实施上庞大的工程量和低下的模型训练效率、对于现有遥感影像数据和已构建模型的极低的有效利用率和复用率,限制了大规模的工程实施。为了解决这一问题并推动遥感影像解译的自动化发展,研究者尝试使用在线学习和持续学习的方法来对现有的模型和已经学习到的知识在新的遥感解译任务中进行复用。现有的多种持续学习方法中,最简单的方法是通过新任务提供的新训练数据来训练原网络从并实现网络微调。然而,这种简单的重训练方法会同时降低原网络对于新任务和旧任务的解译效果。如果新任务与旧任务之间的相关性很低,例如两个任务是对两种不同种类的地物,如小麦和建筑物进行分类,这时网络从旧任务学习到的特征就可能对于新任务起不到任何作用。另一个会遇到的问题是灾难性遗忘问题,原网络在学习到了新的知识后会遗忘掉之前学习到的内容,这是由以下两点所导致的:(1)因为深度学习的结构一旦确定,在训练过程中很难调整,神经网络的结构直接决定学习模型的容量。固定结构的神经网络意味着模型的容量也是有限的,在容量有限的情况下,神经网络为了学习一个新的任务,就必须擦除旧有的知识;(2)其次,深度学习的隐含层的神经元是全局的,单个神经元的细小变化能够同时影响整个网络的输出结果。另外,所有前馈网络的参数与输入的每个维度都相连,新数据很大可能改变网络中所有的参数。对于本身结构就已经固定的神经网络,参数是关于知识的唯一变化量。如果变化的参数中包含与历史知识相关性很大的参数,那么最终的效果就是,新知识覆盖了旧的知识。

3、对于遥感领域,如何保证在新的解译任务上取得较好的效果的同时能不降低模型在旧解译任务上原有的能力,以及如何克服灾难性遗忘问题是当前遥感终身学习技术发展中需要解决的重要问题。

技术实现思路

1、本发明提出一种基于终身学习的遥感影像解译方法,该方法通过结合遥感影像场景分类模型和动态可扩展遥感影像解译模型的组合模型实现了适应于遥感影像解译的终身学习方法。通过遥感影像场景分类来识别已知的和未知的任务,并进一步通过对解译网络的扩展和重训练来实现面对新的未知任务时模型容量的扩充以及对未知任务的学习,进而实现知识持续不断地更新。将学习到的知识充分运用于新的遥感解译任务,在不降低解译精度的同时有效避免了灾难性遗忘问题,提高了对现有模型和数据的利用率。

2、为实现上述技术目的,本发明的技术方案如下:

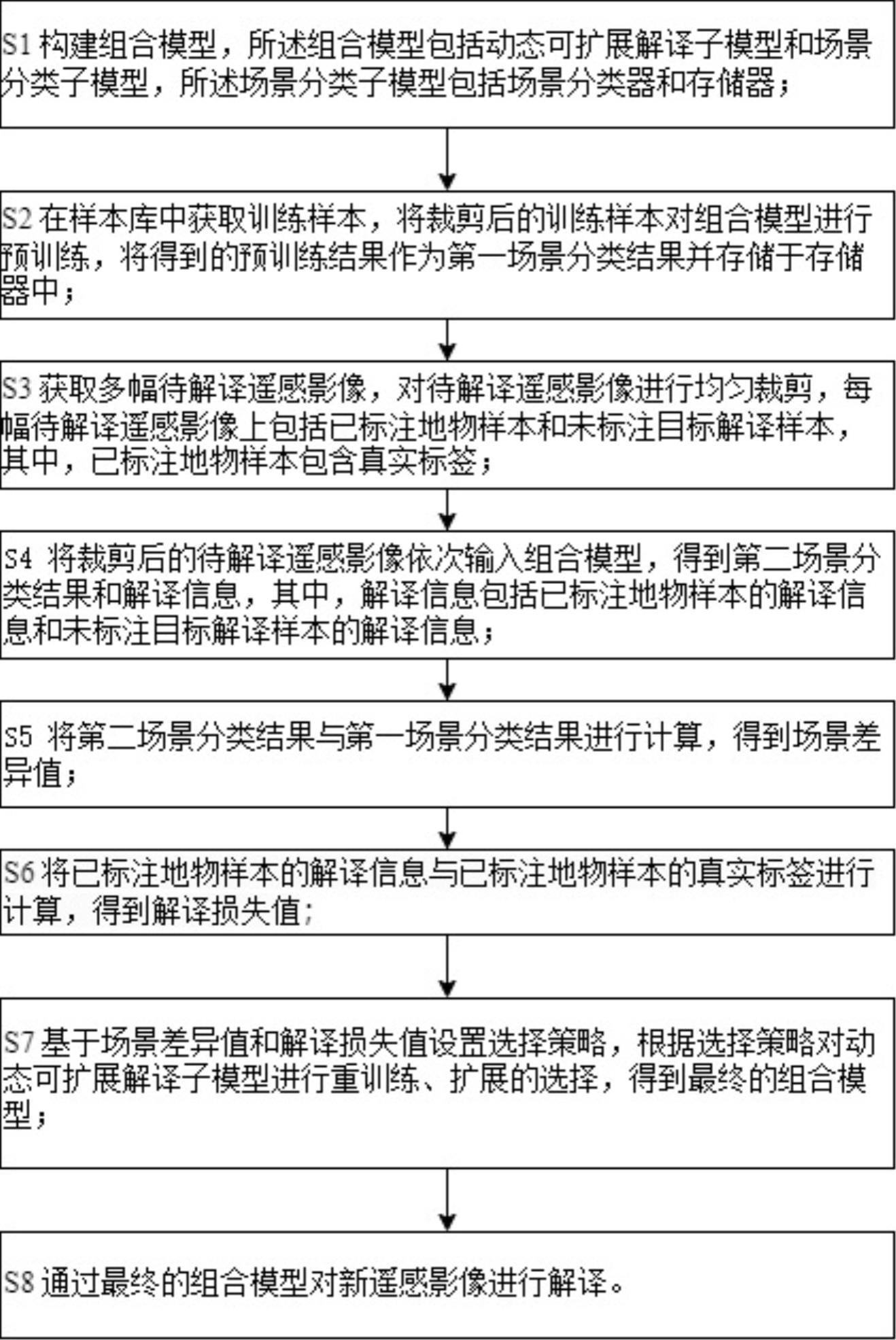

3、一种基于终身学习的遥感影像解译方法,该方法包括以下步骤:

4、s1 构建组合模型,组合模型包括动态可扩展解译子模型和场景分类子模型,场景分类子模型包括场景分类器和存储器;

5、s2 在样本库中获取训练样本,将裁剪后的训练样本对组合模型进行预训练,将得到的预训练结果作为第一场景分类结果并存储于存储器中;

6、s3 获取多幅待解译遥感影像,对待解译遥感影像进行均匀裁剪,每幅待解译遥感影像上包含已标注地物样本和未标注目标解译样本,其中,已标注地物样本包含真实标签;

7、s4 将裁剪后的待解译遥感影像依次输入组合模型,得到第二场景分类结果和解译信息,其中,解译信息包括已标注地物样本的解译信息和未标注目标解译样本的解译信息;

8、s5 将第二场景分类结果与第一场景分类结果进行计算,得到场景差异值;

9、s6 将已标注地物样本的解译信息与已标注地物样本的真实标签进行计算,得到解译损失值;

10、s7 基于场景差异值和解译损失值设置选择策略,根据选择策略对动态可扩展解译子模型进行重训练、扩展的选择,得到最终的组合模型;

11、s8 通过最终的组合模型对新遥感影像进行解译。

12、于本发明一实施例中,步骤s7中,选择策略为:

13、第一种:当场景差异值小于第一预设阈值,且解译损失值小于第二预设阈值时,保持动态可扩展解译子模型的当前结构,并得到最终的组合模型;

14、第二种:当场景差异值小于第一预设阈值,且解译损失值大于第二预设阈值时,重训练动态可扩展解译子模型,对组合模型进行更新,并转至步骤s4;

15、第三种:当场景差异值大于第一预设阈值,且解译损失值小于第二预设阈值时,重训练动态可扩展解译子模型,对组合模型进行更新,并转至步骤s4;

16、第四种:当场景差异值大于第一预设阈值,且解译损失值大于第二预设阈值时,扩展动态可扩展解译子模型,以对组合模型进行更新,并转至步骤s4。

17、于本发明一实施例中,动态可扩展解译子模型包括卷积神经网络和扩展器,其中卷积神经网络用于完成解译任务,扩展器用于对卷积神经网络进行扩展。

18、于本发明一实施例中,扩展动态可扩展解译子模型包括增加卷积神经网络的神经元,并对增加的神经元进行训练;

19、重训练动态可扩展解译子模型包括选择性对部分网络参数进行调整。

20、于本发明一实施例中,扩展动态可扩展解译子模型包括:

21、对每层神经网络增加预设数量的神经元;

22、使用组稀疏正则化去除新增的无效神经元;

23、对最终增加的神经元进行训练:

24、

25、其中,l表示神经网络的第l层,dt为解译数据,w为神经网络权重,l为损失函数,μ和γ为正则项参数,t为当前任务,t-1为前一次任务,g为由每个神经元的输入权值定义的一个组。

26、于本发明一实施例中,重训练动态可扩展解译子模型包括:

27、当接收到新任务t时,将一个稀疏的线性分类器安装到动态可扩展解译子模型的最后一层:

28、

29、其中,l表示卷积神经网络的第l层,为第l层的网络参数,μ是正则化强度,n为网络的总层数,表示除了之外的其他网络参数;

30、根据建立的稀疏连接识别出与当前新任务t相关的子网络s,并对子网络s进行重训练:

31、。

32、于本发明一实施例中,步骤s5中,对第二场景分类结果与第一场景分类结果进行计算的方法为距离计算。

33、于本发明一实施例中,距离计算的过程为:

34、;

35、c表示第一场景分类结果,其中p(y=i|x=j)为输入的裁剪后的训练样本j属于类别i的预测概率,m为场景类别的总数量,n为训练样本被裁切后的数量;

36、待解译遥感影像被均匀裁剪为r块,ct表示第二场景分类结果,

37、

38、d=[d1,d2,...,dr]表示第二场景分类结果与第一场景分类结果进行距离计算得到的最近距离,其中;

39、将d以数值降序排序,选取前k个数值,将这k个数值的中值作为场景差异值。

40、于本发明一实施例中,初始的动态可扩展解译子模型中卷积神经网络的结构包括:

41、第一层:卷积层1,输入为229×229×3的裁剪后的图像;卷积核的数量为96;卷积核的大小为13×13×3;步长为4;

42、第二层:池化层1,池化尺寸为3×3;步长为2;

43、第三层:卷积层2,输入为第二层的输出,卷积核个数为256,卷积核大小为5×5;步长为1;

44、第四层:池化层2,池化尺寸为3×3;步长为2;

45、第五层:卷积层3,输入为第四层的输出,卷积核个数为384,卷积核大小为3×3;

46、第六层:卷积层4,输入为第五层的输出,卷积核个数为384,卷积核大小为3×3;

47、第七层:卷积层5,输入为第六层的输出,卷积核个数为256,卷积核大小为3×3;

48、第八层:池化层3,池化尺寸为3×3;步长为2;

49、第九至十一层为全连接层,神经元个数分别为384、192、100。

50、于本发明一实施例中,场景分类器为残差网络resnet-50。

51、本发明的有益效果为:通过结合场景分类子模型和动态可扩展解译子模型的组合模型实现了适应于遥感影像解译的终身学习方法。通过遥感影像场景分类来识别已知的和未知的任务,并进一步通过对解译网络的扩展和重训练来实现面对新的未知任务时模型容量的扩充以及对未知任务的学习,进而实现知识持续不断地更新。将学习到的知识充分运用于新的遥感解译任务,在不降低解译精度的同时有效避免了灾难性遗忘问题,提高了对现有模型和遥感影像数据的利用率。

- 还没有人留言评论。精彩留言会获得点赞!