一种基于时空信息的面部疼痛表情分析方法及系统

本发明涉及疼痛评估,尤其涉及的是一种基于时空信息的面部疼痛表情分析方法及系统。

背景技术:

1、国际上对于疼痛的评估都是由受过专门训练并熟悉各项监测指标的医护人员进行人工评估,评估结果更多地依赖于个人的知识与经验,并受个人的情绪等主观因素的影响,不能完全客观反映病患疼痛程度。因此,开发一种面部表情的疼痛分析方法,为临床提供客观准确的疼痛评估,对医护人员及时采取相应的镇痛措施具有非常重要的意义和价值。

2、当前的疼痛评估方法多是对面部表情图像进行分析,获得疼痛等级,没有考虑到表情是一个动态变化的过程,同时具有时间域上的特征信息和空间域上的序列信息,因此,特征信息提取不够充分,疼痛评估的准确性不高。并且当前对视频进行分割时仅仅是对视频进行分段,增加视频的段数,获得多段视频,本质上并没有提高整体数据集的数据量和利用率。

技术实现思路

1、本发明的主要目的在于提供一种基于时空信息的面部疼痛表情分析方法、系统、智能终端及存储介质,能够解决目前特征信息提取不够充分,疼痛评估的准确性不高,数据集利用率低的问题。

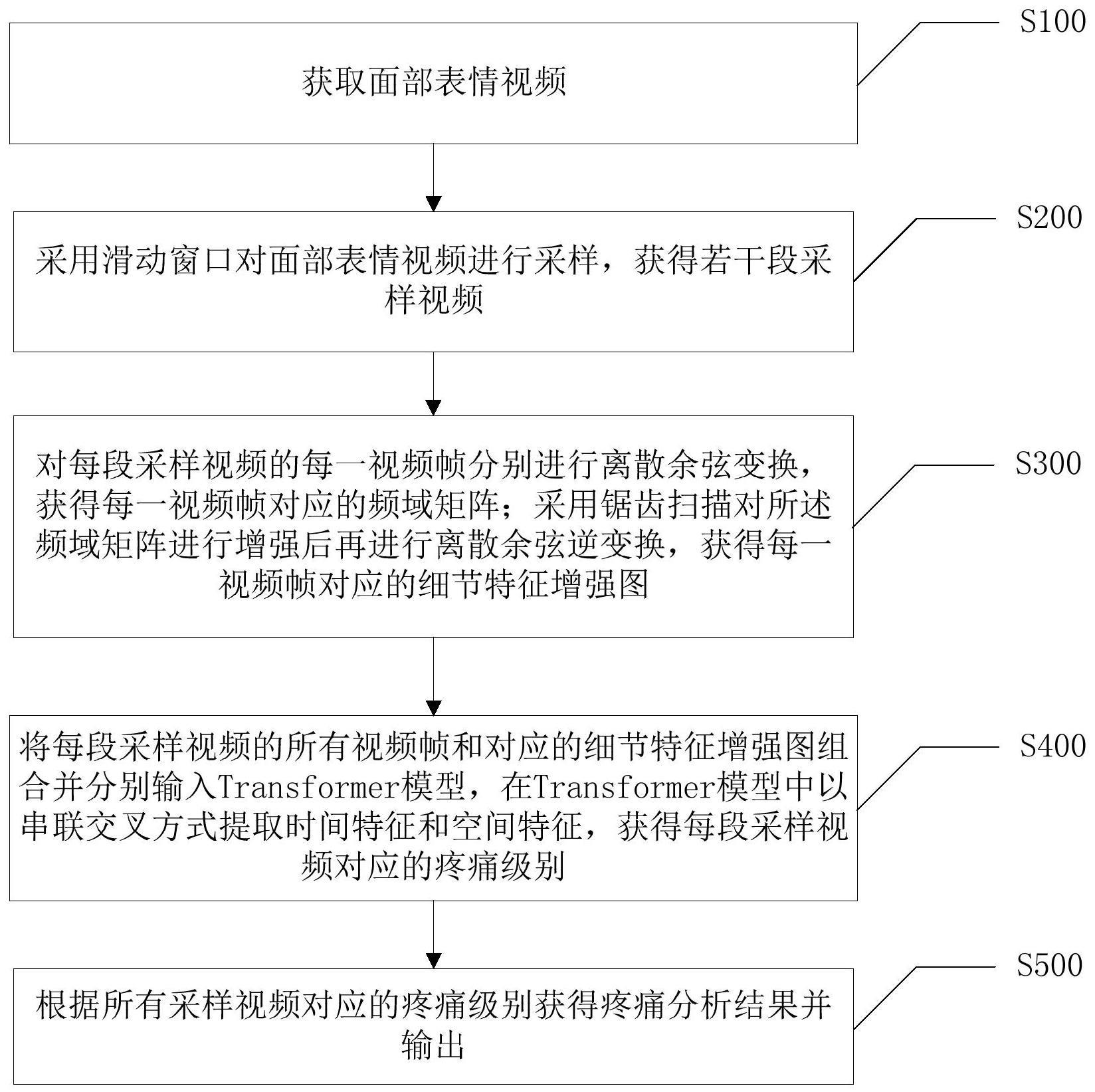

2、为了实现上述目的,本发明第一方面提供一种基于时空信息的面部疼痛表情分析方法,所述方法包括:

3、获取面部表情视频;

4、采用滑动窗口对所述面部表情视频进行采样,获得若干段采样视频;

5、对每段采样视频的每一视频帧分别进行离散余弦变换,获得每一视频帧对应的频域矩阵;采用锯齿扫描对所述频域矩阵进行增强后再进行离散余弦逆变换,获得每一视频帧对应的细节特征增强图;

6、将每段采样视频的所有视频帧和对应的细节特征增强图组合并分别输入transformer模型,在所述transformer模型中以串联交叉方式提取时间特征和空间特征,获得每段采样视频对应的疼痛级别;

7、根据所有采样视频对应的疼痛级别获得疼痛分析结果并输出。

8、可选的,所述采用滑动窗口对所述面部表情视频进行采样,获得若干段采样视频,包括:

9、根据第一段采样视频预设的起始帧位置、采样总帧数、间隔帧数初始化滑动窗口;根据所述间隔帧数在滑动窗口内采样所述面部表情视频的视频帧,获得第一段采样视频;

10、将下一段采样视频设为目标视频段;

11、根据移动步长滑动所述滑动窗口;

12、当目标视频段预设的采样总帧数、间隔帧数与前一段采样视频预设的采样总帧数、间隔帧数中任一项不同时,根据目标视频段预设的采样总帧数、间隔帧数更新滑动窗口;

13、根据目标视频段预设的间隔帧数在滑动窗口内采样所述面部表情视频的视频帧,获得所述目标视频段;

14、返回将下一段采样视频设为目标视频段以获得下一段采样视频,直至获得所有段采样视频。

15、可选的,所述采用锯齿扫描对所述频域矩阵进行增强,包括:

16、采用锯齿扫描方式,从所述频域矩阵的右下角开始扫描,依次获取频域频率特征信息,若当前扫描位置的序号为偶数时,用前一位置的频域频率特征信息替换当前扫描位置的频域频率特征信息。

17、可选的,对视频帧进行离散余弦变换,获得视频帧对应的频域矩阵,包括:

18、基于预设图像块尺寸,将所述视频帧分割为若干图像块;

19、对每一图像块分别采用离散余弦变换将空域图像特征信息转化为频域频率特征信息,获得每一图像块对应的频域频率特征信息;

20、根据图像块在视频帧中的位置,组合所有的频域频率特征信息,获得所述频域矩阵。

21、可选的,将采样视频的所有视频帧和对应的细节特征增强图组合并输入transformer模型,包括:

22、将所述采样视频的每一视频帧和对应的细节特征增强图组合并按照预设图像块尺寸进行切分,获得图像块序列;

23、将所述图像块序列展平、线性投影以及添加位置标识后输入transformer编码器。

24、可选的,所述在所述transformer模型中以串联交叉方式提取时间特征和空间特征,包括:

25、将多头自注意力模块中所有注意力头提取的空间特征与上一网络层提取的时间特征融合后输入多层感知器并采用残差连接,获得所述空间特征;

26、将多头自注意力模块中所有注意力头提取的时间特征与上一网络层提取的空间特征融合后输入多层感知器并采用残差连接,获得所述时间特征。

27、可选的,获得多头自注意力模块中注意力头提取的时间特征或空间特征,包括:

28、对查询矩阵与关键词矩阵进行点积运算,获得用于表征特征元素之间相关度的相似度权重;

29、根据所述相似度权重和数值矩阵,获得自注意力模块注意力头提取的时间特征或空间特征。

30、本发明第二方面提供基于时空信息的面部疼痛表情分析系统,其中,上述系统包括:

31、数据获取模块,用于获取面部表情视频;

32、滑动窗口模块,用于采用滑动窗口对所述面部表情视频进行采样,获得若干段采样视频;

33、细节特征增强图模块,用于对每段采样视频的每一视频帧分别进行离散余弦变换,获得每一视频帧对应的频域矩阵;采用锯齿扫描对所述频域矩阵进行增强后再进行离散余弦逆变换,获得每一视频帧对应的细节特征增强图;

34、疼痛级别分析模块,用于将每段采样视频的所有视频帧和对应的细节特征增强图组合并分别输入transformer模型,在所述transformer模型中以串联交叉方式提取时间特征和空间特征,获得每段采样视频对应的疼痛级别;

35、结果模块,用于根据所有采样视频对应的疼痛级别获得疼痛分析结果并输出。

36、本发明第三方面提供一种智能终端,上述智能终端包括存储器、处理器以及存储在上述存储器上并可在上述处理器上运行的基于时空信息的面部疼痛表情分析程序,上述基于时空信息的面部疼痛表情分析程序被上述处理器执行时实现任意一项上述基于时空信息的面部疼痛表情分析方法的步骤。

37、本发明第四方面提供一种计算机可读存储介质,上述计算机可读存储介质上存储有基于时空信息的面部疼痛表情分析程序,上述基于时空信息的面部疼痛表情分析程序被处理器执行时实现任意一项上述基于时空信息的面部疼痛表情分析方法的步骤。

38、由上可见,与现有技术相比,本发明通过使用滑动窗口采样面部表情视频,获得若干段采样视频,能够提高数据集的利用率,对视频帧进行离散余弦变换并采用锯齿扫描进行增强,获得细节特征增强图,能够增强细节信息,然后将每段采样视频的所有视频帧和对应的细节特征增强图组合后分别输入transformer模型,在transformer模型中采用串联交叉方式提取时间特征和空间特征并融合,最后根据每段采样视频对应的疼痛级别获得疼痛分析结果。能够充分地提取面部表情视频的特征信息,疼痛评估的准确性高,且序列预测的时序性强。

技术特征:

1.基于时空信息的面部疼痛表情分析方法,其特征在于,所述方法包括:

2.如权利要求1所述的基于时空信息的面部疼痛表情分析方法,其特征在于,所述采用滑动窗口对所述面部表情视频进行采样,获得若干段采样视频,包括:

3.如权利要求1所述的基于时空信息的面部疼痛表情分析方法,其特征在于,所述采用锯齿扫描对所述频域矩阵进行增强,包括:

4.如权利要求1所述的基于时空信息的面部疼痛表情分析方法,其特征在于,对视频帧进行离散余弦变换,获得视频帧对应的频域矩阵,包括:

5.如权利要求1所述的基于时空信息的面部疼痛表情分析方法,其特征在于,将采样视频的所有视频帧和对应的细节特征增强图组合并输入transformer模型,包括:

6.如权利要求1所述的基于时空信息的面部疼痛表情分析方法,其特征在于,所述在所述transformer模型中以串联交叉方式提取时间特征和空间特征,包括:

7.如权利要求6所述的基于时空信息的面部疼痛表情分析方法,其特征在于,获得多头自注意力模块中注意力头提取的时间特征或空间特征,包括:

8.基于时空信息的面部疼痛表情分析系统,其特征在于,所述系统包括:

9.智能终端,其特征在于,所述智能终端包括存储器、处理器以及存储在所述存储器上并可在所述处理器上运行的基于时空信息的面部疼痛表情分析程序,所述基于时空信息的面部疼痛表情分析程序被所述处理器执行时实现如权利要求1-7任意一项所述基于时空信息的面部疼痛表情分析方法的步骤。

10.计算机可读存储介质,其特征在于,所述计算机可读存储介质上存储有基于时空信息的面部疼痛表情分析程序,所述基于时空信息的面部疼痛表情分析程序被处理器执行时实现如权利要求1-7任意一项所述基于时空信息的面部疼痛表情分析方法的步骤。

技术总结

本发明公开了一种基于时空信息的面部疼痛表情分析方法及系统,通过使用滑动窗口采样面部表情视频,获得若干段采样视频,能够提高数据集的利用率,对视频帧进行离散余弦变换并采用锯齿扫描进行增强,获得细节特征增强图,能够增强细节信息,然后将每段采样视频的所有视频帧和对应的细节特征增强图组合后分别输入Transformer模型,在Transformer模型中采用串联交叉方式提取时间特征和空间特征并融合,最后根据每段采样视频对应的疼痛级别获得疼痛分析结果。能够充分地提取面部表情视频的特征信息,疼痛评估的准确性高。

技术研发人员:叶欣婷,谢耀钦,梁晓坤,胡伽尼

受保护的技术使用者:中国科学院深圳先进技术研究院

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!