一种基于非对称掩码的对比学习方法

本发明属于图像分类,涉及一种基于非对称掩码的对比学习方法。

背景技术:

1、深度学习的迅速进展,使它成为了许多现代人工智能技术的基础方法。传统的监督训练方式,严重依赖于带标签的数据集。这就是自监督方法在推动深度学习进步方面发挥重要作用的地方,它不需要昂贵的带标签的数据,即在学习图像表征时不需要提供有监督的数据。近年来,自监督/无监督学习的领域取得了巨大的突破。基于代理任务的差异,目前较为流行的分支包括对比学习(cl)和掩码图像建模(mim)。

2、对于对比学习任务,需要训练模型将同一图像的不同视图与其他图像区分开来,这种方式称为实例区分。为了学习有效的图像表征,不对称设计在对比学习中发挥着至关重要的作用,它在低级特征上引入了一系列变化,但不改变图像的语义信息。其中最重要的非对称设计是一系列应用于正样本对的数据增强技术,例如,颜色变换、灰度变换和曝光等操作,它们显著的改变了正样本的颜色,因此这要求基于对比学习的模型捕获图像中无关于颜色的表征。然后,随机裁剪操作引入了图像大小和比例的变化,这进一步消除了模型对图像的大小和比例的依赖性。因此,该模型被训练来使用语义特征来识别对象,而不是浅显的表层特征。此外,非对称设计也被引入到网络架构中,例如预测模块和动量编码器,它们改变了正样本对的表征。因此,合理的不对称设计对于对比学习的表现非常重要。然而,由于正样本对之间的图像区域重叠,现有的对比学习方法中正样本对仍然存在大量的外观相似性,这降低了模型学习良好表征的能力。

3、与对比学习不同,mim任务遵循自然语言处理(nlp)中掩码语言建模任务(mlm)的思想,其中部分掩码的数据被输送到模型中,以自动编码的方式预测数据的不可见部分。由于图像的严重空间冗余,mim任务中的掩码图像仍然可以有效地保留原始图像的语义,这在自监督学习中实现了非常不错的性能。然而,在相似的语义下,原始像素或其图像块在外观上具有较大的波动,导致从随机掩码图像重建不可见区域存在着非唯一的预测目标,特别是当掩码比率较大时。现有的mim方法试图将高度掩码的图像映射到固定的目标,即使预测的目标是给定输入的合理目标,这也不可避免地引入了较大的拟合误差。我们称之为非唯一目标问题,这实质上限制了mim模型的灵活性。

4、为此,一些方法使用了基于特征预测的方法来缓解上述问题。尽管这些方法取得了不错的结果,但这些方法仍然严重依赖于重建像素或图像块的不稳定目标。因此,相比之下,我们所提出的方法通过学习由非对称采样策略采样的不同视图之间的实例相似性来建模掩码图像,这为自监督学习提供了更灵活和稳定的目标。

技术实现思路

1、本发明所解决的技术问题是,针对现有技术的不足,提供一种基于非对称掩码的对比学习方法,这个方法能够提高图像分类的准确度。

2、为实现上述目的,本发明的技术方案如下:

3、一种基于非对称掩码的对比学习方法,包括以下步骤:

4、步骤1、对获取到的原始图像进行两次随机裁剪、随机水平垂直翻转和颜色变化等数据增强,构建正样本对。

5、步骤2、采用非对称掩码策略对图像块掩码采样,降低正样本之间重叠区域的采样率,构建具有较大外观差异的正样本对。

6、步骤3、分别将正样本对放入初始参数共享的编码器中,提取图像表征信息。其中一侧编码器使用梯度下降更新,另一侧编码器动量更新。

7、步骤4、将编码器得到的表征分别经过映射模块和预测模块,使用对比损失函数最小化正样本之间的差异,同时最大化负样本之间的差异。

8、步骤5、在训练的过程中利用自适应的裁剪梯度策略来平稳梯度、稳定训练过程。

9、步骤6、通过训练得到的模型在图像分类任务上微调,在测试数据集图像上进行分类。

10、进一步地,所述步骤1中,对原始图像做两次不对称的数据增强的过程是:首先在原始图像以随机的面积比例和随机宽高比例裁剪出矩形区域。将裁剪区域的位置和大小数据保存:

11、box=[i,j,h,w]

12、其中,box代表裁剪区域的矩形框;i表示裁剪矩形框的左上角横坐标,j表示裁剪矩形框的左上纵坐标,h表示裁剪矩形框的高度,w表示裁剪矩形框的宽度。

13、对图像进行两次裁剪后,得到了图像两个视图的矩形框,分别为box1和box2。之后,使用双线性插值将裁剪后的图像恢复成指定的模型输入大小,让模型学习无关于图像尺寸和区域的表征。然后,将图像分别做随机的水平和垂直翻转。

14、对图像做数据增强使用的是torchvision的transform工具包,该工具包是计算机上视觉领域中常用的python工具箱;

15、进一步地,为了使得模型学习无关于颜色的表征信息,对图像做颜色变换、灰度化变换和曝光操作。

16、进一步地,所述步骤2中,由于图像空间的严重冗余,为了提高代理任务的难度,以便于模型学习更深层的语义信息而不是浅层的表征信息。对视图1采用稀疏采样来实现掩码操作。其中掩码块大小与图像块大小一致,掩码块的总数为掩码比率乘以图像块总数。

17、为了进一步的降低正样本对两视图之间的外观相似性,采用非对称掩码策略来降低重叠区域的图像块的采样率,提高非重叠区域的采样率,从而保持采样图像块总数不变。具体来说,首先对视图1中的图像块进行随机采样,再根据视图1中已经采样的图像块来确定视图2中需要采样的图像块。所采用的采样方法是根据图像块的重叠比例来确定图像块的采样率。

18、其中,重叠比例的计算方式如下:

19、

20、其中,pi(i=1,2)代表视图i中图像块。s(·)代表的是给定图像块的面积。为了降低重叠图像块的采样概率,在视图2使用了一种选择性的图像块采样方法,其中图像块的采样概率密度psel通过以下公式计算:

21、psel=(γ+1)·s1·(1-roverlap)γ

22、其中s1指的是视图1中采样的图像块的采样概率,γ是调整采样灵敏度的超参数。γ越大,图像块被采样的可能性越小。这种选择性采样和稀疏采样方法形成了不对称采样策略。

23、由于稀疏采样策略从第一视图x1均匀的采样图像块,因此重叠区域x1∩x2中的图像块采样的概率也是s1,与x1中的概率相同。因此,采样概率密度需要满足以下等式:

24、这保证了总概率满足所提出的采样策略的比率(x1∩x2)。

25、进一步地,所述步骤3中,采用视觉transformer来提取图像的表征信息。将所有的图像块都经过一维线性投影e(·),得到对应的token嵌入向量。为了使图像不丢失位置信息,所有的token嵌入向量中都加上可学习的位置编码epos,同时除了现有的所有token外,还添加了一个class token嵌入来获取图像的全局信息。接着,通过transformer的编码器层,实现token之间的信息交互。transformer结构中每层编码器结构相同。所采用的transformer结构由一系列相同结构的transformer块构成。其中,每个transformer块由多头注意力机制和多层感知机构成,在每个transformer块之前采用layer norm对输入进行归一化操作,在每个transformer块之后使用残差连接。

26、把视图1和视图2的token序列分别输入到两个初始化参数相同的编码器中,其中一个编码器使用正常的梯度下降更新,另一个编码器使用动量方式更新参数。动量更新公式如下所示:

27、pt=m·pt-1+(1-m)·pt

28、其中pt为t步骤下正常梯度下降更新后模型的参数,pt-1为(t-1)步骤下动量编码器的模型参数,m为动量更新系数。

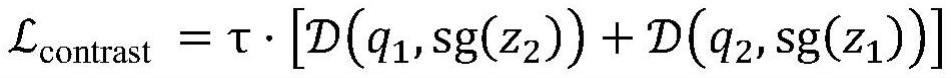

29、进一步地,所述步骤4中,将视图1和视图2的图像表征class token经过映射模块和预测模块进行特征映射。然后,使用对比损失函数最小化正样本之间的差异,同时最大化负样本之间的差异。对比损失函数公式如下所示:

30、

31、

32、

33、其中τ和n分别表示温度参数和批次大小,q(i)和z(i)分别表示数据批次中第i个样本的表征q和z,sg(·)表示表示梯度截断操作。q代表的是经过映射模块出来的特征,z代表的经过映射模块和预测模块出来的特征。

34、进一步地,所述步骤5中,为了解决基于视觉transformer的对比学习方法的不稳定的优化问题,稳定训练过程,根据梯度的指数移动平均值为步骤t设置自适应阈值,公式如下所示:

35、

36、其中m∈[0,1)是动量系数,gt表示步骤t中模型参数的梯度。当时,梯度按阈值的范数缩放:

37、

38、通过设置∈来提升梯度缩放的数值稳定性,将梯度的幅度调整到合理的范围内,从而提高对比学习的训练稳定性。

39、进一步地,所述步骤6中,将上述预训练的transformer模型在标注数据集上进行微调。将预训练模型的参数加载到标准的transformer模型中,丢弃预训练模型的映射层和预测层参数,同时为了实现分类任务将完整的图片裁剪成图像块序列的形式输入到模型中,经过transformer模型编码得到token表征序列。取其中的全局表征class token,并输入到单层的线性网络构成的分类器模块中,计算其与标注数据的one-hot标签的交叉熵损失函数来,引导模型往分类正确的方向进行参数优化。

40、有益效果

41、本发明构建的模型是基于非对称掩码的对比学习神经网络,主要包括对获取到的原始图像进行两次随机裁剪并分别做不同的数据增强来构建正样本对;采用非对称掩码策略对图像块进行采样,降低重叠区域图像块的采样率,构建具有较大外观差异的正样本对;将采样的图像块输入到一对初始化参数相同的编码器中来获取图像表征,其中一侧编码器使用正常的梯度下降更新,另一侧编码器则使用动量方式更新参数;将图像表征分别经过映射模块和预测模块,使用对比损失函数最小化正样本之间的差异,同时最大化负样本之间的差异;同时在训练的过程中利用自适应的裁剪梯度策略来稳定训练过程。在imagenet和cifar数据集上的实验表明,本发明能够提高图像分类的准确率并且降低显存的占用。

- 还没有人留言评论。精彩留言会获得点赞!