一种基于注意力机制的小样本目标检测系统及方法

本发明涉及一种基于注意力机制的小样本目标检测系统及方法,适用于计算机视觉中的小样本目标检测。

背景技术:

1、随着人类社会的发展,人类获取信息的重要来源逐渐变为图像和视频,其中基于大量图像视频样本进行深度学习的系统越来越成熟,但在工业界,还存在着大量的专业的非热门类别的目标有采用目标检测的需求,将目标识别技术应用于这些小众方向是一个难题,其中面临最重要的难题一方面是数据集的缺乏,具体来说就是难以借助公开的数据集从而获得海量的训练数据;另一方面就是即使有大量的数据,对于这些数据的标注工作不仅费时更需要一定的专业技术背景。基于以上两个困难,基于深度学习的目标检测技术在工业界仍有巨大人的应用潜力,如果从较少的数据中就能训练学习出一个性能相对不错的算法模型,则将大大利于目标检测在小众领域的应用,因此如何设计算法在少量样本条件下对数据进行充分利用进行目标检测,是工业界对计算机视觉技术发展的迫切需求。小样本条件下的目标检测具有非常高的研究价值,在医疗、农业、海洋、军事等领域有着广泛的应用。

2、但由于对于目标类别数据集较小,普通的小样本目标检测模型的检测精度与一般的海量样本数据的目标检测模型精度差的很远,其中一个原因就是模型定位目标的问题,由于缺乏先验知识,很多模型目标检测结果框偏离实际的实例位置过远或者检测模型对于一些关键特征提取与关注度不够,这是造成小样本目标检测精度低的一个重要,

3、2017年,谷歌推出了transformer结构,使用注意力机制进行翻译任务,并取得很好的效果,再次将注意力机制推向了一个热点。注意力模型被广泛地用于自然语言处理、图像识别、语音识别等各种不同类别的深度学习任务中。其源于对人类视觉的研究,当处理信息的能力有限,人类会选择性地关注部分信息而忽略其它的信息。注意力机制能让网络具备更加关注于某一部分特征的能力,可以用一个通用的表达式来表示:

4、attention(q,,v)=softmax(qkt)v

5、其中q为查询向量queries、k为键值向量keys和v内容向量values,通过查询向量和键值向量计算出一个权重并加在内容向量中,从而实现对于内容的选择性注意或者忽略。

技术实现思路

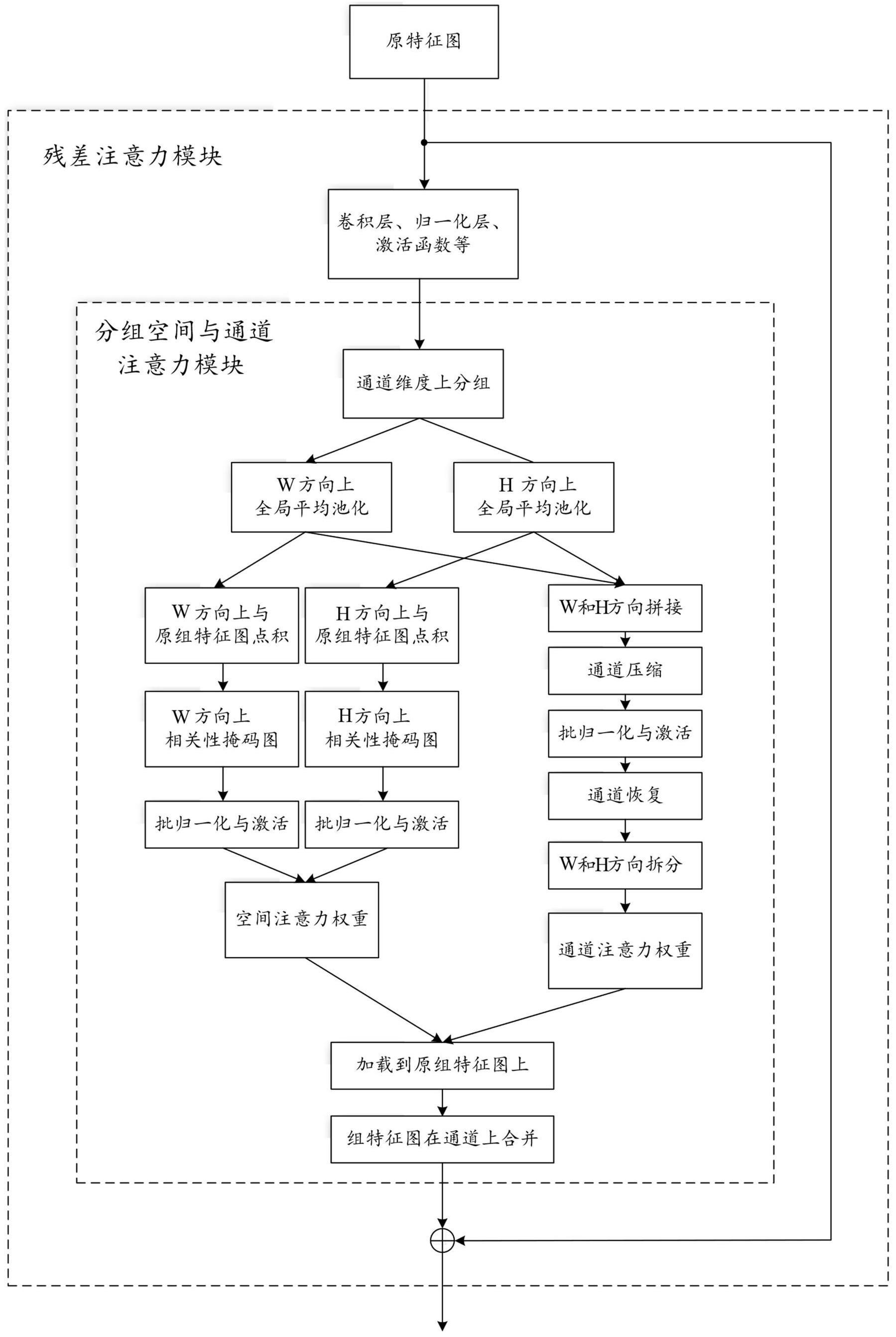

1、针对现有的小样本目标检测问题,提出了一种基于注意力机制的小样本目标检测系统。所述系统包括分组空间与通道注意力模块、注意力残差模块。

2、具体而言,分组空间与通道注意力模块主要分为两大模块,第一个模块通过将特征图在通道维度上进行分组,并对每一组的特征图在空间的两个方向上生成相关性图实现在空间上的注意力,而第二个模块通过将不同组别、不同空间维度上的相关性特征图进行拼接,而后统一进行一系列的卷积正则等操作,再分开进行通道还原,完成了基于空间信息嵌入的通道间的注意力机制,并将最终的空间与通道注意力的权重加载在原特征图上。

3、具体而言,注意力残差块由卷积层、批量标准化层,激活函数层以及残差连接组成。注意力残差模块作为整个网络的基础模块堆叠了卷积层,激活函数层,批量标准化层、分组空间与通道注意力残差层和残差连接。分组空间与通道注意力残差层的嵌入能够对卷积运算后的特征图进行空间以及通道维度的加权,自适应地调整不同通道特征的重要性,强化重要特征信息,增强网络的特征提取能力。

4、经过具体实验得出基于注意力机制的小样本目标检测系统提高了小样本目标检测模型的检测平均精度map,说明本发明能够有效提高模型小样本目标检测精度。

5、为了实现上述目的,本发明提供如下技术方案:

6、一种基于注意力机制的小样本目标检测系统,其特征在于,包括如下步骤:

7、步骤s101:将输入的h×w×c的特征图,其中h代表图像高度,w代表图像宽度,c代表图像通道,在通道维度上分成多组,每组代表特定的子特征,通过分组可以对不同的特征针对性地进行学习和抑制噪声;

8、步骤s102:将每一组特征xk分为两路,分别使用尺寸(w,1)和(1,h)的池化核沿着竖直方向和水平方向对每个通道做全局平均池化(global average pooling,gap),得到高为h的行特征图以及宽为w的列特征图和上分别嵌入了特征组xk两个空间维度上的信息,与的表达式如式(1)(2)所示:

9、

10、

11、其中xc(i,h)表示原特征图xk第h行的第i个特征向量,xc(w,j)表示原特征图xk第w列的第j个特征向量;

12、步骤s103:分为两条支路,分别对应空间注意力模块和通道注意力模块;

13、步骤s104:在空间注意力模块,计算两个空间方向上的相关性掩码图与表达式如式(3)(4)所示:

14、

15、

16、其中·表示点积;

17、步骤s105:对和在空间上进行归一化得到标准化后的h方向和w方向上的相关性掩码图与如公式(5)(6)(7)所示:

18、

19、

20、

21、其中表示行相关性掩码图和列相关性掩码图μ{h,w}表示在每个通道上的空间全局平均值,表示在每个通道上的空间全局方差;

22、步骤s106:在通道注意力模块,将行特征图与列特征图按照通道进行对齐拼接得到拼接后的特征图对使用一个1×1的卷积并激活,如式(8)所示:

23、

24、其中δ是非线性激活函数,f1是卷积编码函数,得到通道经过编码后的特征图其中的r代表下采样的比例,这一部分作为整个分组空间与通道注意力模块的瓶颈结构,用以控制模块的大小;

25、步骤s107:紧接着,将f切分恢复为之前两个空间维度上的张量和再利用两个1×1的卷积分别将两个互相关特征图解码到原始的通道数,并再分别通过激活函数得到如下的两个值在(0,1)的特征图权重和如式(9)(10)所示:

26、

27、

28、其中fh为在h方向上的卷积解码函数,fw为在w方向上的卷积解码函数,σ(·)为sigmoid激活函数;

29、步骤s108:将和以按行和按列的方式加载到经过空间注意力机制加权后的特征图上,最终得到第k组经过空间与通道加权后的特征图如式(11)所示:

30、

31、其中⊙表示按元素点积;

32、步骤s109:在得到每个组上经过空间与通道注意力后的特征图后,将不同的通道特征图进行拼接组合,而后将经过空间与通道注意力后的权重加载到原始的特征图上,得到分组空间与通道注意力模块最终的输出。

33、进一步地,所述步骤s2具体包括:

34、步骤s201:将特征模型输入进卷积层进行通道变换;

35、步骤s202:将经过通道变换后特征图进行批归一化;

36、步骤s203:将经过批归一化后特征图经过激活函数;

37、步骤s204:将经过激活函数的特征图经过卷积恢复初始特征图的通道数;

38、步骤s205:将恢复过原始通道数的特征图送入分组空间与通道注意力模块,进行注意力的加权得到加载过注意力的特征图;

39、步骤s206:将加载过注意力的特征图与最初的特征图通过残差连接,得到最终的输出。

40、本发明与现有主要的注意力机制相比,分组空间与通道注意力模块能通过将特征图的通道分组分别进行两个空间维度上的互相关注意力增强,并将空间增强后所有分组进行通道再合并以进行通道维度上的注意力增强,提升检测模型对实例的注意力,尤其是针对只有少量样本的小样本学习领域,本发明能提升小样本目标检测模型的检测精度;其中的注意力残差块通过包括分组空间与通道注意力模块的残差结构,来减轻网络反向传播过程中的梯度消失和梯度爆炸的问题,达到增强小样本目标检测网络的效果。

41、本发明与当前主要的注意力机制相比,能够对小样本目标的检测性能精度上有所提升,是一种更加轻量级的、检测精度更高的、更适用于小样本目标检测任务的注意力机制。

- 还没有人留言评论。精彩留言会获得点赞!