一种基于对抗性边缘学习重建的图像修复方法

本发明涉及本发明涉及图像处理,尤其涉及一种基于对抗性边缘学习重建的图像修复方法。

背景技术:

1、图像修复是一种用于修复受损图像的技术,可以恢复图像中的缺失、损坏或者降质的部分。最传统的技术为人类使用自身的一种将视觉上的不一致归为零的能力,使用photoshop等软件进行人为的修复,修复后的图像如果缺乏细致的结构,就会让人觉得有问题。尽管传统的人为图像修复方法可以产生良好的修复效果,但它们通常需要大量的人工操作和时间,而且对修复人员的技能和经验要求较高。随着深度学习等计算机视觉技术的发展,自动化的图像修复方法正在得到广泛应用,并在某些情况下取得了更好的修复结果。基于深度学习修复的常见方法包括图像插值方法、自动编码器、基于生成对抗网络的模型、基于稀疏表示的模型、基于全变分的模型等方法,但是其中的问题也有很多,效果也差强人意。

2、目前发明人已知最先进的图像修复方法为基于边缘信息重建修复图像,先进行边缘的重建,再进行上色。但是该方法基于边缘信息重建的图像修复方法在恢复图像细节和真实感方面存在一些局限性。它们更适用于一些简单的图像修复任务或对图像结构较为敏感的场景。对于复杂的图像内容或需要恢复更多细节的任务,可能效果一般。针对这种局限性,我们引入了注意力机制和残差连接,注意力机制可以帮助模型更好地关注修复区域、抑制干扰信息,并且具有自适应调整的能力,从而提高修复结果的准确性、真实感和细节恢复能力。而加入残差连接可以提高模型的信息流动性,加速训练收敛,减少参数量,并增强模型的表达能力。这些优势可以改善图像修复的效果和性能。

技术实现思路

1、本部分的目的在于概述本发明的实施例的一些方面以及简要介绍一些较佳实施例。在本部分以及本技术的说明书摘要和发明名称中可能会做些简化或省略以避免使本部分、说明书摘要和发明名称的目的模糊,而这种简化或省略不能用于限制本发明的范围。

2、鉴于上述现有存在的问题,提出了本发明。

3、因此,本发明提供了一种基于对抗性边缘学习重建的图像修复方法,能够解决传统的修复方法在细节的修复中有很大比例的缺失,修复痕迹较为明显,且如果涂抹的地方太小,效果更差,并且该方法环境配置较为繁琐的问题。

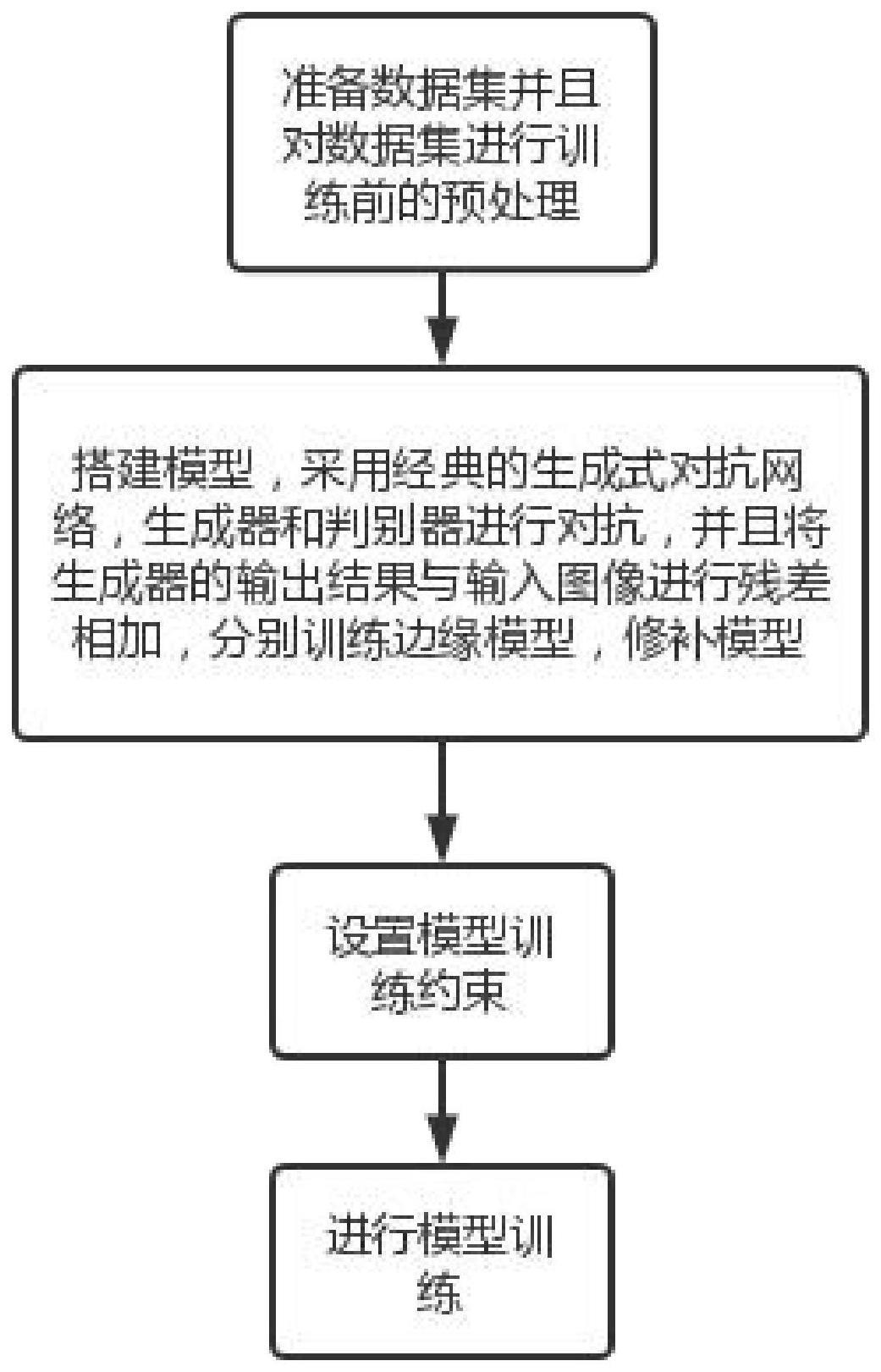

4、为解决上述技术问题,本发明提供如下技术方案,一种基于对抗性边缘学习重建的图像修复方法,包括:

5、准备数据集并且对数据集进行训练前的预处理;

6、搭建模型,采用经典的生成式对抗网络,生成器和判别器进行对抗,并且将生成器的输出结果与输入图像进行残差相加,分别训练边缘模型,修补模型;

7、设置模型训练约束;

8、进行模型训练。

9、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述预处理包括,通过数据集的选取与处理,进行不规则mask和人脸数据集的载入,并进行图像的预处理与划分。

10、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述图像的预处理包括对于图像的边缘提取,使用canny边缘检测获取图像的边缘,具体如下:

11、进行高斯滤波处理:canny边缘检测首先对图像进行高斯滤波,使用高斯核来平滑图像并抑制噪声,具体表示为以下公式:

12、

13、其中g(x,y)是高斯核,σ是高斯滤波的标准差;

14、计算梯度幅值和方向:在平滑后的图像上计算像素点的梯度幅值和方向,使用sobel算子或prewitt算子来计算水平和垂直方向的梯度;

15、梯度幅值表示为:

16、gmag(x,y)=√gx(x,y)2+gy(x,y)2

17、非极大值抑制:对梯度幅值图像进行非极大值抑制,保留梯度幅值图像中局部最大值对应的像素点,以获得细化的边缘;

18、双阈值处理:根据高阈值和低阈值对梯度幅值图像进行分类,包括强边缘、弱边缘以及非边缘;

19、强边缘:梯度幅值大于等于高阈值gmag(x,y)≥thigh的像素点;

20、弱边缘:梯度幅值小于高阈值且大于等于低阈值tlow≤gmag(x,y)<thigh的像素点;

21、非边缘:梯度幅值小于低阈值gmag(x,y)<tlow的像素点;

22、边缘连接:通过连接强边缘像素和与之相邻的弱边缘像素,形成闭合边缘。

23、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述搭建模型包括在边缘生成器中使用掩膜灰度图像作为输入,其边缘图以及掩膜m作为前提条件:

24、

25、使用cgt、cpred、igray为条件,作为判别器的输入,预测边缘图是否真实;

26、边缘生成器和判别器的训练目标包括gan损失和特征匹配损失,gan损失使用了铰链损失的形式;

27、

28、其中和λfm是正则化参数,生成器和判别器的铰链损失定义为:

29、lg1=-eigray[d1(cpred,igray)]

30、

31、特征匹配损失特征匹配损失lfm用于比较判别器中间层的激活图;

32、其中,ni表示第i层激活层中元素数量表示判别器第i层的激活值。

33、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述搭建模型包括,所使用的网络利用不完整的彩色图像作为输入,并使用复合边缘图ccomp作为条件,复合边缘图ccomp是通过将真实边缘图在背景区域与上一阶段生成的边缘图在缺失区域进行组合得到的:ccomp=cgt⊙(1-m)+cpred⊙m,网络返回一张修复后的彩色图像ipred:

34、

35、并在网络中引入残差连接,设原始输入为x,而模型的输出为f(x),残差连接将原始输入直接添加到输出f(x)中,形成残差块,其数学表达式为:

36、residual block:y=f(x)+x

37、联合损失函数包括重建损失l1、感知损失lperc、对抗损失(铰链损失lg2)、风格损失lstyle:

38、

39、其中表示损失权重参数。

40、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述损失包括重建损失、对抗损失、感知损失以及风格损失;

41、重建损失:使用l1损失生成的修复图像ipred和真实图像igt以及二值化的掩膜m表示缺失区域,其中1表示缺失,0表示非缺失;

42、

43、其中,n为掩膜中非零元素的数量,即缺失区域的像素数目;

44、对抗损失:使用铰链损失

45、lg2=-eccomp[d2(ipred,ccomp)]

46、ld2=e(igt,ccomp)[max(0,1-d2(igt,ccomp))]+eccomp[max(0,1+d2(ipred,ccomp))]

47、感知损失:感知损失用于衡量生成的修复图像与真实图像在预训练网络的中间层激活图方面的相似性;

48、

49、其中φi是预训练网络中的第i层激活图,ni是激活图中的元素数量;

50、风格损失:风格损失通过计算激活图的协方差矩阵来衡量两张图像之间的风格差异,具体来说,给定特征图的大小为ni=cj×hj×wj,风格损失表示为:

51、

52、其中,φj是预训练网络中的第j层激活图是生成的修复图像和真实图像,g是激活图的gram矩阵;

53、再引入注意力机制:通过注意力机制,模型可以在图像修复过程中动态地关注输入的不同位置,根据重要性调整输入的权重,修复图像中的缺失部分;

54、有输入序列x=(x1,x2,…,xn)和一个与输入相关的权重向量w=(w1,w2,…,wn),注意力机制的输出y是输入序列中每个元素的加权和,即:

55、

56、其中,wi表示输入序列中第i个元素的权重,以便将注意力集中在对任务更有帮助的元素上。

57、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述训练模型包括采用反向传播算法更新优化网络参数权重,直至模型损失趋于收敛。

58、作为本发明所述的基于对抗性边缘学习重建的图像修复方法的一种优选方案,其中:所述训练模型还包括将训练好的模型导入并使用opencv工具做成人脸涂抹修复软件,最后使用打包工具打包成exe文件。

59、一种计算机设备,包括存储器和处理器,所述存储器存储有计算机程序,其特征在于,所述处理器执行所述计算机程序时实现一种基于对抗性边缘学习重建的图像修复方法的步骤。

60、一种计算机可读存储介质,其上存储有计算机程序,其特征在于,所述计算机程序被处理器执行时实现一种基于对抗性边缘学习重建的图像修复方法的步骤。

61、本发明的有益效果:本发明方法基于对抗性边缘学习,对于传统修复的图像中有明显的缺失与不自然痕迹有了改进,使得痕迹更加不明显,效果更令人满意。使用opencv做了简易的前端系统,并且使用python工具进行打包,使得在无环境配置,无编程经验的电脑上也能运行。

- 还没有人留言评论。精彩留言会获得点赞!