一种基于局部外观流的虚拟试衣方法

本发明涉及虚拟现实与仿真,尤其涉及一种基于局部外观流的虚拟试衣方法。

背景技术:

1、虚拟试衣技术分为二维和三维两种形式,其中二维虚拟试衣是通过对用户和目标服装图像进行处理合成试衣图像的过程。与三维虚拟试衣相比,二维虚拟试衣具备部署简便、易于推广等优势,这使得二维虚拟试衣技术在实际应用中更具可行性,容易被大众所接受。因此,二维虚拟试衣技术在服装领域的应用前景广阔。目前的基于图像的虚拟试衣方法可以通过是否依赖解析器信息可以分为基于解析器和无解析器两类。

2、基于解析器的虚拟试衣技术利用人体解析信息来实现试衣效果。它通过提取人体图像的关键点、和姿势等特征,将提取的服装特征与解析得到的人体特征进行匹配和合成,生成最终的试衣图像。然而,当人体解析图质量低或存在误差时,例如cp-vton和clothflow等,其试穿结果会显得不自然。

3、为了解决这个问题,基于无解析器的虚拟试衣pf-afn中引入了教师模块,该网络在经过预处理的图像上能够生成真实的服装翘曲图像。学生模块与教师模块具有相同的架构,但没有使用解析器和姿态估计技术,直接模仿教师模块的试衣能力。然而,由于教师模块仍然基于解析器,因此生成的图像会出现较大的伪影,进而影响到学生模块的试衣结果。

4、如何解决上述技术问题为本发明面临的课题。

技术实现思路

1、本发明的目的在于提供一种基于局部外观流的虚拟试衣方法,在不需要人体解析的情况下,通过提取局部外观流信息,对服装进行局部翘曲变形,对生成对抗网络的训练进行优化和改进,有效保持服装上的纹理特征和变形后的衣服细节,缓解服装纹理失真问题,减少教师模块中生成图像的伪影,提高生成结果的质量和真实度,优化学生模块的算法和训练过程,通过引入知识蒸馏使其能够更好地模仿教师模块的试衣能力,从而提升试穿结果的理想程度,即使在挑战性姿势的情况下,如交叉手臂、手臂遮挡身体,也能够处理较大的错位和变形,有助于用户感受高质量的虚拟试衣效果。

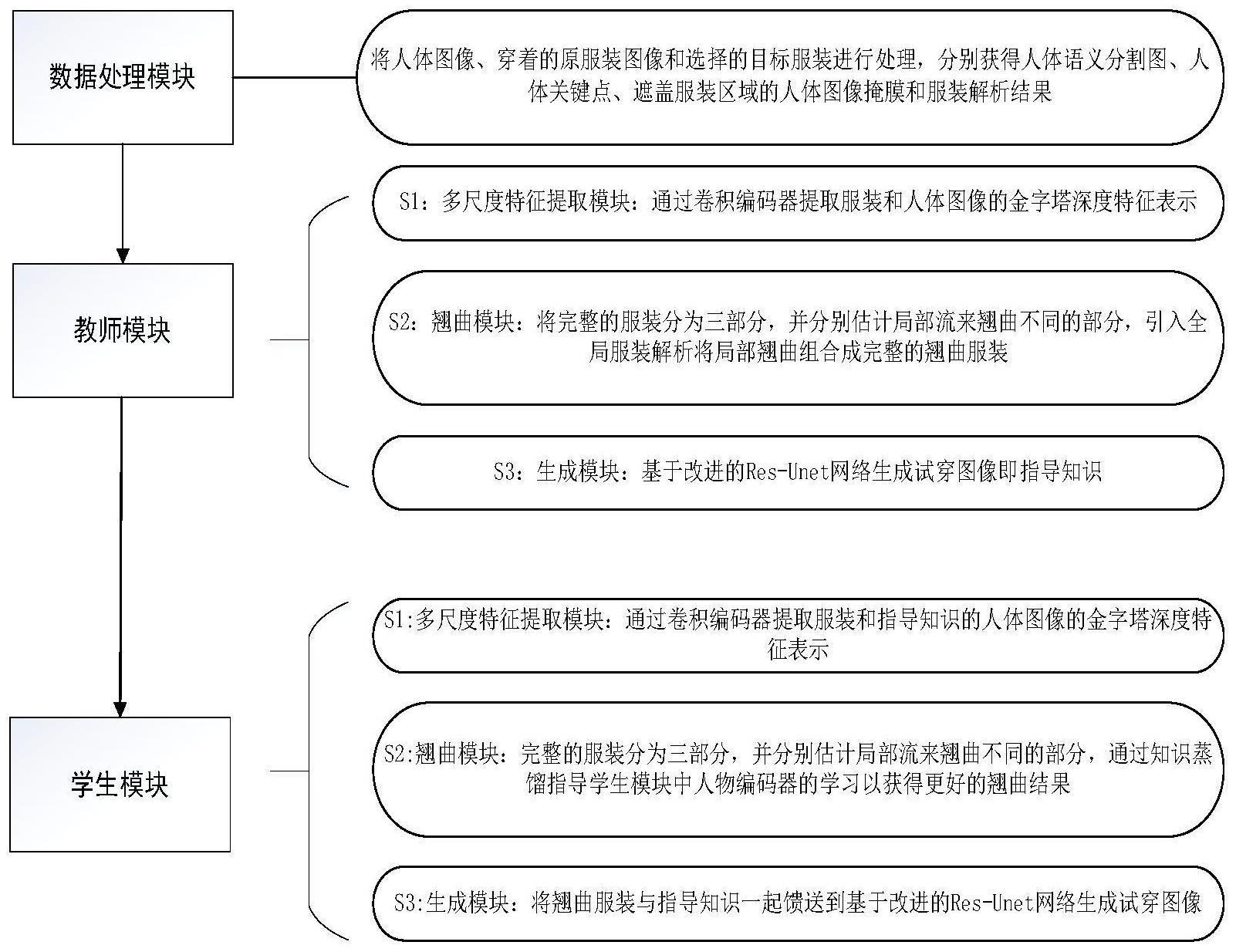

2、为了实现上述发明目的,本发明采用技术方案具体为:一种基于局部外观流的虚拟试衣方法,包括以下步骤:

3、s1:数据处理模块,将人体图像、穿着的原服装图像和选择的目标服装进行处理,分别获得人体语义分割图、人体关键点、遮盖服装区域的人体图像掩膜和服装解析结果;

4、s2:教师模块,该模块包含三个子模块,分别是多尺度特征提取模块、翘曲模块和生成模块;

5、首先通过卷积编码器提取服装和人体图像的金字塔深度特征表示,将完整的服装分为三部分,并分别估计局部流来翘曲不同的部分,引入全局服装解析,将局部翘曲组合成完整的翘曲服装,最后基于改进的res-unet网络生成试穿图像即指导知识;此外,将经过翘曲的原服装图像作为知识蒸馏送入学生模块中进行约束,实现更好的翘曲服装;

6、s3:学生模块,该模块与教师模块结构相似,但是输入只有指导知识和服装图像,在知识蒸馏的指导下,经过翘曲模块对服装进行变形,最终与指导知识一起馈送到生成模块中实现虚拟试穿。

7、所述步骤s1的具体内容为:首先,选择人体图像和目标服装;然后,将人体图像i进行处理,分别获得人体语义分割图idp、人体关键点ip、遮盖服装区域的人体图像掩膜mp并将其组合成p*,穿着的原服装图像c和选择的目标服装g获得服装解析结果cs和gs。

8、所述步骤s2的具体步骤如下:教师模块包含三个子模块,分别是多尺度特征提取模块、翘曲模块和生成模块。

9、s2.1:首先,将卷积编码器ec和ep来提取两个分支的金字塔深度特征表示,分别用表示服装图像,表示人体图像;

10、s2.2:将完整的服装分为三个局部部分即左/右袖和躯干区域,并分别估计三个局部流来翘曲不同的部分,由于同一部分内变形的多样性较小,局部流能够准确处理翘曲并生成语义正确的扭曲结果。

11、此外,设计了一个全局的服装解析,将局部翘曲组合成完整的翘曲服装gwarp,这种改进的方法能够提供更逼真的变形效果。

12、具体地,渐进式外观流估计由n个流网络fn组成用于估计n个多尺度局部流,首先最高级金字塔层级上提取gn和pn,馈送道流网络fn-1层级中进行逐像素匹配估计初始局部流然后将和n-1尺度上的特征输入到fn-2,即下一个层级中细化获取流继续上述步骤将和n-2尺度上的特征输入到fn-3获取细化流,直到最终输出通过n个fn网络逐渐细化估计的外观流,以捕捉服装图像和人物图像之间的长距离对应关系。

13、具体地,fn网络中包含粗/细流估计模块,粗流估计模块,首先复制服装特征{gi}为利用来自上一层流网络的局部流{fin}将生成三个局部翘曲特征并集成:

14、

15、其中,corr代表flownet2中的相关运算,然后分别送入三个卷积层以估计相应的局部流{f'},最后与{fin}相加生成细化的局部流{fout},细流估计模块具有相同结构只是输出{fout}变成输入{fin},corr运算变成直接拼接。

16、为了更好地保留衣服的特性并准确预测人物图像和衣服图像之间的外观流,在模型中引入了二阶光滑约束,该约束旨在鼓励相邻外观流的共线性,更好地捕捉到相邻像素之间的变化趋势,从而提高外观流的平滑性和准确性,从而降低变形结果的不自然程度,减少非自然的变形,并保持衣服特性的完整性。

17、

18、其中,fit表示第i个尺度的流图上的第t个点,表示第t个点周围的水平邻域、垂直邻域和两个对角线邻域的集合,是广义的charbonnier损失函数。

19、将最后层级预测的局部外观流用于将服装局部翘曲变形:

20、

21、

22、然后,组成完整的翘曲服装gwarp,但是,将局部翘曲组合成完整的翘曲服装过程中直接组装局部翘曲可能导致重叠区域出现不同的伪影,所以使用局部流信息和变形特征来估计全局服装解析s'g以确保每个像素点准确地分配到特定的翘曲部分,从而消除重叠伪影并获得更精确的解析结果。

23、具体地,利用来自局部的精细流{fin}将生成三个局部翘曲特征通过卷积层进行融合,得到全局翘曲特征将其与输入特征gpi连接并经过卷积层来估计全局服装解析结果s'g。

24、s2.3:将变形的衣服gwarp、人体姿势估计和遮盖服装区域的人体图像连接起来作为输入,采用改进的res-unet结构,保留服装细节并生成试穿图像,将其作为导师知识

25、

26、基于改进的res-unet结构的生成模块,它是由多个残差块组成,包含下采样、上采样和基于跨层融合模块跳跃连接,下采样操作通过卷积和池化层来提取图像的低级特征,并减小特征图的尺寸,上采样操作通过反卷积和上采样层来恢复图像的细节,并增加特征图的尺寸,跳跃连接将下采样和上采样的特征图进行融合,以保留多尺度的语义信息,但是采用简单的拼接忽略了编码器和解码器之间的语义歧义,通过引入跨层融合模块,对特征进行加权处理,增强重要特征的影响,消除不必要的特征,减少了底层和高层信息融合过程中的语义歧义。

27、具体地,跨层融合模块将浅层编码器和深层解码器的特征拼接起来并使用全局平均池化来压缩特征图的尺寸,通过卷积层增强特征信息的交流,然后通过softmax进行特征通道的加权,用残差连接复用来自解码器的特征获取更丰富的信息。

28、s3具体步骤如下;

29、在学生模块中,同样包括三个子模块,分别是多尺度特征提取模块、翘曲模块和生成模块

30、s3.1将指导知识和原服装图像作为翘曲模块输入。其中指导知识为教师网络中随机选择的一个不同的服装图像生成试穿图像原服装图像就是教师网络中人体图像原本的衣服c。将服装图像翘曲变形的过程与教师网络相似,只是输入不同,通过卷积编码器提取服装图像c和指导知识的金字塔深度特征,在知识蒸馏的指导下先局部变形再组成完整翘曲服装c*warp。

31、s3.2生成模块将变形的服装图像c*warp和人体图像连接起来作为输入,馈送到生成模块中输出图像ci。生成器模块具有和教师模块相同改进的res-unet结构,通过最小化损失函数来优化生成模块和翘曲模块的参数:

32、

33、

34、

35、其中,是l1损失,是感知损失,其中φ是特征映射,用于促进试穿图像ci与真实图像i之间的相似性。因为学生网络的试穿输出就是教师网络的输入,使用真实图像进行约束可以获得更好的结果。

36、由于教师模块中以人体解析结果、人体姿势估计和服装图像作为输入,学生网络的输入仅有指导知识和服装图像。因此,基于解析器的方法对准确的解析结果依赖较强,如果解析结果不准确,会导致错误的指导信息。

37、为了解决该问题,引入蒸馏损失来有效地指导学生模块中人物编码器的学习,而无需依赖解析器进行特征提取,从而提高虚拟试穿过程中语义信息和预测结果的质量和准确性。通过最小化指导特征与生成特征之间的差异,蒸馏损失定义为:

38、

39、

40、

41、其中,gpi和cpi是从人体特征表示p*和指导知识中第i层级尺度中通过人物编码器ep提取的特征;gfi和cfi分别表示在第i层级尺度中预测的流。

42、与现有技术相比,本发明的技术效果为:

43、1、本发明能先将人体图像、穿着的原服装图像和选择的目标服装进行处理,获得人体语义分割图、人体关键点、遮盖服装区域的人体图像掩膜和服装解析结果。

44、2、发明学习不同服装部件的不同局部变形流,从而能够处理具有挑战性的输入,通过卷积编码器提取服装和人体图像的金字塔深度特征表示,将完整的服装分为三部分,并分别估计局部流来翘曲不同的部分能够获得合理的翘曲部分和语义正确的完整服装,并且引入全局服装解析,使用局部流信息和变形特征来估计全局服装解析s'g以确保每个像素点准确地分配到特定的翘曲部分,从而消除重叠伪影并获得更精确的解析结果,最终将局部翘曲组合成完整的翘曲服装。在传统方法中,在将服装变形时,需要确保服装的纹理完全符合模型的边界约束。然而,这会导致在重叠区域出现服装纹理扭曲,出现服装纹理失真。在生成对抗网络的训练过程中通过动态控制梯度更新范围,变形后的服装纹理不需要完全符合边界约束,灵活有效的避免了纹理挤压问题。另外,在模型中引入了二阶光滑约束,更好地保留衣服的特性,并准确预测人物图像和衣服图像之间的外观流。

45、3、本发明基于改进的res-unet网络生成试穿图像,即指导知识,通过引入跨层融合模块,对特征进行加权处理,增强重要特征的影响,消除不必要的特征,减少了底层和高层信息融合过程中的语义歧义,缓解梯度问题,改善模型的鲁棒性和泛化能力;此外,将经过翘曲的原服装图像作为知识蒸馏送入学生模块中进行约束,实现知识迁移使得学生模块更好的利用教师模块的经验更好的翘曲衣服。

46、4、本发明中,由于学生模块中的输入只有指导知识和服装图像,所以引入蒸馏损失可以有效地指导学生模块中人物编码器的学习,而无需依赖解析器进行特征提取,从而提高虚拟试穿过程中语义信息和预测结果的质量和准确性;在知识蒸馏的指导下,经过翘曲模块对服装进行变形,最终与指导知识一起馈送到生成模块中实现虚拟试穿。学生模块的优点在于试穿输出就是教师模块的输入,可以通过真实图像进行约束可以获得更好的试穿效果结果。

- 还没有人留言评论。精彩留言会获得点赞!