一种基于光谱成像的目标物体自动分割方法

本发明属于高光谱图像分割目标,尤其涉及一种基于光谱成像的目标物体自动分割方法。

背景技术:

1、随着光谱成像技术的快速发展,人们能可以获取物体在不同波长下的光谱信息,这对于许多领域的研究和应用具有重要意义。其中一个关键任务是食品质量检测与安全控制:通过光谱反演任务,可以评估食品的质量、成熟度和安全性。例如,通过分析水果在不同波长下的光谱反射特性,可以推断水果中的化学成分,如含糖量、酸度、脂肪含量等。通过建立光谱与成熟度、硬度、颜色等品质指标之间的关联模型,可以预测水果的成熟度和品质,并进行品质分级和筛选。在进行反演任务中,建立模型需要制作大量数据集。使用光谱相机拍摄多组目标的光谱图像,每张光谱图像中包含多个目标。在训练阶段不能直接送入训练网络中进行训练,以及在测试阶段不能直接输入到反演模型中预测内部品质,因为造成多个光谱信息混乱,无法预测出结果,所以需要进行对每张图像中的目标分割出来,批量转化为mat格式文件。

2、目前在反演任务中,大多数是使用envi软件进行手动分割,手动分割方法虽然准确,但劳动密集且效率低下,特别是在处理大量数据时,这种方法更显得力不从心。手动分割不仅效率低下,对操作人员的眼睛也有潜在的伤害。

技术实现思路

1、鉴于此,本发明公开提供了一种基于光谱成像的目标物体自动分割方法,应用该方法能够进行全自动的光谱图像的分割,以提高效率并减轻工作人员的负担。

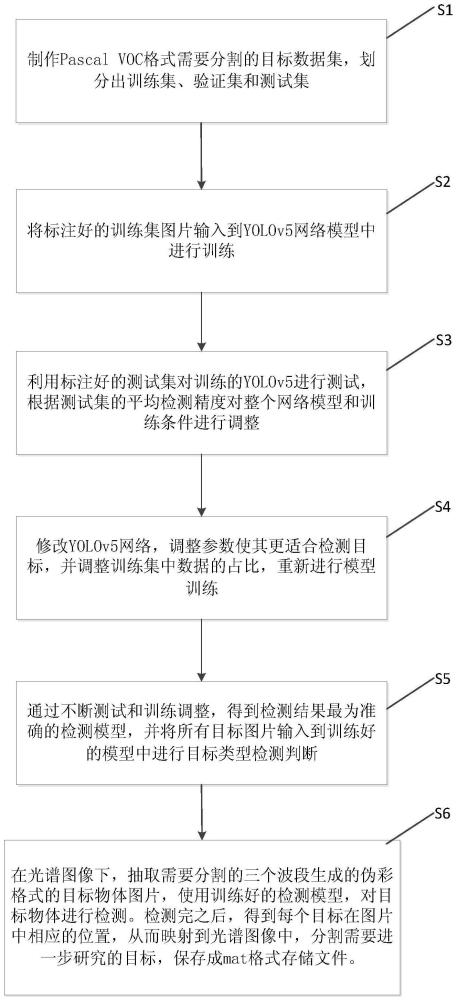

2、本发明提供的技术方案,具体为,一种基于光谱成像的目标物体自动分割方法,包括:

3、s1:制作pascal voc格式需要分割的目标物体数据集,并将所述数据集划分并标注为训练集、验证集和测试集;

4、s2:yolov5网络模型通过imagenet数据集预训练;将训练集图片输入训练后的yolov5网络模型中进行训练;

5、s3:利用测试集对训练的yolov5网络进行测试,根据测试集的平均检测精度对整个网络模型及训练条件进行调整;

6、s4:修改yolov5网络,调整参数及训练集中数据的占比,重新进行模型训练;

7、s5:重复步骤s2-s4,通过不断测试和训练调整,得到检测结果最为准确的检测模型;并将所有目标图片输入到所述模型中进行目标类型检测判断;

8、s6:在光谱图像下,抽取需要分割的三个波段生成的伪彩格式的目标物体图片,使用训练好的检测模型,对目标物体进行检测;检测完之后,得到每个目标在图片中相应的位置,从而映射到光谱图像中,分割需要进一步研究的目标,保存成mat格式存储文件。

9、进一步地,s1具体包括:

10、s101:在光谱图像下,抽取三个波段生成的伪彩格式的图片数据,制作pascal voc格式需要分割的目标物体数据集,并划分出训练集、验证集和测试集;

11、s102:创建一个train文件夹和一个test文件夹,分别用来存储训练集标签和测试集标签;

12、s103:按批次将训练集中图片导入labelimg中,然后对每一张图片进行打标签操作;

13、s104:将测试集中的图片导入labelimg中,对每一张图片进行打标签操作,所打的标签信息同样存储在test文件夹当中。

14、进一步地,s2中采用训练集对yolov5网络进行训练的方法包括:

15、s201:对所述yolov5网络的参数进行初始化,其中,所述yolov5网络的参数包括初始参数、偏置、初始学习率以及训练次数epochs;

16、s202:对迭代训练次数进行赋值,并进行迭代训练计算;其中,第一次进行迭代训练时epochs=300;

17、s203:判断当前训练次数是否小于最大训练次数;若所述当前训练次数小于所述最大训练次数,则通过所述层内多尺度模块将输入的特征图划分为低频特征图以及高频特征图;若所述当前训练次数不小于所述训练次数,则结束迭代训练并输出所述最终权重文件。

18、进一步地,所述s103打标签操作具体包括:

19、s1031:首先标定目标物体的位置,用最小外接矩形框将图片中包含的目标物体全部包含进去;

20、s1032:将训练集中的图片导入labelimg中,然后对每一张图片进行打标签操作,给标定的最小外接矩形框标注类别信息,所打的标签信息同样存储在train文件夹当中,每一张图片同样对应train文件夹中的一个xml格式文件。

21、进一步地,s3具体为:

22、s301:据预先设定的锚框确定正样本以及负样本;

23、s302:根据正负样本的预测框信息计算置信度损失,根据正样本的预测信息计算分类损失和边界框损失。

24、进一步地,所述方法中,总的损失函数是边界框损失(bbox_loss)、分类损失(cls_loss)、置信度损失(obj_loss)三个部分的加权和,具体的权重在训练过程中进行调整;按照公式(1)进行计算,

25、loss总=λ*lossbbox+α*losscls+β*lossobj (1)

26、公式(1)中,loss总是边界框损失、分类损失、置信度损失,三者的总损失;lossbbox是边界框损失,losscls是分类损失,lossobj是置信度损失。三种损失在总损失中,重要程度不同,其中λ、α、β三个占比值,根据具体任务和数据集的需求进行调整。

27、yolov5在目标检测任务中采用了一种名为完全交并比complete intersectionover union,ciou的损失函数,设预测框为a,真实框为b,交并比即预测框与真实框的交集面积除以并集面积,按照公式(2)进行计算。

28、

29、ciou的惩罚项基础上添加了一个影响因子αv,影响因子αv将预测框的宽高比和真实框的宽高比考虑进去,其中b和bgt分别表示预测框和真实框的中心点,ρ2表示两个中心点之间的欧式距离,c表示预测框和真实框的最小闭包区域的对角线距离,即ciou的惩罚项如(3)公式:

30、

31、其中α权重参数,它的表达式如(4)所示:

32、

33、v是用来衡量宽高比的一致性,其中w和wgt分别表示预测框和真实框的宽,其中h和hgt分别表示预测框和真实框的中高,它的表达式如(5)所示:

34、

35、得出边界框损失计算公式如(6)所示:

36、

37、yolov5使用二元交叉熵函数来计算分类损失;二元交叉熵函数的计算如(7)公式所示:

38、

39、其中yi为输入样本对应的标签(正样本为1,负样本为0),pi为模型预测该输入样本为正样本的概率。

40、yolov5使用ciou与二元交叉熵函数来计算置信度损失;置信度cobj计算公式如(8)公式所示:

41、cobj=(1.0-gr)+gr*sciou (8)

42、其中gr为标签平滑系数,当参数gr为1时,置信度标签就等于sciou,具体sciou计算公式如(9)所示:

43、

44、公式(9)中,b和bgt分别表示预测框和真实框的中心点,ρ2表示两个中心点之间的欧式距离,c表示预测框和真实框的最小闭包区域的对角线距离;iou即交并比,是衡量目标检测中预测框与真实框的重叠程度。

45、sciou经过sigmoid函数激活的,将其转换为0-1之间的概率值;然后采用二元交叉熵损失函数对置信度进行计算,从而得到置信度损失lossobj。

46、进一步地,s4在完成了每次迭代训练计算之后,对所述yolov5网络的参数进行更新,使用余弦退火算法,对学习率进行更新;预设的学习率按照公式(10)进行计算:

47、

48、其中,new_lr为新得到的学习率,initial_lr为初始学习率,eta_min表示最小学习率,cur_epoch代表当前训练到某个epoch对应的值,t_max代表训练的总epoch数,last_epoch表示最后一个epoch的index。

49、本发明提供的一种基于光谱成像技术的目标物体自动分割方法,用于针对光谱图像的目标物体,制作数据集,调整合适的模型参数后,分割结果基本无差错。本发明采用yolov5算法,该算法基于深度学习、特别是卷积神经网络(convolutional neuralnetwork,cnn)的物体检测模型。当检测出目标物体后,把检测出来的目标框坐标映射到光谱图像上,根据坐标进行分割任务。

50、应用本技术的方法,分割速度远远快于人工分割,更有利于反演工作的进行,本发明已在多种水果(如圣女果、蓝莓、桑葚等)光谱图像上进行了分割任务,得到了非常好的效果。

51、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不能限制本发明的公开。

- 还没有人留言评论。精彩留言会获得点赞!