基于深度学习的人员流量检测方法及系统

本发明属于智慧交通和深度学习,具体涉及一种人员流量检测方法及系统。

背景技术:

1、随着经济和城市人口的不断增长,尤其是在经济发达的一线城市,城市公共场所的人员流量巨大,对商场、地铁等公共场所的人员流量进行检测的方法,主要有人工检测、红外线遮挡检测、重力检测、移动设备信号检测等。

2、虽然仍然有大量的场所依旧在使用如游乐场排队人数检测、教室学生人数统计、学校在校人数统计等,但是人工检测不仅耗时耗力,而且受到责任心等人为因素的严重影响,因此目前正在逐渐被其他检测方式所替代。而目前的自动检测技术中,红外线遮挡检测对于多目标的检测效果差且容易漏检;重力检测容易受到人员体重因素和携带物质量因素的影响不仅检测准确率低,而且不能准确地统计实际的人数;移动设备信号检测对于携带多个移动设备以及移动设备信号故障的人员无法检测;因此这些技术都普遍存在检测适用性有限、检测准确率差、测量误差大等缺点。

技术实现思路

1、本发明为了解决现有的人员流量检测方法存在适用性有限、检测准确率差的问题。

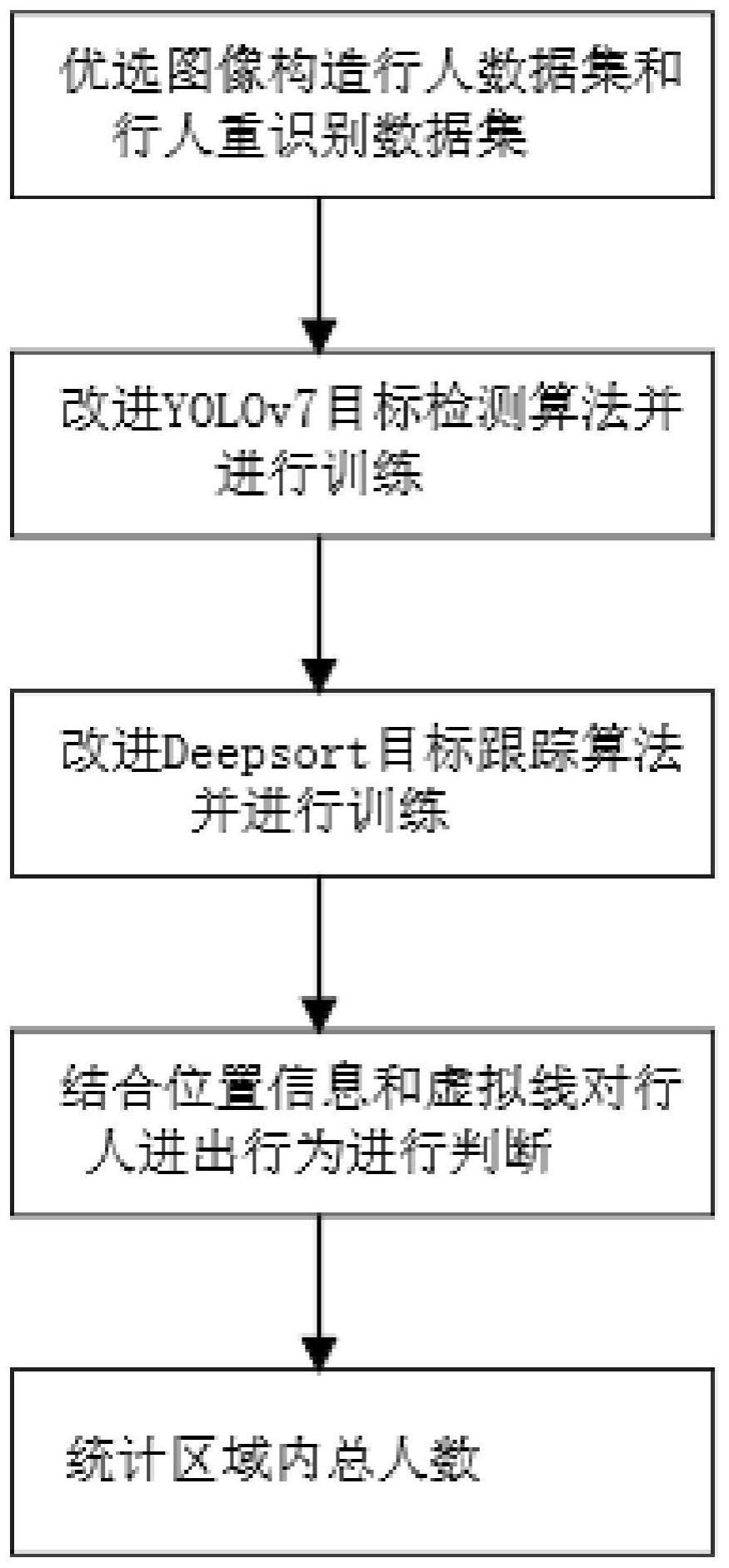

2、一种基于深度学习的人员流量检测方法,包括以下步骤:

3、首先将监控视频帧图像输入目标识别神经网络模型进行目标识别,基于目标识别神经网络模型按帧对目标进行识别的结果,采用改进的deepsort模型进行跟踪,在基于deepsort模型进行跟踪的过程中,使用卡尔曼滤波算法作为改进的deepsort模型的位置预测器,同时使用匈牙利算法作为特征匹配器,用余弦距离计算检测框经过向量化得到的近似度,再利用匈牙利算法对前后两帧中检测框内行人进行匹配,确定前后两帧中的同一人员实现跟踪,基于跟踪结果实现人员流量的检测;

4、所述的改进的deepsort模型为改进了提取网络的deepsort模型,即使用训练好的reid特征提取网络作为deepsort模型的征提取网络;训练好的reid特征提取网络为利用乘客行人重识别数据集对reid特征提取网络进行训练得到的,所述的乘客行人重识别数据集是基于已知的监控视频帧图像制作的。

5、进一步地,所述的reid特征提取网络选用resnet网络。

6、进一步地,所述的目标识别神经网络模型为改进yolov7模型,所述的改进yolov7模型结构如下:

7、yolov7模型包括输入层、主干网络backbone、特征融合网络head和输出层;基于所述的yolov7模型,在主干网络和特征融合网络之间的每个处理路径上引入cbam注意力机制模块,同时在特征融合网络中重构sppcspc模型块汇中,采用simam注意力机制模块替换位于池化层之前的1×1的cbs层,即裁剪掉一个位于池化层之前的1×1的cbs层,并在相同的位置增加一个simam注意力机制模块。

8、进一步地,采用改进的deepsort模型进行跟踪的具体过程包括以下步骤:

9、(1)、基于目标识别神经网络模型按帧对目标进行识别的结果,针对第一次检测到的结果创建对应的轨迹tracks;

10、(2)、将当前的帧目标检测的结果和上一帧通过tracks预测的结果进行iou匹配,确定确认态或未确认态;

11、(3)、将代价矩阵输入至匈牙利算法中,得到线性匹配结果,并更新对应的卡尔曼参数;

12、(4)、循环执行步骤(2)至步骤(3),当出现确认态的tracks时或视频的帧结束时停止循环,进入步骤(5);

13、(5)、通过卡尔曼滤波预测确认态的tracks和未确认态的tracks对应的框,将确认态的tracks的框和detections进行级联匹配,将未确认态的tracks对应的框和detections进行iou匹配;

14、(6)、进行级联匹配的数据关联并计算代价矩阵,对跟踪过程中出现频率最高的目标赋予其优先权,若出现频率最高的目标达到最大的未匹配帧数时将其删除;

15、(7)、将步骤(6)中所有代价矩阵输入至匈牙利算法中,得到线性匹配结果;

16、(8)、循环执行步骤(5)至步骤(7),从而实现实时的目标跟踪。

17、进一步地,所述基于跟踪结果实现人员流量的检测的过程包括以下步骤:

18、s41、对车厢监控视角画面关键区域设置虚拟线,在车厢开关门关键区域设置横向虚拟线,用于检测行人的上下车人数,在车厢之间的通道关键区域设置纵向虚拟线,用于检测乘客的上下车人数;

19、s42、根据每一个tracks的前后的帧位置和虚拟线位置来判断该目标的状态,采用reid特征提取网络对所述客流视频的帧集合进行目标行人检索,获取目标视频帧集合;

20、基于目标视频的帧集合中的目标进行位置划定,在图像中靠近车门进出口区域和车厢之间的过道处设置虚拟线;在上下车区域以乘客上车方向的变动为正方向,以下车方向的变动为负方向;在车厢过道处以列车前进方向为正方向,以列车前进方向的反方向为负方向;将车厢停靠后开门的一侧两个门记为a车门和b车门;

21、单侧开门时:为第i站点、第j节车厢a车门的人数增加量、进入量、流出量;为第i站点、第j节车厢b车门的人数增加量、进入量、流出量;为第i站点、第j节车厢和第i+1站点、第j节车厢相连的通道的人数增加量、进入量、流出量;iij为第i站点、第j节车厢的人数的增加量;

22、列车车门关键区域,当乘客轨迹没有撞击虚拟线时,即乘客只在车厢内行走;当乘客轨迹撞击虚拟线且由车内移动到车外,即乘客进行下车行为,或值减一、或值保持不变、或值加一;当乘客轨迹撞击虚拟线且由车外移动到车内,即乘客进行上车行为,或值加一、或值加一、或值保持不变;

23、车厢通道关键区域,当乘客轨迹撞击虚拟线且乘客轨迹和列车前进方向相同时,值加一、值加一、值不变;当乘客轨迹撞击虚拟线且乘客轨迹和列车前进方向相同时,值加一、值加一、值不变;

24、s43、对各时间段各车厢的内检测的客流数据进行汇总、整理,并计算出对应车厢的人数:

25、针对第i站第j节车厢,人数变化量为

26、

27、

28、

29、

30、其中,为第i站第0节车厢的进入和流出人数;为第i站第max节车厢的进入和流出人数;是起始站流出人数和终点站进入人数;

31、最终得到,第a站点、第j节车厢的总人数raj为:

32、

33、一种基于深度学习的人员流量检测系统,包括:

34、目标识别单元:将基于监控视频帧图像输入目标识别神经网络模型进行目标识别;

35、目标跟踪单元:基于目标识别神经网络模型按帧对目标进行识别的结果,采用改进的deepsort模型进行跟踪,在基于deepsort模型进行跟踪的过程中,使用卡尔曼滤波算法作为改进的deepsort模型的位置预测器,同时使用匈牙利算法作为特征匹配器,用余弦距离计算检测框经过向量化得到的近似度,再利用匈牙利算法对前后两帧中检测框内行人进行匹配,确定前后两帧中的同一人员实现跟踪;

36、所述的改进的deepsort模型为改进了提取网络的deepsort模型,即使用训练好的reid特征提取网络作为deepsort模型的征提取网络;训练好的reid特征提取网络为利用乘客行人重识别数据集对reid特征提取网络进行训练得到的,所述的乘客行人重识别数据集是基于已知的监控视频帧图像制作的;

37、人员流量检测单元:基于跟踪结果实现人员流量的检测。

38、进一步地,所述的reid特征提取网络选用resnet网络。

39、进一步地,所述的目标识别神经网络模型为改进yolov7模型,所述的改进yolov7模型结构如下:

40、yolov7模型包括输入层、主干网络backbone、特征融合网络head和输出层;基于所述的yolov7模型,在主干网络和特征融合网络之间的每个处理路径上引入cbam注意力机制模块,同时在特征融合网络中重构sppcspc模型块汇中,采用simam注意力机制模块替换位于池化层之前的1×1的cbs层,即裁剪掉一个位于池化层之前的1×1的cbs层,并在相同的位置增加一个simam注意力机制模块。

41、进一步地,目标跟踪单元采用改进的deepsort模型进行跟踪的具体过程包括以下步骤:

42、(1)、基于目标识别神经网络模型按帧对目标进行识别的结果,针对第一次检测到的结果创建对应的轨迹tracks;

43、(2)、将当前的帧目标检测的结果和上一帧通过tracks预测的结果进行iou匹配,确定确认态或未确认态;

44、(3)、将代价矩阵输入至匈牙利算法中,得到线性匹配结果,并更新对应的卡尔曼参数;

45、(4)、循环执行步骤(2)至步骤(3),当出现确认态的tracks时或视频的帧结束时停止循环,进入步骤(5);

46、(5)、通过卡尔曼滤波预测确认态的tracks和未确认态的tracks对应的框,将确认态的tracks的框和detections进行级联匹配,将未确认态的tracks对应的框和detections进行iou匹配;

47、(6)、进行级联匹配的数据关联并计算代价矩阵,对跟踪过程中出现频率最高的目标赋予其优先权,若出现频率最高的目标达到最大的未匹配帧数时将其删除;

48、(7)、将步骤(6)中所有代价矩阵输入至匈牙利算法中,得到线性匹配结果;

49、(8)、循环执行步骤(5)至步骤(7),从而实现实时的目标跟踪。

50、进一步地,人员流量检测单元基于跟踪结果实现人员流量检测的过程包括以下步骤:

51、s41、对车厢监控视角画面关键区域设置虚拟线,在车厢开关门关键区域设置横向虚拟线,用于检测行人的上下车人数,在车厢之间的通道关键区域设置纵向虚拟线,用于检测乘客的上下车人数;

52、s42、根据每一个tracks的前后的帧位置和虚拟线位置来判断该目标的状态,采用reid特征提取网络对所述客流视频的帧集合进行目标行人检索,获取目标视频帧集合;

53、基于目标视频的帧集合中的目标进行位置划定,在图像中靠近车门进出口区域和车厢之间的过道处设置虚拟线;在上下车区域以乘客上车方向的变动为正方向,以下车方向的变动为负方向;在车厢过道处以列车前进方向为正方向,以列车前进方向的反方向为负方向;将车厢停靠后开门的一侧两个门记为a车门和b车门;

54、单侧开门时:为第i站点、第j节车厢a车门的人数增加量、进入量、流出量;为第i站点、第j节车厢b车门的人数增加量、进入量、流出量;为第i站点、第j节车厢和第i+1站点、第j节车厢相连的通道的人数增加量、进入量、流出量;iij为第i站点、第j节车厢的人数的增加量;

55、列车车门关键区域,当乘客轨迹没有撞击虚拟线时,即乘客只在车厢内行走;当乘客轨迹撞击虚拟线且由车内移动到车外,即乘客进行下车行为,或值减一、或值保持不变、或值加一;当乘客轨迹撞击虚拟线且由车外移动到车内,即乘客进行上车行为,或值加一、或值加一、或值保持不变;

56、车厢通道关键区域,当乘客轨迹撞击虚拟线且乘客轨迹和列车前进方向相同时,值加一、值加一、值不变;当乘客轨迹撞击虚拟线且乘客轨迹和列车前进方向相同时,值加一、值加一、值不变;

57、s43、对各时间段各车厢的内检测的客流数据进行汇总、整理,并计算出对应车厢的人数:

58、针对第i站第j节车厢,人数变化量为

59、

60、

61、

62、

63、其中,为第i站第0节车厢的进入和流出人数;为第i站第max节车厢的进入和流出人数;是起始站流出人数和终点站进入人数;

64、最终得到,第a站点、第j节车厢的总人数raj为:

65、

66、有益效果:

67、本发明提供了基于深度学习的人员流量检测方法,可以捕捉和跟踪密集目标行人的特征,可以在无人工干预的情况下自动实现公共场所环境下的人员流量检测,本发明适用于包括移动设备信号覆盖不到的多种环境,适用性强;同时本发明具有较高的检测准确率,因此能够为人员诱导提供可靠的数据支持。

- 还没有人留言评论。精彩留言会获得点赞!