一种基于颜色标签的漫画线稿图的着色方法及系统

本发明涉及图像处理领域,特别是涉及一种基于颜色标签的漫画线稿图的着色方法及系统。

背景技术:

1、在漫画艺术创作中,着色是至关重要的,因为它可以增强故事性、传达情感和增加视觉吸引力。线稿的着色需要考虑适当的颜色组合、复杂的纹理和阴影细节,并且通常需要专业知识。但人工上色可能会因技术或创作上的限制或未完全理解作者的意图而达不到预期效果,导致出现偏差。此外,它会带来额外的时间和经济成本。因此,高质量的自动化线稿艺术着色研究既必要又极具吸引力。

2、现有的自动线稿艺术着色方法可分为两类:非用户引导和用户引导。非用户引导的方法通常通过感知图像的内部线稿细节和结构信息来生成彩色图像。但是,它们不能满足用户定制化需求并且缺乏交互性。用户引导的着色方法涉及三种主要类型的用户提示:涂鸦、参考图像和语言。

3、与涂鸦和参考图像相比,语言是人类准确表达思想最直接的工具,可以通过简单的文字描述或说明传达对着色结果的期望和要求。因此,使用语言(文本标签)进行线稿艺术着色作为重点研究。

4、目前,已经对基于语言的着色进行了各种研究。有文献使用描述特定对象颜色的文本句子作为用户提示为灰度图像着色;有文献通过使用带有颜色描述的文本句子作为用户提示来修改图像特定部分的颜色;有文献提出使用文本标签为艺术线稿图像着色。这种方法对单字线稿图像的着色有一定的效果,但是,它在为多个人物的艺术线稿图像着色时表现不佳,不仅难以正确匹配文本标签,而且还存在渗色和伪影。在现有的这些方法中,当用户提供的需求信息不完整、不详细时,往往会在角色没有自定义颜色的部分进行不合理的着色,导致最终生成的彩色图像出现颜色不匹配的问题。

5、可见,目前虽然已有一些基于语言的图像着色研究,但仍然缺乏基于语言的线稿着色研究,尤其是多人物线稿着色研究。文本标签和相应像素之间的关系是高度非线性的,因此很难学习这种关联。设计的模型需要能够捕捉这种复杂的关系,并根据文本标签生成适当的颜色和纹理。因此,基于文本标签的多人物线稿艺术着色问题仍极具挑战性。

技术实现思路

1、基于此,本发明实施例提供一种基于颜色标签的漫画线稿图的着色方法及系统,以在多人物线稿艺术上实现准确着色。

2、为实现上述目的,本发明实施例提供了如下方案:

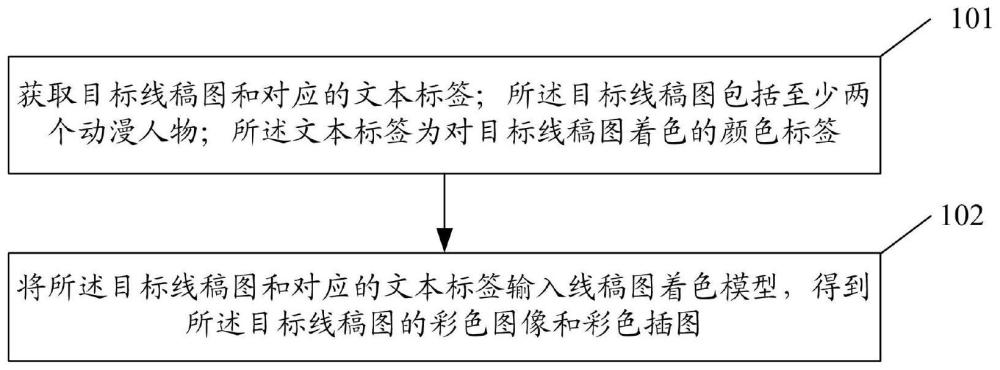

3、一种基于颜色标签的漫画线稿图的着色方法,包括:

4、获取目标线稿图和对应的文本标签;所述目标线稿图包括至少两个动漫人物;所述文本标签为对目标线稿图着色的颜色标签;

5、将所述目标线稿图和对应的文本标签输入线稿图着色模型,得到所述目标线稿图的彩色图像和彩色插图;

6、其中,所述线稿图着色模型的确定方法包括:

7、采用训练数据集对multag2pix网络进行训练,并将训练好的multag2pix网络中训练好的生成器确定为所述线稿图着色模型;

8、所述训练数据集包括:训练线稿图以及对应的文本标签、真实彩色图像和真实彩色插图;所述multag2pix网络包括依次连接的生成器和鉴别器;所述生成器包括:特征提取模块、风格迁移模块和细化着色模块;

9、所述特征提取模块用于对输入的线稿图进行特征提取,得到特征提取信特征提取模块、风格迁移模块和细化着色模块息;所述特征提取信息包括:不同动漫人物的边缘分割信息和单个动漫人物内部区域的特征信息;

10、所述风格迁移模块用于对输入的文本标签提取空间特征和语义特征,并根据所述特征提取信息、所述语义特征和所述空间特征进行风格迁移,得到风格化特征图;

11、所述细化着色模块用于根据所述特征提取信息、所述语义特征和所述风格化特征图进行解码,得到与输入的线稿图对应的彩色图像和彩色插图。

12、可选地,所述特征提取模块包括:第一特征提取单元、第二特征提取单元和第一特征融合单元;所述第一特征提取单元包括:u-net网络;所述第二特征提取单元包括:resnext-50网络;

13、所述第一特征提取单元用于对输入的线稿图进行特征提取,得到第一特征;所述第一特征包括:不同动漫人物的边缘分割信息;

14、所述第二特征提取单元用于根据输入的线稿图确定骨架预测图,并对所述骨架预测图进行特征提取,得到第二特征;所述第二特征包括:单个动漫人物内部区域的特征信息;

15、所述第一特征融合单元用于将所述第一特征和所述第二特征融合,得到所述特征提取信息。

16、可选地,所述风格迁移模块包括:cvt编码器、adain块和第二特征融合单元;

17、所述编码器用于对输入的文本标签提取空间特征和语义特征;

18、所述adain块用于根据所述特征提取信息和所述语义特征进行风格迁移,得到第三特征;

19、所述第二特征融合单元用于将所述第三特征和所述空间特征融合,得到所述风格化特征图。

20、可选地,所述cvt编码器包括:第一编码单元和第二编码单元;

21、所述第一编码单元包括:依次连接的一个全连接层和三个卷积层;所述第一编码单元用于对输入的文本标签提取空间特征;

22、所述第二编码单元包括:依次连接的四个全连接层;所述第二编码单元用于对输入的文本标签提取语义特征。

23、可选地,所述adain块包括:三个相同且依次连接的子模块;所述子模块包括:依次连接的卷积层、自适应实例归一化层和激活函数。

24、可选地,所述细化着色模块包括:生成解码器和引导解码器;

25、所述生成解码器用于根据所述特征提取信息、所述语义特征和所述风格化特征图进行解码,得到与输入的线稿图对应的彩色图像;

26、所述引导解码器用于根据所述风格化特征图进行解码,得到与输入的线稿图对应的彩色插图。

27、可选地,所述生成解码器包括:依次连接的四个解码层和一个卷积层;所述解码层包括:依次连接的convnext块和pixelshuffle层。

28、可选地,所述引导解码器包括:依次连接的四个卷积层。

29、本发明还提供了一种基于颜色标签的漫画线稿图的着色系统,包括:

30、线稿图获取模块,用于获取目标线稿图和对应的文本标签;所述目标线稿图包括至少两个动漫人物;所述文本标签为对目标线稿图着色的颜色标签;

31、线稿图着色模型确定模块,用于确定线稿图着色模型;

32、线稿图着色模块,用于将所述目标线稿图和对应的文本标签输入线稿图着色模型,得到所述目标线稿图的彩色图像和彩色插图;

33、所述线稿图着色模型确定模块,具体包括:

34、模型训练单元,用于采用训练数据集对multag2pix网络进行训练,并将训练好的multag2pix网络中训练好的生成器确定为所述线稿图着色模型;

35、所述训练数据集包括:训练线稿图以及对应的文本标签、真实彩色图像和真实彩色插图;所述multag2pix网络包括依次连接的生成器和鉴别器;所述生成器包括:特征提取模块、风格迁移模块和细化着色模块;

36、所述特征提取模块用于对输入的线稿图进行特征提取,得到特征提取信息;所述特征提取信息包括:不同动漫人物的边缘分割信息和单个动漫人物内部区域的特征信息;

37、所述风格迁移模块用于对输入的文本标签提取空间特征和语义特征,并根据所述特征提取信息、所述语义特征和所述空间特征进行风格迁移,得到风格化特征图;

38、所述细化着色模块用于根据所述特征提取信息、所述语义特征和所述风格化特征图进行解码,得到与输入的线稿图对应的彩色图像和彩色插图。

39、根据本发明提供的具体实施例,本发明公开了以下技术效果:

40、本发明实施例基于颜色标签和multag2pix实现了多人物漫画线稿图的着色,其中融合不同动漫人物的边缘分割信息、单个动漫人物内部区域的特征信息、文本标签的空间特征和文本标签的语义特征实现着色,提高了多人物线稿艺术上着色的准确性。

- 还没有人留言评论。精彩留言会获得点赞!