数字人界面控制的优化方法与流程

本技术涉及智能控制,且更为具体地,涉及一种数字人界面控制的优化方法。

背景技术:

1、数字人是指利用计算机技术生成的虚拟人物形象,数字人具备人类的外观和行为模式,其本体存在于计算设备中(比如电脑、手机)中,通过显示设备呈现出来,让人类能通过眼睛看见。在平常的观感上,数字人是整合了人物形象模拟、人物声音克隆、自然语言处理、知识图谱解析等众多世界领先的人工智能技术的可视化数字虚拟人。

2、在数字人界面控制领域中,虚拟形象语音动画合成技术可以根据输入语音,通过某种规则或者深度学习算法生成对应的3d虚拟形象人脸表情系数,从而完成3d虚拟形象的口型的精准驱动,实现虚拟数字人在新闻播报、虚拟客服等领域的应用。唇形驱动控制直接影响数字人的逼真程度,但现有的唇形驱动控制技术,在虚拟数字人的语音交互的过程中,唇形与语音的匹配效果不佳。

3、因此,期待一种数字人界面控制的优化方法。

技术实现思路

1、为了解决上述技术问题,提出了本技术。本技术的实施例提供了一种数字人界面控制的优化方法,其利用深度学习技术从唇语识别图像集中提取出唇形参考特征,以及从输入的音频数据中提取出音频语义特征,同时建立音频语义特征和唇形参考特征的关联关系,并基于二者的关联特征生成对应于输入音频的唇形动作视频。这样,能够实现更加精准的口型驱动,使虚拟数字人的口型表现更加逼真,提供更加自然、流畅的虚拟人机交互体验。

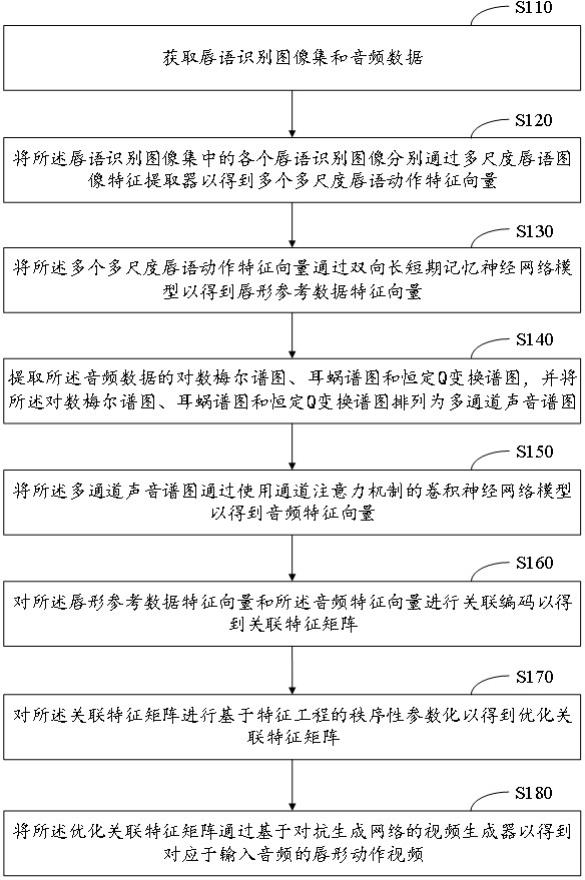

2、相应地,根据本技术的一个方面,提供了一种数字人界面控制的优化方法,其包括:

3、获取唇语识别图像集和音频数据;

4、将所述唇语识别图像集中的各个唇语识别图像分别通过多尺度唇语图像特征提取器以得到多个多尺度唇语动作特征向量;

5、将所述多个多尺度唇语动作特征向量通过双向长短期记忆神经网络模型以得到唇形参考数据特征向量;

6、提取所述音频数据的对数梅尔谱图、耳蜗谱图和恒定q变换谱图,并将所述对数梅尔谱图、耳蜗谱图和恒定q变换谱图排列为多通道声音谱图;

7、将所述多通道声音谱图通过使用通道注意力机制的卷积神经网络模型以得到音频特征向量;

8、对所述唇形参考数据特征向量和所述音频特征向量进行关联编码以得到关联特征矩阵;

9、对所述关联特征矩阵进行基于特征工程的秩序性参数化以得到优化关联特征矩阵;

10、将所述优化关联特征矩阵通过基于对抗生成网络的视频生成器以得到对应于输入音频的唇形动作视频。

11、在上述数字人界面控制的优化方法中,所述多尺度唇语图像特征提取器包括第一卷积层、与所述第一卷积层并行的第二卷积层,以及,与所述第一卷积层和所述第二卷积层连接的级联层,其中,所述第一卷积层使用具有第一尺度的二维卷积核,所述第二卷积层使用具有第二尺度的二维卷积核。

12、在上述数字人界面控制的优化方法中,将所述唇语识别图像集中的各个唇语识别图像分别通过多尺度唇语图像特征提取器以得到多个多尺度唇语动作特征向量,包括:使用所述多尺度唇语图像特征提取器的第一卷积层的各层在层的正向传递中分别对输入数据进行:基于所述具有第一尺度的二维卷积核对所述输入数据进行卷积处理、全局均值池化处理和非线性激活处理以得到第一尺度唇语动作特征向量;使用所述多尺度唇语图像特征提取器的第二卷积层的各层在层的正向传递中分别对输入数据进行:基于所述具有第二尺度的二维卷积核对所述输入数据进行卷积处理、全局均值池化处理和非线性激活处理以得到第二尺度唇语动作特征向量;融合所述第一尺度唇语动作特征向量和所述第二尺度唇语动作特征向量以得到所述多尺度唇语动作特征向量。

13、在上述数字人界面控制的优化方法中,将所述多通道声音谱图通过使用通道注意力机制的卷积神经网络模型以得到音频特征向量,包括:使用所述卷积神经网络的各层在层的正向传递中对输入数据分别进行:基于三维卷积核对所述输入数据进行卷积处理以得到卷积特征图;对所述卷积特征图的沿通道维度的各个特征矩阵进行全局均值池化以得到通道特征向量;计算所述通道特征向量中各个位置的特征值相对于所述通道特征向量的所有位置的特征值的加权和的比值以得到通道加权特征向量;以所述通道加权特征向量中各个位置的特征值作为权重对所述卷积特征图的沿通道维度的特征矩阵进行加权以得到通道注意力特征图;对所述通道注意力特征图进行沿通道维度的各个特征矩阵的全局池化处理以得到池化特征图;对所述池化特征图进行激活处理以生成激活特征图;其中,所述卷积神经网络的最后一层的输出为所述音频特征向量,所述卷积神经网络的第一层的输入为所述多通道声音谱图。

14、在上述数字人界面控制的优化方法中,对所述唇形参考数据特征向量和所述音频特征向量进行关联编码以得到关联特征矩阵,包括:以如下关联公式对所述唇形参考数据特征向量和所述音频特征向量进行关联编码以得到所述关联特征矩阵;

15、其中,所述关联公式为:

16、

17、其中表示所述唇形参考数据特征向量,表示所述唇形参考数据特征向量的转置向量,表示所述音频特征向量,表示所述关联特征矩阵,表示向量相乘。

18、在上述数字人界面控制的优化方法中,对所述关联特征矩阵进行基于特征工程的秩序性参数化以得到优化关联特征矩阵,包括:对所述关联特征矩阵进行特征矩阵切分以得到关联局部特征矩阵的序列;将所述关联局部特征矩阵的序列通过基于softmax函数的秩序性权重生成器以得到秩序权重值的序列;基于所述秩序权重值的序列,对所述关联局部特征矩阵的序列进行排序以得到重排关联局部特征矩阵的序列;对所述重排关联局部特征矩阵的序列进行特征展平化以得到重排关联局部特征向量的序列;将所述重排关联局部特征向量的序列通过基于转换器的上下文编码器以得到上下文重排关联局部特征向量的序列;对所述秩序权重值的序列进行基于最大值的归一化处理以得到归一化秩序权重值的序列;以所述归一化秩序权重值的序列中各个位置的归一化秩序权重值作为权重,分别对所述上下文重排关联局部特征向量的序列进行加权以得到优化上下文重排关联局部特征向量的序列;对所述优化上下文重排关联局部特征向量的序列进行维度重构以得到所述优化关联特征矩阵。

19、在上述数字人界面控制的优化方法中,所述基于对抗生成网络的视频生成器包含鉴别器和生成器,其中,所述生成器用于生成视频,所述鉴别器用于计算生成视频和参考视频之间的差异,并通过梯度下降的方向传播算法来更新所述生成器的网络参数以得到具有生成准确的唇形动作视频功能的生成器;进而,再将所述优化关联特征矩阵输入所述基于对抗生成网络的视频生成器的生成器以得到所述对应于输入音频的唇形动作视频。

20、根据本技术的另一个方面,提供了一种数字人界面控制的优化系统,其包括:

21、数据采集模块,用于获取唇语识别图像集和音频数据;

22、唇形动作特征提取模块,用于将所述唇语识别图像集中的各个唇语识别图像分别通过多尺度唇语图像特征提取器以得到多个多尺度唇语动作特征向量;

23、唇形动作前后向关联特征提取模块,用于将所述多个多尺度唇语动作特征向量通过双向长短期记忆神经网络模型以得到唇形参考数据特征向量;

24、音频谱图提取模块,用于提取所述音频数据的对数梅尔谱图、耳蜗谱图和恒定q变换谱图,并将所述对数梅尔谱图、耳蜗谱图和恒定q变换谱图排列为多通道声音谱图;

25、音频特征提取模块,用于将所述多通道声音谱图通过使用通道注意力机制的卷积神经网络模型以得到音频特征向量;

26、关联模块,用于对所述唇形参考数据特征向量和所述音频特征向量进行关联编码以得到关联特征矩阵;

27、优化模块,用于对所述关联特征矩阵进行基于特征工程的秩序性参数化以得到优化关联特征矩阵;

28、唇形控制结果生成模块,将所述优化关联特征矩阵通过基于对抗生成网络的视频生成器以得到对应于输入音频的唇形动作视频。

29、在上述数字人界面控制的优化系统中,所述多尺度唇语图像特征提取器包括第一卷积层、与所述第一卷积层并行的第二卷积层,以及,与所述第一卷积层和所述第二卷积层连接的级联层,其中,所述第一卷积层使用具有第一尺度的二维卷积核,所述第二卷积层使用具有第二尺度的二维卷积核。

30、在上述数字人界面控制的优化系统中,所述唇形动作特征提取模块,包括:第一尺度特征提取单元,用于使用所述多尺度唇语图像特征提取器的第一卷积层的各层在层的正向传递中分别对输入数据进行:基于所述具有第一尺度的二维卷积核对所述输入数据进行卷积处理、全局均值池化处理和非线性激活处理以得到第一尺度唇语动作特征向量;第二尺度特征提取单元,用于使用所述多尺度唇语图像特征提取器的第二卷积层的各层在层的正向传递中分别对输入数据进行:基于所述具有第二尺度的二维卷积核对所述输入数据进行卷积处理、全局均值池化处理和非线性激活处理以得到第二尺度唇语动作特征向量;多尺度特征融合单元,用于融合所述第一尺度唇语动作特征向量和所述第二尺度唇语动作特征向量以得到所述多尺度唇语动作特征向量。

31、与现有技术相比,本技术提供的数字人界面控制的优化方法,其利用深度学习技术从唇语识别图像集中提取出唇形参考特征,以及从输入的音频数据中提取出音频语义特征,同时建立音频语义特征和唇形参考特征的关联关系,并基于二者的关联特征生成对应于输入音频的唇形动作视频。这样,能够实现更加精准的口型驱动,使虚拟数字人的口型表现更加逼真,提供更加自然、流畅的虚拟人机交互体验。

- 还没有人留言评论。精彩留言会获得点赞!