一种基于改进CenterNet算法的测试样本自动标注方法与流程

本发明属于计算机视觉图像识别,尤其是一种基于改进centernet算法的测试样本自动标注方法。

背景技术:

1、目标检测是计算机视觉的热门研究领域,目前常见的有三类基于深度学习的目标检测算法,分别是基于候选框的目标检测算法、基于回归的目标检测算法和基于无锚框的目标检测算法。

2、基于候选框的目标检测算法其过程分为两步:首先生成目标可能存在的子区域候选框,然后对这些候选框进行分类和校准,实现目标的检测过程。该方法检测精度较高,但检测速度偏慢。

3、基于回归的目标检测算法没有显示的生成候选框,将原始图像输入后,直接回归得到最终结果,该方法检测速度更快,但检测精度有所下降。代表算法yolo系列、ssd系列及其改进算法。

4、与基于锚框的目标检测算法相比,基于无锚框的检测算法取消了预设锚框的过程,其最常见的算法是centernet和cornernet。centernet与cornernet相比,centernet将检测目标作为边界框的中心点,提高了模型对内部信息的感知能力,避免了cornernet中误检率高的问题。但是centernet作为基础模型在处理远距离目标时可能存在较大的检测误差。这是因为目标在远距离时会变得较小,导致其中心点难以准确定位。其次原始的centernet模型对目标定位时可能存在一定的偏差。这是因为中心点预测和尺寸回归是独立进行的,没有直接建模它们之间的关联关系。原始的centernet模型主要依赖单一尺度的特征来进行目标检测,可能无法有效利用不同尺度下的多样信息。

技术实现思路

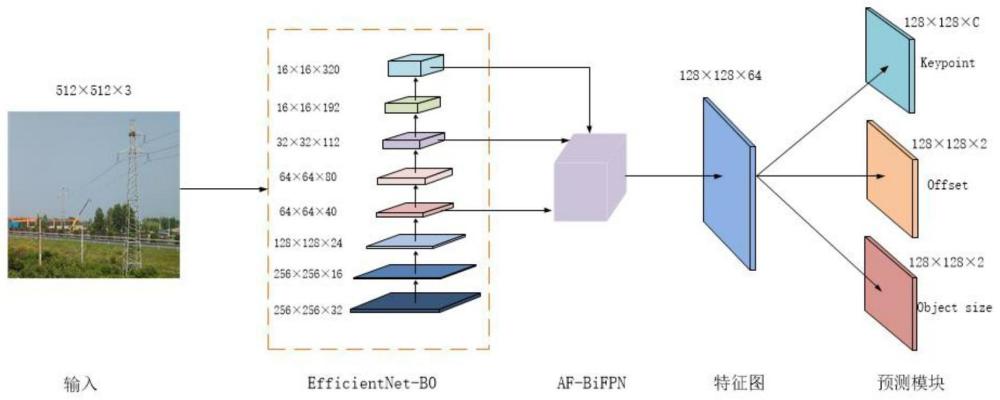

1、本发明的目的在于克服现有技术的不足,提出一种基于改进centernet算法的测试样本自动标注方法,通过引入改进的efficientnet-b0作为特征提取网络,并设计多尺度自适应特征融合模块af-bifpn将浅层像素级特征与深层语义特征结合起来,提高模型检测精度,最后通过引入miou损失将预测的中心点位置以及目标尺寸共同解码为预测框,减少原模型对目标识别过程的定位偏差,进一步实现测试样本的自动标注。

2、本发明解决其技术问题是采取以下技术方案实现的:

3、一种基于改进centernet算法的测试样本自动标注方法,应用于centernet模型中,包括以下步骤:

4、步骤1、调整原图像尺寸;

5、步骤2、通过改进的efficientnet-b0作为特征提取网络对调整后的图像进行特征提取;

6、步骤3、通过多尺度自适应特征融合模块af-bifpn对提取的特征进行多尺度特征融合;

7、步骤4、通过miou损失函数将预测的中心点位置以及目标尺寸共同解码为预测框,进行测试样本的自动标注。

8、而且,所述步骤1的具体实现方法为:将原图像的尺寸调整为512×512。

9、而且,所述步骤2的具体实现方法为:通过包含eca模块的efficientnet-b0网络提取目标特征,并将提取后的目标特征输入至eca模块,eca模块对特征通道之间的关联性进行建模,增强特征的表征能力。

10、而且,所述步骤3的具体实现方法为:将增强后的表征使用改进的双向特征金字塔网络bifpn进行多尺度特征融合,从不同层级的特征金字塔上进行信息的传递和融合输出多尺度的语义信息融合结果;再将多尺度特征融合结果输入至多尺度自适应特征融合模块af-bifpn自适应地融合不同层级的特征图,输出自适应融合后的特征表示。

11、而且,所述步骤4的具体实现方法为:将自适应融合后的特征表示、真实框和标签信息输入至miou损失中衡量预测框与真实框之间的重叠度,输出损失函数的优化结果,指导模型训练。

12、本发明的优点和积极效果是:

13、本发明通过调整原图像尺寸;使用改进的efficientnet-b0作为特征提取网络对调整后的图像进行特征提取;多尺度自适应特征融合模块af-bifpn对提取的特征进行多尺度特征融合;miou损失函数将预测的中心点位置以及目标尺寸共同解码为预测框,进行测试样本的自动标注。本发明通过引入改进的efficientnet-b0作为特征提取网络,并设计多尺度自适应特征融合模块af-bifpn将浅层像素级特征与深层语义特征结合起来,提高模型检测精度,最后通过引入miou损失将预测的中心点位置以及目标尺寸共同解码为预测框,减少原模型对目标识别过程的定位偏差,进一步实现测试样本的自动标注。原centernet模型与本发明提出的改进的centernet网络模型分别进行训练,在工程车辆数据集上的检测结果对比后得出改进的模型在检测精度、检测速度方面均有明显提升。改进模型的map比原模型提高了16.29%,检测速度提高了9fps,模型占用空间减小了43mb。

技术特征:

1.一种基于改进centernet算法的测试样本自动标注方法,应用于centernet模型中,其特征在于:包括以下步骤:

2.根据权利要求1所述的一种基于改进centernet算法的测试样本自动标注方法,其特征在于:所述步骤1的具体实现方法为:将原图像的尺寸调整为512×512。

3.根据权利要求1所述的一种基于改进centernet算法的测试样本自动标注方法,其特征在于:所述步骤2的具体实现方法为:通过包含eca模块的efficientnet-b0网络提取目标特征,并将提取后的目标特征输入至eca模块,eca模块对特征通道之间的关联性进行建模,增强特征的表征能力。

4.根据权利要求3所述的一种基于改进centernet算法的测试样本自动标注方法,其特征在于:所述步骤3的具体实现方法为:将增强后的表征使用改进的双向特征金字塔网络bifpn进行多尺度特征融合,从不同层级的特征金字塔上进行信息的传递和融合输出多尺度的语义信息融合结果;再将多尺度特征融合结果输入至多尺度自适应特征融合模块af-bifpn自适应地融合不同层级的特征图,输出自适应融合后的特征表示。

5.根据权利要求4所述的一种基于改进centernet算法的测试样本自动标注方法,其特征在于:所述步骤4的具体实现方法为:将自适应融合后的特征表示、真实框和标签信息输入至miou损失中衡量预测框与真实框之间的重叠度,输出损失函数的优化结果,指导模型训练。

技术总结

本发明涉及一种基于改进CenterNet算法的测试样本自动标注方法,本发明通过调整原图像尺寸;使用改进的EfficientNet‑B0作为特征提取网络对调整后的图像进行特征提取;多尺度自适应特征融合模块AF‑BiFPN对提取的特征进行多尺度特征融合;MIOU损失函数将预测的中心点位置以及目标尺寸共同解码为预测框,进行测试样本的自动标注。本发明通过引入改进的EfficientNet‑B0作为特征提取网络,并设计多尺度自适应特征融合模块AF‑BiFPN将浅层像素级特征与深层语义特征结合起来,提高模型检测精度,最后通过引入MIOU损失将预测的中心点位置以及目标尺寸共同解码为预测框,减少原模型对目标识别过程的定位偏差,进一步实现测试样本的自动标注。

技术研发人员:郭威,王仰铭,周晨曦,文清丰,李隆基,张弛,王松波,李学刚,李琳,何金,赵琦,董鹏,李楠,姚瑛,晋萃萃,张贺,宁琦

受保护的技术使用者:国网天津市电力公司电力科学研究院

技术研发日:

技术公布日:2024/3/12

- 还没有人留言评论。精彩留言会获得点赞!