一种基于多先验融合的低光照图像增强方法

本发明涉及图像增强或复原领域,具体地说,是一种基于多先验融合的低光照图像增强方法。

背景技术:

1、现实生活中在低光照场景下捕获图像是不可避免的,采集的低光照图像存在曝光不足、模糊、可见性差的不足,不仅难以满足人类对高质量图像的需求,还限制了一些计算机视觉任务的性能,例如:图像识别、目标追踪和图像分割等,为此,一般采集的低光照图像首先会通过转换,使用图像增强方法对低光照图像进行增强。

2、通常而言,现有的方法可以粗略地划分为基于曲线调整的方法、模型驱动的方法以及数据驱动的方法。基于曲线调整的方法旨在根据曲线来调整低光照图像的灰度值以提升其视觉质量,例如:伽马校正。最直观的情况是,借助一个凹函数将低光照图像的像素值转换为正常光照的像素值。模型驱动的方法的代表性方法是retinex理论。其核心思想是从低光照分解出亮度分量和反射分量。反射分量表征了图像的内在特征,即为增强图像。不幸的是,大多数传统方法不能恢复出令人满意的纹理结构和颜色信息。为增强出高质量的图像,一些存在的工作会引入复杂的正则项来赋予模型具有感知纹理结构和保持色彩一致性的能力,但这也带来了额外的求解负担。

3、近年来,随着深度学习的发展,许多基于学习的方法被提出来用于低光照图像增强。与传统方法相比,它们更具有竞争力。基于深度学习的低光照图像增强可以被划分为:基于卷积神经网络(cnn)的方法、基于生成对抗网络(gan)的方法、基于transformer的方法。基于卷积cnn的方法的核心思想是在pixel-wise损失函数的约束下学习低光照到正常光照图像的映射函数。基于gan的方法相比纯cnn的模型具有一定的竞争力,但其训练的不稳定性增加了模型的训练难度。基于transformer的方法由于其自注意力模块带来的全局信息建模为视觉任务带来了活力。

4、一般上,基于深度学习的低光照图像增强旨在学习一个从低光照图像与正常光照图的映射其中x表示输入的低光照图像,为增强结果,从上述映射中,我们可以发现到模型的输入仅包含了低光照图像,而并没有对纹理结构和颜色进行显式或隐式地建模,而众所周知,恢复结构细节并保持颜色一致性是低光照图像增强中众多工作所追求的目标。

技术实现思路

1、本发明是一种基于多先验融合的低光照图像增强方法,可以对低光照图像进行有效增强,恢复纹理结构细节并保持颜色一致性。

2、为达到上述目的,一种基于多先验融合的低光照图像增强方法,包括下列步骤:

3、步骤1、设计深度神经网络模型;

4、步骤2、训练和验证评价深度神经网络模型;

5、步骤3、使用训练好的深度神经网络模型对低光照图像进行增强;

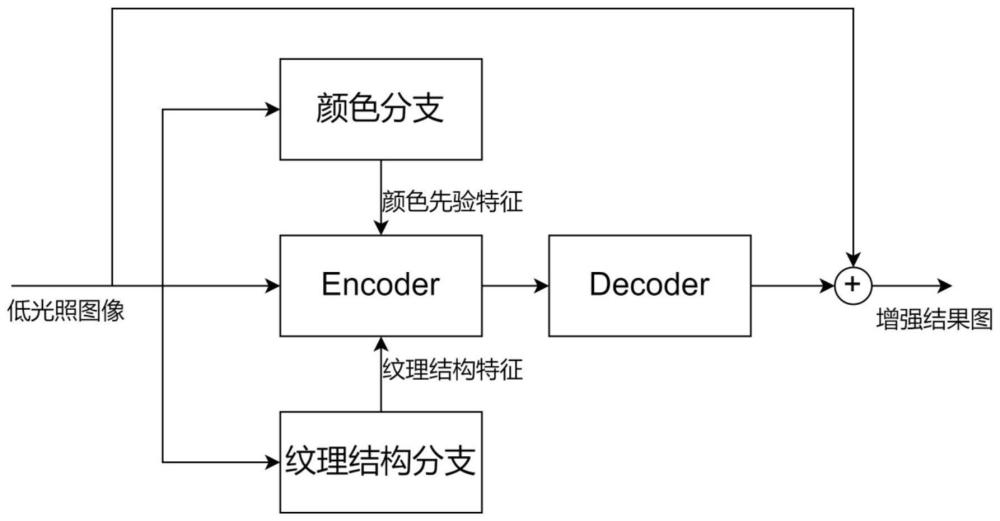

6、深度神经网络模型设置有颜色分支、纹理结构分支、基于transformer架构的encoder模块、基于transformer架构的decoder模块和第一加法模块;

7、颜色分支获取低光照图像后,输出颜色先验特征;

8、纹理结构分支获取低光照图像后,输出纹理结构特征;

9、encoder模块获取低光照图像、颜色先验特征和纹理结构特征后,输出第五内容特征;

10、decoder模块获取第五内容特征后,输出增强差值图;

11、第一加法模块获取增强差值图和低光照图像后,输出增强结果图。

12、采用颜色分支、纹理结构分支、encoder和decoder作为骨干网络,实现内容编码与图像重建,通过特征融合,恢复纹理结构细节并保持颜色一致性。

13、颜色先验特征包括第一颜色先验特征、第二颜色先验特征、第三颜色先验特征和第四颜色先验特征,其空间分辨率为由高到低;

14、所述纹理结构特征包括第一纹理结构特征、第二纹理结构特征、第三纹理结构特征和第四纹理结构特征,其空间分辨率为由高到低。

15、采用不同空间分辨率的颜色先验特征和纹理结构特征,为图像重建提供更加完备的特征表达。

16、颜色分支设置有图像转换模块和负残差网络,图像转换模块获取低光照图像后,输出多尺度颜色图;负残差网络获取多尺度颜色图后,输出颜色先验特征和颜色结果图;

17、多尺度颜色图cmap(x)与低光照图像x的关系为:

18、

19、light(x)=blurr(x)*0.299+blurg(x)*0.587+blurb(x)*0.114

20、

21、其中,表示滤波核大小为k(·)×k(·)的均值滤波,k1=3,k2=5,k3=7;light(x)表示x的亮度分量;blurr(x)、blurg(x)和blurb(x)分别表示blur(x)的rgb通道;⊙为哈达玛积。

22、通过图像转换模块,将低光照图像转换为多尺度颜色图,使得颜色分支更加容易学习到低光照图像的颜色先验特征。

23、负残差网络包括第一卷积块、第一负残差模块、第二负残差模块、第三负残差模块、第四负残差模块、第二卷积块;

24、第一卷积块获取多尺度颜色图后,输出数据d10;

25、第一负残差模块获取数据d10后,输出数据d11;

26、第二负残差模块获取数据d11后,输出数据d12;

27、第三负残差模块获取数据d12后,输出数据d13;

28、第四负残差模块获取数据d13后,输出数据d14;

29、第二卷积块获取数据d14后,输出颜色结果图;

30、其中第一卷积块和第二卷积块的卷积核大小为3×3;

31、数据d11经过1×1的卷积后,得到第一颜色先验特征;

32、合并数据d12与第一颜色先验特征后,生成数据d15,数据d15经过1×1的卷积后,得到第二颜色先验特征;

33、合并数据d13与第二颜色先验特征后,生成数据d16,数据d16经过1×1的卷积后,得到第三颜色先验特征;

34、合并数据d14与第三颜色先验特征后,生成数据d17,数据d17经过1×1的卷积后,得到第四颜色先验特征;

35、第一负残差模块、第二负残差模块、第三负残差模块和第四负残差模块为结构相同的四个负残差模块,单个负残差模块的输入数据为数据d181,输出数据为数据d185,其处理过程为:数据d181经过1×1的卷积后,得到数据d182,数据d182经过3×3的卷积后,得到数据d183,数据d183经过1×1的卷积后,得到数据d184,对数据d184与数据d181进行矩阵减法运算后,得到数据d185。

36、采用带有负残差的模块,来渐进式地学习鲁棒的颜色图,进一步地减少图像噪声;在深度模型中,颜色为浅层的低级语义信息,因此基于负金字塔结构的颜色先验层,来获取不同层级的颜色表示,使得颜色先验特征更加完备。

37、纹理结构分支设置有vgg模块、第一自蒸馏模块、第二自蒸馏模块、第三自蒸馏模块和第四自蒸馏模块;

38、vgg模块获取低光照图像后,其由浅层到深层的输出数据,分别为数据d21、数据d22、数据d23和数据d24;

39、第一自蒸馏模块获取数据d21后,输出第一纹理结构特征;

40、第二自蒸馏模块获取数据d22后,输出第二纹理结构特征;

41、第三自蒸馏模块获取数据d23后,输出第三纹理结构特征;

42、第四自蒸馏模块获取数据d24后,输出第四纹理结构特征。

43、预训练的高级视觉模型,其提取的浅层和深层特征,可以分别表示纹理和结构,因此使用vgg模块由浅层到深层的输出结果,作为提取的纹理结构特征,自蒸馏模块用于精炼vgg模块提取的特征,去除冗余的信息,蒸馏后的特征也更加容易有机融合到encoder中去。

44、第一自蒸馏模块、第二自蒸馏模块、第三自蒸馏模块和第四自蒸馏模块为结构相同的自蒸馏模块,单个自蒸馏模块的输入数据为数据d200,输出数据为数据d293;单个自蒸馏模块的处理过程,包括squeeze阶段和weighting阶段;

45、在squeeze阶段,首先,沿着通道维度计算数据d200的平均值和标准差后,分别得到数据d201和数据d202;然后,通过参数共享的1×1的卷积块,对数据d200、数据d201和数据d202进行降维后,分别得到数据d203、数据d204和数据d205;

46、在weighting阶段,首先,合并数据d204和数据d205后,得到数据d206,使用softmax函数对数据d206进行归一化后,生成特征权重数据d207,沿着通道维度对特征权重数据d207进行切分后,得到数据d208和数据d209,对数据d208和数据d209进行矩阵加法运算后,得到数据d291,使用sigmoid函数对数据d291进行归一化后,得到数据d292,对数据292与数据d203进行哈达玛积运算后,得到数据d293。

47、在squeeze阶段,平均值和标准差是常用且简单的信息量描述器,使用平均值和标准差来辅助通道降维;在weighting阶段,使用softmax和sigmoid函数来生成特征权重,用以强调信息量大的通道的重要性。

48、encoder模块设置有第一内容块、第一融合块、第二内容块、第二融合块、第三内容块、第三融合块、第四内容块、第四融合块和第五内容块;

49、第一内容块获取低光照图像后,输出第一内容特征;

50、第一融合块获取第一内容特征、第一颜色先验特征和第一纹理结构特征后,输出第一融合特征;

51、第二内容块获取第一融合特征后,输出第二内容特征;

52、第二融合块获取第二内容特征、第二颜色先验特征和第二纹理结构特征后,输出第二融合特征;

53、第三内容块获取第二融合特征后,输出第三内容特征;

54、第三融合块获取第三内容特征、第三颜色先验特征和第三纹理结构特征后,输出第三融合特征;

55、第四内容块获取第四融合特征后,输出第四内容特征;

56、第四融合块获取第四内容特征、第四颜色先验特征和第四纹理结构特征后,输出第四融合特征;

57、第五内容块获取第四融合特征后,输出第五内容特征。

58、基于transformer的encoder模块,负责在颜色先验特征、纹理结构特征和图像的内容特征之间提供像素级交互,并提供更优的图像特征。

59、第一融合块、第二融合块、第三融合块和第四融合块为四个结构相同的融合块,单个融合块设置有多先验融合块和联合全局-局部前馈网络;

60、多先验融合块获取内容特征、颜色先验特征和纹理结构特征后,输出数据el`;

61、联合全局-局部前馈网络获取数据el`后,输出数据el*,数据el*为单个融合块的输出数据。

62、使用多先验融合块融合内容特征、颜色先验特征和纹理结构特征,使用联合全局-局部前馈网络保证全局光照一致性与局部光照的多样性。

63、多先验融合块的处理过程为:

64、首先,纹理结构特征、颜色先验特征和内容特征分别依次通过层归一化和1×1卷积后,分别得到query特征、key特征和value特征;

65、然后,对query特征和key特征进行矩阵乘法运算后,得到数据d31,使用softmax函数对数据d31进行归一化后,得到数据d32,对数据d32和value特征进行矩阵乘法后,得到数据d33,数据d33经过1×1卷积后,得到数据d34,对数据d34与第一亮度引导器参数进行哈达玛积相乘后,得到数据d35;

66、最后,对数据d35与内容特征进行矩阵加法运算后,得到数据el`;

67、其中第一亮度引导器参数为1-light(x),light(x)为低光照图像x的亮度分量。

68、使用两次矩阵乘法计算多头自注意力,再使用一个1×1的卷积和残差连接,获取多先验融合的特征表示;使用第一亮度引导器,对低光照区域给予充分的关注。

69、联合全局-局部前馈网络的处理过程为:

70、首先,对数据el`进行通道切分后,得到数据d411、数据d421和数据d431;

71、然后,数据d411经过平均池化后,得到数据d412,数据d412经过向上采样的1×1卷积后,得到数据d413,数据d413乘以第一全局剂量调整参数α后,得到数据d414;数据d421经过平均池化后,得到数据d422,数据d422经过向上采样的3×3可变卷积后,得到数据d423,数据d423乘以第二全局剂量调整参数β后,得到数据d424;数据d431经过3×3的可变卷积后,得到数据d432;其中,数据d411的池化程度大于数据d421的池化程度;

72、最后,对数据d414、数据d424和数据d432进行合并后,得到数据d44,数据d44经过1×1卷积后,得到数据d45,对数据d45与第二亮度引导器参数进行哈达玛积相乘后,得到数据d46,对数据d46与数据el`进行矩阵加法运算后,得到数据el*;

73、其中第二亮度引导器参数为1-light(x),light(x)为低光照图像x的亮度分量。

74、数据d411和数据d412进行平均池化,分别获取全局和大感受野的特征表示,数据d413不进行平均池化,获得局部的特征表示;通过合并和1×1卷积操作,拼接三种不同尺度的特征,同时强调了全局光照的一致性和局部光照的多样性;第一全局剂量调整参数α和第二全局剂量调整参数β,根据图像的内在特性,自适应地调整全局和局部调整的剂量;使用第二亮度引导器,用以关注图像的低光照区域。

75、本发明的益处:可以对低光照图像进行有效增强,恢复纹理结构细节并保持颜色一致性。

- 还没有人留言评论。精彩留言会获得点赞!