基于经典量子的混合卷积神经网络的EEG数据分类方法

本发明涉及量子计算,尤其是基于经典量子的混合卷积神经网络的eeg数据分类方法。

背景技术:

1、量子计算利用量子态叠加产生的量子并行性,相干性等特征,在处理高维数据时表现出特别的优势。量子机器学习是量子计算和机器学习的交叉领域,目前正在受到越来越广泛地关注。量子机器学习主要指通过量子计算硬件实现机器学习算法,基于量子叠加,纠缠,并行性等量子属性,量子机器学习有潜力实现超越经典机器学习技术的学习率和判别效率,从而可以更高效智能的处理经典数据。

2、虽然eeg数据的分类与识别在经典计算领域取得了一定的研究成果,但是在量子计算领域的探索尚且不足。虽然现有的经典计算领域的eegnet神经网络等方法在对eeg数据的分类识别方面取得了较好的效果,但其在量子计算领域方面的探索尚且不足。随着量子计算的发展,量子神经网络的热度越来越高,成为机器学习研究中极具潜力的研究课题,也是当前研究的热门课题。由于eeg数据的高维特性,且现有的可用的量子计算资源的不足,直接使用现有的量子神经网络所带来的计算资源异常巨大。

技术实现思路

1、本发明需要解决的技术问题是提供基于经典量子的混合卷积神经网络的eeg数据分类方法,应用在低量子比特资源的计算场景下。结合量子计算和深度学习的优势,将经典卷积神经网络和量子神经网络相结合,以实现量子计算在eeg数据分类识别领域的应用,并为探索量子计算在该领域的研究提供新的思路。

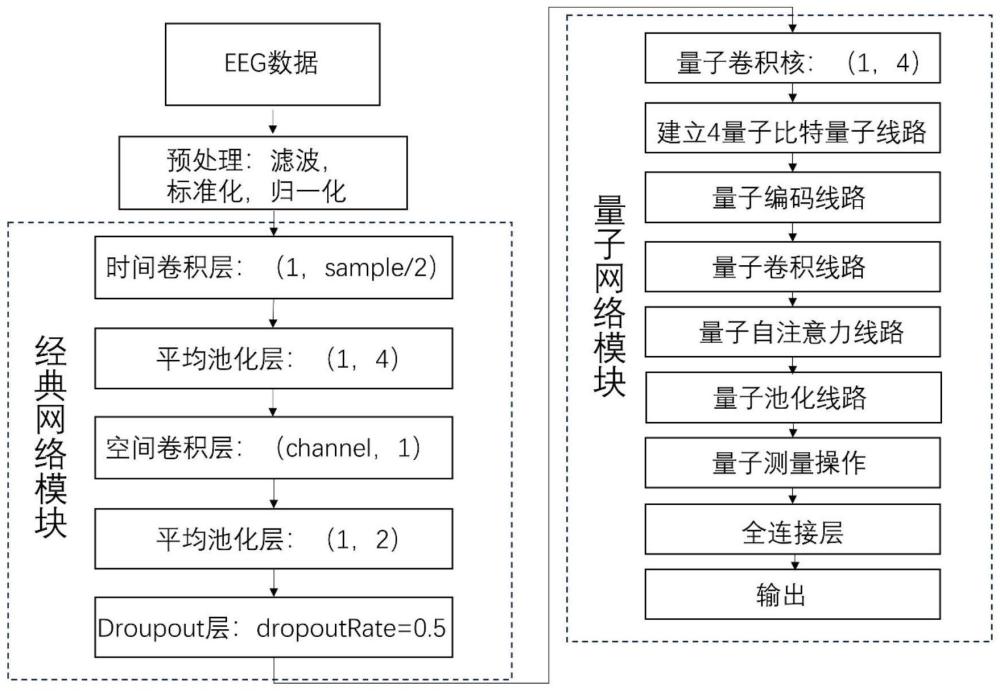

2、为解决上述技术问题,本发明所采用的技术方案是:基于经典量子的混合卷积神经网络的eeg数据分类方法,包括如下步骤:

3、步骤s1、eeg数据预处理:对eeg数据进行滤波处理,并将其进行归一化和标准化处理;

4、步骤s2、经典卷积模块:通过经典卷积模块的卷积层和池化层初步提取eeg数据特征,并对数据进行降维处理得到特征图;

5、步骤s3、将步骤s2中的特征图输入到量子卷积模块中,具体过程如下:

6、步骤s31、确定量子卷积核,设定量子卷积核的大小,确立量子线路的量子比特数,使用卷积窗口从特征图中提取局部数据;

7、步骤s32、建立量子编码线路,将从特征图中提取的局部数据通过量子编码线路编码为对应的量子态;

8、步骤s33、建立量子卷积线路,通过量子卷积线路对编码得到的量子态进行演化,提取特征;

9、步骤s34、建立量子注意力机制线路,通过注意力机制线路对提取到的特征进一步演化;

10、步骤s35、建立量子池化线路,通过量子池化线路对量子态进行进一步演化,减小量子比特位的数量;

11、步骤s36、建立量子测量操作,对经过量子池化后剩余的量子比特位进行测量操作,得到单次测量结果,通过预设的shots值,进行多次测量,取多次测量的期望值作为输出结果;

12、步骤s4、参数优化,建立损失函数,基于链式求导法则,通过反向传播和梯度下降法最小化损失函数,完成参数的更新。

13、本发明技术方案的进一步改进在于:所述步骤s1中eg数据预处理的具体过程为,首先使用fir滤波器对eeg数据进行带通滤波,滤波频率为1-40hz,并且经信号采样频率下采样为128hz,然后对经过处理的eeg数据进行标准化和归一化。

14、本发明技术方案的进一步改进在于:所述步骤s2中经典卷积模块包括卷积层、池化层和dropout层,所述卷积层分为两层,包括时间序列卷积层和空间卷积层,卷积核大小分别为1×sample/2和channel×1,其中,sample为数据采样率,channel为数据的通道电极数,所述池化层选用平均值池化,所述dropout层用于实现让网络在学习过程中按照预先设定概率丢失一部分隐藏的节点输出结果。

15、本发明技术方案的进一步改进在于:所述步骤s31中量子卷积核大小设为m×n,并且建立n个量子比特位的量子线路,其中n=m*n。

16、本发明技术方案的进一步改进在于:所述步骤s32中量子卷积模块中的量子编码线路上的含参量子门,并将使用卷积窗口从特征图中提取局部数据作为含参量子门的参数,完成数据编码,得到量子态|ψx>,其中

17、

18、本发明技术方案的进一步改进在于:所述步骤s33中量子卷积线路包括含参量子线路和纠缠量子线路,其中,含参量子线路包括含参量子门,参数为可学习参数,纠缠量子线路采用cnot双比特控制量子门。

19、本发明技术方案的进一步改进在于:所述步骤s34中所述量子注意力机制线路中的含参量子线路,由含参量子门构成,包含uq,uk,uv三个量子门,其中uacore量子门由多个cnot量子门和旋转量子门组成,对输入数据的量子比特进行演化。

20、本发明技术方案的进一步改进在于:所述步骤s35中量子池化线路中的含参量子线路由含参量子门构成。

21、本发明技术方案的进一步改进在于:所述步骤s4中建立损失函数,对输出结果和输入数据的期望值进行相似度度量,通过基于梯度的参数优化方式对整个网络的参数进行更新,计算损失函数对于整个网络模型中可调参数的梯度,使用梯度下降法更新网络模型中的参数,

22、定义损失函数为交叉熵损失函数,公式如下:

23、

24、梯度下降法的参数更新方式,公式如下:

25、

26、其中为第k轮训练中第i个参数,η为学习率,为参数的梯度;

27、使用反向传播计算损失函数相对于参数的梯度,经典模块中每一层的梯度使用自动微分法计算,而量子模块采用参数移位法,之后通过链式法则进行反向传播;

28、参数移位法的公式如下:

29、

30、其中f(x,θi)为量子卷积核中量子线路的目标函数,r为移位常数,取

31、由于采用了上述技术方案,本发明取得的技术进步是:

32、本发明的基于经典量子的混合卷积神经网络的eeg数据分类方法,与现有技术相比,本发明通过将经典卷积层和量子卷积层相结合,准确的提取eeg数据特征,对eeg数据进行分类识别,从而实现了量子计算在eeg数据分类识别方面的应用,发挥了量子计算的并行优势,且参数量大大减少,准确率更高,收敛速度更快。

技术特征:

1.基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:包括如下步骤:

2.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s1中eg数据预处理的具体过程为,首先使用fir滤波器对eeg数据进行带通滤波,滤波频率为1-40hz,并且经信号采样频率下采样为128hz,然后对经过处理的eeg数据进行标准化和归一化。

3.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s2中经典卷积模块包括卷积层、池化层和dropout层,所述卷积层分为两层,包括时间序列卷积层和空间卷积层,卷积核大小分别为1×sample/2和channel×1,其中,sample为数据采样率,channel为数据的通道电极数,所述池化层选用平均值池化,所述dropout层用于实现让网络在学习过程中按照预先设定概率丢失一部分隐藏的节点输出结果。

4.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s31中量子卷积核大小设为m×n,并且建立n个量子比特位的量子线路,其中n=m*n。

5.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s32中量子卷积模块中的量子编码线路上的含参量子门,并将使用卷积窗口从特征图中提取局部数据作为含参量子门的参数,完成数据编码,得到量子态|ψx>,其中

6.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s33中量子卷积线路包括含参量子线路和纠缠量子线路,其中,含参量子线路包括含参量子门,参数为可学习参数,纠缠量子线路采用cnot双比特控制量子门。

7.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s34中所述量子注意力机制线路中的含参量子线路,由含参量子门构成,包含uq,uk,uv三个量子门,其中uacore量子门由多个cnot量子门和旋转量子门组成,对输入数据的量子比特进行演化。

8.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s35中量子池化线路中的含参量子线路由含参量子门构成。

9.根据权利要求1所述的基于经典量子的混合卷积神经网络的eeg数据分类方法,其特征在于:所述步骤s4中建立损失函数,对输出结果和输入数据的期望值进行相似度度量,通过基于梯度的参数优化方式对整个网络的参数进行更新,计算损失函数对于整个网络模型中可调参数的梯度,使用梯度下降法更新网络模型中的参数,

技术总结

本发明公开了基于经典量子的混合卷积神经网络的EEG数据分类方法,包括如下步骤:S1、EEG数据预处理:对EEG数据进行滤波处理,并将其进行归一化和标准化处理;S2、经典卷积模块:通过经典卷积模块的卷积层和池化层初步提取EEG数据特征,并对数据进行降维处理得到特征图;S3、将S2中的特征图输入到量子卷积模块中;S4、参数优化,建立损失函数,基于链式求导法则,通过反向传播和梯度下降法最小化损失函数,完成参数的更新。本发明结合量子计算和深度学习的优势,将经典卷积神经网络和量子神经网络相结合,以实现量子计算在EEG数据分类识别领域的应用,并为探索量子计算在该领域的研究提供新的思路。

技术研发人员:付荣荣,牛少雄,王世伟,文桂林,路斌

受保护的技术使用者:燕山大学

技术研发日:

技术公布日:2024/5/16

- 还没有人留言评论。精彩留言会获得点赞!