一种基于人体姿态估计的动态课堂签到方法

本技术涉及模式识别与教育信息化,更具体地,涉及一种基于人体姿态估计的动态课堂签到方法。

背景技术:

1、当前,人工智能技术在很多领域中都得到了广泛的应用。在教育领域,人工智能因其便利的技术而发挥着十分重要的作用。课堂签到作为教育场景下的一个重要环节,需要一种人工智能技术,在保证签到可信度的同时提高签到效率。传统的签到方法一般为点名或签字,但其不具备唯一性和不可替代性,无法保证考勤信息完全正确;近年来使用的一些新型签到方法,大多利用生物特征如指纹、人脸进行签到。虽提升了效率,但仍需特定装置进行识别,易受设备位置等因素影响,操作较为繁琐。

2、随着人工智能技术的发展,人体步态特征因其易采集性、唯一性、不变性、不易模仿性、和高频使用性等特点,逐渐被人们接纳和采用,也是目前较适用教育教学场景“无感”签到的生物特征。但在教育教学场景下,学生密度大,容易存在遮挡、重叠、尺度不一等问题,外界因素如复杂背景和光照变化也加剧了数据处理的难度,人体步态特征也容易受角度、覆盖物等的影响导致难以识别。上述问题为将人体步态特征应用于课堂签到带来不小的挑战,导致识别率不高。

技术实现思路

1、针对现有技术的至少一个缺陷或改进需求,本发明提供了一种基于人体姿态估计的动态课堂签到方法,通过结合检测对象的rgb图像信息及深度图像信息,减少复杂背景和光照变化带来的影响,同时辅助解决遮挡导致的信息缺失。使用一个基于级联transformer的网络架构解决遮挡情况下的逆向问题;并使用全局推理与局部捕获的方式将rgb诱导的骨架特征与深度诱导的轮廓特征进行充分、恰当的融合,使多模态特征具有更高的精度。基于高精度的人体姿态特征,针对课堂场景提出一个新的签到机制进行动态签到。

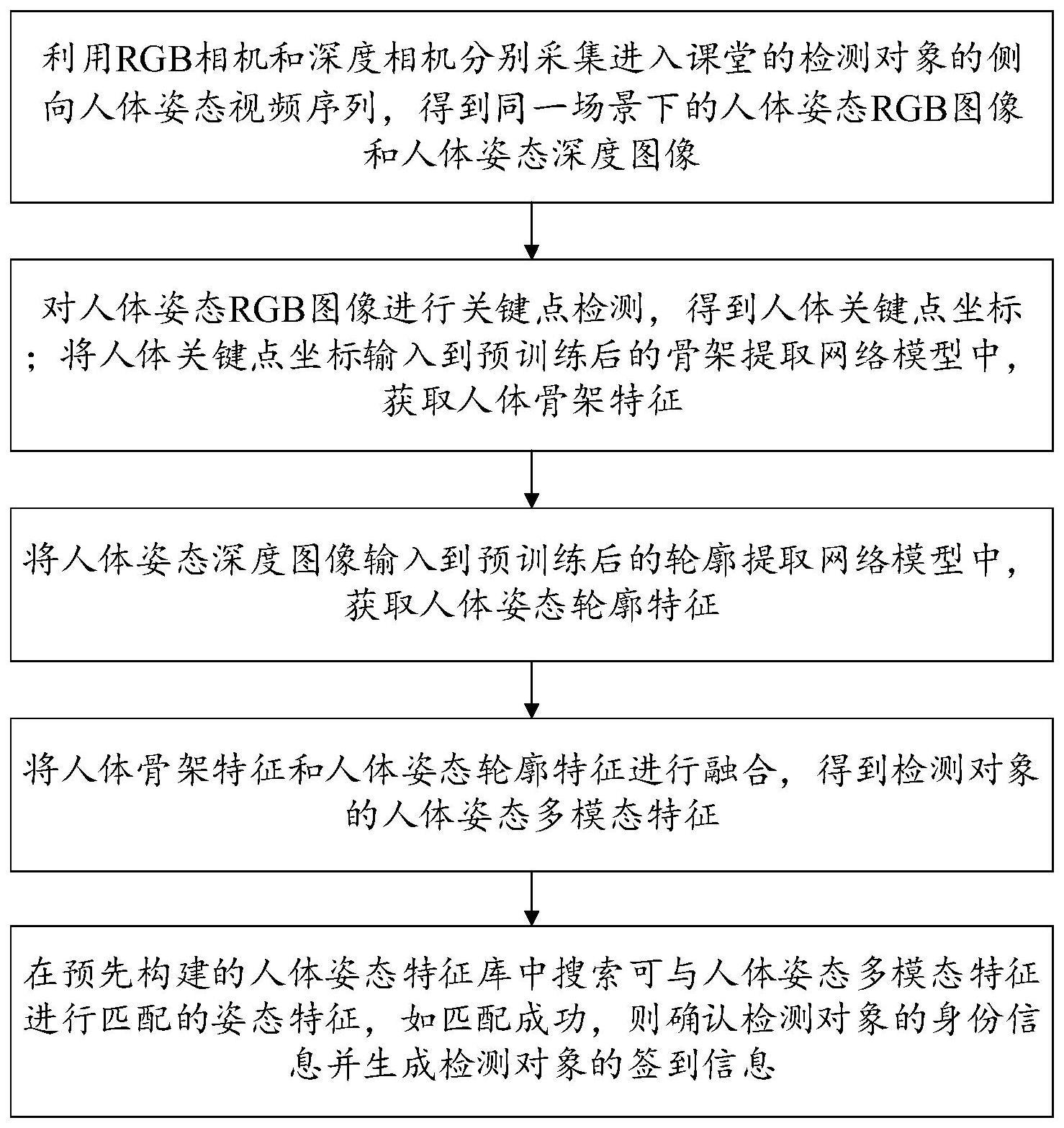

2、为实现上述目的,按照本发明的第一个方面,提供了一种基于人体姿态估计的动态课堂签到方法,其包括:

3、利用rgb相机和深度相机分别采集进入课堂的检测对象的侧向人体姿态视频序列,得到同一场景下的人体姿态rgb图像和人体姿态深度图像;

4、对所述人体姿态rgb图像进行关键点检测,得到人体关键点坐标;将所述人体关键点坐标输入到预训练后的骨架提取网络模型中,获取人体骨架特征;

5、将所述人体姿态深度图像输入到预训练后的轮廓提取网络模型中,获取人体姿态轮廓特征;

6、将所述人体骨架特征和人体姿态轮廓特征进行融合,得到检测对象的人体姿态多模态特征;

7、在预先构建的人体姿态特征库中搜索可与所述人体姿态多模态特征进行匹配的姿态特征,如匹配成功,则确认检测对象的身份信息并生成检测对象的签到信息。

8、进一步地,上述动态课堂签到方法还包括:

9、对所述人体姿态rgb图像和人体姿态深度图像进行数据清洗、几何畸变矫正和噪声抑制处理。

10、进一步地,上述动态课堂签到方法,所述骨架提取网络模型包括多假设生成模块、时序信息嵌入模块、单假设增强模块、多假设交互模块以及回归头;

11、所述多假设姿态生成模块用于根据人体关键点坐标生成多个假设姿态;

12、所述时序信息嵌入模块用于将时间位置编码嵌入到每个所述假设姿态的特征表示中;

13、所述单假设增强模块用于增强单个假设姿态的内部特征;

14、所述多假设融合模块用于将特征增强后的各假设姿态的特征表示进行融合;

15、所述回归头将多假设融合模块输出的融合特征通过线性变换层进行回归,得到所述人体骨架特征。

16、进一步地,上述动态课堂签到方法中,其所述多假设姿态生成模块包括空间位置嵌入器和多个级联的多假设特征编码器;

17、所述空间位置嵌入器将一个可学习的空间位置嵌入每一帧的人体关键点坐标中,保留其关节的空间信息;

18、所述多假设特征编码器用来生成多个假设姿态,每个多假设特征编码器内部使用残差连接促进梯度传播。

19、进一步地,上述动态课堂签到方法中,所述单假设增强模块增强单个假设姿态的内部特征的方式为:

20、逐一对单个假设姿态进行归一化操作及自注意力计算,通过残差连接,得到单假设交互后的第一特征块;

21、将各假设姿态对应的第一特征块进行拼接,经归一化后,使用假设混合多层感知机融合各假设姿态之间的信息,得到特征融合块;

22、沿通道维度将所述特征融合块均匀地分割成不重叠的小块,数量与特征块保持一致,得到特征增强后的单个假设姿态。

23、进一步地,上述动态课堂签到方法中,所述多假设融合模块将各假设姿态的特征表示进行融合的方式为:

24、对特征增强后的多个假设姿态进行归一化操作,并进行姿态间的自注意力计算;

25、通过残差连接,得到单假设交互后的第二特征块;

26、将各假设姿态对应的第二特征块进行拼接,经归一化后,使用假设混合多层感知机融合各假设姿态之间的信息,得到多个姿态假设的融合特征。

27、进一步地,上述动态课堂签到方法中,所述轮廓提取网络模型使用语义分割网络对人体姿态深度图像中的每一个像素点进行分类,使用像素点作为输入,经过一系列卷积、池化操作,输出根据像素点类别分割好的人体姿态轮廓特征。

28、进一步地,上述动态课堂签到方法中,将所述人体骨架特征和人体姿态轮廓特征输入融合网络模型中进行特征融合;

29、所述融合网络模型包括两组具有相同结构的并行网络,第一组为rgb诱导的骨架特征网络,用于提取骨架特征;第二组为深度诱导的轮廓特征网络,用于提取轮廓特征;

30、其中,每组网络均包括公共分支,以及并行的全局分支和局部分支;所述全局分支包括卷积层、池化层和全连接层,所述局部分支采用扩张卷积;

31、在融合阶段,rgb诱导的骨架特征网络、深度诱导的轮廓特征网络的全局分支和本地分支分别合并,并通过逐元素求和的方式将合并的全局分支和局部分支得到的特征图组合为最终的人体姿态多模态特征。

32、进一步地,上述动态课堂签到方法中,所述在预先构建的人体姿态特征库中搜索可与所述人体姿态多模态特征进行匹配的姿态特征,具体为:

33、分别计算所述人体姿态多模态特征与人体姿态特征库中的每个姿态特征之间的欧式距离,将所述欧式距离与预定义的阈值进行比对;所述预定义的阈值包括决断阈值和匹配阈值;

34、若所述欧式距离不小于所述决断阈值,则认为两者不匹配;

35、若所述欧式距离大于所述匹配阈值且小于所述决断阈值,则将对应的姿态特征作为局部最优候选加入匹配队列中;从所述匹配队列中选择欧式距离最小的姿态特征作为全局最优解,与人体姿态多模态特征进行匹配;

36、若所述欧式距离小于所述匹配阈值,则直接将对应的姿态特征作为全局最优解,与人体姿态多模态特征进行匹配。

37、进一步地,上述动态课堂签到方法中,所述人体姿态特征库通过以下方式建立:

38、提取待签到人员的人体姿态特征并建立所述人体姿态特征与所述待签到人员的个人信息之间的映射关系;所述个人信息包括人员学号、院系、姓名。

39、进一步地,上述动态课堂签到方法还包括:

40、将课前进入课堂的检测对象的签到信息加入候选名单,如识别到该检测对象在课前再次离开课堂,则将其签到信息从所述候选名单中移除;

41、循环识别、记录直到课程正式开始,筛选出上课时仍位于课堂内的检测对象,生成签到名单。

42、按照本发明的第二个方面,还提供了一种计算机设备,其包括至少一个处理单元、以及至少一个存储单元,其中,所述存储单元存储有计算机程序,当所述计算机程序被所述处理单元执行时,使得所述处理单元执行上述任一项所述方法的步骤。

43、总体而言,通过本发明所构思的以上技术方案与现有技术相比,能够取得下列有益效果:

44、(1)本发明采用含有骨架提取网络、轮廓提取网络以及融合模型的多模态融合的网络结构;骨架提取网络使用图神经网络架构对rgb图像的关键点及骨架信息进行提取;轮廓提取网络使用u-net模型对深度图像进行处理,得到人体姿态轮廓;融合模型使用vgg-16卷积神经网络作为架构,具有多尺度的上下文推理能力,并且能够允许底层特征和高层特征进行跨模态互补,减少了融合的模糊性,从而得到更加精准的人体姿态特征。

45、(2)本发明使用rgb相机与深度相机相结合的方法,使两相机优势叠加,缺点互补,从而提升了数据获取的质量。使用神经网络模型提取骨架信息以及轮廓信息,并对其进行结合成为人体姿态特征。使用多路径多模态融合地思想,具有更好地融合适应性,使得识别率不易受遮挡、光照变化、复杂背景等因素影响,提高模型的鲁棒性。

46、(3)本发明提出一种由粗到细(coarse-to-fine)的双阈值签到机制,适用于现阶段在各大高校广泛应用的智慧教室场景。具体地,在特征匹配时采用双阈值欧式距离的匹配方式对待识别学生姿态和学生姿态库中的信息进行匹配,能够对特征模糊的待识别学生起到二次比对的效果,从而降低错误判断的可能性。在记录签到时首先使用候选名单机制对学生进出情况进行记录,并不断增删,达到粗粒度筛选的目的。待上课后,将候选名单中的学生记录到正式签到名单中,并将签到结果反馈到学生手机端,真正实现了无感高效签到,并在一定程度上提升签到可信度及公平性。

47、本方法提出的由粗到细的动态签到机制及双阈值欧式距离比对方法能够精准、高效地判断学生签到情况。节约了课堂时间、减轻了师生负担。此外,该公开实施例也能够有效避免签到造假,并降低签到管理和维护成本。

- 还没有人留言评论。精彩留言会获得点赞!