一种基于多摄像头的十字路口车辆实时跟踪方法

1.本发明涉及一种基于多摄像头的十字路口车辆实时跟踪方法。

背景技术:

2.多摄像头车辆识别与跟踪是智能交通系统中研究的重点内容,但多摄像头的切换可能导致目标车辆的外形发生变化,尤其是在十字路口等车祸事故高发地点,监控视频背景复杂、目标车辆遮挡等问题也对识别跟踪的准确度及误检率提出了巨大的挑战。

3.对出现在多个摄像头监控区域下的同一目标进行确定,既是区别于单摄像头目标识别与定位的地方,也是多摄像头目标识别与定位问题的难点所在。对同一目标的确定既包括对同一目标在不同摄像头视角下进行匹配确定,也包括对该目标被遮挡的状态判断,通过对目标的状态和被遮挡情况进行分析判断,完成目标在不同摄像头视角下的持续识别与跟踪。本发明提出一种基于多摄像头的十字路口车辆实时跟踪方法,旨在克服单摄像头下识别与跟踪技术的不足,对多摄像头下车辆的识别与定位方法进行讨论与改进。

技术实现要素:

4.本发明是为了解决上述现有技术存在的问题而提供一种基于多摄像头的十字路口车辆实时跟踪方法。

5.本发明所采用的技术方案有:一种基于多摄像头的十字路口车辆实时跟踪方法,包括s1:采集位于十字路口四个方向上摄像头视角的监控视频;s2:分别对每个摄像头进行目标车辆特征提取,求取每个摄像头下目标车辆的位置,分别求取所有摄像头之间的单应性矩阵,从而确定所有摄像头监控区域下目标车辆的相对位置关系;s3:十字路口四个方向上所有摄像头的监控区域下形成目标车辆的空间位置约束,对不同摄像头下的同一目标车辆进行位置关联,进行目标车辆的特征提取;s4:当某一摄像头发生目标车辆跟踪丢失时,将其他摄像头的信息补偿到该摄像头的监控图像中,完成目标车辆的持续跟踪。

6.进一步地,步骤s2中,根据十字路口四个方向上摄像头的监控视野,选取每个路口的固定标志物,根据选取的固定标志物将整个十字路口框定成一个矩形区域,在矩形区域的视野内分别求取十字路口四个方向上摄像头之间的单应性矩阵,从而确定十字路口四个方向上摄像头监控区域下车辆的相对位置关系。

7.进一步地,选取每个路口的人行横道作为固定标志物。

8.进一步地,通过十字路口四个方向上摄像头同时对同一棋盘格进行拍摄,求取十字路口四个方向上摄像头之间的单应性矩阵。

9.进一步地,步骤s3中,目标车辆的特征提取包括全局特征的颜色特征提取和局部特征的surf算法特征匹配;

针对目标车辆的全局特征提取和局部特征匹配,在目标车辆未被遮挡时,通过全局特征的颜色特征提取选取整个目标车辆的像素区域进行颜色特征提取匹配;当目标车辆出现遮挡现象时,通过目标车辆的位置,比较目标车辆以及遮挡车辆距离目标车辆前进方向处摄像头的距离,靠近所述前进方向处摄像头的遮挡车辆同时进行全局特征提取和局部特征匹配,远离所述前进方向处摄像头的目标车辆选取目标车辆在监控视频中的外界矩形框并减去与遮挡车辆重叠的区域,然后再进行全局特征提取和局部特征匹配,完成目标车辆是否发生遮挡的判断。

10.进一步地,当确定目标车辆发生遮挡时,首先从目标车辆以及遮挡车辆的空间位置进行判断,当十字路口的某一摄像头监控视频中目标车辆的外界矩形框与遮挡车辆的外界矩形框发生重叠时,则可能发生遮挡现象,此时同时对比同一目标车辆原本的颜色特征和sift特征,求取目标车辆颜色特征的欧氏距离,当该目标车辆的欧氏距离大于设定的阈值时,判定目标车辆发生遮挡,然后通过十字路口其他方向的摄像头对目标车辆进行跟踪补偿,标记出目标车辆在被遮挡摄像头中的相对位置,完成目标的识别与定位。

11.进一步地,所述局特征的颜色特征提取为:通过rgb颜色空间先获取车辆的颜色特征,再转换到hsv颜色空间进行颜色特征量化,然后选择合适的颜色名对颜色特征进行量化降维处理,建立颜色名量化表,对目标车辆进行颜色名量化,从而达到颜色特征快速匹配。

12.进一步地,所述局部特征的surf算法特征匹配为:c1:构建黑塞矩阵:通过黑塞矩阵中行列式的局部最大值判断被检测目标车辆特征点的尺度和位置,如果行列式的值大于零,则该像素为极值点,反之则为非极值点;c2:构建图像的尺度空间:在不同尺度寻找相同位置的特征点,利用surf算法,采用尺寸不同的方格滤波器处理被检测目标车辆的初始图片,获取图片尺度空间;c3:特征点的定位:将像素点的特征点与该像素点三维空间中周围的点进行对比,如果该像素点的值比周围的值都要大,则该像素点被定义为特征点。

13.进一步地,步骤s4中,根据同一十字路口的各个车道建立车辆行驶轨迹的数据库,在当十字路口某方向上摄像头的监控视野内出现车辆部分遮挡或完全遮挡导致车辆跟踪丢失情况时,存在跟踪丢失的摄像头根据建立的数据库对被遮挡车辆的行驶路线进行轨迹预测,然后通过其他摄像头对被遮挡车辆通过空间位置的确定和特征匹配进行定位和跟踪,并将被遮挡车辆的位置信息补偿到跟踪丢失摄像头的监控图像中,结合预测的行驶轨迹,当该车辆再次出现在跟踪丢失摄像头的监控视野时,仍能准确的定位到该车辆的位置,从而完成车辆的持续跟踪。

14.本发明具有如下有益效果:本发明主要应用于十字路口,克服单摄像头下识别与跟踪技术的不足,对多摄像头下车辆的识别与定位方法进行讨论与改进。

15.本发明相比单摄像头监控系统,可以从多个角度对目标场景进行监控,通过对拍摄车辆的空间特征信息与颜色特征信息进行识别匹配,实现同一目标车辆的确认,从而完成同一车辆在复杂场景下的识别定位与持续跟踪。多摄像头可以大大改善单摄像头的监控问题,为解决复杂场景下目标车辆的识别与定位提供了可能性,解决了单摄像头监控观测范围小、目标跟踪不稳定、复杂情况下的遮挡等问题。

附图说明

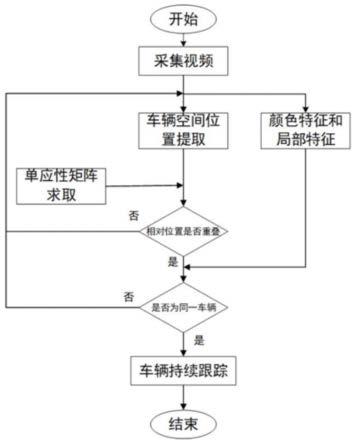

16.图1为本发明流程图。

17.图2为多摄像头目标监控协同策略图。

具体实施方式

18.下面结合附图对本发明作进一步的说明。

19.如图1所示,本发明一种基于多摄像头的十字路口车辆实时跟踪方法,包括s1:采集位于十字路口四个方向上摄像头视角的监控视频;s2:分别对每个摄像头进行目标车辆特征提取,求取每个摄像头下目标车辆的位置,分别求取所有摄像头之间的单应性矩阵,从而确定所有摄像头监控区域下目标车辆的相对位置关系;s3:十字路口四个方向上所有摄像头的监控区域下形成目标车辆的空间位置约束,对不同摄像头下的同一目标车辆进行位置关联,进行目标车辆的特征提取;s4:当某一摄像头发生目标车辆跟踪丢失时,将其他摄像头的信息补偿到该摄像头的监控图像中,完成目标车辆的持续跟踪。

20.步骤s2中,根据十字路口四个方向上摄像头的监控视野,选取每个路口的人行横道作为固定标志物,这样,就可以根据人行横道将整个十字路口框定成一个矩形区域,在矩形区域的视野内分别求取十字路口四个方向上摄像头之间的单应性矩阵,从而确定十字路口四个方向上摄像头监控区域下车辆的相对位置关系。

21.单应性矩阵能够很好地表达多个摄像头之间的相互关系,通过将不同视角的拍摄画面进行像素坐标转换,能够快速实现同一目标在不同视角下的像素位置转换,从而实现车辆在多摄像头不同视角下的定位。

22.本发明还可以通过十字路口四个方向上摄像头同时对同一棋盘格进行拍摄,求取十字路口四个方向上摄像头之间的单应性矩阵。或者还可以通过实际测量十字路口的摄像头之间的距离位置,通过测量各个摄像头之间的距离以及离地高度和标志物的位置等等,求取单应性矩阵。这样的话,即使在某一摄像头视野内出现车辆遮挡情况时,通过车辆和其他摄像头以及标志物之间的空间关系,仍然可以准确的定位到车辆的位置。

23.步骤s3中,目标车辆的特征提取包括全局特征的颜色特征提取和局部特征的surf算法特征匹配;针对目标车辆的全局特征提取和局部特征匹配,在目标车辆未被遮挡时,通过全局特征的颜色特征提取选取整个目标车辆的像素区域进行颜色特征提取匹配;当目标车辆出现遮挡现象时,通过目标车辆的位置,比较目标车辆以及遮挡车辆距离目标车辆前进方向处摄像头的距离,靠近所述前进方向处摄像头的遮挡车辆同时进行全局特征提取和局部特征匹配,远离所述前进方向处摄像头的目标车辆选取目标车辆在监控视频中的外界矩形框并减去与遮挡车辆重叠的区域,然后再进行全局特征提取和局部特征匹配,完成目标车辆是否发生遮挡的判断。

24.局特征的颜色特征提取为:通过rgb颜色空间先获取车辆的颜色特征,再转换到hsv颜色空间进行颜色特征量化,然后选择合适的颜色名对颜色特征进行量化降维处理,建立颜色名量化表,对目标车辆进行颜色名量化,从而达到颜色特征快速匹配。

25.当确定目标车辆发生遮挡时,首先从目标车辆以及遮挡车辆的空间位置进行判断,当十字路口的某一摄像头监控视频中目标车辆的外界矩形框与遮挡车辆的外界矩形框发生重叠时,则可能发生遮挡现象,此时同时对比同一目标车辆原本的颜色特征和sift特征,求取目标车辆颜色特征的欧氏距离,当该目标车辆的欧氏距离大于设定的阈值时,判定目标车辆发生遮挡,然后通过十字路口其他方向的摄像头对目标车辆进行跟踪补偿,标记出目标车辆在被遮挡摄像头中的相对位置,完成目标的识别与定位。

26.局部特征的surf算法特征匹配为:c1:构建黑塞矩阵:通过黑塞矩阵中行列式的局部最大值判断被检测目标车辆特征点的尺度和位置,如果行列式的值大于零,则该像素为极值点,反之则为非极值点;c2:构建图像的尺度空间:在不同尺度寻找相同位置的特征点,利用surf算法,采用尺寸不同的方格滤波器处理被检测目标车辆的初始图片,获取图片尺度空间;c3:特征点的定位:将像素点的特征点与该像素点三维空间中周围的点进行对比,如果该像素点的值比周围的值都要大,则该像素点被定义为特征点。

27.结合图2,对步骤s4进行进一步说明,将同一十字路口各个车道的车辆行驶轨迹通过深度学习的方式建立数据库,这样当摄像头1监控视野内发生车辆1跟踪丢失,即出现车辆部分遮挡或完全遮挡情况时,被遮挡摄像头1根据数据库对被遮挡车辆1的行驶路线进行轨迹预测,然后通过另外的摄像头2对被遮挡车辆通过空间位置的确定和特征匹配进行定位和跟踪,并将被遮挡车辆1的位置信息补偿到该摄像头的监控图像中,结合预测的位置,将信息进行综合,当车辆1再次出现在摄像头1的监控视野时,仍然能准确的定位到车辆1的位置,从而完成车辆1的持续跟踪。

28.以上所述仅是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下还可以作出若干改进,这些改进也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1