一种立体视频重定位方法与流程

[0001]

本发明涉及一种图像信号的处理方法,尤其是涉及一种立体视频重定位方法。

背景技术:

[0002]

随着立体显示技术的快速发展,各种具有不同立体显示功能的立体显示终端也广泛出现了,但是,由于立体显示终端的种类繁多,宽/高比规格不一,因此若将宽/高比一定的立体视频放在不同的立体显示终端上显示,则必须先对立体视频的尺寸进行调整,以达到立体显示的效果。传统的视频缩放方法是通过裁剪或者是按固定比例进行缩放,然而这样做可能会出现视频中的内容减少或者导致显著物体形变。

[0003]

对于立体视频,如果直接对左视点视频和右视点视频分别采用相同的视频重定位方法,即单独处理立体视频中的左视点视频和右视点视频,则会造成错误的深度信息;同时,当立体视频有较快的深度运动时,传统的深度保持会使得重定位后的立体视频仍然有不舒适的深度运动,进而会造成视觉不舒适,影响观看体验。因此,如何对立体视频进行缩放以优化深度运动、减少图像形变、避免时域抖动、突出显著内容,从而降低视觉不舒适,都是在对立体视频进行重定位过程中需要研究解决的问题。

技术实现要素:

[0004]

本发明所要解决的技术问题是提供一种立体视频重定位方法,其符合显著语义特征,且能够较好地保持时域一致性,能够有效地调整立体视频的尺寸大小。

[0005]

本发明解决上述技术问题所采用的技术方案为:一种立体视频重定位方法,其特征在于包括以下步骤:

[0006]

步骤一:将待处理的原始立体视频序列中当前待处理的第t帧左视点视频图像和第t帧右视点视频图像对应定义为当前左视点视频图像和当前右视点视频图像;其中,t为正整数,t的初始值为1,1≤t≤frame-1,待处理的原始立体视频序列中包含的左视点视频图像的总帧数为frame帧,待处理的原始立体视频序列中包含的右视点视频图像的总帧数也为frame帧,frame为正整数,frame>1,待处理的原始立体视频序列中包含的左视点视频图像和右视点视频图像的宽度为w且高度为h,w和h均能被8整除;

[0007]

步骤二:将当前左视点视频图像和当前右视点视频图像对应记为和然后采用基于光流的视差估计方法,计算与的左视差图像,记为其中,1≤x≤w,1≤y≤h,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值;

[0008]

步骤三:将分割成个互不重叠的尺寸大小为8

×

8的四边形网格,将中的第k个四边形网格记为并将中的所有四边形网格构成的集合记为合记为其中,k为正整数,k的初始值为1,1≤k≤m,m表示中包含的四边形网格的总个数,中包含的四边形网格的总个数,通过其左上、左下、右上和右下4个网格顶点的集合来描述,4个网格顶点的集合来描述,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到;

[0009]

步骤四:采用基于图论的视觉显著模型提取出的显著图,记为然后根据和获取的三维显著图,记为其中,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值;

[0010]

步骤五:采用基于光流的估计方法,计算与的运动矢量,记为其中,表示中坐标位置为(x,y)的像素点对应的运动矢量,中坐标位置为(x,y)的像素点对应的运动矢量,用于表示水平方向,用于表示垂直方向,表示的水平偏移量,表示的垂直偏移量,表示待处理的原始立体视频序列中的第t+1帧左视点视频图像,表示中坐标位置为(x,y)的像素点的像素值;

[0011]

步骤六:根据和获取中的所有互不重叠的尺寸大小为8

×

8的四边形网格,将中的第k个四边形网格记为并将中的所有四边形网格构成的集合记为四边形网格构成的集合记为其中,通过其左上、左下、右上和右下4个网格顶点的集合来描述,右上和右下4个网格顶点的集合来描述,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,描述,描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量;

[0012]

步骤七:计算中的所有四边形网格对应的目标四边形网格的形状保持

能量,记为计算中的所有四边形网格对应的目标四边形网格的时域一致能量,记为计算中的所有四边形网格对应的目标四边形网格的视差重映射能量,记为

[0013]

步骤八:根据和计算中的所有四边形网格对应的目标四边形网格的总能量,记为e

total

,然后通过最小二乘优化求解得到中的所有四边形网格对应的最佳目标四边形网格构成的集合,记为的集合,记为接着根据计算中的每个四边形网格对应的最佳目标四边形网格的最佳相似变换矩阵,将对应的最佳目标四边形网格的最佳相似变换矩阵记为的最佳相似变换矩阵记为其中,为的加权参数,为的加权参数,为的加权参数,min()为取最小值函数,表示中的所有四边形网格对应的目标四边形网格构成的集合,表示对应的最佳目标四边形网格,通过其左上、左下、右上和右下4个网格顶点的集合来描述,合来描述,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平

坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值;

[0014]

步骤九:根据中的每个四边形网格对应的最佳目标四边形网格的最佳相似变换矩阵,计算中的每个四边形网格中的每个像素点经最佳相似变换矩形变换后的水平坐标位置和垂直坐标位置及深度值,将中任意水平坐标位置为和垂直坐标位置为的像素点经最佳相似变换矩阵变换后的水平坐标位置和垂直坐标位置及深度值对应记为和及及然后根据中的每个四边形网格中的每个像素点经最佳相似变换矩形变换后的水平坐标位置和垂直坐标位置及深度值,获取经重定位后的重定位左视点视频图像,记为接着获取经重定位后的左视差图像,记为将中坐标位置为(x',y')的像素点的像素值记为记为其中,其中,重定位左视点视频图像的宽度为w',重定位左视点视频图像的高度为h,重定位左视点视频图像的宽度为w',重定位左视点视频图像的高度为h,表示中水平坐标位置为和垂直坐标位置为的像素点的深度值,1≤x'≤w',1≤y'≤h,表示中坐标位置为(x',y')的像素点的像素值,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,表示显示器的水平宽度,表示显示器的水平分辨率;

[0015]

步骤十:根据和获取经重定位后的重定位右视点视频图像,记为将中坐标位置为(x',y')的像素点的像素值记为中坐标位置为(x',y')的像素点的像素值记为其中,表示中坐标位置为的像素点的像素值;

[0016]

步骤十一:令t=t+1;然后将待处理的原始立体视频序列中当前待处理的第t帧左视点视频图像和第t帧右视点视频图像对应作为当前左视点视频图像和当前右视点视频图像;再返回步骤二继续执行,直至获得待处理的原始立体视频序列中的前frame-1帧左视点视频图像对应的重定位左视点视频图像和前frame-1帧右视点视频图像对应的重定位右视

点视频图像,进而得到包含frame-1帧重定位左视点视频图像和frame-1帧重定位右视点视频图像的重定位立体视频序列;其中,t=t+1中的“=”为赋值符号。

[0017]

所述的步骤三中,所述的步骤三中,其中,表示的视差值,表示的视差值,表示的视差值,表示的视差值,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,表示显示器的水平宽度,表示显示器的水平分辨率。

[0018]

所述的步骤四中,其中,λ1表示的权重,λ2表示的权重,λ1+λ2=1。

[0019]

所述的步骤七中,的获取过程为:

[0020]

a1、根据中的所有四边形网格对应的目标四边形网格,对中的每个四边形网格进行相似变换,使得原四边形网格与原四边形网格经过相似变换后得到的目标四边形网格的变换误差最小,得到中的每个四边形网格对应的目标四边形网格的相似变换矩阵,将对应的目标四边形网格的相似变换矩阵记为的相似变换矩阵记为其中,其中,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,表示的第i

个网格顶点,i=1,2,3,4,个网格顶点,i=1,2,3,4,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,为的转置,为的逆;

[0021]

a2、计算a2、计算其中,表示中的所有像素点的三维显著值的均值,也即表示中与对应的区域中的所有像素点的像素值的均值,符号“|| ||”为求欧氏距离符号。

[0022]

所述的步骤七中,的获取过程为:;其中,对应表示的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,对应表示的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,对应表示的水平坐标位置、垂直坐标位置、深度值,对应表示对应的目标四边形网格的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,的第1个网格顶点为的左上网格顶点,的第2个网格顶点为的左下网格顶点,的第3个网格顶点为的右上网格顶点,的第4个网格顶点为的右下网格顶点,符号“| |”为取绝对值符号。

[0023]

所述的步骤七中,的获取过程为:

其中,exp()表示以自然基数为底的指数函数,符号“| |”为取绝对值符号,z

max

表示的最大深度值,z

min

表示的最小深度值,cvz

min

表示最小舒适观看区域范围,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,η1表示最小舒适观看视角,cvz

max

表示最大舒适观看区域范围,η2表示最大舒适观看视角。

[0024]

与现有技术相比,本发明的优点在于:

[0025]

本发明方法通过提取立体视频序列每个时刻的左视点视频图像中的所有四边形网格对应的目标四边形网格的形状保持能量、时域一致能量和视差重映射能量,并通过优化获取最佳相似变换矩阵得到重定位后的左视点视频图像和左视差图像,并通过视差绘制得到重定位后的右视点视频图像,这样使得获得的重定位立体视频能够较好地保留重要的显著语义信息、较好地保持时域一致性,能够有效地调整立体视频尺寸大小且保持视觉舒适性。

附图说明

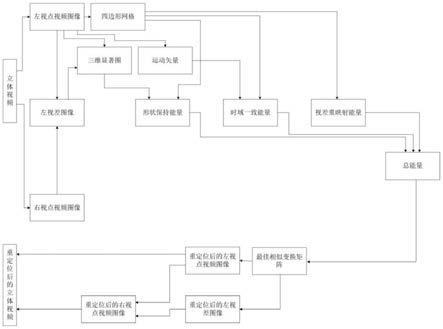

[0026]

图1为本发明方法的总体实现框图;

[0027]

图2a为“bunny”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图;

[0028]

图2b为“bunny”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0029]

图2c为“bunny”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图;

[0030]

图2d为“bunny”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0031]

图2e为“bunny”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图;

[0032]

图2f为“bunny”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0033]

图2g为“bunny”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图;

[0034]

图2h为“bunny”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0035]

图3a为“bunny_jp”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图;

[0036]

图3b为“bunny_jp”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0037]

图3c为“bunny_jp”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图;

[0038]

图3d为“bunny_jp”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0039]

图3e为“bunny_jp”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图;

[0040]

图3f为“bunny_jp”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0041]

图3g为“bunny_jp”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图;

[0042]

图3h为“bunny_jp”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0043]

图4a为“people”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图;

[0044]

图4b为“people”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0045]

图4c为“people”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图;

[0046]

图4d为“people”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0047]

图4e为“people”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图;

[0048]

图4f为“people”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0049]

图4g为“people”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图;

[0050]

图4h为“people”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0051]

图5a为“ship”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图;

[0052]

图5b为“ship”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0053]

图5c为“ship”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图;

[0054]

图5d为“ship”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0055]

图5e为“ship”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图;

[0056]

图5f为“ship”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;

[0057]

图5g为“ship”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图;

[0058]

图5h为“ship”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图。

具体实施方式

[0059]

以下结合附图实施例对本发明作进一步详细描述。

[0060]

本发明提出的一种立体视频重定位方法,其总体实现框图如图1所示,其包括以下步骤:

[0061]

步骤一:将待处理的原始立体视频序列中当前待处理的第t帧左视点视频图像和第t帧右视点视频图像对应定义为当前左视点视频图像和当前右视点视频图像;其中,t为正整数,t的初始值为1,1≤t≤frame-1,待处理的原始立体视频序列中包含的左视点视频图像的总帧数为frame帧,待处理的原始立体视频序列中包含的右视点视频图像的总帧数也为frame帧,frame为正整数,frame>1,frame的值根据实际视频而定,待处理的原始立体

视频序列中包含的左视点视频图像和右视点视频图像的宽度为w且高度为h,w和h均能被8整除,当前左视点视频图像和当前右视点视频图像构成当前立体视频图像。

[0062]

步骤二:将当前左视点视频图像和当前右视点视频图像对应记为和然后采用现有的基于光流的视差估计方法,计算与的左视差图像,记为其中,1≤x≤w,1≤y≤h,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值。

[0063]

步骤三:将分割成个互不重叠的尺寸大小为8

×

8的四边形网格,将中的第k个四边形网格记为并将中的所有四边形网格构成的集合记为合记为其中,k为正整数,k的初始值为1,1≤k≤m,m表示中包含的四边形网格的总个数,中包含的四边形网格的总个数,通过其左上、左下、右上和右下4个网格顶点的集合来描述,个网格顶点的集合来描述,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到,根据中与对应的像素点的像素值计算得到。

[0064]

在此具体实施例中,步骤三中,

其中,表示的视差值,也即为中坐标位置为的像素点的像素值,表示的视差值,也即为中坐标位置为的像素点的像素值,表示的视差值,也即为中坐标位置为的像素点的像素值,表示的视差值,也即为中坐标位置为的像素点的像素值,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,表示显示器的水平宽度,表示显示器的水平分辨率,在本实施例中的e、d、和的值根据具体的立体视频序列和观看条件确定。

[0065]

步骤四:采用现有的基于图论的视觉显著(graph-based visual saliency,gbvs)模型提取出的显著图,记为然后根据和获取的三维显著图,记为其中,表示中坐标位置为(x,y)的像素点的像素值,表示中坐标位置为(x,y)的像素点的像素值。

[0066]

在此具体实施例中,步骤四中,其中,λ1表示的权重,λ2表示的权重,λ1+λ2=1,在本实施例中取λ1=λ2=0.5。

[0067]

步骤五:采用现有的基于光流的估计方法,计算与的运动矢量,记为其中,表示中坐标位置为(x,y)的像素点对应的运动矢量,矢量,用于表示水平方向,用于表示垂直方向,表示的水平偏移量,表示的垂直偏移量,表示待处理的原始立体视频序列中的第t+1帧左视点视频图像,表示中坐标位置为(x,y)的像素点的像素值。

[0068]

步骤六:根据和获取中的所有互不重叠的尺寸大小为8

×

8的四边形网格,将中的第k个四边形网格记为并将中的所有四边形网格构成的集合记为四边形网格构成的集合记为其中,通过其左上、左下、右上和右下4个网格顶点的集合来描述,右上和右下4个网格顶点的集合来描述,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网

格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,描述,描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量,以的水平坐标位置和垂直坐标位置及深度值的集合来描述,的集合来描述,的集合来描述,表示中坐标位置为的像素点对应的运动矢量的水平偏移量,表示中坐标位置为的像素点对应的运动矢量的垂直偏移量。

[0069]

步骤七:为了通过重定位降低由于较快的深度运动导致的视觉不舒适现象,本发明获取以下几个能量,计算中的所有四边形网格对应的目标四边形网格的形状保持能量,记为计算中的所有四边形网格对应的目标四边形网格的时域一致能量,记为计算中的所有四边形网格对应的目标四边形网格的视差重映射能量,记为

[0070]

在此具体实施例中,步骤七中,的获取过程为:

[0071]

a1、根据中的所有四边形网格对应的目标四边形网格,对中的每个四边形网格进行相似变换,使得原四边形网格与原四边形网格经过相似变换后得到的目标四边形网格的变换误差最小,得到{i

tl

(x,y)}中的每个四边形网格对应的目标四边形网格的相似变换矩阵,将对应的目标四边形网格的相似变换矩阵记为的相似变换矩阵记为其中,其中,对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,表示的第i个网格顶点,i=1,2,3,4,格顶点,i=1,2,3,4,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,为的转置,为的逆。

[0072]

a2、计算a2、计算其中,表示中的所有像素点的三维显著值的均值,也即表示中与对应的区域中的所有像素点的像素值的均值,符号“|| ||”为求欧氏距离符号。

[0073]

在此具体实施例中,步骤七中,的获取过程为:;其中,

对应表示的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,对应表示的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,对应表示的水平坐标位置、垂直坐标位置、深度值,对应表示对应的目标四边形网格的第i个网格顶点的水平坐标位置、垂直坐标位置、深度值,的第1个网格顶点为的左上网格顶点,的第2个网格顶点为的左下网格顶点,的第3个网格顶点为的右上网格顶点,的第4个网格顶点为的右下网格顶点,符号“| |”为取绝对值符号。

[0074]

在此具体实施例中,步骤七中,的获取过程为:的获取过程为:其中,exp()表示以自然基数为底的指数函数,自然基数的值为2.71828183

…

,符号“| |”为取绝对值符号,z

max

表示的最大深度值,z

min

表示的最小深度值,cvz

min

表示最小舒适观看区域范围,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,η1表示最小舒适观看视角,在本实施例中取η1=-1

°

,cvz

max

表示最大舒适观看区域范围,η2表示最大舒适观看视角,在本实施例中取η2=1

°

。

[0075]

步骤八:根据和计算中的所有四边形网格对应的目标四边形网格的总能量,记为e

total

,然后通过最小二乘优化求解得到中的所有四边形网格对应的最佳目标四边形网格构成的集合,记为成的集合,记为接着根据计算中的每个四边形网格对应的最佳目标四边形网格的最佳相似变换矩阵,将对应的最佳目标四边形网格的最佳相似变换矩阵记为的最佳相似变换矩阵记为其中,为的加权参数,为的加权参数,为的加权参数,在本实施例中取min()为取最小值函数,表示中的所有四边形网格对应的目标四边形网格构成的集合,表示对应的最佳目标四边形网格,通过其左上、左下、右上和右下4个网格顶点的集合来描述,

对应表示的作为第1个网格顶点的左上网格顶点、作为第2个网格顶点的左下网格顶点、作为第3个网格顶点的右上网格顶点、作为第4个网格顶点的右下网格顶点,点的右上网格顶点、作为第4个网格顶点的右下网格顶点,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值,和对应表示的水平坐标位置、垂直坐标位置和深度值。

[0076]

步骤九:根据中的每个四边形网格对应的最佳目标四边形网格的最佳相似变换矩阵,计算中的每个四边形网格中的每个像素点经最佳相似变换矩形变换后的水平坐标位置和垂直坐标位置及深度值,将中任意水平坐标位置为和垂直坐标位置为的像素点经最佳相似变换矩阵变换后的水平坐标位置和垂直坐标位置及深度值对应记为和及及然后根据中的每个四边形网格中的每个像素点经最佳相似变换矩形变换后的水平坐标位置和垂直坐标位置及深度值,获取经重定位后的重定位左视点视频图像,记为接着获取经重定位后的左视差图像,记为将中坐标位置为(x',y')的像素点的像素值记为素值记为其中,

重定位左视点视频图像的宽度为w',重定位左视点视频图像的高度为h,点视频图像的高度为h,表示中水平坐标位置为和垂直坐标位置为的像素点的深度值,1≤x'≤w',1≤y'≤h,表示中坐标位置为(x',y')的像素点的像素值,e表示待处理的原始立体视频序列的左视点与右视点之间的水平基线距离,d表示待处理的原始立体视频序列的左视点和右视点与显示器之间的观看距离,表示显示器的水平宽度,表示显示器的水平分辨率,在本实施例中的e、d、和的值根据具体的立体视频序列和观看条件确定。

[0077]

步骤十:根据和获取经重定位后的重定位右视点视频图像,记为将中坐标位置为(x',y')的像素点的像素值记为中坐标位置为(x',y')的像素点的像素值记为其中,表示中坐标位置为的像素点的像素值。

[0078]

步骤十一:令t=t+1;然后将待处理的原始立体视频序列中当前待处理的第t帧左视点视频图像和第t帧右视点视频图像对应作为当前左视点视频图像和当前右视点视频图像;再返回步骤二继续执行,直至获得待处理的原始立体视频序列中的前frame-1帧左视点视频图像对应的重定位左视点视频图像和前frame-1帧右视点视频图像对应的重定位右视点视频图像,进而得到包含frame-1帧重定位左视点视频图像和frame-1帧重定位右视点视频图像的重定位立体视频序列;其中,t=t+1中的“=”为赋值符号,重定位左视点视频图像与对应的重定位右视点视频图像构成重定位立体视频图像。

[0079]

以下就利用本发明方法对mpeg3d立体视频测试库提供的数据库中的bunny、bunny_jp、people和ship四组立体视频序列进行重定位实验。

[0080]

图2a给出了“bunny”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图,图2b给出了“bunny”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图2c给出了“bunny”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图,图2d给出了“bunny”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图2e给出了“bunny”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图,图2f给出了“bunny”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图2g给出了“bunny”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图,图2h给出了“bunny”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;图3a给出了“bunny_jp”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图,图3b给出了“bunny_jp”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图3c给出了“bunny_jp”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图,图3d给出了“bunny_jp”立体视频序列的第2时刻的重定位到原

始立体视频图像的宽度60%后的“红/绿”图,图3e给出了“bunny_jp”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图,图3f给出了“bunny_jp”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图3g给出了“bunny_jp”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图,图3h给出了“bunny_jp”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;图4a给出了“people”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图,图4b给出了“people”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图4c给出了“people”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图,图4d给出了“people”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图4e给出了“people”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图,图4f给出了“people”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图4g给出了“people”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图,图4h给出了“people”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图;图5a给出了“ship”立体视频序列的第1时刻的原始立体视频图像的“红/绿”图,图5b给出了“ship”立体视频序列的第1时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图5c给出了“ship”立体视频序列的第2时刻的原始立体视频图像的“红/绿”图,图5d给出了“ship”立体视频序列的第2时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图5e给出了“ship”立体视频序列的第3时刻的原始立体视频图像的“红/绿”图,图5f给出了“ship”立体视频序列的第3时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图,图5g给出了“ship”立体视频序列的第4时刻的原始立体视频图像的“红/绿”图,图5h给出了“ship”立体视频序列的第4时刻的重定位到原始立体视频图像的宽度60%后的“红/绿”图。从图2a至图5h中可以看出,采用本发明方法得到的重定位立体视频图像能够较好地保留重要的显著语义信息,同时又能保证时域一致性。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1