基于小波分解和改进型LSTM的算力网络流量预测方法与流程

本发明实施例涉及通信,尤其涉及一种基于小波分解和改进型lstm的算力网络流量预测方法。

背景技术:

1、随着数字经济的蓬勃发展,算力网已成为支撑云计算、大数据、人工智能等新一代信息技术创新应用的核心基础设施。组成算力网的各算力中心之间需要通过算力网络进行高速互联,实现数据的快速传输与处理,为各类应用提供强大的计算支撑。然而,随着业务规模的扩大和数据处理需求的增长,算力中心面临的网络吞吐压力日益增大,网络流量的复杂性和不确定性对算力网络整体性能带来了显著影响。算力网络流量预测作为算力网一体化运营管理的重要环节,对于提升算力网络的资源利用率、保障业务连续性和优化用户体验具有重要意义。通过准确预测算力网络流量,算力网平台中心可以合理进行算力资源调度和投放,避免数据传输拥塞和算力资源闲置,同时也有助于提前发现潜在的安全性风险和异常流量模式,保障算力网络安全和数据安全。

2、现有技术存在的问题:

3、1.算力网络的流量特性具有高度的复杂性和不确定性,受到多种因素的影响,如用户行为、应用特性、设备性能、网络拓扑等,这使得准确预测算力网络流量变得非常困难,且没有专门用于算力网络的流量预测方法。

4、2.组合模型往往忽略了分解后组件之间的相关性,这将影响预测结果的准确性。

5、3.算力中心的网络流量是动态变化的,并且需要实时预测以支持业务决策。这要求预测模型具有高度的动态适应性和实时响应能力。

6、可见,亟需一种预测实时性、精准度和适应性强的基于小波分解和改进型lstm的算力网络流量预测方法。

技术实现思路

1、有鉴于此,本发明实施例提供一种基于小波分解和改进型lstm的算力网络流量预测方法,至少部分解决现有技术中存在预测实时性、精准度和适应性较差的问题。

2、本发明实施例提供了一种基于小波分解和改进型lstm的算力网络流量预测方法,包括:

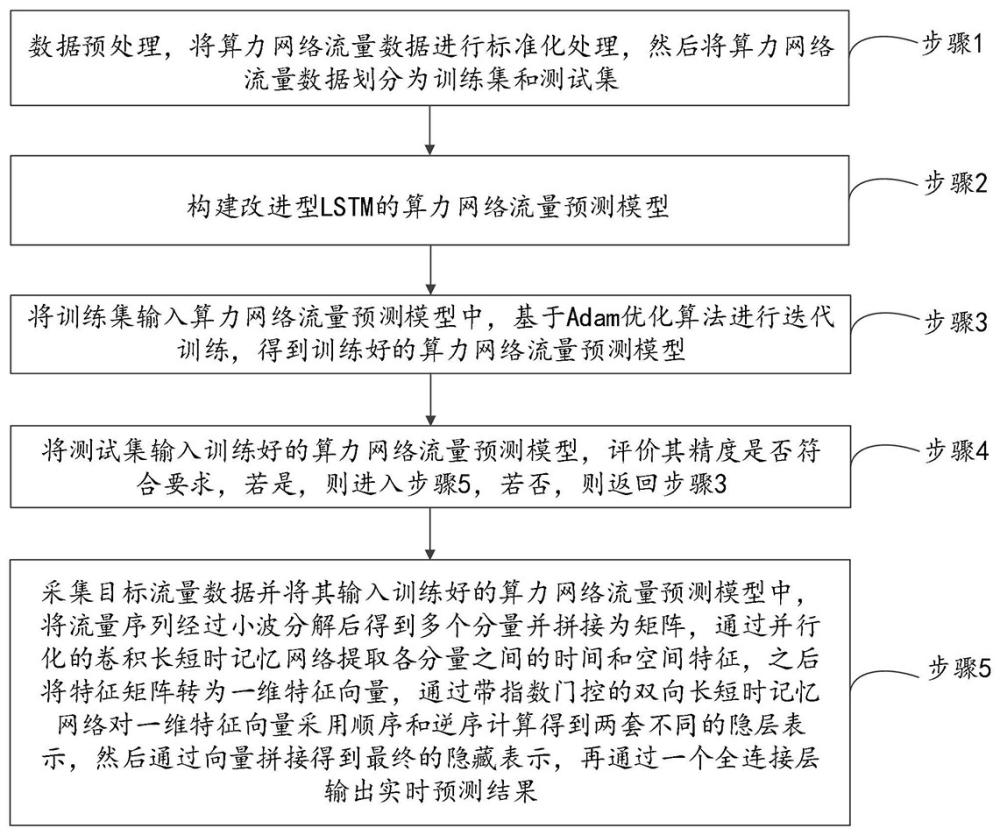

3、步骤1,数据预处理,将算力网络流量数据进行标准化处理,然后将算力网络流量数据划分为训练集和测试集;

4、步骤2,构建改进型lstm的算力网络流量预测模型,其中,所述算力网络流量预测模型包括小波分解算法、卷积长短时记忆网络和双向长短时记忆网络;

5、步骤3,将训练集输入算力网络流量预测模型中,基于adam优化算法进行迭代训练,得到训练好的算力网络流量预测模型;

6、步骤4,将测试集输入训练好的算力网络流量预测模型,评价其精度是否符合要求,若是,则进入步骤5,若否,则返回步骤3;

7、步骤5,采集目标流量数据并将其输入训练好的算力网络流量预测模型中,将流量序列经过小波分解后得到多个分量并拼接为矩阵,通过并行化的卷积长短时记忆网络提取各分量之间的时间和空间特征,之后将特征矩阵转为一维特征向量,通过带指数门控的双向长短时记忆网络对一维特征向量采用顺序和逆序计算得到两套不同的隐层表示,然后通过向量拼接得到最终的隐藏表示,再通过一个全连接层输出实时预测结果。

8、根据本发明实施例的一种具体实现方式,所述步骤1具体包括:

9、步骤1.1,读取算力网络流量数据集到本地,其中,所述算力网络流量数据集包括目标算力中心各个历史时刻的网络流量数值;

10、步骤1.2,获取算力网络流量数据集的流量最大值和流量最小值;

11、步骤1.3,对算力网络流量数据集进行标准化,即;

12、其中,x为原始算力网络流量数据,为算力网络历史流量数据的最小值,为算力网络历史流量数据的最大值,为标准化后的结果;

13、步骤1.4,设定每条样本的大小t以及对应标签大小p,即根据t个历史时刻的流量数据预测未来p个时刻的流量数据,按照设定的t和p将算力网络流量数据集制成多个样本和对应的标签;

14、步骤1.5,将样本和对应的标签划分成训练集和测试集。

15、根据本发明实施例的一种具体实现方式,所述卷积长短时记忆网络的表达式为

16、

17、其中,当前时刻记为t,t-1为上一个时刻,为当前时刻的输入,代表卷积,代表哈达玛积,为sigmoid激活函数,tanh和softmax也为一种激活函数,为新设计的一种补偿门,为补偿门中对的三个卷积核,为补偿门的三个偏置项,先将两个卷积结果相乘并激活,再与第三个卷积结果相乘并激活即可得到补偿门的结果,代表隐状态,代表输入门,代表遗忘门,代表输出门,为细胞状态,为细胞状态的一个备选状态,分别为输入门、遗忘门、细胞状态和输出门对的卷积核,分别为输入门、遗忘门、细胞状态和输出门对的卷积核,分别为输入门、遗忘门、细胞状态和输出门的偏置项;

18、将各个隐藏状态通过自适应加权求和的方式对最后的输出门进行补偿,得到最终的输出,自适应加权的过程表达式为:

19、

20、

21、

22、

23、其中,为卷积操作,为t时刻的隐藏状态,为一个卷积核,为偏置项,为缩放因子,都为可学习的参数,整个过程为隐藏状态分配一个系数,通过加权相加的方式把信息相加得到,再将更新到输出门。

24、根据本发明实施例的一种具体实现方式,所述双向长短时记忆网络的表达式为

25、;

26、其中,为前一时刻隐藏状态,为当前时刻输入,exp为以e为底数的指数函数,为sigmoid函数,为遗忘门的偏置向量,代表输入门,为一个备选向量,为更新门的偏置向量,为记忆单元偏置向量,为当前单元状态,为输出门,为输出门偏置向量,为当前隐藏状态,为平稳状态,和为平稳化后的结果。

27、根据本发明实施例的一种具体实现方式,所述步骤3具体包括:

28、步骤3.1,设置批大小,将训练集划分成多个批次;

29、步骤3.2,将每个批次的数据输入算力网络流量预测模型中,计算损失函数;

30、步骤3.3,基于adam算法进行迭代优化,直到设定的迭代次数;

31、步骤3.4,迭代结束,将训练好的算力网络流量预测模型对应的模型参数保存。

32、根据本发明实施例的一种具体实现方式,所述步骤4具体包括:

33、步骤4.1,将测试集输入训练好的算力网络流量预测模型,得到p个时刻的预测结果;

34、步骤4.2,以均方根误差和绝对百分比均值误差两个指标评价模型精度,若其精度符合要求,则进入步骤5,若否,则返回步骤3。

35、根据本发明实施例的一种具体实现方式,所述均方根误差的表达式为

36、

37、所述绝对百分比均值误差的表达式为

38、

39、其中,为模型的预测值,为训练集中的真实值。

40、根据本发明实施例的一种具体实现方式,所述模型参数包括隐藏层的层数、隐藏层的神经元个数、卷积核的大小、学习率、最大迭代次数和预测未来时刻的数量。

41、根据本发明实施例的一种具体实现方式,所述步骤5具体包括:

42、步骤5.1,选择一个小波基函数对目标流量数据进行多层分解,得到多个分解后的分量,将分量组合成矩阵,长度不足的分量用0填充;

43、步骤5.2,将分量矩阵输入并行化的卷积长短时记忆网络,提取分量间的特征,并将特征矩阵转化为一维特征向量;

44、步骤5.3,将特征向量输入带指数门控的双向长短时记忆网络提取时间特征;

45、步骤5.4,最后通过一个全连接层输出预测结果;

46、步骤5.5,将预测结果加入样本并重复步骤5.4,直到未来p个时刻的数据全被计算出来。

47、本发明实施例中的基于小波分解和改进型lstm的算力网络流量预测方案,包括:步骤1,数据预处理,将算力网络流量数据进行标准化处理,然后将算力网络流量数据划分为训练集和测试集;步骤2,构建改进型lstm的算力网络流量预测模型,其中,所述算力网络流量预测模型包括小波分解算法、卷积长短时记忆网络和双向长短时记忆网络;步骤3,将训练集输入算力网络流量预测模型中,基于adam优化算法进行迭代训练,得到训练好的算力网络流量预测模型;步骤4,将测试集输入训练好的算力网络流量预测模型,评价其精度是否符合要求,若是,则进入步骤5,若否,则返回步骤3;步骤5,采集目标流量数据并将其输入训练好的算力网络流量预测模型中,将流量序列经过小波分解后得到多个分量并拼接为矩阵,通过并行化的卷积长短时记忆网络提取各分量之间的时间和空间特征,之后将特征矩阵转为一维特征向量,通过带指数门控的双向长短时记忆网络对一维特征向量采用顺序和逆序计算得到两套不同的隐层表示,然后通过向量拼接得到最终的隐藏表示,再通过一个全连接层输出实时预测结果。

48、本发明实施例的有益效果为:通过本发明的方案,先对算力网络流量序列进行分解,并用并行化卷积长短时记忆网络convlstm模块提取分解后的各个分量之间的特征,再通过带指数门控的双向长短时记忆网络bilstm模块提取时序特征,最后通过全连接层输出,模型轻量且对样本适应能力强,能对特定区域内的算力网络流量变化进行高精度的预测。

- 还没有人留言评论。精彩留言会获得点赞!