一种人体目标的跟踪方法及装置、机器人与流程

1.本发明涉及目标跟踪领域,尤指一种人体目标的跟踪方法及装置、机器人。

背景技术:

2.目前,机器人跟踪人体目标常借助于机器人身上的深度相机来探测人体骨骼,在识别出人体目标后,深度相机能够提供人体骨骼各个重要关节节点的点云数据(即三维位置信息),根据某个关节的三维位置信息可以计算出该关节与深度相机的间距和偏向角度。然后机器人下发指令给运动控制模块,进行行进和或旋转的动作,从而控制机器人的行走。但深度相机在面对具有光滑表面的物体,如光滑镜面的大门,铝合金制光滑材质的门框等,由于光的反射作用常出现错误识别出骨骼的情况,从而导致机器人撞上门框等跟踪异常。

技术实现要素:

3.本发明的目的是提供一种人体目标的跟踪方法及装置、机器人,用于解决深度相机在面对光滑表面的物体易出现识别错误,从而导致机器人跟踪异常的问题。

4.本发明提供的技术方案如下:

5.一种人体目标的跟踪方法,包括:获取人体目标在当前时间的深度图像和普通图像;对所述深度图像进行处理,得到对应的深度图像跟踪信息;

6.对所述普通图像进行处理,得到对应的普通图像跟踪信息;

7.根据所述深度图像跟踪信息和普通图像跟踪信息综合确定本次跟踪信息,根据有效的本次跟踪信息更新人体目标跟踪信息;

8.根据所述人体目标跟踪信息对所述人体目标进行跟踪;

9.其中,所述的根据所述深度图像跟踪信息和普通图像跟踪信息综合确定本次跟踪信息包括:

10.若所述深度图像跟踪信息检测到人体,但所述普通图像跟踪信息未检测到人体,则认为所述深度相机检测到的人体是虚假的,本次跟踪未检测到人体,本次跟踪信息无效。

11.在一些实施例中,所述深度图像跟踪信息包括所述人体目标相对所述机器人的第一距离和第一角度信息;所述普通图像跟踪信息包括所有检测到的人体相对所述机器人的第二角度信息;

12.所述的根据所述深度图像跟踪信息和普通图像跟踪信息综合确定本次跟踪信息还包括:

13.若所述深度图像跟踪信息和所述普通图像跟踪信息都检测到人体,则比较所述第一角度信息与所有的所述第二角度信息;

14.若存在一个第二角度信息与所述第一角度信息的偏差在预设偏差范围内,则认为本次跟踪所述深度相机检测到的人体是存在的,本次跟踪信息有效,并根据所述深度图像跟踪信息得到本次跟踪信息。

15.在一些实施例中,对所述深度图像进行处理,得到对应的深度图像跟踪信息,包

括:若所述深度图像存在多个人体,且已确定需要跟踪的人体目标,则从已存储的所述人体目标跟踪信息中获取所述人体目标的最新位置信息,从所述深度图像中选择距离所述人体目标的最新位置信息在预设位置范围内的人体作为分析对象,根据所述分析对象的分析结果得到对应的深度图像跟踪信息。

16.在一些实施例中,所述的从所述深度图像中选择距离所述人体目标的最新位置信息在预设位置范围内的人体作为分析对象,包括:

17.从所述人体目标跟踪信息中获取所述人体目标的跟踪节点的三维位置信息,将其作为参考位置信息;

18.获取所述深度图像中每个人体的跟踪节点的三维位置信息;

19.遍历所述深度图像中每个人体的跟踪节点的三维位置信息,将其与所述参考位置信息按预设规则进行比较,选择距离所述参考位置信息在预设位置范围内的人体作为分析对象。

20.在一些实施例中,所述预设规则为:

21.若所述人体的跟踪节点相对所述参考位置信息在垂向的变化在预设位置范围内,且所述人体的跟踪节点相对所述参考位置信息在前后方向的变化在预设位置范围内,则将所述人体作为分析对象。

22.在一些实施例中,对所述深度图像进行处理,得到对应的深度图像跟踪信息,还包括:

23.若所述深度图像存在多个人体,但尚未确定需要跟踪的人体目标,则从所述深度图像中选择执行预定手势的人体或选择距离所述机器人最近的人体作为人体目标,并根据所述人体目标的分析结果得到对应的深度图像跟踪信息。

24.在一些实施例中,对所述普通图像进行处理,得到对应的普通图像跟踪信息,包括:若所述普通图像存在多个人体,则获取每个人体相对所述机器人的第二角度信息,并根据所有第二角度信息得到对应的普通图像跟踪信息。

25.在一些实施例中,所述人体目标跟踪信息包括所述人体目标相对所述机器人的第一距离和第一角度信息;

26.根据所述人体目标跟踪信息对所述人体目标进行跟踪包括:

27.比较本次的人体目标跟踪信息的第一角度信息与上一次的人体目标跟踪信息的第一角度信息;

28.若两个第一角度信息之差超过偏向阈值,则机器人进行旋转操作;

29.比较本次的人体目标跟踪信息的第一距离与上一次的人体目标跟踪信息的第一距离;

30.若两个第一距离之差不超过距离阈值,则不进行新的行进处理,保持原有的行进处理。

31.本发明还提供一种人体目标的跟踪装置,包括:

32.图像获取模块,用于获取人体目标在当前时间的深度图像和普通图像;

33.深度图像处理模块,用于对所述深度图像进行处理,得到对应的深度图像跟踪信息;

34.普通图像处理模块,用于对所述普通图像进行处理,得到对应的普通图像跟踪信

息;

35.综合确定模块,用于根据所述深度图像跟踪信息和所述普通图像跟踪信息综合确定本次跟踪信息,根据有效的本次跟踪信息更新人体目标跟踪信息;

36.运动处理模块,用于根据所述人体目标跟踪信息对所述人体目标进行跟踪;

37.所述综合确定模块,还用于若所述深度图像跟踪信息检测到人体,但所述普通图像跟踪信息未检测到人体,则认为所述深度相机检测到的人体是虚假的,本次跟踪未检测到人体,本次跟踪信息无效。

38.本发明还提供一种机器人,包括用于获取深度图像的深度相机、用于获取普通图像的普通相机和跟踪装置;所述跟踪装置用于执行前述的人体目标的跟踪方法。

39.与现有技术相比,本发明所提供的一种人体目标的跟踪方法及装置、机器人,至少能够带来以下有益效果:

40.1、本发明通过在机器人上增设普通相机,利用普通相机识别人体并估算人体与机器人的偏向角度,辅助深度相机的跟踪结果,提高了人体识别的精度,有效改善了深度相机因为红外反射造成的人体识别错误,从而导致“撞门”等怪异现象。

41.2、本发明根据人体目标在短时间的位置变化的有限性,通过判断数据的连续性,减少了跟踪特定人体过程中跟错的情况出现。

42.3、本发明优化了运动处理,对前后两次的人体目标跟踪信息进行比较,若人体目标的位置变化较小,则不进行新的旋转或行进操作,避免了运动中出现卡顿或进入死锁状态。

附图说明

43.下面将以明确易懂的方式,结合附图说明优选实施方式,对一种人体目标的跟踪方法及装置、机器人的上述特性、技术特征、优点及其实现方式予以进一步说明。

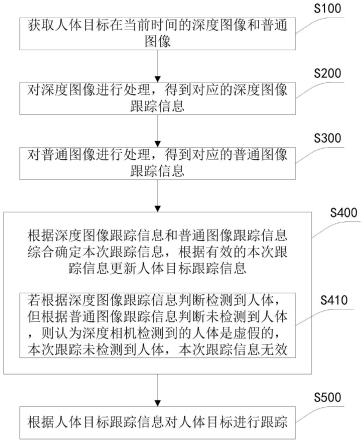

44.图1是本发明的人体目标的跟踪方法的一个实施例的流程图;

45.图2是本发明的人体目标的跟踪装置的一个实施例的结构示意图;

46.图3是本发明的机器人的一个实施例的结构示意图;

47.图4是人体骨骼关节节点的示意图。

具体实施方式

48.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对照附图说明本发明的具体实施方式。显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图,并获得其他的实施方式。

49.为使图面简洁,各图中只示意性地表示出了与本发明相关的部分,它们并不代表其作为产品的实际结构。另外,以使图面简洁便于理解,在有些图中具有相同结构或功能的部件,仅示意性地绘示了其中的一个,或仅标出了其中的一个。在本文中,“一个”不仅表示“仅此一个”,也可以表示“多于一个”的情形。

50.在本发明的一个实施例中,如图1所示,一种人体目标的跟踪方法,包括:

51.步骤s100获取人体目标在当前时间的深度图像和普通图像;

52.步骤s200对深度图像进行处理,得到对应的深度图像跟踪信息;

53.步骤s300对普通图像进行处理,得到对应的普通图像跟踪信息;

54.步骤s400根据深度图像跟踪信息和普通图像跟踪信息综合确定本次跟踪信息,根据有效的本次跟踪信息更新人体目标跟踪信息;

55.其中,步骤s400包括:

56.步骤s410若根据深度图像跟踪信息判断检测到人体,但根据普通图像跟踪信息判断未检测到人体,则认为深度相机检测到的人体是虚假的,本次跟踪未检测到人体,本次跟踪信息无效;

57.步骤s500根据人体目标跟踪信息对人体目标进行跟踪。

58.本实施例提供的跟踪方法应用于机器人上,该机器人设有一深度相机和一普通相机。

59.如背景所述,深度相机和普通相机各有优缺点,深度相机可以获得物体的3维信息,探测人体骨骼,但对于光滑表面的物体会错误识别出骨骼;普通相机,如rgb相机,虽然只能获得物体的2维平面信息,但对于光滑表面的物体,如光滑镜面的大门,不会误识别出骨骼。

60.本实施例,利用以上特点,在机器人上安装至少两个相机,一个深度相机和一个普通相机,利用两个相机同时对人体目标所在的同一场景进行拍摄,分别对获得的深度图像和普通图像进行分析,再对得到的深度图像跟踪信息和普通图像跟踪信息进行综合判断,这样可有效识别出深度相机误检测出人体的情况。若本次跟踪中深度相机存在误检测,但普通相机未检测到人体,则本次跟踪信息无效,不必根据无效的信息更新人体目标跟踪信息,这样可避免错误数据引起的跟踪异常。

61.优选深度相机和普通相机安装在一起,这样可以保证两个相机的视野基本一致。

62.在一个实施例中,步骤s200包括:

63.步骤s210若深度图像存在多个人体,但尚未确定需要跟踪的人体目标,则从深度图像中选择执行预定手势的人体或选择距离机器人最近的人体作为人体目标,并根据人体目标的分析结果得到对应的深度图像跟踪信息。

64.具体地,如果本次为初次跟踪,则尚未确定跟踪目标。如果深度图像存在多个人体,可以选择离机器人最近的人体作为跟踪目标,具体可以为:

65.如图4所示,人体存在多个骨骼关节节点,选择其中一个节点作为所有人体的跟踪节点,比如选择人体中心节点(spine_mid,两胸中间的节点),对该节点的跟踪就相当于对人体的跟踪。

66.借助深度相机厂商提供的sdk(software development kit,软件开发工具包),可以获取到每一帧画面中存在的骨骼列表,以及每个骨骼对应的重要关节(即节点)的位置数据,即节点在机器人本体坐标系的横向x坐标值、垂向y坐标值、前向z坐标值。机器人本体坐标系是原点设在机器人身上的一直角坐标系,比如原点为机器人的中心节点,x坐标值反映了节点在机器人的左边或右边,z坐标值反映了节点与机器人的距离信息。

67.获取深度图像中每个人体的跟踪节点的三维位置信息(即(x,y,z)坐标值),根据该三维位置信息的z坐标值得到对应人体与机器人的距离,从中选择最小的距离值所对应的人体作为跟踪目标。

68.也可以利用现有技术从深度图像中检测出执行预定手势的人体,将执行预定手势的人体作为跟踪目标。

69.在一个实施例中,步骤s200包括:步骤s220若深度图像存在多个人体,且已确定需要跟踪的人体目标,则从人体目标跟踪信息中获取人体目标的最新位置信息,从深度图像中选择距离人体目标的最新位置信息在预设位置范围内的人体作为分析对象,根据分析对象的分析结果得到对应的深度图像跟踪信息。

70.若已经确定了跟踪目标,但本次深度图像中存在多个人体,则需要从多个人体中选出跟踪目标,否则会出现跟错的现象。

71.为此,从人体目标跟踪信息中获取跟踪到的人体目标的最新位置信息,从深度图像中选择距离人体目标的最新位置信息在预设位置范围内的人体作为分析对象。具体可包括:

72.从人体目标跟踪信息中获取人体目标的跟踪节点的三维位置信息,将其作为参考位置信息;

73.获取深度图像中每个人体的跟踪节点的三维位置信息;

74.遍历深度图像中每个人体的跟踪节点的三维位置信息,将其与参考位置信息按预设规则进行比较,选择距离参考位置信息在预设位置范围内的人体作为分析对象。

75.基于相邻2帧数据,跟踪目标的垂向变化和跟踪目标相对机器人的前后方向变化不会波动太大,即同一人体的跟踪节点的y、z坐标值不会太大波动,故可将预设规则设为:

76.若跟踪节点相对参考位置信息在垂向的变化,即y坐标的变化,在预设位置范围内,且跟踪节点相对参考位置信息在前后方向的变化,即z坐标的变化,也在预设位置范围内,则该人体为分析对象。若存在多个人体符合上述条件,可选择与参考位置信息距离最近的人体作为分析对象。

77.也可以根据深度图像中每个人体的跟踪节点的三维位置信息与参考位置信息计算每个人体与上次人体目标的距离,若该距离在预设位置范围内,则对应的人体作为分析对象,即该人体与上次人体目标是同一人。

78.故深度图像跟踪信息只记录人体目标(即跟踪对象)的分析结果。

79.在跟踪某个特定人体时,本实施例通过判断数据的连续性,减少了跟踪过程中出现跟踪目标跟错了或跟丢了的情况。

80.在一个实施例中,深度图像跟踪信息包括人体目标相对机器人的第一距离和第一角度信息。通过以下方式获取第一距离和第一角度信息:

81.获取深度图像中人体目标的跟踪节点的三维位置信息;

82.根据该跟踪节点的x坐标值和z坐标值,得到人体目标相对机器人的第一角度信息;根据跟踪节点的z坐标值得到人体目标相对机器人的第一距离。

83.具体地,假设人体目标相对机器人的偏向角定义为:机器人本体坐标系中过跟踪节点g做xoz平面(x轴与z轴构成的平面)的垂线,得到垂足g,原点o到垂足g的直线离z轴的夹角。将该跟踪节点的x坐标值除以z坐标值,得到该偏向角的正切值;根据该正切值得到偏向角,将该偏向角记为第一角度信息。偏向角也可以采用其他定义,比如为原点到垂足g的直线离x轴的夹角,则计算方法做对应的改变即可。

84.角度信息包括方位和角度数值,比如,6表示在机器人左边,夹角为6度的位置;-6

表示在机器人右边,夹角为6度的位置。

85.有时候深度相机检测到的人体骨骼不一定准确,需要先判断预设关节是否存在,若存在,则检测到人体,再去获取人体目标的跟踪节点的三维位置信息。预设关节包括但不限于颈关节neck、脊柱中部spine_mid、左膝关节knee_left、右膝关节knee_right。

86.在一个实施例中,步骤s300包括:

87.步骤s310将普通图像输入人体检测模型进行处理,获取普通图像中每个人体相对机器人的第二角度信息,并根据所有第二角度信息得到对应的普通图像跟踪信息。

88.人体检测模型采用深度学习算法经过训练得到,比如采用yolov3目标检测等深度学习算法,能较快检测到人体,并可以在每帧中框出人体在帧画面中的位置。

89.针对每个人体,通过确定人体中心在图像中的坐标位置(即横向x坐标值和垂向y坐标值),根据该位置的横向坐标估算出该人体相对机器人的第二角度信息。第二角度信息包括方位和角度值。为了便于第二角度信息与第一角度信息比较,第二角度信息对应的偏向角的定义应与第一角度信息对应的偏向角的定义相同。

90.比如,人体相对机器人的偏向角定义为原点到跟踪节点的直线离z轴的夹角,设width为屏幕的横向分辨率,height为屏幕的纵向分辨率;angle为经验角度值,x为人体中心点的横向坐标。

91.计算相机的焦距focusdistance=(width/2.0)/tan(toradians(angle));

92.计算旋转参数rotateparam=focusdistance/width;

93.计算distance=x/width-0.5;

94.判断人体相对机器人的方位orientation=distance《0?-1:1;-1:表示人体目标在机器人左边;1:表示人体目标在机器人右边;

95.计算人体相对机器人的偏向角的弧度值grad=atan(abs(distance/rotateparam));计算对应的角度值degree=todegrees(grad);

96.其中,degree为第二角度信息的角度值,orientation为第二角度信息的方位;toradians()为将角度转换为弧度的函数,todegrees()为将弧度转换为角度的函数,abs()为求绝对值函数,atan()为反正切函数,tan()为正切函数。

97.当普通图像存在多个人体时,普通图像跟踪信息包括所有检测到的人体相对机器人的第二角度信息。

98.人体检测模型有时处理费时,所以针对同一时间拍摄的普通图像和深度图像,普通图像的处理结果的输出有时会比深度图像的慢很多,可以对普通图像跟踪信息加上一个时间戳,以表明该跟踪信息是针对哪个时间的普通图像的分析结果。这样在根据深度图像跟踪信息和普通图像跟踪信息进行综合判断时,先查阅获取的普通图像跟踪信息的时间戳,只有时间戳在允许范围内的普通图像跟踪信息才具备参考价值,否则丢弃。

99.在一个实施例中,步骤s400还包括:

100.深度图像跟踪信息包括人体目标相对机器人的第一角度信息;普通图像跟踪信息包括所有检测到的人体相对机器人的第二角度信息;

101.步骤s420若根据深度图像跟踪信息和普通图像跟踪信息都判断检测到人体,则比较第一角度信息与所有的第二角度信息;

102.步骤s430若存在一个第二角度信息与第一角度信息的偏差在预设偏差范围内,则

认为本次跟踪深度相机检测到的人体是存在的,本次跟踪信息有效,并将深度图像跟踪信息作为本次跟踪信息;否则,认为本次跟踪信息无效。

103.具体地,深度图像跟踪信息只包含一个人体,即人体目标的第一角度信息,而普通图像跟踪信息是包含普通图像上出现的所有人体的第二角度信息。若第一角度信息与其中一个第二角度信息的偏差在预设误差范围内,则说明深度相机检测到的人体是存在的,本次跟踪有效。若本次跟踪有效,则将本次的深度图像跟踪信息作为本次跟踪信息,并根据本次跟踪信息更新人体目标跟踪信息。

104.通过综合深度图像跟踪信息和普通图像跟踪信息,可以提高跟踪信息的准确度。

105.在一个实施例中,步骤s500包括:

106.人体目标跟踪信息包括人体目标相对机器人的第一距离和第一角度信息;

107.步骤s510比较本次的人体目标跟踪信息的第一角度信息与上一次的人体目标跟踪信息的第一角度信息;

108.步骤s520若两个第一角度信息之差超过偏向阈值,则机器人进行旋转操作;

109.步骤s530比较本次的人体目标跟踪信息的第一距离与上一次的人体目标跟踪信息的第一距离;

110.步骤s540若两个第一距离之差不超过距离阈值,则不进行新的行进处理,保持原有的行进处理;否则进行新的行进处理。

111.具体地,机器人在根据人体目标跟踪信息进行行进处理时,需要停止上次运动,再执行新的运动,若前后两次运动的间距太近,导致机器人的底盘操作频繁则会出现运动卡顿;若对于太小的偏向角度也执行旋转,会引起机器人进入一直在旋转的死锁状态。

112.人体目标跟踪信息的第一距离反映了人体目标相对机器人的距离,第一角度信息反映了人体目标相对机器人的偏向角度。

113.鉴于上述问题,若本次的人体目标跟踪信息与上一次的数据比较,距离变化小于距离阈值,则不进行新的行进处理,以避免重复操作底盘,引起机器人出现运动卡顿。

114.对不超过偏向阈值的角度数据,不进行旋转操作,以避免机器人一直在旋转的死锁状态。对超过偏向阈值的角度数据,才进行旋转操作。

115.本实施例,通过在机器人上增设普通相机,利用普通相机识别人体并估算人体与机器人的偏向角度,辅助深度相机的跟踪结果,提高了人体识别的精度,有效改善了深度相机因为红外反射造成的人体识别错误;设计了一套识别特定人体的判断方法,根据人体目标在短时间的位置变化的有限性,通过判断数据的连续性,在跟踪特定人体过程中减少了跟错的情况;优化了运动处理,对前后两次的人体目标跟踪信息进行比较,若人体目标的位置变化较小,则不进行新的旋转或行进操作,避免了机器人运动中出现卡顿或进入死锁状态。

116.基于同一发明构思,本发明实施例还提供一种跟踪装置,该跟踪装置可以位于机器人上,用于执行前述任一实施例的人体目标的跟踪方法。

117.在本发明的一个实施例中,如图2所示,一种人体目标的跟踪装置,包括:

118.图像获取模块100,用于获取人体目标在当前时间的深度图像和普通图像;

119.深度图像处理模块200,用于对深度图像进行处理,得到对应的深度图像跟踪信息;

120.普通图像处理模块300,用于对普通图像进行处理,得到对应的普通图像跟踪信息;

121.综合确定模块400,用于根据深度图像跟踪信息和普通图像跟踪信息综合确定本次跟踪信息,根据有效的本次跟踪信息更新人体目标跟踪信息;

122.运动处理模块500,用于根据人体目标跟踪信息对人体目标进行跟踪;

123.综合确定模块400,还用于若根据深度图像跟踪信息判断检测到人体,但根据普通图像跟踪信息判断未检测到人体,则认为深度相机检测到的人体是虚假的,本次跟踪未检测到人体,本次跟踪信息无效。

124.在一个实施例中,深度图像处理模块200,还用于若深度图像存在多个人体,但尚未确定需要跟踪的人体目标,则从深度图像中选择执行预定手势的人体或选择距离机器人最近的人体作为人体目标,并根据人体目标的分析结果得到对应的深度图像跟踪信息。

125.在一个实施例中,深度图像处理模块200,还用于若深度图像存在多个人体,且已确定需要跟踪的人体目标,则从人体目标跟踪信息中获取人体目标的最新位置信息,从深度图像中选择距离人体目标的最新位置信息在预设位置范围内的人体作为分析对象,根据分析对象的分析结果得到对应的深度图像跟踪信息。

126.在一个实施例中,深度图像处理模块200还用于从人体目标跟踪信息中获取人体目标的跟踪节点的三维位置信息,将其作为参考位置信息;获取深度图像中每个人体的跟踪节点的三维位置信息;遍历深度图像中每个人体的跟踪节点的三维位置信息,将其与参考位置信息按预设规则进行比较,选择距离参考位置信息在预设位置范围内的人体作为分析对象。

127.在一个实施例中,普通图像处理模块,还用于将普通图像输入人体检测模型进行处理,人体检测模型采用深度学习算法经过训练得到;若普通图像存在多个人体,则获取每个人体相对机器人的第二角度信息,并根据所有第二角度信息得到对应的普通图像跟踪信息。

128.在一个实施例中,深度图像跟踪信息包括人体目标相对机器人的第一距离和第一角度信息;普通图像跟踪信息包括所有检测到的人体相对机器人的第二角度信息;综合确定模块,还用于若根据深度图像跟踪信息和普通图像跟踪信息都判断检测到人体,则比较第一角度信息与所有的第二角度信息;若存在一个第二角度信息与第一角度信息的偏差在预设偏差范围内,则认为本次跟踪深度相机检测到的人体是存在的,本次跟踪信息有效,并将深度图像跟踪信息作为本次跟踪信息;否则,认为本次跟踪信息无效。

129.在一个实施例中,人体目标跟踪信息包括人体目标相对机器人的第一距离和第一角度信息;

130.运动处理模块,还用于比较本次的人体目标跟踪信息的第一角度信息与上一次的人体目标跟踪信息的第一角度信息;若两个第一角度信息之差超过偏向阈值,则机器人进行旋转操作;比较本次的人体目标跟踪信息的第一距离与上一次的人体目标跟踪信息的第一距离;若两个第一距离之差未超过距离阈值,则不进行新的行进处理,保持原有的行进处理;否则进行新的行进处理。

131.由于人体目标的跟踪装置的实施例与前述提供的人体目标的跟踪方法的实施例均基于同一发明构思,能够取得相同的技术效果,因而,人体目标的跟踪装置的实施例的其

它具体内容可以参照前述人体目标的跟踪方法的实施例内容的记载。

132.在本发明的一个实施例中,如图3所示,一种机器人,包括:

133.深度相机10、一普通相机20和跟踪装置30;

134.跟踪装置30用于执行前述任一实施例所述的人体目标的跟踪方法。

135.应当说明的是,上述实施例均可根据需要自由组合。以上所述仅是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1