电子设备和控制方法与流程

1.本公开的各方面总体上涉及获取到物体的距离的电子设备、控制该电子设备的方法以及包括该电子设备的可移动体。

背景技术:

2.已知包括包含具有光电转换功能的像素被二维地布置的像素区域的传感器并可以获取每个像素区域中的图像信号和距离信息的成像装置。在日本专利申请公开no.2007-281296中讨论的固态图像传感器包括被布置为图像传感器的一部分或全部像素的具有测距功能的像素,并基于在成像平面上检测的相位差来检测到被摄体的距离(成像平面相位差系统)。基于两个图像信号之间的相关性来计算位置偏移,并且基于位置偏移来获取到被摄体的距离,该两个图像信号是基于由已穿过成像装置中包括的成像光学系统的不同光瞳区域的光束生成的图像。

3.使用诸如从每个图像信号中提取预定检查区域中包括的图像信号以评估图像信号之间的相关性的基于区域的匹配方法之类的方法来评估两个图像信号之间的相关性。

4.在图像信号包括被摄体对比度中的小变化的情况下,或者在图像信号中包括的噪声量大的情况下,有时由于被摄体或成像条件而出现图像信号之间的相关性的错误评估。在以预定频率或更高频率出现相关性的错误评估的情况下,计算出的两个图像信号之间的位置偏移量可能包括误差,并且待获取的被摄体距离的精度可能下降。

技术实现要素:

5.根据各种实施例,提供了可以高度精确地获取到物体的距离的装置和方法。

6.根据本发明的一方面,一种电子设备包括:设置单元,被配置为在从成像单元获取的图像中设置物体区域;获取单元,被配置为获取包括与物体区域中包括的像素对应的距离信息的距离图;以及处理单元,被配置为基于与物体区域中包括的像素对应的距离信息来确定指示到物体区域中包括的物体的距离的物体距离信息。

7.根据本发明的另一方面,一种方法包括:在从成像单元获取的图像中设置物体区域;获取包括与物体区域中包括的像素对应的距离信息的距离图;以及基于与物体区域中包括的像素对应的距离信息来确定指示到物体区域中包括的物体的距离的物体距离信息。

8.本公开的其它方面将从以下示例实施例的描述中变得清楚。

附图说明

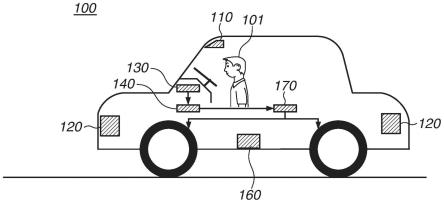

9.图1是图示了车辆的配置的示意图。

10.图2是图示了车辆的配置的配置图。

11.图3是图示了路线生成装置的配置的框图。

12.图4a和图4b是图示了图像传感器的配置的示意图。

13.图5a至图5d是图示了成像平面相位差系统中的被摄体距离与入射光之间的关系

的示意图。

14.图6a和图6b是图示了要由图像处理单元执行的处理的流程图。

15.图7a和图7b是图示了要由距离信息生成单元执行的处理的流程图。

16.图8a至图8e是各自图示了要由距离信息生成单元执行的处理中的图像和信息的示意图。

17.图9是图示了要由路线生成单元执行的路线生成处理的流程图。

18.图10是图示了要由距离信息生成单元执行的物体距离信息生成处理的流程图。

19.图11是图示了关于与第n个物体具有相同标识号的物体的物体距离信息的时间变化的示意图。

20.图12是图示了要由距离信息生成单元执行的物体距离信息生成处理的流程图。

21.图13a至图13d是图示了加权平均的示意图。

22.图14是图示了用于获取测量距离值(物体距离信息)的处理的流程图。

23.图15是图示了在按时间顺序输入多个连续输入数据的情况下要执行的处理的流程图。

24.图16a和图16b是图示了绝对误差的校正处理的示意图。

25.图17是图示了测距系统的配置示例的框图。

26.图18是图示了要由物体检测单元执行的分隔线检测任务和物体识别任务的输出结果的示意图。

27.图19是图示了相机安装位置与道路表面之间的位置关系的示图。

28.图20是图示了在道路上检测具有已知物体尺寸的两个交通标志的场景的示意图。

29.图21是图示了缩放测距单元的配置示例的框图。

30.图22a至图22d是图示了要由车道分析单元执行的车道宽度检测处理和车道中心检测处理的示意图。

31.图23是将指示有和没有侧倾角(roll angle)的捕获图像中的车道宽度的位置进行比较的示意图。

32.图24是图示了要由侧倾角估计单元执行的侧倾角估计处理的流程图。

33.图25a至图25c是图示了在侧倾角估计处理中执行的每个处理的示意图。

34.图26是图示了要由接地位置估计单元对车道宽度数据执行的坐标估计处理的流程图。

35.图27是图示了由接地位置估计单元设置的测距目标的接地位置的坐标的示意图。

36.图28是图示了要由物体距离计算单元执行的到测距目标的距离的估计处理的流程图。

37.图29是图示了每个车道宽度数据的示意图。

具体实施方式

38.以下,将参考附图描述本公开的示例实施例、特征和方面。然而,本发明的实施例不限于以下的示例实施例。

39.将参考附图来详细描述第一示例性实施例。

40.将使用包括成像装置的路线生成装置(电子设备)作为路线生成装置的示例给出

以下描述,但路线生成装置不限于此。

41.在将参考附图给出的描述中,不同附图中图示的相同组件原则上被指定相同的附图标记,并且将尽可能多地避免冗余描述。

42.图1是图示了车辆100的配置的示意图。车辆100是包括成像装置110、雷达装置120、路线生成电子控制单元(ecu)130、车辆控制ecu 140和测量设备单元160的可移动体。车辆100包括驱动单元170以及存储器180和190。将参考图2描述驱动单元170以及存储器180和190。成像装置110和路线生成ecu 130构成路线生成装置150。驾驶员101可以乘坐车辆100。当车辆100正在行进时,驾驶员101面向车辆100的前侧(行进方向)乘坐车辆100。驾驶员101可以通过操作诸如方向盘、加速踏板和刹车踏板之类的车辆100的操作构件来控制车辆100的操作。

43.成像装置110以捕获车辆100的前侧(通常行进方向)的图像这样的方式布置。如图1中图示的,成像装置110被布置在车辆100的挡风玻璃上端附近,以捕获朝向车辆100前侧的预定角度范围(下文中,成像视场角)内的区域的图像。成像装置110可以以捕获车辆100的后侧(与通常行进方向相反的反向方向)的图像这样的方式布置,或者可以以捕获车辆100的侧面的图像这样的方式布置。多个成像装置110可以安装在车辆100中。

44.图2是图示了车辆100的配置的配置图。

45.成像装置110捕获包括车辆100行进的道路(行驶道路)的车辆100周围的环境(周围环境)的图像。成像装置110检测成像装置110的成像视场角的范围中包括的物体。成像装置110获取关于检测的物体的信息(外部信息)以及关于到检测的物体的距离的信息(物体距离信息),并将所获取的信息输出到路线生成ecu 130。物体距离信息可以是使用预定参考表或预定转换系数和转换式可以从车辆100的预定位置被转换为到物体的距离的任何信息。例如,距离可以被分配给预定整数值,并且预定整数值可以被顺次地输出到路线生成ecu 130。

46.成像装置100包括包含具有光电转换功能的像素被二维地布置的像素区域的传感器,并可以使用成像平面相位差系统获取到物体的距离。以下将描述使用成像平面相位差系统获取关于到物体的距离的距离信息。

47.雷达装置120是通过发射作为发射波的电磁波并接收电磁波的反射波来检测物体的检测装置。雷达装置120基于从发射电磁波时到接收到反射波时的时间以及反射波的接收强度,获取指示在电磁波的发射方向上的到物体的距离的距离信息。雷达装置120将距离信息输出到路线生成ecu 130。雷达装置120是使用从毫米波段到亚毫米波段的波长中的电磁波的毫米波雷达装置。

48.在第一示例性实施例中,多个雷达装置120安装在车辆100上。例如,雷达装置120附接到车辆100的左前侧和右前侧以及左后侧和右后侧。每个雷达装置120用电磁波扫描预定的角度范围,基于从发射电磁波时到接收到反射波时的时间以及反射波的接收强度来测量距雷达装置120的距离,并生成扫描位置处的距离信息。除了距雷达装置120的距离之外,距离信息可以包括关于反射波的接收强度和物体的相对速度的信息。

49.测量设备单元160包括行进速度测量设备161、转向角测量设备162和角速度测量设备163,并获取关于诸如行进速度、转向角和角速度之类的车辆的状态的车辆信息。行进速度测量设备161是检测车辆100的行进速度的测量设备。转向角测量设备162是检测车辆

100的转向角的测量设备。角速度测量设备163是检测车辆100在转向方向上的角速度的测量设备。每个测量设备将与所测量的参数对应的测量信号作为车辆信息输出到路线生成ecu 130。

50.路线生成ecu 130包括逻辑电路,并基于测量信号、外部信息、物体距离信息和距离信息来生成车辆100的行进轨迹和关于该行进轨迹的路线信息。路线生成ecu 130将行进轨迹和路线信息输出到车辆控制ecu140。要由路线生成ecu 130处理的数据以及要由路线生成ecu 130执行的程序被存储在存储器180中。

51.行进轨迹是指示车辆100经过的轨迹(路线)的信息。路线信息是车辆100基于其经过由行进轨迹所指示的路线的信息。

52.车辆控制ecu 140包括逻辑电路,并基于从测量设备单元160获取的路线信息和车辆信息,以车辆100沿着由路线信息限定的路线行驶这样的方式控制驱动单元170。要由车辆控制ecu 140处理的数据以及要由车辆控制ecu 140执行的程序被存储在存储器190中。

53.驱动单元170是用于驱动车辆100的驱动构件,并例如包括诸如产生用于使轮胎旋转的能量的发动机或马达之类的动力单元以及控制车辆100的行进方向的转向单元。驱动单元170还包括用于使用由动力单元产生的能量使轮胎旋转的齿轮箱、控制齿轮箱中的组件的齿轮控制单元以及执行制动操作的制动单元。车辆控制ecu 140控制驱动单元170以车辆100沿着与路线信息对应的路线行驶这样的方式调整车辆100的驱动量、制动量和转向量。具体地,车辆控制ecu 140通过控制制动组件、转向组件和齿轮组件来操作车辆100。

54.路线生成ecu 130和车辆控制ecu 140可以共享共用中央处理单元(cpu)和存储算术处理程序的存储器。

55.人机界面(hmi)240向驾驶员101传送信息。hmi 240包括当驾驶员101位于驾驶位置时可供驾驶员101查看的显示器以及生成要在显示器上显示的信息的显示控制装置。hmi 240还包括输出语音的装置(扬声器系统)和生成语音数据的语音控制装置。显示控制装置基于由路线生成ecu 130生成的路线信息在显示器上显示导航信息。语音控制装置基于路线信息来生成用于向驾驶员101通知信息的语音数据,并从扬声器系统输出语音数据。例如,语音数据是用于通知车辆100正在接近车辆100要转向的十字路口的数据。

56.图3是图示了路线生成装置150的配置的框图。路线生成装置150包括成像装置110和路线生成ecu 130。

57.成像装置110包括成像光学系统301、图像传感器302、图像处理单元310和物体信息生成单元320。成像光学系统301、图像传感器302、图像处理单元310和物体信息生成单元320布置在成像装置110的外壳内部。

58.成像光学系统301是成像装置110的成像透镜,并具有在图像传感器302上形成被摄体的图像(光学图像)的功能。成像光学系统301包括多个透镜单元。成像光学系统301包括在远离图像传感器302预定距离的位置处的出射光瞳。

59.图像传感器302包括互补型金属氧化物半导体(cmos)图像传感器或电荷耦合器件(ccd)传感器,并且是具有基于成像平面相位差测距系统的测距功能的图像传感器。图像传感器302将基于由成像光学系统301形成的图像的图像信号顺次地输出到图像处理单元310。图像传感器302包括具有光电转换功能的像素被二维地布置的像素区域。每个像素区域包括两个光电转换单元(第一光电转换单元和第二光电转换单元)。图像传感器302经由

成像光学系统301对形成在图像传感器302上的被摄体图像进行光电转换,以生成与被摄体图像对应的图像信号。图像传感器302将图像信号输出到图像处理单元310。图像信号是包括每个像素区域中的每个光电转换单元的输出值的信号。图像传感器302将基于从第一光电转换单元输出的信号的第一图像信号和基于从第二光电转换单元输出的信号的第二图像信号输出到图像处理单元310。

60.基于图像信号,图像处理单元310生成包括关于每个像素的红色、绿色和蓝色的每个颜色的亮度信息的图像数据以及指示关于每个像素的距离信息的距离图像数据。图像处理单元310包括基于图像信号来生成图像数据的显影单元311以及基于图像信号来生成距离图像数据的距离图像生成单元312。以下将描述要由这些单元执行的处理。图像处理单元310将图像数据和距离图像数据输出到物体信息生成单元320。

61.物体信息生成单元320包括识别处理单元321,识别处理单元321检测所获取的图像中包括的物体,并基于图像数据来生成指示关于物体的信息的外部信息。外部信息是指示图像中检测的物体的位置、尺寸(诸如,宽度和高度)以及区域的信息。外部信息还包括关于检测的物体的属性和标识号的信息。

62.物体信息生成单元320包括距离信息生成单元322,距离信息生成单元322基于外部信息和距离图像数据来生成指示到所获取的图像中包括的物体的距离的物体距离信息。物体距离信息包括关于外部信息中包括的检测的物体的标识号的信息。

63.物体信息生成单元320将外部信息和物体距离信息输出到路线生成ecu 130。

64.图像处理单元310和物体信息生成单元320可以由成像装置110中包括的一个或多个处理器实现。图像处理单元310和物体信息生成单元320的功能可以由执行从存储器340读出的程序的一个或多个处理器来实现。

65.路线生成ecu 130包括路线生成单元330。路线生成单元330基于外部信息和物体距离信息以及从雷达装置120获取的距离信息来生成路线信息。

66.接下来,将详细描述路线生成装置150的每个块的结构和控制。

67.图4a和图4b是图示了图像传感器302的配置的示意图。图4a是从光入射方向观察到的图像传感器302的顶视图。图像传感器302包括排列成矩阵的多个像素组410,并且每个像素组410包括2行

×

2列的像素。像素组410包括检测绿光的绿色像素g1和g2、检测红光的红色像素r和检测蓝光的蓝色像素b。在像素组410中,绿色像素g1和g2对角地布置。每个像素包括第一光电转换单元411和第二光电转换单元412。

68.图4b是图4a中图示的截面i-i’中的像素组410的截面图。每个像素包括微透镜413、光引导层414和光接收层415。

69.光引导层414是包括用于将进入像素的光束高效地引导到光接收层415的微透镜413、在与由每个像素检测的光的颜色对应的波段中透射光的滤色器以及用于图像读取和像素驱动的布线的光引导构件。

70.光接收层415是将经由光引导层414进入像素的光光电转换为电信号并输出该电信号的光电转换单元。光接收层415包括第一光电转换单元411和第二光电转换单元412。

71.图5a至图5d是图示了成像平面相位差系统中的被摄体距离与入射光之间的关系的示意图。图5a是图示了成像光学系统301的出射光瞳501、图像传感器302的绿色像素g1以及进入绿色像素g1的每个光电转换单元的光的示意图。虽然图像传感器302包括多个像素,

但为了简便起见,将给出一个绿色像素g1的描述。

72.绿色像素g1的微透镜413以出射光瞳501和光接收层415处于光学共轭关系这样的方式布置。结果,已穿过第一光瞳区域510(包括在出射光瞳501中的部分光瞳区域)的光束进入第一光电转换单元411。类似地,已穿过第二光瞳区域520(包括在出射光瞳501中的另一部分光瞳区域)的光束进入第二光电转换单元412。

73.每个像素的第一光电转换单元411将接收到的光束光电转换为信号并输出该信号。根据从图像传感器302中包括的多个第一光电转换单元411输出的信号生成第一图像信号。第一图像信号指示主要由已穿过第一光瞳区域510的光束在图像传感器302上形成的图像的强度分布。

74.每个像素的第二光电转换单元412将接收到的光束光电转换为信号并输出该信号。根据从图像传感器302中包括的多个第二光电转换单元412输出的信号生成第二图像信号。第二图像信号指示主要由已穿过第二光瞳区域520的光束在图像传感器302上形成的图像的强度分布。

75.第一图像信号与第二图像信号之间的相对位置偏移量(下文中,视差量)对应于散焦量。将参考图5b、图5c和图5d描述视差量与散焦量之间的关系。

76.图5b、图5c和图5d是图示了图像传感器302和成像光学系统301的示意图。第一光束511穿过第一光瞳区域510,并且第二光束521穿过第二光瞳区域520。

77.图5b图示了第一光束511和第二光束521会聚在图像传感器302上的聚焦状态。此时,由第一光束511形成的第一图像信号与由第二光束521形成的第二图像信号之间的视差量为0。

78.图5c图示了焦点在像侧z轴的负方向上偏移时的散焦状态。此时,由第一光束511形成的第一图像信号与由第二光束521形成的第二图像信号之间的视差量不为0,而是具有负值。

79.图5d图示了焦点在像侧z轴的正方向上偏移的散焦状态。此时,由第一光束511形成的第一图像信号与由第二光束521形成的第二图像信号之间的视差量不为0,而是具有正值。

80.通过图5c与图5d之间的比较,可以看出,取决于散焦量是具有正值还是负值来切换产生视差的方向。从几何关系还可以看出,产生与散焦量对应的视差量。因此,如下所述,通过使用基于区域的匹配方法检测第一图像信号与第二图像信号之间的视差量,可以通过使用预定转换系数将视差量转换为散焦量。此外,通过使用成像光学系统301的图像形成公式可以将像侧的散焦量转换为到物体的距离。

81.可替代地,图像传感器302可以将第一图像信号与第二图像信号的合成信号以及第一图像信号输出到图像处理单元310。在这种情况下,图像处理单元310基于合成信号与第一图像信号之间的差异来生成第二图像信号,以获取第一图像信号和第二图像信号。

82.接下来,将描述要由图像处理单元310执行的处理。

83.图6a和图6b是图示了要由图像处理单元310执行的处理的流程图。图6a是图示了图像处理单元310的显影单元311从图像信号生成图像数据的显影处理的操作的流程图。在从图像传感器302接收到图像信号时执行显影处理。

84.在步骤s601中,显影单元311执行通过合成已经从图像传感器302输入的第一图像

信号和第二图像信号来生成合成图像信号的处理。通过合成第一图像信号和第二图像信号,可以获得基于由已穿过出射光瞳501的整个区域的光束形成的图像的图像信号。当图像传感器302的水平方向上的像素坐标由x表示,并且图像传感器302的垂直方向上的像素坐标由y表示时,像素(x,y)的合成图像信号im(x,y)可以由使用第一图像信号im1(x,y)和第二图像信号im2(x,y)的下式(式1)表示。

85.im(x,y)=im1(x,y)+im2(x,y)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式1)

86.在步骤s602中,显影单元311执行合成图像信号的缺陷像素的校正处理。缺陷像素是在图像传感器302中不能正常地输出信号的像素。显影单元311获取指示图像传感器302的缺陷像素的坐标的信息。显影单元311使用用于将缺陷像素的信号值替换为缺陷像素周围的像素的合成图像信号的中值的中值过滤器来生成缺陷像素的合成图像信号。作为校正合成图像信号的缺陷像素的方法,可以通过使用预先准备的关于缺陷像素的坐标信息并且基于缺陷像素周围的像素的信号值进行插值来生成缺陷像素的信号值。

87.在步骤s603中,显影单元311向合成图像信号应用校正由成像光学系统301生成的视场角周围的光量减少的光量校正处理。作为校正光量的方法,可以通过将合成图像信号乘以预先准备的增益来校正光量,该增益使视场角之间的相对光量比恒定。例如,显影单元311通过将每个像素的合成图像信号乘以具有从图像传感器302的中心像素向周边像素增加的特性的增益来执行光量校正。

88.在步骤s604中,显影单元311对合成图像信号执行降噪处理。作为降噪方法,可以采用使用高斯过滤器的降噪方法。

89.在步骤s605中,显影单元311对合成图像信号执行去马赛克处理,并针对每个像素生成包括关于红(r)、绿(g)和蓝(b)的每个颜色的亮度信息的图像数据。作为去马赛克方法,可以使用对每个颜色通道使用线性插值来生成关于每个像素的颜色信息的方法。

90.在步骤s606中,显影单元311使用预定伽马值(gamma value)来执行灰度校正(伽马校正处理)。已经历灰度校正的像素(x,y)的图像数据idc(x,y)由使用未经历灰度校正的像素(x,y)的图像数据id(x,y)和伽马值γ的下式(式2)表示。

91.idc(x,y)=idc(x,y)

γ

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式2)

92.可以使用预先准备的值作为伽马值γ。可以取决于像素的位置来确定伽马值γ。例如,对于通过将图像传感器302的有效区域划分成预定数量的分区而获得的每个区域,伽马值γ可以变化。

93.在步骤s607中,显影单元311执行将图像数据的颜色空间从rgb颜色空间转换为yuv颜色空间的颜色空间转换处理。使用预定系数和颜色空间转换式(式3),显影单元311通过将与红、绿和蓝的每个颜色的亮度对应的图像数据转换为亮度值和色差值来将图像数据的颜色空间从rgb颜色空间转换为yuv颜色空间。

94.idcr(x,y)表示已经历灰度校正的像素(x,y)的红色图像数据值。idcg(x,y)表示已经历灰度校正的像素(x,y)的绿色图像数据值。idcb(x,y)表示已经历灰度校正的像素(x,y)的蓝色图像数据值。y(x,y)表示通过颜色空间转换获得的像素(x,y)的亮度值。u(x,y)表示通过颜色空间转换获得的像素(x,y)的亮度值与蓝色分量之间的差值(色差值)。v(x,y)表示通过颜色空间转换获得的像素(x,y)的亮度值与红色分量之间的差值(色差值)。系数(ry,gy,gy)是用于获得y(x,y)的系数,并且系数(ru,gu,gu)和(rv,gv,bv)是用于计算

色差值的系数。

95.y(x,y)=ry

×

idcr(x,y)+gy+idcg(x,y)+by

×

idcb(x,y)

96.u(x,y)=ru

×

idcr(x,y)+gu

×

idcg(x,y)+bu

×

idcb(x,y)

97.v(x,y)=rv

×

idcr(x,y)+gv

×

idcg(x,y)+bv

×

idcb(x,y)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式3)

98.在步骤s608中,显影单元311对经转换的图像数据执行用于抑制由于成像光学系统301的光学特性而引起的畸变像差的影响的校正(畸变校正)。通过对图像数据进行几何变形以校正成像光学系统301的畸变率来执行畸变像差的校正处理。使用用于从不包括畸变像差的正确像素位置生成未校正的像素位置的多项式方程式来执行几何变形。在未校正的像素位置具有小数值的情况下,可以通过舍入该小数值来使用最近的像素,或者可以使用线性插值。

99.在步骤s609中,显影单元311将已应用了畸变像差的校正处理的图像数据输出到物体信息生成单元320。

100.然后,结束由显影单元311执行的显影处理。

101.如果将在下面描述的路线生成ecu 130的识别处理单元321可以通过使用图像数据执行外部性识别处理来生成外部信息,则显影单元311不需要执行图6a中图示的所有处理。例如,在识别处理单元321可以基于未应用步骤s608中的畸变像差的校正处理的图像数据来检测成像视场角内的物体的情况下,可以从图6a中图示的显影处理中省略步骤s608中的处理。

102.图6b是图示了要由距离图像生成单元312执行的距离图像数据生成处理的操作的流程图。距离图像数据是与距成像装置110的距离对应的距离信息和每个像素关联的数据。距离信息可以是距离值d,或者可以是要用于计算距离值的散焦量δl或视差量d。在第一示例性实施例中,将在假定距离图像数据是距离值d与每个像素关联的数据的情况下给出描述。

103.在步骤s611中,距离图像生成单元312从输入图像信号生成亮度图像信号。距离图像生成单元312使用第一图像信号生成第一亮度图像信号,并使用第二图像信号生成第二亮度图像信号。距离图像生成单元312通过使用系数合成每个像素组410的红色像素、绿色像素和蓝色像素的图像信号的值来生成亮度图像信号。距离图像生成单元312可以通过使用线性插值执行去马赛克处理并且然后通过将图像信号的值乘以针对红、绿和蓝的每个通道的预定系数来合成图像信号的值来生成亮度图像信号。

104.在步骤s612中,距离图像生成单元312执行第一亮度图像信号与第二亮度图像信号之间的光量平衡的校正。通过将第一亮度图像信号和第二亮度图像信号中的至少一个乘以校正系数来执行光量平衡的校正。以通过在成像光学系统301和图像传感器302的位置调整之后均匀地发射照明光而获得的第一亮度图像信号与第二亮度图像信号之间的亮度比变得恒定这样的方式来预先计算校正系数,并且校正系数被存储在存储器340中。距离图像生成单元312通过将第一亮度图像信号和第二亮度图像信号中的至少一个乘以校正系数来生成已应用光量平衡校正的第一图像信号和第二图像信号。

105.在步骤s613中,距离图像生成单元312对已应用光量平衡校正的第一亮度图像信号和第二亮度图像信号执行用于降噪的处理。距离图像生成单元312通过对每个亮度图像信号应用用于减少高空间频带的低通滤波器来执行降噪处理。距离图像生成单元312可以

使用用于允许预定空间频带内的信号通过的带通滤波器。在这种情况下,可以获得减小在步骤s612中执行的光量平衡校正中可能发生的校正误差的影响的效果。

106.在步骤s614中,距离图像生成单元312计算第一亮度图像信号与第二亮度图像信号之间的视差量-即,相对位置偏移量。距离图像生成单元312在对应于第一亮度图像信号的第一亮度图像中设置目标点和以目标点为中心的检查区域。接下来,距离图像生成单元312在对应于第二亮度图像信号的第二亮度图像中设置参考点和以参考点为中心的基准区域。

107.距离图像生成单元312在顺次地移动参考点的同时,计算检查区域中包括的第一亮度图像与基准区域中包括的第二亮度图像之间的相关度,并将相关度最高的参考点设置为对应点。距离图像生成单元312将目标点与对应点之间的相对位置移动量设置为目标点处的视差量。通过在顺次地移动目标点的同时计算视差量,距离图像生成单元312可以计算多个像素位置处的视差量。

108.距离图像生成单元312生成针对每个像素识别指示视差值的值并指示视差分布的视差图像数据。

109.可以使用已知方法作为由距离图像生成单元312使用的用于获得视差量的相关度的计算方法。例如,距离图像生成单元312可以使用用于评估亮度图像之间的归一化互相关的被称为归一化互相关(ncc)的方法。可替代地,距离图像生成单元312可以使用评估差异度作为相关度的方法。例如,距离图像生成单元312可以使用用于评估亮度图像之间的差值的绝对值之和的绝对差之和(sad),或者用于评估亮度图像之间的差值的平方值之和的平方差之和(ssd)。

110.在步骤s615中,距离图像生成单元312通过将视差图像数据中的像素的视差量转换为散焦量来获取每个像素的散焦量。距离图像生成单元312基于视差图像数据中的每个像素的视差量来生成指示每个像素中的散焦量的散焦图像数据。距离图像生成单元312从使用视差图像数据中的像素(x,y)的视差量d(x,y)和转换系数k的下式(式4)计算像素(x,y)的散焦量δl(x,y)。在成像光学系统301中,第一光束511和第二光束521由于渐晕而在周边视场角中被部分遮挡。因此,转换系数k变为取决于视场角(像素位置)的值。

111.δl(x,y)=k(x,y)

×

d(x,y)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式4)

112.在成像光学系统301具有在中心视场角和周边视场角之间焦点位置改变的像面弯曲的特性的情况下,可以使用下式(式5)将视差量d(x,y)转换为散焦量δl(xy),其中,cf是像面弯曲量。通过在调整成像光学系统301和图像传感器302的位置之后通过捕获图的图像来获取视差量与到物体的距离的值之间的关系,可以获取转换系数k和像面弯曲量cf。此时,像面弯曲量cf取决于视场角,并作为像素位置的函数给出。

113.δl(x,y)=k(x,y)

×

d(x,y)

×

cf(x,y)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式5)

114.在步骤s616中,距离图像生成单元312将像素(x,y)的散焦量δl(x,y)转换为像素(x,y)中的到物体的距离值d(x,y),并生成距离图像数据。通过利用与成像光学系统301的图像形成的关系来转换散焦量δl,可以计算到物体的距离值d。当成像光学系统301的焦距由f表示并且从像侧主点到图像传感器302的距离由ipp表示时,可以使用由下式(式6)表示的图像形成公式将散焦量δl(x,y)转换为到物体的距离值d(x,y)。

[0115][0116]

焦距f和从像侧主点到图像传感器302的距离ipp被设置为固定值而与视场角无关,但焦距f和距离ipp不限于固定值。在成像光学系统301的图像形成倍率对于每个视场角大幅地变化的情况下,焦距f和从像侧主点到图像传感器302的距离ipp中的至少一个可以设置为对于每个视场角变化的值。

[0117]

在步骤s617中,距离图像生成单元312将距离图像数据输出到物体信息生成单元320。距离图像生成单元312结束距离图像数据的生成处理。

[0118]

每个像素的视差量d和散焦量δl以及距成像光学系统301的主点的距离值d是可以使用上述系数和转换式进行转换的值。因此,作为要由距离图像生成单元312生成的距离图像数据,每个像素可以包括指示视差量d或散焦量δl的信息。当考虑到物体信息生成单元320计算物体区域中包括的距离值d的代表值时,期望的是基于频数分布(frequency distribution)变得对称的散焦量来生成距离图像数据。

[0119]

在步骤s614的计算视差量的处理中,使用第一亮度图像与第二亮度图像之间的相关性来搜索对应点。在第一图像信号中包括的噪声量(例如,归因于光散射噪声的噪声)大的情况下,或者在检查区域中包括的亮度图像信号之中的信号值的变化小的情况下,有时不能正确地评估相关度。在这种情况下,有时计算与正确的视差量的误差大的视差量。在视差量的误差大的情况下,在步骤s616中生成的距离值d的误差也变大。

[0120]

由距离图像生成单元312执行的距离图像数据的生成处理可以包括用于计算视差量的可靠度(视差可靠度)的可靠度计算处理。视差可靠度是指示计算出的视差量中包括的误差程度的指标。例如,标准偏差相对于检查区域中包括的信号值的平均值的比率可以被评估为视差可靠度。在检查区域中的信号值的变化(即,对比度)大的情况下,标准偏差变大。在进入像素的光量大的情况下,平均值变大。在进入像素的光量大的情况下,光散射噪声量大。换句话说,平均值与噪声量呈正相关。

[0121]

平均值相对于标准偏差的比率(标准偏差/平均值)对应于对比度的大小与噪声量之间的比率。如果相对于噪声量而言对比度足够大,则可以估计视差量的计算误差小。换句话说,视差可靠度越大,计算出的视差量的误差越小,并且计算出的视差量可以说是较精确的视差量。

[0122]

在步骤s614中,可以在每个目标点处计算视差可靠度,并且可以生成指示距离图像数据中包括的每个像素的距离值的确定性的可靠度数据。距离图像生成单元312可以将可靠度数据输出到物体信息生成单元320。

[0123]

接下来,将描述物体信息生成单元320基于图像数据和距离图像数据来生成外部信息和物体距离信息的处理。

[0124]

图7a和图7b是图示了要由物体信息生成单元320执行的处理的流程图。图8a至图8e是各自图示了要由物体信息生成单元320执行的处理中的图像和信息的示意图。

[0125]

识别处理单元321生成指示基于图像数据的图像中的图像位置和物体的诸如宽度和高度之类的尺寸、指示物体的区域的区域信息以及物体的类型(属性)和标识号(id号)的

外部信息。标识号是用于标识检测的物体的标识信息,并不限于数字。识别处理单元321检测成像装置110的成像视场角内存在的物体的类型以及该物体在图像中的位置和尺寸,并同时确定物体是否是经登记的物体并分配标识号。

[0126]

图8a图示了基于由成像装置110获取并输入到物体信息生成单元320的图像数据的图像810。图像810包括人801、车辆802、交通标志803、道路804和车道805。识别处理单元321从图像810检测物体,并生成指示关于每个物体的类型、标识号和区域信息的外部信息。图8b是图示了关于从图像810检测的物体的外部信息的示意图,并且在x-y坐标平面上的对应于图像810中图示的位置处指示物体。例如,外部信息被生成作为由表1表示的表格。在外部信息中,物体的区域被限定为围绕物体的矩形框(物体框)。在外部信息中,关于物体的区域信息包括指示矩形物体框的形状的左上坐标(x0,y0)和右下坐标(x1,y1)。

[0127]

[表1]

[0128][0129]

图7a是图示识别处理单元321生成外部信息的处理的流程图。识别处理单元321在获取图像数据时开始生成外部信息的处理。

[0130]

在步骤s701中,识别处理单元321从图像数据生成要用于物体检测处理的图像数据。识别处理单元321执行将从图像处理单元310输入的图像数据的大小扩大或缩小至从物体检测处理中的检测性能和处理时间确定的大小的处理。

[0131]

在步骤s702中,识别处理单元321执行检测在基于图像数据的图像中包括的物体的处理,并检测图像中的与物体对应的区域和物体类型。识别处理单元321可以从一个图像检测多个物体。在这种情况下,识别处理单元321标识多个检测的物体的各个类型和区域。

[0132]

识别处理单元321生成检测到物体的图像中的区域的位置和尺寸(水平宽度、垂直高度)以及物体的类型作为外部信息。可以由识别处理单元321检测的物体的类型的示例包括车辆(乘用车、公共汽车、卡车)、人、二轮汽车和交通标志。通过将图像中的物体的外形与预先与物体的类型关联的预定外形图案进行比较,识别处理单元321检测物体,并标识检测的物体的类型。可以由识别处理单元321检测到的物体的类型不限于上述类型。然而,在处理速度方面,期望的是取决于车辆100的行驶环境来缩减待检测的物体的类型的数量。

[0133]

在步骤s703中,识别处理单元321追踪标识号已被登记的物体。识别处理单元321从在步骤s702中检测到的物体当中标识已登记了标识号的物体。标识号已被登记的物体例如是在先前的物体检测处理中被检测并且被分配了标识号的物体。在检测到标识号已被登记的物体的情况下,识别处理单元321将与标识号对应的外部信息与在步骤s702中获取的关于物体的类型和区域的信息关联(即,更新外部信息)。

[0134]

在确定在图像中不存在标识号已被登记的物体的情况下,确定与标识号关联的物体已经移动到成像装置110的成像视场角的外部(即,物体丢失),并且停止追踪。

[0135]

在步骤s704中,识别处理单元321确定在步骤s702中检测到的每个物体是否是标识号未被登记的新的物体,将新的标识号分配给指示被确定为新的物体的物体的类型和区域的外部信息,并且然后登记外部信息。

[0136]

在步骤s705中,识别处理单元321将所生成的外部信息与指示时间的信息一起输出到路线生成装置150。

[0137]

识别处理单元321结束外部信息的生成处理。

[0138]

图7b是图示了要由距离信息生成单元322执行的关于每个物体的距离信息的生成处理的流程图。基于外部信息和距离图像数据,距离信息生成单元322生成指示每个检测的物体的距离值的物体距离信息。

[0139]

图8c图示了与基于图8a中图示的图像数据的图像810对应的基于距离图像数据的距离图像820。在距离图像820中,距离信息由颜色的浓度指示。颜色越深指示距离越短,而颜色越浅指示距离越长。

[0140]

在步骤s711中,距离信息生成单元322通过对由识别处理单元321检测到的物体的数量nmax进行计数来计算检测的物体的数量。

[0141]

在步骤s712中,距离信息生成单元322将n设置为1(初始化处理)。对由外部信息指示的每个物体顺次地执行步骤s713和后续步骤中的处理。按从在外部信息中具有较小标识号的物体的顺序,对物体执行步骤s713至s716中的处理。

[0142]

在步骤s713中,距离信息生成单元322标识与外部信息中包括的第n个物体的图像810上的区域(物体框)对应的距离图像820上的矩形区域。距离信息生成单元322设置指示距离图像820上的对应区域的外形的框(物体框)。图8d是图示了叠加在从图像810检测到的各个物体上的指示在距离图像820中设置的区域的外形的框的示意图。如图8d中图示的,距离信息生成单元322在距离图像820上设置对应于人801的物体框821、对应于车辆802的物体框822和对应于交通标志803的物体框823。

[0143]

在步骤s714中,距离信息生成单元322生成关于对应于第n个物体的距离图像820中的矩形区域中包括的像素的距离信息的频数分布。在与距离图像数据的每个像素关联的信息是距离值d的情况下,按以相等间隔设置距离的倒数这样的方式设置频数分布的区间。在散焦量或视差量与距离图像数据的每个像素关联的情况下,期望的是以相等的间隔将频数分布分隔成区间。

[0144]

在步骤s715中,距离信息生成单元322将频数分布中最频繁的距离信息设置为指示第n个物体的距离的物体距离信息。

[0145]

可替换地,可以计算区域中包括的距离值的平均值并将其设置为物体距离信息。当计算平均值时,可以使用可靠度数据来采用加权平均。通过在距离值的可靠度较高时对每个像素设置较大的权重,可以更精确地计算物体的距离值。

[0146]

为了有助于在下面描述的路线生成处理中的路线生成,期望的是将指示从车辆100的预定位置到物体的距离的信息设置为物体距离信息。在指示从图像传感器302到物体的距离的距离值d被用作距离信息的情况下,可以通过将众数值偏移预定量来获得指示从车辆100的预定位置到物体的距离的信息。在散焦量δl被用作距离信息的情况下,可以通过使用式6将距离信息转换为距图像传感器302的距离,然后将经转换的距离偏移预定量来获得指示从车辆100的预定位置到物体的距离的信息。

[0147]

在步骤s716中,距离信息生成单元322确定n是否大于检测的物体的数量nmax+1。在n大于检测的物体的数量nmax+1的情况下(步骤s716中的“是”),处理前进至步骤s717。在步骤s717中,距离信息生成单元322将n+1设置为n,并且处理返回到步骤s713。换句话说,对于下一个物体(第(n+1)个物体)执行物体距离信息的提取。在n等于或大于检测的物体的数量nmax+1的情况下(步骤s716中的“否”),处理结束。

[0148]

在步骤s718中,距离信息生成单元322将对应于n个物体的物体距离信息与关于时间的信息一起输出到路线生成单元330,并且处理结束。

[0149]

通过上述物体距离信息生成处理,针对外部信息中包括的每个物体生成物体距离信息。特别地,通过从与在图像810中检测到的物体对应的距离图像820的区域中包括的距离信息当中统计地确定关于物体的距离信息,可以抑制归因于噪声和计算精度的像素之中的距离信息的变化。因此,可以更精确地获取指示到物体的距离的信息。可以采用各种方法作为统计地确定距离信息的方法。例如,从距离信息的分布中提取最频繁的距离信息、平均值或中值的方法。

[0150]

接下来,将描述要由路线生成ecu 130的路线生成单元330执行的生成路线信息的处理(路线生成处理)。路线信息是包括车辆的行进方向和速度的信息。路线信息也可以被称为行驶计划信息。路线生成单元330将路线信息输出到车辆控制ecu 140。基于路线信息,车辆控制ecu 140控制驱动单元170。

[0151]

在第一示例性实施例中,在车辆100的行进方向上存在车辆(前车)的情况下,路线生成单元330以车辆100跟随领头辆行进这样的方式生成路线信息。另外,路线生成单元330以车辆100执行避让行为从而不与物体碰撞这样的方式生成路线信息。

[0152]

图9是图示了要由路线生成单元300执行的路线生成处理的流程图。路线生成单元330基于外部信息、物体距离信息以及由雷达装置120生成的距离信息来生成关于车辆100的路线信息。路线生成ecu 130从路线生成装置150中包括的存储器340中读取每个时间的外部信息和物体距离信息以及由雷达装置120生成的距离信息,并开始路线生成处理。

[0153]

在步骤s901中,路线生成单元330基于外部信息和物体距离信息来检测车辆100计划行驶的行进路线上的物体。路线生成单元330通过将车辆100计划行驶的行进方向的方位方向与外部信息中包括的物体的位置和类型进行比较来确定行进路线上的物体。基于从车辆控制ecu 140获取的关于车辆100的制动的信息(转向偏航角量、速度等)来标识车辆100计划行驶的行进方向。在行进路线上没有检测到物体的情况下,路线生成单元330确定“未检测到物体”。

[0154]

假定成像装置110获取了图8a中图示的图像810。在路线生成单元330基于从车辆控制ecu 140获取的关于车辆100的制动的信息来确定车辆100正在沿着车道805延伸的方向上行进的情况下,路线生成单元330检测作为行进路线上的物体的车辆802。

[0155]

在步骤s902和s903中,基于车辆100与行进路线上的物体之间的距离以及车辆100的行进速度vc,路线生成单元330确定是生成用于执行跟随行驶的路线信息还是生成用于执行避让行为的路线信息。

[0156]

在步骤s902中,路线生成单元330确定车辆100与行进路线上的物体之间的距离是否比阈值dth短。阈值dth由车辆100的行进速度vc的函数表示。随着车辆速度vc变得较高,阈值dth变得较大。在路线生成单元330确定车辆100与行进路线上的物体之间的距离比阈

140确定转向偏航角量、加速器的控制值、制动器的控制值、用于齿轮的连接的控制信号以及灯的照明控制信号。

[0167]

在步骤s908中,路线生成单元330开始生成用于执行跟随行驶的路线信息的处理。

[0168]

在步骤s909中,路线生成单元330生成供车辆100跟随行进路线上的物体(前车)的路线信息。具体地,路线生成单元330以将车辆100与在车辆100前方行进的前车之间的距离(车辆间距离)保持在预定范围内这样的方式来生成路线信息。例如,在车辆100与前车之间的相对速度具有正值并且车辆间距离比预定范围短的情况下,路线生成单元330以车辆100在将行进方向维持在笔直方向上的同时减速这样的方式生成路线信息。

[0169]

路线生成单元330以车辆100的行进速度不超过预定值(例如,车辆100行驶的道路的合法速度、基于来自驾驶员101的指令的设定的行进速度)这样的方式生成路线信息。处理前进至步骤s907,并且车辆控制ecu 140基于所生成的路线信息来控制驱动单元170。

[0170]

路线生成单元330结束路线信息的生成处理。在车辆100正在行进时重复执行路线信息的生成处理。

[0171]

根据上述控制,通过整合在基于图像中的物体的位置和尺寸的框内的距离信息,可以减小传感器噪声的影响以及归因于来自被摄体的高亮度反射的局部距离误差的影响,并高度精确地计算到每个物体的距离的值。因为路线生成ecu 130由于到每个物体的更精确的距离值而可以精确地计算车辆100的路线,所以车辆100可以更稳定地行驶。

[0172]

变形例1

[0173]

在上述处理中,包含物体的矩形区域(物体框)被用作物体的区域,但由图像中的物体的外周限定的区域可以被用作物体的区域。在步骤s702中,识别处理单元321将图像810中的存在物体的区域存储在外部信息中作为物体的区域。例如,识别处理单元321可以通过标识图像数据的每个像素的属性来划分每个物体的区域。

[0174]

图8e中的图830是图示了由识别处理单元321针对各个物体划分的并叠加在图像810上的区域的示意图。区域831指示人801的区域,区域832指示车辆802的区域,并且区域833指示交通标志803的区域。此外,区域834指示道路804的区域,并且区域835指示车道805的区域。

[0175]

在这种情况下,在步骤s713和s714中,距离信息生成单元322针对图8e中图示的每个区域计算每个物体的区域中包括的距离值的频数分布。

[0176]

通过以这种方式限定物体的区域,关于除了诸如背景之类的物体以外的区域的距离信息变得不太可能被包括在区域中。换句话说,可以在区域中包括的距离信息的分布中进一步反映关于物体的距离信息。因此,因为除了诸如物体的背景或前景之类的物体以外的区域的影响可以减弱,所以可以更精确地计算物体的距离值。

[0177]

变形例2

[0178]

从根据第一示例性实施例的成像装置110,顺次地输出图像信息和距离图像信息。此外,识别处理单元321使用顺次接收到的图像信息顺次地生成外部信息。外部信息包括物体的标识号。在特定时间t0和时间tl检测到具有相同标识号的物体的情况下,可以确定物体的检测到的尺寸和距离信息的时间变化。在变形例2中,距离信息生成单元322计算在预定时间范围内具有相同标识号的物体的距离值d的平均值。由此,时间方向上的距离变化减少。

[0179]

图10是图示了根据变形例2的要由距离信息生成单元322执行的物体距离信息生成处理的流程图。在图10中图示的流程图中的处理当中,被指定与图7b中图示的处理中的步骤编号相同的步骤编号的处理与上述处理中的处理相同。因此,将省略这些处理的描述。

[0180]

在步骤s721中,距离信息生成单元322将频数分布中最频繁的距离信息设置为指示第n个物体的距离的物体距离信息。然后,距离信息生成单元322将物体距离信息与标识号和时间一起存储在存储器340中。

[0181]

在步骤s722中,距离信息生成单元322从存储在存储器340中的物体距离信息中获取具有与第n个物体的标识号相同的标识号的物体距离信息的历史。距离信息生成单元322获取与比对应于最新的物体距离信息的时间早预定时间段的时间对应的具有相同标识号的物体距离信息。图11是图示了关于与第n个物体具有相同标识号的物体的物体距离信息的时间变化的示意图。水平轴指示时间,并且垂直轴指示物体距离信息(距离值d)。时间t0指示最新的距离值d被获取的时间。

[0182]

在步骤s723中,距离信息生成单元322从所获取的关于与第n个物体具有相同标识号的物体的物体距离信息的历史,计算获取最新的物体距离信息的时间与比最新的获取时间早预定时间段的时间之间的时间范围中包括的物体距离信息的平均值。例如,距离信息生成单元322计算图11中的预定时间范围δt中包括的四个距离值的平均值。

[0183]

以上述方式,通过使用外部信息中包括的标识号获取关于同一物体的物体距离信息(距离值)的历史并且计算时间平均值,可以抑制变化。即使在车辆100行驶的道路改变(例如,弯曲道路、倾斜道路、具有许多不平坦的崎岖道路)的情况下,也可以在追踪同一物体的同时计算时间方向上的平均值。因此,可以通过减少归因于图像信号中包括的诸如光散射噪声之类的噪声的距离值的变化同时减少行驶环境改变的影响来更精确地计算物体的距离值。

[0184]

变形例3

[0185]

在上述变形例2中,通过计算具有相同标识号的物体距离信息的时间平均值来抑制变化。当在预定时间范围内计算物体距离信息的历史的平均值时,可以通过使用较长的时间范围来增加在求平均时使用的样本数。因此,可以进一步减小从车辆100到物体的距离值的变化。然而,在从车辆100到物体的距离在预定时间范围内变化的情况下,因为计算了包括距离变化的平均值,所以存在不能正确地估计从车辆100到物体的距离值的可能性。在变形例3中,通过使用具有相同标识号的物体的尺寸计算物体距离信息的加权平均,可以更精确地获取车辆100与物体之间的距离。

[0186]

图12是图示了根据变形例3的要由距离信息生成单元322执行的物体距离信息生成处理的流程图。在图12中图示的流程图中的处理当中,被指定与图7b中图示的处理中的步骤编号相同的步骤编号的处理与上述处理中的处理相同。因此,将省略这些处理的描述。

[0187]

在步骤s721中,距离信息生成单元322将频数分布中最频繁的距离信息设置为指示第n个物体的距离的物体距离信息。然后,距离信息生成单元322将物体距离信息与标识号和时间一起存储在存储器340中。

[0188]

在步骤s731中,距离信息生成单元322从存储器340获取关于具有与第n个物体的标识号相同的标识号的物体的物体距离信息的历史以及指示物体的尺寸的信息的历史。从指示存储在外部信息中的物体框的信息获取指示物体的尺寸的信息。例如,基于左上坐标

(x0,y0)和右下坐标(x1,y1),获得宽度(x1-x0)作为指示物体的尺寸的信息。

[0189]

在步骤s732中,使用指示具有与第n个物体的标识号相同的标识号的物体的尺寸的信息,距离信息生成单元322对与比对应于最新的物体距离信息的时间早预定时间段的时间对应的具有相同标识号的物体距离信息执行加权平均处理。使用对应时间的物体尺寸来确定每个时间的权重系数。

[0190]

图13a至图13d是图示了加权平均的示意图。图13a是图示了在比对应于最新的物体距离信息的时间t0早的时间t1、基于由成像装置110获取的图像数据的图像1300的示意图。图像1300包括车辆1301。框1302指示从图像1300确定的车辆1301的物体框。

[0191]

图13b是图示了在时间t0基于由成像装置110获取的图像数据的图像1310的示意图。与图像1300类似,图像1310包括车辆1301。框1312指示图像1310中的对应于车辆1301的物体框。在时间t0,图像1310中的车辆1301的尺寸大于在时间t1获取的图像1300中的车辆1301的尺寸。因此,物体框1312大于物体框1302。

[0192]

因为图像中的物体的尺寸与成像光学系统301的横向倍率成比例,所以物体与车辆100之间的距离和图像信息上的物体尺寸的倒数成比例关系。基于图像信息中的不同时间的物体尺寸之间的比较,例如,在尺寸变大的情况下,可以确定物体与车辆100之间的距离变短。相比之下,在尺寸变小的情况下,可以确定物体与车辆100之间的距离变长。在尺寸变化小的情况下,可以确定物体与车辆100之间的距离变化小。

[0193]

下文中,将给出在假定车辆1301是第n个物体的情况下获取距离信息的示例的描述。

[0194]

图13c是图示了关于与车辆1301(第n个物体)具有相同标识号的物体的物体距离信息的时间变化的示意图。图13d是图示了指示与车辆1301(第n个物体)具有相同标识号的物体的尺寸的信息(宽度)的倒数的时间变化的示意图。

[0195]

在步骤s732中,距离信息生成单元322将从时间t0到比时间t0早预定时间段的时间的时间范围内的每个时间的物体的尺寸(宽度)的倒数与时间t0的物体的尺寸(宽度)的倒数进行比较。距离信息生成单元322确定权重系数,使得物体的尺寸(宽度)的倒数的差值的绝对值越大,权重系数越小。物体的尺寸(宽度)的倒数与权重系数之间的关系不限于上述示例中的关系。例如,可以根据每个时间的物体的尺寸(宽度)的倒数与时间t0的物体的尺寸(宽度)的倒数的比率来确定权重系数。

[0196]

在步骤s732中,距离信息生成单元322使用权重系数来计算物体距离信息的加权平均值,并将加权平均值设置为关于时间t0的车辆1301的物体距离信息。

[0197]

根据变形例3中的处理,通过利用使用图像上的物体的尺寸确定的权重系数来计算物体距离信息的加权平均,可以减小归因于从车辆100到物体的相对距离变化的距离值的估计误差。

[0198]

下文中,将描述第二示例性实施例。在第一示例性实施例中,通过对已经使用成像平面相位差系统获取的关于物体的距离数据进行统计处理,高度精确地获取到图像中包括的物体的距离(物体距离信息)。在第二示例性实施例中,通过组合使用成像平面相位差系统的距离计算方法以及使用图像识别的距离计算方法,可以更精确地获取到物体的距离。下文中,距离计算方法和基于该方法的距离计算处理将被称为“测距”。

[0199]

下文中,将参考附图来详细描述第二示例性实施例。以下处理可以由成像装置110

的图像处理单元310和物体信息生成单元320中包括的处理器以及路线生成ecu 130中的任一个或它们的组合来执行。在以下描述中,物体信息生成单元320的距离信息生成单元322执行以下处理。第二示例性实施例不限于该配置。

[0200]

在将参考附图给出的描述中,不同附图中图示的相同组件原则上被指定相同的附图标记,并且将省略冗余描述。

[0201]

在第二示例性实施例中,路线生成装置150通过成像平面相位差测距与使用图像识别的测距的组合来校正测量距离值。

[0202]

成像平面相位差测距是使用在第一示例性实施例中描述的成像平面相位差系统的测距。

[0203]

使用图像识别的测距是用于从基于物体识别检测到的物体的宽度来计算距离的测距(物体宽度测距)、或用于从物体与地面接触的位置来计算距离的测距(接地位置测距),该位置在下文中被称为物体的接地位置。

[0204]

在物体宽度测距中,使用以下特性来计算到物体的距离:随着图像上的物体的宽度中的像素的数量变得越小,到物体的距离越长,并且随着图像上的物体的宽度中的像素的数量变得越大,到物体的距离越短。指示在高度方向和倾斜方向上的图像上的物体的尺寸的其他参数可以类似地用于距离的计算。

[0205]

在接地位置测距中,假定物体与道路表面接触,例如,基于物体的图像上的接地线(道路表面存在于下侧的图像中的下端)与图像上的消失点之间的距离来计算从车辆100到物体的距离。随着接地线越靠近消失点,物体越远离车辆100,并且随着接地线越远离消失点,物体越靠近车辆100。

[0206]

将描述成像平面相位差测距、物体宽度测距和接地位置测距中的误差的特性。作为常见的考虑误差的方式,如下地定义相对误差和绝对误差。相对误差被定义为与在没有相对距离变化的情况下足够样本之间的标准偏差对应的量。绝对误差被定义为与在没有相对距离变化的情况下足够样本之间的平均值与真实值之间的差值对应的量。

[0207]

成像平面相位差测距中的相对误差的主要原因是因由于归因于传感器噪声的像素值的变化而引起块匹配导致的视差误差。因为相对误差不取决于视差值而变化,所以在相对误差被转换为距离的情况下,相对误差基本上与距离的平方成比例地恶化。由于光学系统的像差、组装误差以及受热或振动影响的波动分量而发生绝对误差。可以对每个原因执行校正处理。在考虑计算量而不执行校正处理的情况下,有时维持大误差。

[0208]

物体宽度测距中的相对误差取决于图像上的物体的分辨率和识别精度。在物体宽度测距中,如果实际物体宽度(例如,物体侧的实际物体的宽度,以米为单位表示的物理量)未知,则检测的图像上的物体的宽度不能被转换为距离。因此,将以某种方式确定实际物体宽度,并且绝对误差和相对误差二者取决于实际物体宽度。因为相对误差与距离成比例,所以在距离较大的情况下,相对误差可以小于成像平面相位差测距中的相对误差。

[0209]

接地位置测距中的相对误差取决于图像上的物体的接地线的识别精度和图像的分辨率。因为图像的分辨率是用于测量消失点与接地线之间的距离的分辨率,所以即使在距离大的情况下,也可以在高分辨率图像中更高度精确地测量距离。在道路表面在下侧延伸的情况下,光轴方向上的俯仰角的估计误差导致测距误差。

[0210]

在获取图像的成像装置被附接到可移动体的情况下,取决于移动的加速度和道路

表面状况,俯仰角对于每个图像捕获帧而言变化。在这种情况下,俯仰角的误差导致相对误差。取决于安装状态或可移动体的倾斜的总是以恒定值出现的俯仰角的误差导致绝对误差。如下所述,可以使用关于消失点的信息和移动信息来估计俯仰角,并且可以减小误差。相对误差与等同于物体宽度的距离成比例,但因为相对误差受俯仰角估计影响的影响,所以误差量大于物体的宽度的误差量。可以基于物体要与地面接触来执行物体接地位置测距。在下端没有像交通信号灯或交通标志那样与地面接触的情况下,这引起了不能执行测距的问题。

[0211]

图14是图示了根据第二示例性实施例的用于获取测量距离值(物体距离信息)的处理的流程图。

[0212]

输入数据d1401是输入到距离信息生成单元322的数据。如在第一示例性实施例中描述的,通过对由图像传感器302捕获的图像执行图像识别而获得的关于物体的外部信息(物体的标识号、物体的类型(属性)、与物体对应的区域的大小)被输入到距离信息生成单元322。输入数据d1401还可以包括通过另一类型的图像识别处理获得的其他结果。输入数据d1401可以包括任何图像识别结果信息(只要可以识别图像中的物体与地面接触的像素位置),例如,指示识别到的图像的图像范围的图像坐标、或通过语义区域分割技术获得的关于同一物体区域的信息。

[0213]

指示通过使用成像平面相位差系统执行计算而获得的结果(关于每个像素的距离信息)的距离图像数据作为输入数据d1401被输入到距离信息生成单元322。在第二示例性实施例中,除了这些数据之外,成像光学系统301的焦距f、关于车辆100的移动速度的信息以及关于成像装置110的安装位置的信息也被作为输入数据d1401输入到距离信息生成单元322。输入数据d1401是通过整合这些信息而获得的数据集。

[0214]

在以下步骤中,可以对多个物体同时执行识别处理,但对被识别为相同物体的物体执行要在保存和参考时间序列数据信息的同时执行的处理。换句话说,相同的标识号被包括作为输入数据。

[0215]

在步骤s1401中,距离信息生成单元322通过接地位置测距获取测量距离值d1,并将测量距离值d1作为数据d1402输出。测量距离值dl指示通过接地位置测距计算出的车辆100(成像装置110)与目标物体之间的距离。数据d1402是指示在步骤s1401中通过接地位置测距计算出的测量距离值d1的信息。

[0216]

使用指示输入数据d1401中包括的识别图像的图像范围的图像坐标,距离信息生成单元322获取图像中的物体与地面接触的像素位置。将给出在光轴被设置在高度h处且平行于道路表面并且图像上的消失点和接地线之间的距离是hs个像素(可以是以子像素为单位的数字)的情况下要执行的测距处理的概述的描述。如果使用中心投影系统以焦距f获取的(可以是对中心投影系统进行校正的图像)图像中的像素尺寸由ps表示,则可以使用下式(式7)如下地表示测量距离值(距离)d1。

[0217][0218]

另外,在不是道路表面的情况下,在接地表面与光轴不平行的情况下,在不采用中心投影系统的情况下,或者在包括大的畸变像差的情况下,如果可以估计消失点和接地线,

则可以执行测距计算本身。

[0219]

在式7中,假定光轴平行于道路表面,但如上所述,在可移动体的俯仰角包括误差的情况下,消失点位置变为与假设位置不同的位置。因此,hs的值包括误差,并且这因此导致距离误差。在识别精度低的情况下,因为hs被识别为与实际接地线不同的位置,所以产生类似的距离误差。

[0220]

在步骤s1402中,距离信息生成单元322通过图像平面相位差测距获取测量距离值d3,并将测量距离值d3作为数据d1404输出。数据d1404是指示在步骤s1402中通过成像平面相位差测距计算出的测量距离值d3的信息。

[0221]

如在第一示例性实施例中描述的,距离信息生成单元322可以基于距离图像数据和外部信息来获取关于目标物体的距离信息(距离值)。例如,假定通过散焦量指示关于每个像素的距离信息的距离图像数据以及通过框指示物体的区域的外部信息被作为输入数据d1401输入。此时,距离信息生成单元322可以使用目标物体的物体框中包括的散焦量的众数值和焦距f从图像形式公式中获取车辆100与目标物体之间的距离(物体距离信息)。所获得的距离被作为测量距离值d3获取。可以输入距离值本身作为输入数据d1401,或者可以输入在计算处理中获得的其他类型的数据作为输入数据d1401。

[0222]

在步骤s1403中,距离信息生成单元322获取图像中的目标物体的宽度(物体宽度)ws。物体宽度ws由像素的数量表示。可替代地,物体宽度ws可以由子像素的数量表示。距离信息生成单元322基于图像识别结果来执行物体宽度ws的测量。例如,在指示图像中的每个物体的物体框的信息被包括作为输入数据d1401中包括的外部信息的情况下,可以获取与目标物体对应的物体框的宽度作为物体宽度ws。作为获取物体宽度的替代,距离信息生成单元322可以获取物体的高度,或者可以选择包括较大数量的像素的宽度或高度,或宽度和高度二者,以增强鲁棒性。距离信息生成单元322获取指示物体宽度ws的信息作为数据d1403。

[0223]

在步骤s1404中,距离信息生成单元322使用由数据d1403指示的物体宽度ws以及由接地位置测距获得并由数据d1402指示的测量距离值d1和由成像平面相位差测距获得并由数据d1404指示的测量距离值d3中的任一者或二者来计算实际物体宽度w。实际物体宽度w是以指示长度的单位系统(例如,米)指示目标物体的宽度的信息。尽管可以使用测量距离值d1和测量距离值d3中的任一者或二者获得实际物体宽度w,但期望的是选择具有较小绝对误差的测量距离值。在使用测量距离值d1的情况下,可以使用下式(式8)如下地表示实际物体宽度w。

[0224][0225]

可以基于指示作为输入数据d1401输入的外部信息中包括的物体的类型的信息来确定实际物体宽度w。例如,如果目标物体的类型是乘用车,则实际物体宽度w可以被设置为预定义值1.7m。然而,在根据物体的类型确定实际物体宽度w的情况下,准确地说,实际物体宽度w取决于每个物体而不同,因此该差异导致绝对误差。距离信息生成单元322输出指示实际物体宽度w的信息作为数据d1405。

[0226]

在步骤s1405中,距离信息生成单元322使用实际物体宽度w和物体宽度ws获取距

离值d2。数据d1406是指示基于物体宽度并在步骤s1405中计算出的测量距离值d2的信息。在步骤s1405中执行的处理是在步骤s1404中执行的处理的逆处理。可以使用下式(式9)如下地表示距离值d2。

[0227][0228]

在这种情况下,因为实际物体宽度w相同,所以获得d1=d2。通过使用将在下面描述的时间序列信息,因为在步骤s1404中添加了处理,所以获得不同的距离值作为距离值d1和d2。

[0229]

包括步骤s1403、s1404和s1405的步骤组c1101对应于物体宽度测距。

[0230]

在步骤s1406中,距离信息生成单元322对由数据d1402指示的测量距离值d1、由数据d1406指示的测量距离值d2和由数据d1404指示的测量距离值d3进行整合,并将整合的值设置为到识别物体的距离值d。

[0231]

例如,整合处理是选择测量距离值d1、测量距离值d2和测量距离值d3中的任一个作为测量距离值d的处理。测量距离值d1、测量距离值d2和测量距离值d3包括取决于获取各个值的测距的类型而变化的相对误差或绝对误差。通过选择被视为包括小的相对误差或绝对误差的测量距离值,距离信息生成单元322可以在通过多种测距方法获取的测量距离值当中根据场景形式采用具有小的误差的测量距离值。例如,当距离值较大时,通过接地位置测距和成像平面相位差测距获取的测量距离值包括较小的误差。因此,在所获取的测量的s距离值大于预定距离的情况下,距离信息生成单元322选择测量距离值dl和测量距离值d2中的任一者。在所获取的测量的距离值等于或小于预定距离的情况下,距离信息生成单元322选择测量距离值d3。

[0232]

作为另一整合处理方法,在考虑到绝对误差或相对误差的情况下,相对于距离计算存在概率分布,并且还可以以存在概率变得最高这样的方式从概率分布之和中选择测量距离值。此外,基于输入数据d1401中包括的车辆100的移动速度以及关于加速器、制动器和转向的信息,可以确定相对于当前相对距离值的相对距离值的存在概率。例如,通过以加速度变化不变得较大这样的方式将与先前时间的加速度相同的加速度设置为最大概率,可以以随着加速度变化变得越大而变得越小这样的方式来确定存在概率。可以因此计算相对距离的存在概率。在包括加速器信息的情况下,可以在加速度增大的方向上确定最大概率。在包括制动器信息的情况下,可以在d加速度减小的方向上确定最大概率。此外,可以取决于目标物体的类型来确定存在概率。如果目标物体的类型是乘用车或两轮车辆,则因为识别物体可以大幅地d加速或减速,所以相对距离变化可以变得较大。在目标物体的类型是不进行快速加速和减速的行人的情况下,相对距离变化很可能取决于其操作,并且可以更精确地确定存在概率。

[0233]

到目前为止,已经描述了在输入某个时间的一个输入数据的情况下执行的基本流程。随后,将描述按时间顺序输入连续输入数据的情况。

[0234]

图15是图示了在按时间顺序输入多个连续输入数据的情况下要执行的处理的流程图。与以上参考图14描述的处理和数据相同的处理和数据被指定相同的附图标记,并且将省略描述。

[0235]

在按时间顺序输入连续输入数据的情况下,对于被分配了相同标识号的物体(即,被识别为相同物体的物体),可以按时间顺序获取由数据d1402指示的测量距离值d1、由d1403指示的物体宽度ws和由d1404指示的测量距离值d3。

[0236]

在按时间顺序输入连续输入数据的情况下,由于与目标物体的相对距离的时间变化,每个测量的距离值在时间上变化。然而,如果假定物体是刚性物体,则可以说实际物体宽度w总是恒定的。因此,在步骤s1504中,即使相对距离值按时间顺序变化,距离信息生成单元322也通过在时间序列方向上平滑实际物体宽度w来获取平均实际物体宽度w’。由此,可以减少相对误差。

[0237]

在假定式8中的物体宽度w的情况下,通过在时间序列方向上充分地平滑物体宽度w,绝对误差仅保持与接地位置测量距离值对应的量,但可以充分减小接地位置测量距离值和物体宽度(像素数量)的相对误差。也可以类似地考虑使用成像平面相位差测量距离值来计算实际物体宽度w’的情况。数据d1505指示具有小的相对误差的物体宽度w’。通过步骤s1405中的距离转换处理,获得由数据d1406指示的物体宽度测量距离值d2作为仅包括物体宽度ws的相对误差和与接地位置测量距离值对应的绝对误差的距离值。

[0238]

在步骤s1507中,距离信息生成单元322计算成像平面相位差测量距离值d3的绝对误差的校正量。成像平面相位差测量距离值的绝对误差的主要分量是当转换为散焦量时与距离无关地变为恒定值的误差。因此,距离信息生成单元322基于焦距和图像形成公式将成像平面相位差测量距离值d3转换为散焦量。类似地,距离信息生成单元322使用等同的焦距和图像形成公式将物体宽度测量距离值d2转换为散焦量。可以使用接地位置测量距离值d1和相对测量距离值d将物体宽度测量距离值d2转换为散焦量。距离信息生成单元322使用相同时间数据来计算从成像平面相位差测量距离值d3转换的散焦量与从物体宽度测量距离值d2转换的散焦量之间的差值,并计算时间序列差值数据的平均值。在使用足够量的数据计算平均值的情况下,所获得的平均值指示成像平面相位差测量距离值d3与物体宽度测量距离值d2的绝对值误差之间的差值。平均值被用作由数据d1508指示的绝对误差校正值。

[0239]

在使用接地位置测量距离值d1的情况下,校正接地位置测量距离值d1的绝对值误差,因此变为在步骤s1504中使用接地位置测量距离值d1的情况下获得的相同的绝对值误差。在这种情况下,通过选择具有较小的相对误差的测量距离值,相对误差的影响较小。在步骤s1509中,距离信息生成单元322执行确定在步骤s1507和s1508中获得的结果中的哪一个将被选择作为绝对误差校正值的绝对误差校正值选择处理。以下将描述细节。

[0240]

在步骤s1402中,距离信息生成单元322通过成像平面相位差测距计算测量距离值d3。距离信息生成单元322使用由数据d1508指示的绝对误差校正值来校正散焦量。因为绝对误差校正值指示散焦的偏移,所以根据从输入数据计算出的散焦量计算差值,并且由数据d1404指示的测量距离值d3包括经校正的绝对误差。距离值可以被直接校正。实际上,绝对误差与在步骤s1507中用作差值的数据的绝对误差同步。如上所述,在使用从物体宽度测量距离值d2转换的散焦量的情况下,绝对误差变为物体宽度测量距离值d2的绝对误差。因为物体宽度测量距离值d2取决于在步骤s1504中使用的测量距离值,所以在步骤s1504中使用接地位置测量距离值d1计算实际物体宽度w的情况下,所有接地位置测量距离值d1、成像平面相位差测量距离值d3和物体宽度测量距离值d2包括接地位置测量距离值d1的绝对误差。由于在三个测量距离值之中,绝对误差变得一致,因此在步骤s1406中的整合测距处理

中,可以仅考虑相对误差来确定概率分布。利用该配置,可以更简单且稳定地计算由数据d1507指示的相对测量距离值d。

[0241]

通过如上所述输入关于物体的时间序列数据,可以根据接地位置测量距离值d1、成像平面相位差测量距离值d3和物体宽度测量距离值d2按时间顺序计算相对测量距离值d。根据相对测量距离值d的时间序列数据,可以计算相对于目标物体的相对速度、相对加速度和相对加速度的变化率。使用这些值,可以计算上述相对距离值的概率分布。例如,可以以相对加速度的变化变得较小这样的方式来确定概率分布。

[0242]

虽然以上已经描述了时间序列数据的获取,但数据不需要总是连续地获取。在由于物体识别的失败而不能在某个帧中获得正确输入数据的情况下,不需要执行处理,并且当物体识别成功时,可以从该帧开始重新计算。在这种情况下,可以在没有任何改变的情况下直接使用实际物体宽度的平均值w’和绝对误差校正值,并且可以从这些值获得稳定的相对测量距离值d。然而,在这种情况下,因为不能使用从相对测量距离值d计算的相对速度、相对加速度和相对加速度变化率来正确地获得相对测量距离值的概率分布,所以期望的是设置0。

[0243]

还可以考虑不能正确计算接地位置测量距离值d1、成像平面相位差测量距离值d3和物体宽度测量距离值d2中的任一个或任两个的情况。这种情况的示例包括所识别的物体浮起的情况以及由于另一物体进入车辆100和所识别的物体之间而不能正确测量物体宽度的情况。在这种情况下,因为变化与先前值的差异大,或者距离值与其他距离值的差异大,所以不能获得正确值的可能性高。在这种情况下,通过将0或非常小的值设置为距离值的存在概率分布,可以避免或减少对相对测量距离值d的计算的影响。

[0244]

在与目标物体的相对距离值d充分改变为时间序列变化的情况下,在步骤s1508中,距离信息生成单元322执行使用相对距离的变化和实际物体宽度w的改变来执行高精度的绝对误差校正的校正处理。

[0245]

图16a和图16b是图示了绝对误差的校正处理的示意图。在图16a中,水平轴是时间轴,并且距离值d是沿着垂直轴绘制的。在图16b中,水平轴是时间轴,并且实际物体宽度w是沿着垂直轴绘制的。图16b图示的不是平均实际物体宽度w',而是使用每个时间的物体宽度计算的实际物体宽度w。为了便于说明,移除了相对误差。

[0246]

即使在如图16a中图示地相对距离值d变化的情况下,如图16b中的虚线所指示的,实际物体宽度w也将是恒定的。然而,如果包括绝对误差,则如实线所指示的,实际物体宽度w取决于距离而变化。使用真实的距离值dt、真实的实际物体宽度wt和估计的平均实际物体宽度we’,包括误差的估计的距离值de可以由下式(式10)表示。

[0247][0248]

假定不包括相对误差,如果平均实际物体宽度we’与真实的实际物体宽度wt相等,则真实的距离值dt和估计的距离值de变得相等。因此,可以正确地估计相对距离。在平均实际物体宽度we’与真实的实际物体宽度wt不相等的情况下(即,保留绝对误差),在以平均实际物体宽度we’与真实的实际物体宽度wt之间的比率的相对距离中也观察到误差。如图16b中图示的,估计的实际物体宽度we因此根据距离而变化。

[0249]

因此,在发生固定的相对距离变化的情况下,以实际物体宽度在每个时间不改变

这样的方式确定绝对距离校正分量。因为真实距离值dt是未知的,所以考虑到接地位置测量距离值d1、成像平面相位差测量距离值d3和相对测量距离值d中的一个或两个或更多个的值,可以根据变化分量和实际物体宽度w的变化来估计真实距离值dt。具体地,例如,使用成像平面相位差测量距离值d3利用与步骤s1404中的方法等同的方法来计算实际物体宽度w,并计算其时间序列变化。仅需要以实际物体宽度w的变化变得较小这样的方式来校正绝对误差校正值。作为计算方法,可以使用通常的优化方法找到实际物体宽度w的变化变为最小的校正值。由此,同时估计绝对误差校正值和实际物体宽度校正值。

[0250]

经校正的成像平面相位差测量距离值d3、物体宽度测量距离值d2和接地位置测量距离值d1的绝对误差将相等,并且绝对误差之间的差值也可以计算为绝对误差校正量。在步骤s1401中的接地位置测距处理中,绝对误差分量的主要原因包括上述成像装置的俯仰角变化。换句话说,消失点偏移到与估计位置不同的位置,并且分量变为接地位置测量距离值的绝对误差。基于步骤s1508中的绝对误差分量的估计,可以估计俯仰角变化。校正量可以被用作由数据d1510指示的绝对误差校正量。如果以这种方式出现相对距离变化,则可以使用该信息高度精确地校正每个测量距离值的绝对误差分量。如果包括绝对误差分量的时间序列变化的变化落入可忽略范围内,则在步骤s1508中的整体绝对误差校正处理之后,基本上不需要步骤s1504中的实际物体宽度获取处理中的实际物体宽度的平均值计算以及步骤s1507中的绝对误差校正处理。因此,可以简化处理,或者可以连续执行处理以进行确认。

[0251]

在步骤s1509中,距离信息生成单元322选择将在步骤s1507和s1508中计算出的绝对误差校正值中的哪一个要作为数据d1508输出。如上所述,在出现固定的相对距离变化的情况下,执行步骤s1508中的处理。因此,在步骤s1509中,距离信息生成单元322基本上选择在步骤s1507中计算出的绝对误差校正值,并且在执行步骤s1508中的处理的情况下选择在步骤s1508中计算出的绝对误差校正值。在绝对误差再次变化的情况下,可以再次选择在步骤s1507中计算出的绝对误差校正值。例如,在选择了在步骤s1508中计算出的绝对误差校正值之后在步骤s1507中计算出的绝对误差校正值变化的情况下,可以再次选择在步骤s1507中计算出的绝对误差校正值。此后,在再次出现固定的相对距离变化的情况下,通过执行步骤s1508中的处理并选择在步骤s1508中计算出的绝对误差校正值,可以连续地选择较好的绝对误差校正值。

[0252]

如上所述,已经参考图15、图16a和图16b描述了使用接地位置测距、物体宽度测距和成像平面相位差测距按时间顺序校正相对误差和绝对误差的流程。在上述处理中已经描述了成像平面相位差测距,但对于立体测距,也可以类似地考虑上述处理。相对误差可以被视为等同于传感器噪声影响,并且绝对误差可以被视为是每个立体成像装置的安装位置影响。虽然绝对误差没有被转换为散焦值,但校正量可以被估计为安装位置。

[0253]

类似的思维方式也可以应用于诸如光检测和测距(lidar)之类的另一种模态。例如,在lidar的情况下,因为在距离分辨率中类似地产生相对误差,并且还产生绝对误差作为距离的偏移,所以可以应用与第二示例性实施例中的思维方式类似的思维方式。虽然在第二示例性实施例中已经描述了使用三种类型的方法的整合流程,但可以提取两种类型。可替代地,即使通过添加成像平面相位差测距、立体声或lidar(另一模态)来使用四种类型的方法,也可以类似地校正误差。通过使用这种方法,出于在一定时间段内追踪所识别的物体的目的,可以获得稳定的测量距离值。例如,通过将该成像装置安装在车辆上,成像装置

可以应用于自动巡航控制(acc)或自动驾驶。

[0254]

下文中,将描述第三示例性实施例。根据第三示例性实施例的路线生成装置150通过组合使用多个图像的视差测距和基于单个图像的距离估计来实现从近距离到远距离的高精度测距。

[0255]

图17是图示了测距系统的配置示例的框图。测距系统被包括在成像装置110中。测距系统包括图像传感器1702、识别处理单元1721、距离图像生成单元1712、缩放测距单元1703和距离校正单元1704。图像传感器1702对应于根据第一示例性实施例的图像传感器302。识别处理单元1721对应于识别处理单元321。距离图像生成单元1712对应于距离图像生成单元312。缩放测距单元1703和距离校正单元1704对应于距离信息生成单元322。

[0256]

图像传感器1702从成像光学系统301获取图像信号。图像传感器1702获取包括由第一光电转换单元411获取的图像信号的图像信号以及包括由第二光电转换单元412获取的图像信号的图像信号。这些图像信号对应于被称为视差图像的不同视点处的图像。图像传感器1702获取通过合成两个视差图像的图像信号而获得的合成图像信号作为捕获图像。图像传感器1702可以获取两个视差图像中的一个作为捕获图像。

[0257]

作为用于获得视差图像的相机配置,可以使用左右并排布置的立体相机。此外,可以使用单目相机配置,并且可以通过考虑车辆自身的速度将连续帧图像中的物体的相对移动量视为视差来获得视差图像。

[0258]

识别处理单元1721通过对捕获图像应用图像识别处理来检测由图像传感器1702捕获的捕获图像中包括的物体。为了实现车辆100的自动驾驶控制或碰撞减少制动控制,将识别车辆100行驶的车道、在车辆100前方行驶的车辆(前车)以及诸如侧行道上的人之类的物体。作为物体检测的方法,诸如使用用于检测外观基本上没有变化的物体(交通灯或交通标志等)的模板匹配的方法和使用机器学习的一般物体(车辆、人等)检测之类的方法。

[0259]

在第三示例性实施例中,识别处理单元1721执行分隔线检测任务和物体识别任务。图18是图示了要由识别处理单元1721执行的分隔线检测任务和物体识别任务的输出结果的示意图。分隔线检测任务使用用于检测输入的捕获图像中的每个像素是否表示道路上的分隔线(或白线)的机器学习模型来获取分隔线区域图,其中像素各自用指示像素是否表示分隔线的信息来标记(在图18中,检测到的分隔线由黑色虚线指示)。物体识别任务使用用于检测输入的捕获图像中的道路上的物体的机器学习模型,通过获得检测的物体的类型(人、车辆、交通标志)、检测框的左上点的坐标(x0,y0)和检测框的右下点的坐标(x1,y1)来获取与检测的物体接触的检测框的坐标。物体识别任务的输出等同于在第一示例性实施例中描述的外部信息。

[0260]

距离图像生成单元1712从由图像传感器1702获取的视差图像获取距离数据。在来自视差图像的测距中,通过检测在不同视点处捕获的图像中的对应点来计算视差值,并且可以从视差值和捕获视差图像的相机条件(焦距、基线长度)来计算距离。如上所述,即使捕获了视差图像的相机是包括双像素cmos传感器的单目相机,也可以识别用于距离计算的相机条件。在使用视差图像的测距中,已知的是,如果测距目标移动得更远,则因为视差实际上变得不可检测,所以测距估计精度通常变差。

[0261]

缩放测距单元1703通过以存在于第一区域中的物体与存在于第二区域中的物体之间的尺寸比,缩放由距离图像生成单元1712计算出的第一区域的距离值来计算第二区域

的距离值。在第三示例性实施例中,将给出以下示例的描述:通过基于关于近距离侧和远距离侧的道路信息,缩放由距离图像生成单元1712计算出的近距离侧的距离值来将近距离侧的道路表面延伸到远距离侧。

[0262]

图19是图示了相机安装位置与道路表面之间的位置关系的示图。设置在相机安装位置v(0,y0,0)的垂直方向上延伸的道路表面上的点处定义原点o的全局坐标(x,y,z)。包括图像传感器1702的成像相机以光轴方向水平延伸这样的方式布置。成像范围由成像相机的视角指示。当成像范围(即,捕获图像和由距离图像生成单元1712计算出的距离图)的图像宽度和图像高度分别由wu和hv表示时,距离图的中心像素被表示为c(wu/2,hv/2)。

[0263]

首先,估计近距离侧的道路表面。距离图的下部区域可以被估计为距离图上的近距离侧的道路表面。可替代地,可以通过对捕获图像执行识别处理来直接估计近距离侧的道路表面。在距离图的下部区域中,被确定为表示由识别处理单元1721检测到的分隔线区域图上的分隔线的像素周围的区域可以被设置为道路表面。仅被确定为比由相机安装条件(视角、分辨率、视点角度)、成像环境(天气、时间)和关于车辆行驶的道路的信息(车道宽度、车道数量、分支点/路口、道路类型)限定的阈值更接近的距离图区域可以被设置为道路表面。

[0264]

当距离图上的像素p(u0,v0)的距离值由d表示时,近距离侧的道路表面p(u0,v0)可以被转换为全局坐标中的x=u0-wu/2、y=v0-hv/2、z=d。

[0265]

当假定道路表面是水平时,表面的式子被表示为ax+by+cz+d=0(a、b、c和d为常数)。通过使用指示近距离侧的道路表面的四个或更多个点来限定上述式子的常数,可以估计道路表面。

[0266]

通过估计的道路表面的式子变得可以估计远距离侧的道路表面。此外,从延伸的远距离侧的道路表面缩放距离。具体地,位于由式子表示的道路表面与通过视点v(0,y0,0)和指示距离图上的远距离侧的区域的像素q(u1,v1)的直线的交点处的点r(x,y,z)的深度z可以被估计为距离值。

[0267]

即使缩放测距单元1703不能从距离数据获取与像素q(u1,v1)对应的道路的距离,也可以通过以上述方式计算来获取与像素q(u1,v1)对应的道路的距离值z。

[0268]

如果在距离图上考虑处理,则通过以存在于近距离区域(第一区域)中的道路表面与存在于远距离区域中的道路表面之间的比率(三维空间上的深度比率)缩放第一区域的距离来计算第二区域的距离。

[0269]

因为以这种方式计算出的距离值不使用在远距离处恶化的视差测距单元的距离值,所以提高了远距离处的估计距离精度。

[0270]

此外,通过使用由识别处理单元1721检测到的检测框,可以提高测距精度。图20是图示了在道路上检测到具有已知物体尺寸的两个交通标志的场景的示意图。在所获取的图像中,具有预先已知尺寸的两个交通标志布置在近距离侧和远距离侧。在这种状态下,可以通过距离图像生成单元1712精确地计算到近距离侧的交通标志的距离。如果物体的尺寸已知,则缩放测距单元1703可以基于图像上的像素数量之间的比率来计算到远距离侧的交通标志的距离。

[0271]

近距离侧的交通标志的高度(像素数量)由w0表示,从相机位置到近距离侧的交通标志的距离由d0表示,远距离侧的交通标志的高度(像素数量)由w1表示,并且从相机位置

到远距离侧的交通标志的距离由d1表示。缩放测距单元1703可以通过d1=d0

×

(w0/w1)来计算距离。如上所述,如果可以检测到具有已知尺寸的物体(交通标志、交通灯等)或其尺寸可以假定为在近距离侧和远距离侧相同的物体(护栏、分隔线的宽度、长度、间隔),则可以执行高精度的缩放测距。在使用具有已知尺寸的物体执行缩放测距的情况下,难以增强从近距离区域到远距离区域的整个距离范围内的精度。然而,通过组合上述用于延伸道路表面的缩放测距与使用物体尺寸比率的缩放测距,变得可以执行精确的缩放测距。

[0272]

距离校正单元1704基于由缩放测距单元1703计算出的距离值对由距离图像生成单元1712测量的距离值进行校正来获取校正距离值dc。下文中,由距离图像生成单元1712测量的距离值将被称为距离值d,并且由缩放测距单元1703计算出的距离值将被称为缩放测量距离值ds。根据使用系数α的下式(式11)计算校正距离值dc。

[0273]

dc=α

×

d+(1-α)

×

ds

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式11)

[0274]

系数α由以下三种方法中的任一种确定。

[0275]

(1)基于距离值的大小的系数α确定方法

[0276]

在由视差测距单元执行的测距中,到测距目标的距离的值影响测距精度。如果到测距目标的距离长,则由视差测距单元计算出的距离值的精度下降。因此,根据距离值以缩放测量距离值的百分比变得较高这样的方式确定系数α。可以由此获得精确的测距结果。换句话说,将系数α以距离值d越大而越小这样的方式确定。

[0277]

(2)基于测距目标的对比度的系数α确定方法

[0278]

在由视差测距单元执行的测距中,作为影响测距精度的除了到测距目标的距离的值以外的因素,存在测距目标的对比度。在计算视差图像中的对应点(视差)时,即使对比度低的区域经历匹配处理,因为与周围区域的区分不清楚,所以也不能精确地获得视差。因此,在夜间测距目标没有被充分照明并且测距目标的对比度低的情况下,确定距离值的测距精度低,并且以缩放测量距离值的百分比变高这样的方式设置系数α。换句话说,在测距目标的对比度低的情况下,将系数α以变得较大这样的方式确定。例如,因为基于由车辆的光照明的范围内的高精度距离值生成缩放测量距离值,所以在测距目标的对比度低的情况下,也可以获得精确的测距结果。

[0279]

(3)基于检测框的类别类型的系数确定方法

[0280]

取决于测距目标的类型(类别),测距精度倾向于在视差测距和缩放测距之间变化。例如,关于存在于距诸如交通灯的发光部之类的缩放基准的距离处的测距物体,可以与其他物体的测距类似地执行视差测距,但缩放测距的测距精度倾向于下降。为此原因,在检测框的类别是特定类型的情况下,可以通过以距离值的百分比变得较高这样的方式设置系数来获得精确的测距结果。如图20中图示的,在缩放测距的方法提高了物体检测区域周围的周边区域中的缩放测距的距离精度的情况下,可以根据类别以检测框周围的缩放测距的百分比变得较高这样的方式确定系数。

[0281]

上述系数确定方法不需要限于一种。可以基于针对各个原因生成的系数来确定最终系数。利用上述配置,可以获得精确的测距结果。

[0282]

缩放测距单元的变形例

[0283]

作为缩放测距单元1703的变形例,将给出通过基于图像上的近距离侧和远距离侧的道路宽度之间的尺寸比缩放邻近的距离数据来估计到目标物体的距离的示例的描述。图

21是图示了缩放测距单元1703的配置示例的框图。

[0284]

缩放测距单元1703包括车道分析单元2101、侧倾角估计单元2102、接地位置估计单元2103和物体距离计算单元2104。

[0285]

车道分析单元2101从分隔线区域图中检测布置在分隔线之间的像素的数量作为车道宽度,并检测分隔线之间的中心坐标作为车道中心(坐标)。

[0286]

图22a至图22d是示意性图示了要由车道分析单元2101执行的车道宽度检测处理和车道中心检测处理的示意图。图22a是示意性图示了图像中的指示分隔线的分隔线区域图的示图。车道分析单元2101将(由图22a中的黑色虚线指示的)分隔线标志分配给在图像中被检测为分隔线的像素。因为道路上的分隔线在行驶车道与超车车道之间的边界部分中由虚线指示,或者分隔线被道路上的车辆或障碍物隐藏,因此分隔线区域图间歇地出现。

[0287]

图22b是图示了计算车道宽度和车道中心位置的方法的示意图。车道分析单元2101按从分隔线区域图的左侧到右侧的顺序检查是否向每个像素分配了分隔线标志。在不向被检查的像素分配分隔线标志而向被检查的像素的左侧的邻近像素分配分隔线标志的情况下,被检查的像素被设置为道路宽度的起点。在向被检查的像素分配分隔线标志而不向被检查的像素的左侧的邻近像素分配分隔线标志的情况下,被检查的像素被设置为道路宽度的终点。利用该配置,如图22b中图示的箭头所指示的,可以针对分隔线区域图的每条线检测车道宽度(箭头的长度)和车道位置(箭头的中心位置)。

[0288]

图22c是图示了检测的车道宽度数据的示意图。除非车道的实际尺寸改变,否则基于与距相机的距离的倒数成比例的像素的数量来观察车道宽度。在图22c中,水平轴指示分隔线区域图的线,并且垂直轴指示检测的车道宽度(像素的数量)。当以这种方式指示时,车道宽度与线具有高度线性关系。取决于分隔线的不连续程度,在某些情况下,混合地观察对应于一个车道的车道宽度和对应于两个车道的车道宽度。因为车道宽度相差约两倍,因此容易将它们彼此分开。

[0289]

图22d是插入与左侧的一个车道对应的分离的观察数据以及关于不能从观察数据获得车道宽度的线的数据的示意图。在分开的邻近车道(左车道和右车道)中,通过比较车道的位置(箭头的中心位置),容易排除关于邻近车道的观察数据。从这些信息中,例如,可以通过诸如随机样本一致性(ransac)方法之类的鲁棒估计来获取仅与图22b中图示的左侧的一个车道对应的车道宽度。为了插入车道宽度,可以通过上述ransac方法来计算近似直线的式子,并且可以使用近似直线式,或者可以以插入观察的道路宽度数据这样的方式来执行插值。关于车道的位置,可以通过与上述方法类似的方法来获得每条线的数据。

[0290]

使用如上所述获得的车道信息(车道宽度和车道中心),执行缩放测距。

[0291]

侧倾角估计单元2102从距离图估计相机的侧倾角。产生车载相机的侧倾角存在多种原因。例如,在一些情况下,道路表面的不平坦产生左右轮胎的接地表面之间的高度差,并且因为相机安装位置不能保持水平而产生侧倾角。在其他情况下,由于在车辆沿着曲线行进时施加的离心力而导致车身变形,因此产生侧倾角。这种侧倾角的产生大幅地影响距离估计。

[0292]

这里将描述的缩放测距是使用假定存在于与物体相同距离处的指示车道的宽度的像素数量与指示邻近车道的宽度的像素数量之间的比率,对通过精确测量到道路表面上的物体的距离而获得的邻近距离值进行缩放的处理。在产生相机的侧倾角的情况下,难以

识别假定存在于与物体相同距离处的车道的宽度。

[0293]

图23是将指示有或没有侧倾角的情况下捕获图像中的车道宽度的位置进行比较的示意图。左侧的捕获图像图示了不产生侧倾角的情况,并且右侧的捕获图像图示了从同一场景中图像的左下侧产生10

°

侧倾角的情况。在左侧的捕获图像的情况下,因为测距目标车辆的接地位置和假定存在于相同距离处的车道布置在同一直线上,所以可以容易地将接地位置与车道关联。另一方面,在产生侧倾角的右侧的捕获图像的情况下,在与测距目标车辆的接地位置的同一条线上不存在车道。即使存在车道,也不能计算存在于相同距离处的车道的宽度。为了计算存在于与测距目标车辆相同距离处的车道的宽度,将精确地估计侧倾角。

[0294]

侧倾角估计单元2102基于通过视差测距获取的距离图来估计侧倾角。在产生侧倾角的情况下,如图23中图示的,已知的是存在于与到可以假定为水平倾斜的道路表面的距离相同的距离处的测距目标车辆的位置。因为侧倾角是绕在视点方向上延伸的轴的旋转的角度,所以相机与目标物体之间的距离不改变,并且由相机捕获的图像以侧倾角倾斜。因此,距离图也根据图像中的道路表面的倾斜来倾斜。

[0295]

图24是图示了要由侧倾角估计单元2102执行的侧倾角估计处理的流程图。图25a至图25c是图示了侧倾角估计处理中的每个处理的示意图。

[0296]

在步骤s2400中,侧倾角估计单元2102从距离图确定目标像素设置范围。图25a是图示了距离图中的目标像素设置范围的示意图。

[0297]

如图25a中图示的,目标像素设置范围处于距离图的左下区域。目标像素设置范围的高度被假定为对应于道路表面的区域的高度。例如,从水平线到距离图下端的长度被设置为高度。在考虑目标像素与搜索范围之间的间隔的情况下设置目标像素设置范围的宽度。搜索范围被设置为在水平方向上与目标像素远离预定像素数量(预定间隔)的位置处。在目标像素与搜索区域之间的间隔大的情况下,即使设置了目标像素设置范围的大宽度,也不能设置搜索范围。在第三示例性实施例中,预定间隔被设置为约距离图的图像宽度的1/4,并且目标像素设置范围的尺寸被设置为约距离图的图像宽度的一半。可以通过适当地设置目标像素设置范围来抑制计算量。

[0298]

在步骤s2401中,侧倾角估计单元2102从距离图获取关于目标像素2500的距离数据。在第三示例性实施例中,侧倾角估计单元2102获取关于目标像素设置范围中的像素当中的目标像素2500的距离数据。

[0299]

在步骤s2402中,侧倾角估计单元2102确定搜索范围。与侧倾角的产生无关,目标像素附近的像素的距离值倾向于接近目标像素的距离值。为了基于目标像素2500的坐标和对应像素2501以高分辨率检测侧倾角,因此侧倾角估计单元2102将在水平方向上与目标像素2500分开预定间隔的区域设置为搜索范围。

[0300]

侧倾角估计单元2102可以基于预计产生的侧倾角范围来限制搜索范围的高度。例如,在安装在车辆中的车载相机并且车辆在一般道路上行驶的情况下,要产生的侧倾角限于

±

几度的角度。在第三示例性实施例中,搜索范围的高度被设置为约距离图的图像高度的1/8。作为搜索范围的宽度,设置从在水平方向上与目标像素2500分开预定间隔的位置到距离图右端的长度。搜索范围的右端不限于距离图的右端。然而,在搜索范围的宽度太小的情况下,不能找到与目标像素2500对应的道路表面上的距离数据,使得期望的是设置尽可

能大的宽度的搜索范围。

[0301]

在步骤s2403中,侧倾角估计单元2102从确定的搜索范围搜索对应于目标像素2500的对应像素2501。因为搜索范围中的具有与目标像素2500的距离值类似的距离值的像素被视为对应像素2501,所以针对搜索范围中的每个像素检测与目标像素2500的距离值的差异,并且差异最小的像素被视为对应像素2501。对应像素2501的搜索方法不限于像素与像素之间的差异的比较。可以在目标像素和包括搜索范围中的像素的邻近像素组之间执行距离值中的差异的比较,并且类似度最高的像素组的中心像素可以被视为对应像素2501。

[0302]

在步骤s2404中,侧倾角估计单元2102基于目标像素和对应像素的坐标来计算倾斜度θ。如图25b中图示的,当目标像素2500的坐标被表示为(x0,y0),并且对应像素2501的坐标被表示为(x1,y1)时,通过θ=arctan((y1-y0)/(x1-x0))计算倾斜度θ。

[0303]

在步骤s2405中,侧倾角估计单元2102确定是否已完成对目标像素设置范围中的所有像素的处理。在对目标像素设置范围中的所有像素的处理已经作为目标像素完成的情况下(步骤s2405中的“是”),处理前进至步骤s2406。在对目标像素设置范围中的所有像素的处理未作为目标像素完成的情况下(步骤s2405中的“否”),处理返回到步骤s2401,并且对新的目标像素执行处理。

[0304]

在步骤s2406中,侧倾角估计单元2102计算侧倾角。图25c是图示了水平轴指示目标像素的距离值并且垂直轴指示针对目标像素计算的倾斜度的曲线图的示意图。因为从一个目标像素计算出的倾斜度包括噪声分量,所以通过对多个倾斜度求平均来检测最可能的侧倾角。从视差图像生成被参考以用于执行侧倾角估计的距离图,并且已知的是随着到物体的距离越长,根据视差图像测距的检测精度变得越差。因此,如果使用距离图计算每个目标像素的倾斜度,则计算出的倾斜度的变化根据目标像素的距离值的大小而变大。因此,在侧倾角的计算中,通过以距离值小的目标像素的倾斜度的百分比变得较大并且距离值大的目标像素的倾斜度的百分比变得较小这样的方式执行加权平均来估计侧倾角。作为用于确定加权平均的百分比的因素,可以使用在搜索对应像素时使用的类似度。

[0305]

通过上述处理,可以使用道路表面的距离图来估计侧倾角。

[0306]

此外,将描述在要估计的侧倾角的分辨率被预先确定的情况下设置目标像素与搜索范围之间的间隔的方法。

[0307]

基于侧倾角的分辨率来限定目标像素与搜索范围之间的间隔。侧倾角被计算为从目标像素到对应像素的倾斜度,并由目标像素和对应像素之间的水平差异与目标像素和对应像素之间的垂直差异之间的比率来表示。因为垂直差异最小为一个像素,所以侧倾角的分辨率是基于水平差异的大小确定的。目标像素与搜索范围之间的间隔d是通过使用侧倾角的分辨率r的下式(式12)获得的。

[0308][0309]

在式12中,r表示最小检测角度,并且目标像素与搜索范围之间的间隔d是从在y轴方向的差异为一个像素的情况下获得的角度r的关系推导出的。

[0310]

随着计算出的间隔d越大,分辨率越高,但如上所述,当间隔d越大时,搜索范围变得越窄。因此,期望的是设置最小分辨率。例如,在所需的分辨率r为0.1

°

的情况下,间隔d为

573个或更多个像素。

[0311]

在通过上述计算方法给出侧倾角的检测分辨率的情况下,使得可以设置适当的间隔。

[0312]

接地位置估计单元2103使用通过物体检测任务获取的检测框、由车道分析单元2101获得的车道中心以及由侧倾角估计单元2102估计的侧倾角,估计位于与测距目标的接地位置相同的距离处的车道宽度数据的坐标。图26是图示了要由接地位置估计单元2103执行的车道宽度数据的坐标估计处理的流程图。

[0313]

在步骤s2601中,接地位置估计单元2103从通过物体识别任务获取的检测框当中选择测距目标的检测框。

[0314]

在步骤s2602中,接地位置估计单元2103将检测框下部的中心位置设置为测距目标的接地位置的坐标(xc,yc)。图27是图示了由接地位置估计单元2103设置的测距目标的接地位置的坐标(xc,yc)的示意图。测距目标的接地位置的坐标(xc,yc)通过使用检测框的左上坐标(x0,y0)和右下坐标(x1,y1)的下式(式13)表示。

[0315][0316]

作为获取测距目标的接地位置的坐标的方法,可以使用与上述方法不同的方法。在像车辆一样宽度宽的物体的情况下,由于物体可能看起来以侧倾角倾斜,因此检测框下端的中心坐标与轮胎实际与地面接触的坐标之间的差异可能变大。在这种情况下,例如,可以使用捕获图像和距离图来检测检测框中的物体的轮廓,并且具有侧倾角的倾斜度的直线r与物体的轮廓的下端接触的位置可以被设置为接地表面的坐标。利用这样的配置,可以设置测距目标实际与接地表面接触的坐标。

[0317]

因为识别物体的轮廓的处理涉及大的计算负荷,因此,作为考虑计算成本的配置,可以根据车道中心与测距目标之间的位置关系从检测框的角坐标当中选择合适的坐标。具体地,在车道中心的左侧存在测距目标的情况下选择检测框的左下坐标以及在车道中心的右侧存在测距目标的情况下选择检测框的右下坐标的选择方法。利用该配置,将在下一步骤中获得的直线r与测距目标实际接触的坐标可以有时被设置为比在设置检测框下端的中心的情况下获得的坐标更接近实际坐标的坐标。

[0318]

在步骤s2603中,接地位置估计单元2103获得经过测距目标的接地位置坐标(xc,yc)并具有侧倾角的倾斜度的直线r与通过分隔线检测任务获取的车道中心处的直线c彼此相交的坐标(xt,yt)。

[0319]

通过执行如上所述的处理,即使距离图以侧倾角倾斜,也可以获得存在于与测距目标的接地位置相同距离处的车道宽度数据的坐标。

[0320]

物体距离计算单元2104使用与接地位置对应的并由接地位置估计单元2103获取的车道宽度数据的坐标、由车道分析单元2101计算出的车道宽度数据以及关于距离图的数据来计算到测距目标的距离。图28是图示了要由物体距离计算单元2104执行的到测距目标的距离的估计处理的流程图。

[0321]

在步骤s2801中,物体距离计算单元2104使用车道宽度数据和坐标(xt,yt)来计算车道宽度n2。物体距离计算单元2104可以获取坐标(xt,yt)处的车道宽度作为车道宽度n2,

或者可以通过获取坐标(xt,yt)附近的多个车道宽度,根据与坐标(xt,yt)的距离对车道宽度进行加权并执行加权平均来获取车道宽度。在从通过图像识别检测到的车道获得车道宽度的情况下,存在由于图像识别的误差而在检测的车道宽度与实际车道宽度之间产生差异的可能性。通过使用如上所述的多个车道宽度来计算车道宽度n2,可以减小检测的车道宽度中的变化。要在平滑中使用的车道宽度数据的数量可以取决于处理负荷被设置为一个。

[0322]

在步骤s2802中,物体距离计算单元2104将在目前时间的帧中获得的车道宽度数据和距离数据彼此关联地存储。首先,物体距离计算单元2104获取车道宽度数据及其坐标,并从距离图获取与车道宽度数据的坐标对应的距离数据。此时,可以通过获取与以对应于车道中心线c的车道宽度n1的坐标(xn,yn)为中心的车道宽度数据范围(xn-n1/2,yn)至(xn+n1/2,yn)内的每个坐标对应的距离数据并平滑距离数据来获得对应的距离数据。物体距离计算单元2104针对在目前时间的帧t0处获得的每个车道宽度数据执行这种车道宽度数据与距离数据的关联。图29是图示了车道宽度数据的示意图。物体距离计算单元2104可以取决于处理负荷和记录容量来缩小要关联的数据的数量的范围。例如,物体距离计算单元2104可以被配置为仅存储关联了高确信度的距离数据的数据。

[0323]

在步骤s2803中,物体距离计算单元2104计算要用于到测距目标的距离的计算的基准数据b。当先前步骤中的关联数据的数量由k表示时,通过使用到车道的距离d1和车道宽度n1的下式(式14)来表示基准数据b。

[0324][0325]

此时,因为距离数据的误差有可能随着距离变长而变大,所以可以通过以对具有小距离值的点设置大权重并且对具有大距离值的点设置小权重这样的方式执行加权平均来计算基准数据b。在步骤s2802中获得的与数个帧对应的数据可以被作为关于过去帧t1和t2的数据存储,并且可以计算包括该数据的基准数据b。

[0326]

在式13中,d1[n]

×

n1[n]变为与用于距离计算的基准车道宽度等同的值。当到车道的距离由d表示时,与图像上的车道宽度对应的像素数量被设置为n个像素,成像相机的水平视场角由f

°

表示,并且水平图像宽度被设置为h个像素,可以通过w=(d

×

n)

×2×

tan(f/2)/w来计算实际车道宽度w。当确定了成像相机的规格时,“2

×

tan(f/2)/w”部分可以被视为固定值。因此,实际车道宽度变为(d

×

n)的变量。在式13中,因为基于以上关系,在车辆行驶期间车道宽度可以被视为相同,所以可以通过对d1[n]

×

n1[n]执行平滑来减少观察噪声。即使在多个连续帧的情况下,因为假定车辆在同一车道上行驶,所以实际车道宽度可以被视为相同。因此,还可以通过对d1[n]

×

n1[n]执行平滑来减少观察噪声。

[0327]

另一方面,在一些帧中,存在由于由车身越过小石头行驶而导致的图像不稳定而不能正确地获取车道宽度数据的可能性。因此,通过减少d1[n]

×

n1[n]中具有大的差异(即,大的不稳定性)的帧的权重,可以以减小误差这样的方式计算基准数据。可替代地,通过对与目前时间的帧的时间差异较小的帧增加权重并且对时间差异较大的帧减少权重,可以以在对目前时间的帧的响应以及帧之间导致的不稳定的平滑之间实现平衡这样的方式来计算基准数据。

[0328]

在步骤s2804中,物体距离计算单元2104使用在先前步骤中获得的基准数据b和测

距目标的车道宽度n2,获得测距目标的距离数据d2。可以通过下式(式15)获得距离数据d2。

[0329]

d2=b/n2

ꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(式15)

[0330]

通过执行如上所述的处理,可以估计到测距目标的距离。物体距离计算单元2104输出指示以这种方式获得的到测距目标的距离的物体距离信息。

[0331]

在第三示例性实施例中,已经给出了通过组合使用视差图像的立体测距和使用单个图像的距离估计可以在从近距离区域到远距离区域的所有距离范围中高度精确地执行测距的测距系统的示例的描述。当单独执行使用视差图像的测距时,即使测距目标存在于测距精度变差的远区域中,也可以通过使用诸如道路表面之类的缩放物体的尺寸比来维持距离精度。在缩放目标物体是诸如道路之类的实际尺寸很少改变的物体的情况下,可以通过在缩放时执行平滑并减少尺寸测量中的观察噪声来增强距离精度。通过根据使用视差图像的测距与基于单个图像的距离估计的测距之间的距离范围来改变合成比率,使得可以执行更稳健的距离估计。此外,通过执行侧倾角的检测和校正,使得可以在减少车辆变形和行驶道路不平坦的影响的情况下执行稳健的距离估计。

[0332]

下文中,将描述第四示例性实施例。在上述示例性实施例中,已经使用了使用成像平面相位差系统经由相同光学系统获取左视差图像和右视差图像以获取距离图像数据的成像装置的示例给出了描述,但视差图像的获取方法不限于此。也可以通过立体相机获取左视差图像和右视差图像,立体相机通过设置在左侧和右侧并且分开预定距离的两个成像装置来获取左视差图像和右视差图像。

[0333]

还可以通过使用诸如lidar之类的测距设备获取距离信息并且使用通过对从成像装置获取的捕获图像执行图像识别而获得的外部信息来执行上述测距。

[0334]

下文中,将描述第五示例性实施例。上述示例性实施例中描述的各种功能、各种类型的处理和各种方法也可以由执行程序的设备或装置的计算机来实现。在这种情况下,经由计算机可读存储介质将程序供应到设备或装置的计算机。根据第五示例性实施例的计算机可读存储介质的示例包括硬盘设备、磁存储设备、光存储设备、磁光存储设备、存储卡、易失性存储器和非易失性存储器。例如,根据第五示例性实施例的计算机可读存储介质是非暂态存储介质。

[0335]

虽然已经参考示例性实施例描述了本发明,但要理解,本发明不限于所公开的示例性实施例。随附权利要求的范围应被赋予最宽泛的解释,以包含所有这样的修改以及等同的结构和功能。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1