一种毫米波雷达与摄像头数据融合的目标检测方法和装置与流程

本发明涉及多类型传感器融合感知领域,尤其涉及一种毫米波雷达与摄像头数据融合的方法、装置和设备。

背景技术:

1、摄像头传感器技术成熟,价格便宜,尤其是相较于目前市场上动辄上万的激光雷达来说,以摄像头为主的视觉方案是自动驾驶汽车量产的首选。其次,摄像头所采集的图像包含丰富的色彩、纹理、轮廓、亮度信息,这些是激光雷达、毫米波雷达等传感器无法比拟的。比如说红绿灯监测、交通标志识别只能通过摄像头实现。但其缺点同样明显,摄像头是一种被动式传感器,对光照变化十分敏感,在雨雾黑夜等天气影响下,摄像头的成像质量就会大幅度下降,使得感知算法很难实现物体的检测识别。此外,作为一个被动式传感器,摄像头在测距,测速性能上表现不如激光雷达和毫米波雷达。毫米波雷达和红外、激光、摄像头等光学传感器相比,其穿透雾、烟、灰尘的能力强,可全天候、全天时工作,并可提供高精度的测距、测速以及测角结果,但其缺点同样明显:数据点稀疏,难以提供目标的纹理、轮廓、色彩等语义信息。

2、毫米波雷达和摄像头作为两种主流的传感器,具有成本低廉的优势,但是单独使用时分别在功能性、准确性以及可靠性上有所欠缺。毫米波雷达和摄像头的性能互补性强,但是,现有的毫米波雷达和摄像头融合算法一般停留在“目标层”融合或者“决策层”融合,不能很好地利用毫米波雷达和摄像头数据的互补特性,导致信息利用不够充分,从而准确率、稳定性等不足以满足实际需求。

技术实现思路

1、本发明要克服现有技术的上述不足,实现毫米波雷达和摄像头数据的优势互补,提供一种毫米波雷达与摄像头数据融合的目标检测方法。

2、本发明采用如下的技术方案:

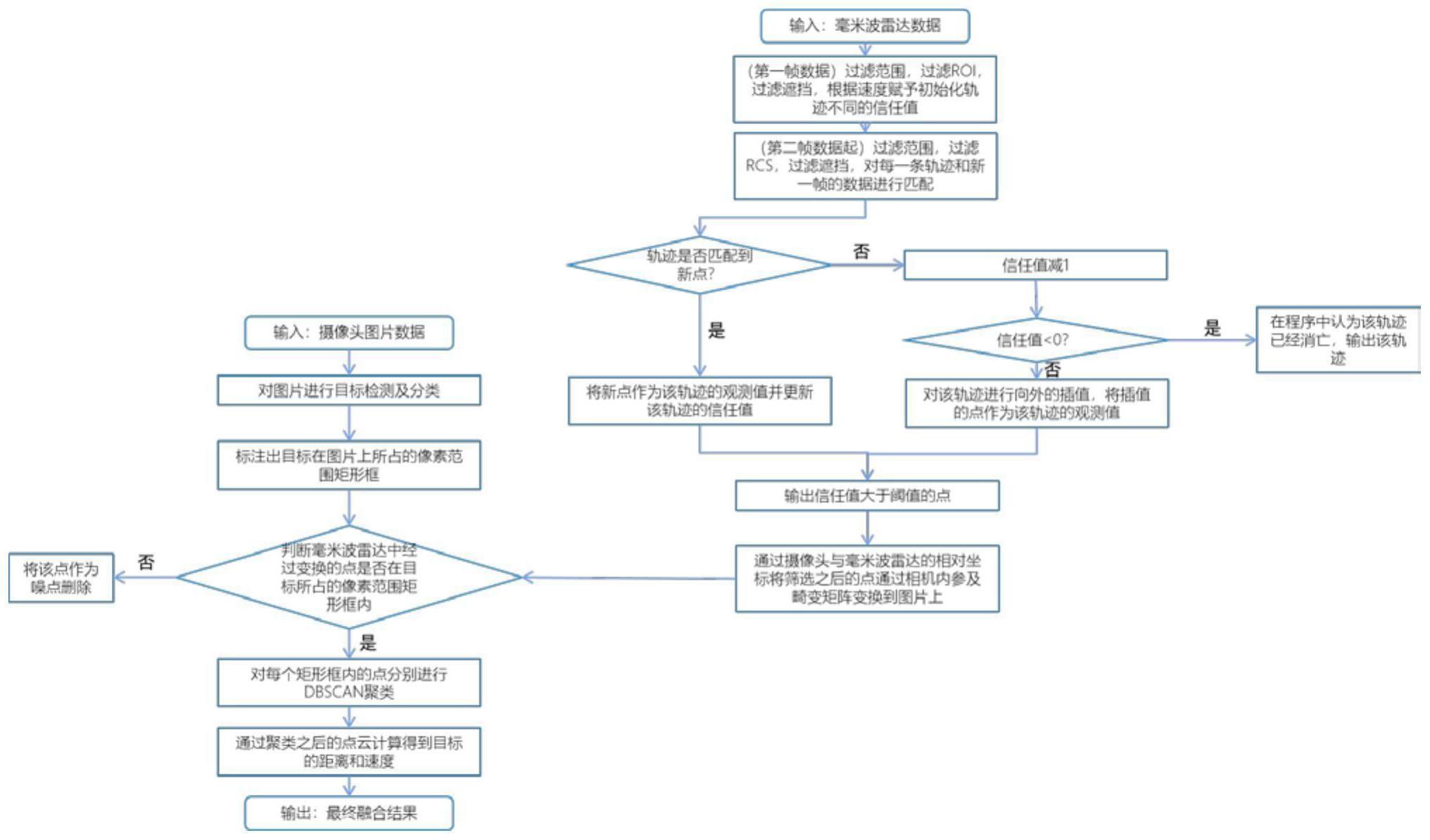

3、一种毫米波雷达与摄像头数据融合的目标检测方法,该方法包括以下步骤:

4、s1,将毫米波雷达和摄像头安装在固定的相对位置上,为有效实施数据融合,毫米波雷达与摄像头的视场应尽可能重合,标定毫米波雷达与摄像头之间的相对位置关系;

5、s2,实时获取毫米波雷达点云数据,每帧毫米波雷达点云数据为时间与数据点的集合其中,tr为当毫米波雷达数据的前帧的时间,为雷达的数据点,n为当前帧中雷达数据点的个数。每个数据点包含位置、速度和雷达散射截面积(rcs)信息,通常位置和速度信息又包含纵向和横向分量,以下记其中,表示横向位置,表示纵向位置,表示横向速度,表示纵向速度;

6、s3,实时获取摄像头数据,每帧摄像头数据为时间与一幅二维图像,(tc,m),其中,tc为当摄像头数据的前帧的时间,m为表示图像的二维矩阵,m的长、宽为图像的分辨率,m的每个元素mx,y为图像中的一个像素;

7、s4,根据时间对毫米波雷达数据和摄像头数据进行配对。通常,摄像头的采样频率大于毫米波雷达,对于每帧图像数据,找到与tc最接近的tr,使用该帧毫米波雷达数据作为与其配对的数据;

8、s5,对于每帧配对的毫米波雷达数据和摄像头数据执行以下步骤:

9、s5.1,对图片进行特征提取,得到特征张量,具体包括:对每个特征张量接入目标检测头,输出每个目标的二维包围盒以及目标的类别信息,其中目标检测头可以检测的类别总数为c;

10、s5.2,根据具体场景调整roi(region of interest,感兴趣区域)范围,对毫米波雷达数据点进行roi过滤,对超出roi的毫米波雷达数据点进行删除;关联s5.1中的目标识别与分类的结果,通过每个目标分类的结果来设定对应rcs(radar cross section,雷达截面积)范围,对毫米波雷达数据点进行rcs过滤,对超出rcs正常范围的毫米波雷达数据点进行删除;同时关联上一时刻的毫米波雷达数据,对本时刻中的毫米波雷达数据点进行匹配、卡尔曼滤波以及信任值更新等步骤;最后对毫米波雷达数据点进行信任值的过滤,对低于信任值阈值的毫米波雷达数据点进行删除;

11、s5.3,获取摄像头内参矩阵及其畸变系数,通过毫米波雷达和摄像头的相对位置计算毫米波雷达的每一个点在摄像头坐标系下的坐标,然后通过摄像头内参及其畸变系数将每个毫米波雷达的数据点投影到图像空间中的像素位置(xi,yi),然后应用s5.1中的目标识别与分类的每个目标的像素区域范围的结果,对毫米波雷达数据进行筛选,对超出像素区域范围的毫米波雷达数据点进行删除,若某个目标的像素区域范围内有1个或者没有毫米波雷达数据点,则直接输出结果,若某个目标的像素区域范围内有2个或者2个以上的毫米波雷达数据点,则通过s5.1中的目标分类的结果与目标类别的通常大小来预设每种目标类别的聚类半径,从而对该目标像素区域范围内的毫米波雷达数据点进行聚类;构建不同类别目标的三维模型,从而得到不同目标的尺寸信息。将二维包围盒内的特征张量与s5.2中匹配得到的毫米波雷达数据点云进行组合,得到融合特征,具体包括:获取该目标的类别,得到该类别下的三维模型;构建回归模型,得到目标的尺寸信息,结合匹配的毫米波雷达数据点信息,最终输出目标的三维检测结果,包括类别、三维坐标以及三维模型;

12、s6,通过聚类之后的点云分布及其对应的信息来计算目标所在的位置、速度等,若某个目标的像素区域范围内没有毫米波雷达数据点,则认为是基于图像的识别算法误判;若某个目标的像素区域范围内有1个毫米波雷达数据点,则使用该数据点的速度对目标的速度赋值;若某个目标的像素区域范围对应多于一个毫米波雷达数据点,则使用这些数据点的平均位置对目标的位置赋值,根据不同的决策需求选择使用这些数据点的平均速度或者最大速度对目标的速度赋值,最后结合s5.3生成的三维模型,完成毫米波雷达数据和摄像头数据的融合。

13、本发明还涉及一种毫米波雷达与摄像头数据融合的目标检测装置,包括一个或者多个处理器、毫米波雷达、摄像头及信号连接线,毫米波雷达数据和摄像头数据分别通过对应的信号连接线传输到处理器,在处理器中实现权利要求1-5中任一项所述的毫米波雷达与摄像头数据融合方法。

14、本发明还涉及一种计算机可读存储介质,其上存储有程序,该程序被处理器执行时,实现权利要求1-5中任一项所述的毫米波雷达与摄像头数据融合的目标检测方法。

15、本发明还涉及一种计算设备,包括存储器和处理器,其中,所述存储器中存储有可执行代码,所述处理器执行所述可执行代码时,实现权利要求1-5中任一项所述的方法。

16、本发明的一种毫米波雷达与摄像头数据融合的方法,将毫米波雷达与摄像头安装在固定的相对位置上,同时采集毫米波雷达与摄像头的数据。将毫米波雷达和摄像头数据根据采集时间对齐;对摄像头采集的图像数据进行目标检测,得到目标占用的像素区域范围和类别;根据毫米波雷达和摄像头的相对位置关系以及摄像头的内部参数,将毫米波雷达数据点投影到图像平面中的像素位置,并根据该像素与目标的像素区域范围之间的关系在目标和毫米波雷达数据点之间建立对应关系;利用基于图像的目标类别信息对毫米波雷达数据点进行过滤和聚类;利用毫米波雷达数据点的位置和速度信息定义目标的位置和速度;最后输出目标的完整三维检测信息,包括类别、位置、速度和三维模型。

17、本发明的优点是:将基于图像的目标检测信息与基于毫米波雷达的目标检测信息应用到对方域辅助识别,提高了目标感知的维度与准确度,同时在高速与低速目标的识别中都能有较好的表现,提供了更加可信的感知信息。

- 还没有人留言评论。精彩留言会获得点赞!