一种基于递归注意力机制的裂纹检测的方法及装置

1.本发明属于计算机视觉图像的分割领域,具体涉及一种基于递归注意力机制的裂纹检测的方法及装置。

背景技术:

2.图像裂纹的检测(image crack detection),是语义分割(semantic segmentation)的一个特殊领域,裂纹检测的目的是区分图片中裂纹的位置,用来进行异常识别。例如,桥梁底部/道路裂纹检测可以识别裂纹在哪里并提醒进行维护。电致发光可以判断裂纹是否在太阳能电池或电池组件中。因此,裂纹检测已广泛应用于许多实际场景中,发挥着重要作用。

3.通常,裂纹检测任务似乎与边缘检测,语义分割具有相似的目的。实际上,边缘检测算子(例如sobel,laplace,canny和其中的某些增强版本)被广泛地直接用于图像中的裂纹分割。这些基于边缘算子的检测方法通过依赖于准确选择阈值的梯度分布来区分裂纹或背景。考虑到全局和局部梯度可能彼此不同,选择阈值不能正确地表示整个图像梯度分布,因此基于手工特征学习的边缘算子处理复杂的真实世界图像的性能有限。在深度卷积神经网络(cnn)成功的基础上,一些先进的语义分割方法被应用于端到端。xie充分利用cnn的边缘检测任务中,以学习层次图像表示(hed)来指导边界检测。liu引入了更丰富的卷积特征(rcf),以通过使用丰富的纹理信息来提高检测性能。yang进一步使用特征金字塔和层次增强网络来检测路面裂缝。该方法学习了从局部斑块到全局图像的多尺度特征以检测边缘,并在道路裂缝上获得了令人满意的结果。

4.最近,u

‑

net被提议用于大量的分割任务中,并获得了令人印象深刻的结果。由于u

‑

net自然使用多尺度信息进行表示,因此对于分割任务而言,它表现得很强大。cheng通过u

‑

net在像素级别检测到裂缝,并取得了良好的效果。但是,与包含丰富纹理信息的普通图像不同,桥梁底部或道路裂缝是在单调/简单背景下随机生成的。因此,检测裂缝比对丰富纹理图像进行语义分割更具挑战性。另一方面,尽管直接使用u

‑

net进行分割可以访问多尺度信息,但是简单的背景并不能区分无关的信息,从而导致预测边缘上的错误。

5.虽然u

‑

net的方法还有一些缺点,没有显著关注目标区域和抑制相关的背景区域,使得检测出来的结果不是很理想。因此,如何获取到足够显著区域的特征,并抑制无关区域的相应,通过更深的网络学习到更多的边缘信息是非常重要的。

技术实现要素:

6.本发明的目的在于,提供一种基于递归注意力机制的裂纹检测的方法及装置,解决目前图片裂纹检测算法不能很好分割出比较好的裂纹图或者分割出很多有瑕疵的图片的问题。

7.为解决上述技术问题,本发明的技术方案为:一种基于递归注意力机制的裂纹检测的方法,包括以下步骤:

8.s1、采集裂纹图片,通过u

‑

net的编码部分对裂纹图片进行下采样,得到不同尺度下采样图片的特征信号;

9.s2、将不同尺度下采样图片的特征信号分别输入到相应的ram模块中,所述ram模块中包含有递归模块,通过所述递归模块输出相应的下采样特征信号;

10.s3、通过ram模块分别输入u

‑

net的编码部分的l层特征信号和解码部分的l

‑

1层门控信号;

11.s4、通过ram模块分别输出u

‑

net的编码部分的下采样输出信号和通过门控信号关注得到显著区域的特征信号;

12.s5、构建u

‑

net的上采样模块,将ram模块输出的显著区域的特征信号与通过反卷积操作得到的上采样的特征信号拼接后进行上采样,得到裂纹检测图片。

13.进一步地,所述s1中使用三线性插值法在u

‑

net网络中将裂纹图片进行下采样,得到不同尺度下采样图片的特征信号。

14.进一步地,所述s3还包括u

‑

net的编码部分的l层特征信号和解码部分的l

‑

1层门控信号进行相加,相加机制为加性注意力机制,具体的公式如下:

[0015][0016]

式中,v1表示的是relu函数,w

g

、w

x

、ψ均为卷积操作,b

g

和b

ψ

为对应卷积的偏置项,t表示递归卷积操作。

[0017]

更进一步地,所述s4中,关注显著区域的特征信号经过跳跃链接的u

‑

net的编码部分的l层特征信号与解码部分的l

‑

1层门控信号进行相加后,经过relu和sigmoid变换输出经过α

i

之后形成,具体的公式如下:

[0018][0019]

式中,σ2是sigmoid函数,g是门控信号。

[0020]

进一步地,所述s5中,u

‑

net的编码部分通过解码器使用反卷积层逐步恢复目标的细节和相应的空间维度,通过跳跃链接输出ram的特征与上采样的特征进行拼接,构建上采样模块。

[0021]

更进一步地,所述s5中,上采样的具体步骤为通过ram模块输出得到显著区域的特征信号与上采样的特征拼接,将拼接之后的特征经过1x1的卷积和sigmoid函数变化,得到裂纹检测图片。

[0022]

进一步地,本方法还包括以下步骤:

[0023]

s6、构建训练模块,迭代给定次数后,得到裂纹检测模型。

[0024]

更进一步地,本方法还包括以下步骤:

[0025]

s7、构建测试模块,将测试图像输入到裂纹检测模型中,得到裂纹测试图片。

[0026]

一种用于实现上述的基于递归注意力机制的裂纹检测的方法的装置,包括样本采集模块,若干ram模块,训练模块和测试模块;其中,

[0027]

所述样本采集模块,用于采集裂纹图片,通过u

‑

net的编码部分对裂纹图片进行下采样,得到不同尺度下采样图片的特征信号;将不同尺度下采样图片的特征信号分别输入到相应的ram模块中;

[0028]

所述ram模块中包含有递归模块,用于通过所述递归模块输出相应的下采样特征

信号;分别输入u

‑

net的编码部分的l层特征信号和解码部分的l

‑

1层门控信号;分别输出u

‑

net的编码部分的下采样输出信号和通过门控信号关注显著区域的特征信号;构建u

‑

net的上采样模块,将显著区域的特征信号与原来上采样的特征信号拼接后进行上采样,得到裂纹检测图片;

[0029]

所述训练模块,用于迭代给定次数后,得到裂纹检测模型;

[0030]

所述测试模块,用于将测试图像输入到裂纹检测模型中,得到裂纹测试图片。

[0031]

一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现上述方法的步骤。

[0032]

与现有技术相比,本发明的有益效果为:

[0033]

本发明提供了一种基于递归注意力机制的裂纹检测的方法及装置,通过递归残差块和注意力模块,将ram整合到了裂纹分割的任务中,从而提高图像去雾算法的性能。

附图说明

[0034]

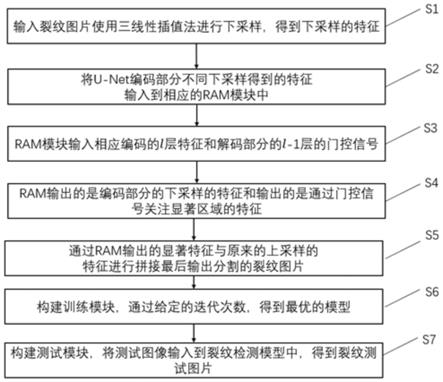

图1是本发明实施例中基于递归注意力机制的裂纹检测的方法流程图;

[0035]

图2是本发明实施例中基于递归注意力机制的裂纹检测网络结构图;

[0036]

图3是本发明实施例中ram模块的结构图;

[0037]

图4是本发明实施例中recursive block的结构图;

[0038]

图5是本发明实施例中不同测试方法裂纹数据集的对比表。

具体实施方式

[0039]

为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。此外,下面所描述的本发明各个实施方式中所涉及到的技术特征只要彼此之间未构成冲突就可以相互组合。

[0040]

本发明实施例的基于递归注意力机制的裂纹检测的方法,如图1所示,包括以下步骤:

[0041]

s1、将输入的裂纹图片,通过u

‑

net的编码部分进行下采样,得到不同尺度的特征;

[0042]

s2、将不同尺度的特征分别输入到相应的ram模块中,在ram中有一个递归模块会输出相应的下采样特征;

[0043]

s3、在ram中有两个输入,一个输入是编码l层的特征,另外一个输入的是解码l

‑

1层的门控信号;

[0044]

s4、在ram模块的输出中,有一个输出是u

‑

net在编码部分的下采样输出,另外一个输出是经过u

‑

net在编码部分输入l层的特征经过下采样之后跳跃链接输入到attention机制中,与解码部分l

‑

1层输入的门控信号相加,使用的是加性注意力,尽管在计算上更加的费时,但是精确度比乘法注意力更高,然后经过relu和sigmoid和上采样等一系列的变换输出比较关注显著区域和抑制无关区域的特征。

[0045]

s5、构建u

‑

net的上采样模块,将ram输出关注显著区域的特征与原来上采样的特征进行一个拼接然后进行上采样,最后输出得到一个更加精细的裂纹检测的图片。

[0046]

s6、构建训练的模块,迭代给定的次轮后,得到最优的裂纹检测的模型。

[0047]

s7、构建测试模块,将测试图像输入到最优的模型中,得到检测的裂纹图片。

[0048]

进一步地,步骤s1中:使用三线性插值法(trilinear interpolation)用过u

‑

net网络将裂纹下采样得到不同尺寸的下采样图片的特征。

[0049]

进一步地,步骤s2中:将原始图片输入到ram模块中经过递归模块后下采样学习到更多的边缘特征。

[0050]

进一步的,步骤s3中:

[0051]

s3.1:对于ram模块,不同于一般模块只有一个输入一个输出。ram模块有两个输入和两个输出。其中一个输入是u

‑

net编码部分l层的特征,另外一个输入是u

‑

net的解码部分l

‑

1层的门控信号g。

[0052]

s3.2对于ram的两个输入,其中的u

‑

net的编码部分l层的特征的输入经过下采样后与解码部分的l

‑

1层的门控信号进行相加,选用的是加性注意力机制,具体的公式如下:

[0053][0054]

式中,σ1表示的是relu函数,w

g

、w

x

、ψ都表示卷积操作,b

g

和b

ψ

都是对应卷积的偏置项。选用加性注意力而不是乘法注意力是因为尽管在计算上加法注意力更加昂贵,但是从实验上看,它的性能比乘法注意力更高。

[0055]

优选地,步骤s4包括:

[0056]

s4.1在ram模块中一共有两个输出,其中一个输出是在u

‑

net编码器部分经过递归模块下采样的输出特征,另外一个输出是经过跳跃链接的u

‑

net输入的l层编码部分的特征与解码部分l

‑

1进行相加然后经过一系列的relu和sigmoid变换输出经过α

i

之后的特征图,α

i

的作用是为了突显显著的图像区域和抑制任务无关的特征响应。具体的公式如下:

[0057][0058]

式中,σ2是sigmoid函数,之所以σ2使用sigmoid函数,是因为顺序使用softmax函数会输出较稀疏的激活响应,而用sigmoid函数能够使训练更好的收敛,g表示的使门控信号,门控信号不使全局图像的表示矢量,而是在一定条件下部分图像空间信息的grid signal,每个跳跃链接的门控信号都会汇总来自多个成像比例的信息。

[0059]

s4.2在ram模块中的通过递归模块下采样输出的特征,其中递归模块中t表示递归卷积操作。发现当t=2的时候,检测的miou是最好的,它是由单个卷积层和两个后续递归卷积层组成的。

[0060]

优选地,步骤s5包括:在u

‑

net的编码部分,通过解码器使用反卷积层等网络层逐步恢复目标的细节和相应的空间维度,其中通过跳跃链接输出ram的特征与上采样的特征进行拼接,可以得到更加精细的特征,恢复更多的细节。

[0061]

优选地,步骤s6包括:迭代给定的次轮后,得到最优的裂纹检测的模型。

[0062]

进一步地,步骤s7包括:给定待测试的裂纹图像,输出裂纹检测后的图片。

[0063]

本发明还提供一种用于实现上述基于感知判别增强生成对抗网络的图像去雾方法的基于感知增强生成对抗网络的图像去雾装置,包括:

[0064]

样本采集模块,收集用于训练和测试的有裂纹的图片和标注的裂纹分割的ground truth图像;

[0065]

ram模块中包含有递归模块,用于通过所述递归模块输出相应的下采样特征信号;

分别输入u

‑

net的编码部分的l层特征信号和解码部分的l

‑

1层门控信号;分别输出u

‑

net的编码部分的下采样输出信号和通过门控信号关注显著区域的特征信号;构建u

‑

net的上采样模块,将关注显著区域的特征信号与原来上采样的特征信号拼接后进行上采样,得到裂纹检测图片;

[0066]

训练模块,输入有裂纹的图像和原始裂纹分割ground truth的图像训练模型,经过给定次数的训练后得到最优模型;

[0067]

测试模块,输入待测试的裂纹检测图像,输出分割后的裂纹检测的图像;

[0068]

实验采用公开的三个裂纹数据集crack500、gaps38和cfd数据集,其中crack500包含500个路面裂纹图像,大小约为2,000x1,500像素。由于数量有限,将每个图像裁剪为16个不重叠的图像区域,仅保留包含超过1000个像素的裂缝的区域。其中,训练数据1896张,验证数据348张,测试数据1124张。

[0069]

本发明与其他的裂纹检测算法对比,提供实验数据来表达本方法的有效性,对比实验结果的参数比较如图5所示,从表格实验数据可以看出,本发明方法均与对比方法相比获得了高的分数,即优于对比算法。

[0070]

上述根据本发明的方法可在硬件、固件中实现,或者被实现为可存储在记录介质(诸如cd

‑

rom、ram、软盘、硬盘或磁光盘)中的软件或计算机代码,或者被实现通过网络下载的原始存储在远程记录介质或非暂时机器可读介质中并将被存储在本地记录介质中的计算机代码,从而在此描述的方法可被存储在使用通用计算机、专用处理器或者可编程或专用硬件(诸如asic或fpga)的记录介质上的这样的软件处理。可以理解,计算机、处理器、微处理器控制器或可编程硬件包括可存储或接收软件或计算机代码的存储组件(例如,ram、rom、闪存等),当所述软件或计算机代码被计算机、处理器或硬件访问且执行时,实现在此描述的基于分层多尺度残差融合网络的人脸超分辨率方法。此外,当通用计算机访问用于实现在此示出的处理的代码时,代码的执行将通用计算机转换为用于执行在此示出的处理的专用计算机。

[0071]

需要指出,根据实施的需要,可将本申请中描述的各个步骤/部件拆分为更多步骤/部件,也可将两个或多个步骤/部件或者步骤/部件的部分操作组合成新的步骤/部件,以实现本发明的目的。

[0072]

本领域的技术人员容易理解,以上所述仅为本发明的较佳实施例而已,并不用以限制本发明,凡在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1