基于混合卷积的多级特征融合模型的视频动作识别方法及系统

1.本发明属于计算机视觉技术领域,涉及一种基于混合卷积的多级特征融合模型的视频动作识别方法及系统。

背景技术:

2.人工智能研究领域的飞速发展,促使人机交互技术逐渐渗透到人们的日常生活中,由此衍生的人体动作识别研究受到了广泛的关注。在基于视频的动作识别任务中,传统方法主要依靠于特定的特征设计来实现,具有严重的领域局限性。为克服上述缺陷,制取更具通用性的特征表示,基于生物视觉感知机制构建的卷积神经网络(convolutional neural networks,cnn)在动作识别领域中得到了大量应用。

3.模型关于人体动作识别性能的好坏与其对于视频的表征能力强弱息息相关,由于视频数据作为二维平面图像在三维时空里的顺序扩展,因此基于视频的特征提取过程被划分为空间外观表示与时序动态建模两部分,两者同等重要且互为补充。基于此,2d cnn模型虽然能有效捕捉输入视频帧的空间邻域相关性,但其受限于动态特征提取能力的不足,缺乏对于时间维度上肢体动作动态变化的关注,具有较多的局限性。进一步地,3d cnn得益于其固有的内在结构,在原始输入数据上直接进行时空特征的融合,具有先天的优势,但是3d cnn模型要求昂贵的计算成本与内存开销。因此为在计算速度与识别性能之间寻求一个更好的折衷,如何构造一个高性能的动作识别模型,充分结合二维卷积操作的低复杂性与三维卷积操作的有效性,无疑是一个值得探索的研究方向。

4.此外,考虑到对于视觉外观表现相似性较大的肢体动作,仅依据被观测目标在时空维度上的动态变化情况进行判别,易在分类过程中造成相似动作类别的混淆。为增加相似动作类别之间的区分性,模型应给予视觉节奏这一线索同等程度的关注。尽管在输入级上预先定义视觉节奏变化能够显著地提升模型识别效果,但由于涉及到多个网络分支的参数训练,导致模型复杂度大幅上升。研究人员证实,随着网络层数的加深,模型从不同深度的网络层中所导出的卷积特征已经包含了视觉节奏的快慢变化信息。因此,如何实现在特征级上建模视觉节奏的动态变化,也是一个重要的研究方向。

技术实现要素:

5.有鉴于此,本发明的目的在于提供一种基于混合卷积的多级特征融合模型的视频动作识别方法及系统。

6.为达到上述目的,本发明提供如下技术方案:

7.一方面,本发明提供一种基于混合卷积的多级特征融合模型的视频动作识别方法,包括以下步骤:

8.步骤一:采用二维卷积和可分离三维卷积构造混合卷积模块;

9.步骤二:沿着时间维度对各输入特征执行通道移位操作,构建时间移位模块,促进

相邻帧之间的信息流动,补偿二维卷积操作对动态特征进行捕捉的缺陷;

10.步骤三:从骨干网络的不同卷积层中导出多级互补特征,并对其进行空间调制与时间调制,从而使各层次特征在空间维度上具有一致的语义信息,在时间维度上具有多变的视觉节奏线索;

11.步骤四:通过构造自下而上的特征流和自顶向下的特征流,使各个特征之间相辅相成,互为补充,并对所述特征流进行并行处理,以实现多级特征融合;

12.步骤五:利用两阶段训练策略进行模型训练。

13.进一步,步骤一中所述混合卷积模块构造过程包括:遵循三维残差网络的基本架构,在残差网络底层结构中采用二维卷积操作提取低级空间特征,在网络顶层结构中采取可分离三维卷积操作提取高级时空特征,从而搭建为混合卷积网络,其中可分离三维卷积操作指将卷积核大小为t

×

h

×

w的三维卷积沿着时空维度进行分解,从而得到大小为t

×1×

1的时间卷积核和大小为1

×

h

×

w的空间卷积核,其中,t,h,w分别表示所述卷积核的时间维度、高度和宽度。

14.进一步,所述步骤二具体包括:

15.首先定义f

t

∈r

h

×

w

×

c

表示第t时刻的特征张量,h,w和c分别表示输入特征的高度、宽度和通道维度;所述时间移位模块在时间维度上对各时刻输入特征的部分通道信息进行移位操作,从而将相邻帧的空间语义信息融合到当前帧中,进而促进相邻帧之间的信息交互,其数学表示如下:

[0016][0017]

其中,表示将f

t

‑1的部分通道信息在时间维度上前移至t时刻,表示将f

t+1

的部分通道信息在时间维度上后移至t时刻,f

t0

表示f

t

中并未参与时间移位的通道信息;

[0018]

时间移位模块仅移动小部分通道来建模时间流动,单向通道移动比率设置为1/8,在所述时间移位模块中,移位操作仅发生在残差映射分支中,使原始空间语义信息仍能够被完整地传递到后续网络层中。

[0019]

进一步,所述步骤三具体包括以下步骤:

[0020]

首先定义多级特征融合模块的输入,收集m个不同深度的卷积层特征,表示为:

[0021]

f={f1,f2,

…

f

m

},

[0022]

其中,表示从某一深度网络层中所导出的卷积特征,i∈(1,m);

[0023]

引入时空调制过程如下:

[0024]

1)空间调制:对于网络顶层特征f

top

∈r

t

×

h

×

w

×

c

,空间调制相当于恒等映射,保留其原有尺寸;对于其余网络深度的卷积特征利用具有特定步长设计的二维卷积操作来削减各层次特征的空间尺寸大小,使其在空间维度上与网络顶层特征相匹配,即:其中,m

s

(

·

)表示空间调制操作;

[0025]

2)时间调制:首先将经过空间调制操作更新后的各个特征重新表示为然后对其在时间维度上进行下采样操作,其中下采样因子由一组精心设计的超参数决定,α

i

表示与深度级为i的特征相对应的下采样因子;对通道维度进行下采

样操作,下采样因子由参与特征导出的网络层个数n所决定,即:其中,m

t

(

·

)表示时间调制操作。

[0026]

进一步,步骤四所述的特征融合具体包括:

[0027]

表示经过时空调制后的卷积特征;对于不同深度级的特征,利用自下而上的特征流和自顶向下的特征流进行特征聚合;

[0028]

对于自下而上的特征流,从顶层特征开始,上一层级特征f'

i

利用元素级加法和下采样操作依次对下一层级特征f'

i+1

进行补充,即:

[0029][0030]

其中,f

″

i+1

表示经过自下而上流加聚后的特征,表示元素级加法,g(

·

)表示下采样操作,用于保证聚合期间各层特征的维度不发生冲突,t

i

/t

i

‑1为采样因子;

[0031]

对于自顶向下的特征流,从底层特征开始,下一层级特征f

′

i+1

依次丰富上一层级特征f

i

'的空间语义信息,即:

[0032][0033]

其中,f

i

'为自顶向下流加聚后的特征,f(

·

)表示上采样操作,t

i

/t

i

‑1为采样因子;

[0034]

对上述两种特征流进行融合,即通过同时处理两条并行的特征流,生成最终的分类判别特征,然后利用softmax函数得到由多层级融合特征产生的分类预测结果。

[0035]

进一步,步骤五所述的两阶段训练策略的具体为:在第一阶段,首先针对骨干网络进行训练,然后固定骨干网络部分的参数,单独训练后续的多级特征融合模块;在第二阶段,利用第一阶段所学习到的权重初始化多级特征融合模块,再通过端到端的训练范式对整个模型进行联合训练。

[0036]

另一方面,本发明提供一种基于混合卷积的多级特征融合的视频动作识别系统,包括混合卷积模块、时间移位模块、多级特征融合模块及两阶段训练策略模块;

[0037]

所述混合卷积模块为遵循三维残差网络的基本架构,在残差网络底层结构中采用二维卷积操作提取低级空间特征,在网络顶层结构中采取可分离三维卷积操作提取高级时空特征,从而搭建为混合卷积网络,其中可分离三维卷积操作指将卷积核大小为t

×

h

×

w的三维卷积沿着时空维度进行分解,从而得到大小为t

×1×

1的时间卷积核和大小为1

×

h

×

w的空间卷积核,其中,t,h,w分别表示所述卷积核的时间维度、高度和宽度;

[0038]

所述时间移位模块用于沿着时间维度对各时刻输入特征的部分通道信息进行移位操作,补偿二维卷积缺乏动态特征提取能力的缺陷;

[0039]

所述多级特征融合模块用于从骨干网络不同深度的卷积层中导出多级互补特征,然后利用空间调制操作促使各个特征在空间维度上具有相同的形状,利用时间调制操作捕获动作实例的视觉节奏动态变化情况,最后通过特征融合制取高质量的分类判别特征;

[0040]

所述两阶段训练策略模块用于分阶段进行模型训练,最大化利用有限的视频数据。

[0041]

本发明的有益效果在于:本发明利用混合卷积模块结合了二维卷积操作的低复杂性和可分离三维卷积操作的高效性的优势,显著降低了模型复杂度,在计算速度与识别性能之间寻求了一个更好的折衷;使用低成本的时间移位模块模拟短期时间尺度上肢体动作

的动态变化,一定程度上补偿了二维卷积操作所缺乏的动态特征提取能力;使用多级特征融合模块实现了对于多深度特征的有效融合,在充分利用各层次特征视觉信息的情况下有效地表征了动作实例的视觉节奏变化。

[0042]

本发明的其他优点、目标和特征在某种程度上将在随后的说明书中进行阐述,并且在某种程度上,基于对下文的考察研究对本领域技术人员而言将是显而易见的,或者可以从本发明的实践中得到教导。本发明的目标和其他优点可以通过下面的说明书来实现和获得。

附图说明

[0043]

为了使本发明的目的、技术方案和优点更加清楚,下面将结合附图对本发明作优选的详细描述,其中:

[0044]

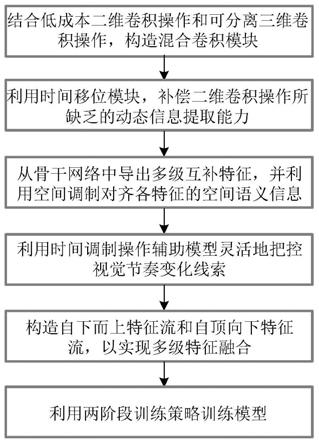

图1为本发明所述基于混合卷积的多级特征融合模型的视频动作识别方法步骤图;

[0045]

图2为本发明所述基于混合卷积的多级特征融合模型的视频动作识别系统模型图;

[0046]

图3为混合卷积模块示意图;

[0047]

图4为时间移位模块示意图;

[0048]

图5为多级特征融合模块示意图。

具体实施方式

[0049]

以下通过特定的具体实例说明本发明的实施方式,本领域技术人员可由本说明书所揭露的内容轻易地了解本发明的其他优点与功效。本发明还可以通过另外不同的具体实施方式加以实施或应用,本说明书中的各项细节也可以基于不同观点与应用,在没有背离本发明的精神下进行各种修饰或改变。需要说明的是,以下实施例中所提供的图示仅以示意方式说明本发明的基本构想,在不冲突的情况下,以下实施例及实施例中的特征可以相互组合。

[0050]

其中,附图仅用于示例性说明,表示的仅是示意图,而非实物图,不能理解为对本发明的限制;为了更好地说明本发明的实施例,附图某些部件会有省略、放大或缩小,并不代表实际产品的尺寸;对本领域技术人员来说,附图中某些公知结构及其说明可能省略是可以理解的。

[0051]

本发明实施例的附图中相同或相似的标号对应相同或相似的部件;在本发明的描述中,需要理解的是,若有术语“上”、“下”、“左”、“右”、“前”、“后”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此附图中描述位置关系的用语仅用于示例性说明,不能理解为对本发明的限制,对于本领域的普通技术人员而言,可以根据具体情况理解上述术语的具体含义。

[0052]

如图1所示,本发明提供一种基于混合卷积的多级特征融合的视频动作识别方法,包括以下步骤:

[0053]

步骤一:在网络底层采用低成本的二维卷积操作,而在网络顶层采用可分离三维

卷积操作,从而构造混合卷积模块,旨在削减全三维卷积模型的冗余度;

[0054]

混合卷积模块的构造过程为:遵循三维残差网络的基本架构,在残差网络底层结构中利用二维卷积操作提取空间维度上的表观细节特征,以弱化低层次时空语义信息,而在网络顶层结构中保留三维卷积结构以提取高级时空特征,从而强调更为抽象的时空语义线索。为进一步减少模型计算复杂度,将网络顶层结构中所涉及的三维卷积替换为可分离三维卷积,具体表现为将大小为t

×

h

×

w的三维卷积核沿着时空维度进行分解,从而得到大小为t

×1×

1的时间卷积核和大小为1

×

h

×

w的空间卷积核,其中,t,h,w分别表示所述卷积核的时间维度、高度和宽度。

[0055]

步骤二:沿着时间维度对各输入特征执行通道移位操作,构建时间移位模块,从而促进相邻帧之间的信息流动,以补偿二维卷积操作所缺乏的动态特征提取能力;

[0056]

首先定义f

t

∈r

h

×

w

×

c

表示第t时刻的特征张量,h,w和c分别表示输入特征的高度、宽度和通道维度。时间移位模块在时间维度上对各时刻输入特征的部分通道信息进行移位操作,从而将相邻帧的空间语义信息融合到当前帧中,进而促进相邻帧之间的信息交互。其数学表示如下:

[0057][0058]

其中,表示将f

t

‑1的部分通道信息在时间维度上前移至t时刻,表示将f

t+1

的部分通道信息在时间维度上后移至t时刻,f

t0

表示f

t

中并未参与时间移位的通道信息。

[0059]

此外,为避免大面积地移动通道信息导致模型空间建模能力被破坏,进而引发模型性能衰减。因此,时间移位模块仅移动了小部分通道来建模时间流动,单向通道移动比率通常设置为1/8。为进一步保留模型的空间特征学习能力,在所采用时间移位模块中,移位操作仅发生在残差映射分支中,从而原始空间语义信息仍然能够被完整的传递到后续网络层中。

[0060]

步骤三:从骨干网络的不同卷积层中导出多级互补特征,并对其进行空间调制与时间调制,从而使各层次特征在空间维度上具有一致的语义信息,在时间维度上具有多变的视觉节奏线索;

[0061]

首先,定义多级特征融合模块的输入。为充分利用各层次卷积特征的视觉信息,收集了m个不同深度的卷积层特征,表示为:

[0062]

f={f1,f2,

…

f

m

},

[0063]

其中,表示从某一深度网络层中所导出的卷积特征,i∈(1,m)。为确保特征的有效融合,引入了时空调制。详细介绍过程如下:

[0064]

1)空间调制。一方面,对于网络顶层特征f

top

∈r

t

×

h

×

w

×

c

,空间调制相当于恒等映射,保留了其原有尺寸。另一方面,对于其余网络深度的卷积特征利用具有特定步长设计的二维卷积操作来削减各层次特征的空间尺寸大小,使其在空间维度上与网络顶层特征相匹配,即:其中,m

s

(

·

)表示空间调制操作。

[0065]

2)时间调制。首先将经过空间调制操作更新后的各个特征重新表示为然后对其在时间维度上进行下采样操作,其中下采样因子由一组精心设计的

超参数决定,α

i

表示与深度级为i的特征相对应的下采样因子。此外,为方便后续特征执行聚合操作,通道维度也需要进行下采样操作,下采样因子由参与特征导出的网络层个数n所决定。即:其中,m

t

(

·

)表示时间调制操作。

[0066]

步骤四:通过构造自下而上的特征流和自顶向下的特征流,使各个特征之间相辅相成,互为补充,并对所述特征流进行并行处理,以实现多级特征融合;

[0067]

定义表示经过时空调制后的卷积特征。考虑到低层次特征的时间感受野范围较小,而高层次特征又缺乏对于局部细节的描述,因此对于不同深度级的特征,研究利用自下而上的特征流和自顶向下的特征流进行特征聚合,使各层次特征相辅相成,互为补充。接下来,详细地介绍了所采用的特征聚合方法。

[0068]

对于自下而上的特征流,从顶层特征开始,上一层级特征f'

i

利用元素级加法和下采样操作依次对下一层级特征f'

i+1

进行补充,即:

[0069][0070]

其中,f

″

i+1

表示经过自下而上流加聚后的特征,表示元素级加法,g(

·

)表示下采样操作,用于保证聚合期间各层特征的维度不发生冲突,t

i

/t

i

‑1为采样因子;

[0071]

对于自顶向下的特征流,从底层特征开始,下一层级特征f

′

i+1

依次丰富上一层级特征f

i

'的空间语义信息,即:

[0072][0073]

其中,f

i

'为自顶向下流加聚后的特征,f(

·

)表示上采样操作,t

i

/t

i

‑1为采样因子。

[0074]

为执行后续的分类预测,需要对上述两种特征流进行融合,即通过同时处理两条并行的特征流,生成最终的分类判别特征,然后利用softmax函数得到由多层级融合特征产生的分类预测结果。

[0075]

步骤五:利用两阶段训练策略进行模型训练,以进一步改进模型性能;

[0076]

模型主要包括两部分,一方面为混合卷积模块辅以时间移位模块所构成的骨干网络,另一方面为多级特征融合模块。模型所采用训练方式如下:在第一阶段,先对骨干网络进行训练,然后固定骨干网络参数,训练多级特征融合模块;在第二阶段,利用第一阶段的预训练权重初始化多级特征融合模块,然后通过端到端的训练范式对整个模型进行训练。通过两阶段训练策略执行模型训练,可以最大化地利用有限的训练集数据,进一步提升模型的识别效果。

[0077]

图2为本发明的系统模型图,下面结合附图进行说明,包括以下几个模块:

[0078]

模块一:通过在网络底层结构中采用低成本二维卷积操作提取低级空间特征,在网络顶层结构中采取可分离三维卷积操作制取高级时空特征,结合了二维卷积操作的低复杂性和可分离三维卷积操作的高效性的优势,从而构造混合卷积模块;

[0079]

模块二:通过引入时间移位模块,沿着时间维度对各时刻输入特征的部分通道信息进行移位操作,以补偿二维卷积缺乏动态特征提取能力的缺陷;

[0080]

模块三:利用多级特征融合模块从骨干网络不同深度的卷积层中导出多级互补特征,然后利用空间调制操作促使各个特征在空间维度上具有相同的形状,利用时间调制操

作捕获动作实例的视觉节奏动态变化情况,最后通过有效的特征融合制取高质量的分类判别特征;

[0081]

模块四:使用两阶段训练策略分阶段进行模型训练,从而最大化地利用有限的视频数据,进一步改进模型性能。

[0082]

图3为混合卷积模块示意图,图解详细给出了混合卷积的排列情况及与之相对应的卷积核大小。

[0083]

图4为时间移位模块示意图,输入特征经过时间维度上的通道移位操作后,将相邻帧的空间语义信息与当前帧进行融合,促进了相邻帧之间的时间信息流动。

[0084]

图5为多级特征融合模块示意图,输入特征集合经过空间调制操作、时间调制操作和特征融合操作后,得到了最终的分类判别特征。

[0085]

可选的,模块一具体包括:

[0086]

混合卷积模块。如图3所示,混合卷积模块的构造过程为:遵循三维残差网络的基本架构,在残差网络底层结构中利用二维卷积操作提取空间维度上的表观细节特征,以弱化低层次时空语义信息,而在网络顶层结构中保留三维卷积结构以提取高级时空特征,从而强调更为抽象的时空语义线索。为进一步减少模型计算复杂度,将网络顶层结构中所涉及的三维卷积替换为可分离三维卷积,具体表现为将大小为t

×

h

×

w的三维卷积核沿着时空维度进行分解,从而得到大小为t

×1×

1的时间卷积核和大小为1

×

h

×

w的空间卷积核,其中,t,h,w分别表示所述卷积核的时间维度、高度和宽度。

[0087]

可选的,模块二具体包括:

[0088]

时间移位模块。如图4所示,首先定义f

t

∈r

h

×

w

×

c

表示第t时刻的特征张量,h,w和c分别表示输入特征的高度、宽度和通道维度。时间移位模块在时间维度上对各时刻输入特征的部分通道信息进行移位操作,从而将相邻帧的空间语义信息融合到当前帧中,进而促进相邻帧之间的信息交互。其数学表示如下:

[0089][0090]

其中,表示将f

t

‑1的部分通道信息在时间维度上前移至t时刻,表示将f

t+1

的部分通道信息在时间维度上后移至t时刻,f

t0

表示f

t

中并未参与时间移位的通道信息。

[0091]

此外,为避免大面积地移动通道信息导致模型空间建模能力被破坏,进而引发模型性能衰减。因此,时间移位模块仅移动了小部分通道来建模时间流动,单向通道移动比率通常设置为1/8。为进一步保留模型的空间特征学习能力,在所采用时间移位模块中,移位操作仅发生在残差映射分支中,从而原始空间语义信息仍然能够被完整的传递到后续网络层中。

[0092]

可选的,模块三具体包括:

[0093]

多级特征融合模块。如图5所示,首先,定义多级特征融合模块的输入。为充分利用各层次卷积特征的视觉信息,收集了m个不同深度的卷积层特征,表示为:

[0094]

f={f1,f2,

…

f

m

},

[0095]

其中,表示从某一深度网络层中所导出的卷积特征,i∈(1,m)。为确保特征的有效融合,引入了时空调制。详细介绍过程如下:

[0096]

1)空间调制。一方面,对于网络顶层特征f

top

∈r

t

×

h

×

w

×

c

,空间调制相当于恒等映

射,保留了其原有尺寸。另一方面,对于其余网络深度的卷积特征利用具有特定步长设计的二维卷积操作来削减各层次特征的空间尺寸大小,使其在空间维度上与网络顶层特征相匹配,即:其中,m

s

(

·

)表示空间调制操作。

[0097]

2)时间调制。首先将经过空间调制操作更新后的各个特征重新表示为然后对其在时间维度上进行下采样操作,其中下采样因子由一组精心设计的超参数决定,α

i

表示与深度级为i的特征相对应的下采样因子。此外,为方便后续特征执行聚合操作,通道维度也需要进行下采样操作,下采样因子由参与特征导出的网络层个数n所决定。即:其中,m

t

(

·

)表示时间调制操作。

[0098]

特征融合。定义表示经过时空调制后的卷积特征。考虑到低层次特征的时间感受野范围较小,而高层次特征又缺乏对于局部细节的描述,因此对于不同深度级的特征,研究利用自下而上的特征流和自顶向下的特征流进行特征聚合,使各层次特征相辅相成,互为补充。接下来,详细地介绍了所采用的特征聚合方法。

[0099]

对于自下而上的特征流,从顶层特征开始,上一层级特征f'

i

利用元素级加法和下采样操作依次对下一层级特征f

″

i+1

进行补充,即:

[0100][0101]

其中,f

″

i+1

表示经过自下而上流加聚后的特征,表示元素级加法,g(

·

)表示下采样操作,用于保证聚合期间各层特征的维度不发生冲突,t

i

/t

i

‑1为采样因子;

[0102]

对于自顶向下的特征流,从底层特征开始,下一层级特征f

′

i+1

依次丰富上一层级特征f

i

'的空间语义信息,即:

[0103][0104]

其中,f

i

'为自顶向下流加聚后的特征,f(

·

)表示上采样操作,t

i

/t

i

‑1为采样因子。

[0105]

为执行后续的分类预测,需要对上述两种特征流进行融合,即通过同时处理两条并行的特征流,生成最终的分类判别特征,然后利用softmax函数得到由多层级融合特征产生的分类预测结果。

[0106]

可选的,模块四具体包括:

[0107]

两阶段训练策略模块。模型主要包括两部分,一方面为混合卷积模块辅以时间移位模块所构成的骨干网络,另一方面为多级特征融合模块。模型所采用训练方式如下:在第一阶段,先对骨干网络进行训练,然后固定骨干网络参数,训练多级特征融合模块;在第二阶段,利用第一阶段的预训练权重初始化多级特征融合模块,然后通过端到端的训练范式对整个模型进行训练。通过两阶段训练策略执行模型训练,可以最大化地利用有限的训练集数据,进一步提升模型的识别效果。最后说明的是,以上实施例仅用以说明本发明的技术方案而非限制,尽管参照较佳实施例对本发明进行了详细说明,本领域的普通技术人员应当理解,可以对本发明的技术方案进行修改或者等同替换,而不脱离本技术方案的宗旨和范围,其均应涵盖在本发明的权利要求范围当中。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1