一种用于电力系统平衡截断的RNN降阶方法

本发明涉及电力系统降阶领域,具体涉及一种用于电力系统平衡截断的rnn降阶方法。

背景技术:

1、在电力系统降阶领域,平衡截断法因其对输入输出特性的高精度保留而被广泛应用,但其计算速度受制于lyapunov方程的求解效率(朱泽翔.电力系统动态参数辨识与模型降阶研究[d].浙江大学,2018.)。多年来,许多数值方法被提出以高效地求解lyapunov方程,譬如经典的bartels-stewart方法(bartels r.,stewart g.(1972).solution of theequation a x+x b=c.comm acm,15(9),820–826.doi:10.1145/361573.361582)、最小残差方法(lin y.,simoncini v.(2013)minimal residual methods for large scalelyapunov equations.appl.numer.math.,72,52–71.doi:10.1016/j.apnum.2013.04.004)、低秩迭代法(stykel t.(2008).low-rank iterative methodsfor projected generalized lyapunov equations.electron.trans.numer.anal.,30(1),187–202.doi:10.1080/14689360802423530)等。然而,这些串行算法可能难以满足大规模系统的实时计算需求。

2、近年来,由于并行处理能力和易于硬件实现的特点,循环神经网络(rnn)得到了很大发展,在实时性方面相较传统数值算法有更大的优势。因此rnn也被提出并设计用于求解lyapunov方程。用于求解lyapunov方程的rnn主要包括梯度神经网络(gnn)和张氏神经网络(znn)。

3、不少学者通过提高rnn模型的收敛性来提高lyapunov的求解效率(yi c.,cheny.,lu z.(2011).improved gradient-based neural networks for online solution oflyapunov matrix equation.inform.process.lett.,111(16),780–786.doi:10.1016/j.ipl.2011.05.010,yi c.,chen y.,lan x.(2013).comparison on neural solvers forthe lyapunov matrix equation with stationary&nonstationarycoeffificients.appl.math.model.,37(4),2495–2502.doi:10.1016/j.apm.2012.06.022,xiao l.,liao b.(2016).a convergence-accelerated zhangneural network and its solution application to lyapunov equation,neurocomputing,193,213–218.doi:10.1016/j.neucom.2016.02.021,xiao l.,zhang y.,hu z.,dai j.(2019).performance benefits of robust nonlinear zeroing neuralnetwork for finding accurate solution of lyapunov equation in presence ofvarious noises.ieee trans.ind.inf.,15(9),5161-5171.doi:10.1109/tii.2019.2900659),而事实上,rnn模型的降阶也是提高rnn性能的有效途径。

技术实现思路

1、针对rnn模型的规模问题,本发明利用全阶循环神经网络的对称性,提出一种用于电力系统平衡截断的rnn降阶方法。相比全阶模型,该降阶模型能降低软件仿真的内存需求,也能减小硬件电路的器件和接线数量、减小硬件体积、降低硬件故障率。

2、本发明的目的至少通过如下技术方案之一实现。

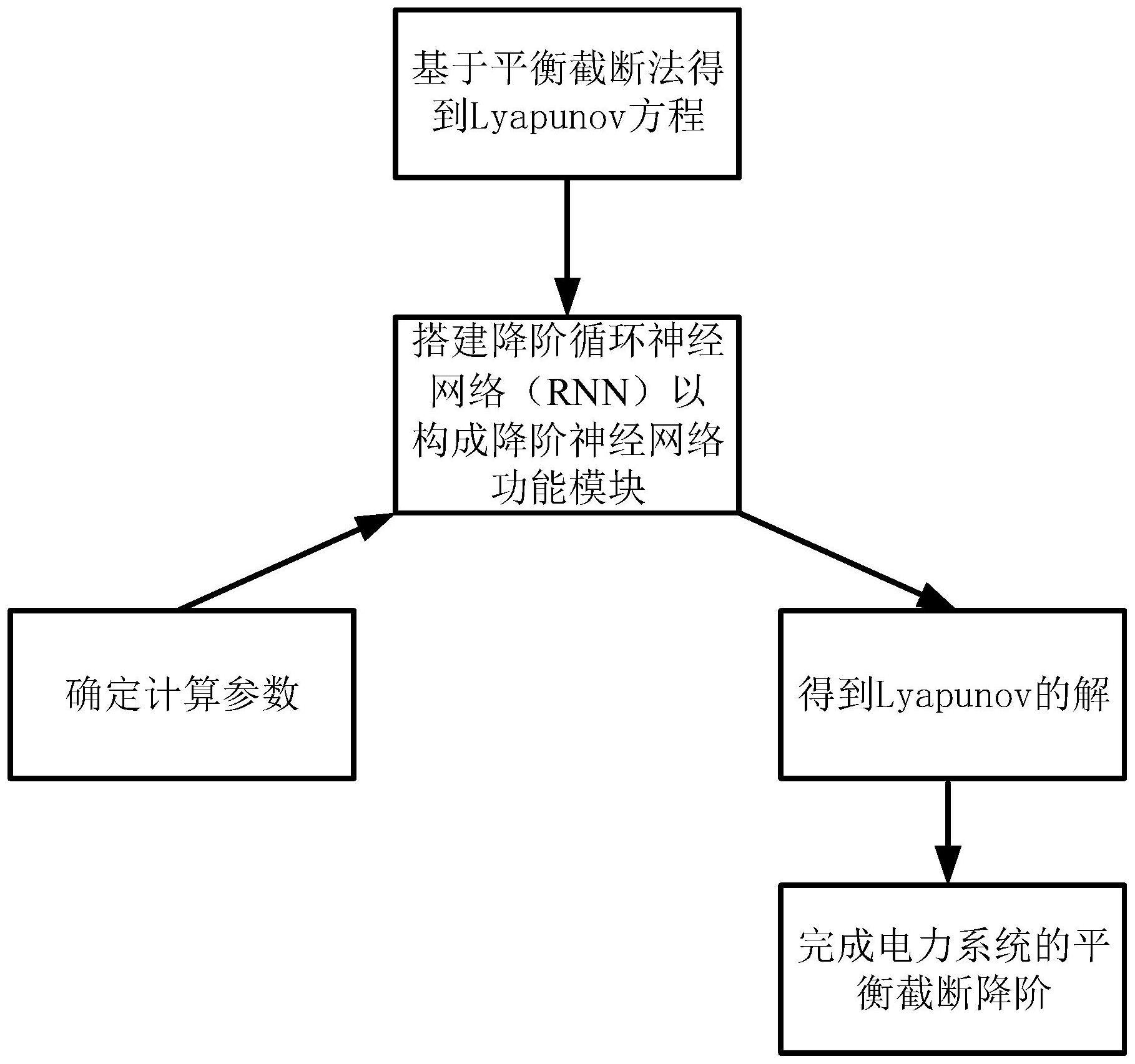

3、一种用于电力系统平衡截断的rnn降阶方法,包括以下步骤:

4、s1、基于平衡截断法原理得到电力系统的lyapunov方程;

5、s2、搭建降阶循环神经网络(rnn)以构成降阶神经网络功能模块;

6、s3、确定计算参数并驱动降阶神经网络功能模块而得到lyapunov方程的解;

7、s4、基于所得lyapunov方程的解,完成电力系统的平衡截断降阶。

8、进一步地,步骤s1具体如下:

9、s1.1、电力系统模型可采用如下微分代数方程组表示:

10、

11、其中,xo和分别表示系统内部的状态变量及其微分量,表示系统内部的代数变量,u表示系统的输入变量,yo表示系统的输出变量,f、g和h分别是电力系统模型的状态变量、代数变量以及输入变量的非线性函数,t表示时间,n表示状态变量及其微分量的维数,s、m、p分别表示代数变量、输入变量和输出变量的维数,表示实数域;

12、s1.2、将公式(1)在平衡点处线性化,得到:

13、

14、其中,a0、b0、c0均为线性化系统的常数矩阵;xo表示系统内部的状态变量,u表示系统的输入变量,yo表示系统的输出变量,δxo一般包括线性化的发电机转子角、发电机角频率及动态元件的状态量,δu和δyo需要根据具体研究对象来确定;

15、s1.3、基于平衡截断法原理得到电力系统的lyapunov方程:

16、

17、其中,x、g分别为可控性矩阵和可观性矩阵。

18、进一步地,步骤s2具体如下:

19、s2.1、对于可控性矩阵,lyapunov方程如下:

20、atx(t)+x(t)a=-q (4)

21、其中,是常系数的稳定矩阵,是常系数对称正定矩阵,是可控性lyapunov方程的解,且a0=at,q=b0b0t;

22、对于可观性矩阵,lyapunov方程如下:

23、ag(t)+g(t)at=-w (5)

24、其中,是常系数对称正定矩阵且w=c0tc0,是可观性lyapunov方程的解;

25、s2.2、构建矢量化的全阶循环神经网络模型;由于降阶循环神经网络(rnn)主要包括梯度神经网络(gnn)和张氏神经网络(znn),分别根据两者的定义构建模型;

26、为便于求解降阶循环神经网络(rnn)模型,需要对其进行矢量化运算;

27、s2.3、构造用于指导降阶的索引矩阵s,

28、s2.4、列降阶;

29、s2.5、行降阶。

30、进一步地,步骤s2.2中,对于可控性矩阵,若采用梯度神经网络(gnn),则所构造的用于求解lyapunov方程的模型为:

31、

32、其中,γ是大于0的常数,是x(t)关于时间的导数,表示梯度神经网络(gnn)的激活函数;

33、若采用张氏神经网络(znn),则所构造的模型为:

34、

35、其中,是张氏神经网络(znn)的激活函数;

36、同理,对于可观性矩阵,其梯度神经网络(gnn)模型为:

37、

38、其张氏神经网络(znn)模型为:

39、

40、对于可控性矩阵,矢量化后的梯度神经网络(gnn)模型为:

41、

42、其中,表示克罗内克积运算,i表示n阶单位矩阵,vec(x(t))=[x11(t),…,x1n(t),x21(t),…,xn1(t),…,xnn(t)]t,vec(q)=[q11,…,q1n,q21,…,qn1,…,qnn]t,式中的qij表示矩阵q的元素;

43、矢量化后的张氏神经网络(znn)模型为:

44、

45、对于可观性矩阵,矢量化后的梯度神经网络(gnn)模型为:

46、

47、矢量化后的梯度神经网络(gnn)模型为:

48、

49、式(10)-式(13)即为矢量化的全阶循环神经网络模型;

50、进一步地,步骤s2.3中,用于指导降阶的索引矩阵s具体如下:

51、

52、s中的每个元素都是a中相同位置的元素的索引号,矩阵s中处于对称位置的索引可构成n(n-1)/2个索引对,索引对中的两个元素分别来自矩阵的上三角和下三角;可以把上三角的元素放到向量l中,不含对角线元素;把下三角的元素放到向量n中,不含对角线元素。

53、进一步地,步骤s2.4中,列降阶具体如下:

54、对于可控性矩阵的矢量化梯度神经网络(gnn),根据n的指导,将式(10)的vecx(t)和对应的行删掉,然后根据l和n的指导,把的处于对称位置的两列进行求和、得到的新的列替换索引对中上三角元素对应的列,而下三角元素对应的列则删去;而对于可控性矩阵的矢量化张氏神经网络(znn),对式(11)进行同样的操作即可完成列降阶;

55、对于可观性矩阵的矢量化梯度神经网络(gnn),根据n的指导,将式(12)的vecg(t)和对应的行删掉,然后根据l和n的指导,把的处于对称位置的两列进行求和、得到的新的列替换索引对中上三角元素对应的列,而下三角元素对应的列则删去;而对于可观性矩阵的矢量化张氏神经网络(znn),对式(13)进行同样的操作即可完成列降阶。

56、进一步地,步骤s2.5中,行降阶具体如下:

57、对于可控性矩阵的矢量化梯度神经网络(gnn),根据n的指导,将列降阶后的和式(10)的vecq对应的行删掉,再将列降阶和行降阶后的进行转置、就得到了降阶后的而对于可控性矩阵的矢量化张氏神经网络(znn),执行同样的操作即可完成行降阶;

58、于是,通过降阶方法,将式(10)和式(11)分别变为如下的降阶梯度神经网络(gnn)、降阶张氏神经网络(znn):

59、

60、

61、其中,vecxr(t)=[x1,…,x0.5(n+1)n]t,矩阵和vecxr(t)分别是降阶后的和vecx(t),矩阵就是降阶后的vecqr=[q1,…,q0.5(n+1)n]t,矩阵vecqr是降阶后的vecq,和分别表示和vecxr(t)的第i个元素,kij是矩阵k的第i行第j列的元素,qi表示vecqr的第i个元素。

62、进一步地,对于可观性矩阵的矢量化梯度神经网络(gnn),根据n的指导,将列降阶后的和式(12)的vecw对应的行删掉,再将列降阶和行降阶后的进行转置、就得到了降阶后的而对于可观性矩阵的矢量化张氏神经网络(znn),执行同样的操作即可完成行降阶;

63、于是,通过降阶方法,将式(12)和式(13)分别变为如下的降阶梯度神经网络(gnn)、降阶张氏神经网络(znn):

64、

65、

66、其中,vecgr(t)=[g1,…,g0.5(n+1)n]t,矩阵和vecgr(t)分别是降阶后的和vecg(t),矩阵et∈就是降阶后的vecwr=[w1,…,w0.5(n+1)n]t,矩阵vecwr是降阶后的vecw,和分别表示和vecgr(t)的第i个元素,eij是矩阵e第i行第j列的元素,wi表示vecwr的第i个元素。

67、式(15)-式(18)即为矢量化的降阶循环神经网络模型,是搭建降阶神经网络功能模块的关键。

68、降阶神经网络功能模块的具体形式可以是软件算法,也可以是硬件电路。采用软件算法搭建降阶神经网络功能模块,就是根据式(15-18)构建微分方程组模型。采用硬件电路搭建降阶神经网络功能模块,则是根据式(15-18),通过积分器、加法器、乘法器等搭建电路模型。图2显示的就是全阶gnn硬件电路模型,若把n2换成0.5(n+1)n,则图2表示的就是式(15)对应的降阶gnn硬件电路模型。

69、进一步地,步骤s3具体如下:

70、s3.1、设置解向量的初值、激活函数和模型参数γ;

71、s3.2、驱动降阶神经网络功能模块而得到lyapunov方程的解。

72、进一步地,步骤s4具体如下:

73、s4.1、原系统可控性矩阵x与其平衡系统可控性矩阵的关系为:

74、

75、原系统可观性矩阵g与其平衡系统可观性矩阵的关系为:

76、

77、其中,t为gramian平衡变换矩阵;

78、s4.2、平衡截断降阶系统表示为:

79、

80、δxr=rtδxo表示降阶系统的状态变量,表示降阶系统状态变量的微分;ar=rta0t-1rt,br=rtb0,cr=c0t-1rt,r为galerkin投影矩阵;

81、因此,根据步骤s3所得的x和g,可得降阶系统模型。

82、本发明相对于现有技术,具有如下的优点及效果:

83、1、本发明首次利用全阶循环神经网络的对称性,提出一种用于电力系统平衡截断的rnn降阶方法。

84、2、相比全阶模型,该降阶模型能降低软件仿真的内存需求,也能减小硬件电路的器件和接线数量、减小硬件体积、降低硬件故障率。

- 还没有人留言评论。精彩留言会获得点赞!