一种拥有发丝级细节的单图像超分辨率重建方法

本发明涉及单图像超分辨率,具体为一种拥有发丝级细节的单图像超分辨率重建方法。

背景技术:

1、随着手机和平板电脑等移动设备的迅速发展,人们已经不再满足于对低质量图片的浏览,而更加倾向于浏览视觉效果更好的高分辨率图像。同时随着网络技术的逐步发展,如今大多数电子设备已可以支持接收和显示超高分辨率图像。但由于图片在采集、传输、和储存的过程中,很容易被引入失真。因此,对单图像超分辨率重建成为了当今计算机视觉中一个重要的研究课题。同时由于在实际应用中,人们在互联网上浏览的图像都是没有原始图像作为参考的,这就促进了盲图像超分辨率重建领域的发展。

2、通常,失真包括自然的真实失真和人工的合成失真。真实失真是在拍摄过程中由于曝光不足、过度曝光或欠曝、拍摄者运动导致的模糊以及压缩误差等自然失真的混合。合成失真是指由人工添加的诸如白噪声、高斯模糊、jpeg2000、椒盐噪声、全局对比度降低等引起的失真。无论是真实失真还是合成失真都广泛的出现在图像中。因此,能发明一种可以对任意失真类型的图像,都能进行超分辨率重建的方法具有重大意义。

3、现有技术方案1:刘若鹏,一种超分辨率重建方法,2020。

4、本发明提供了一种超分辨率重建方法,所述方法包括:建立图片数据集;搭建神经网络结构,所述神经网络结构用于在神经网络训练过程中提取所述图片数据集的特征;建立神经网络结构的损失函数,所述损失函数用于指导神经网络训练;对所述图片数据集进行训练得到神经网络模型;使用神经网络模型重建图片,输入低分辨率图片,输出高分辨率图片。将srgan(super-resolution generative adversarial network)进行了改进,其中将生成网络g-net改变了网络结构,改进了损失函数,由于改进后,生成网络g-net提取出更精确的特征,使得超分辨率重建的效果更优,所以在做检测、识别、语义分割时候,可以获得更好效果。

5、现有技术方案2:李冀翔,一种图像超分辨率重建方法,2020。

6、本发明公开一种图像超分辨率重建方法,其包括以下步骤:将低分辨特征空间和高分辨特征空间构造成多个成对设置的低分辨特征子空间和高分辨特征子空间;在成对设置的低分辨特征子空间和高分辨特征子空间之间建立线性映射关系;根据线性映射关系将低分辨率重构图像重构成高分辨率重构图像。采用本发明图像超分辨率重建方法能够快速的获得高质量的高分辨率图像。

7、现有技术方案3:常侃,基于重建的图像超分辨率方法,2019。

8、本技术公开了一种基于重建的图像超分辨率方法,包括:a、对低分辨率lr图像y,生成初始hr图像x0,并将初始hr图像作为最近一次重建的hr图像x';b、在最近一次重建的hr图像x'上,为每个图像块计算引导核,并由此建立相应的同质像素提取矩阵;在最近一次重建的hr图像x'上,为每个图像块利用同质像素提取矩阵进行自适应形状的块匹配,并计算第i个图像块的相似图像块组的预测值;采用最近一次重建的hr图像x'以及预先训练好的去噪器计算hr图像的梯度预测值;e、确定当前次重建的hr图像x,若未达到迭代次数上限,则将当前次重建的hr图像x作为最近一次重建的hr图像x'返回到步骤b,否则,将当前次重建的hr图像x进行保存或输出。应用本技术,能够提高超分辨率的性能。

9、对于现有技术方案1,该方案存在的缺点是:尽管使用gan能够给图像带来不错的视觉效果,但gan往往会给图像带来伪影,使得生成的图像保真度不高。

10、对于现有技术方案2、3,该方案存在的缺点是:这两种方法均没有考虑图像内部的全局信息,并且不使用gan的方法往往生成的图像会过于模糊、平滑。

11、综上,我们提出了一种拥有发丝级细节的单图像超分辨率重建方法。

技术实现思路

1、(一)解决的技术问题

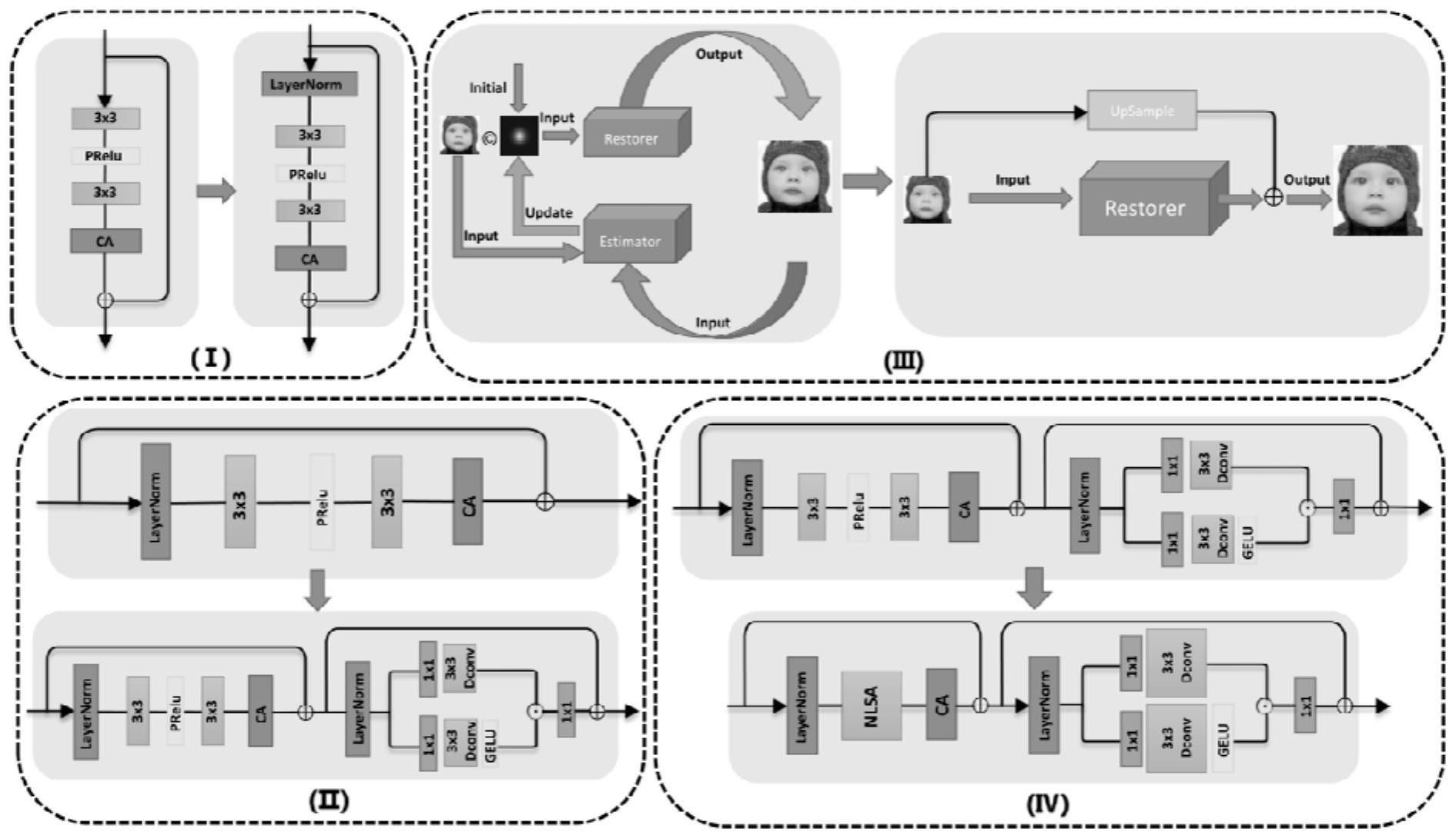

2、针对现有技术的不足,本发明提供了一种拥有发丝级细节的单图像超分辨率重建方法,首先引入了一个非局部注意机制,通过对整个图像区域的学习来恢复局部片段。然后,我们发现,现有的方法对于模糊核的使用和估计是没有必要的。基于这一发现,我们创建了一个双分支的网络结构,将非局部注意力机制和深度可分离卷积结合起来,但由于两者均没有考虑通道间的信息交互,因此,我们在双分支后接上通道注意力机制,以获得通道间的信息交互。

3、(二)技术方案

4、为实现上述所述目的,本发明提供如下技术方案:一种拥有发丝级细节的单图像超分辨率重建方法,包括以下步骤:

5、第一步:对通道上的特征图进行layernorm操作;

6、第二步:增加门控dconv前馈网络模块,移除估计模糊核模块,并增加了双三次插值的上采样;

7、第三步:引入非局部注意机制,通过对整个图像区域的学习来恢复局部片段;

8、第四步:创建双分支的网络结构,将非局部注意力机制和深度可分离卷积结合起来;

9、第五步:采用上述网络为生成器,将带有光谱归一化的u-net判别器作为判别器,用l1损失训练一个面向psnr的模型。然后,我们将训练好的面向psnr的模型作为生成器,用l1损失、感知损失和对抗性损失的组合来训练面向gan的模型,网络的总损失表示如下:

10、ltotal=l1+lperc+0.1×ladv;

11、其中l1、lperc和ladv分别代表l1损失、感知损失和对抗性损失;

12、第六步:将权重分别设定为1、1和0.1,使用预训练的vgg19把激活函数前的conv1,...,conv5特征图作为感知损失;

13、第七步:对图像退化的过程描述如下:

14、

15、其中ilr表示低分辨率图像,ihr表示高分辨率图像,表示卷积运算,k代表模糊核,↓bic表示双三次下采样,n表示加性高斯白噪声;

16、第八步:将超分辨率重建的过程简化为以下公式:

17、ihr=f(ilr);

18、其中f即为拥有发丝级细节的单图像超分辨率重建方法。

19、优选的,双分支的网络结构包括经过一个nlsa块的分支与另一个经过两层3×3的深度可分离卷积的分支,两个分支在通道上串联起来。

20、优选的,用1×1的卷积来融合两个分支,然后用ca来处理通道之间的信息交互。

21、(三)有益效果

22、与现有技术相比,本发明提供了一种拥有发丝级细节的单图像超分辨率重建方法,具备以下有益效果:

23、1、该拥有发丝级细节的单图像超分辨率重建方法,可以利用图像内部非局部信息对图像进行超分辨率重建,使图像拥有发丝级别的细节,如附图3所示,能够很好的对动物毛发、建筑中重复的结构、重复的条纹等进行超分辨率重建。

24、2、该拥有发丝级细节的单图像超分辨率重建方法,如附图4的第三行所示,所比较的方法产生了倾斜的条纹,如红色方框所显示的。本方案保留了与原始图像几乎相同的直条纹。原因是,现有的技术都没有关注到图像周围类似的区域信息,比如蓝色区域的水平条纹。相反,本方案专注于非局部信息,因此产生了与原始图像相同的条纹,进而可以达到发丝级别的细节超分辨率重建。

- 还没有人留言评论。精彩留言会获得点赞!