一种基于MSGRU-TRF的视频异常检测方法

本发明属于计算机视觉和模式识别领域,涉及一种msgru-trf网络的视频异常检测方法。

背景技术:

1、社会安全是保障国家综合实力不断发展的基本条件,只有良好的安防措施才能保护和发展社会生产力、促进社会和经济持续健康的发展。监控视频在维护社会安全方面发挥着关键作用。然而,目前监控视频系统的主要功能是显示监控画面和存储监控视频数据,异常事件检测功能需要通过安保人员观看监视器来完成。而异常事件发生的频率较低且无规律可循,依靠人工检测异常事件容易导致误检和漏检现象发生。此外,通过人工从海量的视频数据中及时的检测出异常事件,将需要投入大量的人力资源。尽管目前安装监控设备所需的价格越来越便宜,但监视和分析这些视频数据所需的人力却十分昂贵。因而依靠人力实现异常检测,对企业来说是缺乏经济效率的。因此,构建智能化的视频异常事件检测系统,对视频监控数据进行24小时不间断分析与监测,并自动检测出正在发生的异常事件并预警,将是十分有意义和必要的。

2、随着深度学习在计算机视觉方面的发展及应用,用深度学习解决监控视频下的异常行为检测成了近几年的研究热点之一。因为视频异常具有数量少,不易定义等特点,现有方法主要使用弱监督方法中的基于多事例学习的方法。针对视频数据强时空相关性的特点,部分算法又在多事例学习框架的特征提取网络中加入多尺度卷积结构来增强算法在时间上的建模能力,但这种基于卷积的多尺度结构往往不能很好的提取全局时间联系。

技术实现思路

1、针对现有算法的不足,本发明提出一个高精度的基于msgru-trf网络的视频异常检测算法。在多尺度卷积网络中加入gru结构,既利用了多尺度卷积网络对输入数据多尺度建模的特点,又加入gru结构加强对输入数据时间上的建模。除此之外,本发明将常见多事例学习方法中预处理过程中不同视频特征存在的时间分辨率信息进行提取,通过时间分辨率特征映射模块映射到特征学习网络辅助网络学习到视频的更多信息。最后,本发明提出自适应k模块来改进传统的top-k损失函数,通过为不同的输入视频定制k的值,自适应k模块为网络训练带来更多的灵活性。相较于现有算法,本发明提出的msgru-trf网络对真实世界长短不一的监控视频有很好的时间尺度建模作用,在视频异常检测问题方面有较高的准确率。

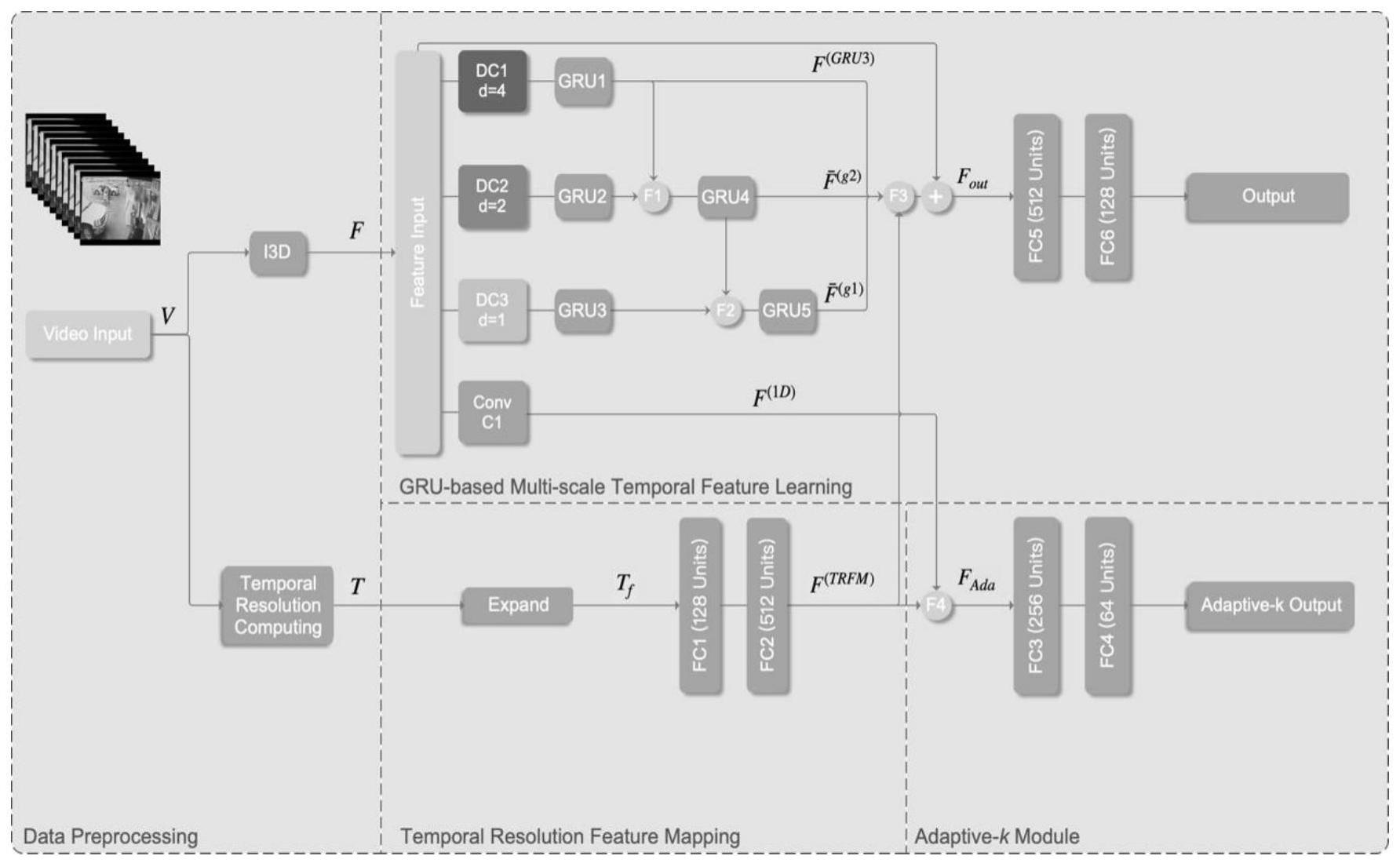

2、本发明提供一种高精度基于msgru-trf网络的视频异常检测算法,包括以下步骤:

3、1、预处理

4、首先,将原始的长视频数据切分成单帧的视频帧图像。其次,将切分好的视频帧分成32个固定片段。对每个视频进行视频级别的弱监督标注。最后,利用预训练好的i3d特征提取器初步提取视频的运动特征,得到网络输入所需的特征向量。另外,计算出视频的时间分辨率信息作为网络的额外输入。

5、2、构造msgru-trf网络

6、本发明所构建的网络结构为:

7、多尺度gru时间特征学习网络,三层膨胀卷积层(dc1、dc2、dc3),一层卷积层(c1),三层gru层(gru1、gru2、gru3),第一次特征融合(f1),一层gru层(gru4),第二次特征融合(f2),一层gru层(gru5),两层全联接层(fc1、fc2),第三次特征融合(f3),模块输出层;时间分辨率特征映射模块,两层全联接层(fc5、fc6);自适应k模块,两层全联接层(fc1、fc2),第四次特征聚合(f4),两层全联接层(fc3、fc4),自适应k模块输出层。最后形成一个基于gru的多尺度时间信息与时间分辨率信息结合学习的网络,msgru-trf。

8、3、利用msgru-trf网络实现基于无监督视频异常检测算法

9、训练过程:

10、对训练集中的原始长视频切分成单帧视频帧,将切分好的视频帧分成32个固定片段并对每个视频进行片段级别的弱监督标注。利用预训练好的i3d特征提取器初步提取视频的运动特征,得到网络输入所需的特征向量。另外,计算出视频的时间分辨率信息作为网络的额外输入。

11、将预处理后的视频特征和时间分辨率特征分别输入到msgru-trf网络的多尺度gru时间特征学习模块和时间分辨率特征映射模块,视频特征通过多尺度gru时间特征学习模块后将得到包含每个片段的异常分数的分数矩阵。时间分辨率信息通过时间分辨率特征映射模块和自适应k模块后将得到用于计算top-k损失函数的k值和用于计算adaptive-k损失函数的特征向量。通过最小化输入的异常视频的异常分数最高的k个片段的均值和正常视频的异常分数最大值的差值来进行网络优化。并利用自适应k模块根据视频特定的时间分辨率信息定制的k值来辅助损失函数优化。最后,使用自适应k模块输出特征与预设值特征进行mse损失函数计算来限制生成极端大小的k值。

12、测试过程:

13、将测试集中的原始长视频切分成单帧视频帧,利用预训练好的i3d特征提取器初步提取视频的运动特征,得到网络输入所需的特征向量。然后直接输入到训练好msgru-trf网络中,得到片段级别的异常分数,片段中的每一帧的异常分数都与该片段的异常分数相同。通过视频异常分数和groudtruth异常标注可以计算出视频整体异常检测的准确率auc。通过比较异常分数与所设阈值之间的差异,来判定该输入的视频帧是否属于异常。

14、有益效果

15、1、本发明提出时间分辨率特征映射模块

16、由于真实世界监控视频具有长度差别较大的特点,导致现有的基于多事例学习的弱监督视频异常检测算法在预处理过程中会出现视频特征的时间压缩程度差异大的现象,也就是不同视频的特征向量的时间分辨率具有较大的差异。

17、为提高网络的对于这样的复杂数据的异常检测能力,本发明提出了时间分辨率特征映射模块。通过利用预处理阶段计算出的时间分辨率信息,该模块将每个视频特有的附加信息通过全联接层与特征融合操作映射到时间多尺度特征学习空间中,以帮助网络学习到视频特征的时间分辨率差异,并提高视频长度具有显著差异的数据集的检测精度。

18、2、本发明提出基于gru的多尺度时间特征学习模块

19、目前已有利用多尺度卷积网络进行特征时间联系的学习,但卷积结构更关注局部的时间依赖信息,从而忽略了输入视频数据在时间轴上全局的时间关联性,并且在不同的时间尺度支路结构之间缺乏关联性。本发明提出基于gru的多尺度时间特征学习模块,该方法将多尺度卷积与gru结构相结合,在利用gru能够更好获取全局时间联系的优点的同时弥补了gru无法获得多尺度时间信息的缺点。另外,该模块在不同支路之间加入递进特征融合结构,增加不同时间尺度之间的联系,减少彼此的干扰。相比多尺度卷积,多尺度gru利用更全局的时间特征信息进行异常学习,且在时间上也较强的特征提取能力。

20、3、本发明利用msgru-trf网络实现基于多事例学习的弱监督视频异常检测算法现有能够在复杂多场景的真实世界数据集上取得不错的视频异常检测结果的算法均是基于多事例学习的弱监督方法,但是现有多事例学习方法为了方便训练在预处理阶段将长短不同的输入视频统一处理成形状相同的特征向量,这将导致特征的时间分辨率出现差异。本发明提出利用msgru-trf网络进行视频异常检测,该方法中的三个模块(时间分辨率特征映射模块、基于gru的多尺度时间特征学习模块、自适应k模块)分别从三个方面优化多事例学习存在的问题,进一步提升视频异常检测的准确度。

21、4、本发明提出自适应k模块

22、现有基于多事例学习的弱监督方法中常用top-k损失函数来进行训练,该损失函数将异常视频中异常分数最高的k个片段的分数均值与正常视频中片段的最高分计算差值。通过在训练中最大化分数差,网络可以更好的区分异常视频与正常视频。现有方法都使用预设好的固定值k来进行训练,但是这样会导致训练的灵活性下降。对于不同的异常视频,异常帧的比例也有很大差异,使用固定值会导致参与计算损失的片段分数不能完全代表该视频的异常情况,从而限制异常检测的准确率。

23、本发明提出自适应k模块来优化top-k损失函数。通过视频特征与时间分辨率信息融合并降维,该模块为不同的视频定制合适的k值,增加训练的灵活性,提升网络异常检测的训练上限。另外,该模块还提出自适应k损失函数来约束生成极端大小的k值,该损失作为多事例学习损失函数的一个分量从而进一步提升异常检测准确率。

- 还没有人留言评论。精彩留言会获得点赞!