一种基于枪机和云台相机联动的目标定位方法及设备与流程

本发明涉及智能监控技术,尤其涉及一种基于枪机和云台相机联动的目标定位方法及设备。

背景技术:

1、在监控系统中,枪机可以用来监控特定区域,而云台相机则可以通过控制云台的角度和方向,来扫描整个区域。通过云台相机和枪机联动来实现更为智能化的监控系统,比如:自动跟踪、聚焦、预置位、场景切换等等。通过将云台相机和枪机联动,可以实现更为智能化、高效化的监控系统,提高监控的准确性和效率。

2、现有提供一种相机布点方法,其通过获取三维模型中相机的可布点范围以及待监测目标;每个布点位置设置有对应的相机;获得每个布点位置的相机与待监测目标之间的第一距离、观测角度以及遮挡情况,并根据所有第一距离、观测角度和遮挡情况从所有布点位置中筛选出多个布点位置以形成第一合集;获得第一合集中的每个布点位置的相机所覆盖待监测目标的第一空间范围,并根据所有第一空间范围从第一合集中筛选出最优布点位置。这样可以对相机的布点位置进行合理的规划。然而,在布点合理规划的基础上,如何使得枪机和云台相机进行有效联动,实现更精准的监控目标或定位目标成为当前亟需解决的技术问题。

技术实现思路

1、(一)要解决的技术问题

2、鉴于现有技术的上述缺点、不足,本发明提供一种基于枪机和云台相机联动的目标定位方法及装置。

3、(二)技术方案

4、为了达到上述目的,本发明采用的主要技术方案包括:

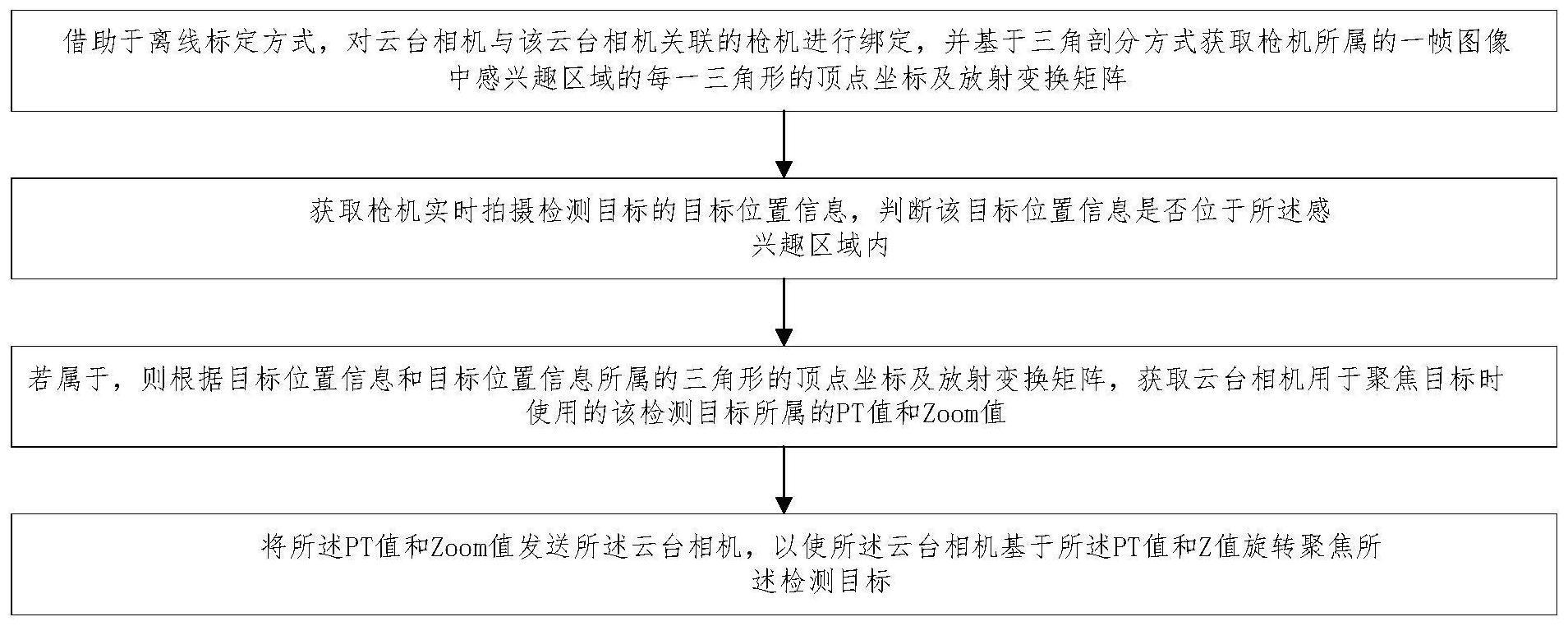

5、第一方面,本发明实施例提供一种基于枪机和云台相机联动的目标定位方法,包括:

6、s10、借助于离线标定方式,对云台相机与该云台相机关联的枪机进行绑定,并基于多边形剖分方式获取枪机所属的一帧图像中感兴趣区域的每一多边形的顶点坐标及放射变换矩阵;

7、s20、获取枪机实时拍摄检测目标的目标位置信息,判断该目标位置信息是否位于所述感兴趣区域内;

8、s30、若属于,则根据目标位置信息和目标位置信息所属的多角形的顶点坐标及放射变换矩阵,获取云台相机用于聚焦目标时使用的该检测目标所属的pt值和zoom值,

9、s40、将所述pt值和zoom值发送所述云台相机,以使所述云台相机基于所述pt值和zoom值旋转聚焦所述检测目标。

10、可选地,所述s10中的基于多边形剖分方式获取枪机所属的一帧图像中感兴趣区域的每一多角形的顶点坐标及放射变换矩阵,包括:

11、基于三角剖分方式获取枪机所属的一帧图像中感兴趣区域的每一三角形的顶点坐标及放射变换矩阵。

12、可选地,所述s10包括:

13、针对云台相机绑定的每一枪机,从该枪机拍摄的视频流中选择一帧图像,确定该帧图像中属于云台相机可视范围内的子图;

14、对子图的边界区域选择多个第一坐标点,将所有第一坐标点按照指定方向连接形成感兴趣区域,获得感兴趣的像素坐标范围;

15、依据限定距离和均匀条件对感兴趣区域内部选择多个第二坐标点;

16、获取所有第一坐标点的像素坐标和pt值,该pt值为任一第一坐标点被云台相机聚焦时旋转信息;

17、获取所有第二坐标点的像素坐标和pt值,该pt值为任一第二坐标点被云台相机聚焦时旋转信息;

18、基于三角剖分方式将所有的第一坐标点和所有的第二坐标点形成依次排列且无重复的三角形,每一三角形具有唯一标识;

19、基于每一三角形中三个顶点的像素坐标和pt值,获取将三个顶点在像素坐标转换为各自pt值的放射变换矩阵。

20、可选地,所述s20包括:

21、获取枪机的视频流信息,根据目标检测模型,获取检测目标在当前帧中的第一位置信息,该第一位置信息包括像素坐标和检测目标的宽高信息;

22、根据所述检测目标的像素坐标,判断像素坐标是否位于感兴趣区域的像素坐标范围,

23、若是,则执行步骤s30,否则结束。

24、可选地,所述s30包括:

25、根据检测目标中心点的像素坐标和每一三角形中三个顶点的像素坐标,确定检测目标的所归属的三角形;

26、根据所述检测目标所归属的三角形的放射变换矩阵,将检测目标中心点的像素坐标转化为检测目标的pt值。

27、可选地,所述s30还包括:

28、根据已知的云台相机的zoom值范围和和检测目标的宽高信息,获取该检测目标的zoom值。

29、可选地,云台相机的zoom值范围是z_min~z_max,则基于下述公式,获取检测目标的zoom值z目标;

30、z目标=(z_min-z_max)*s+z_max,

31、s=min(w/image_w,h/image_h);

32、image_w和image_h分别表示枪机的分辨率宽高;

33、w和h分别表示检测目标的宽高。

34、可选地,获取枪机的视频流信息,根据目标检测模型,获取检测目标在当前帧中的第一位置信息,包括:

35、选择枪机的视频流信息中当前关键帧,采用基于神经网络的yolov5算法,获取检测目标在当前帧中的第一位置信息。

36、第二方面,本发明实施例还提供一种基于枪机和云台相机联动的目标定位方法,其包括:

37、a10、获取枪机实时拍摄检测目标的目标位置信息,判断该目标位置信息是否位于预先定义的感兴趣区域范围内;

38、a20、若属于,则根据目标位置信息和目标位置信息所属的多边形的顶点坐标及放射变换矩阵,获取云台相机用于聚焦目标时使用的该检测目标所属的pt值和zoom值,

39、a30、将所述pt值和zoom值发送所述云台相机,以使所述云台相机基于所述pt值和z值旋转聚焦所述检测目标;

40、所述预先定义的感兴趣区域为在枪机和云台相机绑定时,从枪机拍摄的图像中确定的对应云台相机可视范围内的区域;

41、在离线阶段,借助于多边形剖分方式将感兴趣区域划分多个多边形,且获取每一多边形中各顶点的像素坐标和pt值、以及每一顶点在像素坐标转换为各自pt值的放射变换矩阵。

42、举例来说,在离线阶段,借助于三角剖分方式将感兴趣区域划分多个三角形,且获取每一三角形中各顶点的像素坐标和pt值、以及每一顶点在像素坐标转换为各自pt值的放射变换矩阵。

43、因为三角形是最少边的形状,且比较好识别,故,在实际中可借助现有的三角剖分方式实现。

44、第三方面,本发明提供一种计算设备,电连接云台相机和至少一个枪机,在枪机和云台相机绑定时,所述计算设备的处理器执行上述第一方面任一所述的一种基于枪机和云台相机联动的目标定位方法的步骤。

45、(三)有益效果

46、本发明实施例的方法适用于多个枪机和云台相机联动的相机标定过程,其操作流程渐变,在线处理阶段的速度更快、定位更精准。

47、在本发明实施例中,可预先通过离线标定方式将目标区域划分为多个子区域,然后获取各个子区域的顶点坐标及放射变换矩阵,进而再通过在线推理方式借助于目标位置信息所在的子区域/感兴趣区域信息,然后确定聚焦目标时云台相机所属的pt值和zoom值,由此,可以使得云台相机基于所述pt值和zoom值旋转聚焦所述检测目标,使得整个处理过程简单且速度快,准确率高,保证了云台相机聚焦的精确定位。

- 还没有人留言评论。精彩留言会获得点赞!