一种场景自适应的注视点神经辐射场渲染方法及系统

本发明涉及计算机图形学领域,具体涉及一种场景自适应的注视点神经辐射场渲染方法及系统。

背景技术:

1、随着计算机图形学以及深度学习技术的发展,研究人员提出一系列神经渲染技术,将传统的渲染技术与基于学习的三维场景表示技术相结合,取得了远超传统渲染技术的效果,其中最具代表性的是神经辐射场技术。2021年mildenhall等人提出神经辐射场nerf用于生成复杂场景在新视角下的渲染图像。nerf使用一个全连接深度网络来表示场景,在训练时以一组多视角的物体图像为数据,通过优化该神经网络实现三维场景的重建。在新视角图像渲染时,nerf以视角三维位置以及二维方向为输入,输出场景中每个体素位置的颜色以及体密度,而后通过体渲染方法渲染得到新视角下场景图像。实验结果表明相较于传统的神经渲染方法nerf在渲染质量方面提升18%-27%。针对nerf处理不同分辨率训练/测试图像时易模糊、失真的问题,2021年barron等人提出mip-nerf。mip-nerf对nerf进行了拓展,以连续值表示场景,并将nerf中体素渲染步骤中的光线追踪(ray tracing)替换为锥跟踪(cone tracing)。实验结果表明,相较于nerf,mip-nerf在数据集上的错误率降低了17%。2021年park等人针对nerf只能处理静态场景不能处理动态场景的问题提出nerfies。nerfies通过引入额外的多层感知机(mlp),将输入的帧坐标映射到变形的规范坐标,并通过自适应掩蔽位置编码添加弹性正则化、背景正则化和粗到细变形正则化,从而实现动态场景重建以及新视角渲染。针对nerf渲染时间较长的问题,2022年虞等人提出一个专门为nerf渲染定制的加速器架构-icarus,icarus使用全光核(plcore)执行完整的nerf管道,同时将全连接操作转换为近似的可重构多重常数乘法(mcms),以提高计算效率。

2、为了进一步提升基于神经辐射场的渲染方法的合成性能以达到实时帧率,2022年邓等人提出了一种基于注视点的神经辐射场表示和图像合成方法(fovnerf),利用注视点渲染对神经辐射场渲染技术进行加速。具体而言,该方法构建了一种以用户为中心、由内向外的同心球三维神经辐射场表示结构,然后基于该神经辐射场表示结构结合人眼视敏度实时合成当前视点的注视点渲染结果。然后,fovnerf的同心球三维神经辐射场表示结构难以很好地对复杂场景的辐射度进行表示,且该方法需要两个图像生成网络合成注视点渲染结果,难以达到近眼显示设备的帧率要求。因此,如何在不降低注视点图像合成质量的情况下,提升注视点图像的合成性能,从而满足近眼显示设备的帧率要求,成为一个亟待解决的问题。

技术实现思路

1、为了解决上述技术问题,本发明提供一种场景自适应的注视点神经辐射场渲染方法及系统。

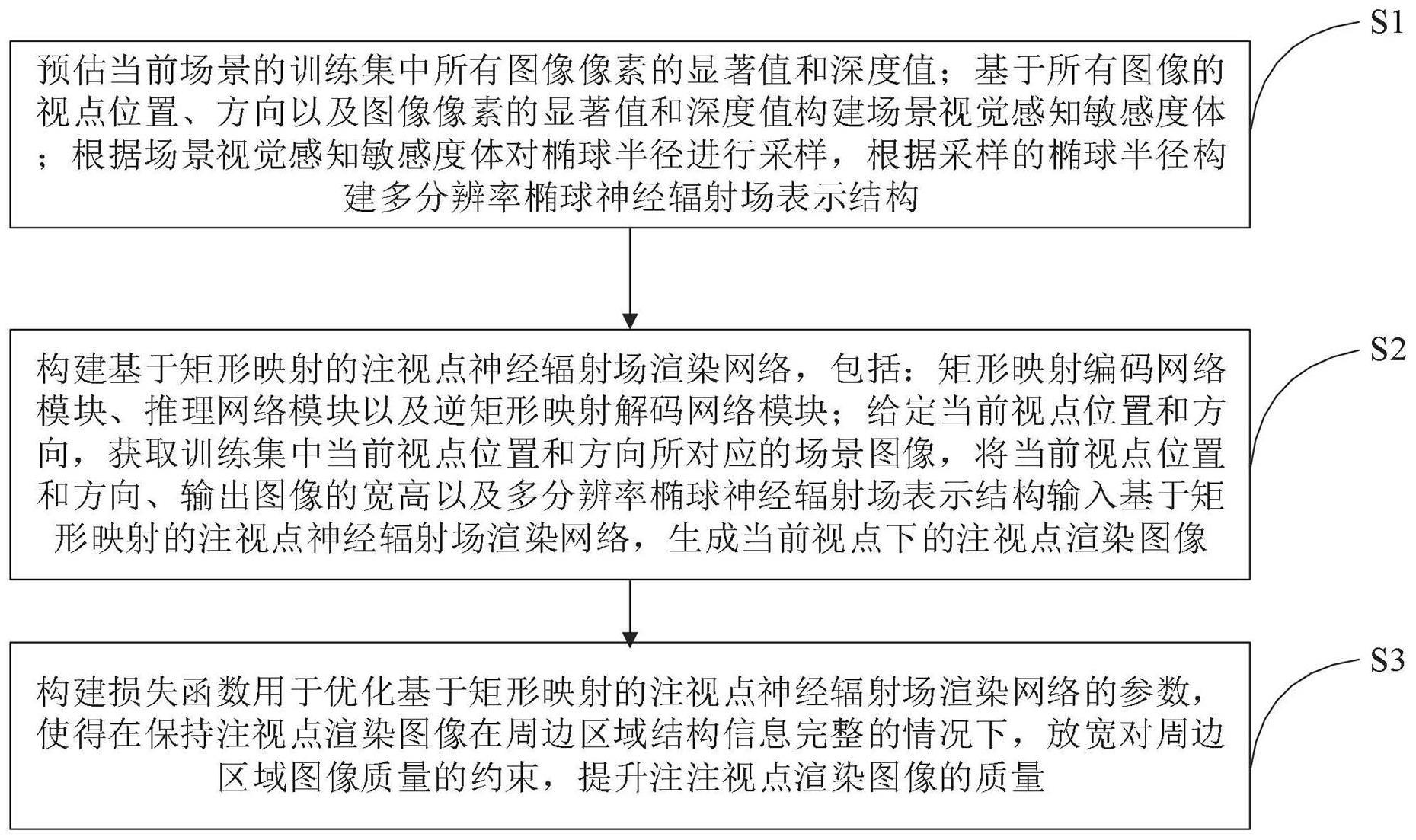

2、本发明技术解决方案为:一种场景自适应的注视点神经辐射场渲染方法,包括:

3、步骤s1:预估当前场景的训练集中所有图像像素的显著值和深度值;基于所有图像的视点位置、方向以及所述图像像素的显著值和深度值构建场景视觉感知敏感度体;根据所述场景视觉感知敏感度体对椭球半径进行采样,根据采样的椭球半径构建多分辨率椭球神经辐射场表示结构;

4、步骤s2:构建基于矩形映射的注视点神经辐射场渲染网络,包括:矩形映射编码网络模块、推理网络模块以及逆矩形映射解码网络模块;给定当前视点位置和方向,获取训练集中所述当前视点位置和方向所对应的场景图像,将所述当前视点位置和方向、输出图像的宽高以及所述多分辨率椭球神经辐射场表示结构输入所述基于矩形映射的注视点神经辐射场渲染网络,生成当前视点下的注视点渲染图像;

5、步骤s3:构建损失函数用于优化所述基于矩形映射的注视点神经辐射场渲染网络的参数,使得在保持所述注视点渲染图像在周边区域结构信息完整的情况下,放宽对周边区域图像质量的约束,提升注所述注视点渲染图像的质量。

6、本发明与现有技术相比,具有以下优点:

7、1、本发明公开了一种场景自适应的注视点神经辐射场渲染方法,实现了一种多分辨率椭球神经辐射场表示结构,根据复杂场景内容自适应调整椭球半径提升场景高视觉感知敏感区域的球体密度,提升复杂场景的辐射场表示能力。在相同球层数的情况下,与现有的fovnerf方法的同心球结构相比,本发明提升了复杂场景的辐射场表示能力。

8、2、本发明设计并实现了一种基于矩形映射的注视点神经辐射场渲染网络,将矩形映射集成到注视点神经辐射场渲染网络中,使用单个端到端的网络结构高效合成注视点渲染图像,在合成质量相似的情况下,与fovnerf方法相比,本发明能够在近眼显示设备中以高帧率(≥60fps)为复杂场景合成高质量注视点渲染图像,并且合成性能提升了1.3-1.8倍。

9、3、本发明针对基于矩形映射的注视点神经辐射场渲染网络,构建了损失函数对其进行参数优化,实现了参数量满足网络以高帧率合成注视点图像的前提下保持了注视点区域的高质量合成结果,并且本发明所需训练数据与传统神经辐射场渲染方法一致,无需针对目标场景重新构建注视点图像进行训练。

技术特征:

1.一种场景自适应的注视点神经辐射场渲染方法,其特征在于,包括:

2.根据权利要求1所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s1:预估当前场景的训练集中所有图像像素的显著值和深度值;基于所有图像的视点位置、方向以及所述图像像素的显著值和深度值构建场景视觉感知敏感度体;根据所述场景视觉感知敏感度体对椭球半径进行采样,根据采样的椭球半径构建多分辨率椭球神经辐射场表示结构,具体包括:

3.根据权利要求2所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s2:构建基于矩形映射的注视点神经辐射场渲染网络,包括:矩形映射编码网络模块、推理网络模块以及逆矩形映射解码网络模块;给定当前视点位置和方向,获取训练集中所述当前视点位置和方向所对应的场景图像,将所述当前视点位置和方向、输出图像的宽高以及所述多分辨率椭球神经辐射场表示结构输入所述基于矩形映射的注视点神经辐射场渲染网络,生成当前视点下的注视点渲染图像,具体包括:

4.根据权利要求3所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s22:给定当前视点位置和方向,获取训练集中所述当前视点位置和方向所对应的场景图像,将所述当前视点位置、方向和输出图像的宽高的宽高以及所述多分辨率椭球神经辐射场表示结构输入所述矩形映射编码网络模块,输出所述场景图像的逐像素特征,具体包括:

5.根据权利要求4所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s23:将所述逐像素特征输入所述推理网络模块,基于所述逐像素特征从所述多分辨率椭球神经辐射场表示结构进行采样并计算得到逐像素辐射度,得到矩形映射空间下的视图合成结果,具体包括:

6.根据权利要求5所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s24:将所述视图合成结果输入逆矩形映射解码网络模块进行解码,生成当前视点下的注视点渲染图像,具体包括:

7.根据权利要求6所述的场景自适应的注视点神经辐射场渲染方法,其特征在于,所述步骤s3:构建损失函数用于优化所述基于矩形映射的注视点神经辐射场渲染网络的参数,使得在保持所述注视点渲染图像在周边区域结构信息完整的情况下,放宽对周边区域图像质量的约束,提升注所述注视点渲染图像的质量,具体包括:

8.一种场景自适应的注视点神经辐射场渲染系统,其特征在于,包括下述模块:

技术总结

本发明涉及一种场景自适应的注视点神经辐射场渲染方法及系统,其方法包括:S1:基于当前场景的训练集中所有图像的视点位置、方向以及所述图像像素的显著值和深度值构建场景视觉感知敏感度体;根据场景视觉感知敏感度体对椭球半径进行采样,构建多分辨率椭球神经辐射场表示结构;S2:构建基于矩形映射的注视点神经辐射场渲染网络,用于生成当前视点下的注视点渲染图像;S3:构建损失函数用于优化基于矩形映射的注视点神经辐射场渲染网络的参数,在保持注视点渲染图像的周边图像结构信息完整的同时,放宽对周边图像质量的约束。本发明提供的方法可基于少量场景拍摄图像,以高帧率为近眼显示设备合成该场景任意视角下的高质量注视点渲染结果。

技术研发人员:王莉莉,石雪怀,吴健,樊润泽

受保护的技术使用者:北京航空航天大学

技术研发日:

技术公布日:2024/1/16

- 还没有人留言评论。精彩留言会获得点赞!