基于Transformer的多类别多特征尺度行人重识别方法及系统

本发明属于计算机视觉,尤其涉及基于transformer的多类别多特征尺度行人重识别方法及系统。

背景技术:

1、行人重识别(pedestrian re-identification)是计算机视觉领域的一个关键研究领域,其主要目标是从不同摄像头或时间点捕获的视频或图像中,准确地识别和跟踪同一行人的身份。

2、行人重识别技术在多个领域具有广泛的应用潜力。随着城市化的不断发展,监控系统的普及程度越来越高,这使得对行人进行准确的识别和跟踪成为一项至关重要的任务。在传统监控系统中,行人的识别和跟踪通常依赖于人工干预,这既费时又容易出错。行人重识别技术迎合了这一需求,克服了传统监控系统中的局限性。行人重识别技术可以实现自动化、高效率和高精度的行人识别,为安全监控、智能交通、城市规划等领域提供了巨大的潜力。在安全监控中,它可以用于追踪和识别犯罪嫌疑人,提高监控系统的效率。在智能交通领域,行人重识别有助于改善交通流量管理,提高交通安全性。在商场和零售领域,它可以用于优化商场布局,改善购物体验。在城市规划中,行人重识别可用于人流分析,有助于改善城市交通和基础设施规划。行人重识别技术的发展为解决现实生活中的安全和管理问题提供了有力工具。

3、目前行人重识别面临着多个技术挑战。首先,不同摄像头之间的视角、光照和分辨率差异导致了行人图像的外观变化,这增加了识别的难度。其次,同一行人在不同时间和场景下可能穿着不同的服装,这也会引入干扰。此外,大规模的行人重识别数据集和有效的训练方法是实现高性能模型的关键因素。

4、随着深度学习技术的快速发展,行人重识别取得了显著的进展。深度卷积神经网络(cnn)在图像特征提取方面表现出色,siamese网络和triplet网络等架构被广泛用于学习行人图像的特征表示。度量学习方法也得到了应用,通过学习如何在特征空间中度量行人之间的相似度来提高识别性能。此外,多摄像头联合跟踪和多尺度特征融合等技术也推动了行人重识别的发展。随着深度学习技术和硬件计算能力的不断提高,行人重识别技术将继续取得进展,并在各个领域发挥越来越重要的作用。这一技术背景为行人重识别的发明专利提供了坚实的基础和动机。

5、目前市面上基于transformer的行人重识别还较少,例如公开号cn115631513a(基于transformer的多尺度行人重识别方法)也是通过挖掘行人图像的不同尺度信息来学习特征,但只是将多尺度信息通过插值与卷积进行融合,没有动态地将不同尺度的特征融合,此外也没有在transformer中引入多类别标签;公开号cn116012771a(一种基于关系注意力transformer的行人重识别方法)通过通道注意力模块和近邻关系注意力模块来关联特征信息;公开号cn115909408a(一种基于transformer网络的行人重识别方法及装置)将原始图像通过线性映射分为两个分支,再经由一二分支加入参数得到三四分支,分别放入transformer模型中获取全局与局部特征信息;公开号cn114677646a(一种基于visiontransformer的跨域行人重识别方法)使用基于密度空间的聚类方法给数据赋予了伪标签,将vision transformer特征提取架构与聚类模块融合,通过聚合信息存储模块对学习到聚合信息进行存储以学习全局特征。但上述方法都不涉及多类别标签与特征动态融合。

6、本发明提出一种基于transformer的多类别多特征尺度行人重识别方法及系统,从而解决当前行人重识别准确度不高的问题。

技术实现思路

1、本发明的目的在于提供一种基于transformer的多类别多特征尺度行人重识别方法及系统,以解决上述背景技术中提出的现有技术中基于transformer的行人重识别技术不涉及多类别标签与特征动态融合,且行人重识别准确度不高等问题。

2、为实现上述目的,本发明采用以下技术方案实现:

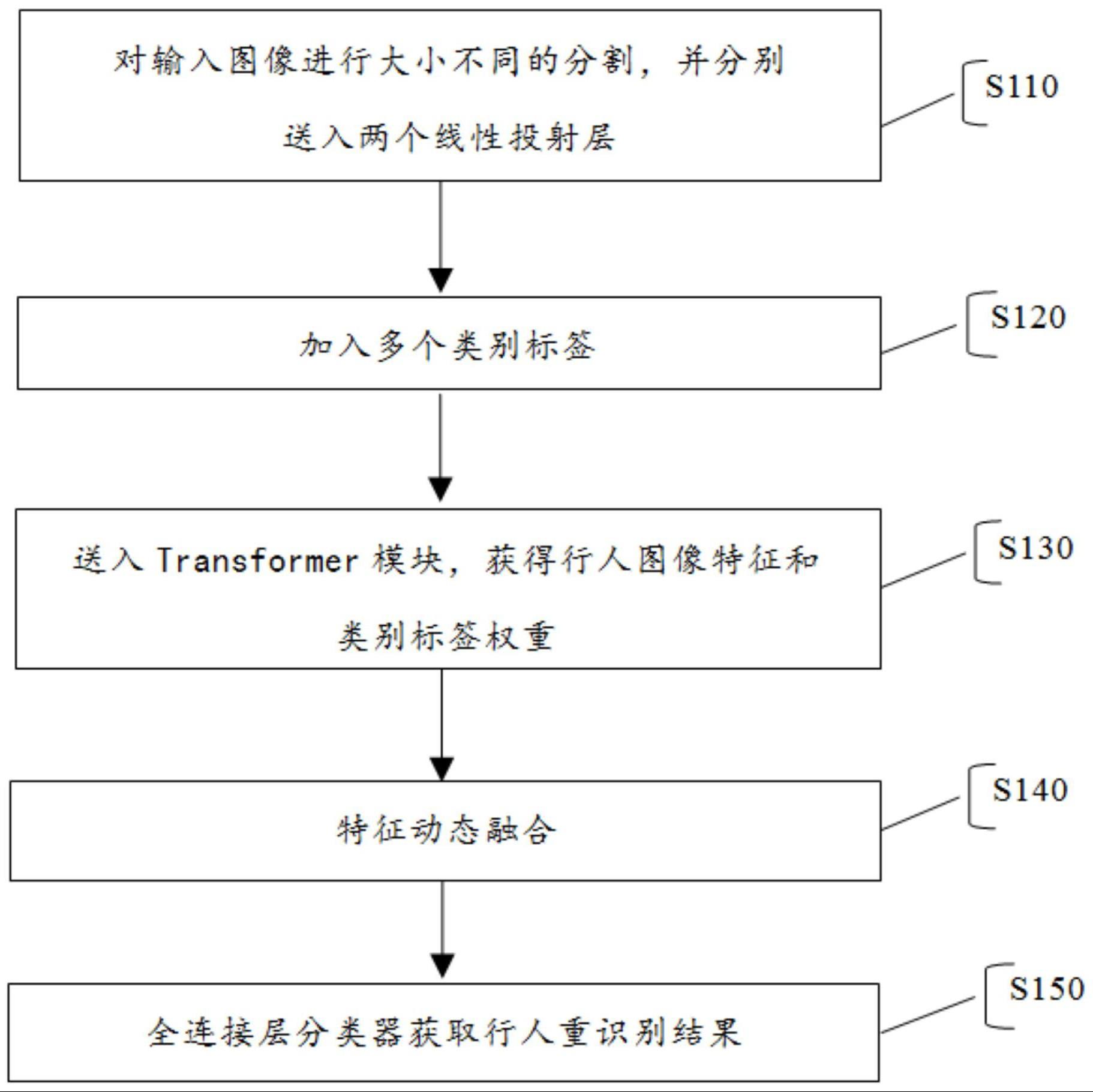

3、本发明提供了基于transformer的多类别多特征尺度行人重识别方法,包括以下步骤:

4、s1、将行人图像进行大小不同的分割;行人图像分别分割为大分块图像块与小分块图像块,并分别送入两个线性投射层,得到每个行人两种不同的图像特征序列;

5、s2、加入多个类别标签;在得到的两个图像特征序列中分别加入相同个数的类别标签cls_token,并添加相应个数的位置编码pos_token;

6、s3、两个图像特征序列各自通过transformer网络,提取行人特征,分别获得相对应的行人图像特征和类别标签权重;

7、s4、将通过transformer网络的两个图像特征序列进行动态融合,得到合并后的一组包含分类标签与图像特征的向量;

8、s5、将融合后的分类标签输入至全连接层分类器获取行人重识别结果。

9、优选地,所述s1中使用对输入图像特征的多尺度提取,对行人图像进行大小不同的分割。

10、优选地,所述s2中加入多个类别标签,具体包括如下步骤:

11、s201、将图像块经过线性投影层得到相应的图像特征序列;

12、s202、在图像特征序列前,加入多个类别标签cls_tokfn;

13、s203、图像特征序列通过transformer网络时,逐渐调整注意力机制中的查询值相互正交,使得|cos(f1,f2)|→0,以让不同的类别标签学习到不同的特征;

14、其中,f1,f2为同一特征的不同表示。

15、优选地,所述s3中transformer网络的构建,具体如下:

16、transformer网络主要由多层堆叠的transformer模块构成,单个transformer层由多头注意力机制msa、层归一化ln和多层感知器mlp构成,如下述公式所示:

17、f′l=msa(ln(fl-1))+fl-1,l=1...l

18、fl=mlp(ln(f′l))+f′l,l=1…l

19、其中,fl‘为transformer模块块内结果,fl为transformer模块生成结果,l为第l层的transformer模块,l为总的transformer模块数量;

20、transformerout为transformer模块最后一层transformer,其将输出n个类别标签的特征,与图像全局特征feat;

21、cls[c1,...cn],feat=trasnformerout(x)。

22、优选地,所述s4中通过transformer网络的两个图像特征序列进行动态融合,具体如下:

23、通过两个transformer网络得到两组不同的类别与特征权重;

24、使用公式对两组权重进行结合;

25、t=λt1+(1-λ)t2

26、其中,λ=e/e,e为当前迭代次数,e为总迭代次数,t1,t2分别表示小分块图像块和大分块图像块得到的transformer特征。

27、应用于上述所述方法的基于transformer的多类别多特征尺度行人重识别系统,包括:

28、多尺度特征提取模块,用于分割出不同尺度的图像,从而获取不同尺度下的行人图像深层特征信息;

29、多个类别标签添加模块,用于在行人图像深层特征信息加入多个类别标签,并添加相应个数的位置编码;

30、基于transformer的多类别标签特征提取模块,用于学习行人图像中的特征信息,并获取类别数据;

31、特征动态融合模块,用于将通过基于transformer的多类别标签特征提取模块获取的类别与特征通过动态融合方式进行结合;

32、全连接分类模块,用于获得行人图像的类别分类。

33、与现有技术相比,本发明的有益效果是:

34、(1)、本发明中方法将同一个行人图像分割为两种大小不同的图像块,并输入至两个transformer通道,有助于网络提取同一个行人的不同层次的深层特征。

35、(2)、本发明相较于传统的transformer网络,采用多个类别标签,多个类别标签可以捕捉图像的不同区域或层次的信息,允许网络在不同位置或层次上聚焦于重要的信息,从而更好地理解图像,增加了鲁棒性;

36、(3)、本发明中方法设计了基于迭代轮次的动态融合方法;一定程度小的图像块所携带的深层信息会多于较大的图像块,因此当越接近迭代轮次的结束,需要使小图像块所在transformer网络所输出的特征权重越大,因此本发明中方法设计了基于迭代轮次的动态融合方法,两个transformer网络在输出结果后,会根据当前迭代轮次调整小图像块与大图像块经过transformer网络后产出结果的比重,实现特征动态融合。

- 还没有人留言评论。精彩留言会获得点赞!