一种基于无人机的人员搜救方法与流程

本发明涉及机器视觉领域,具体为一种基于无人机的人员搜救方法。

背景技术:

1、在城市的火灾、地震现场、森林登山旅行、湖面江面游泳等场所经常发生人员被困甚至失联的情况,由于野外搜救环境恶劣,遮挡干扰物较多,视线常常受阻,采用人工搜救需要面临高温、浓烟、甚至毒气、二次坍塌等高难度高危环境,且夜间视线差、障碍物遮挡等因素导致被困人员定位、搜寻进度缓慢,盲目大范围搜救不仅耗时耗力,还可能错过最佳救援时间。

技术实现思路

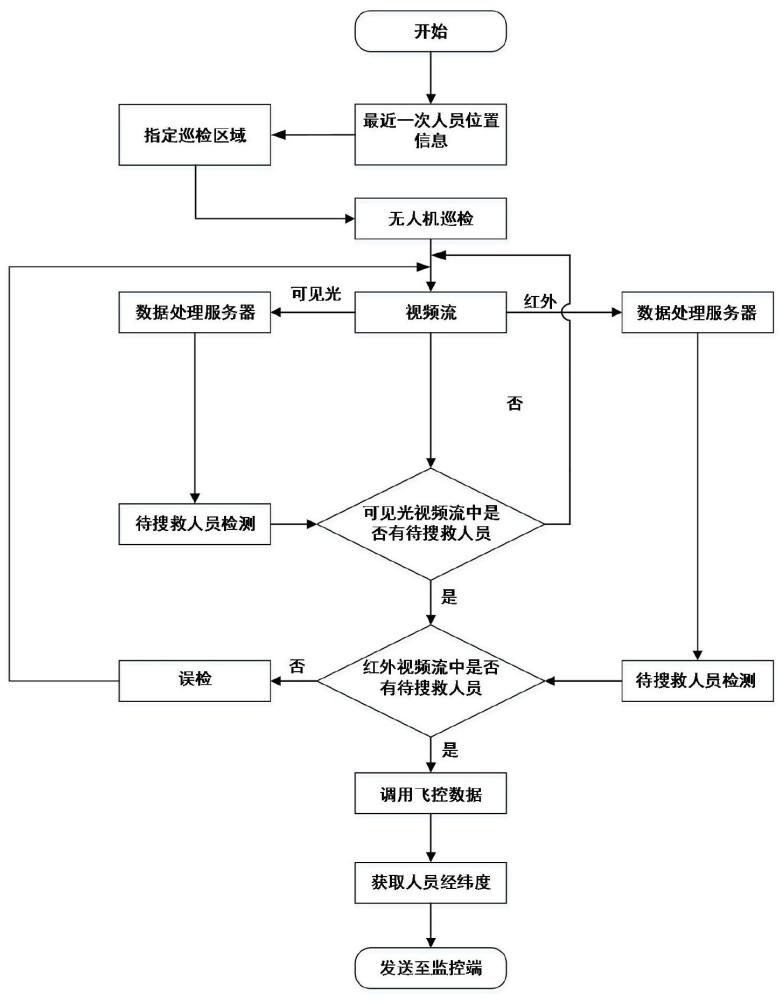

1、针对现有技术的不足,本发明提供了一种基于无人机的人员搜救方法,其通过可见光视频流、红外视频流对待搜救人员进行二次确认,避免因复杂地形等原因造成的误检,同时可大幅提高预测结果的准确性,增强对微小目标的检测能力。

2、为实现上述目的,本发明提供如下技术方案:

3、提供了一种基于无人机的人员搜救方法,其包括如下步骤:

4、s1、控制无人机飞行,使其按照设定的巡航高度和路线对指定区域进行巡检;

5、s2、在无人机巡检过程中,通过无人机云台上搭载的成像设备实时获取同一环境的可见光视频流以及红外视频流;其中,所述成像设备包括可见光相机以及红外相机;

6、s3、根据可见光视频流确定当前环境中是否有待搜救人员,且若确定当前环境中有待搜救人员,则执行步骤s4;

7、s4、根据红外视频流再次确定当前环境中是否有待搜救人员,若再次确定当前环境中有待搜救人员,则执行步骤s5;

8、s5、根据可见光图像中的人体像素点以及无人机的飞控数据获取人员在无人机视角下的经纬度信息。

9、优选的,所述获取人员在无人机视角下的经纬度信息包括如下步骤:

10、s51、完成可见光图像中人体像素点的坐标在三维图像坐标系、二维像素坐标系中的转换;

11、s52、获取从像平面到地平面物理距离的转换关系h/f,其中,h为无人机距离地面的高度;f为可见光相机的焦距;

12、s53、利用下述公式获取当前人体像素点pix_obj相对可见光图像中心像素点pix_cent的横向偏移量dx_pix及纵向偏移量dy_pix:

13、

14、以及利用下述公式将所述横向偏移量dx_pix、纵向偏移量dy_pix从像平面对应转换为成像设备上的横向物理偏移量dx_ccd、纵向物理偏移量dy_ccd:

15、

16、其中,x_pix_obj、x_pix_cent分别为当前人体像素点pix_obj、中心像素点pix_cent的横坐标;y_pix_obj、y_pix_cent分别为当前人体像素点pix_obj、中心像素点pix_cent的纵坐标;dis_per_pix为像元间距;

17、s54、利用下述公式将横向物理偏移量dx_ccd、纵向物理偏移量dy_ccd对应转换为地面的横向偏移量dx_gnd、纵向偏移量dy_gnd:

18、

19、以及通过下述公式得到人体像素点的经度偏移量d_lat以及纬度偏移量d_lon;

20、

21、s55、根据下述公式获取人体在无人机视角下的实际经度real_lat以及实际纬度real_lon;

22、

23、优选的,所述人员搜救方法还包括如下步骤:

24、s6、将包含有待搜救人员的环境图像以及人员在无人机视角下的经纬度信息发送到监控端,并产生报警信息。

25、优选的,步骤s3中,根据可见光视频流确定当前环境中是否有待搜救人员与步骤s4中,根据红外视频流再次确定当前环境中是否有待搜救人员的方法相同,均包括如下步骤:

26、s31、按照每k帧图像抽取1帧的频率,从视频流中抽取m帧图像,并发送至数据处理服务器;

27、s32、对m帧图像均进行预处理;

28、s33、每一张图像经过主干网络backbone的卷积层、批归一化层、激活函数层、最大池化层进行特征提取;

29、再通过双向特征金字塔fpn获取p2、p3、p4、p5共四个输出检测头,且p3、p4、p5三个输出检测头对应作为n3、n4以及n5层,输入至pan结构中;输出检测头p2作为n2层,从pan结构的底部输入;

30、s34、根据下述公式进行动态分配,以选择正样本;

31、t=sα×μβ

32、其中,s为预测类别得分,μ为预测框和真实框的ciou值,α和β为权重超参数;t为预测框和真实框的匹配程度;

33、s35、获取损失函数,且所述损失函数包括边框损失函数iou loss、分布焦点损失函数dfl loss以及分布焦点损失函数bce loss;

34、以及s36、获取预测结果,且根据预测结果确定当前环境中是否有待搜救人员。

35、优选的,所述预处理包括:对每一图像进行缩放,且缩放完毕后,将每一图像的格式均转换为rgb格式;添加批次维度,并转换为张量;以及将张量除以255,以完成归一化处理。

36、优选的,所述ciou值通过如下公式获取:

37、

38、

39、

40、其中,spred为预测框,sgt为真实框,bpred为预测框的中心点坐标,bgt为真实框的中心点坐标,ρ为预测框与真实框中心点的欧氏距离,c为预测框与真实框中最远两点的距离,λ为平衡比例的参数;v用于衡量预测框、真实框的宽高比的一致性;wgt,hgt分别为真实框的宽、高;wpred,hpred分别为预测框的宽、高。

41、优选的,根据下述公式获取边框损失函数iou loss;

42、l ciou=1-ciou

43、其中,lciou为边框损失函数。

44、8.如权利要求4所述的人员搜救方法,其特征在于,根据下述公式获取分布焦点损失函数dfl loss:

45、dfl(si,si+1)=-((yi+1-y)×log(si)+(y-yi)×log(si+1))

46、其中,dfl即为分布焦点损失函数;y、yi、yi+1均为标签label,且满足yi<y<yi+1;si、si+1分别为yi、yi+1的概率输出值。

47、优选的,根据下述公式获取分布焦点损失函数bce loss:

48、lbce(p,y0)=-(y0×log(p))-((1-y0)×log(1-p))

49、其中,lbce即为分布焦点损失函数;p表示预测值,y0表示真实值。

50、优选的,所述步骤s36包括如下步骤:

51、计算预测框之间的交并比iou,以此确定预测框的重叠程度;

52、根据预测框之间的交并比iou过滤预测框;

53、将剩余预测框中得分最高的预测框作为预测结果,并将其得分与预设分数阈值进行比较,若预测框得分大于或等于预设分数阈值,则认为当前环境中有待搜救人员。

54、与现有技术相比,本发明具备以下有益效果:

55、本发明通过可见光视频流、红外视频流对待搜救人员进行二次确认,避免因复杂地形等原因造成的误检,同时仅通过可见光图像中的人体像素点以及无人机的飞控数据即可获取人员在无人机视角下的经纬度信息,无需根据全部可见光图像内容获取人员位置信息。

56、同时,对常规的三头检测的yolov8算法进行改进,通过fpn结构输出4个输出检测头,其中的输出检测头p2可作为pan结构的n2层、从pan结构的底部输入,由此构成改进的双向金字塔结构,大幅提高对微小目标的检测能力。且在进行人体识别时,通过边框损失函数iou loss、分布焦点损失函数dfl loss以及分布焦点损失函数bce loss的构建大幅提高预测结果的准确性。

- 还没有人留言评论。精彩留言会获得点赞!