目标检测方法、目标检测装置与流程

本发明涉及检测,具体涉及一种目标检测方法、目标检测装置。

背景技术:

1、目标检测是计算机视觉中关于图像识别的任务之一,该任务可以定位出目标的位置并对目标进行分类。

2、目标检测方法主要分为基于图像、基于激光点云。基于图像是指通过rgb(红-绿-蓝)图像中丰富的特征信息来定位和识别目标,但相机的成像质量易受光照变化、背景干扰等环境因素影响。基于激光点云是指通过激光点云数据中的深度信息来定位目标,不易受到背景环境干扰。

3、然而,激光雷达有时候对黑色物体的检测并不是很准确,因为黑色物体十分吸光,导致反射回激光雷达的光很少,从而影响到检测的准确度。

技术实现思路

1、本发明为解决上述技术问题,提供了一种目标检测方法,针对激光雷达检测到的点云数据中黑色物体所在区域进行了优化,可以使激光雷达能更准确检测到黑色物体,从而能获得更完整、准确的视场点云数据,将且全景图像与点云数据进行融合,大大提升了目标的检测精度。

2、本发明还提供了一种目标检测装置。

3、本发明采用的技术方案如下:

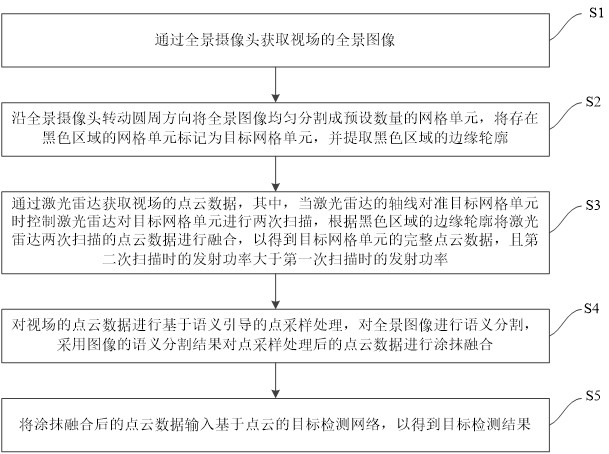

4、本发明的第一方面实施例提出了一种目标检测方法,包括以下步骤:通过全景摄像头获取视场的全景图像;沿全景摄像头转动圆周方向将全景图像均匀分割成预设数量的网格单元,将存在黑色区域的网格单元标记为目标网格单元,并提取黑色区域的边缘轮廓;通过激光雷达获取视场的点云数据,其中,当激光雷达的轴线对准目标网格单元时控制激光雷达对所述目标网格单元进行两次扫描,根据所述黑色区域的边缘轮廓将所述激光雷达两次扫描的点云数据进行融合,以得到所述目标网格单元的完整点云数据,且第二次扫描时的发射功率大于第一次扫描时的发射功率;对所述视场的点云数据进行基于语义引导的点采样处理,对所述全景图像进行语义分割,采用图像的语义分割结果对点采样处理后的点云数据进行涂抹融合;将涂抹融合后的点云数据输入基于点云的目标检测网络,以得到目标检测结果。

5、本发明上述提出的目标检测方法还具有如下附加技术特征:

6、根据本发明一个实施例,通过激光雷达获取视场的点云数据,具体包括:从全景摄像头旋转中心点沿摄像头的转动圆的径向引出一基准线,定义该基准线的角度为0度并建立空间坐标系,旋转中心点为坐标原点;通过目标网格单元的中心点坐标计算出全景摄像头从0度位置转动至对准所述目标网格单元时全景摄像头的转动角度α;根据各个目标网格单元对应的转动角度α计算激光雷达采集所述目标网格单元时的转动角度β;根据所述转动角度β判断所述激光雷达的轴线对准目标网格单元时,控制激光雷达对当前目标网格单元进行两次扫描,以获取目标网格单元的第一组点云数据和第二组点云数据,其中,第一次扫描激光雷达以第一发射功率工作,第二次扫描激光雷达第二发射功率工作,所述第二发射功率大于所述第一发射功率;将所述第一组点云数据中黑色区域的边缘轮廓内的数据剔除得到残缺数据,并提取所述第二组点云数据中黑色区域的边缘轮廓内的数据,将提取到的数据与残缺数据组合得到目标网格单元的完整点云数据;当激光雷达的轴线对准非目标网格单元时,控制激光雷达以第一发射功率进行扫描;重复上述步骤,直至所有网格单元的点云数据扫描完成,得到所述视场的点云数据。

7、根据本发明的一个实施例,上述的目标检测方法还包括:对所述全景摄像头以及激光雷达进行联合标定,使得获取的全景图像和点云数据在时间域与空间域相关联。

8、根据本发明的一个实施例,对所述视场的点云数据进行基于语义引导的点采样处理,具体包括:对点云数据中每个采样点的特征进行编码,以得到每个采样点对应的语义分数;分别计算各个采样点距离该视场的点云数据中的最远点的物理距离,根据所述物理距离以及当前采样点的语义分数计算加权后最远点采样距离;根据计算得到的各个采样点的加权后最远点采样距离对采样点分组,输出分组后的点云数据l和其对应的高级特征。

9、根据本发明的一个实施例,具体采用以下公式计算所述加权后最远点采样距离:;其中,为加权后第i个采样点距离该视场的点云数据中最远点的采样距离,为第i个采样点距离该视场的点云数据中最远点的物理距离,为第i个采样点的语义分数,语义分数∈[0,1],i为采样点的序号,为第i个采样点语义分数的γ次幂,γ为超参。

10、根据本发明的一个实施例,采用图像的语义分割结果对点采样处理后的点云数据进行涂抹融合,具体包括:获取点采样处理后的点云数据以及对图像信息进行语义分割得到的语义分割结果s,通过相机矩阵m和齐次变换矩阵t将点采样处理后的点云数据逐点投影到图像坐标上得到投影结果;将语义分割结果s加到投影结果上以得到涂抹融合后的点云数据。

11、根据本发明的一个实施例,将涂抹融合后的点云数据输入基于点云的目标检测网络,以得到目标检测结果,包括:基于类别感知下采样策略,学习涂抹融合后的点云数据中每个点的语义信息以感知每个点的语义类别,根据每个点的语义类别进行选择性的下采样,以保留前k个前景分数对应的点;基于质心感知下采样策略,利用候选框周围的上下文线索进行质心预测,以保留质心预测得分最高的前n个质心点;对保留的n个质心点进行实例聚合得到质心点特征,根据所述质心点特征输出具有语义类别的预测框。

12、根据本发明的一个实施例,对保留的n个质心点进行实例聚合得到质心点特征,具体包括:对于保留的n个质心点通过pointnet++模块学习每个实例的表示方式,并完成相邻质心点到局部规范坐标系的转换,再通过共享mlp层和对称函数实现质心点特征的聚合。

13、本发明的第二方面实施例提出了一种目标检测装置,包括:图像获取模块,所述图像获取模块用于通过全景摄像头获取视场的全景图像;分割模块,所述分割模块用于沿全景摄像头转动圆周方向将全景图像均匀分割成预设数量的网格单元,将存在黑色区域的网格单元标记为目标网格单元,并提取黑色区域的边缘轮廓;点云获取模块,所述点云获取模块用于通过激光雷达获取视场的点云数据,其中,当激光雷达的轴线对准目标网格单元时控制激光雷达对所述目标网格单元进行两次扫描,根据所述黑色区域的边缘轮廓将所述激光雷达两次扫描的点云数据进行融合,以得到所述目标网格单元的完整点云数据,且第二次扫描时的发射功率大于第一次扫描时的发射功率;融合模块,所述融合模块用于对所述视场的点云数据进行基于语义引导的点采样处理,对所述全景图像进行语义分割,采用图像的语义分割结果对点采样处理后的点云数据进行涂抹融合;目标检测模块,所述目标检测模块用于将涂抹融合后的点云数据输入基于点云的目标检测网络,以得到目标检测结果。

14、本发明上述的目标检测装置还具有如下附加技术特征:

15、根据本发明的一个实施例,所述点云获取模块具体用于:从全景摄像头旋转中心点沿摄像头的转动圆的径向引出一基准线,定义该基准线的角度为0度并建立空间坐标系,旋转中心点为坐标原点;通过目标网格单元的中心点坐标计算出全景摄像头从0度位置转动至对准所述目标网格单元时全景摄像头的转动角度α;根据各个目标网格单元对应的转动角度α计算激光雷达采集所述目标网格单元时的转动角度β;根据所述转动角度β判断所述激光雷达的轴线对准目标网格单元时,控制激光雷达对当前目标网格单元进行两次扫描,以获取目标网格单元的第一组点云数据和第二组点云数据,其中,第一次扫描激光雷达以第一发射功率工作,第二次扫描激光雷达第二发射功率工作,所述第二发射功率大于所述第一发射功率;将所述第一组点云数据中黑色区域的边缘轮廓内的数据剔除得到残缺数据,并提取所述第二组点云数据中黑色区域的边缘轮廓内的数据,将提取到的数据与残缺数据组合得到目标网格单元的完整点云数据;当激光雷达的轴线对准非目标网格单元时,控制激光雷达以第一发射功率进行扫描;重复上述步骤,直至所有网格单元的点云数据扫描完成,得到所述视场的点云数据。

16、本发明的有益效果:

17、本发明针对激光雷达检测到的点云数据中黑色物体所在区域进行了优化,可以使激光雷达能更准确检测到黑色物体,从而能获得更完整、准确的视场点云数据,将且全景图像与点云数据进行融合,大大提升了目标的检测精度。

- 还没有人留言评论。精彩留言会获得点赞!