手术耗材核查方法及手术机器人系统与流程

1.本发明涉及机器人辅助手术技术领域,特别涉及一种手术耗材核查方法及手术机器人系统。

背景技术:

2.微创伤手术是指通过腹腔镜、胸腔镜等内窥镜在人体内实行手术的一种新技术,其具有创伤小、疼痛轻、出血少等优越性,从而能够有效减少病人的恢复时间长、不适应,避免传统手术的一些有害副作用。

3.微创伤手术机器人系统能够使操作者在主操控台处通过二维或三维的显示设备观察病人体内的组织特征,并以遥控方式操控从操作机器人上的机械臂及手术工具器械来完成手术的操作。在机器人手术中,经常需要把一些手术耗材或者辅助物品送入人体,比如缝合线、止血纱布等。在目前的手术中,使用的手术耗材等均通过床旁护士进行管理,术后进行术中使用耗材的核对工作。这种工作方式取决于床旁护士的记录,且一般在术后进行。床旁护士依靠人工盘点术中使用耗材的种类与数量,很有可能出现疏漏。而一旦发生手术耗材遗漏于患者体内,很有可能造成重大医疗事故。

技术实现要素:

4.本发明的目的在于提供一种手术耗材核查方法及手术机器人系统,以解决现有人工统计术中使用耗材易出现疏漏的问题。

5.为解决上述技术问题,根据本发明的第一个方面,提供了一种手术耗材核查方法,其包括:

6.获取术前的手术耗材的第一识别信息;

7.通过图像识别获取术后的手术耗材的第二识别信息;

8.通过内窥镜获取术中留置于预定区域的手术耗材的第三识别信息;

9.判断所述第一识别信息和第二识别信息的差异是否与第三识别信息相同,并输出判断结果。

10.可选的,获取术前的手术耗材的第一识别信息的方法包括:

11.通过图像识别获取手术耗材的第四识别信息;

12.将所述第四识别信息确定为所述第一识别信息。

13.可选的,获取术前的手术耗材的第一识别信息的方法包括:

14.通过图像识别手术耗材的第四识别信息;

15.通过术前录入的手术耗材的输入信息,获取第五识别信息;

16.若所述第四识别信息与所述第五识别信息相同,则将所述第四识别信息或所述第五识别信息确定为所述第一识别信息。

17.可选的,所述第二识别信息或所述第四识别信息的获取步骤包括:

18.获取所述手术耗材的图像信息;

19.根据所述手术耗材的图像信息提取所述手术耗材的特征信息;

20.根据所述手术耗材的特征信息获得所述第二识别信息或所述第四识别信息。

21.可选的,所述根据所述手术耗材的图像信息提取所述手术耗材的特征信息的步骤包括:

22.通过神经网络,提取所述图像信息中的所述手术耗材的特征信息;

23.根据所述特征信息,通过经过训练的分类器获取所述手术耗材的所述第二识别信息或所述第四识别信息。

24.可选的,所述通过神经网络,提取所述图像信息中手术器械的特征信息的方法包括:

25.对所述图像信息进行预处理,以降低所述图片信息的噪声;以及

26.提取经预处理后的图片信息中所述手术器械的特征信息。

27.可选的,对所述图像信息进行预处理,以降低所述图片信息的噪声的方法包括:

28.提取所述图像信息中涵盖目标手术器械的目标区域;

29.对所述目标区域范围内的彩色图像信息进行灰度化处理;

30.扫描灰度化后的图像信息,提取像素值,判断目标区域是否光照均匀:若光照不均匀,则对目标区域进行光照校正,以使目标区域光照均匀;若光照均匀则不进行校正;以及

31.输出经过预处理的图像信息。

32.可选的,所述手术耗材具有唯一性的附加特征,所述第二识别信息或所述第四识别信息的获取步骤包括:

33.获取所述手术耗材的图像信息;

34.根据所述手术耗材的图像信息获取所述手术耗材的附加特征;

35.根据所述附加特征获取所述第二识别信息或所述第四识别信息。

36.可选的,获取所述第六识别信息和所述第七识别信息的步骤包括:

37.获取手术耗材进入内窥镜视野时的第六识别信息,以及手术耗材离开内窥镜视野时的第七识别信息;

38.根据第六识别信息和第七识别信息的差异获得所述第三识别信息。

39.可选的,获取所述第三识别信息的步骤包括:

40.根据所述内窥镜提供的视频信息,判断每帧的帧图像中是否有手术耗材:

41.如果有,则获取所述帧图像中的手术耗材的识别信息,并判断该帧之前的帧、之后的帧的帧图像中是否有手术耗材;

42.如果之前的帧的帧图像中没有所述手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第六识别信息,如果之后的帧的帧图像中没有手术耗材则将该帧的帧图像中的手术耗材的识别信息作为第七识别信息。

43.为解决上述技术问题,根据本发明的第二个方面,还提供了一种手术机器人系统,其包括:内窥镜、识别平台、主控制器;

44.所述主控制器包括内窥镜视野识别模块,用于根据从内窥镜提供的视频获取手术耗材的第三识别信息;

45.所述识别平台用于获取术前手术耗材的第一识别信息和术后手术耗材的第二识别信息;

46.所述主控制器还用于判断所述第一识别信息和所述第二识别信息的差异是否与所述第三识别信息相同,并输出判断结果。

47.可选的,所述内窥镜视野识别模块用于根据所述内窥镜提供的视频信息,获取手术耗材进入内窥镜视野时的第六识别信息,以及手术耗材离开内窥镜视野时的第七识别信息,并根据所述第六识别信息和所述第七识别信息的差异获得所述第三识别信息。

48.可选的,所述内窥镜视野识别模块用于根据所述内窥镜提供的视频信息,判断每帧的帧图像是否有手术耗材,如果有,则获取所述帧图像中的手术耗材的识别信息,同时获取该帧之前的帧、之后的帧的帧图像中是否有手术耗材,如果之前的帧的帧图像中没有手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第六识别信息,如果之后的帧的帧图像中没有手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第七识别信息。

49.可选的,所述内窥镜视野识别模块用于根据帧图像获取所述手术耗材的特征信息,进而根据所述特征信息,获取所述手术耗材的识别信息,或者,

50.所述内窥镜视野识别模块用于根据帧图像获取所述手术耗材的具有唯一性的附加特征,并根据所述附加特征获取所述手术耗材的识别信息。

51.可选的,所述识别平台包括支撑台面,图像采集模块和识别处理器;

52.所述支撑台面用于供手术耗材放置;

53.所述图像采集模块设置于所述支撑台面的上方,并与所述识别处理器通信连接;所述图像采集模块用于采集放置于所述支撑台面上的手术耗材的图像信息,并将所述图像信息传输至所述识别处理器;

54.所述识别处理器用于通过所述图像采集模块所采集的图像信息识别获取术后的手术耗材的第二识别信息。

55.可选的,所述识别平台包括支撑台面,图像采集模块和识别处理器;

56.所述支撑台面用于供手术耗材放置;

57.所述图像采集模块设置于所述支撑台面的上方,并与所述识别处理器通信连接;所述图像采集模块用于采集放置于所述支撑台面上的手术耗材的图像信息,并将所述图像信息传输至所述识别处理器;

58.所述识别处理器用于通过所述图像采集模块所采集的图像信息识别获取术前的手术耗材的第四识别信息,并将第四识别信息确认为第一识别信息。

59.可选的,所述识别处理器还用于通过所述图像采集模块所采集的图像信息识别获取术前的手术耗材的第四识别信息,并将第四识别信息确定为所述第一识别信息。

60.可选的,所述识别处理器包括图像识别模块和图像处理模块,所述图像识别模块分别与所述图像采集模块和所述图像处理模块通信连接,所述图像识别模块用于根据所述图像采集模块获取的图像信息,通过神经网络,提取所述图像信息中手术耗材的特征信息,并将所述特征信息传输至所述图像处理模块;所述图像处理模块根据所述特征信息,获得所述手术耗材的识别信息。

61.可选的,所述图像识别模块包括:预处理单元及提取单元;

62.所述预处理单元用于对所述图像信息进行预处理,以降低所述图像信息的噪声;

63.所述提取单元与所述预处理单元通信连接,用于通过训练好的神经网络,提取经所述预处理单元预处理后的图像信息中所述手术耗材的特征信息。

64.可选的,所述预处理单元包括:特征选择子单元、灰度化子单元与光照校正子单元;

65.所述选择子单元用于确定所述手术耗材需要提取的特征信息所在的图像区域;所述灰度化子单元用于当目标区域为彩色图像时,将目标区域的图像进行灰度化处理;所述光照校正子单元用于当目标区域光照不均匀时将经过灰度化处理的目标区域图像进行校正。

66.可选的,所述图像处理模块包括测试单元,所述测试单元与所述图像识别模块通信连接,用于将所述特征信息通过经过训练的分类器获取所述识别信息。

67.可选的,所述手术机器人系统还包括输入组件,所述识别平台包括图像采集模块和识别处理器;

68.所述输入组件与所述识别处理器通信连接,所述输入组件用于输入手术耗材的输入信息,所述识别处理器用于根据所述输入信息获取手术耗材的第五识别信息;

69.所述图像采集模块与所述识别处理器通信连接,用于采集所述手术耗材的图像信息,并将所述图像信息传输至所述识别处理器;

70.所述识别处理器用于通过所述图像采集模块所采集的图像信息获取术前手术耗材的第四识别信息,并判断所述第四识别信息与所述第五识别信息是否相同,若所述第四识别信息与所述第五识别信息相同,则将所述第四识别信息或所述第五识别信息确定为所述第一识别信息。

71.综上所述,在本发明提供的手术耗材核查方法及手术机器人系统中,所述手术耗材核查方法包括:获取术前的手术耗材的第一识别信息;通过图像识别获取术后的手术耗材的第二识别信息;通过内窥镜获取术中留置于预定区域的手术耗材的第三识别信息;判断所述第一识别信息和第二识别信息的差异是否与第三识别信息相同,并输出判断结果。

72.本发明提供的手术耗材核查方法及手术机器人系统可以方便地判断手术过程是否存在手术耗材遗漏的现象,方便耗材核查及术后评估等。

附图说明

73.本领域的普通技术人员将会理解,提供的附图用于更好地理解本发明,而不对本发明的范围构成任何限定。其中:

74.图1是本发明一实施例的手术机器人系统的示意图;

75.图2是本发明一实施例的手术机器人系统的医生端控制装置的示意图;

76.图3是本发明一实施例的手术机器人系统的患者端控制装置;

77.图4是本发明一实施例的手术机器人系统的图像端的示意图;

78.图5是本发明一实施例的识别平台的示意图;

79.图6是本发明一实施例的识别平台的组成模块示意图;

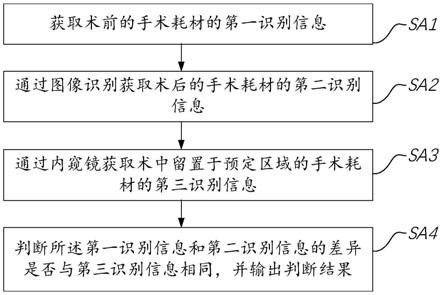

80.图7是本发明一实施例的手术耗材核查方法的流程图;

81.图8是本发明一实施例的图像采集模块所采集的手术耗材的图像信息的示意图;

82.图9a~图9d是本发明一实施例的内窥镜所采集的手术耗材的图像的示意图;

83.图10是本发明一实施例的获取第一识别信息的步骤的流程图;

84.图11是本发明一实施例的获取第二识别信息或第四识别信息的步骤的流程图;

85.图12是本发明一实施例的获取第二识别信息或第四识别信息的进一步步骤的流程图;

86.图13是本发明一实施例的获取第三识别信息的步骤的流程图;

87.图14是本发明一实施例的通过附加特征获取第二识别信息或第四识别信息的步骤的流程图。

88.附图中:

89.100

‑

医生端控制装置;101

‑

主操作手;102

‑

成像设备;103

‑

脚踏手术控制设备;

90.200

‑

患者端控制装置;201

‑

手术调整臂;202

‑

手术工作臂;203

‑

手术器械;204

‑

立柱;205

‑

手术耗材;

91.300

‑

图像端;301

‑

内窥镜;302

‑

内窥镜处理器;303

‑

显示设备;

92.400

‑

识别平台;401

‑

图像采集模块;402

‑

支撑台面;403

‑

显示模块;404

‑

识别处理器;4041

‑

图像识别模块;40411

‑

预处理单元;40412

‑

提取单元;40421

‑

测试单元;40422

‑

训练单元;4042

‑

图像处理模块;405

‑

存储模块;

93.500

‑

主控制器。

具体实施方式

94.为使本发明的目的、优点和特征更加清楚,以下结合附图和具体实施例对本发明作进一步详细说明。需说明的是,附图均采用非常简化的形式且未按比例绘制,仅用以方便、明晰地辅助说明本发明实施例的目的。此外,附图所展示的结构往往是实际结构的一部分。特别的,各附图需要展示的侧重点不同,有时会采用不同的比例。

95.如在本发明中所使用的,单数形式“一”、“一个”以及“该”包括复数对象,术语“或”通常是以包括“和/或”的含义而进行使用的,术语“若干”通常是以包括“至少一个”的含义而进行使用的,术语“至少两个”通常是以包括“两个或两个以上”的含义而进行使用的,此外,术语“第一”、“第二”、“第三”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”、“第三”的特征可以明示或者隐含地包括一个或者至少两个该特征,术语“近端”通常是靠近操作者的一端,术语“远端”通常是靠近患者(即靠近病灶)的一端,“一端”与“另一端”以及“近端”与“远端”通常是指相对应的两部分,其不仅包括端点,除非内容另外明确指出外。

96.本发明的目的在于提供一种手术耗材核查方法及手术机器人系统,以解决现有人工统计术中使用耗材易出现疏漏的问题。

97.以下参考附图进行描述。

98.请参考图1至图14,其中,图1是本发明一实施例的手术机器人系统的示意图;图2是本发明一实施例的手术机器人系统的医生端控制装置的示意图;图3是本发明一实施例的手术机器人系统的患者端控制装置;图4是本发明一实施例的手术机器人系统的图像端的示意图;图5是本发明一实施例的识别平台的示意图;图6是本发明一实施例的识别平台的组成模块示意图;图7是本发明一实施例的手术耗材核查方法的流程图;图8是本发明一实施例的图像采集模块所采集的手术耗材的图像信息的示意图;图9a~图9d是本发明一实施例的内窥镜所采集的手术耗材的图像的示意图;图10是本发明一实施例的获取第一识别信息的步骤的流程图;图11是本发明一实施例的获取第二识别信息或第四识别信息的步骤

的流程图;图12是本发明一实施例的获取第二识别信息或第四识别信息的进一步步骤的流程图;图13是本发明一实施例的获取第三识别信息的步骤的流程图;图14是本发明一实施例的通过附加特征获取第二识别信息或第四识别信息的步骤的流程图。

99.如图1所示,本发明一实施例提供一种手术机器人系统,所述手术机器人系统包括医生端控制装置100、患者端控制装置200、图像端300及主控制器500。即所述手术机器人系统为主从遥操作机器人,但是本发明不限于主从遥操作机器人,其他使用内窥镜辅助手术操作的手术机器人均在本发明保护范围内。

100.请参考图2,所述医生端控制装置100为手术机器人的操作端,并包含安装其上的主操作手101。所述主操作手101用于接收操作者的手部运动信息,以作为整个系统的运动控制信号输入。可选的,所述主控制器500亦设置在所述医生端控制装置100上。优选的,医生端控制装置100还包括成像设备102,所述成像设备102可为操作者提供立体图像,为操作者进行手术操作提供手术操作信息。所述手术操作信息包括手术器械及手术耗材类型、数量、在腹中的位姿,病患器官组织以及周围器官组织血管的形态、布置等。可选的,医生端控制装置100还包括脚踏手术控制设备103,操作者还可通过脚踏手术控制设备103,完成电切、电凝等相关操作指令的输入。

101.请参考图3,患者端控制装置200为手术机器人系统的具体执行平台,并包括立柱204及安装于其上的手术执行组件。所述手术执行组件包括机械臂和手术器械203。在一个实施例中,所述机械臂包括手术调整臂201和手术工作臂202。所述手术工具臂202为机械不动点机构,用于驱动手术器械203围绕机械不动点运动,所述手术调整臂201用于调整所述不动点在工作空间的位置。在另外一个实施例中,所述机械臂为一个至少具有六个自由度的空间构型的机构,用于在程序控制下驱动手术器械203围绕一主动不动点运动。所述手术器械203用于执行具体的手术操作,如夹、切、剪等操作。

102.主控制器500分别与医生端控制装置100、患者端控制装置200通信连接,用于根据主操作手101的运动控制手术执行组件的运动。具体而言,所述主控制器包括主从映射模块,所述主从映射模块用于获取所述主操作手101的末端位姿,以及预定的主从映射关系,获得手术执行组件的期望末端位姿,进而控制机械臂驱动手术器械203运动到期望的末端位姿。进一步,所述主从映射模块还用于接收器械功能操作指令(如电切、电凝等相关操作指令),控制器械的能量驱动器,以释放能量实现电切、电凝等手术操作。

103.如图4所示,所述图像端300包括内窥镜301及与所述内窥镜301通信连接内窥镜处理器302。所述内窥镜301用于获取腔内(指患者的体腔内)的手术操作信息。所述内窥镜处理器302用于对所述内窥镜301所获取的手术操作信息进行图像化处理,并传输至所述成像设备102,以便于操作者通过眼部观察到手术操作信息。可选的,所述图像端300还包括显示设备303。所述显示设备303与所述内窥镜处理器302通信连接,用于为辅助操作者(例如护士)实时提供显示手术操作信息。

104.手术中,操作者坐在位于无菌区之外的医生端控制装置100前,通过成像设备102观察传回的手术操作信息,并通过操作主操作手101来控制手术执行组件和内窥镜运动,以完成各种手术操作。

105.进一步,所述主控制器500还包括内窥镜视野识别模块,所述内窥镜视野识别模块与所述内窥镜处理器302通信连接,用于获取术中留置于预定区域的手术耗材的第三识别

信息。

106.示范性的,所述内窥镜视野识别模块被配置为,当有手术耗材进入内窥镜视野时,被触发获取第六识别信息,当有手术耗材离开内窥镜视野时,被触发获取第七识别信息,根据第六识别信息和第七识别信息的差异获得所述第三识别信息。具体而言,在手术过程中,如需使用或移除手术耗材时,手术耗材必将出现在内窥镜301的视野内。即当送入或取出手术耗材时,操作者必然会将内窥镜301调整至可清楚观察手术耗材的使用位置的状态。因此,可通过对比内窥镜301所采集的前后帧的帧图像之间的对比,来判断手术耗材是否进入或离开腔内。本实施例中,“前后帧”之间可以是连续,也可以是两者之间间隔若干帧。对此本实施例没有特别的限制。

107.如图9a~图9d所示,图9a和图9b所示为时间维度上前后的两帧的帧图像,图9a所示的第一帧图像中,内窥镜视野范围内无手术耗材203,图9b所示的第二帧图像中,内窥镜视野范围内有手术耗材203,则认为操作者通过手术器械向患者体内送入手术耗材203供手术使用。通过对前后帧的帧图像的对比,当出现如图9a和图9b所示的帧图像,则触发内窥镜视野识别模块将图9b所示的第二帧图像中的手术耗材203的识别信息作为第六识别信息。图9c和图9d所示为时间维度上前后的两帧的帧图像,其中图9c所示的第三帧图像中,内窥镜视野范围内有手术耗材203,图9d所示的第四帧图像中,内窥镜视野范围内无手术耗材203,由此确定该手术耗材203被取出离开腔内。通过对前后帧的帧图像的对比,当出现如图9c和图9d所示的帧图像,则触发内窥镜视野识别模块将图9c所示的第三帧图像中的手术耗材203的识别信息作为第七识别信息。需要说明的,在一些特别的情况下,若所有的手术耗材均被留置于腔内时,可能仅能获取到第六识别信息,而获取不到取出的手术耗材的第七识别信息,此时可将第七识别信息设定为空信息,第三识别信息同样可根据第六识别信息和第七识别信息(空信息)的差异来获得。利用内窥镜301来获取手术耗材203的使用信息,仅需对软件进行更新,不需要额外添置其它的硬件设备,成本低,可靠性高。

108.本实施例对如何在内窥镜视野下获取识别信息的方法没有特别的限制。例如,所述内窥镜视野识别模块根据帧图像获取手术耗材的特征信息,例如为颜色,纹理,形状等,进而根据手术耗材的特征信息,获取手术耗材的识别信息,如可通过人工智能等方式获取手术耗材的识别信息。又例如,在术前将手术耗材附加具有唯一性的附加特征,所述内窥镜视野识别模块根据所述附加特征获取手术耗材的识别信息。

109.更进一步的,所述内窥镜视野识别模块通过所述内窥镜处理器302获取内窥镜采集的视频信息,并将每帧的帧图像做判断是否有手术耗材在其中;如果有,则一方面获取手术耗材的识别信息,另一方面判断该帧之前的帧或者之后的帧的帧图像中是否有手术耗材,如果该帧之前的帧的帧图像中没有手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第六识别信息,如果之后的帧的帧图像中没有手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第七识别信息。这里判断是否有手术耗材在每帧的帧图像中,包含原来没有手术耗材而出现手术耗材的情况,也包含原来有手术耗材,而出现新的手术耗材的情况。为方便手术耗材203的数量与种类核查,所述内窥镜视野识别模块将获取第六识别信息或第七识别信息时对视频信息分段标记。即当识别到手术耗材203进入或离开时,所述内窥镜视野识别模块将获取手术耗材203进入或离开时前后若干帧的视频信息进行标记,供术后核查该类耗材的实际发生使用时信息,方便操作者进行核对检查。

110.进一步,所述手术机器人还包括识别平台400,所述识别平台400用于获取术前手术耗材的第一识别信息和术后手术耗材的第二识别信息。如图5和图6所示,所述识别平台400包括:图像采集模块401、支撑台面402及识别处理器404。其中,所述支撑台面402用于供手术耗材放置;所述图像采集模块401设置于所述支撑台面402的上方,并与所述识别处理器404通信连接;所述图像采集模块401用于采集放置于所述支撑台面402上的手术耗材的图像信息,并将所述图像信息传输至所述识别处理器404;所述识别处理器404与所述图像采集模块401通信连接,所述识别处理器404用于根据所述手术耗材的图像信息,得到所述手术耗材的识别信息。由此,识别处理器404可以获得术后的手术耗材的第二识别信息或术前的手术耗材的第一识别信息。优选的,所述支撑平台402包括多个预设区域,每个预设区域用于容纳一个手术耗材205。如图8所示,同一类的手术耗材205放置在同一列,不同的手术耗材205放置在不同的列。如此,手术耗材205的摆放按类别分类排列,同类别的整齐排行,便于对手术耗材205进行识别。

111.进而,所述主控制器500还用于判断第一识别信息与第二识别信息的差异是否与第三识别信息相同,并输出判断结果。若第一识别信息与第二识别信息的差异与第三识别信息相同,则说明手术耗材均按预期使用于人体的腔内,或者手术耗材全部从人体腔内取出;而若第一识别信息与第二识别信息的差异与第三识别信息不同,则说明手术耗材可能存在遗漏或非正常消耗等问题。进一步,所述主控制器500可选控制报警装置输出第一报警信号,以提醒操作者进行核查。本发明对第一报警信号不作特别的限制,本领域技术人员可根据现有技术对第一报警信号进行设置,如通过声音、灯光或者通过用户交互界面进行用户错误提示等。

112.在本实施例中,所述识别处理器404与所述主控制器500分别独立设置。在其他实施例中,所述识别处理器404与所述主控制器500一体化设计,例如所述识别处理器404的相应功能作为功能模块与主控制器500中的其他模块(例如主从映射模块)共同整合在主控制器500中。

113.需要说明的,本实施例对手术耗材的类型没有特别的限制,例如为缝合线,医用海绵,止血海绵,止血纱布等。同样,本实施例对手术器械的类型没有特别的限制,例如为手术刀、剪、针等。优选的,所述识别信息包括手术耗材的识别特征分类,以及每个所述识别特征分类下的手术耗材的数量。相应的,手术耗材的第一识别信息包括术前手术耗材的识别特征分类,以及每个识别特征分类下的手术耗材的数量;第二识别信息包括术后手术耗材的识别特征分类,以及每个识别特征分类下的手术耗材的数量。进一步,识别特征分类包括手术耗材的类别和规格等,例如不同型号的海绵等。

114.在一些实施例中,所述支撑平台402包括多个预设区域,每个预设区域用于容纳一个手术耗材205。如图7所示,同一类的手术耗材205放置在同一列,不同的手术耗材205放置在不同的列。如此,手术耗材205的摆放按类别分类排列,同类别的整齐排行,便于对手术耗材205进行识别。

115.在一些实施例中,所述图像采集模块401通过一支臂设置于所述支撑台面402的上方,并与所述识别处理器404通信连接。所述图像采集模块401用于采集放置于所述支撑台面上的手术耗材的图像信息,并将所述图像信息传输至所述识别处理器404。

116.在一些实施例中,所述识别处理器404包括图像识别模块4041和图像处理模块

4042。所述图像识别模块4041分别与图像采集模块401和所述图像处理模块4042通信连接,所述图像识别模块4041用于根据所述图像采集模块401获取的图像信息,通过神经网络,提取所述图像信息中手术耗材的特征信息,并将所述特征信息传输至所述图像处理模块4042。所述图像处理模块4042根据所述特征信息,获得所述手术耗材的识别信息。可选的,所述特征信息包括:所述图像信息中对应的手术耗材的形状、纹理和颜色中的至少一者。

117.可选的,所述图像识别模块4041包括预处理单元40411和提取单元40412。其中,所述预处理单元40411用于对所述图像信息进行预处理,以降低所述图像信息的噪声,对图像信息进行预处理的具体方法,请参考下文的详细描述;所述提取单元40412与所述预处理单元40411通信连接,用于通过训练好的神经网络,提取经所述预处理单元40411预处理后的图像信息中手术耗材的特征信息。

118.可选的,所述图像处理模块4042包括测试单元40421。所述测试单元40421与所述图像识别模块4041通信连接,用于将所述特征信息通过经过训练的分类器获取所述识别信息。在本实施例对所述分类器的具体类型没有特别的限制,例如为支持向量机(svm),贝叶斯分类器,knn算法,adaboosting方法,rocchio算法等。进一步,所述图像处理模块4042还包括训练单元40422,用于训练所述分类器。例如,所述分类器为支持向量机,将非线性的训练集通过合适的核函数,例如高斯径向基函数,转化为高维空间中的线性训练集,然后再引入支持向量机,并进行数据评估优化,以获得经过训练的支持向量机。

119.可选的,所述预处理单元40412包括特征选择子单元、灰度化子单元与光照校正子单元。其中,所述选择子单元用于确定手术耗材需要提取的特征信息所在的图像区域;所述灰度化子单元用于当目标区域为彩色图像时,将目标区域的图像进行灰度化处理;所述光照校正子单元用于当目标区域光照不均匀时将经过灰度化处理的目标区域图像进行校正。本实施例对实现图像灰度化的具体方法没有特别的限制。例如,对于rgb格式的图像,可以取对人眼比较敏感的g值作为灰度值,也可以对r值,g值以及b值做加权获得灰度;对于yuv编码或yc

b

c

r

编码的图像,则直接取每个像素点的y值作为灰度值。同样,本实施例对实现光照不均匀校正的方法没有特别的限制。例如,基于retinex理论的算法、直方图均衡化(he)方法、非锐化掩膜法、形态学滤波法、基于空间照度图的方法或基于二维伽马函数的自适应校正方法等。

120.进一步的,在一些实施例中,所述识别处理器404还用于通过所述图像采集模块401所采集的图像信息识别获取术前的手术耗材的第四识别信息,并将第四识别信息确定为所述第一识别信息。在一些实施例中,识别处理器404所述第四识别信息不再做校验,所述识别处理器404直接将所述第四识别信息作为第一识别信息传输给所述主控制器500。在其他实施例中,识别处理器404也可对所述第四识别信息进行校验后,再将所述第四识别信息作为第一识别信息传输给所述主控制器500。

121.具体而言,所述识别平台400还包括输入组件。所述输入组件与识别处理器404通信连接,所述输入组件用于输入手术耗材的输入信息。所述输入信息与所述手术耗材的第五识别信息相关联,可以是手术耗材的至少一部分的识别信息,或者是手术耗材附加的信息,例如二维码、条形码。所述识别处理器404用于根据所述输入信息获取手术耗材的第五识别信息,在一个可替代的实施例中,输入组件包括与识别处理器404通信连接的麦克风、鼠标、键盘、扫描枪或nfc读卡器等。所述图像处理模块4042通过输入组件的输入信息获得

手术耗材的第五识别信息。当然在另外的一些实施例中,识别处理器404也可不通过图像采集模块401来采集第四识别信息,而直接将输入的第五识别信息作为第一识别信息传输给所述主控制器500。

122.更具体的,所述机器人预设有手术耗材的类别、规格与输入信息的关联关系。在手术前,操作者通过输入组件输入手术耗材的输入信息,识别处理器404即得到所需手术耗材的识别特征分类及数量(即第五识别信息)。继而操作者将手术耗材摆放至支撑台面402上,图像采集模块401将识别实际放置在支撑台面402上的手术耗材的识别特征分类及数量(即第四识别信息)。通过对比第四识别信息与第五识别信息,可知录入的手术耗材与图像识别出的手术耗材之间的对比情况。如第四识别信息与第五识别信息完全相同,则第四识别信息校验成功,识别处理器404将第四识别信息或第五识别信息确定为术前的手术耗材的第一识别信息。进一步,如第四识别信息与第五识别信息之间存在差异,则识别处理器404控制所述报警装置输出第二报警信号。本发明对第二报警信号不作特别的限制,第二报警信号的具体实现形式可参考第一报警信号,但应与第一报警信号形成区别。

123.优选的,所述手术机器人还包括显示模块403。所述显示模块403与所述主控制器通信连接,用于显示所述第一识别信息,第二识别信息、第三识别信息和判断结果中至少一者。进一步,输入组件包括设置在显示模块403上的触摸件,两者形成触摸屏,操作者可直接在触摸屏上进行输入输入信息。

124.在一个示范性的实施例中,当第一识别信息和第二识别信息的差异与第三识别信息核对一致的时候系统提示通过,显示模块上显示绿色或打勾“√”,经过操作者再次确认无误后,可确认手术结束。

125.当第一识别信息和第二识别信息的差异与第三识别信息核对不一致的时候系统提示不通过,显示模块上显示红色或打叉

“×”

,操作者应查找原因,如果确认该手术耗材已被消耗或使用于人体内,可进行人工干预,并做好记录和处置方案。

126.在一个可替代的实施例中,所述手术机器人还包括存储模块。所述存储模块与内窥镜视野识别模块通信连接,用于存储手术耗材203进入或离开当时前后若干帧的视频信息。所述存储模块还分别与内窥镜、图像采集模块401和识别处理器404通信连接,用于存储内窥镜采用的视频信息、图像采集模块401所采集的图像信息、预处理后的预处理图像等信息。

127.请参考图7,基于上述配置,本发明一实施例提供一种手术耗材核查方法,其包括:

128.步骤sa1:获取术前的手术耗材的第一识别信息;

129.步骤sa2:通过图像识别获取术后的手术耗材的第二识别信息;

130.步骤sa3:通过内窥镜获取术中留置于预定区域的手术耗材的第三识别信息;

131.步骤sa4:判断所述第一识别信息和第二识别信息的差异是否与第三识别信息相同,并输出判断结果。

132.所述手术耗材的识别信息包括术前获得的第一识别信息与术后获得的第二识别信息。在一些实施例中,第一识别信息可以通过图像识别的方式来获得。

133.可选的,步骤sa1中获取术前的手术耗材的第一识别信息的方法包括:

134.步骤sa11a:通过图像识别获取的手术耗材的第四识别信息;该步骤中,如可与术前将手术耗材放置于支撑台面402上,对放置于支撑台面402上的手术耗材的具体识别方法

可参考前文,此处不再重复说明;

135.步骤sa12b:将所述第四识别信息确定为所述第一识别信息。

136.可选的,请参考图10,步骤sa1中获取术前的手术耗材的第一识别信息的方法包括:

137.步骤sa11b:通过图像识别获取手术耗材的第四识别信息;

138.步骤sa12b:获取术前录入的手术耗材的第五识别信息;

139.步骤sa13b:判断所述第四识别信息与所述第五识别信息是否相同;

140.若所述第四识别信息与所述第五识别信息相同,则将所述第四识别信息或所述第五识别信息确定为所述第一识别信息;

141.若所述第四识别信息与所述第五识别信息相异,则触发第二报警信号。

142.优选的,如图11所示,通过图像识别获取手术耗材的所述第二识别信息或所述第四识别信息的步骤包括:

143.步骤sa21a:获取所述手术耗材的图像信息;

144.步骤sa22a:根据所述手术耗材的图像信息提取所述手术耗材的特征信息;

145.步骤sa23a:根据所述手术耗材的特征信息获得所述第二识别信息或所述第四识别信息。

146.进一步的,请参考图12,根据所述手术耗材的图像信息提取所述手术耗材的特征信息的步骤包括:

147.步骤sa25:通过神经网络,提取所述图像信息中的所述手术耗材的特征信息;

148.步骤sa26:根据所述特征信息,通过经过训练的分类器获取所述手术耗材的所述第二识别信息或所述第四识别信息。

149.优选的,通过神经网络,提取图像信息中手术耗材的特征信息的方法包括:

150.步骤sc21:对所述图像信息进行预处理,以降低所述图像信息的噪声;

151.步骤sc22:提取经预处理后的图像信息中所述手术耗材的特征信息。

152.通过神经网络,提取和识别所述图像信息的特征信息的步骤中,预处理单元40411首先针对图像采集模块401所采集的手术耗材的图像信息进行预处理,以降低图像的噪声;进而提取图像中手术耗材的特征信息,优选提取显著的特征信息(如颜色、形状、纹理)。

153.优选的,在步骤sa23提取所述图像信息中手术耗材的特征信息之前,所述手术耗材识别方法还包括:

154.步骤sc231:提取所述图像信息中涵盖目标手术耗材的图像区域,即提取所述图像信息中的目标区域;目标区域如可为采集到的手术耗材的图像中某个/某些手术耗材的整体或部分所在的图像区域。一方面,支撑台面402上搁置的物品不仅仅包括手术耗材,有可能还包括其他物品,所以要设定目标区域;另一方面,手术耗材可能包括多个特征,不是所有特征对于获取识别信息有帮助,所以需要剔除一部分特征,以减少后续识别的计算量。本实施例对提取所述图像信息中涵盖目标手术耗材的图像区域的具体方法没有特别的限制,例如目标区域也可以是通过人为设定的规则来确定,也可以通过手动的方式来确定。

155.步骤sc232:对所述目标区域范围内的彩色图像信息进行灰度化处理。

156.步骤sc233:扫描灰度化后的图像信息,提取像素值,判断目标区域是否光照均匀,若光照不均匀,则对目标区域进行光照校正,以使目标区域光照均匀,若光照均匀则无需校

正,即不进行校正。进一步,对经过光照校正的图像信息,再次判断目标区域是否光照均匀,若光照不均匀,则对目标区域再进行光照校正,直至目标区域光照均匀。

157.步骤sc234:输出经过预处理的图像信息。

158.优选的,所述步骤sc26中,将所述特征信息通过经过训练的分类器获取所述识别信息。进一步,所述分类器为支持向量机,将非线性的训练集通过核函数,例如高斯径向基函数,转化为高维空间中的线性训练集,然后再引入支持向量机,并进行数据评估优化,获得经过训练的支持向量机。

159.如图14所示,若所述手术耗材包括具有唯一性的附加特征,基于具有唯一性的附加特征的手术耗材,所述第二识别信息或所述第四识别信息的获取步骤包括:

160.步骤sb21b:获取所述手术耗材的图像信息;

161.步骤sb22b:根据所述手术耗材的图像信息获取所述手术耗材的附加特征;

162.步骤sb23b:根据所述附加特征获取所述第二识别信息或所述第四识别信息。

163.在一个示范性的实施例中,如图13所示,步骤sa3中获取第三识别信息的步骤包括:

164.步骤sa31:获取手术耗材进入内窥镜301视野时的第六识别信息,以及手术耗材离开内窥镜301视野时的第七识别信息;

165.步骤sa32:根据第六识别信息和第七识别信息的差异获得所述第三识别信息。

166.进一步,获取所述第六识别信息和所述第七识别信息的步骤包括:

167.根据所述内窥镜提供的视频信息,判断每帧的帧图像中是否有手术耗材:

168.如果有,则获取所述帧图像中的手术耗材的识别信息,并判断该帧之前的帧、之后的帧的帧图像中是否有手术耗材;

169.如果之前的帧的帧图像中没有手术耗材,则将该帧的帧图像中的所述手术耗材的识别信息作为第六识别信息,如果之后的帧的帧图像中没有手术耗材,则将该帧的帧图像中的手术耗材的识别信息作为第七识别信息。

170.综上所述,在本发明提供的手术耗材核查方法及手术机器人系统中,所述手术耗材核查方法包括:获取术前的手术耗材的第一识别信息;通过图像识别获取术后的手术耗材的第二识别信息;通过内窥镜获取术中留置于预定区域的手术耗材的第三识别信息;判断所述第一识别信息和第二识别信息的差异是否与第三识别信息相同,并输出判断结果。

171.本发明提供的手术耗材核查方法及手术机器人系统可以方便地判断手术过程是否存在手术耗材遗漏的现象,方便耗材核查及术后评估等。

172.上述描述仅是对本发明较佳实施例的描述,并非对本发明范围的任何限定,本发明领域的普通技术人员根据上述揭示内容做的任何变更、修饰,均属于权利要求书的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1