一种基于深度学习的高精度旋进旋涡流量计

本发明涉及流量测量,具体地说,涉及一种基于多模态传感器和深度学习的高精度旋进旋涡流量计。

背景技术:

1、旋进旋涡流量计是采用最新微处理技术的一种流量计,具有功能强、流量范围较宽、操作维修简单,安装使用方便等优点。广泛应用于石油、化工、电力、冶金煤炭等各个行业的各种气体计量。

2、其测量原理为:流量传感器的流通剖面类似文丘里管的型线。在入口侧安放一组螺旋型导流叶片(起旋器),当流体进入流量传感器时,导流叶片迫使流体产生剧烈的旋涡流。当流体进入扩散段时,旋涡流受到回流的作用,开始作二次旋转,形成陀螺式的涡流进动现象。该进动频率与流量大小成正比,不受流体物理性质和密度的影响,检测元件测得流体二次旋转进动频率就能在较宽的流量范围内获得良好的线性度。但是这个线性关系依然有一定的不稳定性,且受流体流动过程中的温度和流速等的影响,并且超过一定测量范围时,由于流体的斯特劳哈尔数不能被近似地认为是定值,从而会导致测量精度不高甚至产生很大的误差。为了提高旋进旋涡流量计的测量精度和测量范围,研究者们提出了许多改进方法,如采用对其起旋器的结构进行调整、提升信号处理过程的精确度、加入深度学习模型进行系数修正等。这些方法在一定程度上提高了测量精度,但仍存在一定的局限性。

3、深度学习技术是由神经网络改进而来的,在自然语言处理、目标检测和时间序列分析等方面都显示出强大的能力。这些模型和技术依靠其计算效率和泛化能力达到了比较先进的性能。近年来在流量测量领域也得到了快速的发展,为提升流量计的测量精度提供了一种新思路。深度学习作为一种强大的机器学习方法,通过无监督方式或有监督方式逐层提取被测对象的特征,具有自动提取特征、端到端学习等优点,其特征客观性强,且能够精准、详实的反映被测对象的本质,可以有效地处理复杂的非线性问题。因此,将深度学习应用于旋进旋涡流量计的测量过程中,有望提高流量测量的精度和适应性。

技术实现思路

1、本发明的目的是提供一种基于深度学习的高精度旋进旋涡流量计,特别涉及基于多模态传感器和时域卷积网络的流量测量方法。

2、通过使用温度传感器和压力传感器对流体的温度和压力进行测量,然后利用时域卷积网络提取测量信号中的流量信息特征并进行多元信息特征融合,以实现流量系数k的修正,从而提升旋进旋涡流量计的测量精度和测量范围。

3、为实现上述目的,本发明采用以下技术方案:

4、一种基于深度学习的高精度旋进旋涡流量计,包括:

5、(1)采用温度传感器和压力传感器测量流体流过旋进旋涡流量计起旋器时的温度和压力。

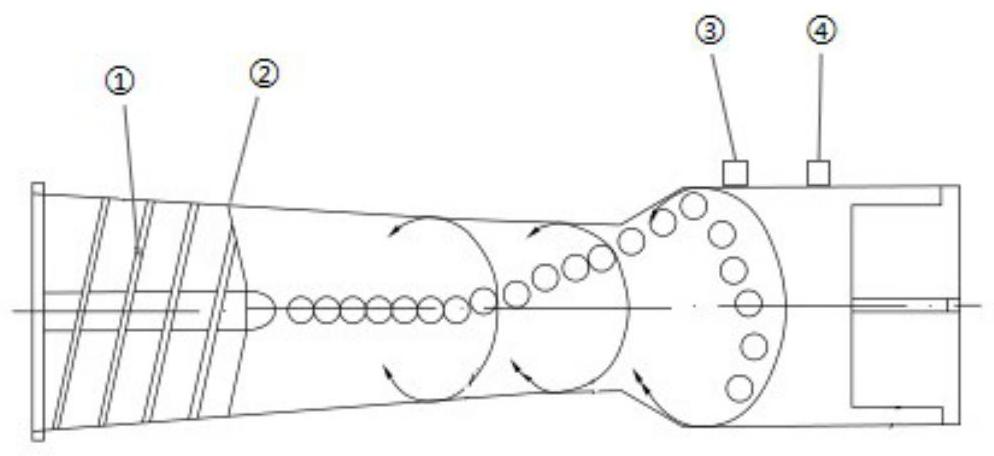

6、如附图1所示,将所设计的旋进旋涡流量计安装在管道上,当流体由管道进入测量管段时,由安装在管道上的温度传感器③和压力传感器④进行流体温度信号和压力信号的采集。温度传感器可分开安装,通过通信将采集的数据传输到主控芯片中。压力传感器部分则是与旋进旋涡流量计的主体和起旋器连在一起的,如附图1所示。压力传感器是通过压敏元件测量流体经过起旋器时产生的微小压力波动,将其转化成电信号并进行放大和处理。并将处理后的压力信号输入到主控芯片中,通过单片机io口的捕捉比较模式对压力信号的频率进行等精度测量。

7、通过测量放大处理后的压力信号的频率可以得到流量信息,在一定的范围内,流体的流速与这个频率是成正比的。多模态传感器部分的测量流程为,温度传感器和压力传感器分别独立地进行测量。在一个采样周期t内,两个传感器分别测量温度和压力,且压力信号要进行一系列的处理和频率的采集,当完成一个周期的采样后,进行下一个周期采样。每一个传感器可采集一路流量波动时间序列信号,共可获取2路传感器测量流量波动信号。

8、(2)构建时域卷积网络tcn模型,用于实现流体流量的温度和压力信号的特征融合及流量计流量系数k的修正。

9、1)对采集到的数据进行预处理

10、①所构建的时域卷积神经网络tcn,首先对多模态传感器部分测量的多元流量信号进行预处理。首先对压力的频率信号和温度信号进行标准化处理,然后使用长度1.5s、重叠率为30%的滑动窗口对数据进行分割以降低数据长度。以斯特劳哈尔数(系数k的一部分)为数据标签,共得到n个带有流量系数标签值的样本。完成数据集的构建。

11、②将含有n个样本的数据集进行随机地划分,具体比例为[训练集:验证集:测试集]=[7:2:1]

12、2)构建时域卷积网络tcn模型

13、①所构建的时域卷积神经网络,其网络结构特征在于,共有2路特征提取网络,分别用于提取流体流动过程中的温度和压力信号的深度特征。如附图2所示,输入层后直接连接时间块,其通道大小与输入层一致,用于提取流体流动信号的特征信息;然后与两个密集层相连,其本质就是全连接层用于提取在时间卷积层中得到的特种,找出特征的关系;通过训练误差最小的adam作为当前tcn模型的最佳优化器来进行训练,最终得到流量系数的预测值。

14、②对于输入层后直接连接的时间块,他是由8个时间卷积块组成的。每个时间卷积块的框架结构如附图3所示。其输入数据维度为批大小*输入数据序列长度*通道,通道大小与输入层一致。然后连接一维因果卷积模块。因果卷积模块是tcn网络模型重要的模块之一。时间序列数据强调时间顺序,单一观测值的数据只有存在于一系列上下文数据点中才有意义,这就需要探究数据点之间的因果关系。

15、因果卷积模块这样计算方式具备两个特性:(1)不存在信息泄露,即不考虑未来,当前的卷积计算结果只与已经观测到的数据相关;(2)因果卷积层堆积的越深,则追溯的历史信息将越久远。因果卷积的条件概率计算公式可以表示为:

16、

17、因果卷积层的堆积可以保证时间序列的因果顺序,但是当时间序列的数据长度延长时,简单堆积这样的卷积层需要足够多的层数才能达到对历史记忆长度的要求。因此tcn网络模型引入空洞卷积模块,即在卷积计算时加入一定长度的空洞,增大了卷积计算的感受野。空洞卷积示意图如附图4所示。

18、对于一个一维的输入序列x∈rt以及过滤器f:{0,...,k-1}→r,空洞卷积的计算定义为:

19、

20、其中f(s)表示在经过一次空洞卷积计算后,新的序列在s位置上的计算结果。d表示空洞因子,d=1,2,4,…,以2的指数幂增加,在不同卷积层空洞间隔不同。k表示的是一维卷积核的尺寸,因此空洞卷积的操作就是指在两个相邻的过滤器之间引入固定的采样间隔,而采样率就由空洞因子d决定。此时感受野的计算公式为:

21、field=(k-1)*d

22、③经过时间块的时间卷积模块后会进行层归一化(layer norm,ln),层归一化是一种用于深度神经网络中的归一化技术。对网络中的每个神经元的输出进行归一化,使得网络中每一层的输出都具有相似的分布,防止过拟合现象的发生。与传统的批归一化(batch normalization,bn)方法相比,ln不需要记忆mini-batch的平均值和方差值,节省了计算时的存储空间。由于tcn的固有特性,它只能“向前看”而不能向后看,零填充操作会延长后面的大小。因此,后面需要连接一个chomp1d层来执行“切割”操作,即零填充长度的扩展大小将被chomp1d层擦除。

23、④由tcn网络提取出的特征向量维度是相同的,卷积网络的每一层计算将提取到不同抽象水平的特征,在最后一层,提取到的特征是高度抽象的,以这一层特征作为分类的依据,可能会丢失中间层的特征。因此为了避免这一问题,网络模型采取了跳层连接机制,即附图2中第二个块的最终dropout是通过对附图3中时间卷积模块的最后一层第8个tcn进行跳层连接操作来实现的。有利于提取到抽象度不同的特征,提高分类准确度。

24、将融合后的特征向量输入到两层密集层中,每个密集层的神经元分别为128个和1个,即附图3中的第三层和第五层。以根据现场标定得到的流量计算得到的的流量系数值作为标签,最终输出预测的流量系数。

25、3)定义网络结构超参数以及评估标准

26、①设置时域卷积网络模型中超参数,使用adam(adaptive moment estimation)优化算法基于训练数据通过梯度反向更新神经网络权重。

27、②构建时域卷积网络模型预测值和标签值间的损失函数

28、计算神经网络每次迭代的前向计算结果与真实值的差距,以最小化差距为准则,指导网络训练与优化向正确的方向进行。

29、使用平均误差损失函数(mse)计算预测值和标签值间差的平方的均值。其表达形式如下:

30、

31、其中,yi、是时域卷积网络模型的标签和预测值,n为样本数目。

32、③对于附图2和附图3中的tcn模型,参数k、p、s、d和v分别表示核大小、零填充、跨距设置、膨胀率和空隙率。选择内核大小为2;选择零填充大小为2,以保证卷积运算后特征大小不变;仔细考虑步幅大小的权衡,较小的步幅可以避免重复计算,降低训练效率,而较大的步幅则可能导致训练数据的信息丢失和关键特征缺失。因此,为了获得最佳的预测结果,将步长设置为1。采用整流线性单元(relu)函数作为激活函数,其函数表达如下所示,消除和克服了梯度消失问题。

33、

- 还没有人留言评论。精彩留言会获得点赞!