超分辨率图像重建的制作方法

超分辨率图像重建

背景技术:

1.超分辨率(super-resolution,sr)图像重建是指基于低分辨率的图像生成高分辨率图像的过程。通过提高图像的分辨率,超分辨率技术可以提高图像的质量,从而能够提供具有更加清晰观感的图像,或者使得图像能够更好地用于后续的图像分析等图像处理任务。超分辨率技术已经被应用于人们生活中的各个方面。

2.随着计算机技术的发展,近年来,除传统的基于插值的方法和基于重建的方法外,还提出了基于机器学习的方法。然而,传统的机器学习方法依赖于成对的高分辨率图像和低分辨率图像。由于现实中往往不存在这样的图像对,一些传统的方案进而通过使用已知的降采样方法生成低分辨率图像以生成图像对,来训练机器学习模型。然而,通过这样的图像对所训练得到的机器学习模型通常只能在处理使用同样的降采样方法所获得的低分辨率图像时获得较好的效果,而难以有效地处理通过其他降采样方法所获得的低分辨率图像。

技术实现要素:

3.根据本公开的实现,提出了用于超分辨率图像重建的方案。根据该方案,具有第一分辨率的输入图像被获取。利用输入图像训练来可逆神经网络,其中可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,并且第二分辨率低于第一分辨率。随后,利用经训练的所述可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,其中第三分辨率高于第一分辨率。该方案能够有效地处理由未知降采样方法获得的低分辨率图像,从而获得高质量的高分辨率图像。

4.提供发明内容部分是为了简化的形式来介绍对概念的选择,其在下文的具体实施方式中将被进一步描述。发明内容部分无意标识要求保护的主题的关键特征或主要特征,也无意限制要求保护的主题的范围。

附图说明

5.图1a示出了能够实施本公开的多个实现的计算设备的示意性框图;

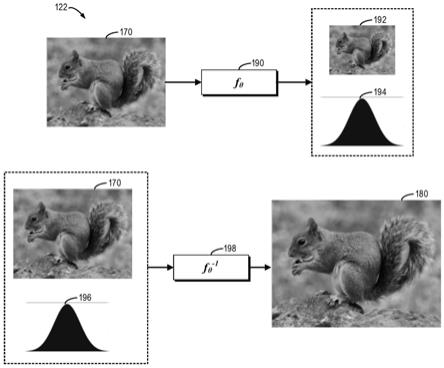

6.图1b示出了根据本公开的实现的图像处理模块的工作原理的示意图;

7.图2a示出了根据本公开的实现的可逆神经网络的示意性框图;

8.图2b示出了根据本公开的实现的示例可逆神经网络单元的示意图;

9.图3示出了根据本公开的实现的训练可逆神经网络的示意图;

10.图4a示出了根据本公开的实现的可逆神经网络的逆网络的示意性框图;

11.图4b示出了根据本公开的实现的示例可逆神经网络单元的示意图;以及

12.图5示出了根据本公开的实现的用于超分辨率图像重建的示例方法的流程图。

13.这些附图中,相同或相似参考符号用于表示相同或相似元素。

具体实施方式

14.现在将参照若干示例实现来论述本公开。应当理解,论述了这些实现仅是为了使得本领域普通技术人员能够更好地理解且因此实现本公开,而不是暗示对本公开的范围的任何限制。

15.如本文所使用的,术语“包括”及其变体要被解读为意味着“包括但不限于”的开放式术语。术语“基于”要被解读为“至少部分地基于”。术语“一个实现”和“一种实现”要被解读为“至少一个实现”。术语“另一个实现”要被解读为“至少一个其他实现”。术语“第一”、“第二”等等可以指代不同的或相同的对象。下文还可能包括其他明确的和隐含的定义。

16.如本文所使用的,“神经网络”能够处理输入并且提供相应输出,其通常包括输入层和输出层以及在输入层与输出层之间的一个或多个隐藏层。神经网络中的各个层按顺序相连,从而前一层的输出被提供作为后一层的输入,其中输入层接收神经网络模型的输入,而输出层的输出作为神经网络模型的最终输出。神经网络模型的每个层包括一个或多个节点(也称为处理节点或神经元),每个节点处理来自上一层的输入。在本文中,术语“神经网络”、“模型”、“网络”和“神经网络模型”可互换使用。

17.如上文所讨论的,超分辨率方法已经被广泛地应用于人们生活的各个方面。传统的超分辨率方法从技术上可以分为三类:(1)基于插值的方法。(2)基于重建的方法。(3)基于学习的方法。

18.随着人工智能技术的快速发展,基于学习的方法已经成为当前最为流行的超分辨率算法。该方法借助训练样本对(高分辨率图像和对应的低分辨率图像)来计算得到高分辨率图像、低分辨率图像之间的先验知识,并建立两者之间的映射模型。

19.传统的基于学习的超分辨方法通常需要依赖于成对的高分辨率图像和低分辨率图像。这样的高/低分辨率的图像对在真实场景中实际是不存在的。因此,一些传统超分辨算法通过人工合成对应的高分辨率图片或低分辨率图像来构建高/低分辨率的图像对。这样的图像对进一步被应用于机器学习模型,以使得该机器学习模型能够利用低分辨率图像来生成高分辨率图像。

20.然而,通过这样的图像对所训练得到的机器学习模型往往通常只能在处理使用同样的降采样方法所获得的低分辨率图像时获得较好的效果。例如,如果用于训练该模型的样本对是通过插值的方法获得的低分辨率图像时,那么该模型往往只能够在对同样通过插值所得到的低分辨率图像进行处理时,才能够获得较好质量的高分辨率图像。

21.在大部分情况下,人们往往不了解所需要处理的低分辨率图像是如何产生的。在这种情况下,超分辨率也被称为盲超分辨率。由于人工构建的图像对所使用的降采样方法往往与需要处理的低分辨率图像的降采样方法不同,这使得所训练得到的机器学习模型可能难以实现高质量的图像超分辨率。

22.根据本公开的实现,提出了一种用于超分率图像重建的方案。在该方案中,利用具有第一分辨率的输入图像来训练可逆神经网络,其中可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,并且第二分辨率低于第一分辨率。随后,利用经训练的可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,其中第三分辨率高于第一分辨率。具体而言,在对可逆神经网络进行训练时,低分辨率的输入图像将转换成更低分辨率的图像,以使得该可逆神经网

络的前向过程能够模拟输入图像位置的降采样方法。随后,可以利用该可逆神经网络的逆网络来处理低分辨率的输入图像,从而获得高分辨率的输出图像。

23.以下进一步结合附图来详细描述该方案的各种示例实现。

24.图1a示出了能够实施本公开的多个实现的计算设备100的框图。应当理解,图1所示出的计算设备100仅仅是示例性的,而不应当构成对本公开所描述的实现的功能和范围的任何限制。如图1所示,计算设备100包括通用计算设备形式的计算设备100。计算设备100的组件可以包括但不限于一个或多个处理器或处理单元110、存储器120、存储设备130、一个或多个通信单元140、一个或多个输入设备150以及一个或多个输出设备160。

25.在一些实现中,计算设备100可以被实现为各种用户终端或服务终端。服务终端可以是各种服务提供方提供的服务器、大型计算设备等。用户终端诸如是任意类型的移动终端、固定终端或便携式终端,包括移动手机、站点、单元、设备、多媒体计算机、多媒体平板、互联网节点、通信器、台式计算机、膝上型计算机、笔记本计算机、上网本计算机、平板计算机、个人通信系统(pcs)设备、个人导航设备、个人数字助理(pda)、音频/视频播放器、数码相机/摄像机、定位设备、电视接收器、无线电广播接收器、电子书设备、游戏设备或者其任意组合,包括这些设备的配件和外设或者其任意组合。还可预见到的是,计算设备100能够支持任意类型的针对用户的接口(诸如“可佩戴”电路等)。

26.处理单元110可以是实际或虚拟处理器并且能够根据存储器120中存储的程序来执行各种处理。在多处理器系统中,多个处理单元并行执行计算机可执行指令,以提高计算设备100的并行处理能力。处理单元110也可以被称为中央处理单元(cpu)、微处理器、控制器、微控制器。

27.计算设备100通常包括多个计算机存储介质。这样的介质可以是计算设备100可访问的任何可以获得的介质,包括但不限于易失性和非易失性介质、可拆卸和不可拆卸介质。存储器120可以是易失性存储器(例如寄存器、高速缓存、随机访问存储器(ram))、非易失性存储器(例如,只读存储器(rom)、电可擦除可编程只读存储器(eeprom)、闪存)或其某种组合。

28.存储设备130可以是可拆卸或不可拆卸的介质,并且可以包括机器可读介质,诸如内存、闪存驱动、磁盘或者任何其他介质,其能够用于存储信息和/或数据并且可以在计算设备100内被访问。计算设备100可以进一步包括另外的可拆卸/不可拆卸、易失性/非易失性存储介质。尽管未在图1中示出,可以提供用于从可拆卸、非易失性磁盘进行读取或写入的磁盘驱动和用于从可拆卸、非易失性光盘进行读取或写入的光盘驱动。在这些情况中,每个驱动可以由一个或多个数据介质接口被连接至总线(未示出)。

29.通信单元140实现通过通信介质与另外的计算设备进行通信。附加地,计算设备100的组件的功能可以以单个计算集群或多个计算机器来实现,这些计算机器能够通过通信连接进行通信。因此,计算设备100可以使用与一个或多个其他服务器、个人计算机(pc)或者另一个一般网络节点的逻辑连接来在联网环境中进行操作。

30.输入设备150可以是一个或多个各种输入设备,例如鼠标、键盘、追踪球、语音输入设备等。输出设备160可以是一个或多个输出设备,例如显示器、扬声器、打印机等。计算设备100还可以根据需要通过通信单元140与一个或多个外部设备(未示出)进行通信,外部设备诸如存储设备、显示设备等,与一个或多个使得用户与计算设备100交互的设备进行通

信,或者与使得计算设备100与一个或多个其他计算设备通信的任何设备(例如,网卡、调制解调器等)进行通信。这样的通信可以经由输入/输出(i/o)接口(未示出)来执行。

31.在一些实现中,除了被集成在单个设备上之外,计算设备100的各个部件中的一些或所有部件还可以以云计算架构的形式被设置。在云计算架构中,这些部件可以被远程布置,并且可以一起工作以实现本公开所描述的功能。在一些实现中,云计算提供计算、软件、数据访问和存储服务,它们不需要终端用户知晓提供这些服务的系统或硬件的物理位置或配置。在各种实现中,云计算使用适当的协议通过广域网(诸如因特网)提供服务。例如,云计算提供商通过广域网提供应用,并且它们可以通过web浏览器或任何其他计算组件被访问。云计算架构的软件或组件以及相应的数据可以被存储在远程位置处的服务器上。云计算环境中的计算资源可以在远程数据中心位置处被合并或者它们可以被分散。云计算基础设施可以通过共享数据中心提供服务,即使它们表现为针对用户的单一访问点。因此,可以使用云计算架构从远程位置处的服务提供商提供本文所描述的组件和功能。备选地,它们可以从常规服务器被提供,或者它们可以直接或以其他方式被安装在客户端设备上。

32.计算设备100可以用于实施根据本公开的多种实现的图像超分辨率重建。存储器120可以包括图像处理模块122,其具有一个或多个程序指令,该模块可以由处理单元110访问和运行,以实现本文所描述的各种实现的功能。

33.在进行超分辨率图像重建时,计算设备100可以通过输入设备150接收输入图像170。在一些实现中,输入图像170例如可以是具有第一分辨率的图像。输入图像170可以被输入到存储器120中的图像处理模块122。图像处理模块122可以利用输入图像170来训练可逆神经网络,以使得该可逆神经网络的正向网络能够模拟输入图像170被降采样的方法。该可逆神经网络能够将输入图像170转换为具有较低分辨率的中间图像。随后,利用该可逆神经网络的逆网络来处理输入图像170,以获得具有更高分辨率的输出图像,从而实现超分辨率图像重建。输出图像180可以经由输出设备160被输出。

34.图1b示出了根据本公开的实现的图像处理模块122的工作原理的示意图。如图1b所示,图像处理模块122可以利用具有第一分辨率的输入图像170来训练可逆神经网络190(被表示为“f

θ”)。该可逆神经网络190被配置为基于输入图像170生成具有较低的第二分辨率的中间图像192和第一高频信息194。进一步地,在利用输入图像170完成可逆神经网络190的训练后,输入图像170和服从预定分布的第二高频信息196被输入到可逆神经网络190的逆网络198(被表示为),以生成具有较高的第三分辨率的输出图像180。在此所述的“预定分布”可以包括但不限于高斯分布、均匀分布等,其可以在可逆神经网络的训练过程中被指定。

35.可逆神经网络(inn)是生成模型中的一种流行的网络结构,其可以指定映射关系m=f

θ

(n)及其逆映射关系inn通常由至少一个可逆块组成。对于第l个块,输入h

l

沿通道轴被划分成和并且经历仿射(affine)变换:

[0036][0037]

[0038]

对应的输出为给定输出,其逆变换可以如下被计算:

[0039][0040][0041]

其中ρ和η可以是任意函数,

⊙

表示同或操作。

[0042]

在将inn应用于图像降采样任务时,基于具有高分辨率的输入图像x,inn不仅可以输出经缩小的低分辨率图像y,还输出服从特定分布的高频信息z,其例如体现为与图像的语义无关的高频噪声。这使得该inn的逆网络能够根据低分辨率图像y和高频信息z来重建高质量的高分辨率图像x。也即,需要维护图像缩小过程中丢失的高频信息z来使图像缩放过程可逆,并且整个图像缩放过程可以利用映射关系(y,z)=f

θ

(x)和来表示。

[0043]

然而,图像超分辨率重建过程中,往往需要对任意的低分辨率图像进行放大。因此,与输入的低分辨率图像相对应的高频信息z通常是不存在的。发明人注意到,根据奈圭斯特香农(nyquist-shannon)采样定理,在图像缩小过程中丢失的信息相当于高频细节。假设与同一低分辨率图像相对应的一组高分辨率图像包括不同的高频细节,这些细节通常可以表现出一定的可变性和随机性。因此,z可以被表示为随机变量,其分布由inn表示z的方式(也即f

θ

输出z的方式)来决定。具体而言,可以训练inn以满足指定分布p(z)。以此方式,在图像超分辨率重建过程中,可以基于低分辨率图像和该指定分布下的任意一个采样来重建高分辨图像。

[0044]

图2a示出了根据本公开的实现的可逆神经网络191的示意性框图。应当理解,如图2a所示的可逆神经网络191的结构仅是示例性的,而无意于限制本公开的范围。本公开的实现也适用于具有不同结构的可逆神经网络。

[0045]

如图2a所示,可逆神经网络191可以由一个或多个下采样模块210串联而成。出于简化目的,在图2a中示出一个下采样模块210。可逆神经网络191所支持的图像缩小的比例可以由每个下采样模块210所支持的图像缩小的比例以及所包含的下采样模块210的个数来决定。例如,假设每个下采样模块210支持将图像缩小2倍并且可逆神经网络191包括2个下采样模块210,则可逆神经网络191支持将图像缩小4倍。

[0046]

如图2a所示,例如,下采样模块210可以包括变换模块230和一个或多个inn单元220-1、220-2

……

220-m(统称为或单独称为“inn单元220”,其中m≥1)。

[0047]

变换模块230可以将具有输入图像170分解成低频分量242和高频分量241,其中低频分量242表示输入图像170的语义,并且高频分量241与该语义有关。在一些实现中,变换模块230可以利用1

×

1可逆卷积块来实现。备选地,变换模块230也可以被实现为小波变换模块,诸如haar变换模块。例如,当变换模块230被实现为haar变换模块时,下采样模块210可以支持将图像缩小2倍。具体而言,haar变换模块可以将具有长度h、宽度w和通道数为c的输入图像或一组特征图转换成输出张量输出张量中的第一个c切片可以近似为等效于双线性插值下采样的低通表示。剩下三组c切片分别包含在垂直方向、水平方

向和对角线方向上的残余分量。这些残余分量基于输入图像170中的高频信息。备选地,变化模块230可以被实现为能够将输入图像170分解成低频分量和高频分量的任何已知或将来开发的变换模块。应当理解,当下采样模块210所支持的图像缩小比例不同时,变换模块230的实现可以是不同的。以此方式,低频信息242和高频信息241可以被馈送到随后的inn单元220-1。

[0048]

如上所述,每个inn单元220的结构应当是可逆的,从而保证神经网络191的网络结构可逆。inn单元220用于从输入的低频分量和高频分量中提取相应特征,并且将与图像语义有关的高频分量转换为服从预定分布且与图像语义无关的高频信息。

[0049]

图2b示出了根据本公开的实现的示例inn单元220的示意图。在此假设输入到inn单元220的低频分量和高频分量分别被表示为和如图2b所示,可以向低频分量应用如上述公式(1)所示的仿射变换,并且向高频分量应用如上述公式(2)所示的仿射变换。图2b中所示的变换函数η和ρ可以是任意函数。应当理解,如图2b所示的inn单元220仅出于示例的目的示出,而无意于限制本公开的范围。本公开的实现也适用于具有其他不同结构的inn单元。inn单元的示例包括但不限于可逆卷积块、可逆残差网络单元、可逆生成网络单元、深度可逆网络单元等等。

[0050]

以下将进一步详细描述可逆神经网络的训练过程。从以上描述能够看出,模型的训练目标是确定高分辨率图像x、低分辨率图像y以及指定分布p(z)之间的映射关系f

θ

。

[0051]

发明人观察到,在一个高分辨率图像在经由未知的降采样方法转换为低分辨率图像后,该低分辨率图像将与高分辨率图像中的对应大小的图像块具有相似的像素分布。基于此,如果可逆神经网络190所生成的中间图像192与输入图像170中的对应图像块具有相似的像素分布,则能够表示可逆神经网络190能够较好地模拟输入图像170的未知降采样方法。

[0052]

基于这一目标,在一些实现中,可以基于中间图像192中的像素分布与输入图像170的具有第二分辨率的图像块中的像素分布之间的差异,确定可逆神经网络190的目标函数(也称为“第一目标函数”)。

[0053]

在一些实现中,可以利用判别器来确定中间图像192与输入图像170中的对应图像块之间的像素分布差异。图3示出了根据本公开实现的训练可逆神经网络190的示意图300。

[0054]

如图3所示,在训练过程中,可以利用判别器330来区分经可逆神经网络190所生成的中间图像192和输入图像170中的对应图像块325的像素分布差异。在一些实现中,图像块325可以是从输入图像中170中随机选择的具有与中间图像192相同像素大小的图像块。

[0055]

在一些实现中,可以基于训练好的生成对抗网络(gan)的判别器330来区分中间图像192的像素是来自中间图像192还是来自图像块325。对应的gan的损失函数可以被确定作为可逆神经网络190的第一目标函数,例如其可以被表示为目标函数l

pd

。应当理解,可以采用任何适当的gan损失函数,例如js散度。

[0056]

附加地或备选地,在一些实现中,在训练可逆神经网络190时,还应当使得可逆神经网络190基于输入图像170生成的第一高频信息194满足预定的分布。具体地,可以基于第一高频信息194的分布与预定分布的差异,确定可逆神经网络190的目标函数(也称为“第二

目标函数”),例如其可以表示为目标函数如上文所讨论的,在此所述的“预定分布”可以包括但不限于高斯分布、均匀分布等。

[0057]

附加地或备选地,在一些实现中,可以基于输入图像170和由可逆神经网络190的逆网络310基于中间图像192而生成的重建图像315之间的差异来确定用于训练可逆神经网络190的目标函数(也称为“第三目标函数”)。具体地,可以将中间图像192和从预定分布采样获得的高频信息输入到逆网络310,以获得重建图像。关于逆网络310的结构将在下文参考图4详细描述。

[0058]

在一些实现中,可以基于输入图像170和重建图像315的l1距离或者l2距离来确定第三目标函数,例如其可以被表示为目标函数l

recon

。

[0059]

附加地或备选地,在一些实现中,如图3所示,也可以利用训练好的判别器320来区分输入图像170和重建图像315来确定第三目标函数。示例性地,判别器320可以是训练好的生成对抗网络(gan)中的判别器,相应地,第三目标函数可以被设置为gan的损失函数,例如其可以表示为

[0060]

在一些实现中,为了加速可逆神经网络190的收敛,并且使得所生成的中间图像192的语义准确,可以基于参考图像来确定用于训练可逆神经网络190的目标函数(也称为“第四目标函数”)。示例性地,可以获取输入图像170语义对应的、并且具有第二分辨率的参考图像作为训练数据,以用于训练该模型。在一些实现中,参考图像可以基于输入图像170来被生成。例如,可以利用插值法、或者任何已知或将要开发的方法来从输入图像170生成与之语义对应的低分辨率参考图像。

[0061]

在一些实现中,可以基于参考图像和由可逆神经网络生成的中间图像192之间的差异来确定用于训练该第四目目标函数。在一些实现中,可以基于中间图像192和参考图像的l1距离或者l2距离来确定第四目标函数,例如其可以被表示为目标函数l

guide

。

[0062]

在一些实现中,可以基于第一目标函数、第二目标函数和第三目标函数的组合来生成用于训练可逆神经网络190的总目标函数。例如,总目标函数可以被表示为:

[0063][0064]

其中,λ1、λ2、λ3、λ4和λ5是用于平衡不同损失项的系数。通过使得总目标函数l

total

最小化,可以确定可逆神经网络190的参数。

[0065]

如图1b中所示,在完成可逆神经网络190的训练后,输入图像170和服从预定分布的第二高频信息196可以被输入到经训练的可逆神经网络190的逆网络198,以获得高分辨率输出图像180。图4a示出了图2a所示的可逆神经网络191的逆网络198的示意性框图。如图4a所示,网络198可以由一个或多个上采样模块410串联而成。出于简化目的,在图4a中示出一个上采样模块410。逆网络192所支持的图像放大的比例可以由每个上采样模块410所支持的图像放大的比例以及所包含的上采样模块410的个数来决定。例如,假设每个上采样模块410支持将图像放大2倍并且逆网络192包括2个上采样模块410,则逆网络192支持将图像放大4倍。

[0066]

如图4a所示,例如,上采样模块410可以包括变换模块430和一个或多个inn单元420-1、420-2

……

420-m(统称为或单独称为“inn单元420”,其中m≥1)。inn单元420的结构与如图2b所示的inn单元220的结构是互逆的,例如如图4b所示。以inn单元420-m为例,在此

假设输入到inn单元420-m的具有低分辨率的输入图像170被表示为并且服从预定分布的高频信息175被表示为如图4b所示,可以向应用如上述公式(3)所示的仿射变换的逆变换,并且向应用如上述公式(4)所示的仿射变换的逆变换。图4b中所示的变换函数η和ρ可以是任意函数。应当理解,如图4b所示的inn单元420仅出于示例的目的示出,而无意于限制本公开的范围。本公开的实现也适用于具有其他不同结构的inn单元。inn单元的示例包括但不限于可逆卷积块、可逆残差网络单元、可逆生成网络单元、深度可逆网络单元等等。

[0067]

如图4a所示,一个或多个inn单元420可以将具有低分辨率的输入图像170和服从预定分布的第二高频信息196转换成待合并的高频分量441和低频分量442。与如图2a所示的变换模块240相反,变换模块430可以将高频分量441和低频分量442合并成具有高分辨率的输出图像180。在一些实现中,当变换模块230被实现为1

×

1逆卷积块时,变换模块430可以被实现为1

×

1可逆卷积块。备选地,当变换模块230被实现为小波变换模块时,变换模块430可以被实现为小波逆变换模块。例如,当变换模块230被实现为haar变换模块时,变换模块430可以被实现为haar逆变换模块。备选地,变换模块430也可以被实现为能够将低频分量和高频分量合并成图像的任何已知或将来开发的变换模块。

[0068]

本公开的实施例通过利用可逆神经网络来模拟输入图像的将采样过程,并利用该可逆神经网络的逆网络来生成具有高分辨率的输出图像。基于这样的方式,本公开的实现可以不用依赖于成对的图像训练数据,并且能够更为准确地模拟出输入图像实际被将采样的过程,从而生成高质量的高分辨率输出图像。

[0069]

图5示出了根据本公开一些实现的用于图像超分辨率重建的方法500的流程图。方法500可以由计算设备100来实现,例如可以被实现在计算设备100的存储器120中的图像处理模块122处。在502,计算设备100获取具有第一分辨率的输入图像。在504,计算设备100利用输入图像训练可逆神经网络,可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,第二分辨率低于第一分辨率。在506,计算设备100利用经训练的可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,第三分辨率高于第一分辨率。

[0070]

以下列出了本公开的一些示例实现方式。

[0071]

在第一方面,本公开提供了一种计算机实现的方法。该方法包括:获取具有第一分辨率的输入图像;利用输入图像训练可逆神经网络,可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,第二分辨率低于第一分辨率;以及利用可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,第三分辨率高于第一分辨率。

[0072]

在一些实现中,利用输入图像训练可逆神经网络包括:基于输入图像和中间图像,确定多个目标函数;通过组合多个目标函数中的至少一部分目标函数,确定用于训练可逆神经网络的总目标函数;以及通过使总目标函数最小化,确定可逆神经网络的网络参数。

[0073]

在一些实现中,确定多个目标函数包括:基于中间图像中的像素分布与输入图像的具有第二分辨率的图像块中的像素分布之间的差异,确定第一目标函数。

[0074]

在一些实现中,确定第一目标函数包括:利用判别器区分中间图像的像素是来自中间图像还是来自图像块;以及基于区分,确定第一目标函数。

[0075]

在一些实现中,确定多个目标函数包括:基于第一高频信息的分布与预定分布的差异,确定第二目标函数。

[0076]

在一些实现中,确定多个目标函数包括:利用可逆神经网络的逆网络,基于中间图像和服从预定分布的第三高频信息,来生成具有第一分辨率的重建图像;以及基于输入图像与重建图像的差异,确定第三目标函数。

[0077]

在一些实现中,确定多个目标函数包括:获取与输入图像的语义对应并且具有第二分辨率的参考图像;以及基于中间图像和参考图像的差异,确定第四目标函数。

[0078]

在一些实现中,可逆神经网络包括变换模块和至少一个可逆网络单元,其中生成输出图像包括:利用至少一个可逆网络单元,基于输入图像和第二高频信息来生成待合并的低频分量和高频分量,低频分量表示输入图像的语义并且高频分量与语义相关;以及利用变换模块,将低频分量和高频分量合并成输出图像。

[0079]

在一些实现中,变换模块包括以下任一项:可逆卷积块;以及小波变换模块。

[0080]

在第二方面,本公开提供管理一种设备。该设备包括:处理单元;以及存储器,耦合至处理单元并且包含存储于其上的指令,指令在由处理单元执行时使设备执行动作,动作包括:获取具有第一分辨率的输入图像;利用输入图像训练可逆神经网络,可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,第二分辨率低于第一分辨率;以及利用可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,第三分辨率高于第一分辨率。

[0081]

在一些实现中,利用输入图像训练可逆神经网络包括:基于输入图像和中间图像,确定多个目标函数;通过组合多个目标函数中的至少一部分目标函数,确定用于训练可逆神经网络的总目标函数;以及通过使总目标函数最小化,确定可逆神经网络的网络参数。

[0082]

在一些实现中,确定多个目标函数包括:基于中间图像中的像素分布与输入图像的具有第二分辨率的图像块中的像素分布之间的差异,确定第一目标函数。

[0083]

在一些实现中,确定第一目标函数包括:利用判别器区分中间图像的像素是来自中间图像还是来自图像块;以及基于区分,确定第一目标函数。

[0084]

在一些实现中,确定多个目标函数包括:基于第一高频信息的分布与预定分布的差异,确定第二目标函数。

[0085]

在一些实现中,确定多个目标函数包括:利用可逆神经网络的逆网络,基于中间图像和服从预定分布的第三高频信息,来生成具有第一分辨率的重建图像;以及基于输入图像与重建图像的差异,确定第三目标函数。

[0086]

在一些实现中,确定多个目标函数包括:获取与输入图像的语义对应并且具有第二分辨率的参考图像;以及基于中间图像和参考图像的差异,确定第四目标函数。

[0087]

在一些实现中,可逆神经网络包括变换模块和至少一个可逆网络单元,其中生成输出图像包括:利用至少一个可逆网络单元,基于输入图像和第二高频信息来生成待合并的低频分量和高频分量,低频分量表示输入图像的语义并且高频分量与语义相关;以及利用变换模块,将低频分量和高频分量合并成输出图像。

[0088]

在一些实现中,变换模块包括以下任一项:可逆卷积块;以及小波变换模块。

[0089]

在第三方面,提供了一种计算机程序产品。该计算机程序产品被有形地存储在非瞬态计算机存储介质中并且包括机器可执行指令,机器可执行指令在由设备执行时使设备执行动作,动作包括:获取具有第一分辨率的输入图像;利用输入图像训练可逆神经网络,可逆神经网络被配置为基于输入图像生成具有第二分辨率的中间图像和第一高频信息,第二分辨率低于第一分辨率;以及利用可逆神经网络的逆网络,基于输入图像和服从预定分布的第二高频信息来生成具有第三分辨率的输出图像,第三分辨率高于第一分辨率。

[0090]

在一些实现中,利用输入图像训练可逆神经网络包括:基于输入图像和中间图像,确定多个目标函数;通过组合多个目标函数中的至少一部分目标函数,确定用于训练可逆神经网络的总目标函数;以及通过使总目标函数最小化,确定可逆神经网络的网络参数。

[0091]

在一些实现中,确定多个目标函数包括:基于中间图像中的像素分布与输入图像的具有第二分辨率的图像块中的像素分布之间的差异,确定第一目标函数。

[0092]

在一些实现中,确定第一目标函数包括:利用判别器区分中间图像的像素是来自中间图像还是来自图像块;以及基于区分,确定第一目标函数。

[0093]

在一些实现中,确定多个目标函数包括:基于第一高频信息的分布与预定分布的差异,确定第二目标函数。

[0094]

在一些实现中,确定多个目标函数包括:利用可逆神经网络的逆网络,基于中间图像和服从预定分布的第三高频信息,来生成具有第一分辨率的重建图像;以及基于输入图像与重建图像的差异,确定第三目标函数。

[0095]

在一些实现中,确定多个目标函数包括:获取与输入图像的语义对应并且具有第二分辨率的参考图像;以及基于中间图像和参考图像的差异,确定第四目标函数。

[0096]

在一些实现中,可逆神经网络包括变换模块和至少一个可逆网络单元,其中生成输出图像包括:利用至少一个可逆网络单元,基于输入图像和第二高频信息来生成待合并的低频分量和高频分量,低频分量表示输入图像的语义并且高频分量与语义相关;以及利用变换模块,将低频分量和高频分量合并成输出图像。

[0097]

在一些实现中,变换模块包括以下任一项:可逆卷积块;以及小波变换模块。

[0098]

本文中以上描述的功能可以至少部分地由一个或多个硬件逻辑部件来执行。例如,非限制性地,可以使用的示范类型的硬件逻辑部件包括:场可编程门阵列(fpga)、专用集成电路(asic)、专用标准产品(assp)、芯片上系统的系统(soc)、负载可编程逻辑设备(cpld)等等。

[0099]

用于实施本公开的方法的程序代码可以采用一个或多个编程语言的任何组合来编写。这些程序代码可以提供给通用计算机、专用计算机或其他可编程数据处理装置的处理器或控制器,使得程序代码当由处理器或控制器执行时使流程图和/或框图中所规定的功能/操作被实施。程序代码可以完全在机器上执行、部分地在机器上执行,作为独立软件包部分地在机器上执行且部分地在远程机器上执行或完全在远程机器或服务器上执行。

[0100]

在本公开的上下文中,机器可读介质可以是有形的介质,其可以包含或存储以供指令执行系统、装置或设备使用或与指令执行系统、装置或设备结合地使用的程序。机器可读介质可以是机器可读信号介质或机器可读储存介质。机器可读介质可以包括但不限于电子的、磁性的、光学的、电磁的、红外的、或半导体系统、装置或设备,或者上述内容的任何合适组合。机器可读存储介质的更具体示例会包括基于一个或多个线的电气连接、便携式计

算机盘、硬盘、随机存取存储器(ram)、只读存储器(rom)、可擦除可编程只读存储器(eprom或快闪存储器)、光纤、便捷式紧凑盘只读存储器(cd-rom)、光学储存设备、磁储存设备、或上述内容的任何合适组合。

[0101]

此外,虽然采用特定次序描绘了各操作,但是这应当理解为要求这样操作以所示出的特定次序或以顺序次序执行,或者要求所有图示的操作应被执行以取得期望的结果。在一定环境下,多任务和并行处理可能是有利的。同样地,虽然在上面论述中包含了若干具体实现细节,但是这些不应当被解释为对本公开的范围的限制。在单独的实现的上下文中描述的某些特征还可以组合地实现在单个实现中。相反地,在单个实现的上下文中描述的各种特征也可以单独地或以任何合适的子组合的方式实现在多个实现中。

[0102]

尽管已经采用特定于结构特征和/或方法逻辑动作的语言描述了本主题,但是应当理解所附权利要求书中所限定的主题未必局限于上面描述的特定特征或动作。相反,上面所描述的特定特征和动作仅仅是实现权利要求书的示例形式。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1