模拟树突棘变化的神经网络架构的构建方法和装置

1.本技术涉及计算机算法技术领域,尤其涉及一种模拟树突棘变化的神经网络架构的构建方法和装置。

背景技术:

2.一、人工神经网路领域现状与弊端:

3.目前,随着深度学习的发展,各种不同架构神经网络的数量呈现井喷的态势,而现阶段的人工神经网络大多为层状结构。如卷积神经网络,采用了卷积层、池化层、全连接层这样的结构。循环神经网络引入了时序的概念,却依然没有摆脱神经网络的层状结构。目前,学者们提出了densenet等架构,将输入层与之后的任意层进行连接,但本质仍是层状结构。这些网络训练的过程、采取特定网络架构的原因不具备生物学理论依据。同时,现阶段的人工神经网络存在着以下弊病:根据不同的问题需要人为调整网络架构以得到较好的训练结果,而调整原因往往不具备可解释性。并且,由于该网络架构的搭建过程中,有很多主观决定或实验确定的因素,当将训练好的网络应用于其他类似问题,或应用于同一问题的其他特殊情况时,神经网络给出的结果较差。

4.二、脑科学领域记忆方面的理论与背景知识:

5.脑科学领域记忆方面的理论与背景知识:研究人员发现,树突棘在生物记忆领域有着至关重要的作用。树突棘是神经元树突的一个小的膜状突起,可以接受来自突触上单个轴突的输入。它是突触强度的储存场所,有助于将电信号传送到神经元的细胞体。大多数树突棘有一个球状的头,和一个连接树突棘头部和树突轴的细颈。单个神经元可能有成百上千的树突棘。它们可以为记忆储存和突触传递提供基础。g.yang等人在2009年对小鼠的实验中发现,在新的动作学习的长期过程,小鼠树突棘缓慢出现并消除。可以从小鼠的反应体现出树突棘重塑的程度与小鼠的记忆的形成有关。通过之后一系列的实验,g.yang等人得出结论:新的学习任务结束后形成的树突棘与大部分早期形成并消除后保留的树突棘,为动物生命记忆提供结构基础,而学习会在皮层留下永久记忆,该记忆保存在稳定连接的突触网络中。树突棘在大脑中的形成、消退、重塑的过程可以分为以下几个步骤:早期生物出生时,大脑中有大量的树突棘。随着年龄的增长与大脑的发育,树突棘渐渐变稀疏。通过新的学习事物的过程,会产生新的特定树突棘,这些树突棘会在之后的过程中消退一部分。各项学习任务最终留存下来的新经验树突棘与大脑中的初期树突棘构支撑这大脑突触网络的连接,作为记忆的基础。

技术实现要素:

6.本技术旨在至少在一定程度上解决相关技术中的技术问题之一。

7.为此,本技术的第一个目的在于提出一种模拟树突棘变化的神经网络架构的构建方法,解决了现有人工神经网络需要根据不同的问题人为的调整网络架构以得到较好训练结果,而调整原因不具备可解释性的问题,同时解决了现有人工神经网络一旦确定架构很

难在训练的过程中对其进行调整,比较不同的网络架构之间的区别也需要分别训练,且耗时巨大的问题,通过模拟树突棘的成长、消退以及在学习任务进行时产生的一系列变化设计一种具备生物学方面的可解释性的网状神经网络架构,可以应用于有监督的图像识别任务,并且可以直接在不同的网络架构中转变,针对不同问题也可以训练出较为合适的神经网络架构,具备较强自适应性。

8.本技术的第二个目的在于提出一种模拟树突棘变化的神经网络架构的构建装置。

9.本技术的第三个目的在于提出一种非临时性计算机可读存储介质。

10.为达上述目的,本技术第一方面实施例提出了一种模拟树突棘变化的神经网络架构的构建方法,包括:使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的剪枝过程,生成初始化后的权重矩阵;获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。

11.可选地,在本技术的一个实施例中,输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵,表示为:

[0012][0013][0014][0015]

其中,n

hid

为神经网络中隐层所有神经元的总数,n

in

为输入层神经元的数目即输入数据的维度,可根据图像识别问题的输入图像大小确定,n

out

为输出层神经元的数目即输出数据的维度,可根据图像识别具体问题的图像类别数决定,w

hid

表示隐层所有神经元之间的连接矩阵,w

in

表示输入层权重矩阵,w

out

表示输出层权重矩阵,

[0016]

使用有向无环图表示神经网络,使用主对角线都为0的上三角矩阵w

hid

表示有向无环图,表示为:

[0017]

w

hid

(i,j)=0

[0018]

where i=0,1,2

…

,n

hid

‑

1and 0≤j≤i

[0019]

其中,i,j为隐层神经元的编号,n

hid

为神经网络中隐层所有神经元的总数,w

hid

表示隐层所有神经元之间的连接矩阵。

[0020]

可选地,在本技术的一个实施例中,使用现有初始化方法对权重矩阵进行初始化,或使用训练完毕或训练一半的神经网络对输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵进行赋值。

[0021]

可选地,在本技术的一个实施例中,将若干组中的每一组输入权重矩阵中进行训练,包括前馈计算输出、修改一部分连接权重、部分连接的置零与固化,其中,修改一部分连接权重模拟高等动物学习新任务时,大脑中的树突棘增加、增强、减弱的过程,置零模拟高

等动物遗忘的过程,固化模拟高等动物形成永久记忆的过程。

[0022]

可选地,在本技术的一个实施例中,前馈计算输出包括以下步骤:

[0023]

计算输入层权重矩阵,得到隐层神经元的初始状态,表示为:

[0024]

i

hid

=f(x

·

w

hid

)

[0025]

其中,f为第一层激活函数。i

hid

为只接受了输入层输入后的隐层神经元状态,x表示样本特征向量,w

hid

表示隐层所有神经元之间的连接矩阵;

[0026]

通过隐层所有神经元之间的连接矩阵计算隐层神经元的最终状态,表示为:

[0027][0028][0029]

其中,隐层所有神经元之间的连接矩阵为主对角线为0的上三角矩阵,在隐层网络中任意存在的(i,j)连接必定满足i≤j,为第i个隐层神经元的初始状态,为第i个隐层神经元的最终状态,f

i

为第i个隐层神经元处的激活函数,为w

hid

中第i个隐层神经元到第j个隐层神经元的连接权重;

[0030]

使用输出层权重矩阵和隐层神经元的最终状态计算输出层的最终输出,表示为:

[0031]

o

nout

=f(o

hid

·

w

out

)

[0032]

其中,f为激活函数,o

hid

表示隐层神经元的最终状态,w

out

表示输出层权重矩阵。

[0033]

可选地,在本技术的一个实施例中,修改一部分连接权重,具体为根据输出层的最终输出和期望的预测向量之间的差别,对输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵进行调整。

[0034]

可选地,在本技术的一个实施例中,部分连接的置零与固化包括置零、固化两个过程,其中,

[0035]

置零具体为,经过若干组样本的训练,若权重矩阵中的某个连接的权重值一直在预设的一个较小的范围内,将其值置为0,之后此处不再建立连接,也不参与权重的更迭计算,较小的范围表示为:

[0036][0037]

其中,为该连接的权重值,threshold为将连接权重置零的阈值,满足上述情况时,令

[0038]

固化具体为,经过若干组样本的训练,若某一非0连接的值始终固定在某一个值设定的范围内,则固定该连接的权重,设定的范围表示为:

[0039][0040]

其中,表示第p+1个迭代步骤该连接的权重值,ε为常数值。

[0041]

可选地,在本技术的一个实施例中,将训练好的权重矩阵转换为真实网络架构,具体为将训练好的权重矩阵的输入层权重矩阵、输出层权重矩阵作为输入层、输出层,将训练

好的权重矩阵的隐层所有神经元之间的连接矩阵作为隐层神经元之间的邻接矩阵,得到最终的神经网络架构和连接权重。

[0042]

为达上述目的,本技术第二方面实施例提出了一种模拟树突棘变化的神经网络架构的构建装置,包括生成模块、初始化模块、获取模块、训练模块、转换模块,其中,

[0043]

生成模块,用于使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;

[0044]

初始化模块,用于对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的变化,生成初始化后的权重矩阵;

[0045]

获取模块,用于获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;

[0046]

训练模块,用于将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;

[0047]

转换模块,用于将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。

[0048]

为了实现上述目的,本技术第三方面实施例提出了一种非临时性计算机可读存储介质,当存储介质中的指令由处理器被执行时,能够执行模拟树突棘变化的神经网络架构的构建方法和装置。

[0049]

本技术实施例的模拟树突棘变化的神经网络架构的构建方法、模拟树突棘变化的神经网络架构的构建装置和非临时性计算机可读存储介质,解决了现有人工神经网络需要根据不同的问题人为的调整网络架构以得到较好训练结果,而调整原因不具备可解释性的问题,同时解决了现有人工神经网络一旦确定架构很难在训练的过程中对其进行调整,比较不同的网络架构之间的区别也需要分别训练,且耗时巨大的问题,通过模拟树突棘的成长、消退以及在学习任务进行时产生的一系列变化设计一种具备生物学方面的可解释性的网状神经网络架构,可以应用于有监督的图像识别任务,并且可以直接在不同的网络架构中转变,针对不同问题也可以训练出较为合适的神经网络架构,具备较强自适应性。本技术针对某一具体问题训练出神经网络架构与连接权重之后,在解决其他类似问题时可以保留网络架构,只训练权重,具备较强迁移性,同时在训练的过程中,存在网络权重的固定、置0,且随着学习的样本的个数增加、迭代次数的增加,越来越多的权重会确定,最终需要训练的权重会越来越少,在一定程度上可以节省时间开销。

[0050]

本技术附加的方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本技术的实践了解到。

附图说明

[0051]

本技术上述的和/或附加的方面和优点从下面结合附图对实施例的描述中将变得明显和容易理解,其中:

[0052]

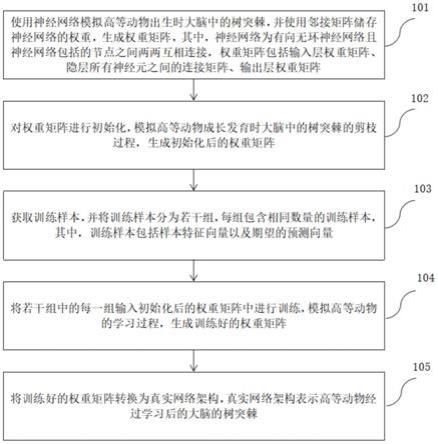

图1为本技术实施例一所提供的一种模拟树突棘变化的神经网络架构的构建方法的流程图;

[0053]

图2为本技术实施例的模拟树突棘变化的神经网络架构的构建方法的另一个流程图;

[0054]

图3为本技术实施例的模拟树突棘生长发育消退固定的过程与本技术神经网络权重变化的对比图;

[0055]

图4为本技术实施例二所提供的一种模拟树突棘变化的神经网络架构的构建装置的结构示意图。

具体实施方式

[0056]

下面详细描述本技术的实施例,所述实施例的示例在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施例是示例性的,旨在用于解释本技术,而不能理解为对本技术的限制。

[0057]

下面参考附图描述本技术实施例的模拟树突棘变化的神经网络架构的构建方法和装置。

[0058]

图1为本技术实施例一所提供的一种模拟树突棘变化的神经网络架构的构建方法的流程图。

[0059]

如图1所示,该模拟树突棘变化的神经网络架构的构建方法包括以下步骤:

[0060]

步骤101,使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;

[0061]

步骤102,对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的剪枝过程,生成初始化后的权重矩阵;

[0062]

步骤103,获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;

[0063]

步骤104,将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;

[0064]

步骤105,将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。

[0065]

本技术实施例的模拟树突棘变化的神经网络架构的构建方法,通过使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的剪枝过程,生成初始化后的权重矩阵;获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。由此,能够解决现有人工神经网络需要根据不同的问题人为的调整网络架构以得到较好训练结果,而调整原因不具备可解释性的问题,同时还可以解决现有人工神经网络一旦确定架构很难在训练

的过程中对其进行调整,比较不同的网络架构之间的区别也需要分别训练,且耗时巨大的问题,通过模拟树突棘的成长、消退以及在学习任务进行时产生的一系列变化设计一种具备生物学方面的可解释性的网状神经网络架构,可以应用于有监督的图像识别任务,并且可以直接在不同的网络架构中转变,针对不同问题也可以训练出较为合适的神经网络架构,具备较强自适应性。

[0066]

本技术针对某一具体问题训练出神经网络架构与连接权重之后,在解决其他类似问题时可以保留网络架构,只训练权重,具备较强迁移性,同时在训练的过程中,存在网络权重的固定、置0,且随着学习的样本的个数增加、迭代次数的增加,越来越多的权重会确定,最终需要训练的权重会越来越少,在一定程度上可以节省时间开销。

[0067]

进一步地,在本技术实施例中,输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵,表示为:

[0068][0069][0070][0071]

其中,n

hid

为神经网络中隐层所有神经元的总数,n

in

为输入层神经元的数目即输入数据的维度,可根据图像识别问题的输入图像大小确定,n

out

为输出层神经元的数目即输出数据的维度,可根据图像识别具体问题的图像类别数决定,w

hid

表示隐层所有神经元之间的连接矩阵,w

in

表示输入层权重矩阵,w

out

表示输出层权重矩阵,

[0072]

使用有向无环图表示神经网络,使用主对角线都为0的上三角矩阵w

hid

表示有向无环图,表示为:

[0073]

w

hid

(i,j)=0

[0074]

where i=0,1,2

…

,n

hid

‑

1 and 0≤j≤i

[0075]

其中,i,j为隐层神经元的编号,n

hid

为神经网络中隐层所有神经元的总数,w

hia

表示隐层所有神经元之间的连接矩阵。

[0076]

在本技术的假设中,初始状态下隐层的数目与各层神经元的数目不提前确定,而是通过后续训练步骤决定,只将所有隐层的神经元总数n

hid

作为超参数。w

hid

可以看作所有隐层节点之间的邻接矩阵,可由之确定隐层数目与各层神经元数目。

[0077]

由于含环的神经网络训练时需考虑时序问题,本技术只考虑有向无环的神经网络,即有向无环图(dag)。所有的dag都可以拓扑排序,因此所有可能的网络必然可以表示为主对角线都为0的上三角矩阵w

hid

。

[0078]

主对角线都为0的上三角矩阵w

hid

可以表示隐层所有神经元的总数为n

hid

的任意层数、任意结构的神经网络。即w

in

、w

hid

、w

out

与隐层所有神经元的总数为n

hid

的多层神经网络一一对应当且仅当w

hid

为主对角线都为0的上三角矩阵。树突棘(神经元之间的连接)可以在任意两个神经元之间形成。

[0079]

进一步地,在本技术实施例中,使用现有初始化方法对权重矩阵进行初始化,或使用训练完毕或训练一半的神经网络对输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵进行赋值。

[0080]

可以使用随机初始化、xavier初始化、恺明初始化等,也可以按照已经训练完毕或训练到一半的某个多层神经网络对w

in

、w

hid

、w

out

进行赋值。例如,将训练了一半的隐层数量为n

h

(n

h

≤n

hid

)的双层神经网络赋值入w

in

、w

hid

、w

out

,则:

[0081]

w

in

(:,0:n

h

‑

1)=w1‑

layer

[0082]

w

hid

=0

[0083]

w

out

(0:n

h

‑

1,:)=w2‑

layer

[0084]

此步骤为新树突棘的成长做出准备,赋值可以包括任意学习阶段的神经网络,可以是还未训练的、训练过程中的、训练完毕的。从任意阶段开始学习样本,有希望在之后的学习过程中不断调整网络的结构与权重,训练出更优的网络架构与连接权重。

[0085]

进一步地,在本技术实施例中,将若干组中的每一组输入权重矩阵中进行训练,包括前馈计算输出、修改一部分连接权重、部分连接的置零与固化,其中,修改一部分连接权重模拟高等动物学习新任务时,大脑中的树突棘增加、增强、减弱的过程,置零模拟高等动物遗忘的过程,固化模拟高等动物形成永久记忆的过程。

[0086]

输入信息包括了样本特征向量以及期望的预测向量。特征向量表示第i个图片样本的共n

in

维的特征,其中x

ij

表示第i个向量的第j维特征。基于监督学习,需要输入样本所对应的目标输出其中,y

i

为第i个样本的二进制类别向量,y

ij

∈{0,1}。y

ij

=1时,表示y

i

属于j类,反之亦然。二进制向量y

i

有且仅有一个j使得y

ij

=1。

[0087]

本技术将所有训练样本分为k份,每份m个样本。一次训练一组m个样本。因此一次输入为x,期望输出y,

[0088]

进一步地,在本技术实施例中,前馈计算输出包括:

[0089]

前馈计算输出是逐层计算,先处理w

in

,得到隐层神经元的初始状态i

hid

,再通过w

hid

计算隐层神经元最终状态o

hid

,最后计算输出层神经元输出o

nout

。

[0090]

计算输入层权重矩阵,得到隐层神经元的初始状态,表示为:

[0091]

i

hid

=f(x

·

w

hid

)

[0092]

其中,f为第一层激活函数。i

hid

为只接受了输入层输入后的隐层神经元状态,x表示样本特征向量,w

hid

表示隐层所有神经元之间的连接矩阵;

[0093]

通过隐层所有神经元之间的连接矩阵计算隐层神经元的最终状态,表示为:

[0094][0095][0096]

其中,隐层所有神经元之间的连接矩阵为主对角线为0的上三角矩阵,在隐层网络中任意存在的(i,j)连接必定满足i≤j,为第i个隐层神经元的初始状态,为第i个隐层神经元的最终状态,f

i

为第i个隐层神经元处的激活函数,为w

hid

中第i个隐层神经

元到第j个隐层神经元的连接权重;

[0097]

使用输出层权重矩阵和隐层神经元的最终状态计算输出层的最终输出,表示为:

[0098]

o

nout

=f(o

hid

·

w

out

)

[0099]

其中,f为激活函数,o

hid

表示隐层神经元的最终状态,w

out

表示输出层权重矩阵。

[0100]

激活函数可以使用softmax等,此输出即为预测结果,可以根据输出与目标输出的差进行权重调整。

[0101]

进一步地,在本技术实施例中,修改一部分连接权重,具体为根据输出层的最终输出和期望的预测向量之间的差别,对输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵进行调整。

[0102]

结合输出o

nout

与目标输出之间的差别,可以使用梯度下降算法等方法调整权重w

i

n、w

hid

、w

out

。该步骤模拟学习新任务的过程中,增加一部分树突棘、原有部分树突棘连接增强、遗忘过程中部分树突棘连接减弱。

[0103]

进一步地,在本技术实施例中,部分连接的置零与固化包括置零、固化两个过程,其中,

[0104]

置零具体为,经过若干组样本的训练,若权重矩阵中的某个连接的权重值一直在预设的一个较小的范围内,将其值置为0,之后此处不再建立连接,也不参与权重的更迭计算,较小的范围表示为:

[0105][0106]

其中,为该连接的权重值,threshold为将连接权重置零的阈值,满足上述情况时,令

[0107]

置零步骤是模拟遗忘的过程,对于连接强度较弱的部分神经元,树突棘在遗忘的过程中会渐渐消退。通过这种方法,可以降低网络架构的复杂度,去除一些冗余的连接。

[0108]

固化具体为,经过若干组样本的训练,若某一非0连接的值始终固定在某一个值设定的范围内,则固定该连接的权重,设定的范围表示为:

[0109][0110]

其中,表示第p+1个迭代步骤该连接的权重值,ε为常数值。

[0111]

固化步骤模拟永久记忆的形成。对降低复杂网络权重更新的复杂度有着重要意义。

[0112]

将每一组输入初始化后的权重矩阵中进行训练,直到全部的样本训练完毕,在训练的过程中会有越来越多的权重确定,包括被固定或被置零,最终训练完所有样本时,整个网络的训练完成。

[0113]

进一步地,在本技术实施例中,将训练好的权重矩阵转换为真实网络架构,具体为将训练好的权重矩阵的输入层权重矩阵、输出层权重矩阵作为输入层、输出层,将训练好的权重矩阵的隐层所有神经元之间的连接矩阵作为隐层神经元之间的邻接矩阵,得到最终的神经网络架构和连接权重。

[0114]

一方面,可以直接将训练出来的网络架构以及其权重用于解决该问题的其他测试

集,另一方面,针对相似问题,可以尝试保留训练出来的网络架构,重新训练网络的权重以达到训练的目的。

[0115]

对于不同问题均可以使用上述方式构建网络,例如图像识别分类问题,可以根据图像大小确定输入层神经元的数量、通过分类的类别确定输出层神经元的数量。中间层的层数、神经元数量、神经元之间的连接关系先初始化为空,通过训练过程得到神经元之间的连接关系与权重,最后将确定架构的网络用于具体的图像识别问题。

[0116]

图2为本技术实施例的模拟树突棘变化的神经网络架构的构建方法的另一个流程图。

[0117]

如图2所示,该模拟树突棘变化的神经网络架构的构建方法,根据树突棘从开始到学习任务到掌握任务的变化过程设计了一种具备生物学方面可解释性的网状神经网络架构。人类等高等生物出生时,大脑中的树突棘数目庞大,随着生物的逐渐发育成熟,部分树突棘被剪枝,因此一段时间以后树突棘逐渐稀疏。开始新的学习过程以后,树突棘会发生部分调整,伴随着新树突棘的产生与旧树突棘的消退,记忆逐渐形成。记忆巩固阶段,部分树突棘会永久保留,表示着永久记忆的形成。生物对于不同任务学习的同时,树突棘逐渐生成演化消退,构成了大脑记忆的基础。由于树突棘为神经元突触传递提供基础,可以自然而然地联想到树突棘与人工神经网络中连接各个神经元的权重向量具有一定相似性。根据树突棘形成的过程不难设计出神经网络训练过程。在初始阶段,构建可以两两连接的神经网络,可以通过邻接矩阵来存储其权重。树突棘随着成长发育的剪枝可以看作是权重矩阵初始化的过程。在任务学习中,样本一个接一个地输入。在对样本的学习过程中,矩阵中的权值不断调整,即人工神经网络中的权重连接有的增强有的减弱,这与新树突棘的产生与消退不谋而合。通过对不同样本的学习的循环,部分权重固定,即神经网络的连接渐渐确定,最终学完所有样本之后,权重矩阵的值确定,由此,神经网路的连接形式与连接强度也确定了。对于该任务的特定神经网络训练完毕。

[0118]

图3为本技术实施例的模拟树突棘生长发育消退固定的过程与本技术神经网络权重变化的对比图。

[0119]

如图3所示,该图详细展示了树突棘变化过程与本技术的网状神经网络训练全过程。第一行体现了树突棘变化相关的生物学理论,包括了变稀疏、新棘形成、树突棘消退与最终固化的过程。其中第一行第三张图中的红点代表新棘,第四张图的黑点代表树突棘的消退。第二行反映了本技术中网状神经网络训练的过程。由于神经元之间的突触传导是单向的,两个神经元之间不可能有两条相互对应的有向边,本技术中的网络权重邻接矩阵可以只考虑除去对角线外的上三角部分。第二行第一张图表示了神经网络的初始结构,第二张图是神经网络初始化后的结果,第三张图中的红点代表训练过程中一部分权重的增加,绿色部分代表训练过程中一部分权重的减少。第四张图和第五张图分别显示了训练后期一部分神经元之间的连接消退,而一部分神经元之间的连接固化。第三行是第二行的邻接矩阵对应的网络示意图,它更加清晰地显示了训练的过程与树突棘生长的过程对比。

[0120]

图4为本技术实施例二所提供的一种模拟树突棘变化的神经网络架构的构建装置的结构示意图。

[0121]

如图4所示,该模拟树突棘变化的神经网络架构的构建装置,包括生成模块、初始化模块、获取模块、训练模块、转换模块,其中,

[0122]

生成模块10,用于使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;

[0123]

初始化模块20,用于对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的变化,生成初始化后的权重矩阵;

[0124]

获取模块30,用于获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;

[0125]

训练模块40,用于将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;

[0126]

转换模块50,用于将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。

[0127]

本技术实施例的模拟树突棘变化的神经网络架构的构建装置,包括生成模块、初始化模块、获取模块、训练模块、转换模块,其中,生成模块,用于使用神经网络模拟高等动物出生时大脑中的树突棘,并使用邻接矩阵储存神经网络的权重,生成权重矩阵,其中,神经网络为有向无环神经网络且神经网络包括的节点之间两两互相连接,权重矩阵包括输入层权重矩阵、隐层所有神经元之间的连接矩阵、输出层权重矩阵;初始化模块,用于对权重矩阵进行初始化,模拟高等动物成长发育时大脑中的树突棘的变化,生成初始化后的权重矩阵;获取模块,用于获取训练样本,并将训练样本分为若干组,每组包含相同数量的训练样本,其中,训练样本包括样本特征向量以及期望的预测向量;训练模块,用于将若干组中的每一组输入初始化后的权重矩阵中进行训练,模拟高等动物的学习过程,生成训练好的权重矩阵;转换模块,用于将训练好的权重矩阵转换为真实网络架构,真实网络架构表示高等动物经过学习后的大脑的树突棘。由此,能够解决现有人工神经网络需要根据不同的问题人为的调整网络架构以得到较好训练结果,而调整原因不具备可解释性的问题,同时还可以解决现有人工神经网络一旦确定架构很难在训练的过程中对其进行调整,比较不同的网络架构之间的区别也需要分别训练,且耗时巨大的问题,通过模拟树突棘的成长、消退以及在学习任务进行时产生的一系列变化设计一种具备生物学方面的可解释性的网状神经网络架构,可以应用于有监督的图像识别任务,并且可以直接在不同的网络架构中转变,针对不同问题也可以训练出较为合适的神经网络架构,具备较强自适应性。

[0128]

本技术针对某一具体问题训练出神经网络架构与连接权重之后,在解决其他类似问题时可以保留网络架构,只训练权重,具备较强迁移性,同时在训练的过程中,存在网络权重的固定、置0,且随着学习的样本的个数增加、迭代次数的增加,越来越多的权重会确定,最终需要训练的权重会越来越少,在一定程度上可以节省时间开销。

[0129]

为了实现上述实施例,本技术还提出了一种非临时性计算机可读存储介质,其上存储有计算机程序,计算机程序被处理器执行时实现上述实施例的模拟树突棘变化的神经网络架构的构建方法和装置。

[0130]

在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本技术的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不

必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。此外,在不相互矛盾的情况下,本领域的技术人员可以将本说明书中描述的不同实施例或示例以及不同实施例或示例的特征进行结合和组合。

[0131]

此外,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括至少一个该特征。在本技术的描述中,“多个”的含义是至少两个,例如两个,三个等,除非另有明确具体的限定。

[0132]

流程图中或在此以其他方式描述的任何过程或方法描述可以被理解为,表示包括一个或更多个用于实现定制逻辑功能或过程的步骤的可执行指令的代码的模块、片段或部分,并且本技术的优选实施方式的范围包括另外的实现,其中可以不按所示出或讨论的顺序,包括根据所涉及的功能按基本同时的方式或按相反的顺序,来执行功能,这应被本技术的实施例所属技术领域的技术人员所理解。

[0133]

在流程图中表示或在此以其他方式描述的逻辑和/或步骤,例如,可以被认为是用于实现逻辑功能的可执行指令的定序列表,可以具体实现在任何计算机可读介质中,以供指令执行系统、装置或设备(如基于计算机的系统、包括处理器的系统或其他可以从指令执行系统、装置或设备取指令并执行指令的系统)使用,或结合这些指令执行系统、装置或设备而使用。就本说明书而言,"计算机可读介质"可以是任何可以包含、存储、通信、传播或传输程序以供指令执行系统、装置或设备或结合这些指令执行系统、装置或设备而使用的装置。计算机可读介质的更具体的示例(非穷尽性列表)包括以下:具有一个或多个布线的电连接部(电子装置),便携式计算机盘盒(磁装置),随机存取存储器(ram),只读存储器(rom),可擦除可编辑只读存储器(eprom或闪速存储器),光纤装置,以及便携式光盘只读存储器(cdrom)。另外,计算机可读介质甚至可以是可在其上打印所述程序的纸或其他合适的介质,因为可以例如通过对纸或其他介质进行光学扫描,接着进行编辑、解译或必要时以其他合适方式进行处理来以电子方式获得所述程序,然后将其存储在计算机存储器中。

[0134]

应当理解,本技术的各部分可以用硬件、软件、固件或它们的组合来实现。在上述实施方式中,多个步骤或方法可以用存储在存储器中且由合适的指令执行系统执行的软件或固件来实现。如,如果用硬件来实现和在另一实施方式中一样,可用本领域公知的下列技术中的任一项或他们的组合来实现:具有用于对数据信号实现逻辑功能的逻辑门电路的离散逻辑电路,具有合适的组合逻辑门电路的专用集成电路,可编程门阵列(pga),现场可编程门阵列(fpga)等。

[0135]

本技术领域的普通技术人员可以理解实现上述实施例方法携带的全部或部分步骤是可以通过程序来指令相关的硬件完成,所述的程序可以存储于一种计算机可读存储介质中,该程序在执行时,包括方法实施例的步骤之一或其组合。

[0136]

此外,在本技术各个实施例中的各功能单元可以集成在一个处理模块中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个模块中。上述集成的模块既可以采用硬件的形式实现,也可以采用软件功能模块的形式实现。所述集成的模块如果以软件功能模块的形式实现并作为独立的产品销售或使用时,也可以存储在一个计算机可读取存储介质中。

[0137]

上述提到的存储介质可以是只读存储器,磁盘或光盘等。尽管上面已经示出和描述了本技术的实施例,可以理解的是,上述实施例是示例性的,不能理解为对本技术的限制,本领域的普通技术人员在本技术的范围内可以对上述实施例进行变化、修改、替换和变型。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1