一种基于双域学习的恒定码率压缩视频质量增强方法

1.本发明属于压缩视频质量增强领域,具体涉及一种基于双域学习的压缩视频质量压缩复方法。

技术背景

2.近年来,多媒体在互联网上的传播越来越频繁,多媒体和视频会产生70%到80%的移动数据流量,其中高分辨率多媒体的比例在迅速增强,人们对高清多媒体的需求也越来越大。为解决存储和传输多媒体数据时存储成本巨大、带宽有限的问题,通常采用有损压缩算法对多媒体数据(如图像、音频和视频)进行压缩,而这些不可逆的压缩算法通常会引入降低体验质量的压缩伪影,尤其是对于视频而言。因此,旨在减少引入的伪影并恢复以及压缩编码有损压缩视频细节的视频压缩伪影去除成为多媒体领域的热门话题。在过去的几十年中,提出了需对传统的视频压缩标准,比如h.264,h.265等,但这些编码器是手工制作的,无法实现端到端的方式优化压缩带来的像素损失。

3.基于深度学习图像视频压缩方面的研究,显示了深度学习,额外的时间空间信息在提高压缩视频失真的巨大潜力。例如,陆等人提出光流进行运动补偿,并应用自动编码器来压缩光流和残差,郑等人提出了一种隐式双域卷积网络来减少jpeg图像压缩伪影,该方法使用像素位置标记图和量化表作为输入,与dct变换应用于dct域的传统双域学习方法不同,dct域损失直接由卷积提取的特征估计,无需 dct变换。隐式双域卷积在提高jpeg压缩图像质量方面表现出色。肇等人提出用离散余弦变换域的损失来增强压缩视频质量。对于本次发明创新有很多值得借鉴和学习之处。

4.在视频质量增强上,常用的传统压缩编码有h.264和h.265,无法满足现阶段高质量视频还原的需求。而基于深度学习的方法通常学习非线性映射以直接从大量训练数据中回归去伪影的图像,从而高效获得结果。

技术实现要素:

5.针对现存的问题,本发明提供一种基于双域学习的恒定码率压缩视频质量增强方法,通过训练高质量的视频帧和恒定比特率压缩视频帧,得到增强视频帧质量的模型。本发明将离散余弦逆变换上采样应用于多尺度网络视频质量增强,相对于常规上采样过程(像素洗牌,反卷积),使得在离散余弦域中恢复像素帧有很大的提升,从而提高帧的质量,提高视频的质量。

6.本发明采用的技术方案如下:

7.一种基于双域学习的恒定码率压缩视频质量增强方法,步骤如下:

8.步骤一:数据预处理,获取高质量及低质量的视频帧数据集;

9.步骤二:构建多帧视频增强网络模型;

10.步骤三:使用步骤一生成的数据集训练多帧视频增强网络模型;

11.步骤四:将低质量的视频帧输入模型得到高质量视频帧,并计算峰值信噪比。

12.本发明有以下的有效效果:

13.1.本发明方法通过帧间对齐、帧间融和以及在离散余弦变换域中使用卷积估计压缩量化损失叠加到卷积特征域,使得低质量视频帧能捕捉离散余弦变化域的损失信息。

14.2.本发明构建的多帧视频增强网络模型是个多尺度的结构,存在上采样和下采样操作。在离散余弦变换的多尺度结构中,本发明提出 0.5倍离散余弦变换来代替像素洗牌上采样,能好地还原出量化损失的部分。

附图说明

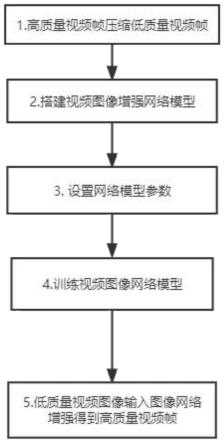

15.图1为本发明实施例的方法流程示意图;

16.图2为本发明实施例的多帧视频增强网络模型总体结构示意图;

17.图3为本发明实施例的离散余弦变换域恢复模块结构原理图;

18.图4为本发明实施例的网络模型测试结果。

具体实施方式

19.如上述的技术方案和附图说明,基于频率损失和残差密集的视频质量增强系统包括:

20.基于双域学习的视频质量增强,包括整理数据集、训练模型和调试网络参数以及测试结果。我们使用ntire2021竞赛视频数据集,其中包含从youtube收集的视频。数据集由200个训练视频,每个视频有超过100个连续帧。图1为本发明实施例的方法流程示意图;

21.一种基于双域学习的恒定码率压缩视频质量增强方法,步骤如下:

22.步骤一,数据预处理,获取高质量及低质量的视频帧数据集,具体方法如下所示:

23.从ntire官网下载数据集高质量视频,将原始高质量的yuv格式视频无损转换成mkv文件对其进行裁帧,作为高质量视频帧训练集;

24.使用hm16编码器将转换后的高质量mkv视频按照帧率30fps,支持 x.265,固定比特率800kbps参数编码参数生成低质量的视频。在低质量视频的处理中,使用ffmpeg开源工具编码恒定比特率视频,再裁帧生成低质量视频帧数据集。

25.步骤二,搭建多帧视频增强网络模型;

26.如图2所示,多帧视频增强网络模型包括特征提取层、多帧对齐融合模块和双域恢复模块。视频帧进入网络模型的顺序是特征提取层,多帧对齐融合模块,然后经过一次下采样得到下采样一倍特征图,再对下采样一倍特征图再次下采样得到下采样二倍特征图,特征图再经过双域恢复模块和convrelu,得到的特征图合并到上一尺度中。随后在下采样一倍特征图合并了下个尺度的特征,再通过双域恢复模块和convrelu层,结果合并到原始尺度中。最后原始尺度中,合并特征图,通过双域恢复模块和convrelu层,最终输出增强的视频帧。

27.所述的特征提取层是由多个残差块组成的,用于将输入图像由三通道变成六十四通道。

28.所述的多帧对齐融合模块分成多帧对齐部分和多帧融合部分。多帧对齐部分采用金字塔,级联和可变形卷积模块,其中金字塔,级联结构是指视频帧经过类似金字塔的上窄下宽三层网络结构,层层连接递进,直至金字塔的第一层输出。可变形卷积模块是利用可变

形卷积来预测多个视频帧的偏移量,通过卷积可学习的特性,不断补偿到理想值。多帧融合部分采用时空特征注意力融合模块,在时间和空间两个维度中赋予特征图不同权重,着重关注的部分来复原,最后将输入的五帧视频帧融合成单帧视频帧。

29.所述的双域恢复模块包括像素域恢复块和离散余弦变换域恢复模块。如图3所示离散余弦变换域恢复模块基于离散余弦逆变换,包括卷积分离层,动态池化层和离散余弦逆变换单元,特征图经过卷积分离层分成y通道和cr/cb通道,然后通过动态池化层和离散余弦逆变换单元。其中动态池化层由三个自适应池化层组成,来估计自适应量化参数;离散余弦逆变换单元对输入的量化参数和特征图进行量化估计分析和上采样,通过设置离散余弦逆变换单元的采样率0.5实现上采样,使得每次变换能预测很多的像素点,达到上采样目的来以及补偿被压缩视频帧的细节。

30.在离散余弦变换双域恢复模块中,特征提取由一组包含密集连接的3

×

3膨胀卷积层层递进连接构成,每次提取新的尺度特征信息时,能整合上一尺度的信息。离散余弦变换恢复域块在卷积分离层将特征图分成y通道和cr/cb通道,因为人眼对y通道很敏感,y通道量化估计优先级高于cr/cb通道,着重处理y通道。

31.像素域恢复模块由多个残差块组成,该模块和离散余弦变换并行处理,完成整个量化损失补偿和叠加。以上两个模块共同完成量化补偿任务。

32.步骤三,通过步骤一生成的数据集训练多帧视频增强网络模型;

33.由于设备的内存有限和扩充数据集,使得网络有更好的泛化性,每次选取五帧连续高质量和低质量视频帧作为视频图像增强网络模型的输入。

34.训练网络采用adam优化器,使用mse loss作为损失函数,损失函数和常用的l1范式函数相比,mse loss来训练模型能更好的处理边缘和彰显出好的性能和细节的锐化。

35.训练过程中,首先在每次输入的五帧高质量和低质量视频帧中随机选取位置裁剪成小图来加快训练速度。初始的学习率设置为1e-4,在五个epoch没有进一步提高客观评价指标时,学习

36.率降低到原来的0.5倍,最后当学习率低于1e-6时,则停止训练。模型参数学习率的每次降低使得模型较快地给出评价结果,前期较高的学习率使得网络能快速收敛到一个损失区间,后期较低的学习率使得网络进行微调,让模型效果达到最优的效果。

37.步骤四,将低质量的视频帧输入训练好的多帧视频增强网络模型中,得到高质量视频图像;

38.将低质量图像到训练好的多帧视频增强网络模型中。首先图像经过特征提取层处理,将图像有三通道变成六十四通道。经特征提取层处理后的图像通过多帧对齐融合模块多帧对齐部分的可变卷积来对齐前后帧,加强前后帧的相关性。再经过多帧融合部分的时空特征注意力融合模块,将输入的五个视频帧动态聚合成单帧。最后经过双域恢复模块分别恢复y通道和cr/cb通道的因压缩引起的量化损失。在每个分支中,添加自适应获取特征空间的量化损失的动态池化层和离散余弦逆变换单元,同时并行进行像素域增强,共同完成量化补偿和上采样的任务,得到最终的高质量视频图像。

39.图4为本发明实施例的的网络模型测试结果。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1