一种多延时状态下的图像处理方法与流程

1.本技术属于图像处理技术领域,具体涉及一种多延时状态下的图像处理方法。

背景技术:

2.随着科学技术的发展,对人工智能及机器人的技术研究变得日益成熟,众所周知,目前来说,可以将机器人应用于诸多领域,比如无人配送领域、无人生产领域以及无人监控领域。

3.由于一些环境为高危状态环境、不适合人类活动或者生存的环境,进而,由于上述不利环境不会对机器人的运行或工作造成影响,因此可以通过人工智能机器人获取上述不利环境下或者指定环境的视频或者图像;例如:通过行走机器人获取战场环境下的视频或者图像;通过行走机器人获取月球或者火星表面上的视频或者图像;通过行走机器人获取狭小空间内的视频或者图像。由于基于上述不利环境获取视频或者图像,均是想获取某些目标物体的变化图像,但是由于现有的具有拍照或者拍摄功能的机器人往往无法对指定环境中运动状态下的目标物体进行有效识别,总是存在一些图像获取误差,进而导致无法获得想要的目标图像。

4.鉴于此,本技术提供一种多延时状态下的图像处理方法,进一步克服,无法在多延时状态下,实现对图像的处理这一问题。

技术实现要素:

5.(一)要解决的技术问题

6.鉴于现有技术的上述缺点、不足,本技术提供一种多延时状态下的图像处理方法。

7.(二)技术方案

8.为达到上述目的,本技术采用如下技术方案:

9.第一方面,本技术提供一种多延时状态下的图像处理方法,包括:

10.s1、获取多延时状态中目标图像对应的背景图像;

11.所述目标图像为研究对象所对应的图像;

12.所述背景图像为不包括研究对象的图像;

13.s2、记录研究对象出现在所述背景图像中的初始时间点;

14.s3、获取研究对象部分出现于所述背景图像时的所有子图像;

15.s4、基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,并对所述研究对象的完整外观图像进行图像转换;

16.s5、基于所述完整外观图像获取目标图像,并记录目标图像对应的获取时间点;

17.s6、基于所述初始时间点和获取时间点,获取对应的延迟时间,并基于获得的延迟时间对目标图像进行处理。

18.可选的,所述s1中的获取多延时状态中目标图像对应的背景图像,包括:

19.通过图像采集装置对出现于背景图像中的研究对象进行拍照,获取对应的目标图

像。

20.可选的,所述s3中的获取研究对象部分出现于所述背景图像时的所有子图像,包括:

21.s3-1、通过摄像设备预先获取所述研究对象的多个视图图像,将获取的视图图像对应的数据划分为训练数据集和验证数据集,并导入到图像处理系统中;

22.所述多个视图图像包括:基于不同距离以及不同角度,获取的研究对象的正面图像、后面图像、左面图像、右面图像、上面图像和下面图像;

23.s3-2、基于预设的图像识别训练误差阈值,通过视图图像对应的训练数据集和验证数据集构建图像识别模型;

24.s3-3、基于获取的背景图像,通过构建的图像识别模型获取研究对象部分出现于所述背景图像时的所有子图像。

25.可选的,所述s4中的基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,包括:

26.分别计算每一子图像与背景图像之间的差异值;

27.选取差异值最大的子图像作为研究对象的完整外观图像。

28.可选的,所述s4中的基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,包括:

29.分别识别每一子图像中研究对象的轮廓;

30.分别计算识别出来的每一轮廓与对应子图像的面积占比;

31.将所述面积占比最大的子图像作为研究对象的完整外观图像。

32.可选的,所述s4中的基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,包括:

33.分别计算每一子图像与背景图像中的差异值;

34.基于全部子图像,将第一次出现差异值最大的子图像作为第一子图像;

35.获取所述第一子图像之后连续多个子图像;

36.若所述多个子图像满足预先设定的像素条件,则判定所述多个子图像任一子图像为研究对象的完整外观图像。

37.可选的,所述s4中的基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,包括:

38.分别计算每一子图像与所述背景图像之间的面积占比;

39.基于全部子图像,将所述面积占比最大的子图像作为第二子图像;

40.获取所述第二子图像之后连续多个子图像;

41.若所述多个子图像满足预先设定的像素条件,则判定所述多个子图像任一子图像为研究对象的完整外观图像。

42.可选的,所述s4中的基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,包括:

43.分别识别每一子图像中研究对象的轮廓;

44.获得所述研究对象的轮廓的外界规则几何形状;

45.获得所述研究对象的轮廓的外界规则几何形状的中心点;

46.基于所述中心点确定研究对象的完整外观图像。

47.可选的,所述s4中的对所述研究对象的完整外观图像进行图像转换,包括:获取完整外观图像对应的块像素,并基于所述块像素的rgb值进行图像转换。

48.可选的,所述s4中的对所述研究对象的完整外观图像进行图像转换,包括:

49.s4-1、获取研究对象的完整外观图像对应的块像素;

50.s4-2、基于所述块像素的rgb值计算对应的明暗的面积比,并基于所述面积比设定所述完整外观图像对应的明暗区域;

51.s4-3、将所述完整外观图像对应的明暗区域转换为rgb值对应的波长区域;

52.s4-4、通过将波长区域中包含的rgb值转换为最大波长的亮度,对rgb值进行亮度转换;

53.s4-5、将经过亮度转换的rgb值转换为表示色调的颜色空间hsv值。

54.(三)有益效果

55.基于本技术中的方法,能够实现在多延迟状态下,获取研究对象的图像,并对获取的图像进行相应的处理。

附图说明

56.本技术借助于以下附图进行描述:

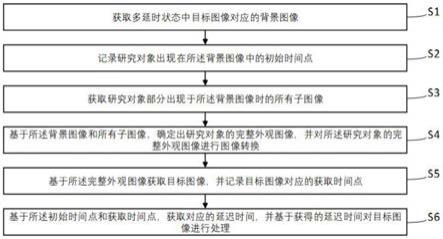

57.图1为多延时状态下的图像处理方法的流程示意图。

具体实施方式

58.为了更好的解释本发明,以便于理解,下面结合附图,通过具体实施方式,对本发明作详细描述。可以理解的是,以下所描述的具体的实施例仅仅用于解释相关发明,而非对该发明的限定。另外还需要说明的是,在不冲突的情况下,本技术中的实施例及实施例中的特征可以相互组合;为了便于描述,附图中仅示出了与发明相关的部分。

59.实施例一提供一种多延时状态下的图像处理方法,如图1所示,具体方法步骤如下:

60.s1、获取多延时状态中目标图像对应的背景图像。

61.本实施例中,目标图像为研究对象所对应的图像。

62.本实施例中,背景图像为不包括研究对象的图像。

63.基于前述步骤s1,对于目标图像对应的背景图像的获取,需要说明的是:

64.通过图像采集装置对出现于背景图像中的研究对象进行拍照,获取对应的目标图像。

65.s2、记录研究对象出现在所述背景图像中的初始时间点。

66.s3、获取研究对象部分出现于所述背景图像时的所有子图像。

67.基于前述步骤s3,需要说明的是:

68.s3-1、通过摄像设备预先获取所述研究对象的多个视图图像,将获取的视图图像对应的数据划分为训练数据集和验证数据集,并导入到图像处理系统中;

69.本实施例中,多个视图图像包括:基于不同距离以及不同角度,获取的研究对象的正面图像、后面图像、左面图像、右面图像、上面图像和下面图像;

70.s3-2、基于预设的图像识别训练误差阈值,通过视图图像对应的训练数据集和验证数据集构建图像识别模型;

71.s3-3、基于获取的背景图像,通过构建的图像识别模型获取研究对象部分出现于所述背景图像时的所有子图像。

72.s4、基于所述背景图像和所有子图像,确定出研究对象的完整外观图像,并对所述研究对象的完整外观图像进行图像转换。

73.基于前述步骤s4,对于研究对象的完整外观图像的确定,需要说明的是:

74.第一种可选的确定方式为:

75.分别计算每一子图像与背景图像之间的差异值;

76.选取差异值最大的子图像作为研究对象的完整外观图像。

77.第二种可选的确定方式为:

78.分别识别每一子图像中研究对象的轮廓;

79.分别计算识别出来的每一轮廓与对应子图像的面积占比;

80.将所述面积占比最大的子图像作为研究对象的完整外观图像。

81.第三种可选的确定方式为:

82.分别计算每一子图像与背景图像中的差异值;

83.基于全部子图像,将第一次出现差异值最大的子图像作为第一子图像;

84.获取所述第一子图像之后连续多个子图像;

85.若所述多个子图像满足预先设定的像素条件,则判定所述多个子图像任一子图像为研究对象的完整外观图像。

86.第四种可选的确定方式为:

87.分别计算每一子图像与所述背景图像之间的面积占比;

88.基于全部子图像,将所述面积占比最大的子图像作为第二子图像;

89.获取所述第二子图像之后连续多个子图像;

90.若所述多个子图像满足预先设定的像素条件,则判定所述多个子图像任一子图像为研究对象的完整外观图像。

91.第五种可选的确定方式为:

92.分别识别每一子图像中研究对象的轮廓;

93.获得所述研究对象的轮廓的外界规则几何形状;

94.获得所述研究对象的轮廓的外界规则几何形状的中心点;

95.基于所述中心点确定研究对象的完整外观图像。

96.基于前述步骤s4,对于对研究对象的完整外观图像进行图像转换,需要说明的是:

97.s4-1、获取研究对象的完整外观图像对应的块像素;

98.s4-2、基于所述块像素的rgb值计算对应的明暗的面积比,并基于所述面积比设定所述完整外观图像对应的明暗区域;

99.s4-3、将所述完整外观图像对应的明暗区域转换为rgb值对应的波长区域;

100.s4-4、通过将波长区域中包含的rgb值转换为最大波长的亮度,对rgb值进行亮度转换;

101.s4-5、将经过亮度转换的rgb值转换为表示色调的颜色空间hsv值。

102.s5、基于所述完整外观图像获取目标图像,并记录目标图像对应的获取时间点。

103.s6、基于所述初始时间点和获取时间点,获取对应的延迟时间,并基于获得的延迟时间对目标图像进行处理。

104.基于实施例一中的方法,能够实现在多延迟状态下,获取研究对象的图像,并对获取的图像进行相应的处理。

105.应当注意的是,在权利要求中,不应将位于括号之间的任何附图标记理解成对权利要求的限制。词语“包含”不排除存在未列在权利要求中的部件或步骤。位于部件之前的词语“一”或“一个”不排除存在多个这样的部件。此外,需要说明的是,在本说明书的描述中,术语“一个实施例”、“一些实施例”、“实施例”、“示例”、“具体示例”或“一些示例”等的描述,是指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本发明的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不必须针对的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任一个或多个实施例或示例中以合适的方式结合。

106.尽管已描述了本发明的优选实施例,但本领域的技术人员在得知了基本创造性概念后,则可对这些实施例做出另外的变更和修改。所以,权利要求应该解释为包括优选实施例以及落入本发明范围的所有变更和修改。

107.显然,本领域的技术人员可以对本发明进行各种修改和变型而不脱离本发明的精神和范围。这样,倘若本发明的这些修改和变型属于本发明权利要求及其等同技术的范围之内,则本发明也应该包含这些修改和变型在内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1