一种胶囊内窥镜胃肠微光图像的自适应增强方法

1.本发明涉及一种胶囊内窥镜胃肠微光图像的自适应增强方法,属于计算机图形学技术领域。

背景技术:

2.无线胶囊内窥镜(wireless capsule endoscopy,wce)图像通常是在有限的照明条件下拍摄的,加之胃肠道的回旋和蠕动等环境的特殊性,导致wce图像不清晰、对比度低甚至产生严重的细节损失,影响医生的诊断或计算机对病灶的识别,甚至对胶囊的自动机器人导航也带来干扰并造成严重的漏检漏测。

3.近年来,微光图像即低光照图像的增强方法已得到了广泛研究,直方图均衡化方法侧重于拉伸整个图像的动态范围,无法克服图像更精细的颜色细节,并且不会根据微光图像中局部照明不足的情况严格调整增强效果。gamma校正方法通过利用幂函数的简单性和效率来实现图像的增强,但是该方法需要为图像或图像局部区域设置最佳参数来达到增强的最佳效果,这将导致微光图像局部区域细节的信息增强不足甚至丢失。基于retinex理论方法使用图像的对数变换和由高斯变换产生的照度分量来提高图像质量,但是该方法在提升图像亮度同时存在局部细节损失。现有方法在对wce图像进行增强时,wce图像局部细节增强与亮度增强之间的平衡并没有达到人们理想的目的,不利于后续的对wce图像的特征提取与匹配。

技术实现要素:

4.为了解决目前存在的wce图像局部细节增强与亮度增强之间的平衡问题,本发明提供了一种胶囊内窥镜胃肠微光图像的自适应增强方法,技术方案如下:

5.本发明的第一个目的在于提供一种胶囊内窥镜胃肠微光图像的自适应增强方法,包括:

6.步骤1:运用引导滤波器对wce图像的hsv颜色空间v分量进行滤波平滑,从而近似估计出所述v分量的照度分量l;

7.步骤2:基于retinex模型分解所述v分量,得到所述v分量的反射分量;

8.步骤3:根据所述照度分量l的最小可觉差阈值与s型函数增益参数的正相关关系得到自适应s型函数,然后利用所述自适应s型函数对所述照度分量l进行自适应增强;

9.步骤4:基于retinex模型将步骤3中自适应增强的照度分量与步骤2中的反射分量进行融合;

10.步骤5:通过加权分布自适应gamma校正算法对步骤4融合得到的wce图像进行对比度增强。

11.可选的,所述步骤1包括:

12.步骤1.1:将wce图像从rgb颜色空间转换到hsv颜色空间;

13.步骤1.2:在引导滤波器中,引导图像为hsv颜色空间v分量,输出图像为照度分量

l,引导图像和输出图像存在线性关系如下:

[0014][0015]

其中,(x,y)为像素索引,ωk为边长为r的方形窗口,窗口中心位于k,ak和bk为线性函数系数,通过下式求出:

[0016][0017]

其中,e(ak,bk)为窗口ωk的代价函数,ε是防止ak过大正则因子;

[0018]

将ak和bk代入线性关系表达式从而求得所述照度分量l。

[0019]

可选的,所述v分量和所述反射分量的关系式为:

[0020]

v(x,y)=r(x,y)

·

l(x,y)

[0021]

其中,v(x,y)为hsv颜色空间v分量,r(x,y)代表反射分量,l(x,y)代表照度分量;

[0022]

将步骤1中的所述照度分量l带入上式l(x,y),从而求得所述v分量的反射分量r。

[0023]

可选的,所述步骤3包括:

[0024]

步骤3.1:根据所述照度分量l计算得到其最小可觉差阈值,计算方法为:

[0025][0026]

步骤3.2:所述照度分量l通过不同增益参数的s型函数进行增强;

[0027][0028]

其中,β为增益参数,l(x,y)为步骤1中得到的照度分量l,le(x,y)是通过s函数增强过后的照度分量;

[0029]

步骤3.3:通过比较所述步骤3.1中的最小可觉差阈值与所述步骤3.2中不同增益参数的s型函数输出得出正相关关系式如下:

[0030][0031]

其中,β(x,y)是照度分量l在(x,y)处的增益参数,jnd(x,y)是所述照度分量l在(x,y)处的最小可觉差阈值;

[0032]

通过步骤3.1计算得到jnd值带入上述正相关关系式,从而得到所述照度分量l不同区域的增益参数β,将所述增益参数β带入s型函数从而得到增强过后的照度分量le(x,y)。

[0033]

可选的,所述步骤4包括:

[0034]

步骤4.1:基于retinex模型将步骤3中增强的照度分量与步骤2中的反射分量进行融合,得到增强的v分量;

[0035]

步骤4.2:将wce图像从hsv颜色空间转换到rgb颜色空间。

[0036]

可选的,所述步骤5包括:

[0037]

步骤5.1:计算自适应参数γ:

[0038]

γ=1-cdf(l)

[0039]

其中,cdf(l)是累积分布函数,l是图像强度;

[0040]

步骤5.2:通过步骤5.1中得到的参数γ,带入gamma校正函数对步骤4得到的wce图像进行对比度增强:

[0041][0042]

其中,l

max

是图像的最大强度,t(l)是执行此函数后的wce图像增强结果。

[0043]

本发明的第二个目的在于提供一种胶囊内窥镜胃肠微光图像的识别或分类方法,采用权利要求上述的胶囊内窥镜胃肠微光图像的自适应增强方法进行图像增强,然后对增强后的图像进行特征提取与匹配,最后基于提取的特征进行识别或分类。

[0044]

本发明的第三个目的在于提供一种胶囊内窥镜胃肠微光图像的识别或分类系统,包括:

[0045]

图像获取模块,用于获取待识别或分类的图像;

[0046]

图像预处理模块,用于对获取的图像进行预处理,所述预处理过程包括采用上述的胶囊内窥镜胃肠微光图像的自适应增强方法对图像进行自适应增强;

[0047]

特征提取模块,用于对预处理之后的图像进行特征提取;

[0048]

输出显示模块,用于根据特征提取结果,输出识别或分类结果。

[0049]

本发明有益效果是:

[0050]

引导滤波利用引导图像和输出图像之间的线性关系,其边缘保持效果良好,本发明运用引导滤波器对wce图像进行滤波平滑来近似地估计出wce微光图像的照度分量,从而更精确的增强wce微光图像的边缘。其次,本发明根据照度分量的jnd阈值与s型函数的增益参数的正相关关系得到自适应s型函数,来对照度分量进行自适应增强,从而解决wce微光图像亮区域过度增强而导致的细节丢失的问题和弥补暗区域细节增强不足的缺陷。但是经过s型函数增强之后,wce图像亮度动态范围会缩小,本发明再结合加权分布自适应gamma校正算法对上述增强的wce图像进行对比度增强,使得最后得到的增强结果整体对比度更佳。且使用本发明增强之后的wce图像特征点提取与匹配数均优于经典增强算法,平均分别提升了67.1%和57.3%。

附图说明

[0051]

为了更清楚地说明本发明实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0052]

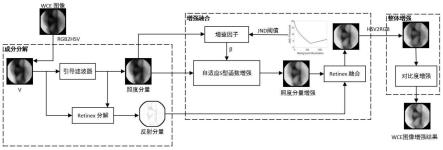

图1是本发明的胶囊内窥镜胃肠微光图像的自适应增强方法流程框图。

[0053]

图2是本发明实施例二的wce输入图像。

[0054]

图3是本发明实施例二的hsv颜色空间v分量图。

[0055]

图4是本发明实施例二的照度分量图。

[0056]

图5是本发明实施例二的反射分量图。

[0057]

图6是本发明实施例二的照度分量自适应增强结果图。

[0058]

图7是本发明实施例二的v分量自适应增强结果图。

[0059]

图8是本发明实施例二的wce图像增强结果rgb颜色空间图。

[0060]

图9是本发明实施例二的wce图像增强结果输出图。

[0061]

图10是本发明实施例二的wce图像增强结果与其他增强方法特征提取与匹配比较图。

具体实施方式

[0062]

为使本发明的目的、技术方案和优点更加清楚,下面将结合附图对本发明实施方式作进一步地详细描述。

[0063]

实施例一:

[0064]

本实施例提供一种胶囊内窥镜胃肠微光图像的自适应增强方法,如图1所示,包括以下步骤:

[0065]

步骤1:运用引导滤波器对wce图像的hsv颜色空间v分量进行滤波平滑,从而近似估计出所述v分量的照度分量l;

[0066]

步骤2:基于retinex模型分解所述v分量,得到所述v分量的反射分量;

[0067]

步骤3:根据所述照度分量l的最小可觉差阈值与s型函数增益参数的正相关关系得到自适应s型函数,然后利用所述自适应s型函数对所述照度分量l进行自适应增强;

[0068]

步骤4:基于retinex模型将步骤3中自适应增强的照度分量与步骤2中的反射分量进行融合;

[0069]

步骤5:通过加权分布自适应gamma校正算法对步骤4融合得到的wce图像进行对比度增强。

[0070]

实施例二:

[0071]

本实施例提供一种胶囊内窥镜胃肠微光图像的自适应增强方法,如图1所示,具体按照以下步骤实施:

[0072]

步骤1:运用引导滤波器对wce图像hsv颜色空间的v分量进行滤波平滑,从而近似估计出v的照度分量;

[0073]

步骤1.1:将wce图像从rgb颜色空间转换到hsv颜色空间,如图2所示为输入的wce图像,图3为wce图像的hsv颜色空间v分量;

[0074]

步骤1.2:在引导滤波器中,引导图像为hsv颜色空间v分量,输出图像为照度分量l,引导图像和输出图像存在线性关系如下:

[0075][0076]

其中,(x,y)为像素索引,ωk为边长为r的方形窗口,窗口中心位于k,ak和bk为线性函数系数,通过下式求出:

[0077][0078]

其中,e(ak,bk)为窗口ωk的代价函数,ε是防止ak过大正则因子。将ak和bk代入线性关系表达式从而求得照度分量l,如图4所示。

[0079]

步骤2:基于retinex模型分解v分量得到其反射分量;

[0080]

retinex模型[land e h.the retinex[j].american scientist,1964,52(2):

247-264]表达式如下。

[0081]

v(x,y)=r(x,y)

·

l(x,y)

[0082]

其中,(x,y)为像素索引,v(x,y)为hsv颜色空间v分量,r(x,y)代表反射分量,l(x,y)为步骤1中得到的照度分量。将步骤1中的照度分量l带入上式的l(x,y),从而求得v(x,y)分量的反射分量r(x,y),如图5所示,为得到的反射分量。

[0083]

步骤3:根据步骤1中的照度分量的最小可觉差(just-noticeable difference,jnd)阈值与s型函数的增益参数的正相关关系得到自适应s型函数,来对步骤1中的照度分量进行自适应增强;

[0084]

步骤3.1:根据步骤1中的照度分量计算得到其最小可觉差(just-noticeable difference,jnd)阈值[jayant n.signal compression:technology targets and research directions[j].ieee journal on selected areas in communications,1992,10(5):796-818]

[0085][0086]

步骤3.2:照度分量通过不同增益参数的s型函数进行增强

[0087][0088]

其中,(x,y)为像素索引,β为增益参数,l(x,y)为步骤1中得到的照度分量,le(x,y)是通过s函数增强过后的照度分量;

[0089]

步骤3.3:通过比较所述步骤3.1中的最小可觉差阈值与所述步骤3.2中不同增益参数的s型函数输出得出正相关关系如下:

[0090][0091]

其中,β(x,y)是照度分量l在(x,y)处的增益参数,jnd(x,y)是照度分量l在(x,y)处的最小可觉差阈值。

[0092]

通过步骤3.1计算得到jnd值带入上述正相关关系式,从而得到照度分量l不同区域的增益参数β,将β带入上述s型函数从而得到增强过后的照度分量le(x,y);如图6所示,为自适应s型函数增强过后的照度分量。

[0093]

步骤4:基于retinex模型将步骤3中增强的照度分量与步骤2中的反射分量进行融合;

[0094]

步骤4.1:基于retinex模型将步骤3中增强的照度分量与步骤2中的反射分量进行融合,得到增强的v分量,如图7所示,为增强过后的v分量;

[0095]

步骤4.2:将wce图像从hsv颜色空间转换到rgb颜色空间,如图8所示,为上述增强过后wce图像的rgb颜色空间结果;

[0096]

步骤5:通过加权分布自适应gamma校正算法对步骤4得到的wce图像进行对比度增强。

[0097]

步骤5.1:计算自适应参数γ。

[0098]

γ=1-cdf(l)

[0099]

其中,cdf(l)是累积分布函数,l是图像强度。

[0100]

步骤5.2:通过步骤5.1中得到的参数γ,带入gamma校正函数对步骤4得到的wce图像进行对比度增强:

[0101][0102]

其中,l

max

是图像的最大强度,t(l)是执行此函数后的wce图像增强结果。如图9所示,为最后wce图像增强结果。

[0103]

为了进一步说名本发明的有益效果,进行了如下对比实验。

[0104]

本发明首先采用afgtcr[long m,lan z,xie x,et al.image enhancement method based on adaptive fraction gamma transformation and color restoration for wireless capsule endoscopy[c].2018 ieee biomedical circuits and systems conference(biocas).ieee,2018:1-4]、agcwd[huang s c,cheng f c,chiu y s.efficient contrast enhancement using adaptive gamma correction with weighting distribution[j].ieee transactions on image processing,2012,22(3):1032-1041]、fu[fu q,jung c,xu k.retinex-based perceptual contrast enhancement in images using luminance adaptation[j].ieee access,2018,6:61277-61286]、lr3m[ren x,yang w,cheng w h,et al.lr3m:robust low-light enhancement via low-rank regularized retinex model[j].ieee transactions on image processing,2020,29:5862-5876]以及本发明的方法对60张wce微光图像进行处理,再结合经典的sift[lowe d g.distinctive image features from scale-invariant keypoints[j].international journal of computer vision,2004,60(2):91-110]特征提取与flann[muja m,lowe d g.fast approximate nearest neighbors with automatic algorithm configuration[j].visapp(1),2009,2(331-340):2]特征匹配,最后采用随机抽样一致性算法(random sample consensus,ransac)[fischler m a,bolles r c.random sample consensus:a paradigm for model fitting with applications to image analysis and automated cartography[j].communications of the acm,1981,24(6):381-395]消除一些错误的匹配对和误差,得到精确的特征点匹配数量。图10中(a)-(f)为上述现有方法与本发明的方法特征点提取与匹配结果,可以发现经过本发明增强之后,在wce图像暗区域与亮区域特征点提取与匹配有明显增加。表1显示了使用不同方法增强60张wce微光图像之后的特征点提取与匹配平均值。

[0105]

表1不同方法特征提取与匹配比较

[0106][0107]

由表1的数据可以看出,本发明方法增强之后特征提取与匹配效果最优。相比于afgtcr、agcwd、fu、lr3m的方法,本发明的特征提取与匹配数量平均分别提升了67.1%和

57.3%。

[0108]

本发明实施例中的部分步骤,可以利用软件实现,相应的软件程序可以存储在可读取的存储介质中,如光盘或硬盘等。

[0109]

以上所述仅为本发明的较佳实施例,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1