一种基于毫米波与相机一体的路测设备的时空同步方法与流程

本发明涉及自动驾驶,具体而言,涉及一种基于毫米波与相机一体的路测设备的时空同步方法。

背景技术:

1、当前车辆在自动驾驶与辅助驾驶领域里存在着感知受限、存在视野盲区和长距离物体识别受限等问题,而利用车路协同技术,将多种传感器数据在数据层和决策层进行融合,可以大大提升交通的安全性。

2、单用相机图像数据,无法准确获取目标的空间距离,单一的视觉相机检测设备精度不够高,稳定性也比较差,且容易受到光线、天气等因素的影响。毫米波雷达受光照和天气因素的影响较小,稳定性比较高,并且测距精度也比较高,距离也比较远,但是目前毫米波雷达分辨率低,且对金属较敏感,导致识别精度比较差。因此,现有技术中,通常采用相机和雷达进行数据融合,但现有融合方案中,需要借助高精度rtk(real time kinematic,实时动态测量)现场打点进行标定,不利于大量安装部署,从而无法实现量产,且需要定期维护,因此会增加维护成本。

技术实现思路

1、本发明提供一种基于毫米波与相机一体的路测设备的时空同步方法及系统,用以克服现有技术中存在的至少一个技术问题。

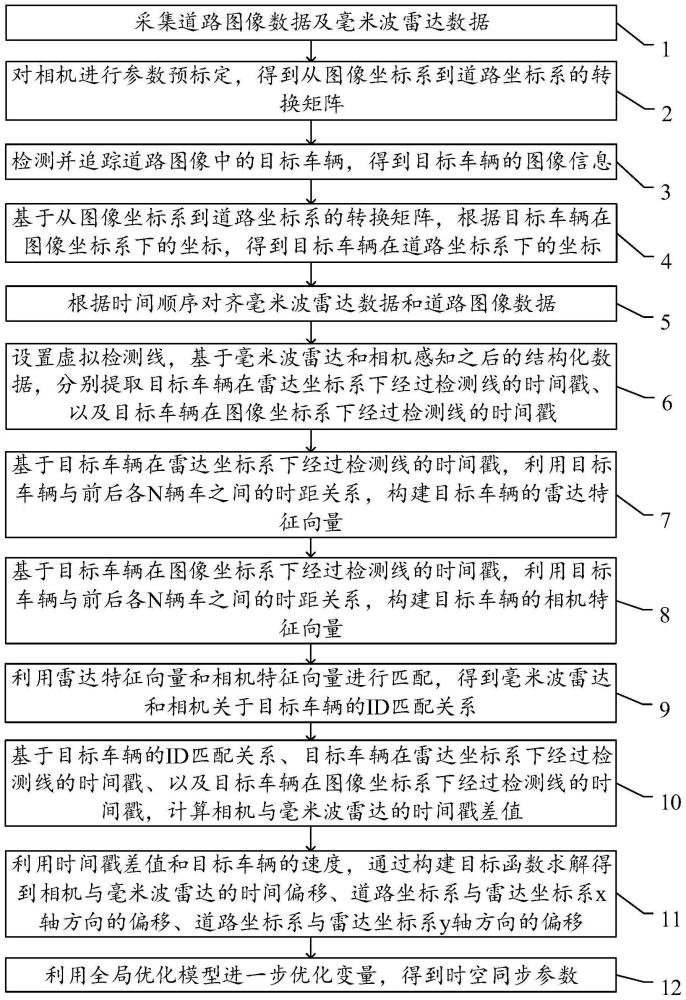

2、本发明实施例提供一种基于毫米波与相机一体的路测设备的时空同步方法,包括:

3、采集道路图像数据及毫米波雷达数据;

4、对所述相机进行参数预标定,得到从图像坐标系到道路坐标系的转换矩阵;

5、检测并追踪所述道路图像中的目标车辆,得到所述目标车辆的图像信息;所述图像信息至少包括所述目标车辆的id、时间戳以及在图像坐标系下的坐标;

6、基于从图像坐标系到道路坐标系的转换矩阵,根据所述目标车辆在图像坐标系下的坐标,得到所述目标车辆在道路坐标系下的坐标;

7、根据时间顺序对齐所述毫米波雷达数据和所述道路图像数据;

8、设置虚拟检测线,基于所述毫米波雷达和所述相机感知之后的结构化数据,分别提取所述目标车辆在所述雷达坐标系下经过所述检测线的时间戳、以及所述目标车辆在所述图像坐标系下经过所述检测线的时间戳;

9、基于所述目标车辆在所述雷达坐标系下经过所述检测线的时间戳,利用所述目标车辆与前后各n辆车之间的时距关系,构建所述目标车辆的雷达特征向量;

10、基于所述目标车辆在所述图像坐标系下经过所述检测线的时间戳,利用所述目标车辆与前后各n辆车之间的时距关系,构建所述目标车辆的相机特征向量;

11、利用所述雷达特征向量和所述相机特征向量进行匹配,得到所述毫米波雷达和所述相机关于所述目标车辆的id匹配关系;

12、基于所述目标车辆的id匹配关系、所述目标车辆在所述雷达坐标系下经过所述检测线的时间戳、以及所述目标车辆在所述图像坐标系下经过所述检测线的时间戳,计算所述相机与所述毫米波雷达的时间戳差值;

13、利用时间戳差值和目标车辆的速度,通过构建目标函数求解得到相机与毫米波雷达的时间偏移δt、道路坐标系与雷达坐标系x轴方向的偏移δx、道路坐标系与雷达坐标系y轴方向的偏移δy;其中,vi表示目标车辆的平均速度,ei表示高斯噪声;

14、利用全局优化模型和进一步优化变量为得到时空同步参数,其中,kx、ky分别表示从图像坐标系到道路坐标系x轴方向与y轴方向的尺度系数,θ表示道路坐标系与雷达坐标系的相对角度偏移,ex_i、ey_i表示像素的选择误差,xw_i、yw_i表示目标车辆在道路坐标系下的坐标,xwr_i、ywr_i表示道路坐标系下的目标车辆转换到雷达坐标系下的坐标,xr_i与yr_i表示目标车辆在雷达坐标系下的坐标。

15、可选地,对所述相机进行参数预标定,得到从图像坐标系到道路坐标系的转换矩阵,具体为:

16、在所述图像坐标系中设置至少4个第一标定点;

17、在所述道路坐标系中设置与所述图像坐标系中的至少4个第一标定点一一对应的第二标定点;

18、利用所述第一标定点在所述图像坐标系下的坐标和所述第二标定点在所述道路坐标系下的坐标,根据模型计算得到从所述图像坐标系到所述道路坐标系的转换矩阵;其中,u、v表示图像坐标系坐标,u、v表示道路坐标系坐标,z表示尺度,h为单应矩阵。

19、可选地,所述目标车辆在道路坐标系下的坐标为:其中,um、vm表示目标车辆在图像坐标系下的坐标。

20、可选地,根据时间顺序对齐所述毫米波雷达数据和所述道路图像数据,具体为:

21、采用线性插值方法,以毫米波雷达时间为基准,在相机队列里寻找与当前毫米波雷达时间戳相邻的两个时间戳,利用时间比例关系,计算当前时刻目标车辆在雷达坐标系下的坐标和速度。

22、可选地,采集道路图像及毫米波雷达数据之前,还包括:

23、初始化检测线的值为ydetectiom_line。

24、可选地,基于所述目标车辆在所述雷达坐标系下经过所述检测线的时间戳,利用所述目标车辆与前后各n辆车之间的时距关系,构建所述目标车辆的雷达特征向量,具体为:

25、在雷达坐标系下,假设第i辆车为所述目标车辆,计算所述目标车辆与前后各n辆车之间的时距,得到所述目标车辆的雷达特征向量为[ti-n-ti,…,ti-1-ti,ti,ti+1-ti,…,ti+n-ti];其中,ti表示在雷达坐标系下第i辆车通过检测线的时间戳;

26、基于所述目标车辆在所述图像坐标系下经过所述检测线的时间戳,利用所述目标车辆与前后各n辆车之间的时距关系,构建所述目标车辆的相机特征向量,具体为:

27、在图像坐标系下,假设第j辆车为所述目标车辆,计算所述目标车辆与前后各n辆车之间的时距,得到所述目标车辆的相机特征向量为[tj-n-tj,…,tj-1-tj,tj,tj+1-tj,…,tj+n-tj];其中,tj表示在图像坐标系下第j辆车通过检测线的时间戳。

28、可选地,利用所述雷达特征向量和所述相机特征向量进行匹配,具体为:

29、利用所述目标车辆的雷达特征向量和相机特征向量,构建特征匹配模型

30、利用匈牙利匹配算法计算特征匹配模型,得到匹配结果描述为match_id<r,c>;其中,r表示雷达检测目标车辆的id,c表示相机检测目标车辆的id。

31、可选地,所述相机与所述毫米波雷达的时间戳差值包括理论时间戳差值δti和实际时间戳差值

32、所述实际时间戳差值为所述理论时间戳差值为

33、可选地,δy=yradar_act-yvideo_act,其中,yradar_act表示雷达检测线的值,yradar_act=ydetection_line,yvideo_act表示图像检测线的值,设置为常数;

34、按预定间距调整所述图像检测线的值,当f的值小于等于阈值时,得到δy;

35、根据反推得到δt。

36、可选地,所述检测并追踪所述道路图像中的目标车辆,具体为:

37、采用开源yolov5算法框架检测所述目标车辆;

38、采用开源deep sort算法框架追踪所述目标车辆。

39、本发明实施例的创新点包括:

40、1、本实施例中,基于摄像机和雷达的时间流速一致,在场景中通过多条虚拟检测线匹配连续车辆的时距,基于匹配关系完成时间与纵向误差预标定,利用场景的特征信息实现实时在线标定,不需要依赖rtk现场打点,且无需定期维护,有利于节约成本,是本发明实施例的创新点之一。

41、2、本实施例中,利用道路中车辆间的时距关系、相机与雷达检测点的映射关系等建立非线性优化模型,从而能够提高标定精度,解决了标定精度低的问题,是本发明实施例的创新点之一。

- 还没有人留言评论。精彩留言会获得点赞!