一种基于光流学习的视频帧表情动作片段定位方法及系统

本发明涉及人脸表情动作片段定位,尤其涉及一种基于光流学习的视频帧表情动作片段定位方法及系统。

背景技术:

1、表情动作片段定位在计算机视觉和情感分析研究领域引起了广泛的学术兴趣。因为它通常作为各种高级面部分析任务中的先决步骤,包括人机交互、医疗保健和驾驶员辅助系统等应用领域。表情动作片段定位的主要目标是识别未修剪的长视频中是否存在表情动作,并确定这些表情动作片段的起始帧和结束帧。通过准确定位表情动作片段,可以有效地删除与任务无关的视频内容,从而提高后续分析任务的准确性。传统的手工定位方法需要大量的人力和时间投入,其性能很大程度上依赖于专家的经验和主观判断。相比之下,自动定位方法利用机器学习和计算机视觉的进步,能够提供更准确和一致的定位结果,为进一步进行面部表情分析提供了可靠的基础。因此,研究表情动作片段领域的自动定位方法具有重要的学术和应用价值。

2、而传统的自动表情动作片段定位方法依赖于手工制作的特征来描述每一帧表情,例如局部二值模式、定向梯度直方图和光流。它们通常在固定长度的时间窗口内检测第一帧和后续帧之间的特征差异,并通过对整个视频进行阈值操作来确定显著的运动。然而,由于传统方法缺乏学习表情中嵌入的情绪线索的机制,因此它们无法区分表情动作和其他非情绪动作,随着人工智能的快速发展,基于深度学习的自动表情动作片段定位方法取得了卓越的性能提升。这些方法将特征学习和分类器网络集成到一个框架中,并从原始视频中定位起始帧和结束帧。由于基于深度学习的方法能够从训练数据中学习情绪线索,因此它们可以有效地区分表情动作和其他非情绪动作。然而,现有方法将光流估计和表情定位视为两个单独的步骤,导致整个网络的更新缺乏统一的优化框架。此外,这些方法需要在训练和推理阶段估计光流图,导致计算成本很高,其次,同一类别的不同实例通常具有共享的视觉模式和特征。深度学习模型在训练过程中通过学习这些共享特征可以更好地理解和区分不同类别,提升模型泛化性。而现有方法忽略了视频片段中包含的语义一致性约束。例如,视频片段及其帧通常具有相似或一致的表情类别特征,并且这种一致性可能存在于每个抽象级别。忽略视频片段中包含的语义一致性约束导致最终的表情预测定位精度偏低。

技术实现思路

1、为了解决上述技术问题,本发明的目的是提供一种基于光流学习的视频帧表情动作片段定位方法及系统,能够减少网络模型的推理时间和计算成本,并提升视频帧表情动作片段定位准确率。

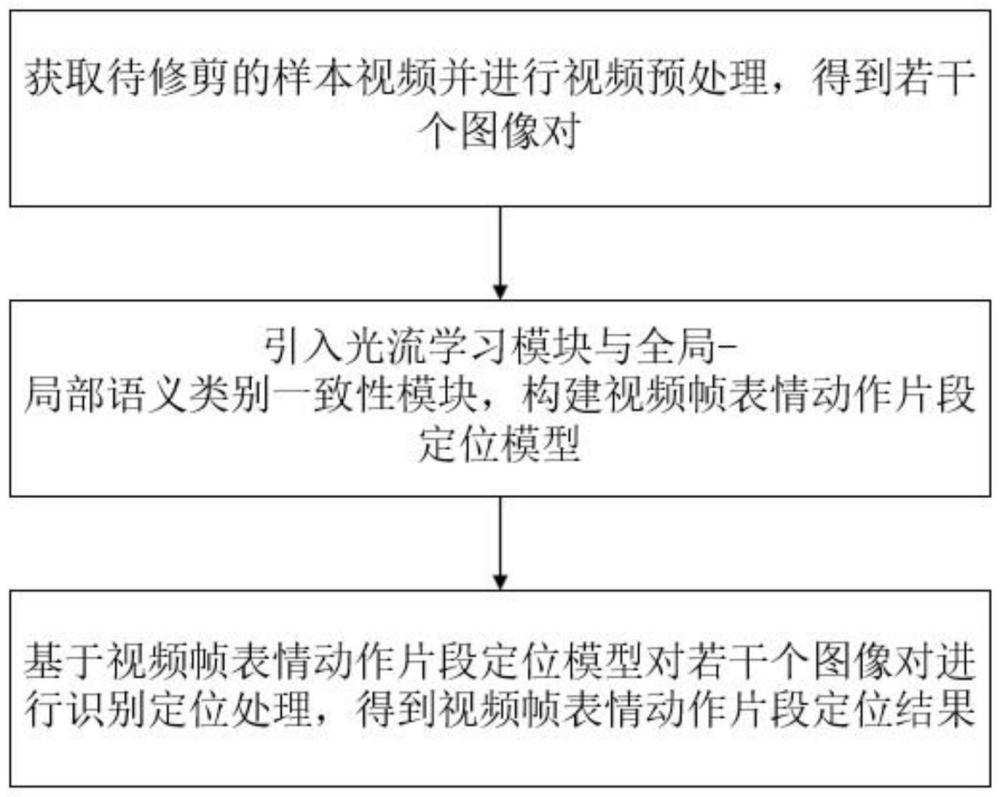

2、本发明所采用的第一技术方案是:一种基于光流学习的视频帧表情动作片段定位方法,包括以下步骤:

3、获取待修剪的样本视频并进行视频预处理,得到若干个图像对;

4、引入光流学习模块与全局-局部语义类别一致性模块,构建视频帧表情动作片段定位模型;

5、基于视频帧表情动作片段定位模型对若干个图像对进行识别定位处理,得到视频帧表情动作片段定位结果。

6、进一步,所述获取待修剪的样本视频并进行视频预处理,得到若干个图像对这一步骤,其具体包括:

7、获取待修剪的样本视频;

8、通过预设固定的采样速率对待修剪的视频进行采样处理,得到采样后的样本视频;

9、通过滑动窗口对采样后的样本视频进行切割处理,得到若干个视频片段,每个视频片段包括t帧,相邻视频片段之间的时间重叠为t/2;

10、基于每个视频片段在不同时间尺度上的运动变化,对若干个视频片段的第一帧及后续帧进行组合,得到若干个图像对。

11、进一步,所述视频帧表情动作片段定位模型包括光流学习模块、定位模块与全局-局部语义类别一致性模块,所述光流学习模块包括编码器结构与解码器结构,所述光流学习模块的编码器结构的第一输出端与所述光流学习模块的解码器结构的输入端连接,所述光流学习模块的编码器结构的第二输出端与所述定位模块的输入端连接,所述光流学习模块的编码器结构的第三输出端、所述定位模块的输出端与所述全局-局部语义类别一致性模块的输入端连接。

12、进一步,所述基于视频帧表情动作片段定位模型对若干个图像对进行识别定位处理,得到视频帧表情动作片段定位结果这一步骤,其具体包括:

13、将若干个图像对输入至视频帧表情动作片段定位模型;

14、基于光流学习模块,对若干个图像对进行光流估计处理,得到图像对的关键运动特征与光流图;

15、根据视频片段的时间顺序对图像对的关键运动特征进行连接,得到组合后的运动特征;

16、基于定位模块,对组合后的运动特征进行表情动作片段估计处理,得到表情动作片段的起始帧和表情动作片段的结束帧和图像对的全局语义类别特征;

17、基于全局-局部语义类别一致性模块,对图像对的关键运动特征进行相似语义类别的信息提取处理,得到图像对的局部语义类别特征,对全局语义类别特征和局部语义类别提特征施加一致性约束;

18、根据光流图、表情动作片段的起始帧和表情动作片段的结束帧进行预测以及图像对的语义类别特征全局语义类别特征和局部语义类别提特征施加一致性约束,得到视频帧表情动作片段定位结果。

19、进一步,所述基于光流学习模块,对若干个图像对进行光流估计处理,得到图像对的关键运动特征与光流图这一步骤,其具体包括:

20、将若干个图像对输入至光流学习模块;

21、基于光流学习模块的编码器结构,对若干个图像对进行特征提取处理,得到图像对的关键运动特征;

22、获取若干个图像对的光流标签;

23、基于光流学习模块的解码器结构,根据若干个图像对的光流标签与图像对的关键运动特征进行光流预估处理,得到光流图。

24、进一步,所述获取若干个图像对的光流标签这一步骤,其具体包括:

25、通过法尔内贝克算法获取图像对的光流;

26、根据图像对的光流,通过dlib算法获取视频片段中的人物面部标志,构建感兴趣区域;

27、对感兴趣区域进行增加像素的额外边距处理,得到若干个图像对的光流标签。

28、进一步,所述基于定位模块,对组合后的运动特征进行表情动作片段估计处理,得到表情动作片段的起始帧、表情动作片段的结束帧和图像对的全局语义类别特征这一步骤,其具体包括:

29、将组合后的运动特征输入至定位模块,所述定位模块包括时间特征金字塔块、分类器和回归器;

30、基于时间特征金字塔块,对组合后的运动特征进行不同时间尺度的时空特征提取处理,得到特征用于估计时间相对距离对和分类;

31、基于回归器,对特征估计时间相对距离对进行帧位置之间的距离计算,得到表情动作区间;

32、基于分类器,对特征进行表情动作分类,得到表情动作与非表情动作;

33、结合表情动作类别与表情动作区间,得到表情动作片段的起始帧和表情动作片段的结束帧。

34、进一步,所述基于全局-局部语义类别一致性模块,对图像对的关键运动特征进行相似语义类别的信息提取处理,得到图像对的局部语义类别特征这一步骤,对全局语义类别特征和局部语义类别提特征施加一致性约束这一步骤,其具体包括:

35、将图像对的关键运动特征输入至全局-局部语义类别一致性模块,所述全局-局部语义类别一致性模块包括一致性损失函数和下采样操作模块;

36、基于下采样操作模块,对图像对的关键运动特征进行下采样操作处理,得到局部语义特征;

37、引入定位模块中的分类器的输出结果,并结合局部语义特征,映射至潜在空间中进行分类,得到类别向量;

38、基于一致性损失函数对类别向量进行语义类别约束。

39、进一步,所述视频帧表情动作片段定位模型的损失函数为:

40、l=αflowlflow+αclslcls+αtioultiou+αconlcon

41、上式中,lflow表示光流学习损失函数,lcls表示分类损失函数,ltiou表示定位损失函数,lcon表示一致性约束损失函数,l表示视频帧表情动作片段定位模型的损失函数,αflow、αcls、αtiou和αcon表示对应的超参数。

42、本发明所采用的第二技术方案是:一种基于光流学习的视频帧表情动作片段定位系统,包括:

43、预处理模块,用于获取待修剪的样本视频并进行视频预处理,得到若干个图像对;

44、构建模块,用于引入光流学习模块与全局-局部语义类别一致性模块,构建视频帧表情动作片段定位模型;

45、定位模块,用于基于视频帧表情动作片段定位模型对若干个图像对进行识别定位处理,得到视频帧表情动作片段定位结果。

46、本发明方法及系统的有益效果是:本发明通过待修剪的样本视频进行视频预处理,采用固定速率对视频帧进行采样,以降低计算成本,进一步引入光流学习模块与全局-局部语义类别一致性模块,构建视频帧表情动作片段定位模型对预处理后的样本视频进行表情片段定位识别,光流学习模块的解码器在训练阶段学习光流图,驱使光流学习模块中的编码器能提取富含运动信息的特征,提升视频帧表情动作片段定位准确率。全局-局部语义类别一致性模块能够约束两个级别的语义类别特征即对全局和局部级别的语义类别特征施加一致性约束,确保不同级别的信息能够协同用于有效区分表情类别,并关注了视频中的类别一致性区域,能够提升视频帧表情动作片段定位准确率。光流学习模块的解码器和全局-局部语义类别一致性模块仅在训练阶段使用,在推理阶段无需显式计算光流特征,从而显著降低了计算成本。

- 还没有人留言评论。精彩留言会获得点赞!