一种基于多场景识别与语音交互的视频监控方法及系统与流程

本发明涉及视频监控领域,具体来说,尤其涉及一种基于多场景识别与语音交互的视频监控方法及系统。

背景技术:

1、目前,视频监控是安全防护系统的重要组成部分,它能帮助监控人员实时观察场所内的情况,快速发现和应对可能的安全威胁。例如,摄像头常常用于商店、银行、公共交通和学校等地方,以防止犯罪行为的发生,通过摄像头监控和分析人员的行为模式,可以帮助商家了解顾客的购物行为、优化店铺布局,或者帮助城市管理者优化交通流量等,随着人工智能技术的发展,视频监控系统不再仅仅是被动记录和播放视频,而是可以实现自动目标检测、行为识别、异常检测等高级功能,极大地提高了视频监控的效率和准确性。

2、视频监控是一种强大的工具,能够提供有价值的信息,帮助我们更好地理解和管理我们的环境。然而,随着技术的发展,我们也需要面对一些新的挑战。

3、传统的视频监控系统通常依赖于预设的规则和阈值来识别异常行为,这种方法缺乏灵活性,不能适应不断变化的环境和行为模式,依赖于手动特征提取和规则设置的方法,对于复杂和抽象的特征提取效果不佳,容易产生误报和漏报,同时处理效率低下,传统方法往往只能识别和追踪视频中的物体,但无法深入理解和分析物体的行为模式,难以识别出异常或者可疑的行为,在检测到异常行为后,传统的视频监控系统的反应速度往往较慢,无法及时触发警报,从而影响了安全防护的效果。

4、针对相关技术中的问题,目前尚未提出有效的解决方案。

技术实现思路

1、为了克服以上问题,本发明旨在提出一种基于多场景识别与语音交互的视频监控方法及系统,目的在于解决传统的视频监控系统通常依赖于预设的规则和阈值来识别异常行为,这种方法缺乏灵活性,不能适应不断变化的环境和行为模式,依赖于手动特征提取和规则设置的方法,对于复杂和抽象的特征提取效果不佳,容易产生误报和漏报,同时处理效率低下的问题。

2、为此,本发明采用的具体技术方案如下:

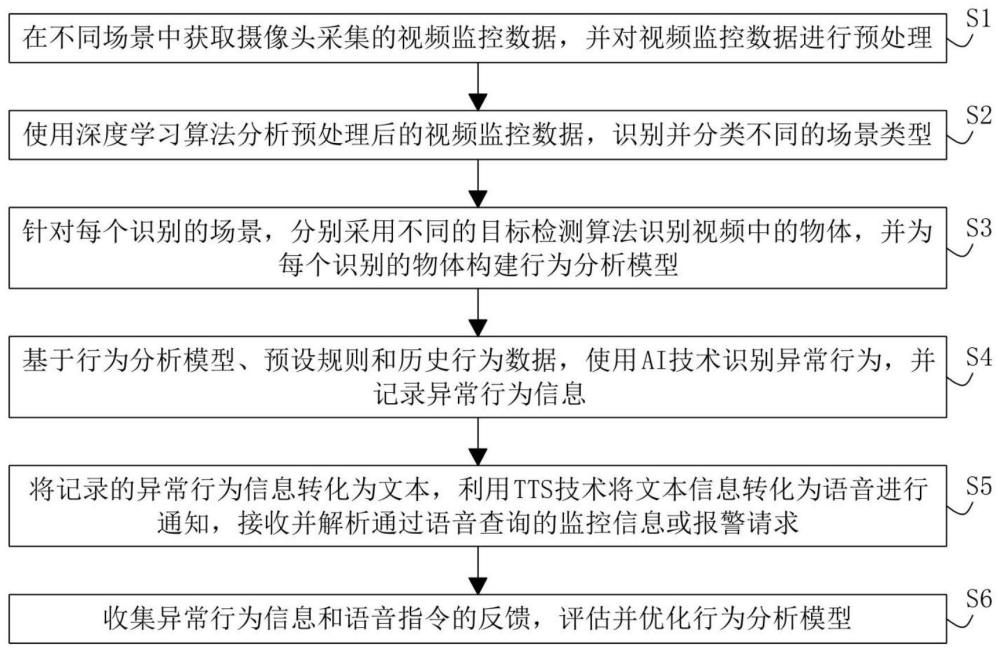

3、根据本发明的一个方面,提供了一种基于多场景识别与语音交互的视频监控方法,该视频监控方法包括以下步骤:

4、s1、在不同场景中获取摄像头采集的视频监控数据,并对视频监控数据进行预处理;

5、s2、使用深度学习算法分析预处理后的视频监控数据,识别并分类不同的场景类型;

6、s3、针对每个识别的场景,分别采用不同的目标检测算法识别视频中的物体,并为每个识别的物体构建行为分析模型;

7、s4、基于行为分析模型、预设规则和历史行为数据,使用ai技术识别异常行为,并记录异常行为信息;

8、s5、将记录的异常行为信息转化为文本,利用tts技术将文本信息转化为语音进行通知,接收并解析通过语音查询的监控信息或报警请求;

9、s6、收集异常行为信息和语音指令的反馈,评估并优化行为分析模型。

10、可选地,在不同场景中获取摄像头采集的视频监控数据,并对视频监控数据进行预处理包括以下步骤:

11、s11、在不同场景中获取摄像头采集的视频监控数据;

12、s12、使用中值滤波器去除视频监控数据中的随机噪声;

13、s13、对视频监控数据中的每一帧进行亮度和对比度的调整;

14、s14、分析视频监控数据的内容,提取关键帧,并为每个关键帧添加时间戳。

15、可选地,使用深度学习算法分析预处理后的视频监控数据,识别并分类不同的场景类型包括以下步骤:

16、s21、根据场景分类的复杂度,选择深度学习算法,并构建卷积神经网络模型;

17、s22、从预处理后的视频监控数据中提取场景图片或视频片段,并构建训练集和验证集;

18、s23、使用训练集对卷积神经网络模型进行训练,通过调整模型的参数、使用损失函数和优化器最小化训练误差;

19、s24、通过验证集评估训练好的卷积神经网络模型的性能,并对卷积神经网络模型进行初步优化;

20、s25、使用初步优化的卷积神经网络模型对新的视频监控数据进行特征提取,并根据提取的特征对视频中的场景进行分类;

21、s26、对分类结果进行分析,识别分类错误的案例,并根据错误案例的反馈对卷积神经网络模型进行优化;

22、s27、将优化后的卷积神经网络模型部署到视频监控平台中,实现实时场景识别和分类。

23、可选地,针对每个识别的场景,分别采用不同的目标检测算法识别视频中的物体,并为每个识别的物体构建行为分析模型包括以下步骤:

24、s31、根据识别的场景特点,为每个场景定制目标检测模型;

25、s32、针对每个场景,从视频监控数据中提取物体图像或视频片段,并进行标注,构建训练集;

26、s33、数据集训练每个场景的目标检测模型;

27、s34、在视频监控平台中部署训练好的目标检测模型,对实时视频流进行物体识别和追踪;

28、s35、对每个识别的物体,根据物体在视频中的运动轨迹、交互和上下文信息,构建行为分析模型,使用标注的视频数据训练行为分析模型,分析视频数据的不同行为模式;

29、s36、将训练好的行为分析模型集成到视频监控平台中,进行行为识别和行为分析;

30、s37、设置监控和响应机制,当行为分析模型检测异常行为时,及时触发警报。

31、可选地,对每个识别的物体,根据物体在视频中的运动轨迹、交互和上下文信息,构建行为分析模型,使用标注的视频数据训练行为分析模型,分析视频数据的不同行为模式包括以下步骤:

32、s351、从视频监控平台中收集包含目标行为的视频片段;

33、s352、对视频片段进行标注,标明目标行为的类型、开始时间和结束时间;

34、s353、从标注的视频数据中提取行为特征;

35、s354、根据行为特征,构建行为分析模型,并使用标注的视频数据对行为分析模型进行训练;

36、s355、将训练好的行为分析模型集成到视频监控平台中,并利用行为分析模型分析视频数据的不同行为模式。

37、可选地,设置监控和响应机制,当行为分析模型检测异常行为时,及时触发警报包括以下步骤:

38、s371、在家庭安全监控、留守老人看护、儿童陪护及家庭娱乐中,分别定义异常行为;

39、s372、在行为分析模型中设定用于检测异常行为的参数,检测异常行为的参数至少包括人形识别精度阈值、烟雾和火焰图像识别参数及声音识别敏感度;

40、s373、通过行为分析模型检测异常行为,并在检测到异常行为时触发警报;

41、s374、设定警报通知方式,警报通知方式至少包括声音警报、手机app推送、短信通知及邮件通知。

42、可选地,基于行为分析模型、预设规则和历史行为数据,使用ai技术识别异常行为,并记录异常行为信息包括以下步骤:

43、s41、根据历史行为数据和预设规则,从各种来源收集行为数据,并调用行为分析模型;

44、s42、使用行为分析模型对新的行为数据进行分析和预测,依据预设规则和行为分析模型,初步识别潜在的异常行为;

45、s43、根据潜在的异常行为,采用不同的异常检测策略,并根据time评估算法和duration评估算法进行行为评估;

46、s44、当识别异常行为时,根据预设规则,对识别到的异常行为进行处理,并对异常行为进行记录,更新行为分析模型。

47、可选地,使用行为分析模型对新的行为数据进行分析和预测,依据预设规则和行为分析模型,初步识别潜在的异常行为包括以下步骤:

48、s421、从物理层、情境表示层和情境分析层接收实时行为数据,并提取行为数据的特征;

49、s422、根据预设规则和历史行为数据选择行为分析模型;

50、s423、使用行为分析模型对新的行为数据进行分析,评估行为数据与预设规则和历史行为数据的匹配度;

51、s424、对行为分析模型的输出进行解析;

52、s425、识别与正常行为模式不匹配的潜在异常行为,并使用阈值判断行为数据是否异常。

53、可选地,根据潜在的异常行为,采用不同的异常检测策略,并根据time评估算法和duration评估算法进行行为评估包括以下步骤:

54、s431、收集time样本数据,计算time样本数据的平均值和加权平均值,并将time样本数据转换为分钟表示;

55、s432、计算time样本数据的标准差,基于权值确定最小置信区间,并计算置信区间的上下界,建立time模型;

56、s433、收集duration样本数据,使用修正序列数策略确定duration的阈值,并计算duration样本数据中的最大序列数和可控缓冲区,建立duration的规律模型;

57、s434、根据建立的time模型和duration模型,对新收集到的行为数据进行评估,并使用time评估算法检查行为的起始时间是否在正常范围内,同时使用duration评估算法检查行为的持续时间是否超出了正常的阈值;

58、s435、根据time评估算法和duration评估算法评估结果,识别出潜在的异常行为;

59、其中,计算time样本数据的标准差的公式为:

60、

61、式中,sn表示样本数据的标准差;

62、n表示样本数据的个数;

63、timei表示第i个样本数据的时间值;

64、表示样本数据的平均值。

65、根据本发明的另一个方面,还提供了一种基于多场景识别与语音交互的视频监控系统,该系统包括:视频数据采集模块、场景识别模块、行为模型构建模块、异常行为识别模块、通知与交互模块及反馈模块;

66、视频数据采集模块,用于在不同场景中获取摄像头采集的视频监控数据,并对视频监控数据进行预处理;

67、场景识别模块,用于使用深度学习算法分析预处理后的视频监控数据,识别并分类不同的场景类型;

68、行为模型构建模块,用于针对每个识别的场景,分别采用不同的目标检测算法识别视频中的物体,并为每个识别的物体构建行为分析模型;

69、异常行为识别模块,用于基于行为分析模型、预设规则和历史行为数据,使用ai技术识别异常行为,并记录异常行为信息;

70、通知与交互模块,用于将记录的异常行为信息转化为文本,利用tts技术将文本信息转化为语音进行通知,接收并解析通过语音查询的监控信息或报警请求;

71、反馈模块,用于收集异常行为信息和语音指令的反馈,评估并优化行为分析模型。

72、相较于现有技术,本技术具有以下有益效果:

73、1、本发明通过自适应地学习数据特征,cnn模型能够从图像或视频片段中提取出复杂和抽象的特征,对于场景识别和分类至关重要,使用深度学习算法进行场景识别和分类可以实现自动化和高效性,一旦模型被训练和优化,它可以自动处理新的视频监控数据,无需人工干预,深度学习模型具有很好的扩展性,随着数据量的增加,模型的性能通常会提高,随着视频监控数据的积累,不断提升场景识别和分类的准确性,通过识别分类错误的案例,找出模型的不足,然后针对性地对模型进行优化。

74、2、本发明通过为每个场景定制目标检测模型,更准确地识别和追踪视频中的物体,不同的场景可能包含不同类型的物体,使用定制的模型可以更好地适应场景的特性,提高目标检测的精度和效率;其次,通过构建行为分析模型,对物体的行为进行深入的理解和分析,了解物体在视频中的动态行为,识别出异常或者可疑的行为模式,这对于安全监控和预警非常重要;通过设置监控和响应机制,在行为分析模型检测到异常行为时及时触发警报,实时的响应机制可以大大提高视频监控系统的反应速度,缩短发现异常行为到采取行动的时间,有效提高安全防护的效果,最后,通过使用标注的视频数据训练行为分析模型,不断地优化和改进模型的性能,随着数据的积累,模型的预测准确性和鲁棒性会不断提高。

75、3、本发明利用了历史行为数据,预设规则和行为分析模型的信息,提供了一种综合和全面的方式来识别异常行为,提高异常检测的准确性,减少误报和漏报的可能性,提供一种动态的异常检测机制,可以根据实时的行为数据和行为模式的变化进行自我调整和优化,使得异常检测平台能够适应不断变化的环境和行为模式,通过记录异常行为的信息,分析和理解异常行为的原因和模式,从而提供有价值的参考信息,以改进和优化行为分析模型和异常检测策略,通过更新行为分析模型,不仅可以提高模型的预测准确性和鲁棒性,还可以使模型更好地适应新的行为模式和情况,从而持续提高异常检测的性能,总的来说,结合历史行为数据、预设规则和行为分析模型的高效、准确和实时的异常检测方法,这对于提高视频监控系统的性能和安全防护效果至关重要。

- 还没有人留言评论。精彩留言会获得点赞!